Tracks

计算机视觉长期以来都严格区分“生成图像的模型”和“理解图像的模型”。生成式框架主要用于合成,而判别式架构则专注于分类、分割或深度回归。面对任何新的视觉任务,标准做法是选一个架构、挂上任务特定的头部,然后在标注数据上微调。

Google DeepMind 的 Vision Banana 正是在打破这一假设。论文主张,图像生成器已经学到了通用视觉模型所需的一切能力,包括分割、深度、表面法线等。在作者看来,所缺的只是薄薄的一层指令微调,用于让这些潜在能力在基准测试上可度量。

本文将先介绍 Vision Banana 究竟是什么,以及为何它能引发领域关注;随后讲解模型如何工作。最后总结有效之处、局限所在,以及实践者应当汲取的要点。阅读过程中我也会点出自己产生的问题,其他读者大概也会有类似疑问。

说明:Vision Banana 本身尚未公开可用。目前只有论文和项目页面。其基础模型建立在 Nano Banana Pro 之上,可通过 Gemini API 和 Google AI Studio 使用。

什么是 Vision Banana?

Vision Banana 是 Google DeepMind 的研究模型,它以 Nano Banana Pro(文本到图像生成器)为基础,在其原始训练数据混合少量计算机视觉任务数据的组合上,进行轻量级指令微调。

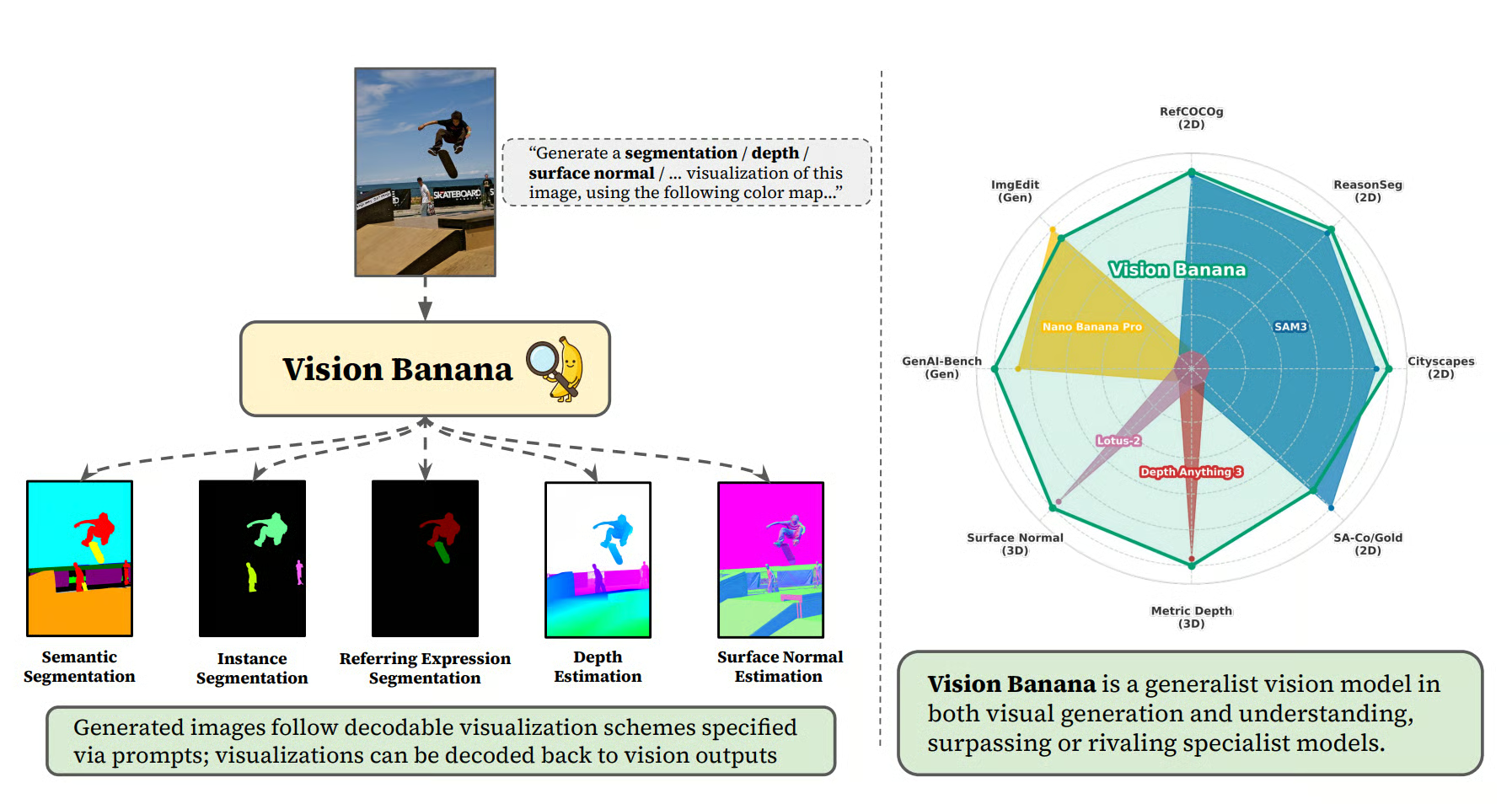

图 1:通过对 Nano Banana Pro 进行指令微调,激发图像生成器隐藏的视觉理解能力(来源)

其方法配方是:

- 保持基础模型架构不变

- 以较低比例将分割、深度和表面法线数据混入训练分布

- 进行指令微调

整个训练方法无需新架构、无需定制头、无需辅助损失、也无需专用解码器。

得到的模型:

- 在三个分割基准上超过 SAM 3

- 在度量深度估计上超过 Depth Anything V3

- 在表面法线估计上超过 Lotus-2

- 保留其基础模型的图像生成质量(在 GenAI-Bench 和 ImgEdit 上统计持平)

以上均在严格的零样本迁移协议下实现,确保模型从未见过所评估基准的训练划分。

为什么这很重要?

视觉表征学习多年来尝试了许多预训练目标。常见的包括:

重要的是,这些都不是生成式的。图像生成在历史上被视为下游能力,而非理解的基础。早期的生成式预训练尝试(iGPT、LVM)在表征质量基准上始终落后于对比方法。

通过下一个词预测扩展生成式自回归目标,催生了 GPT-3 等模型的零样本通才能力。复杂的下游行为被发现潜伏在高维权重空间内,随后经由轻量监督微调与指令对齐被提取出来。例子包括:

- 神经机器翻译

- 多语言代码生成

- 抽象摘要

- 算术推理

Vision Banana 认为,视觉领域正处在类似时刻。论文明确将图像生成预训练类比为语言模型预训练,将指令微调类比为对齐步骤。

若这一类比成立,我们将不再构建任务特定的流水线,而把单个大型图像生成器视作基础层,通过提示来指定任务。

Vision Banana 如何工作?

机制很简单:将每个视觉任务都重述为“生成具有这些属性的 RGB 图像”,并在解码时将该 RGB 图像确定性地还原为任务预测。

各任务的映射如下:

语义分割

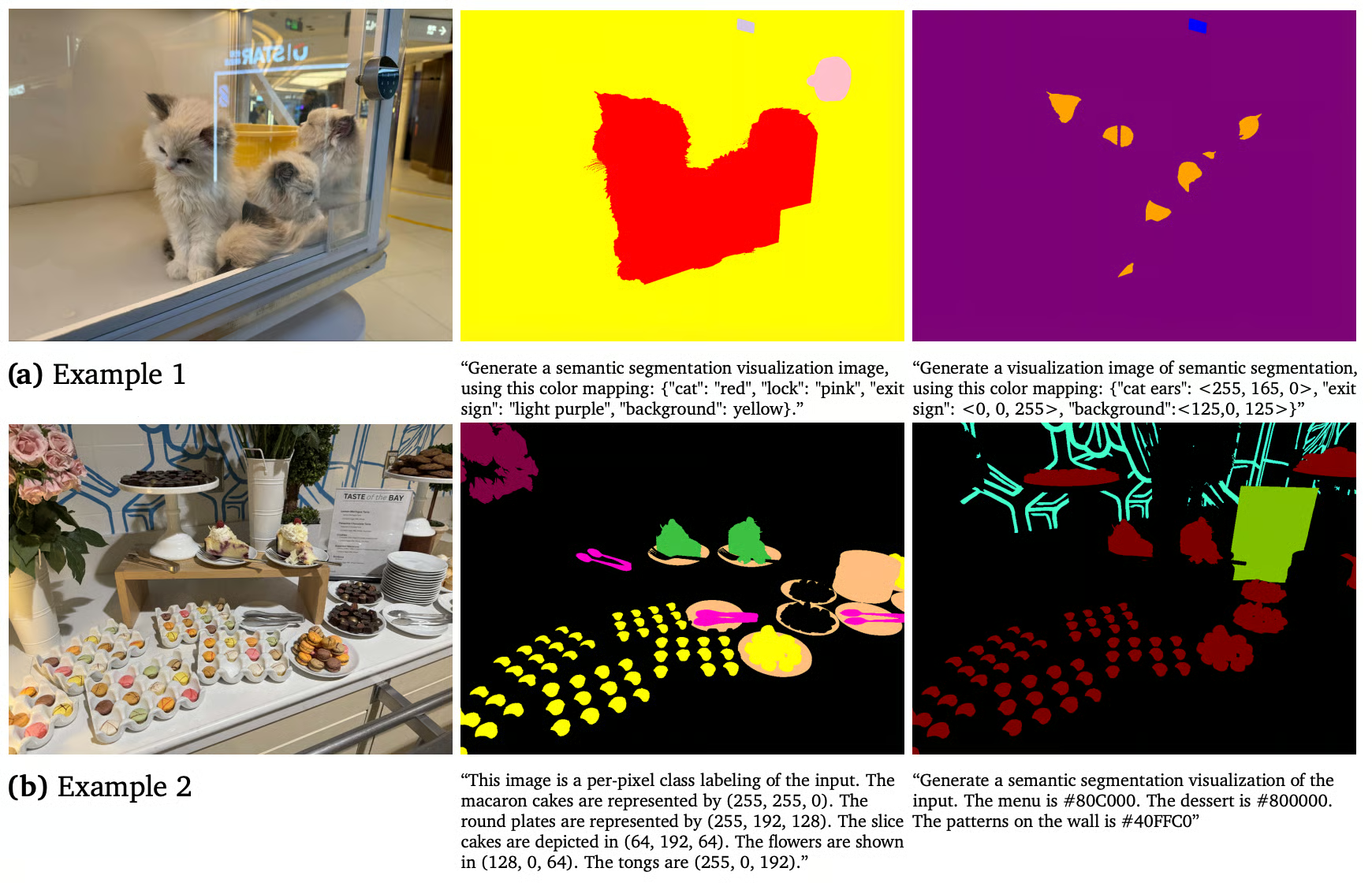

用提示为每个类别指定颜色,在解码时将像素聚类到最近的指定颜色。词汇表由提示决定;按构造即为开放词汇。

看个例子更直观。以下是论文中的一个提示:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

图 2:语义分割(来源)

实例分割

实例分割比语义分割更棘手,因为实例数量事先未知,无法预先分配颜色。

Vision Banana 的做法是每次推理处理一个类别,让模型为不同实例动态分配不同颜色,然后在解码时将像素聚类到颜色模态。

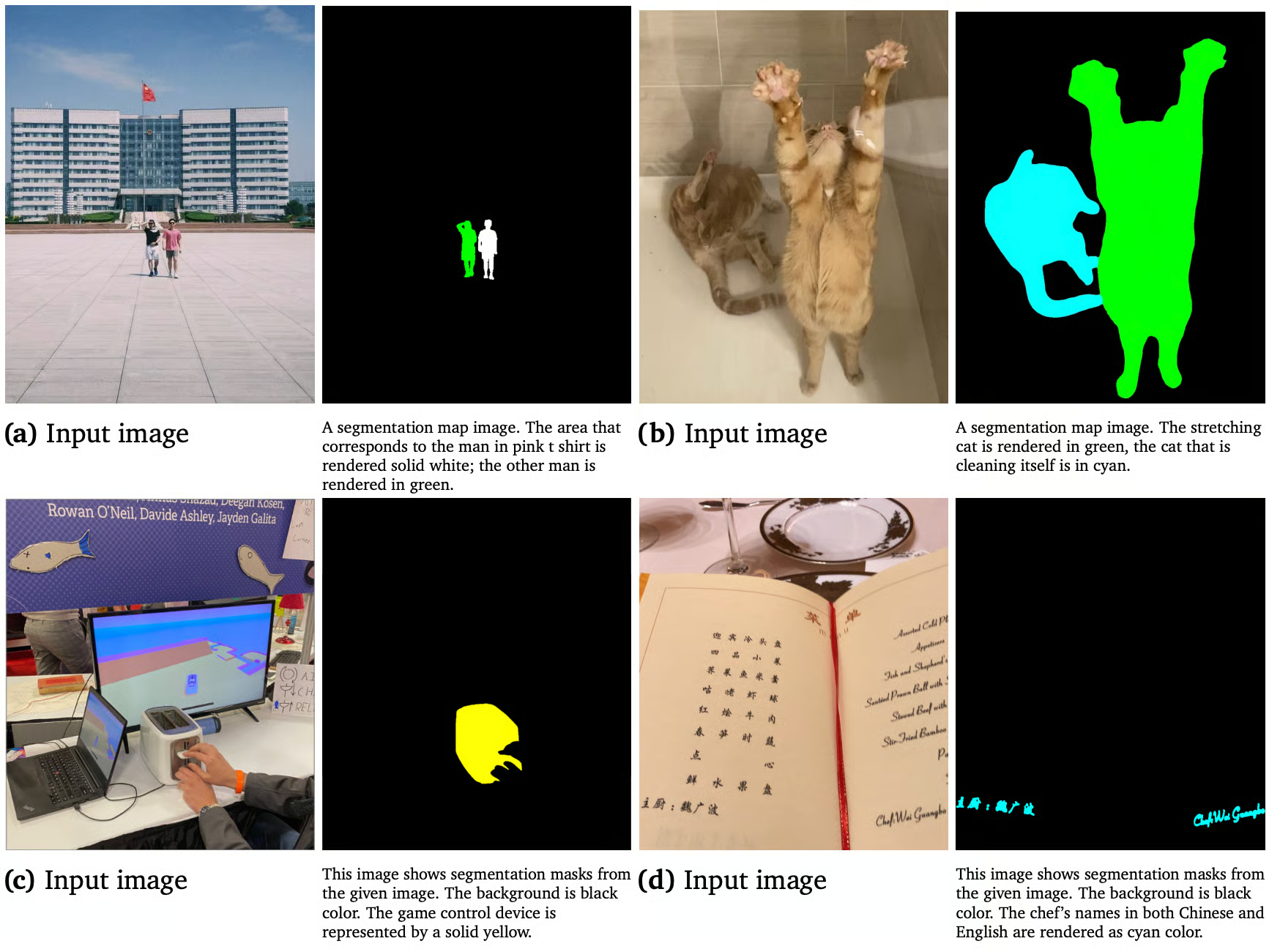

表达式分割

Vision Banana 可接收带有自然语言描述的提示进行分割,并返回掩码。以下是论文中的示例提示:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.这里能体现生成式预训练中多模态推理的优势。判别式模型在指代表达上常常吃力,因为任务需要联合的语言与视觉推理。训练于数十亿配文-图像对的生成式模型对此则更为自然。

图 3:Vision Banana 能理解自然语言提示并进行推理(来源)

深度与表面法线

深度和表面法线都通过双射映射投射到 RGB 空间,确保在变换过程中保持潜在几何属性的零信息损失。下一节我们将剖析深度到 RGB 的具体编码。

这种统一的推理范式将每个计算机视觉任务都视为确定性的图像生成问题。通过在整个流程中保持一致的 RGB 接口,模型避免了任务特定的架构分支,完全依赖提示驱动的条件来定义输出语义。

现在,我们更详细地理解一下深度。 这也是最容易“翻车”的环节。

将无界深度编码到 RGB

如果编码不是双射的,那么在解码时就无法恢复度量距离,“以图像生成作为通用接口”的主张也会随之崩塌。理解这一点很重要,因为它决定了该方法究竟是有原则的,还是权宜之计。

问题在于,深度值是在 [0, ∞) 上的无界实数,而 RGB 则限定在 [0, 1]。因此,若要用“生成深度图”作为训练信号,就需要一个双射映射,使每个度量深度都对应唯一的 RGB 值,并能在解码时反转回米制单位。

Vision Banana 的做法分两步:

第 1 步:将无界深度压缩到 [0, 1)

作者使用Barron(2025)的幂变换,形状参数为 λ = -3,使近距离区域的分辨率高于远距离。2 米远的物体比 200 米远的物体获得更高精度。这与大多数应用的关注点吻合,即可抓取的近景物体,而非远景。

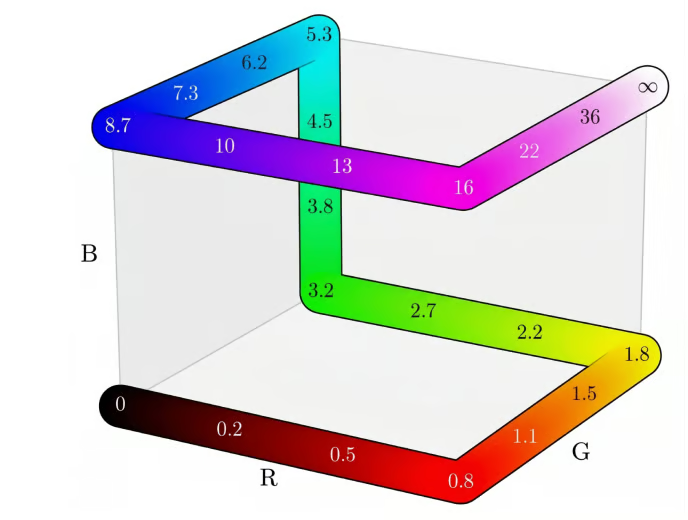

第 2 步:将 [0, 1) 映射到 RGB 立方体边缘

接着,沿着一条分段线性路径在 RGB 立方体边缘上插值,本质上是 3D 希尔伯特曲线的一次迭代。这样可生成平滑、感知上合理的颜色过渡,并且不存在“哪种颜色对应哪一深度”的歧义。

由于两步都严格可逆,复合映射即为双射。训练时用 RGB 编码的真值,在推理时将预测的 RGB 投影到最近的立方体边缘并反转回米制。

图 4:标量度量距离 d ≥ 0 与 RGB 颜色值双射关系的可视化(来源)

为增强鲁棒性,训练中还使用 Plasma、Inferno、Viridis 以及灰度等替代色图进行增强,从而使模型能处理您在提示中要求的任意可视化风格。

表面法线更简单,因为它们本就是 [-1, 1] 上的单位向量,可直接按标准相机坐标约定(+x 向右、+y 向上、+z 垂直画面向外)映射到 RGB。因此,浅绿色表示朝上,偏粉红表示朝左,浅蓝/紫色表示朝向相机,无需变换。

注意:Vision Banana 在任何地方都不使用相机内参,无论训练还是推理。多数 SOTA 深度方法(Depth Anything V3、MoGe-2、UniK3D、DepthLM)都会在某个环节使用内参,因为它们有助于消除单目尺度二义性。

Vision Banana 仅凭视觉先验推断绝对尺度且仍然取胜,是论文中最有力的证据,表明生成式预训练确实在进行几何建模,而不仅仅是在匹配训练中见过的可视化模式。

专用模型 vs Vision Banana:对比

最清晰的比较方式,是在同一任务上直接对比两种范式。这里我们将深度估计在专用范式(Marigold、Lotus、Depth Anything V3)与 Vision Banana 之间进行比较。

两种范式产生不同的产物。Marigold 是专用工具,而 Vision Banana 是通才,其广度来自一次训练步骤。

这些差异会层层传导至实际使用方式:

|

方面 |

专用(Marigold 风格) |

Vision Banana |

|

输出格式 |

任务特定张量 |

RGB 图像 |

|

词汇表 |

训练时固定 |

由提示定义 |

|

多任务 |

每个任务一个模型 |

一个模型,多个任务 |

|

相机内参 |

常常需要 |

不使用 |

|

生成能力 |

微调中丧失 |

得以保留 |

|

推理成本 |

低 |

高(完整图像生成器) |

基准测试既有明显胜出,也有一次坦诚失利。全部在零样本迁移下进行,即模型从未见过评测基准的训练划分。

优势表现:

- 语义分割(Cityscapes):达到 0.699 的平均交并比(mIoU),超过专用的Segment Anything Model(SAM 3)的 0.652。

- 指代表达分割(RefCOCOg):实现 0.738 的 cIoU(累计 IoU),高于 SAM 3 Agent 的 0.734 基线。

- 复杂视觉推理(ReasonSeg):与 Gemini 2.5 Pro 联合使用时,获得 0.793 的 gIoU,超过 SAM 3 Agent 的 0.770,并在零样本设定下刷新 SOTA,甚至超越非零样本、完全监督的方法。

- 度量深度估计:在四个不同数据集上平均

δ(阈值准确率)为 0.929,优于 Depth Anything V3 的 0.918。 - 表面法线估计:在三个室内数据集上的平均角度误差为 15.549°,几何保真度优于 Lotus-2(16.558°)。

劣势表现:

- 实例分割(SA-Co/Gold):在 SA-Co/Gold 的 500 查询样本上评估(非完整基准),成绩为 0.540 pmF1,落后于非零样本的 SAM 3(0.661),与零样本的 DINO-X(0.552)相当。其原因很可能在于为实例基数分配离散颜色的约束,在高密度场景中限制了分辨率。

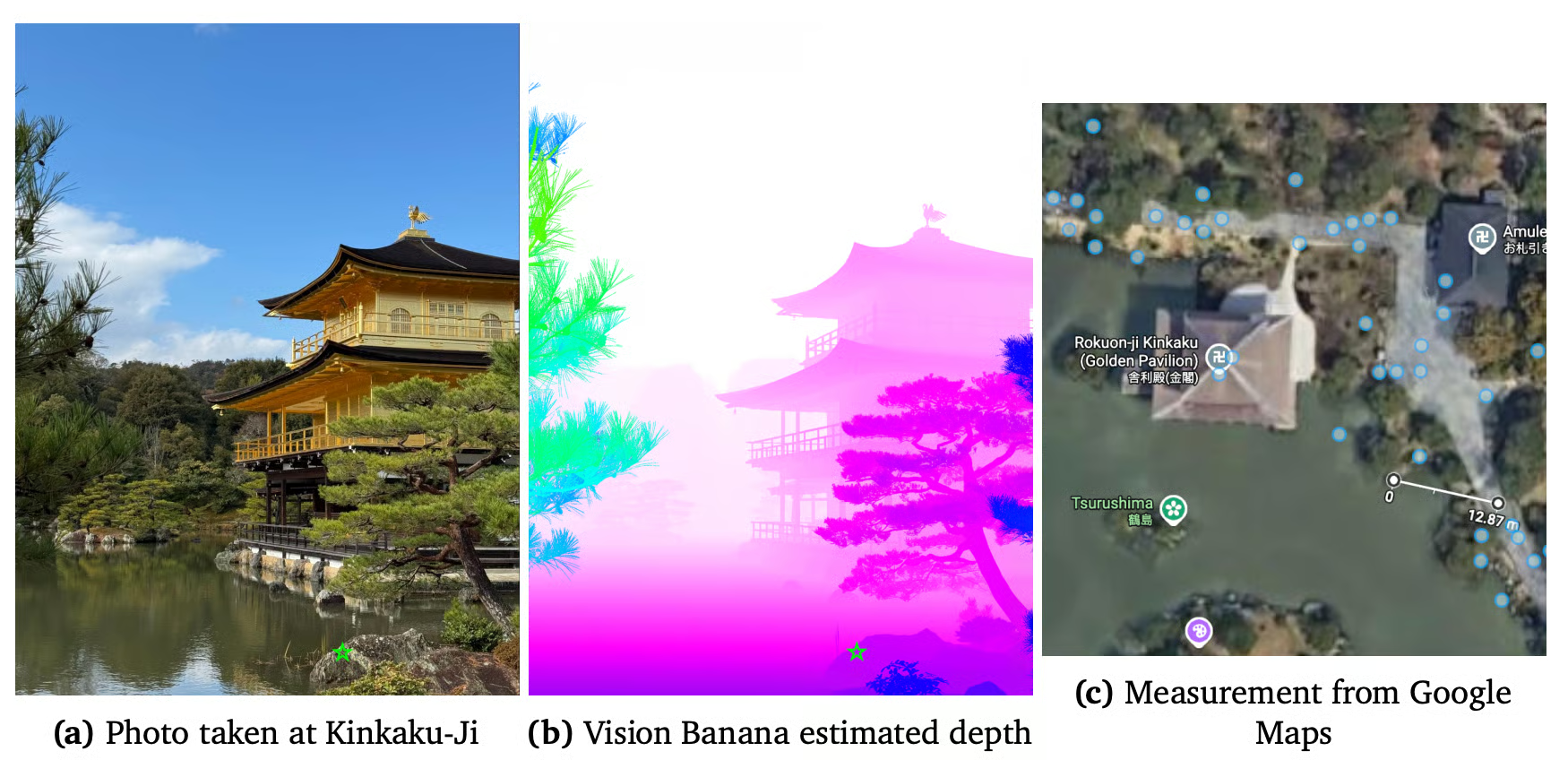

在 GenAI-Bench 上,Vision Banana 在与基础 Nano Banana Pro 的人工对比中赢得 53.5% 的偏好。以下是论文中的一个野外落地测试示例:

图 5:Vision Banana 深度估计(来源)

作者在金阁寺附近用手机拍了一张照片。Vision Banana 预测某点为 13.71 米。Google 地图给出 12.87 米,也就是在无校准、无内参、无设置的手机照片上,绝对相对误差为 6.5%。这种测试比基准分数更能预测真实部署行为。

Vision Banana 的局限

Vision Banana 有四点需要注意的约束,包括:

- 成本:对每次推理都运行一个 Nano Banana Pro 规模的模型,成本远高于运行一个蒸馏后的深度专用模型。论文在“未来工作”部分也直接承认这一点。对于 1 万帧视频,目前这种方法在经济性上并无竞争力。蒸馏为更小的专用模型是顺理成章的下一步。

- 实例密集场景:SA-Co/Gold 是明显短板。按类别分配颜色在需要精确计数的大量小物体时会捉襟见肘。此处 SAM 3 仍占优。

- 单图像:当前模型实现从根本上受限于静态、单视角图像输入,缺乏时空或多视角处理能力。作者将时间维推理列为未来工作。

- 黑盒部署:您无法探查、修改或私有运行模型。这在受监管或知识产权敏感的场景中尤为重要,此类场景无法使用前沿 API。

结语

Vision Banana 清晰地展示了:图像生成器已在为视觉理解承担“重活”,而要显性化这些能力,需要的是对齐,而非新架构。

论文的具体贡献包括:

- 双射的 RGB 编码,使深度与分割成为可逆的图像生成问题

- 轻量级指令微调配方,在不损伤生成先验的前提下增添视觉技能

- 无需相机内参的度量深度估计,效果超越需要内参的专用模型

- 严格的零样本迁移协议,使通才主张能在标准基准上被量化衡量。

论文还倡导一种“生成优先”的心智模型:以提示指定任务、以 RGB 图像解码回输出,并让同一套权重同时负责生成与解析视觉内容。

您可以用项目页面的提示在基础 Nano Banana Pro 或 Nano Banana 2 上试验,看看在不做指令微调的情况下已能获得哪些效果;并可考虑用 NBP 级模型配合多模态 LLM 路由器来构建“推理-分割”功能,而不是直接训练定制流水线。

Vision Banana 常见问答

我今天如何使用 Vision Banana?

目前不能。论文与项目页面已经发布,但模型权重仍在 Google DeepMind。基础模型 Nano Banana Pro 可通过 Gemini API 和 AI Studio 使用,而论文本身的观点也表明,直接用项目页面的提示对 NBP 进行提示,已应能产生有意义的结果。

Vision Banana 能取代 SAM 3 或 Depth Anything 吗?

目前还不行,主要因为成本。对于需要以低成本大规模运行视觉推理的应用(视频、实时、移动端),专用模型在经济性上仍占优势。

它与 GPT-5V 或 Gemini 2.5 等多模态大模型相比如何?

多模态 LLM 接收图像并输出文本。Vision Banana 接收图像与提示并输出图像。两者解决的问题不同。

为何 Vision Banana 在深度估计中不使用相机内参?

多数专用模型使用内参来消除单目尺度二义性(近处小物体与远处大物体可能产生相同像素)。而 Vision Banana 则依托生成式预训练中学到的关于物体大小、场景上下文与世界知识的视觉先验来推断尺度。