Leerpad

Computervisie werkte altijd met een duidelijke scheiding tussen modellen die afbeeldingen produceren en modellen die ze begrijpen. Generatieve frameworks waren de primaire bronnen voor synthese, terwijl discriminerende architecturen zich richtten op classificatie, segmentatie of diepte-regressie. Het standaardrecept voor een nieuwe visietaak was: kies een architectuur, koppel er een taakspecifieke head aan en finetune op gelabelde data.

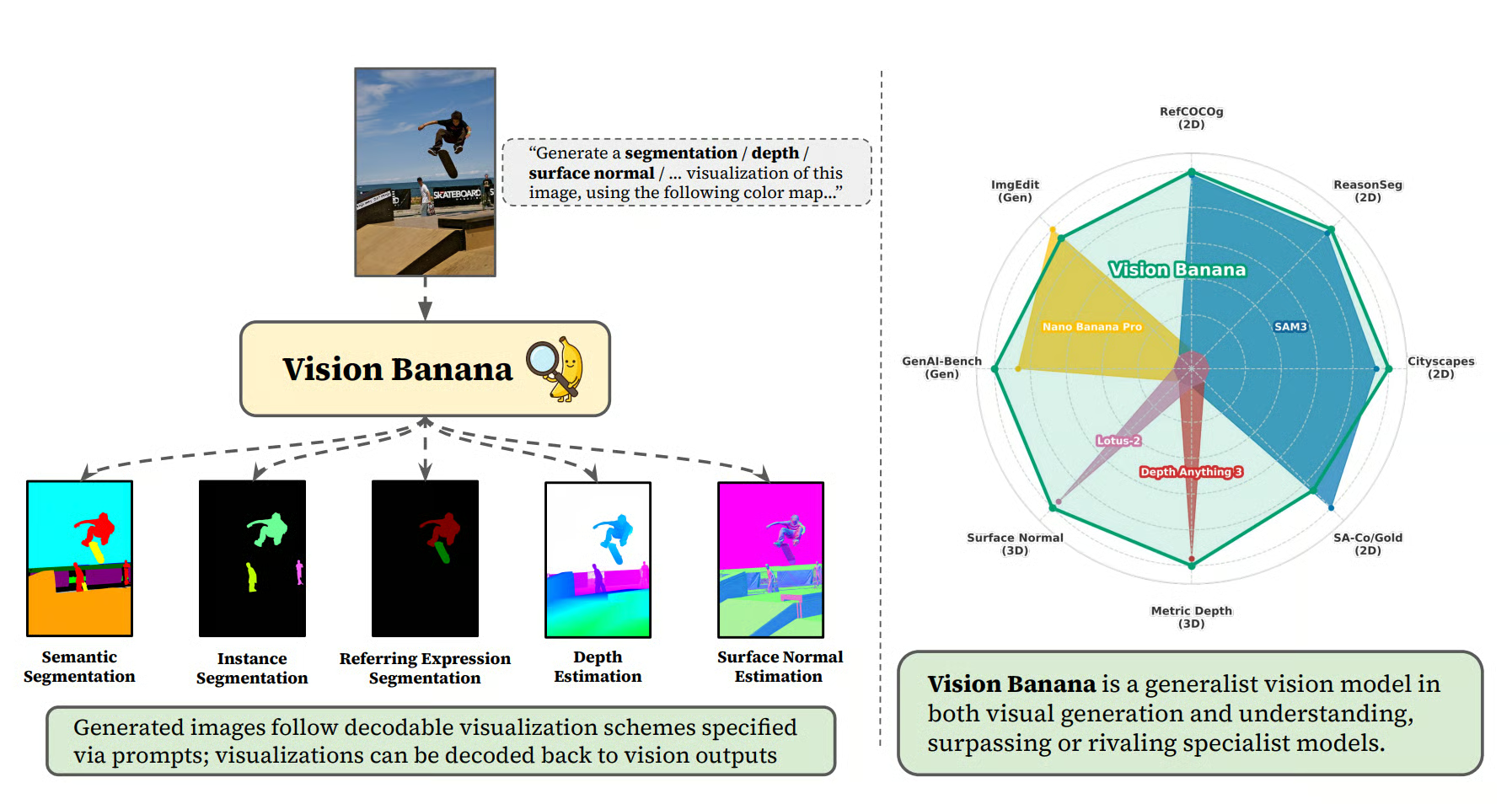

Precies die aanname is wat Vision Banana van Google DeepMind wil doorbreken. Het artikel stelt dat afbeeldingsgeneratoren al alles hebben geleerd wat een generalistisch visiemodel nodig heeft, inclusief segmentatie, diepte, oppervlaknormaalvectoren en meer. Volgens de auteurs ontbreekt er alleen nog een dunne laag met instruction tuning om die latente vaardigheden meetbaar te maken op benchmarks.

In deze post begin ik met wat Vision Banana eigenlijk is en waarom het artikel de aandacht van het veld heeft getrokken, daarna loop ik door hoe het model werkt. Ik eindig met wat wél werkt, wat niet, en wat practitioners hieruit kunnen meenemen. Onderweg licht ik de vragen uit die ik had tijdens het lezen; andere lezers zullen waarschijnlijk dezelfde hebben.

Opmerking: Vision Banana zelf is niet publiek toegankelijk. Wat er is, zijn het paper en de projectpagina. Het basismodel is gebouwd op Nano Banana Pro en is beschikbaar via de Gemini API en Google AI Studio.

Wat is Vision Banana?

Vision Banana is een onderzoeksmodel van Google DeepMind, gebouwd door Nano Banana Pro (tekst-naar-beeldgenerator) te nemen en lichte instruction tuning toe te passen op een mix van de oorspronkelijke trainingsdata, aangevuld met een kleine hoeveelheid data voor computervisie-taken.

Figuur 1: Verborgen visuele begripsvaardigheden van beeldgeneratoren door Nano Banana Pro met instruction tuning (Bron)

Het recept is:

- Laat de basisarchitectuur van het model ongewijzigd

- Mix segmentatie-, diepte- en oppervlaknormaal-data op lage ratio in de trainingsdistributie

- Instruction-tune

De volledige trainingsmethodologie vereist geen nieuwe architectuur, geen custom heads, geen nevenverliezen en geen gespecialiseerde decoders.

Het resulterende model:

- Verslaat SAM 3 op drie segmentatiebenchmarks

- Verslaat Depth Anything V3 op metrische diepteschatting

- Verslaat Lotus-2 op schatting van oppervlaknormaalvectoren

- Behoudt de afbeeldingsgeneratiekwaliteit van het basismodel (statistische gelijkstand op GenAI-Bench en ImgEdit)

Dit alles wordt bereikt onder een strikt zero-shot transfer-protocol, wat garandeert dat het model de trainingssplits van de benchmarks waarop het wordt geëvalueerd nooit heeft gezien.

Waarom is dit belangrijk?

Visuele representatieleren heeft door de jaren heen veel pretraining-doelen geprobeerd. Veelvoorkomende zijn:

- Gecodeerd leren (ImageNet, JFT)

- Contrastief leren (CLIP, SigLIP)

- Self-distillation (DINO, DINOv2)

- Masked autoencoding (MAE, BEiT)

Belangrijk is dat geen van deze generatief is. Afbeeldingsgeneratie werd historisch gezien als een downstream-vaardigheid, niet als fundament voor begrip. Vroege generatieve pretraining-pogingen (iGPT, LVM) bleven consequent achter op contrastieve methoden op representatiekwaliteitsbenchmarks.

Het opschalen van generatieve autoregressieve doelen via next-token-predictie katalyseerde het ontstaan van zero-shot generalistische capaciteiten in modellen zoals GPT-3. Complexe downstream-gedragingen bleken latent aanwezig in de hoogdimensionale gewichtsruimte en werden vervolgens naar boven gehaald via lichte supervised fine-tuning en instruction alignment. Voorbeelden zijn:

- Neurale machinevertaling

- Polyglotte codegeneratie

- Abstracte samenvatting

- Rekenkundig redeneren

Vision Banana betoogt dat we voor visie op hetzelfde punt staan. Het artikel trekt expliciet een analogie tussen pretraining voor afbeeldingsgeneratie en pretraining van taalmodellen, en tussen instruction tuning en de alignmentstap.

Als die analogie standhoudt, stoppen we met het bouwen van taakspecifieke pijplijnen en behandelen we één grote afbeeldingsgenerator als de fundamentlaag, waarbij we taken via prompts specificeren.

Hoe werkt Vision Banana?

Het mechanisme is eenvoudig: elke visietaak wordt herkadert als "genereer een RGB-afbeelding met deze eigenschappen", en bij decoderen zet je die RGB-afbeelding deterministisch terug naar taakvoorspellingen.

Zo mapt elke taak:

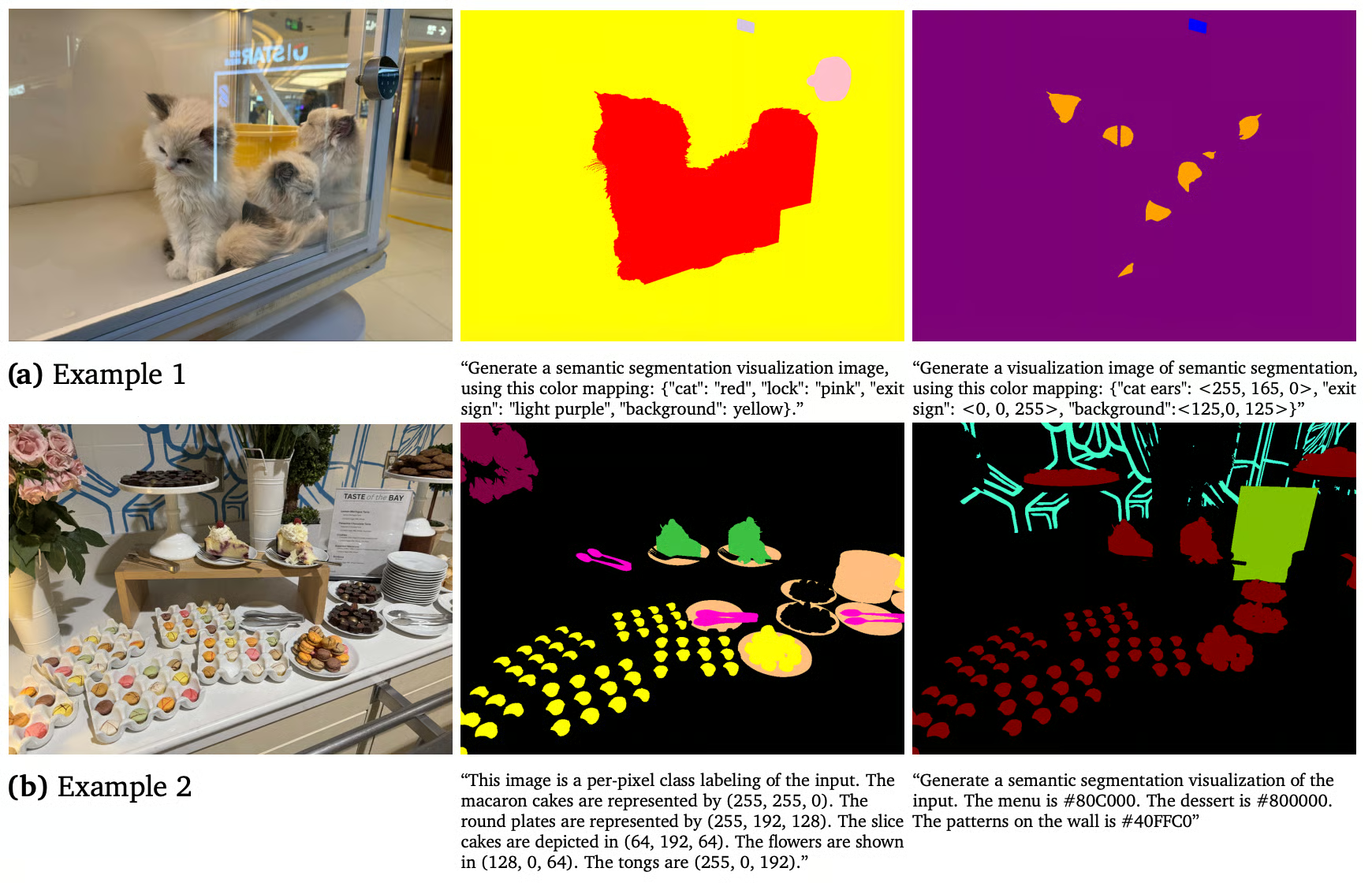

Semantische segmentatie

Geef het model per-klasse kleurtoewijzingen als prompt, en cluster bij decoderen pixels naar de dichtstbijzijnde opgegeven kleur. De woordenschat is wat je in de prompt zet; hij is per definitie open-vocabulary.

Het wordt duidelijker met een voorbeeld. Hier is een prompt uit het paper:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Figuur 2: Semantische segmentatie (Bron)

Instance-segmentatie

Instance-segmentatie is lastiger dan semantische segmentatie, omdat het aantal instanties vooraf niet bekend is. Je kunt dus geen kleuren vooraf toewijzen.

De oplossing van Vision Banana is: één klasse per inferentie, laat het model dynamisch verschillende kleuren aan verschillende instanties toewijzen, en cluster vervolgens pixels bij decoderen naar kleurmodi.

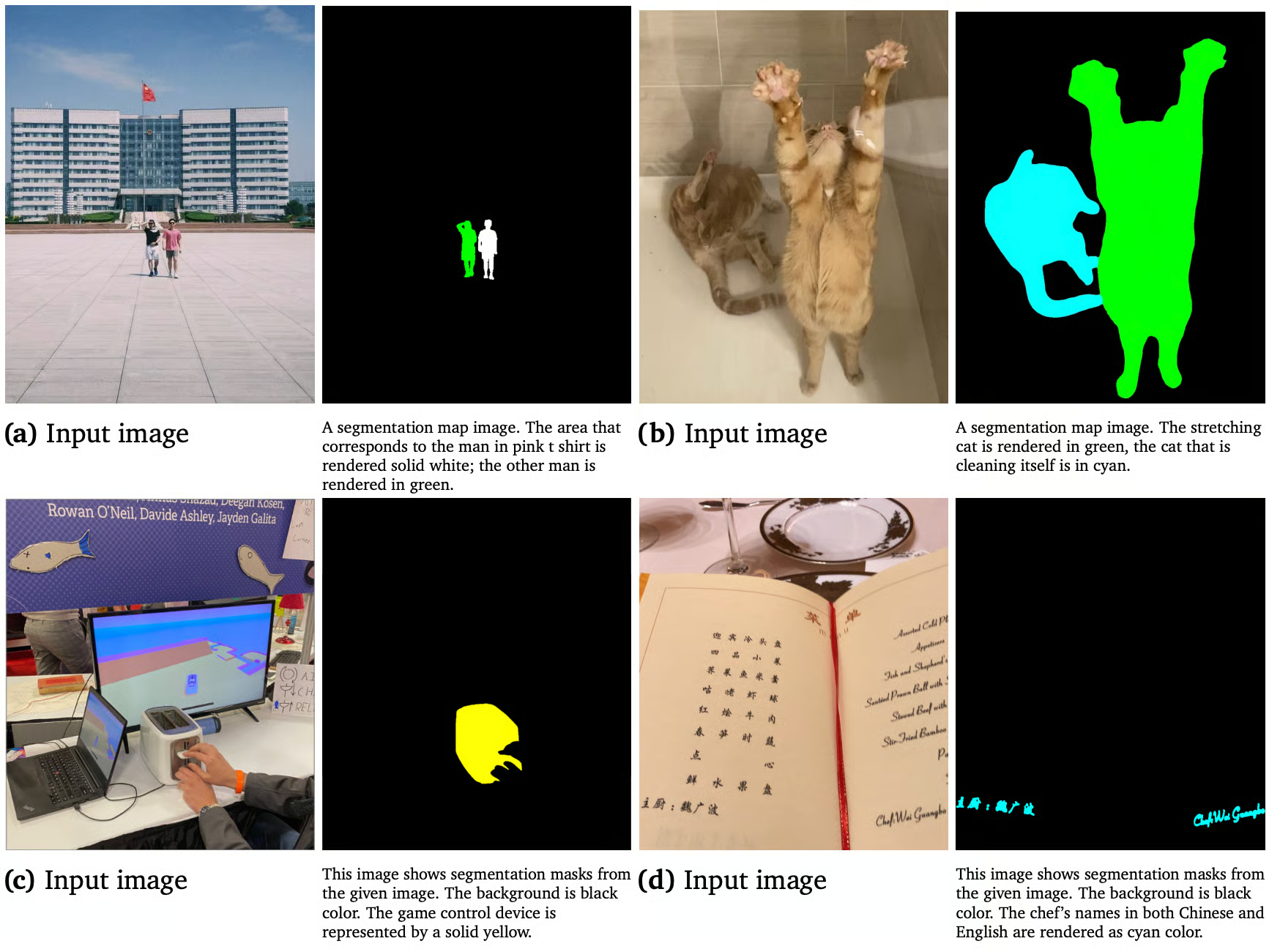

Expression-segmentatie

Vision Banana kan een prompt met een natuurlijke-taalbeschrijving van wat je wilt segmenteren gebruiken en een masker teruggeven. Hier is een voorbeeldprompt uit het paper:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Hier schittert de multimodale redenering die in generatieve pretraining is ingebakken. Discriminerende modellen worstelen met verwijzende expressies omdat de taak gezamenlijke linguïstische en visuele redenering vereist. Generatieve modellen die zijn getraind op miljarden paren van bijschriften en beelden pakken dit van nature op.

Figuur 3: Vision Banana begrijpt prompts in natuurlijke taal en kan erover redeneren (Bron)

Diepte en oppervlaknormaalvectoren

Zowel diepte als oppervlaknormaalvectoren worden via bijectieve mappings naar de RGB-ruimte geprojecteerd, zodat de latente geometrische eigenschappen behouden blijven met nul informatieverlies tijdens de transformatie. In de volgende sectie ontleden we de details van de diepte-naar-RGB-codering.

Dit uniforme inferentieparadigma behandelt elke computervisie-taak als een deterministisch afbeeldingsgeneratieprobleem. Door een consistente RGB-interface in de hele pijplijn te behouden, vermijdt het model taakspecifieke architecturale vertakkingen en vertrouwt het volledig op promptgestuurde conditionering om de outputsemantiek te definiëren.

Laten we diepte nu iets gedetailleerder begrijpen. Dit is het deel waar de hele aanpak het gemakkelijkst kan stuklopen.

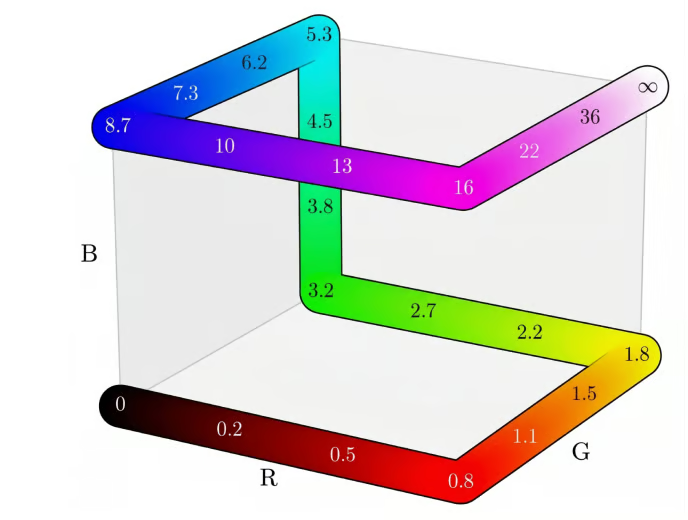

Onbegrensde diepte coderen in RGB

Als de codering niet bijectief is, kun je metrische afstanden bij decoderen niet terugwinnen, en valt de hele claim van "afbeeldingsgeneratie als universele interface" in duigen. Dit is het begrijpen waard, omdat het je vertelt of de aanpak principieel is of een hack.

Het probleem is dat dieptewaarden onbegrensde reële getallen in [0, ∞) zijn, terwijl RGB begrensd is tot [0, 1]. Dus, om "genereer de dieptekaart" als trainingssignaal te gebruiken, heb je een bijectieve mapping nodig waarbij elke metrische diepte naar precies één RGB-waarde mapt, en je deze bij decoderen terug kunt inverteren naar meters.

De aanpak van Vision Banana kent twee stadia:

Fase 1: Onbegrensde diepte comprimeren naar [0, 1)

De auteurs gebruiken Barrons (2025) power transform met vormparameter λ = -3, wat nabijgelegen gebieden meer resolutie geeft dan verafgelegen. Een object op 2 meter krijgt meer precisie dan een object op 200 meter. Dit sluit aan bij de meeste toepassingen, namelijk grijpbare objecten, niet verre.

Fase 2: [0, 1) mappen op de randen van de RGB-kubus

Vervolgens interpoleren ze langs een stukgewijze lineair pad dat de randen van de RGB-kubus volgt, in essentie de eerste iteratie van een 3D-Hilbert-curve. Dit levert vloeiende, perceptueel zinvolle kleurtransities op zonder ambiguïteit over welke kleur bij welke diepte hoort.

Omdat beide stadia strikt omkeerbaar zijn, is de samenstelling een bijectie. Ze trainen dan op RGB-gecodeerde ground truth, en projecteren bij inferentie de voorspelde RGB op de dichtstbijzijnde kubusrand en inverteren terug naar meters.

Figuur 4: Een visualisatie van onze bijectie tussen scalair metrische afstanden 𝑑 ≥ 0 en RGB-kleurwaarden (Bron)

Voor robuustheid wordt tijdens training aangevuld met alternatieve kleurkaarten zoals Plasma, Inferno, Viridis en grijswaarden, zodat het model de visualisatiestijl aankan die je in de prompt vraagt.

Oppervlaknormaalvectoren zijn eenvoudiger omdat het al eenheidsvectoren zijn met componenten in [-1, 1], wat direct naar RGB mapt met de standaard cameraspace-conventie (+x rechts, +y omhoog, +z uit het beeldvlak). Lichtgroen betekent naar boven gericht, roze-rood betekent naar links gericht en lichtblauw/paars betekent naar de camera gericht. Geen warp nodig.

Opmerking: Vision Banana gebruikt geen camera-intrinsieken, noch in training noch in inferentie. De meeste SOTA-dieptemethoden (Depth Anything V3, MoGe-2, UniK3D, DepthLM) gebruiken ergens in de lus intrinsieken omdat die helpen monoculaire schaal te ontwarren.

Dat Vision Banana absolute schaal afleidt uit alleen visuele priors, en toch wint, is het sterkste bewijs in het artikel dat de generatieve pretraining geometrisch werk doet en niet slechts visualisaties napapegaait die het tijdens training zag.

Specialisten vs. Vision Banana: een vergelijking

De schoonste manier om het verschil te zien is de twee paradigma's direct op één taak te vergelijken. Laten we diepteschatting vergelijken met de specialistische aanpak (Marigold, Lotus, Depth Anything V3) en Vision Banana.

De twee paradigma's produceren verschillende artefacten. Marigold is een gespecialiseerd gereedschap, terwijl Vision Banana een generalist is wiens breedte uit één enkele trainingsstap komt.

De verschillen werken door in hoe het model in de praktijk wordt gebruikt:

|

Aspect |

Specialist (Marigold-stijl) |

Vision Banana |

|

Outputformaat |

Taakspecifieke tensor |

RGB-afbeelding |

|

Woordenlijst |

Vastgezet bij training |

Gedefinieerd in prompt |

|

Multitask |

Eén model per taak |

Eén model, veel taken |

|

Camera-intrinsieken |

Vaak vereist |

Niet gebruikt |

|

Generatiecapaciteit |

Gaat verloren bij finetunen |

Behoudt |

|

Infrentiekosten |

Laag |

Hoog (volledige afbeeldingsgenerator) |

De benchmarks zijn een mix van duidelijke overwinningen en één eerlijke nederlaag. Allemaal onder zero-shot transfer, dus het model heeft de trainingssplits van de evaluatiebenchmarks nooit gezien.

Sterke prestatieprofielen:

- Semantische segmentatie (Cityscapes): Behaalde 0,699 mean Intersection over Union (mIoU), beter dan het gespecialiseerde Segment Anything Model (SAM 3) met 0,652.

- Referring-segmentatie (RefCOCOg): Liet 0,738 cIoU (cumulative IoU) zien, beter dan de SAM 3 Agent-baseline van 0,734.

- Complex visueel redeneren (ReasonSeg): In combinatie met Gemini 2.5 Pro behaalde het 0,793 gIoU, beter dan de 0,770 van de SAM 3 Agent en een nieuwe zero-shot state-of-the-art, zelfs ten opzichte van niet-zero-shot, volledig gesuperviseerde methoden.

- Metrische diepteschatting: Noteerde een gemiddelde

δ(drempelnauwkeurigheid) van 0,929 over vier diverse datasets, een verbetering ten opzichte van Depth Anything V3 met 0,918. - Oppervlaknormaalvectoren: Gaf een lagere gemiddelde hoekfout van 15,549° over drie indoor-datasets, wat superieure geometrische getrouwheid toont vergeleken met Lotus-2 (16,558°).

Prestatieverlies:

- Instance-segmentatie (SA-Co/Gold): 0,540 pmF1 (geëvalueerd op een steekproef van 500 queries van SA-Co/Gold, niet de volledige benchmark), achter de niet-zero-shot SAM 3 (0,661) en vergelijkbaar met de zero-shot DINO-X (0,552). Dit komt waarschijnlijk door de beperking van discrete kleurtoewijzing voor het aantal instanties, wat de resolutie beperkt in zeer dichte scènes.

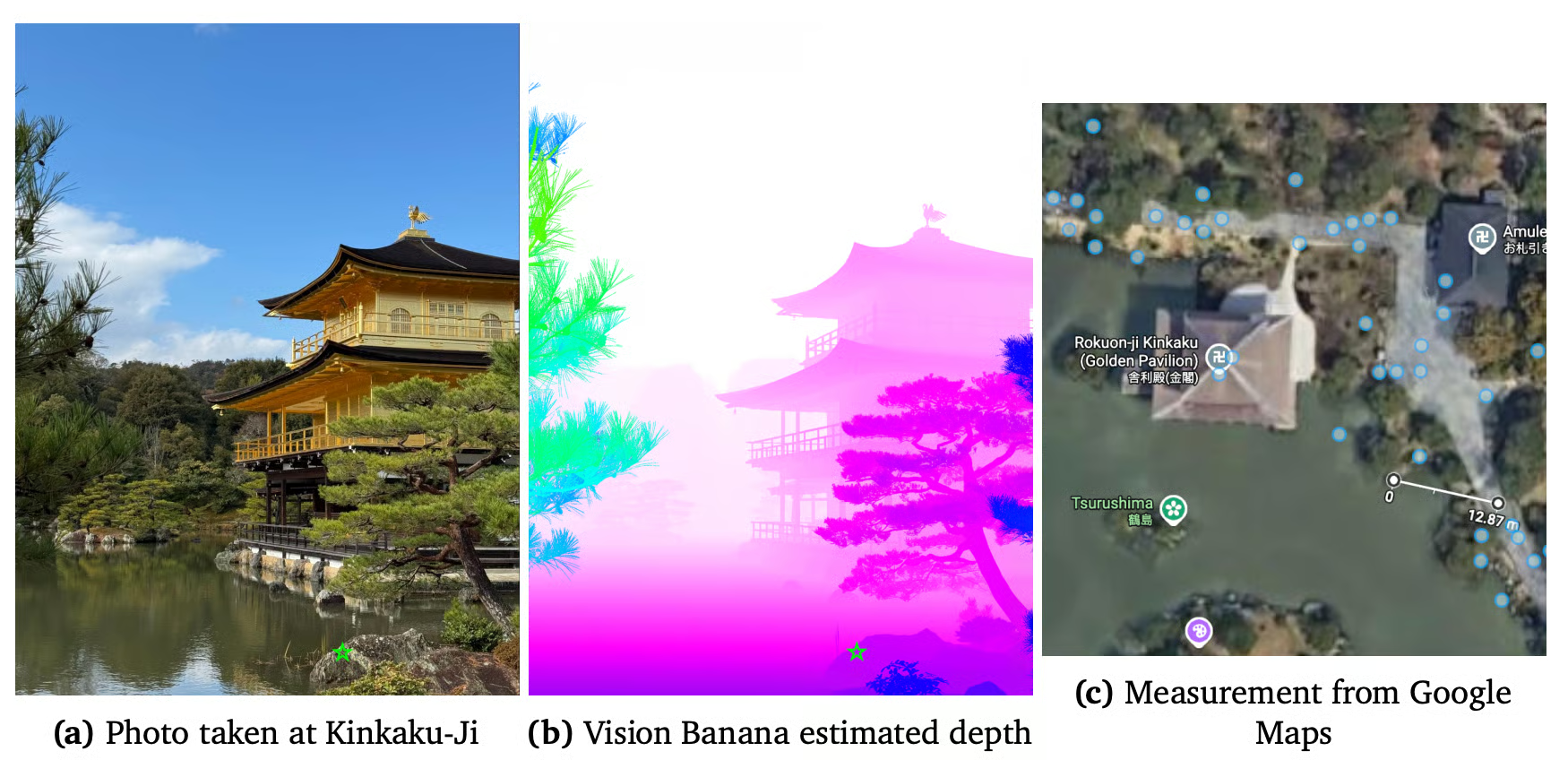

Op GenAI-Bench wint Vision Banana 53,5% van de menselijke vergelijkingen tegen de base Nano Banana Pro. Hier is een voorbeeld van een in-the-wild groundingtest uit het paper:

Figuur 5: Vision Banana diepteschatting (Bron)

Een auteur maakte een smartphonefoto bij Kinkaku-Ji. Vision Banana voorspelde een specifiek punt op 13,71 meter. Google Maps zegt 12,87, wat neerkomt op 6,5% absolute relatieve fout bij een telefoonfoto zonder calibratie, zonder intrinsieken, zonder setup. Dat is het soort test dat het implementatiegedrag betrouwbaarder voorspelt dan benchmarkcijfers.

Beperkingen van Vision Banana

Vision Banana heeft vier beperkingen die het vermelden waard zijn. Dit zijn:

- Kosten: Een model op schaal Nano Banana Pro voor elke inferentie draaien is aanzienlijk duurder dan een gedistilleerde dieptespecialist draaien. Het artikel erkent dit direct in de sectie Toekomstig Werk. Voor 10K videoframes is deze aanpak vandaag economisch niet concurrerend. Distillatie naar kleinere specialisten is de logische volgende stap.

- Scènes met veel instanties: SA-Co/Gold is de duidelijke nederlaag. Per-klasse kleurtoewijzing raakt aan z'n plafond wanneer veel kleine objecten precies geteld moeten worden. SAM 3 wint hier nog steeds.

- Enkele afbeelding: De huidige modelimplementatie is fundamenteel beperkt tot statische inputs met één aanzicht en mist de capaciteit voor spatio-temporele of multi-view verwerking. Temporele redenering is door de auteurs aangewezen als toekomstig werk.

- Black-box implementatie: Je kunt het model niet onderzoeken, aanpassen of privé draaien. Dit is belangrijk in gereguleerde of IP-gevoelige contexten waar het draaien van een frontier-API geen optie is.

Slotgedachten

Vision Banana is een concreet bewijs dat afbeeldingsgeneratoren het zware werk voor visueel begrip al doen, en dat het naar boven halen van die capaciteiten alignment vergt in plaats van nieuwe architecturen.

De specifieke bijdragen van het artikel zijn

- Bijectieve RGB-codering die diepte en segmentatie tot omkeerbare afbeeldingsgeneratieproblemen maakt

- Lichte instruction-tuning-receptuur die visie-vaardigheden toevoegt zonder de generatieve prior te verbranden

- Metrische diepteschatting zonder camera-intrinsieken die specialisten verslaat, die ze wel nodig hebben

- Strikt zero-shot transfer-protocol dat de generalistische claim meetbaar maakt op standaardbenchmarks.

Het artikel promoot ook een generatie-first denkkader waarin taken worden gespecificeerd via een prompt en outputs worden teruggedecodeerd uit RGB-afbeeldingen, en waarin dezelfde gewichten zowel het produceren als het parsen van visuele content afhandelen.

Je kunt de prompts van de projectpagina testen tegen de basis-Nano Banana Pro of Nano Banana 2 om te zien wat er zonder instruction tuning al mogelijk is, en reasoning-segmentatiefuncties bouwen met NBP-klasse modellen en een multimodale LLM-router in plaats van direct custom pijplijnen te trainen.

Vision Banana FAQ's

Hoe kan ik Vision Banana vandaag gebruiken?

Nee. Het paper en de projectpagina zijn beschikbaar, maar de modelgewichten staan bij Google DeepMind. Het basismodel, Nano Banana Pro, is beschikbaar in de Gemini API en AI Studio, en de centrale these van het paper suggereert dat NBP direct prompten met de prompts van de projectpagina nu al betekenisvolle resultaten zou moeten opleveren.

Kan Vision Banana SAM 3 of Depth Anything vervangen?

Vandaag nog niet, vooral vanwege de kosten. Voor toepassingen waar je visie-inferentie goedkoop op schaal moet draaien (video, real-time, mobiel), winnen specialisten het nog steeds op economie.

Hoe verhoudt dit zich tot MLLM's zoals GPT-5V of Gemini 2.5?

Multimodale LLM's nemen een afbeelding en produceren tekst. Vision Banana neemt een afbeelding en een prompt om een afbeelding te produceren. Ze lossen verschillende problemen op.

Waarom gebruikt Vision Banana geen camera-intrinsieken voor diepte?

De meeste specialisten gebruiken intrinsieken om monoculaire schaal te ontwarren (een klein object dichtbij en een groot object ver weg kunnen identieke pixels opleveren). Vision Banana leidt schaal echter af uit visuele priors die zijn geleerd tijdens generatieve pretraining over objectgroottes, scènecontext en wereldkennis.

Ik ben een Google Developers Expert in ML (Gen AI), een Kaggle 3x Expert en een Women Techmakers Ambassador met meer dan 3 jaar ervaring in tech. In 2020 heb ik een healthtech-startup mee opgericht en ik volg een master computer science aan Georgia Tech, met als specialisatie machine learning.