Programma

La computer vision ha sempre mantenuto una netta separazione tra modelli che producono immagini e modelli che le comprendono. I framework generativi erano le fonti principali per la sintesi, mentre le architetture discriminative si concentravano su classificazione, segmentazione o stima della profondità. Il copione standard per qualsiasi nuovo compito di visione era scegliere un’architettura, agganciare una testa specifica per il task e fare finetuning su dati etichettati.

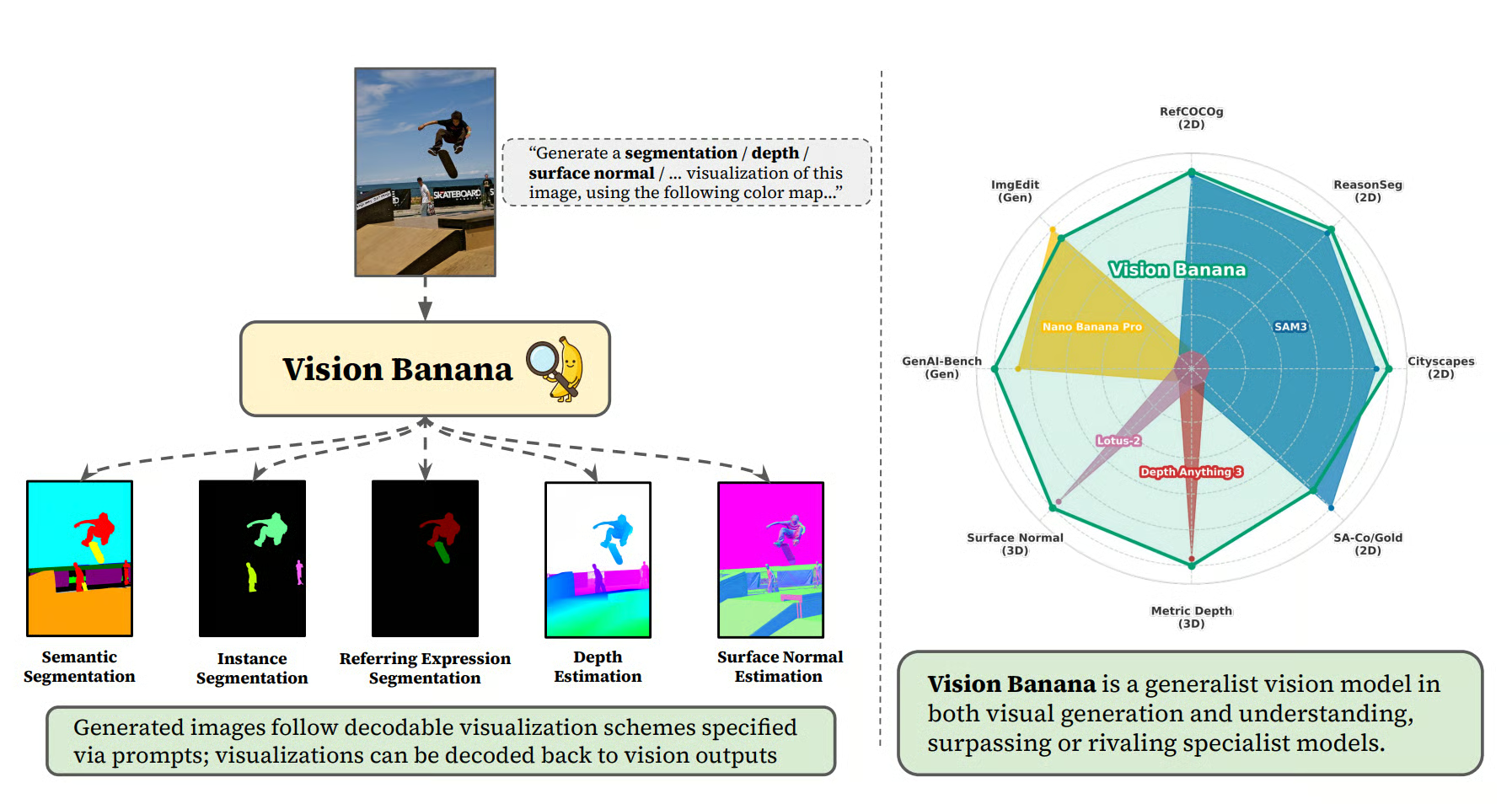

È proprio questa assunzione che Vision Banana di Google DeepMind vuole ribaltare. L’articolo sostiene che i generatori di immagini abbiano già imparato tutto ciò che serve a un modello di visione generalista, inclusi segmentazione, profondità, normali di superficie e altro. Secondo gli autori, tutto ciò che manca è un sottile strato di instruction tuning per rendere queste capacità latenti misurabili sui benchmark.

In questo post, parto da che cos’è davvero Vision Banana e perché ha attirato l’attenzione del settore, poi spiego come funziona il modello. Chiudo con cosa funziona, cosa no e cosa dovrebbe portarsi a casa chi pratica sul campo. Lungo il percorso, farò emergere le domande che mi sono posto leggendo il paper. Probabilmente saranno le stesse di altri lettori.

Nota: Vision Banana in sé non è accessibile pubblicamente. Sono disponibili il paper e la pagina del progetto. Il modello di base è costruito su Nano Banana Pro ed è disponibile tramite le API di Gemini e Google AI Studio.

Che cos’è Vision Banana?

Vision Banana è un modello di ricerca di Google DeepMind, ottenuto prendendo Nano Banana Pro (generatore testo-immagine) e applicando un instruction tuning leggero su un mix dei suoi dati di training originali insieme a una piccola quantità di dati per compiti di computer vision.

Figura 1: Capacità latenti di comprensione visiva dei generatori di immagini tramite instruction-tuning di Nano Banana Pro (Fonte)

La ricetta è:

- Mantenere invariata l’architettura del modello base

- Mischiare dati di segmentazione, profondità e normali di superficie nella distribuzione di training a bassa proporzione

- Fare instruction tuning

L’intera metodologia di training non richiede nuove architetture, né teste personalizzate, né loss ausiliarie, né decoder specializzati.

Il modello risultante:

- Supera SAM 3 su tre benchmark di segmentazione

- Supera Depth Anything V3 nella stima metrica della profondità

- Supera Lotus-2 nella stima delle normali di superficie

- Conserva la qualità di generazione immagini del modello base (pareggio statistico su GenAI-Bench e ImgEdit)

Tutto ciò viene ottenuto sotto un rigoroso protocollo di trasferimento zero-shot, assicurando che il modello non abbia mai visto gli split di training dei benchmark su cui viene valutato.

Perché è importante?

Nel corso degli anni, l’apprendimento di rappresentazioni visive ha sperimentato molti obiettivi di pretraining. Tra i più comuni:

- Classificazione supervisionata (ImageNet, JFT)

- Apprendimento contrastivo (CLIP, SigLIP)

- Auto-distillazione (DINO, DINOv2)

- Masked autoencoding (MAE, BEiT)

Ciò che conta è che nessuno di questi è generativo. La generazione di immagini è stata storicamente trattata come capacità a valle, non come base per la comprensione. I primi tentativi di pretraining generativo (iGPT, LVM) sono rimasti costantemente indietro rispetto ai metodi contrastivi sui benchmark di qualità delle rappresentazioni.

La scalata degli obiettivi generativi autoregressivi tramite la predizione del prossimo token ha catalizzato l’emergere di capacità generaliste zero-shot in modelli come GPT-3. Si è scoperto che comportamenti complessi a valle erano latenti nell’alto-dimensionale spazio dei pesi, poi resi espliciti tramite fine-tuning supervisionato leggero e allineamento tramite istruzioni. Esempi includono:

- Traduzione automatica neurale

- Sintesi di codice poliglotta

- Sintesi astratta

- Ragionamento aritmetico

Vision Banana sostiene che siamo allo stesso punto anche per la visione. Il paper traccia esplicitamente un’analogia tra il pretraining per la generazione di immagini e il pretraining dei modelli linguistici, e tra l’instruction tuning e lo step di allineamento.

Se l’analogia regge, smetteremo di costruire pipeline specifiche per task e tratteremo un singolo grande generatore di immagini come layer di fondazione, specificando i compiti tramite prompt.

Come funziona Vision Banana?

Il meccanismo è semplice: ogni compito di visione viene riformulato come "genera un’immagine RGB con queste proprietà", e in fase di decodifica si trasforma quell’immagine RGB in predizioni per il task in modo deterministico.

Ecco come si mappa ciascun compito:

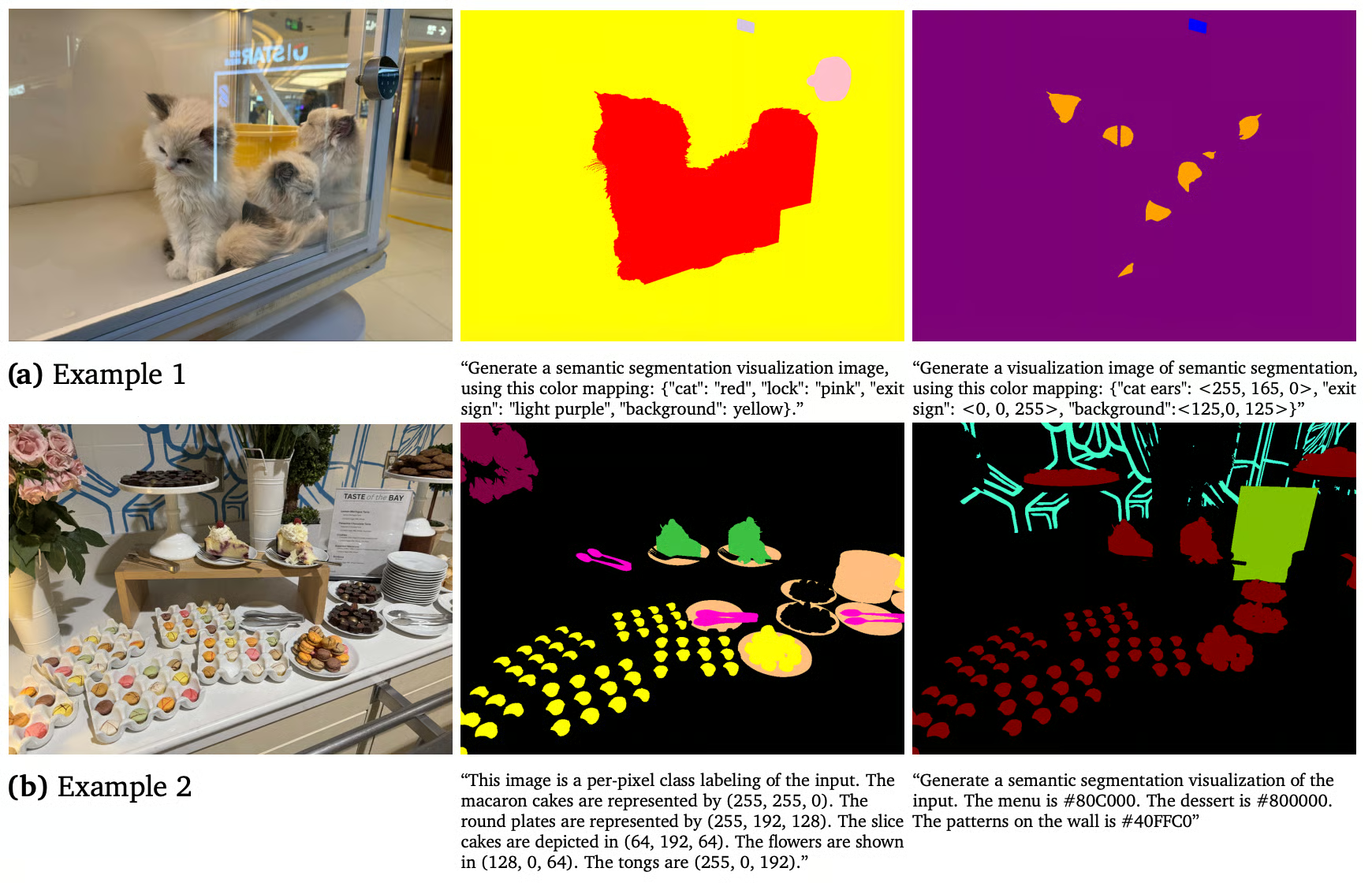

Segmentazione semantica

Fornisci al modello un’assegnazione di colori per classe e in decodifica raggruppi i pixel al colore specificato più vicino. Il vocabolario è quello che metti nel prompt; è aperto per costruzione.

Sarà più chiaro con un esempio. Ecco un prompt tratto dal paper:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Figura 2: Segmentazione semantica (Fonte)

Segmentazione di istanze

La segmentazione di istanze è più complessa della semantica, perché il numero di istanze non è noto in anticipo. Quindi non puoi pre-assegnare i colori.

La soluzione di Vision Banana è processare una classe per inferenza, lasciare che il modello assegni dinamicamente colori distinti alle istanze distinte, quindi in decodifica raggruppare i pixel attorno alle modalità di colore.

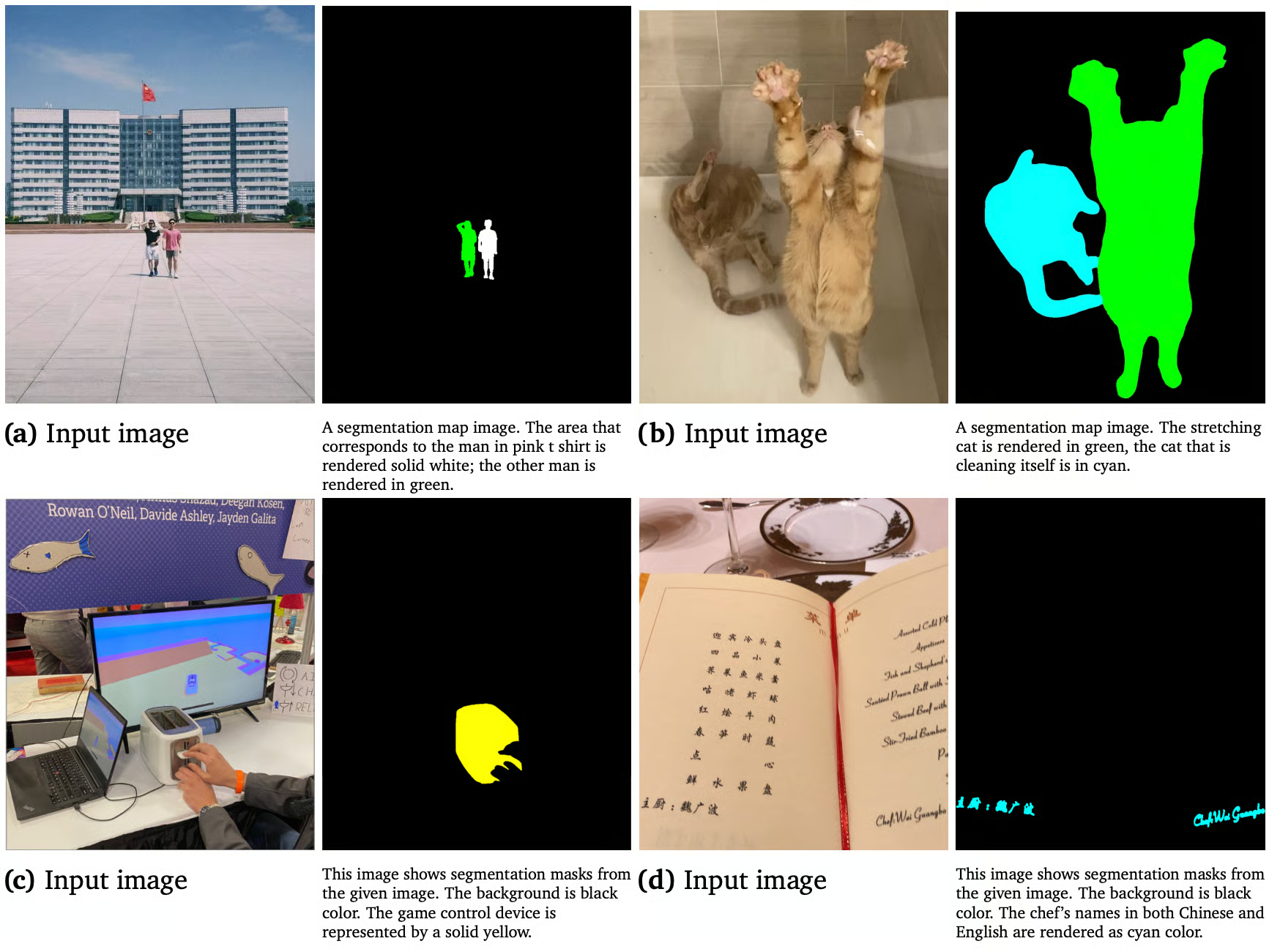

Segmentazione per espressione

Vision Banana può ricevere un prompt con una descrizione in linguaggio naturale di cosa segmentare e restituire una maschera. Ecco un esempio di prompt dal paper:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Qui emerge la forza del ragionamento multimodale insito nel pretraining generativo. I modelli discriminativi faticano con le espressioni di riferimento perché il compito richiede ragionamento linguistico e visivo congiunto. I modelli generativi addestrati su miliardi di coppie didascalia-immagine lo gestiscono in modo naturale.

Figura 3: Vision Banana capisce i prompt in linguaggio naturale e sa ragionare su di essi (Fonte)

Profondità e normali di superficie

Sia la profondità sia le normali di superficie vengono proiettate nello spazio RGB tramite mappature biunivoche, garantendo che le proprietà geometriche latenti vengano preservate senza perdita di informazione durante la trasformazione. Analizzeremo i dettagli della codifica profondità-in-RGB nella sezione seguente.

Questo paradigma di inferenza unificato tratta ogni compito di computer vision come un problema deterministico di generazione di immagini. Mantenendo un’interfaccia RGB coerente lungo tutta la pipeline, il modello evita rami architetturali specifici per task, affidandosi interamente al conditioning guidato dal prompt per definire la semantica dell’output.

Ora, cerchiamo di capire la profondità un po’ più nel dettaglio. È il punto in cui l’intero approccio potrebbe più facilmente crollare.

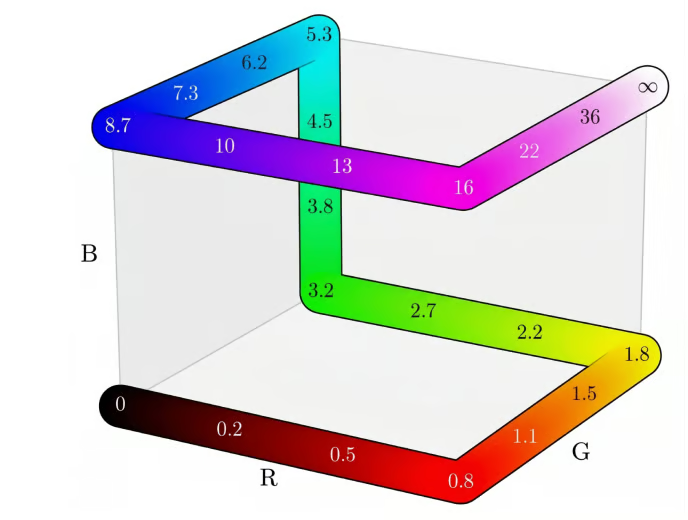

Codificare una profondità illimitata in RGB

Se la codifica non è biunivoca, non puoi recuperare distanze metriche in decodifica, e l’intera tesi di "generazione di immagini come interfaccia universale" crolla con essa. Vale la pena capirlo perché ti dice se l’approccio è fondato o raffazzonato.

Il problema è che i valori di profondità sono numeri reali illimitati in [0, ∞), mentre l’RGB è limitato a [0, 1]. Quindi, per usare "genera la mappa di profondità" come segnale di training, serve una mappatura biunivoca in cui ogni profondità metrica corrisponda esattamente a un valore RGB e in decodifica si possa invertirla tornando ai metri.

L’approccio di Vision Banana ha due stadi:

Stadio 1: comprimere la profondità illimitata in [0, 1)

Gli autori usano la trasformazione di potenza di Barron (2025) con parametro di forma λ = -3, che assegna più risoluzione alle regioni vicine rispetto a quelle lontane. Un oggetto a 2 metri ottiene più precisione di uno a 200 metri. Questo riflette ciò che interessa alla maggior parte delle applicazioni, cioè gli oggetti afferrabili, non quelli distanti.

Stadio 2: mappare [0, 1) sui bordi del cubo RGB

Successivamente interpolano lungo un percorso lineare a tratti che traccia i bordi del cubo RGB, essenzialmente la prima iterazione di una curva di Hilbert 3D. Questo produce transizioni di colore fluide e percettivamente sensate, senza ambiguità su quale colore corrisponda a quale profondità.

Poiché entrambi gli stadi sono strettamente invertibili, la composizione è una biiezione. Allenano quindi sul ground truth codificato in RGB e, in inferenza, proiettano l’RGB predetto sul bordo del cubo più vicino e invertono tornando ai metri.

Figura 4: Visualizzazione della nostra biiezione tra distanze metriche scalari 𝑑 ≥ 0 e valori di colore RGB (Fonte)

Per robustezza, durante il training si aumentano i dati con colormap alternative come Plasma, Inferno, Viridis e scala di grigi, così che il modello possa gestire qualunque stile di visualizzazione tu richieda nel prompt.

Le normali di superficie sono più semplici perché sono già vettori unitari con componenti in [-1, 1], che mappano direttamente in RGB con la convenzione standard nello spazio della camera (+x a destra, +y in alto, +z che esce dal piano immagine). Quindi il verde chiaro significa orientato verso l’alto, il rosso rosato verso sinistra e l’azzurro/viola chiaro verso la camera. Nessuna deformazione necessaria.

Nota: Vision Banana non usa intrinseci della camera in alcun punto, né in training né in inferenza. La maggior parte dei metodi SOTA per la profondità (Depth Anything V3, MoGe-2, UniK3D, DepthLM) usa intrinseci da qualche parte nel loop perché aiutano a disambiguare la scala monoculare.

Il fatto che Vision Banana inferisca la scala assoluta solo da prior visivi, e vinca comunque, è la prova più forte nel paper che il pretraining generativo sta svolgendo lavoro geometrico e non si limita a fare pattern matching di visualizzazioni viste durante il training.

Modelli specialistici vs Vision Banana: un confronto

Il modo più pulito per vedere cosa cambia davvero è confrontare i due paradigmi direttamente su un singolo task. Confrontiamo la stima della profondità con l’approccio specialistico (Marigold, Lotus, Depth Anything V3) e con Vision Banana.

I due paradigmi producono artefatti diversi. Marigold è uno strumento specializzato, mentre Vision Banana è un generalista la cui ampiezza deriva da un unico step di training.

Le differenze si riflettono a cascata su come il modello viene usato in pratica:

|

Aspetto |

Specialista (stile Marigold) |

Vision Banana |

|

Formato output |

Tensore specifico per il task |

Immagine RGB |

|

Vocabolario |

Fissato in training |

Definito nel prompt |

|

Multi-task |

Un modello per task |

Un modello, molti task |

|

Intrinseci della camera |

Spesso richiesti |

Non usati |

|

Capacità di generazione |

Persa nel finetuning |

Preservata |

|

Costo di inferenza |

Basso |

Alto (generatore di immagini completo) |

I benchmark sono un mix di vittorie nette e una sconfitta onesta. Tutto in zero-shot transfer, cioè il modello non ha mai visto gli split di training dei benchmark di valutazione.

Profili di prestazioni superiori:

- Segmentazione semantica (Cityscapes): Ha raggiunto 0,699 mIoU (mean Intersection over Union), superando il Segment Anything Model (SAM 3) specializzato a 0,652.

- Segmentazione per espressioni (RefCOCOg): Ha ottenuto 0,738 cIoU (cumulative IoU), superando il baseline SAM 3 Agent di 0,734.

- Ragionamento visivo complesso (ReasonSeg): Quando sfruttato congiuntamente con Gemini 2.5 Pro, ha raggiunto 0,793 gIoU, superando lo 0,770 del SAM 3 Agent e stabilendo un nuovo stato dell’arte zero-shot, anche rispetto a metodologie non zero-shot e completamente supervisionate.

- Stima metrica della profondità: Ha registrato una

δmedia (accuratezza a soglia) di 0,929 su quattro dataset eterogenei, migliorando lo 0,918 di Depth Anything V3. - Stima delle normali di superficie: Ha registrato un errore angolare medio inferiore di 15,549° su tre dataset indoor, mostrando una fedeltà geometrica superiore rispetto a Lotus-2 (16,558°).

Deficit di prestazioni:

- Segmentazione di istanze (SA-Co/Gold): Prestazioni di 0,540 pmF1 (valutate su un campione di 500 query di SA-Co/Gold, non sull’intero benchmark), inferiori al SAM 3 non zero-shot (0,661) e in linea con DINO-X zero-shot (0,552). Questo risultato probabilmente deriva dal vincolo dell’assegnazione discreta di colori per la cardinalità delle istanze, che limita la risoluzione in scene molto dense.

Su GenAI-Bench, Vision Banana vince il 53,5% dei confronti umani contro il Nano Banana Pro base. Ecco un esempio di test in-the-wild di grounding tratto dal paper:

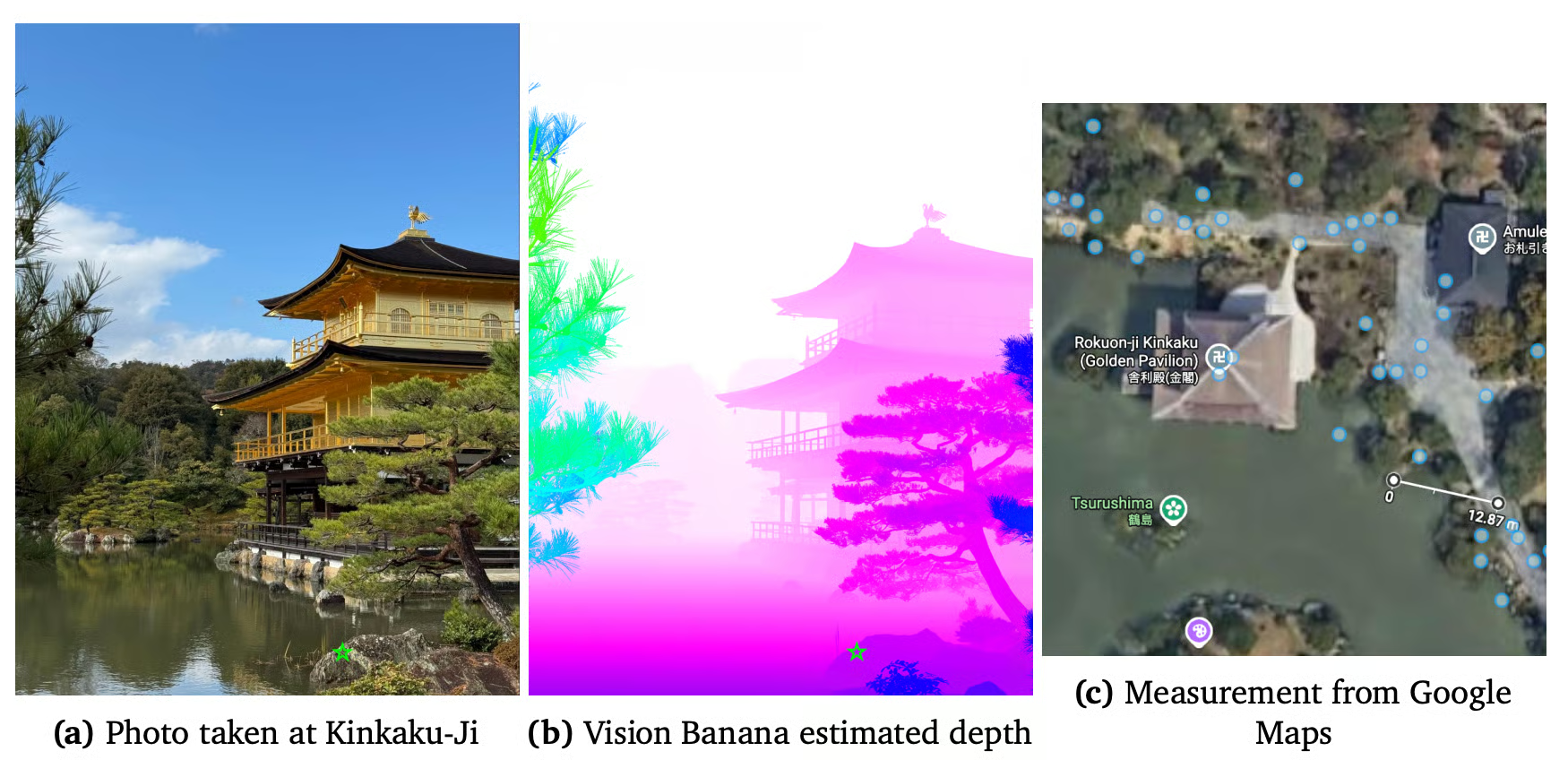

Figura 5: Stima della profondità con Vision Banana (Fonte)

Un autore ha scattato una foto con lo smartphone vicino a Kinkaku-Ji. Vision Banana ha predetto un punto specifico a 13,71 metri. Google Maps indica 12,87, pari al 6,5% di errore relativo assoluto su una foto da telefono senza calibrazione, senza intrinseci, senza setup. È il tipo di test che predice il comportamento in produzione in modo più affidabile dei numeri di benchmark.

Limitazioni di Vision Banana

Vision Banana presenta quattro vincoli da segnalare. Tra questi:

- Costo: Eseguire un modello della scala di Nano Banana Pro per ogni inferenza è molto più costoso che eseguire uno specialista distillato per la profondità. Il paper lo riconosce esplicitamente nella sezione Lavori Futuri. Per 10.000 frame video, oggi questo approccio non è economicamente competitivo. La distillazione in specialisti più piccoli è il passo successivo ovvio.

- Scene con molte istanze: SA-Co/Gold è la sconfitta più chiara. L’assegnazione di colori per classe esaurisce lo spazio quando è necessario contare con precisione molti oggetti piccoli. Qui SAM 3 vince ancora.

- Singola immagine: L’implementazione attuale del modello è fondamentalmente limitata a input di immagini statiche e a singola vista, senza capacità di elaborazione spazio-temporale o multi-vista. Il ragionamento temporale è indicato dagli autori come lavoro futuro.

- Distribuzione come black box: Non puoi sondare, modificare o eseguire il modello in privato. Questo conta in contesti regolamentati o sensibili alla proprietà intellettuale in cui non è possibile usare un’API di frontiera.

Considerazioni finali

Vision Banana è una dimostrazione concreta che i generatori di immagini stanno già facendo il grosso del lavoro per la comprensione visiva e che far emergere tali capacità richiede allineamento più che nuove architetture.

I contributi specifici del paper sono

- Codifica RGB biunivoca che rende profondità e segmentazione problemi di generazione d’immagini invertibili

- Ricetta di instruction tuning leggera che aggiunge abilità di visione senza bruciare il priore di generazione

- Stima metrica della profondità senza intrinseci della camera che supera gli specialisti che invece li richiedono

- Rigoroso protocollo di trasferimento zero-shot che rende la tesi del generalista misurabile su benchmark standard.

Il paper promuove anche un modello mentale “generation-first” in cui i task sono specificati dal prompt e gli output vengono decodificati a partire da immagini RGB, e in cui gli stessi pesi gestiscono sia la produzione sia l’analisi dei contenuti visivi.

Puoi provare i prompt della pagina del progetto sul Nano Banana Pro base o su Nano Banana 2 per vedere cosa è già accessibile senza instruction tuning, costruire funzionalità di reasoning-segmentation con modelli della classe NBP e un router LLM multimodale invece di addestrare direttamente pipeline personalizzate.

FAQ su Vision Banana

Come posso usare Vision Banana oggi?

No. Sono disponibili il paper e la pagina del progetto, ma i pesi del modello sono presso Google DeepMind. Il modello base, Nano Banana Pro, è disponibile nelle API di Gemini e in AI Studio, e la stessa tesi del paper suggerisce che fare prompting direttamente a NBP con i prompt della pagina del progetto dovrebbe già produrre risultati significativi.

Vision Banana può sostituire SAM 3 o Depth Anything?

Non oggi, principalmente per i costi. Per applicazioni in cui devi eseguire inferenza visiva a basso costo su larga scala (video, real-time, mobile), gli specialisti vincono ancora per economia.

Come si confronta con MLLM come GPT-5V o Gemini 2.5?

Gli LLM multimodali prendono un’immagine e producono testo. Vision Banana prende un’immagine e un prompt per produrre un’immagine. Stanno risolvendo problemi diversi.

Perché Vision Banana non usa gli intrinseci della camera per la profondità?

La maggior parte degli specialisti usa gli intrinseci per disambiguare la scala monoculare (un oggetto piccolo vicino e uno grande lontano possono produrre pixel identici). Vision Banana, invece, inferisce la scala dai prior visivi appresi durante il pretraining generativo su dimensioni degli oggetti, contesto della scena e conoscenza del mondo.

Sono una Google Developers Expert in ML (Gen AI), una Kaggle 3x Expert e una Women Techmakers Ambassador con oltre 3 anni di esperienza nel tech. Ho co-fondato una startup health-tech nel 2020 e sto conseguendo un master in informatica al Georgia Tech, con specializzazione in machine learning.