Program

Bilgisayarlı görü, görüntü üreten modeller ile onları anlayan modeller arasında hep net bir ayrım gözetti. Üretken çerçeveler sentez için birincil kaynaklardı; ayırt edici mimariler ise sınıflandırma, bölümleme veya derinlik regresyonuna odaklanıyordu. Yeni bir görsel görev için standart yaklaşım, bir mimari seçmek, göreve özel bir başlık eklemek ve etiketli verilerde ince ayar yapmaktı.

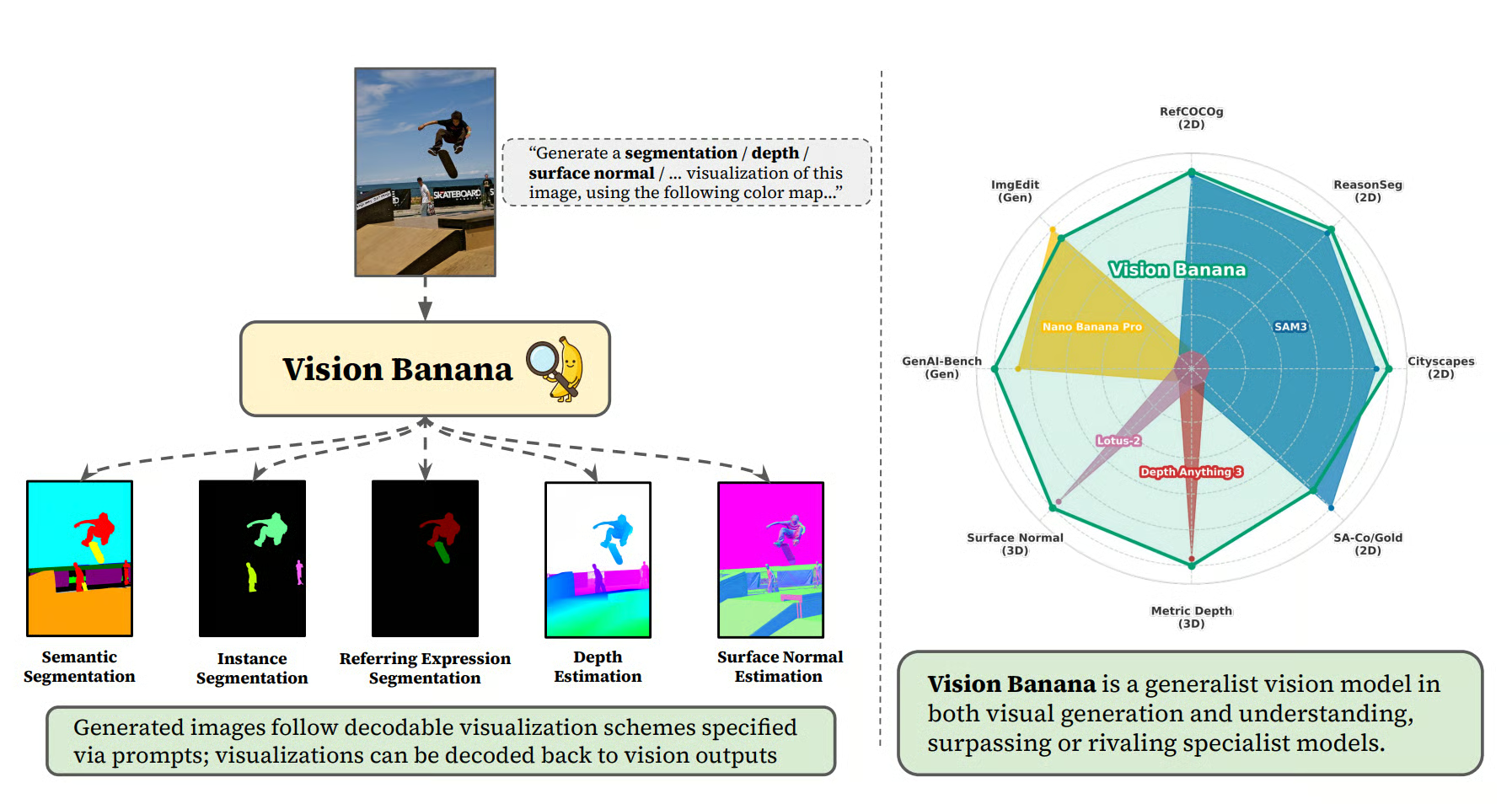

Google DeepMind’dan Vision Banana bu varsayımı yıkmak için burada. Makale, görüntü üreticilerinin halihazırda bir genelist görsel modelin ihtiyaç duyduğu her şeyi öğrendiğini; bölümleme, derinlik, yüzey normalleri ve daha fazlasını içerdiğini savunuyor. Yazarlara göre eksik olan tek şey, bu örtük yetenekleri kıyaslamalarda ölçülebilir kılacak ince bir yönergeyle ayar katmanı.

Bu yazıda Vision Banana’nın gerçekte ne olduğuyla ve neden alanın dikkatini çektiğiyle başlayacağım; ardından modelin nasıl çalıştığını anlatacağım. Ne işe yaradığını, neyin yaramadığını ve uygulayıcıların bundan ne çıkarması gerektiğini belirterek bitireceğim. Bu arada, makaleyi okurken aklıma gelen soruları da paylaşacağım. Muhtemelen diğer okurların da aynı soruları olacaktır.

Not: Vision Banana’nın kendisi herkese açık değil. Yayınlananlar makale ve proje sayfası. Taban model Nano Banana Pro üzerine kurulu ve Gemini API ile Google AI Studio üzerinden erişilebilir.

Vision Banana Nedir?

Vision Banana, Google DeepMind’ın araştırma modelidir; Nano Banana Pro (metinden görüntüye üretici) alınarak, kendi özgün eğitim verilerinin bir karışımı ile az miktarda bilgisayarlı görü görev verisi üzerinde hafif yönergeyle ayar uygulanarak oluşturulmuştur.

Şekil 1: Nano Banana Pro’ya yönergeyle ayar uygulayarak görüntü üreticilerin gizli görsel anlama yeteneklerini açığa çıkarmak (Kaynak)

Tarif şudur:

- Taban model mimarisini değiştirmeden korumak

- Bölümleme, derinlik ve yüzey normal verilerini eğitim dağılımına düşük oranda karıştırmak

- Yönergeyle ayar yapmak

Tüm eğitim yöntemi; yeni bir mimari, özel başlıklar, yardımcı kayıplar veya özelleşmiş kod çözücüler gerektirmez.

Ortaya çıkan model:

- Üç bölümleme kıyaslamasında SAM 3’ü geçiyor

- Metri̇k deri̇nli̇k tahmi̇ninde Depth Anything V3’ü geçiyor

- Yüzey normal tahmininde Lotus-2’yi geçiyor

- Taban modelinin görüntü üretim kalitesini koruyor (GenAI-Bench ve ImgEdit’te istatistiksel beraberlik)

Tüm bunlar, değerlendirildiği kıyaslamaların eğitim bölümlerini asla görmediğinden emin olunan katı sıfır-atış transfer protokolü altında elde edilmiştir.

Neden önemli?

Görsel temsil öğrenimi yıllar boyunca birçok ön eğitim amacını denedi. Yaygın olanlar şunları içerir:

- Denetimli sınıflandırma (ImageNet, JFT)

- Karşıt öğrenme (CLIP, SigLIP)

- Kendi kendine damıtma (DINO, DINOv2)

- Maskeleme ile otomatik kodlama (MAE, BEiT)

Önemli olan, bunların hiçbirinin üretken olmamasıdır. Görüntü üretimi tarihsel olarak, anlama için bir temel değil, aşağı akış bir yetenek olarak ele alınmıştır. Erken üretken ön eğitim girişimleri (iGPT, LVM), temsil kalitesi kıyaslamalarında karşıt yöntemlerin gerisinde kalmıştır.

Dil modellerinde bir sonraki belirteç kestirimi üzerinden üretken özdevinimli amaçların ölçeklenmesi, GPT-3 gibi modellerde sıfır-atış genelist yeteneklerin ortaya çıkmasını hızlandırdı. Karmaşık aşağı akış davranışlarının, yüksek boyutlu ağırlık uzayında örtük olarak bulunduğu ve sonrasında hafif denetimli ince ayar ile yönergeye hizalama yoluyla açığa çıkarıldığı görüldü. Örnekler:

- Sinirsel makine çevirisi

- Çok dilli kod sentezi

- Özetleme (soyutlayıcı)

- Aritmetik akıl yürütme

Vision Banana, görü için de aynı anda olduğumuzu öne sürüyor. Makale açıkça, görüntü üretimiyle ön eğitimi dil modeli ön eğitimiyle ve yönergeyle ayarı hizalama adımıyla benzetimliyor.

Eğer benzetim doğruysa, göreve özel hatlar kurmayı bırakıp, tek bir büyük görüntü üreticisini temel katman olarak kabul edecek ve görevleri istemlerle belirteceğiz.

Vision Banana Nasıl Çalışır?

Mekanizma basit: her görsel görev “bu özelliklere sahip bir RGB görüntü üret” olarak yeniden çerçevelenir ve çözümleme zamanında bu RGB görüntüsünü deterministik olarak görev tahminlerine geri çevirirsiniz.

Her görevin eşlemesi şu şekildedir:

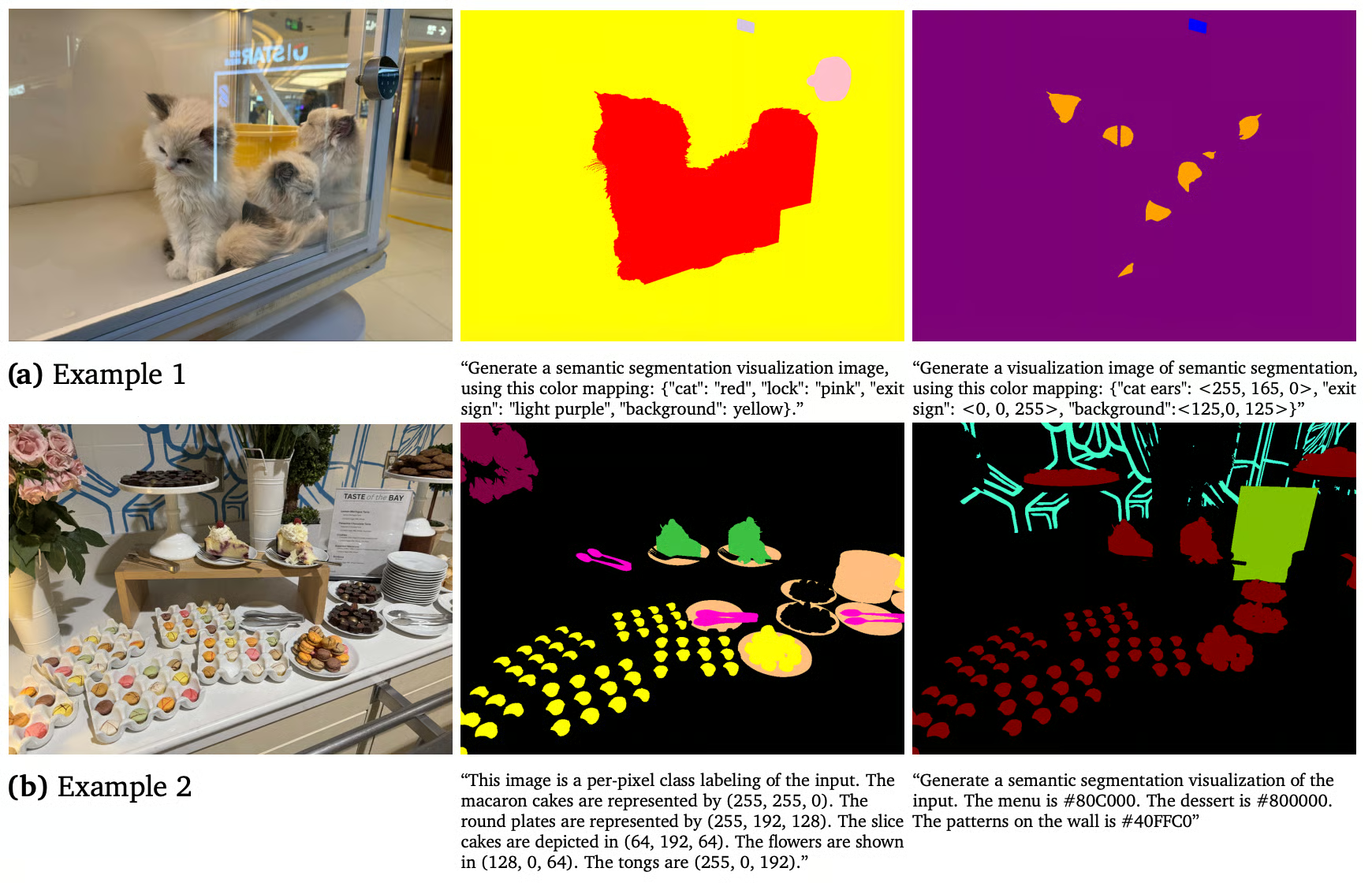

Anlamsal bölümleme

Modeli sınıf başına renk atamalarıyla istemleyin ve çözümleme sırasında pikselleri belirtilen en yakın renge kümeleyin. Söz varlığı, isteme ne koyarsanız odur; yapısı gereği açık söz varlıklıdır.

Bir örneğe bakınca ne demek istediğim daha net olacak. Makaleden bir istem örneği şudur:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Şekil 2: Anlamsal bölümleme (Kaynak)

Örnek bölümleme

Örnek bölümleme, anlamsal bölümlemeden daha zordur; çünkü örnek sayısı baştan bilinmez. Dolayısıyla renkleri önceden atayamazsınız.

Vision Banana’nın çözümü, çıkarım başına bir sınıf çalıştırmak; modele farklı örnekler için dinamik olarak farklı renkler atatmak ve çözümleme sırasında pikselleri renk modlarına kümelemektir.

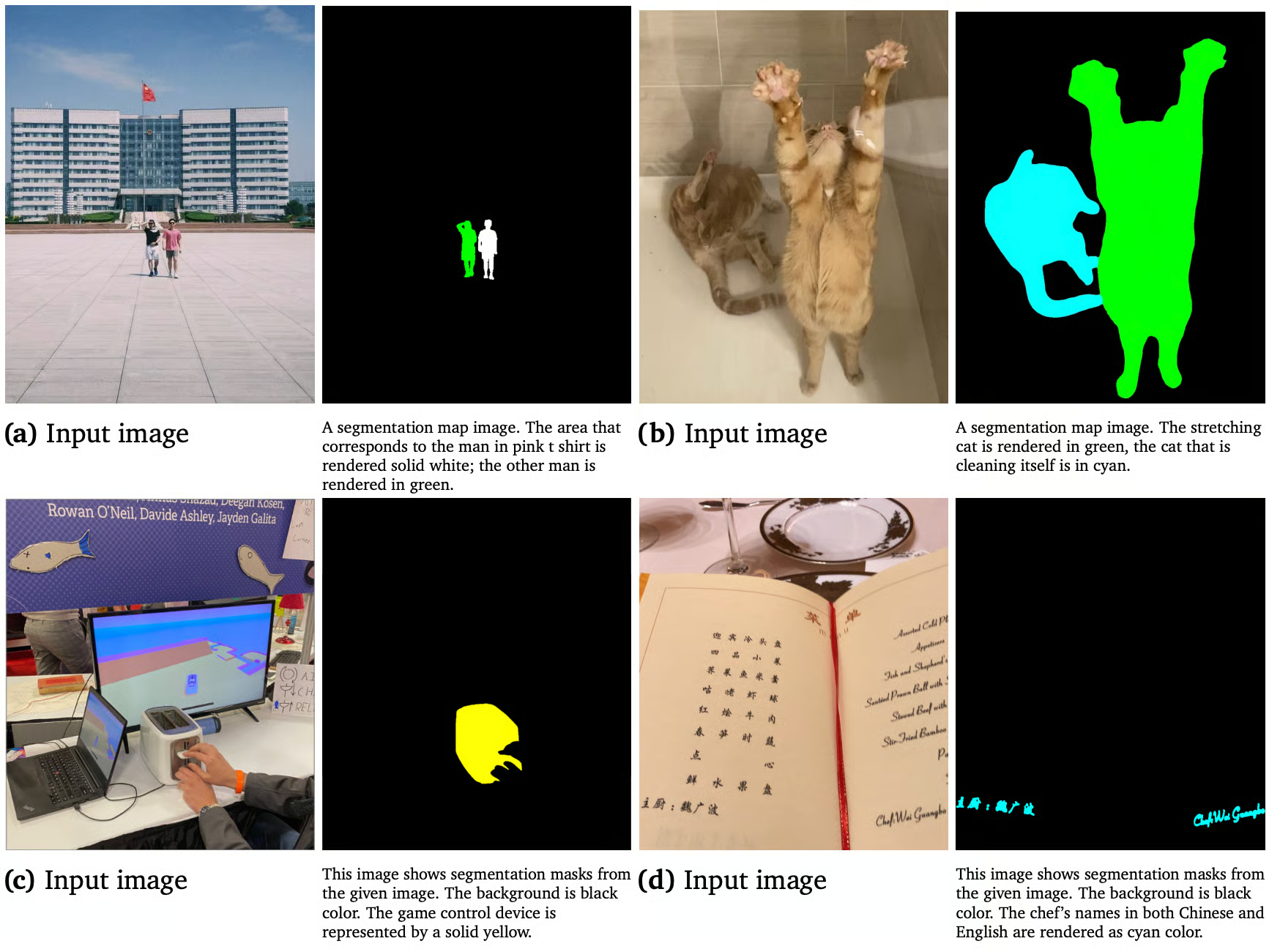

İfade bölümleme

Vision Banana, neyin bölümleneceğine dair doğal dilde bir tanım içeren bir istem alıp bir maske döndürebilir. Makaleden bir istem örneği:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Bu, üretken ön eğitimde yerleşik çok modlu akıl yürütmenin parladığı yerdir. Ayırt edici modeller, başvuru ifadelerinde zorlanır; çünkü görev, dilsel ve görsel akıl yürütmenin birlikte yapılmasını gerektirir. Milyarlarca altyazı-görüntü çiftiyle eğitilen üretken modeller bunu doğal biçimde ele alır.

Şekil 3: Vision Banana doğal dil istemlerini anlayıp bunlar üzerine akıl yürütebilir (Kaynak)

Derinlik ve yüzey normalleri

Hem derinlik hem de yüzey normalleri, örtük geometrik özellikler dönüşüm sırasında sıfır bilgi kaybıyla korunsun diye bire bir eşlemeli dönüşümlerle RGB uzayına yansıtılır. Bir sonraki bölümde derinlikten RGB’ye kodlamanın ayrıntılarını inceleyeceğiz.

Bu birleşik çıkarım paradigması, her bilgisayarlı görü görevini deterministik bir görüntü üretim problemi olarak ele alır. Boru hattı boyunca tutarlı bir RGB arayüzü sürdürerek model, göreve özel mimari dallardan kaçınır ve çıktı anlambilimini tanımlamak için tamamen istem güdümlü koşullandırmaya dayanır.

Şimdi derinliği biraz daha ayrıntılı anlayalım. Yaklaşımın en kolay çökeceği yer burası olabilir.

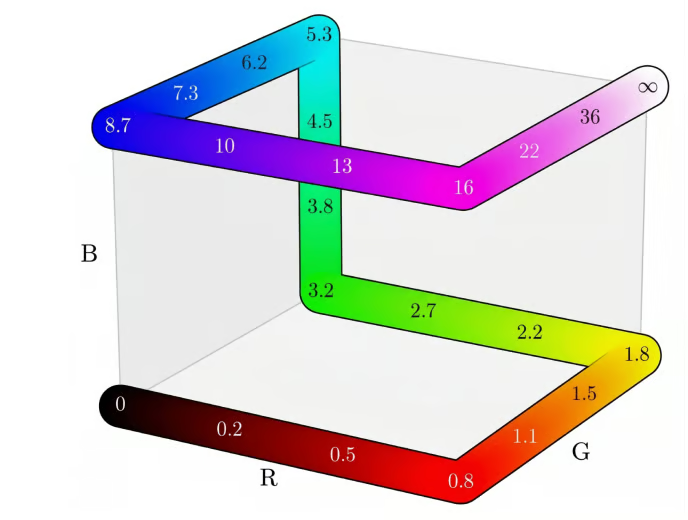

Sınırsız Derinliği RGB’ye Kodlamak

Kodlama bire bir eşleme değilse, çözümlemede metrik uzaklıkları geri kazanamazsınız ve “evrensel arayüz olarak görüntü üretimi” iddiası bununla birlikte çöker. Yaklaşımın ilkesel mi yoksa hileli mi olduğunu anlattığı için bunu kavramaya değer.

Buradaki problem, derinlik değerlerinin [0, ∞) aralığında sınırsız reel sayılar olması; RGB’nin ise [0, 1] ile sınırlı olmasıdır. Bu yüzden “derinlik haritasını üret”i bir eğitim sinyali olarak kullanmak için, her metrik derinliğin tam bir RGB değerine eşlendiği ve çözümlemede tekrar metreye çevrilebildiği bir bire bir eşlemeli dönüşüme ihtiyacınız var.

Vision Banana’nın yaklaşımı iki aşamalıdır:

Aşama 1: Sınırsız derinliği [0, 1) aralığına sıkıştırma

Yazarlar Barron’un (2025) üstel dönüşümünü şekil parametresi λ = -3 ile kullanıyor; bu, yakın alan bölgelerine uzak alandan daha fazla çözünürlük verir. 2 metre uzaktaki bir nesne, 200 metre uzaktakine göre daha hassasiyetli ölçülür. Bu da çoğu uygulamanın önemsediği şeyle uyumludur; yani uzak olan değil, erişilebilir nesneler.

Aşama 2: [0, 1) aralığını RGB küp kenarlarına eşlemek

Ardından, RGB küpünün kenarlarını izleyen, özünde 3B Hilbert eğrisinin ilk iterasyonu olan parçalı doğrusal bir yol boyunca enterpolasyon yapıyorlar. Bu, hangi rengin hangi derinliğe karşılık geldiği konusunda belirsizlik olmadan yumuşak, algısal olarak makul renk geçişleri üretir.

Her iki aşama da kesinlikle tersinir olduğundan, bileşim bire bir eşlemedir. Sonra RGB olarak kodlanmış gerçeğe dayalı verilerle eğitim yapıp, çıkarımda tahmin edilen RGB’yi en yakın küp kenarına izdüşürerek tekrar metreye çeviriyorlar.

Şekil 4: Skaler metrik uzaklıklar 𝑑 ≥ 0 ile RGB renk değerleri arasındaki bire bir eşlemenin görselleştirmesi (Kaynak)

Sağlamlık için eğitim, Plasma, Inferno, Viridis ve gri tonlama gibi alternatif renk haritalarıyla zenginleştirilir; böylece model, istemde hangi görselleştirme stilini isterseniz onu kaldırabilir.

Yüzey normalleri daha kolaydır; çünkü bileşenleri zaten [-1, 1] aralığında birim vektörlerdir ve standart kamera-uzayı uzlaşısıyla (+x sağ, +y yukarı, +z görüntü düzleminden dışarı) doğrudan RGB’ye eşlenir. Dolayısıyla açık yeşil yukarı bakanı, pembemsi kırmızı sola bakanı, açık mavi/mor ise kameraya bakanı ifade eder. Bükme gerekmez.

Not: Vision Banana hiçbir kamera içsel parametresi kullanmaz; ne eğitimde ne de çıkarımda. SOTA derinlik yöntemlerinin çoğu (Depth Anything V3, MoGe-2, UniK3D, DepthLM) döngünün bir yerinde içsel parametreler kullanır; çünkü tek gözlü ölçeği belirsizlikten arındırmaya yardım ederler.

Vision Banana’nın yalnızca görsel ön kabullerden mutlak ölçek çıkarsaması ve yine de kazanması, makaledeki en güçlü kanıttır; üretken ön eğitimin geometrik bir iş yaptığını, yalnızca eğitim sırasında gördüğü görselleştirmeleri desen eşlemediğini gösterir.

Uzman Modeller ve Vision Banana: Karşılaştırma

Gerçekte neyin farklı olduğunu görmenin en temiz yolu, iki paradigmayı tek bir görevde doğrudan karşılaştırmaktır. Derinlik tahminini uzman yaklaşımıyla (Marigold, Lotus, Depth Anything V3) ve Vision Banana ile karşılaştıralım.

İki paradigma farklı çıktılar üretir. Marigold özelleşmiş bir araçtır; Vision Banana ise kapsamını tek bir eğitim adımından alan bir genelisttir.

Farklar, modelin pratikte nasıl kullanıldığına kadar yansır:

|

Boyut |

Uzman (Marigold tarzı) |

Vision Banana |

|

Çıktı formatı |

Göreve özel tensör |

RGB görüntü |

|

Söz varlığı |

Eğitimde sabit |

İstemde tanımlanır |

|

Çoklu görev |

Görev başına bir model |

Tek model, çok görev |

|

Kamera içselleri |

Çoğu zaman gerekli |

Kullanılmaz |

|

Üretim yeteneği |

İnce ayarda yitirilir |

Korunur |

|

Çıkarım maliyeti |

Düşük |

Yüksek (tam görüntü üretici) |

Kıyaslamalar, net zaferler ile dürüst bir yenilginin karışımıdır. Hepsi sıfır-atış transfer altında; yani model, değerlendirme kıyaslamalarının eğitim bölümlerini hiç görmemiştir.

Üstün performans profilleri:

- Anlamsal bölümleme (Cityscapes): Ortalama Kesişim-Birleşim (mIoU) 0,699’a ulaştı; uzman Segment Anything Model’i (SAM 3) 0,652 ile geçti.

- Göndergesel bölümleme (RefCOCOg): 0,738 cIoU (kümülatif IoU) gösterdi; SAM 3 Agent temel çizgisini 0,734 ile geçti.

- Karmaşık görsel akıl yürütme (ReasonSeg): Gemini 2.5 Pro ile ortak kullanıldığında 0,793 gIoU’ya ulaştı; SAM 3 Agent’ın 0,770 değerini geride bırakarak, sıfır-atış dışı, tamamen denetimli yöntemlere karşı bile yeni bir sıfır-atış SOTA kurdu.

- Metrik derinlik tahmini: Dört farklı veri kümesi genelinde ortalama

δ(eşik doğruluğu) 0,929 kaydetti; Depth Anything V3’ün 0,918 değerini iyileştirdi. - Yüzey normal tahmini: Üç kapalı alan veri kümesinde ortalama açısal hatayı 15,549° ile daha düşük kaydetti; Lotus-2’ye (16,558°) kıyasla üstün geometrik sadakat gösterdi.

Performans açığı:

- Örnek bölümleme (SA-Co/Gold): Performans 0,540 pmF1 (SA-Co/Gold’un 500 sorguluk bir örneklemi üzerinde, tam kıyas üzerinde değil) olup, sıfır-atış dışı SAM 3’ün (0,661) gerisinde ve sıfır-atış DINO-X (0,552) ile başa baş. Bu sonuç muhtemelen, örnek sayısını ayrık renk atamalarıyla ifade etme zorunluluğundan kaynaklanıyor; bu da çok yoğun sahnelerde çözünürlüğü kısıtlıyor.

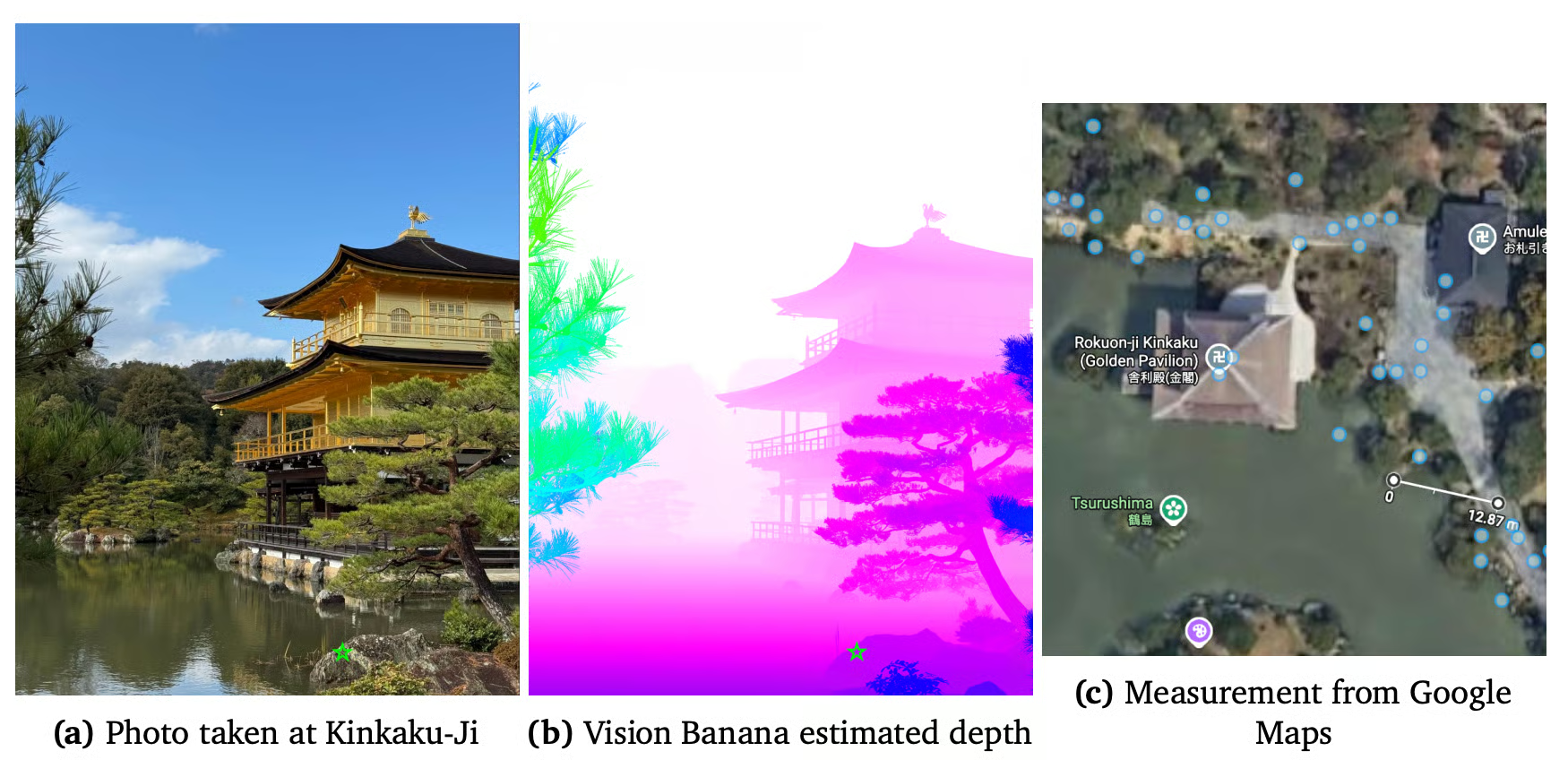

GenAI-Bench’te Vision Banana, taban Nano Banana Pro’ya karşı insan karşılaştırmalarının %53,5’ini kazanıyor. Makaleden doğada yapılan bir dayanaklama testine örnek:

Şekil 5: Vision Banana derinlik tahmini (Kaynak)

Yazarlardan biri Kinkaku-Ji yakınında bir akıllı telefon fotoğrafı çekti. Vision Banana belirli bir noktayı 13,71 metre olarak tahmin etti. Google Haritalar 12,87 diyor; kalibrasyon, içsel parametreler veya kurulum olmadan bir telefon fotoğrafında %6,5 mutlak bağıl hata. Bu tür testler, kıyaslama sayılarına göre dağıtıma daha güvenilir işaret verir.

Vision Banana’nın Sınırlamaları

Vision Banana’nın dikkat çekmeye değer dört kısıtı var. Bunlar şunları içerir:

- Maliyet: Her çıkarımda Nano Banana Pro ölçekli bir modeli çalıştırmak, damıtılmış bir derinlik uzmanını çalıştırmaktan çok daha pahalı. Makale bunu Gelecek Çalışmalar bölümünde doğrudan kabul ediyor. 10 bin video karesi için bu yaklaşım bugün ekonomik olarak rekabetçi değil. Daha küçük uzmanlara damıtma bariz bir sonraki adım.

- Örnek yoğun sahneler: SA-Co/Gold net bir kayıp. Sınıf başına renk ataması, çok sayıda küçük nesnenin hassas sayımı gerektiğinde tıkanıyor. SAM 3 burada hâlâ kazanıyor.

- Tek görüntü: Mevcut model uygulaması, temelde durağan, tek görüşlü görüntü girdileriyle sınırlıdır; uzamsal-zamansal veya çoklu görüş işlemeyi yapamaz. Zamsal akıl yürütme, yazarlar tarafından gelecekteki çalışmalara bırakılmıştır.

- Kara kutu dağıtım: Modeli sorgulayamaz, değiştiremez veya özel olarak çalıştıramazsınız. Bu, düzenlemeye tabi veya fikri mülkiyete duyarlı bağlamlarda, sınır API’sini çalıştırmanın seçenek olmadığı durumlarda önemlidir.

Son Düşünceler

Vision Banana, görüntü üreticilerin görsel anlama işinin büyük kısmını zaten yaptığının ve bu yetenekleri açığa çıkarmanın yeni mimarilerden ziyade hizalama gerektirdiğinin somut bir gösterimidir.

Makalenin özel katkıları şunlardır:

- Derinliği ve bölümlemeyi tersinir görüntü üretim problemleri yapan bire bir RGB kodlama

- Üretim önceliğini yakmadan görsel beceriler ekleyen hafif yönergeyle ayar tarifi

- Uzmanların gerektirdiği kamera içselleri olmadan, onları geçen metrik derinlik tahmini

- Genelist iddiayı standart kıyaslamalarda ölçülebilir kılan katı sıfır-atış transfer protokolü.

Makale ayrıca, görevlerin istemle belirtildiği ve çıktıların RGB görüntülerden geri çözüldüğü; aynı ağırlıkların hem görsel içerik üretimini hem de çözümlemesini üstlendiği üretim-öncelikli bir zihinsel modeli teşvik ediyor.

Proje sayfasındaki istemleri taban Nano Banana Pro veya Nano Banana 2 üzerinde deneyerek, yönergeyle ayar olmaksızın hâlihazırda nelerin erişilebilir olduğunu görebilir; özel hatlar eğitmek yerine NBP sınıfı modeller ve çok modlu bir LLM yönlendiriciyle akıl yürütme-bölümleme özellikleri oluşturabilirsiniz.

Vision Banana SSS

Vision Banana’yı bugün nasıl kullanabilirim?

Hayır. Makale ve proje sayfası yayımlandı, ancak model ağırlıkları Google DeepMind’da. Taban model Nano Banana Pro, Gemini API ve AI Studio’da mevcut ve makalenin kendi tezi, proje sayfasındaki istemlerle doğrudan NBP’yi istemlemenin zaten anlamlı sonuçlar üretmesi gerektiğini öne sürüyor.

Vision Banana, SAM 3 veya Depth Anything’in yerini alabilir mi?

Bugün için hayır; çoğunlukla maliyet nedeniyle. Görsel çıkarımı ölçekli ve ucuza çalıştırmanız gereken uygulamalarda (video, gerçek zamanlı, mobil), uzmanlar hâlâ ekonomik olarak üstün.

Bu, GPT-5V veya Gemini 2.5 gibi MLLM’lerle nasıl karşılaştırılır?

Çok modlu LLM’ler bir görüntüyü alıp metin üretir. Vision Banana ise bir görüntü ve istem alıp görüntü üretir. Farklı problemleri çözüyorlar.

Vision Banana neden derinlik için kamera içsellerini kullanmıyor?

Uzmanların çoğu, tek gözlü ölçekteki belirsizliği gidermek için içsel parametreler kullanır (yakındaki küçük bir nesne ile uzaktaki büyük bir nesne aynı pikselleri üretebilir). Ancak Vision Banana, nesne boyutları, sahne bağlamı ve dünya bilgisi üzerine üretken ön eğitim sırasında öğrenilmiş görsel ön kabullerden ölçeği çıkarsar.

ML (Üretken Yapay Zekâ) alanında Google Developers Uzmanıyım, Kaggle 3x Expert unvanına sahibim ve 3+ yıllık teknoloji deneyimiyle Women Techmakers Elçisiyim. 2020'de bir sağlık teknolojileri girişiminin kurucu ortağı oldum ve Georgia Tech'te makine öğrenmesi alanında uzmanlaşarak bilgisayar bilimleri yüksek lisansı yapıyorum.