Track

कंप्यूटर विज़न लंबे समय से तस्वीरें बनाने वाले मॉडलों और उन्हें समझने वाले मॉडलों के बीच साफ़ विभाजन पर काम करता आया है। जेनरेटिव फ्रेमवर्क मुख्य रूप से सिंथेसिस के स्रोत थे, जबकि डिस्क्रिमिनेटिव आर्किटेक्चर वर्गीकरण, सेगमेंटेशन या डेप्थ रीग्रेशन पर केंद्रित थे। किसी नए विज़न टास्क के लिए मानक तरीका था—एक आर्किटेक्चर चुनना, टास्क-विशिष्ट हेड जोड़ना, और लेबल्ड डेटा पर फाइन-ट्यून करना।

यही धारणा विज़न बनाना (Vision Banana) से Google DeepMind चुनौती दे रहा है। पेपर का तर्क है कि इमेज जेनरेटर पहले से ही एक जनरलिस्ट विज़न मॉडल के लिए ज़रूरी सब कुछ सीख चुके हैं—सेगमेंटेशन, डेप्थ, सरफेस नॉर्मल्स और बहुत कुछ। लेखकों के अनुसार, बस एक पतली इंस्ट्रक्शन-ट्यूनिंग परत की ज़रूरत है ताकि इन लेटेंट क्षमताओं को बेंचमार्क्स पर मापा जा सके।

इस पोस्ट में, मैं शुरू करूँगा कि विज़न बनाना वास्तव में क्या है और इस पेपर ने क्षेत्र का ध्यान क्यों खींचा, फिर बताऊँगा कि मॉडल कैसे काम करता है। अंत में, क्या काम करता है, क्या नहीं, और प्रैक्टिशनर्स को क्या सीखना चाहिए—इस पर बात करूँगा। बीच-बीच में, मैं वे सवाल उजागर करूँगा जो मुझे पेपर पढ़ते समय आए—संभावना है कि अन्य पाठकों के भी वही होंगे।

नोट: स्वयं विज़न बनाना सार्वजनिक रूप से उपलब्ध नहीं है। उपलब्ध हैं पेपर और प्रोजेक्ट पेज। बेस मॉडल Nano Banana Pro पर बना है और Gemini API तथा Google AI Studio के जरिए उपलब्ध है।

विज़न बनाना क्या है?

विज़न बनाना Google DeepMind का एक शोध मॉडल है, जिसे Nano Banana Pro (टेक्स्ट-टू-इमेज जेनरेटर) लेकर और उसके मूल प्रशिक्षण डेटा के मिश्रण के साथ थोड़े से कंप्यूटर विज़न टास्क डेटा पर हल्की इंस्ट्रक्शन ट्यूनिंग लागू करके बनाया गया है।

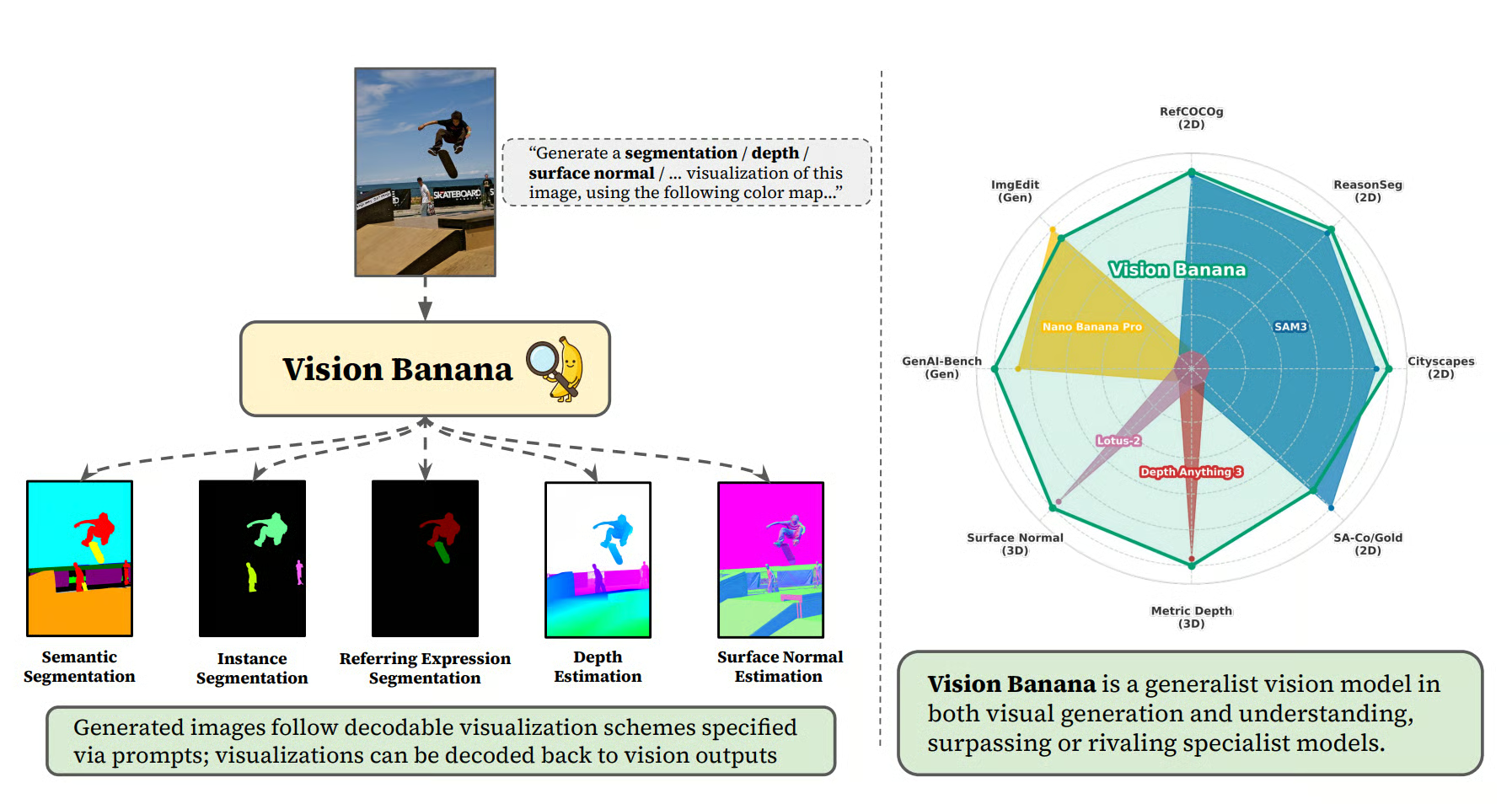

चित्र 1: इंस्ट्रक्शन-ट्यूनिंग Nano Banana Pro द्वारा इमेज जेनरेटर्स की छिपी विज़ुअल समझने की क्षमताएँ (स्रोत)

विधि यह है:

- बेस मॉडल आर्किटेक्चर अपरिवर्तित रखें

- ट्रेनिंग डिस्ट्रीब्यूशन में कम अनुपात पर सेगमेंटेशन, डेप्थ और सरफेस नॉर्मल डेटा मिलाएँ

- इंस्ट्रक्शन-ट्यून करें

पूरी ट्रेनिंग पद्धति में न नया आर्किटेक्चर, न कस्टम हेड्स, न ऑक्ज़िलियरी लॉसेज़, और न ही कोई विशेष डिकोडर चाहिए।

परिणामी मॉडल:

- तीन सेगमेंटेशन बेंचमार्क्स पर SAM 3 को पछाड़ता है

- मेट्रिक डेप्थ एस्टीमेशन में Depth Anything V3 से बेहतर है

- सरफेस नॉर्मल एस्टीमेशन में Lotus-2 को मात देता है

- अपने बेस मॉडल की इमेज जेनरेशन गुणवत्ता बरकरार रखता है (GenAI-Bench और ImgEdit पर सांख्यिकीय टाई)

यह सब सख्त ज़ीरो-शॉट ट्रांसफर प्रोटोकॉल के तहत हासिल किया गया है, यह सुनिश्चित करते हुए कि मॉडल ने जिन बेंचमार्क्स पर मूल्यांकन किया है उनके ट्रेनिंग स्प्लिट्स कभी नहीं देखे।

यह क्यों मायने रखता है?

विज़न रिप्रेज़ेंटेशन लर्निंग ने वर्षों में कई प्रीट्रेनिंग ऑब्जेक्टिव्स आज़माए हैं। आम तौर पर:

- सुपरवाइज़्ड क्लासिफिकेशन (ImageNet, JFT)

- कॉन्ट्रास्टिव लर्निंग (CLIP, SigLIP)

- सेल्फ-डिस्टिलेशन (DINO, DINOv2)

- मास्क्ड ऑटोएन्कोडिंग (MAE, BEiT)

महत्त्वपूर्ण बात यह है कि इनमें से कोई भी जेनरेटिव नहीं है। इमेज जनरेशन को इतिहासतः डाउनस्ट्रीम क्षमता माना गया है, न कि समझ के लिए आधार। शुरुआती जेनरेटिव प्रीट्रेनिंग प्रयास (iGPT, LVM) रिप्रेज़ेंटेशन क्वालिटी बेंचमार्क्स पर कॉन्ट्रास्टिव तरीकों से लगातार पीछे रहे।

नेक्स्ट-टोकन प्रिडिक्शन के जरिए जेनरेटिव ऑटोरिग्रेसिव ऑब्जेक्टिव्स का स्केलिंग GPT-3 जैसे मॉडलों में ज़ीरो-शॉट जनरलिस्ट क्षमताओं के उभरने का उत्प्रेरक बना। जटिल डाउनस्ट्रीम व्यवहार उच्च-आयामी वेट स्पेस में लेटेंट पाए गए, जिन्हें बाद में हल्के सुपरवाइज़्ड फाइन-ट्यूनिंग और इंस्ट्रक्शन एलाइनमेंट से सतह पर लाया गया। उदाहरण:

- न्यूरल मशीन ट्रांसलेशन

- बहुभाषी कोड सिन्थेसिस

- अमूर्त सार-संक्षेप

- अंकगणितीय तर्क

विज़न बनाना का तर्क है कि विज़न के लिए हम इसी मोड़ पर हैं। पेपर स्पष्ट रूप से इमेज जनरेशन प्रीट्रेनिंग और लैंग्वेज मॉडल प्रीट्रेनिंग, तथा इंस्ट्रक्शन ट्यूनिंग और एलाइनमेंट स्टेप के बीच समानता खींचता है।

यदि यह समानता टिकती है, तो हम टास्क-विशिष्ट पाइपलाइन्स बनाना छोड़ देंगे और एक बड़े इमेज जेनरेटर को आधार परत मानेंगे, जहाँ टास्क प्रॉम्प्ट्स से निर्दिष्ट होंगे।

विज़न बनाना कैसे काम करता है?

तरीका सरल है: हर विज़न टास्क को इस रूप में ढाला जाता है—"इन गुणों वाली एक RGB इमेज जेनरेट करो", और डिकोड समय पर, आप उस RGB इमेज को नियत ढंग से फिर से टास्क प्रेडिक्शंस में बदल देते हैं।

प्रत्येक टास्क का मैपिंग यूँ होता है:

सेमांटिक सेगमेंटेशन

मॉडल को प्रति-श्रेणी रंग असाइनमेंट के साथ प्रॉम्प्ट करें, और डिकोड समय पर, पिक्सेल्स को निकटतम निर्दिष्ट रंग से क्लस्टर करें। शब्द-संग्रह वही है जो आप प्रॉम्प्ट में देते हैं; यह निर्माण के हिसाब से ओपन-वोकैब है।

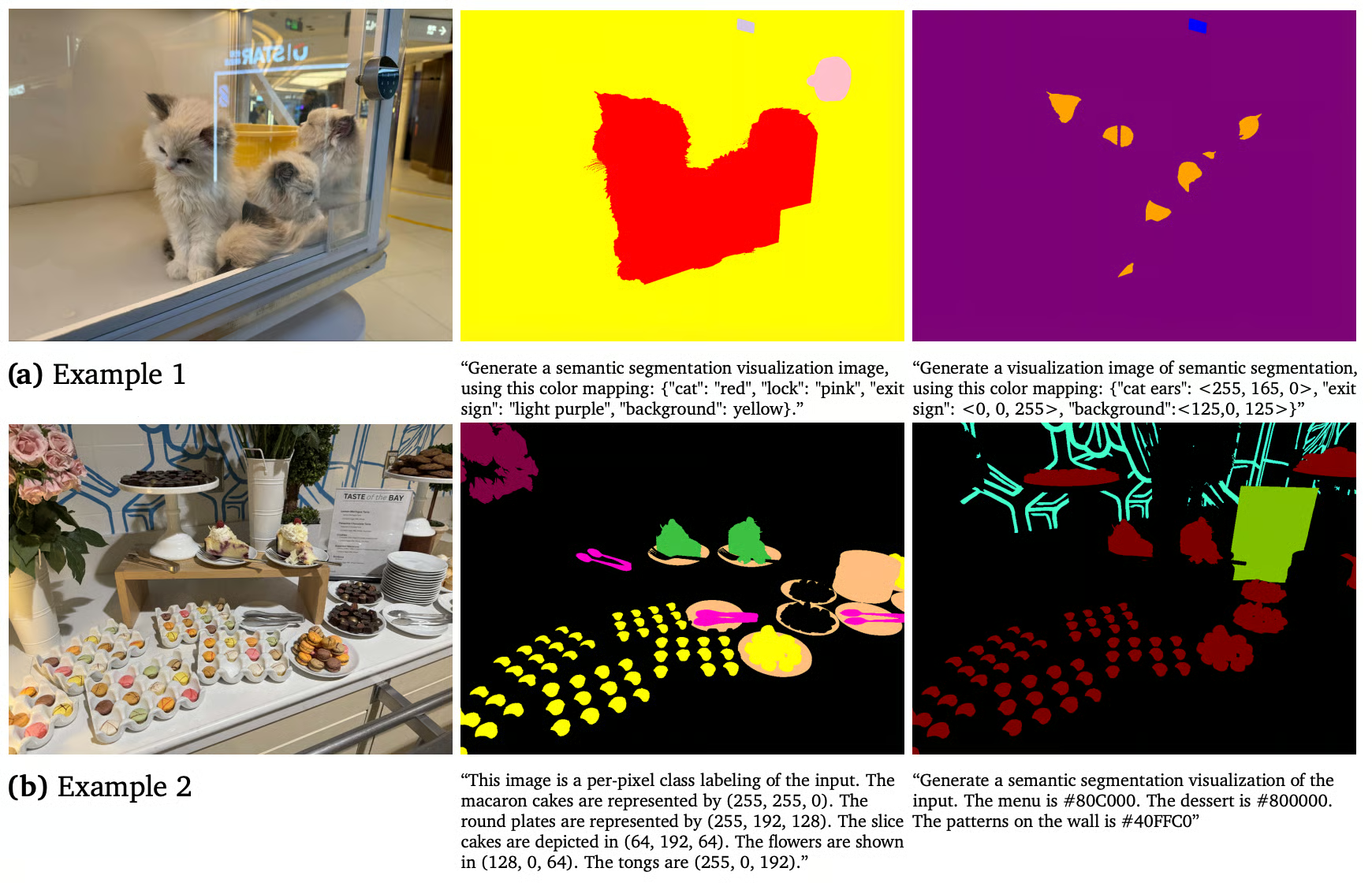

उदाहरण देखकर बात और स्पष्ट होगी। पेपर का एक प्रॉम्प्ट:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

चित्र 2: सेमांटिक सेगमेंटेशन (स्रोत)

इन्स्टेन्स सेगमेंटेशन

इन्स्टेन्स सेगमेंटेशन सेमांटिक सेगमेंटेशन से पेचीदा है क्योंकि इन्स्टेन्स की संख्या पहले से ज्ञात नहीं होती। इसलिए, आप रंग पहले से असाइन नहीं कर सकते।

विज़न बनाना का हल यह है कि प्रति-इनफ़ेरेंस एक क्लास लें, मॉडल को अलग-अलग इन्स्टेन्स के लिए अलग रंग गतिशील रूप से असाइन करने दें, फिर डिकोड समय पर पिक्सेल्स को कलर मोड्स में क्लस्टर करें।

एक्सप्रेशन सेगमेंटेशन

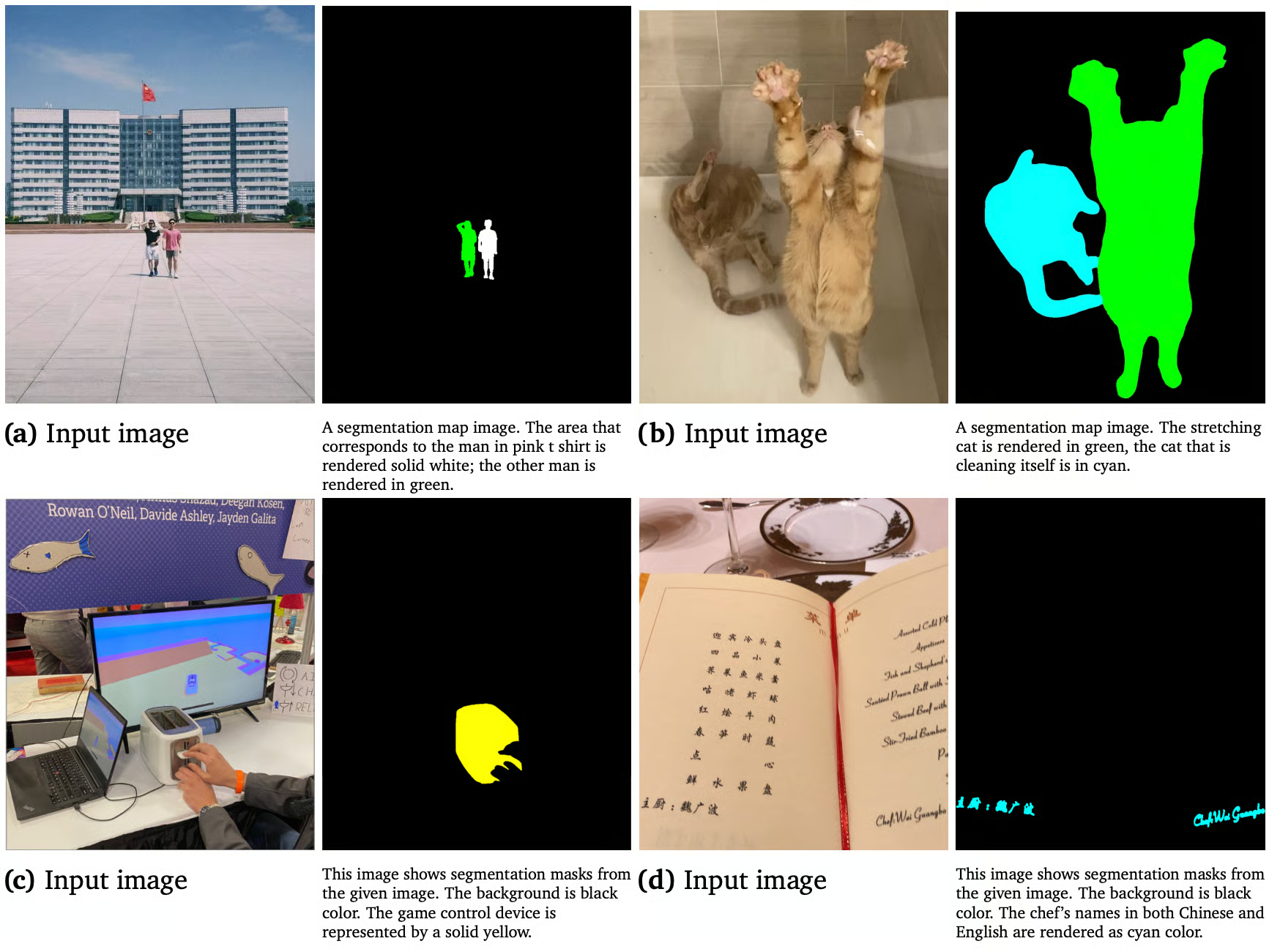

विज़न बनाना प्राकृतिक-भाषा विवरण वाले प्रॉम्प्ट को इनपुट के रूप में लेकर मास्क लौटा सकता है। पेपर का एक उदाहरण प्रॉम्प्ट:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.यहीं जेनरेटिव प्रीट्रेनिंग में निहित मल्टीमॉडल रीज़निंग चमकती है। डिस्क्रिमिनेटिव मॉडल्स रेफ़रिंग एक्सप्रेशंस में जूझते हैं क्योंकि टास्क में संयुक्त भाषायी और दृश्य तर्क चाहिए। अरबों कैप्शन-इमेज युग्मों पर प्रशिक्षित जेनरेटिव मॉडल इसे सहजता से संभालते हैं।

चित्र 3: विज़न बनाना प्राकृतिक भाषा के प्रॉम्प्ट्स को समझ सकता है और उन पर तर्क कर सकता है (स्रोत)

डेप्थ और सरफेस नॉर्मल्स

डेप्थ और सरफेस नॉर्मल्स दोनों को बायजेक्टिव मैपिंग्स के जरिए RGB स्पेस में प्रोजेक्ट किया जाता है, जिससे यह सुनिश्चित होता है कि ट्रांसफ़ॉर्मेशन के दौरान ज्यामितीय गुण बिना किसी सूचना-हानि के संरक्षित रहें। अगला सेक्शन डेप्थ-टू-RGB एन्कोडिंग की बारीकियाँ खोलेगा।

यह एकीकृत इनफ़ेरेंस पैरेडाइम हर कंप्यूटर विज़न टास्क को एक नियत इमेज-जनरेशन समस्या की तरह मानता है। पाइपलाइन में एकसमान RGB इंटरफ़ेस बनाए रखते हुए, मॉडल टास्क-विशिष्ट आर्किटेक्चरल ब्रांच से बचता है और आउटपुट सेमांटिक्स को परिभाषित करने के लिए पूरी तरह प्रॉम्प्ट-ड्रिवन कंडीशनिंग पर निर्भर करता है।

अब, डेप्थ को थोड़ा विस्तार से समझें। यही वह हिस्सा है जहाँ पूरा तरीका सबसे आसानी से कमजोर पड़ सकता है।

अबाउंडेड डेप्थ को RGB में एन्कोड करना

यदि एन्कोडिंग बायजेक्टिव नहीं है, तो आप डिकोड समय पर मेट्रिक दूरियाँ पुनर्प्राप्त नहीं कर सकते, और "यूनिवर्सल इंटरफ़ेस के रूप में इमेज जेनरेशन" का पूरा दावा वहीं ढह जाता है। यह समझना इसलिए ज़रूरी है कि पता चले तरीका सैद्धांतिक है या जुगाड़।

समस्या यह है कि डेप्थ मान [0, ∞) में अबाउंडेड वास्तविक संख्याएँ हैं, जबकि RGB [0, 1] में बाउंडेड है। तो, "डेप्थ मैप जेनरेट करो" को ट्रेनिंग सिग्नल के रूप में इस्तेमाल करने के लिए आपको एक बायजेक्टिव मैपिंग चाहिए जहाँ हर मेट्रिक डेप्थ ठीक एक RGB मान पर मैप हो, और डिकोड समय पर आप उसे मीटर में पलट सकें।

विज़न बनाना का तरीका दो चरणों का है:

चरण 1: अबाउंडेड डेप्थ को [0, 1) पर संकुचित करें

लेखक Barron (2025) का पावर ट्रांसफ़ॉर्म शाप पैरामीटर λ = -3 के साथ प्रयोग करते हैं, जो निकट-क्षेत्र को दूर-क्षेत्र की तुलना में अधिक रेज़ोल्यूशन देता है। 2 मीटर दूर की वस्तु को 200 मीटर दूर की वस्तु से अधिक प्रिसिज़न मिलती है। यह अधिकांश अनुप्रयोगों की परवाह के अनुरूप है, यानी पकड़ में आने वाली वस्तुएँ, न कि दूर की।

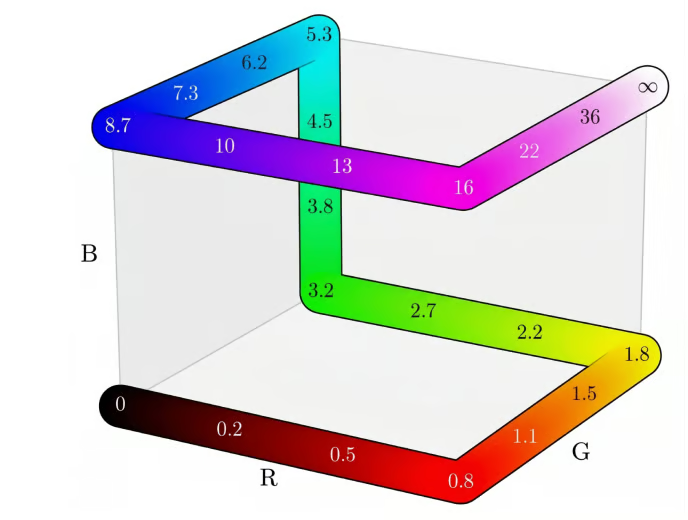

चरण 2: [0, 1) को RGB क्यूब के किनारों पर मैप करें

इसके बाद, वे पीसवाइज़-लीनियर पाथ के साथ इंटरपोलेट करते हैं जो RGB क्यूब के किनारों का अनुगमन करता है—मूलतः 3D हिल्बर्ट कर्व का प्रथम इटरेशन। इससे स्मूद, कथ्यतः समझदार रंग संक्रमण बनते हैं जिनमें यह अस्पष्टता नहीं रहती कि किस रंग का कौन-सा डेप्थ है।

चूँकि दोनों चरण सख्ती से इन्वर्टिबल हैं, उनका संयोजन बायजेक्शन है। फिर वे RGB-एन्कोडेड ग्राउंड ट्रुथ पर ट्रेन करते हैं, और इनफ़ेरेंस पर, प्रेडिक्टेड RGB को निकटतम क्यूब ऐज पर प्रोजेक्ट करके मीटर में इन्वर्ट कर देते हैं।

चित्र 4: स्केलर मेट्रिक डिस्टेंसेज़ 𝑑 ≥ 0 और RGB रंग मानों के बीच हमारे बायजेक्शन का विज़ुअलाइज़ेशन (स्रोत)

रॉबस्टनेस के लिए, ट्रेनिंग में Plasma, Inferno, Viridis और ग्रेस्केल जैसे वैकल्पिक कलरमैप्स से ऑग्मेंट किया जाता है, ताकि मॉडल उस विज़ुअलाइज़ेशन स्टाइल को संभाल सके जिसकी आप प्रॉम्प्ट में माँग करें।

सरफेस नॉर्मल्स आसान हैं क्योंकि वे पहले से ही [-1, 1] घटकों वाले यूनिट वेक्टर हैं, जिन्हें मानक कैमरा-स्पेस परंपरा (+x दाएँ, +y ऊपर, +z इमेज प्लेन से बाहर) के साथ सीधे RGB पर मैप किया जा सकता है। तो हल्का हरा ऊपर की ओर, गुलाबी-लाल बाएँ की ओर, और हल्का नीला/बैंगनी कैमरा की ओर इंगित करता है—कोई वार्प नहीं चाहिए।

नोट: विज़न बनाना कहीं भी कैमरा इंट्रिंसिक्स का उपयोग नहीं करता—न ट्रेनिंग में, न इनफ़ेरेंस में। अधिकांश SOTA डेप्थ विधियाँ (Depth Anything V3, MoGe-2, UniK3D, DepthLM) इंट्रिंसिक्स का कहीं-न-कहीं उपयोग करती हैं क्योंकि वे मोनोकुलर स्केल की अस्पष्टता दूर करने में मदद करती हैं।

केवल दृश्य प्रायर्स से ही विज़न बनाना का एबसोल्यूट स्केल निकालना—और फिर भी जीतना—इस बात का सबसे मजबूत प्रमाण है कि जेनरेटिव प्रीट्रेनिंग ज्यामितीय काम कर रही है, सिर्फ़ प्रशिक्षण में देखी गई विज़ुअलाइज़ेशंस का पैटर्न-मैचिंग नहीं।

स्पेशलिस्ट मॉडल बनाम विज़न बनाना: तुलना

सबसे साफ़ तरीका यह देखने का कि वास्तव में क्या अलग है—एक ही टास्क पर दोनों पैरेडाइम्स की सीधी तुलना है। चलिए डेप्थ एस्टीमेशन की तुलना करते हैं—स्पेशलिस्ट तरीका (Marigold, Lotus, Depth Anything V3) और विज़न बनाना।

दोनों पैरेडाइम्स अलग आर्टिफैक्ट्स पैदा करते हैं। Marigold एक विशेषज्ञ औज़ार है, जबकि विज़न बनाना एक जनरलिस्ट है जिसकी व्यापकता एक ही ट्रेनिंग स्टेप से आती है।

ये फ़र्क इस बात तक फैलते हैं कि मॉडल व्यवहार में कैसे इस्तेमाल होता है:

|

पहलू |

स्पेशलिस्ट (Marigold-शैली) |

विज़न बनाना |

|

आउटपुट फ़ॉर्मैट |

टास्क-विशिष्ट टेन्सर |

RGB इमेज |

|

शब्द-संग्रह |

ट्रेनिंग में तय |

प्रॉम्प्ट में परिभाषित |

|

मल्टी-टास्क |

प्रति टास्क एक मॉडल |

एक मॉडल, कई टास्क |

|

कैमरा इंट्रिंसिक्स |

अक्सर आवश्यक |

उपयोग नहीं |

|

जेनरेशन क्षमता |

फाइन-ट्यूनिंग में खो जाती है |

संरक्षित |

|

इनफ़ेरेंस लागत |

कम |

उच्च (फुल इमेज जेनरेटर) |

बेंचमार्क्स स्पष्ट जीतों और एक ईमानदार हार का मिश्रण हैं। सब कुछ ज़ीरो-शॉट ट्रांसफर के तहत, यानी मॉडल ने मूल्यांकन बेंचमार्क्स के ट्रेनिंग स्प्लिट्स कभी नहीं देखे।

बेहतर प्रदर्शन प्रोफ़ाइलें:

- सेमांटिक सेगमेंटेशन (Cityscapes): 0.699 mIoU (मीन इंटरसेक्शन ओवर यूनियन) हासिल किया, जो विशेष Segment Anything Model (SAM 3) के 0.652 से बेहतर है।

- रेफ़रिंग सेगमेंटेशन (RefCOCOg): 0.738 cIoU (क्यूम्युलेटिव IoU) प्रदर्शित किया, जो SAM 3 Agent के 0.734 बेसलाइन से अधिक है।

- जटिल दृश्य तर्क (ReasonSeg): Gemini 2.5 Pro के साथ संयुक्त रूप से उपयोग करने पर 0.793 gIoU प्राप्त किया, SAM 3 Agent के 0.770 से बेहतर और नॉन-ज़ीरो-शॉट, पूरी तरह सुपरवाइज़्ड तरीकों के मुकाबले भी नया ज़ीरो-शॉट SOTA स्थापित किया।

- मेट्रिक डेप्थ एस्टीमेशन: चार विविध डेटासेट्स पर औसत

δ(थ्रेशहोल्ड एक्यूरेसी) 0.929 दर्ज की, जो Depth Anything V3 की 0.918 से बेहतर है। - सरफेस नॉर्मल एस्टीमेशन: तीन इनडोर डेटासेट्स पर 15.549° औसत मीन एंगुलर एरर दर्ज की, जो Lotus-2 (16.558°) की तुलना में बेहतर ज्यामितीय निष्ठा दर्शाती है।

प्रदर्शन घाटा:

- इन्स्टेन्स सेगमेंटेशन (SA-Co/Gold): प्रदर्शन 0.540 pmF1 रहा (SA-Co/Gold के 500-क्वेरी सैंपल पर, पूरे बेंचमार्क पर नहीं), जो नॉन-ज़ीरो-शॉट SAM 3 (0.661) से पीछे है और ज़ीरो-शॉट DINO-X (0.552) के बराबर है। यह परिणाम संभवतः इन्स्टेन्स कार्डिनैलिटी के लिए डिस्क्रीट कलर असाइनमेंट की बाधा से आता है, जो अत्यधिक घनी सीन में रेज़ोल्यूशन सीमित करता है।

GenAI-Bench पर, विज़न बनाना बेस Nano Banana Pro के विरुद्ध 53.5% मानव तुलनाओं में जीतता है। पेपर से एक इन-द-वाइल्ड ग्राउन्डिंग टेस्ट का उदाहरण:

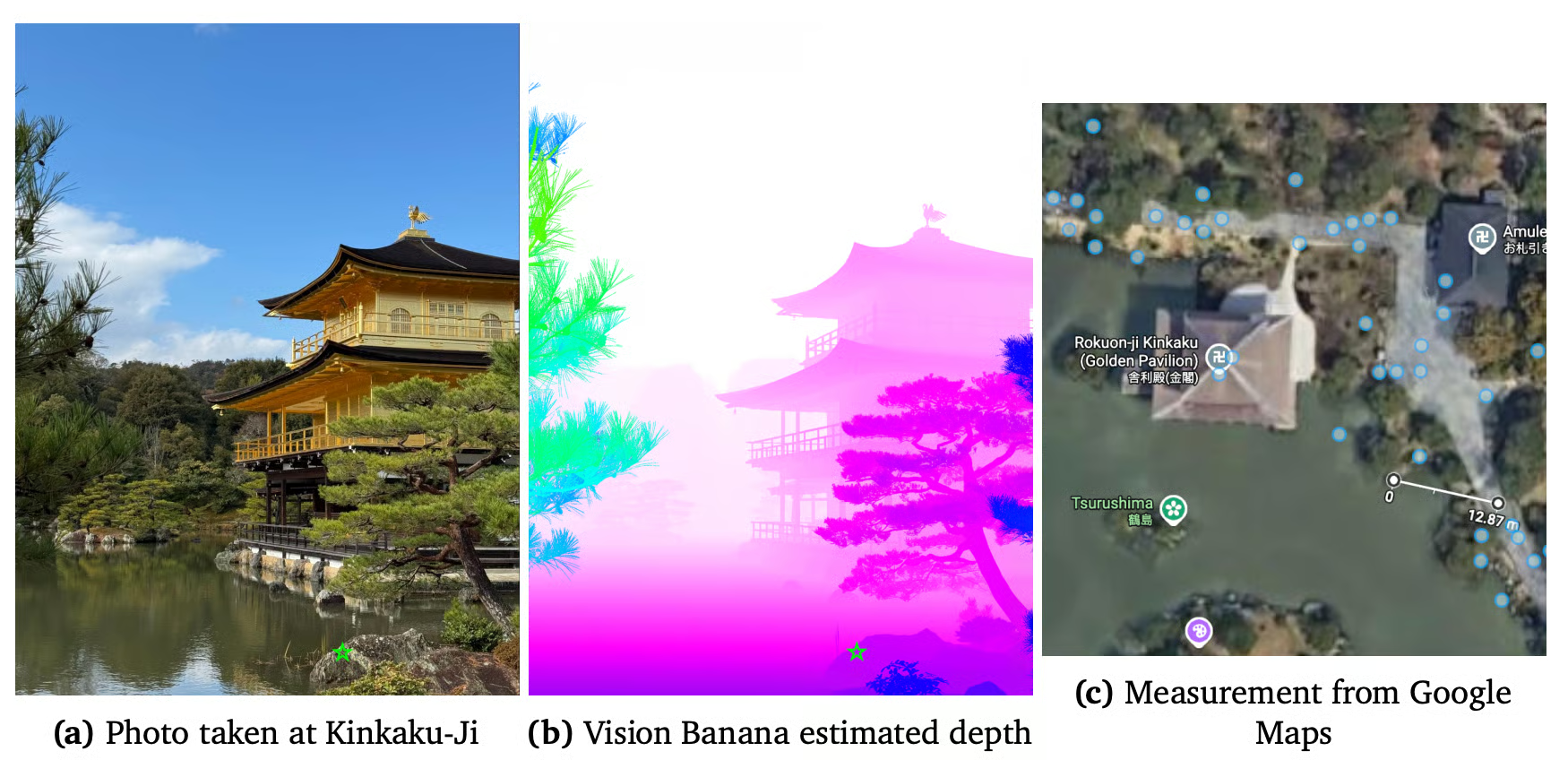

चित्र 5: विज़न बनाना डेप्थ एस्टीमेशन (स्रोत)

एक लेखक ने किंकाकु-जी के पास स्मार्टफ़ोन फोटो लिया। विज़न बनाना ने एक विशिष्ट बिंदु के लिए 13.71 मीटर का अनुमान लगाया। Google Maps ने 12.87 बताया—जो बिना कैलिब्रेशन, बिना इंट्रिंसिक्स, बिना सेटअप के फ़ोन फोटो पर 6.5% एब्सोल्यूट रिलेटिव एरर है। इस तरह के टेस्ट बेंचमार्क संख्याओं की तुलना में डिप्लॉयमेंट व्यवहार की बेहतर भविष्यवाणी करते हैं।

विज़न बनाना की सीमाएँ

विज़न बनाना की चार पाबंदियाँ हैं जिन पर ध्यान देना चाहिए। इनमें शामिल हैं:

- लागत: हर इनफ़ेरेंस के लिए Nano Banana Pro-स्तर का मॉडल चलाना किसी डिस्टिल्ड डेप्थ स्पेशलिस्ट की तुलना में बेहद महँगा है। पेपर ने इसे Future Work सेक्शन में सीधे स्वीकार किया है। 10,000 वीडियो फ़्रेम्स के लिए, आज यह तरीका आर्थिक रूप से प्रतिस्पर्धी नहीं है। छोटे स्पेशलिस्ट्स में डिस्टिलेशन अगला स्वाभाविक कदम है।

- इन्स्टेन्स-भारी सीन: SA-Co/Gold साफ़ हार है। प्रति-क्लास रंग असाइनमेंट तब दम तोड़ देता है जब बहुत-से छोटे ऑब्जेक्ट्स को सटीक गिनना पड़ता है। यहाँ SAM 3 अब भी जीतता है।

- सिंगल-इमेज: वर्तमान मॉडल स्थिर, सिंगल-व्यू इमेज इनपुट तक मूलभूत रूप से सीमित है; इसमें स्पेशियो-टेम्पोरल या मल्टी-व्यू प्रोसेसिंग की क्षमता नहीं है। टेम्पोरल रीज़निंग को लेखकों ने भविष्य के काम के लिए चिह्नित किया है।

- ब्लैक-बॉक्स डिप्लॉयमेंट: आप मॉडल को न जाँच सकते हैं, न संशोधित, न निजी रूप से चला सकते हैं। यह विनियमित या IP-संवेदनशील संदर्भों में मायने रखता है जहाँ फ्रंटियर API चलाना विकल्प नहीं होता।

अंतिम विचार

विज़न बनाना ठोस रूप से दिखाता है कि इमेज जेनरेटर पहले से ही विज़ुअल अंडरस्टैंडिंग के भारी कार्य कर रहे हैं—और इन क्षमताओं को सतह पर लाने के लिए नई आर्किटेक्चर्स से अधिक एलाइनमेंट चाहिए।

पेपर के विशिष्ट योगदान हैं

- बायजेक्टिव RGB एन्कोडिंग, जो डेप्थ और सेगमेंटेशन को इन्वर्टिबल इमेज-जनरेशन समस्याएँ बनाती है

- हल्की इंस्ट्रक्शन-ट्यूनिंग रेसिपी, जो जेनरेशन प्रायर को बिना क्षति पहुँचाए विज़न स्किल्स जोड़ती है

- कैमरा इंट्रिंसिक्स के बिना मेट्रिक डेप्थ एस्टीमेशन—और उन स्पेशलिस्ट्स से बेहतर जो इंट्रिंसिक्स माँगते हैं

- सख्त ज़ीरो-शॉट ट्रांसफर प्रोटोकॉल, जो जनरलिस्ट दावे को मानक बेंचमार्क्स पर मापने योग्य बनाता है

पेपर एक जेनरेशन-फर्स्ट मानसिक मॉडल भी आगे बढ़ाता है, जहाँ टास्क प्रॉम्प्ट से निर्दिष्ट होते हैं और आउटपुट RGB इमेजेज़ से वापस डिकोड होते हैं, तथा वही वेट्स दृश्य सामग्री बनाने और पार्स करने—दोनों को संभालते हैं।

आप प्रोजेक्ट पेज के प्रॉम्प्ट्स को बेस Nano Banana Pro या Nano Banana 2 पर आज़मा सकते हैं ताकि देखें कि बिना इंस्ट्रक्शन ट्यूनिंग के पहले से क्या-संभव है, और कस्टम पाइपलाइन्स सीधे ट्रेन करने के बजाय NBP-क्लास मॉडलों और एक मल्टीमॉडल LLM राउटर के साथ रीज़निंग-सेगमेंटेशन फ़ीचर्स बनाएँ।

विज़न बनाना FAQs

मैं आज विज़न बनाना का उपयोग कैसे कर सकता/सकती हूँ?

अभी नहीं। पेपर और प्रोजेक्ट पेज उपलब्ध हैं, पर मॉडल वेट्स Google DeepMind के पास हैं। बेस मॉडल Nano Banana Pro, Gemini API और AI Studio में उपलब्ध है, और पेपर का स्वयं का तर्क बताता है कि प्रोजेक्ट पेज के प्रॉम्प्ट्स के साथ सीधे NBP को प्रॉम्प्ट करना पहले से सार्थक परिणाम दे सकता है।

क्या विज़न बनाना SAM 3 या Depth Anything की जगह ले सकता है?

अभी नहीं, मुख्यतः लागत के कारण। जिन अनुप्रयोगों में आपको बड़े पैमाने पर सस्ते में विज़न इनफ़ेरेंस चलाने की ज़रूरत है (वीडियो, रियल-टाइम, मोबाइल), वहाँ अर्थशास्त्र में स्पेशलिस्ट्स अब भी जीतते हैं।

यह GPT-5V या Gemini 2.5 जैसे MLLMs से कैसे तुलना करता है?

मल्टीमॉडल LLMs एक इमेज लेते हैं और टेक्स्ट पैदा करते हैं। विज़न बनाना एक इमेज और प्रॉम्प्ट लेकर एक इमेज पैदा करता है। दोनों अलग समस्याएँ हल कर रहे हैं।

विज़न बनाना डेप्थ के लिए कैमरा इंट्रिंसिक्स का उपयोग क्यों नहीं करता?

अधिकांश स्पेशलिस्ट्स मोनोकुलर स्केल की अस्पष्टता दूर करने के लिए इंट्रिंसिक्स का उपयोग करते हैं (पास की छोटी वस्तु और दूर की बड़ी वस्तु समान पिक्सेल्स दे सकती हैं)। जबकि, विज़न बनाना जेनरेटिव प्रीट्रेनिंग के दौरान सीखे गए ऑब्जेक्ट साइज़, सीन कॉन्टेक्स्ट और वर्ल्ड नॉलेज जैसे विज़ुअल प्रायर्स से स्केल का अनुमान लगाता है।