track

Viziunea computerizată a funcționat mereu pe o separare clară între modelele care produc imagini și modelele care le înțeleg. Cadrele generative erau sursele principale pentru sinteză, în timp ce arhitecturile discriminative se concentrau pe clasificare, segmentare sau regresie a adâncimii. Abordarea standard pentru orice nouă sarcină de viziune era să alegeți o arhitectură, să atașați un cap specific sarcinii și să faceți fine-tuning pe date etichetate.

Această presupunere este ceea ce Vision Banana de la Google DeepMind își propune să răstoarne. Lucrarea susține că generatorii de imagini au învățat deja tot ce are nevoie un model de viziune generalist, inclusiv segmentare, adâncime, normale ale suprafețelor și altele. În opinia autorilor, tot ce lipsește este un strat subțire de instruction tuning pentru a face acele capabilități latente măsurabile pe benchmark-uri.

În această postare, voi începe cu ce este de fapt Vision Banana și de ce lucrarea a atras atenția domeniului, apoi voi parcurge modul în care funcționează modelul. Voi încheia cu ce funcționează, ce nu și ce ar trebui să rețină practicienii. Pe parcurs, voi scoate în evidență întrebările pe care le-am avut în timp ce citeam lucrarea. Probabil că alți cititori le vor avea pe aceleași.

Notă: Vision Banana în sine nu este accesibil public. Ce este disponibil sunt lucrarea și pagina proiectului. Modelul de bază este construit pe Nano Banana Pro și este disponibil prin API-ul Gemini și Google AI Studio.

Ce este Vision Banana?

Vision Banana este un model de cercetare de la Google DeepMind, construit prin preluarea Nano Banana Pro (generator text-la-imagine) și aplicarea unui instruction tuning ușor pe un amestec din datele sale originale de antrenare, împreună cu o cantitate mică de date pentru sarcini de viziune computerizată.

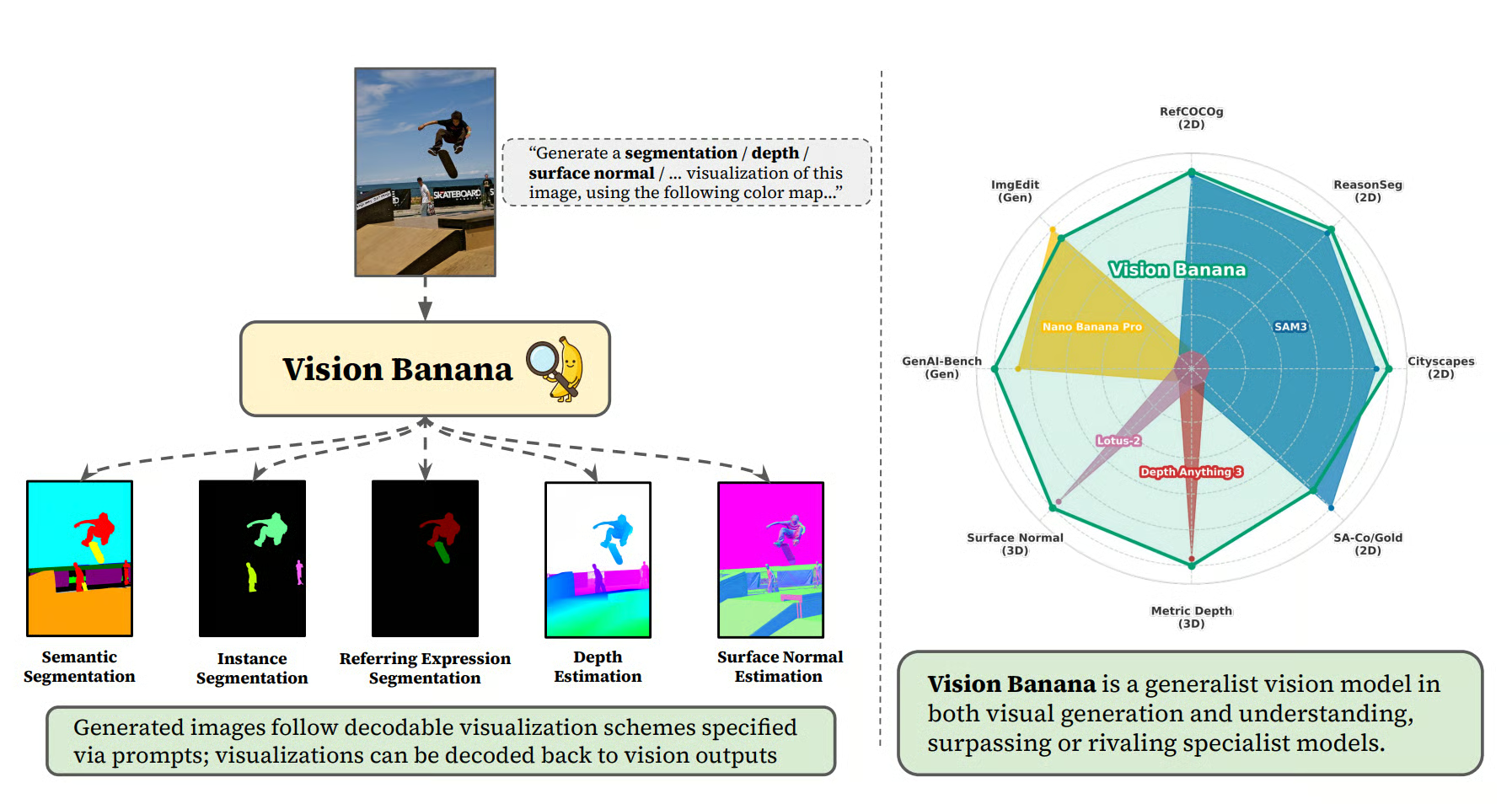

Figura 1: Capacități ascunse de înțelegere vizuală ale generatorilor de imagini prin instruction-tuning pe Nano Banana Pro (Sursa)

Rețeta este:

- Păstrați neschimbată arhitectura modelului de bază

- Amestecați în distribuția de antrenare date de segmentare, adâncime și normale ale suprafețelor într-un raport redus

- Faceți instruction-tuning

Întreaga metodologie de antrenare nu necesită nicio arhitectură nouă, fără head-uri personalizate, fără pierderi auxiliare și fără decodoare specializate.

Modelul rezultat:

- Îl depășește pe SAM 3 pe trei benchmark-uri de segmentare

- Îl depășește pe Depth Anything V3 la estimarea metrică a adâncimii

- Îl depășește pe Lotus-2 la estimarea normalelor suprafețelor

- Își păstrează calitatea de generare a imaginilor din modelul de bază (egalitate statistică pe GenAI-Bench și ImgEdit)

Toate acestea sunt obținute sub un protocol strict de transfer zero-shot, asigurând că modelul nu a văzut niciodată diviziunile de antrenare ale benchmark-urilor pe care este evaluat.

De ce contează acest lucru?

Învățarea reprezentărilor în viziune a încercat de-a lungul anilor multe obiective de preantrenare. Cele comune includ:

- Clasificare supervizată (ImageNet, JFT)

- Învățare contrastivă (CLIP, SigLIP)

- Autodistilare (DINO, DINOv2)

- Autoîncapsulare mascată (MAE, BEiT)

Important este că niciuna dintre ele nu este generativă. Generarea de imagini a fost tratată istoric ca o capabilitate de downstream, nu ca un fundament pentru înțelegere. Primele încercări de preantrenare generativă (iGPT, LVM) au rămas constant în urma metodelor contrastive pe benchmark-urile de calitate a reprezentărilor.

Scalarea obiectivelor autoregresive generative prin predicția următorului token a catalizat apariția capabilităților generaliste zero-shot în modele precum GPT-3. Comportamentele complexe de downstream s-au dovedit a fi latente în spațiul de mare dimensiune al greutăților, fiind apoi scoase la suprafață prin fine-tuning supervizat ușor și aliniere prin instrucțiuni. Exemple includ:

- Traducere automată neurală

- Sinteză poliglotă de cod

- Rezumat abstract

- Raționament aritmetic

Vision Banana susține că suntem în același moment și pentru viziune. Lucrarea trasează explicit o analogie între preantrenarea pentru generarea de imagini și preantrenarea modelelor de limbaj și între instruction tuning și pasul de aliniere.

Dacă analogia se confirmă, vom înceta să mai construim fluxuri specifice sarcinilor și vom trata un singur generator mare de imagini ca strat fundamental, specificând sarcinile prin prompturi.

Cum funcționează Vision Banana?

Mecanismul este simplu: fiecare sarcină de viziune este reformulată ca „generează o imagine RGB cu aceste proprietăți”, iar la decodare transformați acea imagine RGB înapoi în predicții ale sarcinii în mod determinist.

Iată cum se mapează fiecare sarcină:

Segmentare semantică

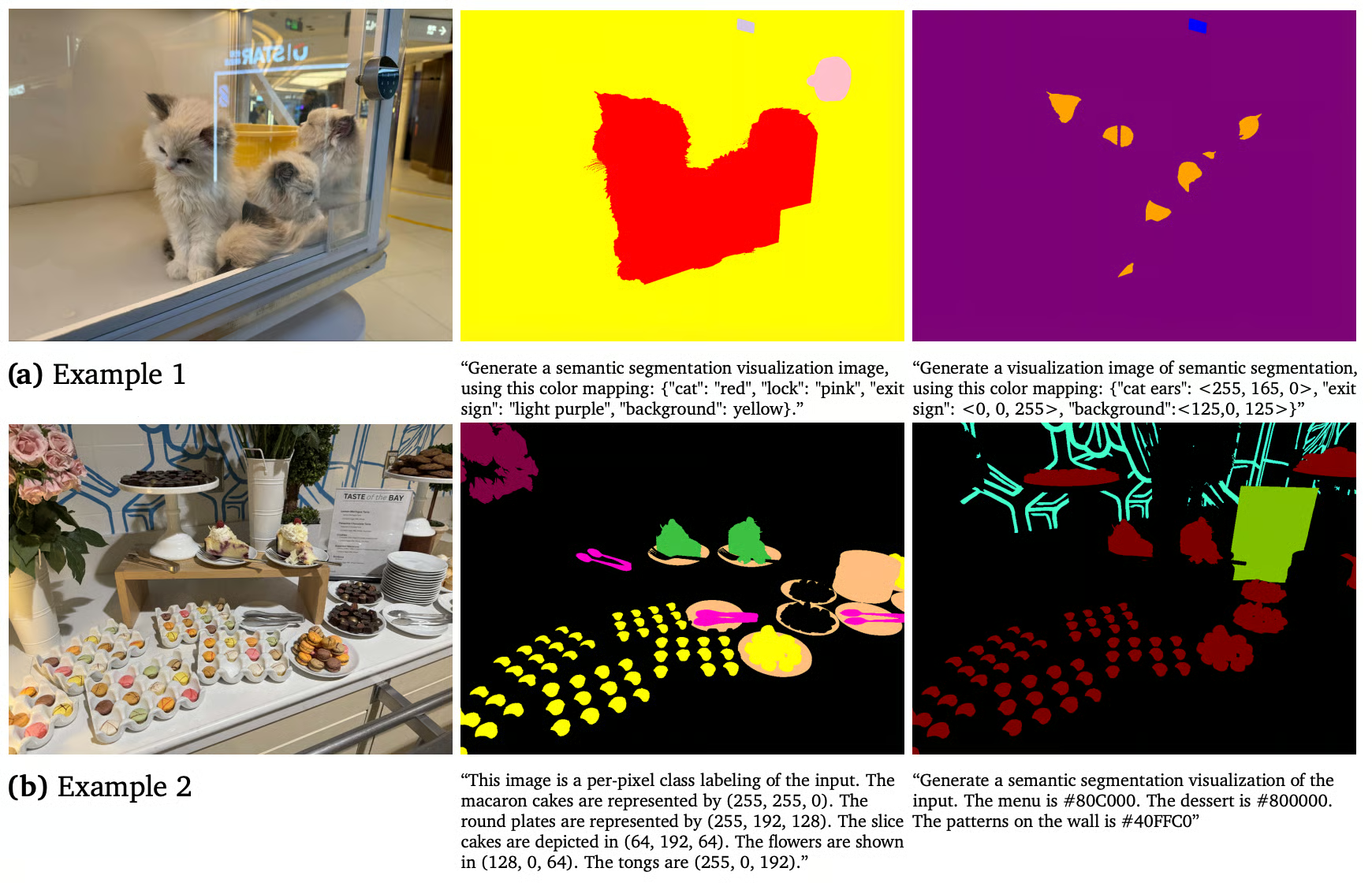

Promptați modelul cu alocări de culori pe clasă, iar la decodare grupați pixelii la cea mai apropiată culoare specificată. Vocabularul este orice puneți în prompt; este open-vocabulary prin construcție.

Va fi mai clar ce înseamnă asta când vom privi un exemplu. Iată un prompt din lucrare:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Figura 2: Segmentare semantică(Sursa)

Segmentare pe instanțe

Segmentarea pe instanțe este mai dificilă decât segmentarea semantică, deoarece numărul de instanțe nu este cunoscut dinainte. Așadar, nu puteți aloca culori în prealabil.

Soluția Vision Banana este să trateze câte o clasă per inferență, să lase modelul să aloce dinamic culori distincte instanțelor distincte, apoi la decodare să grupeze pixelii în jurul modurilor de culoare.

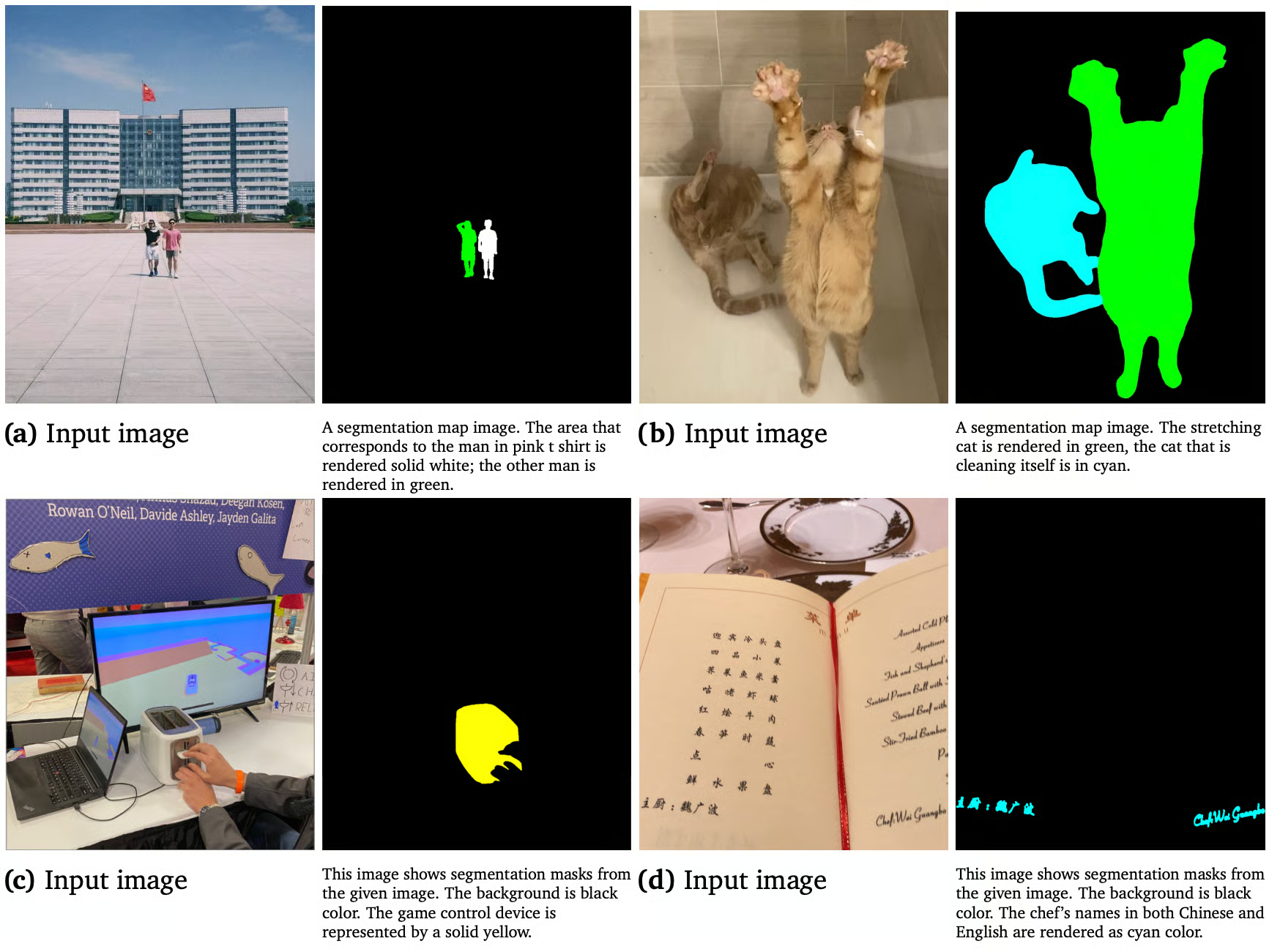

Segmentare prin expresii

Vision Banana poate primi un prompt cu o descriere în limbaj natural a ceea ce trebuie segmentat și returnează o mască. Iată un exemplu de prompt din lucrare:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Aici strălucește raționamentul multimodal încorporat în preantrenarea generativă. Modelele discriminative se luptă cu expresiile de referință deoarece sarcina necesită raționament lingvistic și vizual comun. Modelele generative antrenate pe miliarde de perechi legendă-imagine gestionează acest lucru în mod natural.

Figura 3: Vision Banana poate înțelege prompturi în limbaj natural și poate raționa pe baza lor (Sursa)

Adâncime și normale ale suprafețelor

Atât adâncimea, cât și normalele suprafețelor sunt proiectate în spațiul RGB prin mapping-uri bijective, asigurând că proprietățile geometrice latente sunt păstrate fără pierdere de informație în timpul transformării. Vom diseca specificul codificării adâncime-în-RGB în secțiunea următoare.

Acest tip unificat de inferență tratează fiecare sarcină de viziune computerizată ca pe o problemă de generare deterministă de imagini. Menținând o interfață RGB consecventă de-a lungul întregului flux, modelul evită ramurile arhitecturale specifice sarcinii, bazându-se în întregime pe condiționarea prin prompt pentru a defini semantica ieșirii.

Acum, să înțelegem adâncimea puțin mai în detaliu. Este zona în care această abordare s-ar putea destrăma cel mai ușor.

Codificarea adâncimii neîncadrate în RGB

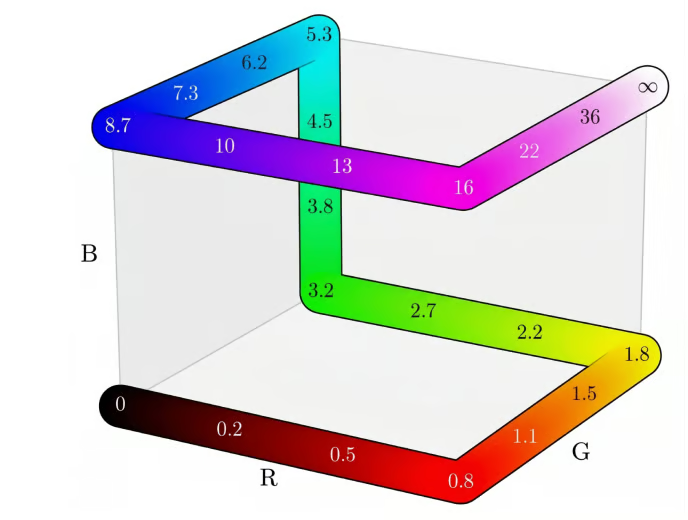

Dacă codificarea nu este bijectivă, nu puteți recupera distanțe metrice la decodare, iar întreaga afirmație „generarea de imagini ca interfață universală” se prăbușește odată cu ea. Merită înțeles, deoarece vă spune dacă abordarea este principială sau improvizată.

Problema aici este că valorile adâncimii sunt numere reale neîncadrate în [0, ∞), în timp ce RGB este încadrat în [0, 1]. Așadar, pentru a folosi „generează harta de adâncime” ca semnal de antrenare, aveți nevoie de un mapping bijectiv în care fiecare adâncime metrică se mapează exact la o valoare RGB, iar la decodare o puteți inversa înapoi în metri.

Abordarea Vision Banana are două etape:

Etapa 1: Comprimați adâncimea neîncadrată pe [0, 1)

Autorii utilizează transformarea de putere a lui Barron (2025) cu parametru de formă λ = -3, care oferă regiunilor de aproape mai multă rezoluție decât celor îndepărtate. Un obiect la 2 metri primește mai multă precizie decât unul la 200 de metri. Acest lucru se aliniază cu ceea ce interesează majoritatea aplicațiilor, adică obiectele manipulabile, nu cele îndepărtate.

Etapa 2: Mapați [0, 1) pe muchiile cubului RGB

În continuare, ei interpolează de-a lungul unei căi părți-liniare care trasează muchiile cubului RGB, practic prima iterație a unei curbe Hilbert 3D. Aceasta produce tranziții de culoare line, perceptual sensibile, fără ambiguități privind corespondența culoare–adâncime.

Deoarece ambele etape sunt strict inversabile, compunerea este o bijecție. Apoi antrenează pe adevărul de teren codificat RGB, iar la inferență proiectează RGB-ul prezis pe cea mai apropiată muchie a cubului și inversează înapoi în metri.

Figura 4: O vizualizare a bijecției dintre distanțele metrice scalare 𝑑 ≥ 0 și valorile de culoare RGB (Sursa)

Pentru robustețe, antrenarea este augmentată cu colormap-uri alternative precum Plasma, Inferno, Viridis și nivele de gri, astfel încât modelul să poată gestiona orice stil de vizualizare solicitați în prompt.

Normalele suprafețelor sunt mai ușoare deoarece sunt deja vectori unitari cu componente în [-1, 1], care se mapează direct la RGB cu convenția standard în spațiul camerei (+x dreapta, +y sus, +z spre afara planului imaginii). Așadar, verde deschis înseamnă orientat în sus, roșu-roz înseamnă orientat spre stânga, iar albastru/violet deschis înseamnă orientat spre cameră. Nu este nevoie de deformare.

Notă: Vision Banana nu folosește deloc parametri intrinseci ai camerei, nici în antrenare, nici în inferență. Majoritatea metodelor SOTA pentru adâncime (Depth Anything V3, MoGe-2, UniK3D, DepthLM) folosesc intrinseci undeva în buclă pentru că ajută la dezambiguizarea scalei monoculare.

Faptul că Vision Banana deduce scara absolută doar din priori vizuali și totuși câștigă este cea mai puternică dovadă din lucrare că preantrenarea generativă face muncă geometrică, nu doar potrivește tipare de vizualizări văzute în timpul antrenării.

Modele specializate vs Vision Banana: o comparație

Cel mai curat mod de a vedea ce este diferit este să comparăm direct cele două paradigme pe o singură sarcină. Să comparăm estimarea adâncimii cu abordarea specialistă (Marigold, Lotus, Depth Anything V3) și Vision Banana.

Cele două paradigme produc artefacte diferite. Marigold este un instrument specializat, în timp ce Vision Banana este un generalist a cărui acoperire provine dintr-un singur pas de antrenare.

Diferențele se propagă în felul în care modelul este folosit în practică:

|

Aspect |

Specialist (stil Marigold) |

Vision Banana |

|

Format ieșire |

Tensor specific sarcinii |

Imagine RGB |

|

Vocabular |

Fixat la antrenare |

Definit în prompt |

|

Multi-sarcină |

Un model per sarcină |

Un model, multe sarcini |

|

Parametri intrinseci cameră |

Adesea necesari |

Neutilizați |

|

Capacitate de generare |

Pierdută la fine-tuning |

Păstrată |

|

Cost inferență |

Scăzut |

Ridicat (generator complet de imagini) |

Benchmark-urile sunt un amestec de victorii clare și o pierdere onestă. Toate în regim zero-shot transfer, adică modelul nu a văzut niciodată diviziunile de antrenare ale benchmark-urilor de evaluare.

Profiluri de performanță superioară:

- Segmentare semantică (Cityscapes): A atins 0,699 mIoU (mean Intersection over Union), depășind Segment Anything Model (SAM 3) specializat, cu 0,652.

- Segmentare prin referință (RefCOCOg): A demonstrat 0,738 cIoU (cumulative IoU), peste baza SAM 3 Agent la 0,734.

- Raționament vizual complex (ReasonSeg): Atunci când este utilizat împreună cu Gemini 2.5 Pro, a obținut 0,793 gIoU, depășind SAM 3 Agent (0,770) și stabilind un nou SOTA zero-shot, chiar și în raport cu metodologii full-supervised non-zero-shot.

- Estimarea metrică a adâncimii: A înregistrat o medie

δ(acuratețe la prag) de 0,929 pe patru seturi de date diverse, îmbunătățind rezultatul Depth Anything V3 de 0,918. - Estimarea normalelor suprafeței: A înregistrat o medie mai mică a erorii unghiulare de 15,549° pe trei seturi de date indoor, demonstrând fidelitate geometrică superioară față de Lotus-2 (16,558°).

Deficit de performanță:

- Segmentare pe instanțe (SA-Co/Gold): Performanța a fost 0,540 pmF1 (evaluat pe un eșantion de 500 de interogări din SA-Co/Gold, nu pe întregul benchmark), în urma SAM 3 non-zero-shot (0,661) și la egalitate cu DINO-X zero-shot (0,552). Acest rezultat probabil provine din constrângerea alocării discrete a culorilor pentru cardinalitatea instanțelor, care limitează rezoluția în scene foarte dense.

Pe GenAI-Bench, Vision Banana câștigă 53,5% din comparațiile umane față de Nano Banana Pro de bază. Iată un exemplu de test in-the-wild de aliniere din lucrare:

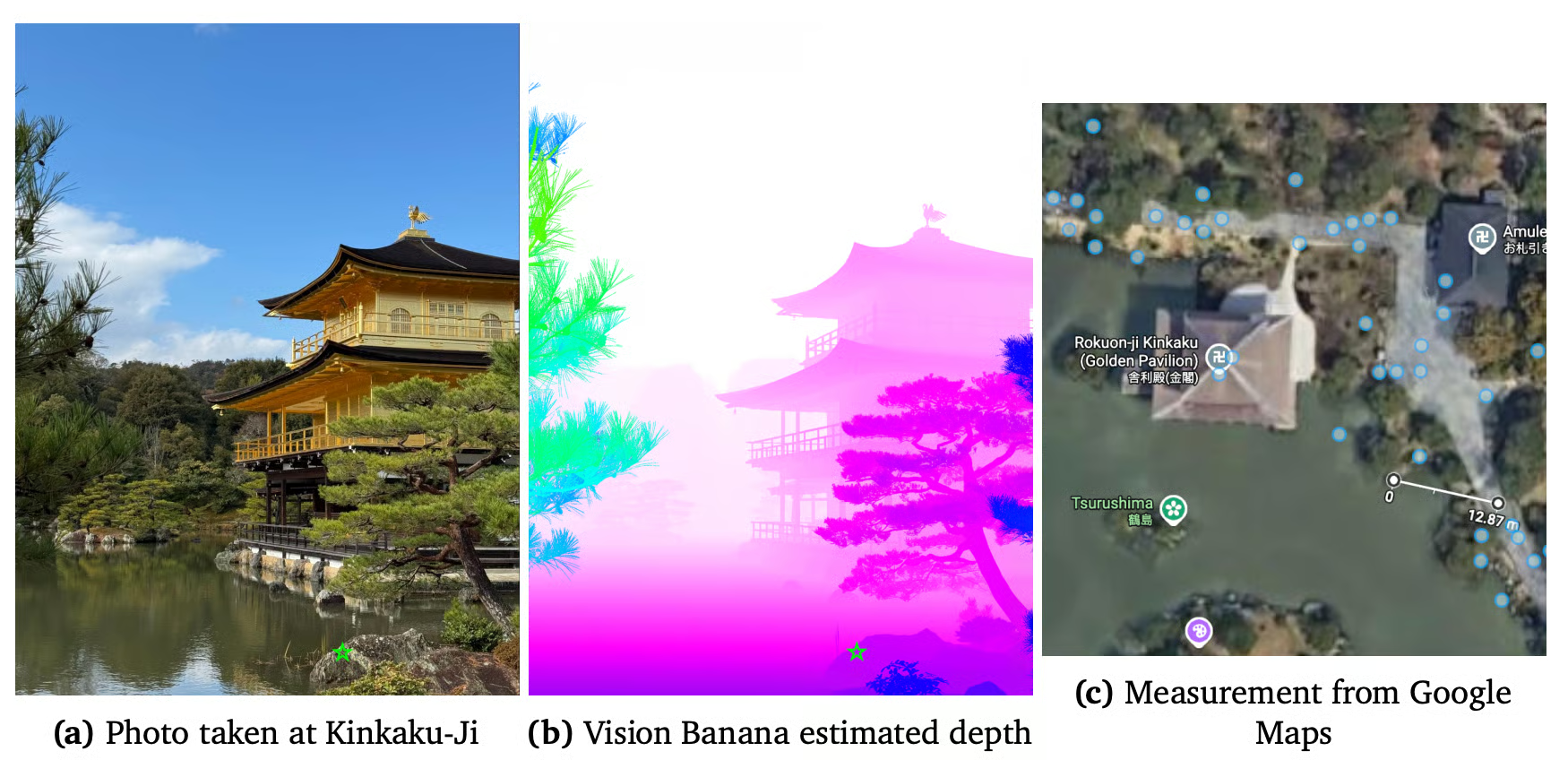

Figura 5: Estimarea adâncimii cu Vision Banana (Sursa)

Un autor a făcut o fotografie cu smartphone-ul lângă Kinkaku-Ji. Vision Banana a prezis un punct specific la 13,71 metri. Google Maps indică 12,87, adică 6,5% eroare relativă absolută pe o fotografie de telefon fără calibrare, fără intrinseci, fără setup. Acesta este genul de test care prezice comportamentul în producție mai fiabil decât cifrele de pe benchmark-uri.

Limitările Vision Banana

Vision Banana are patru constrângeri care merită semnalate. Acestea includ:

- Cost: Rularea unui model de anvergura Nano Banana Pro pentru fiecare inferență este mult mai scumpă decât rularea unui specialist distilat pentru adâncime. Lucrarea recunoaște direct acest lucru în secțiunea de viitoare direcții. Pentru 10.000 de cadre video, această abordare nu este competitivă economic astăzi. Distilarea în specialiști mai mici este următorul pas evident.

- Scene cu multe instanțe: SA-Co/Gold este pierderea clară. Alocarea de culori per clasă rămâne fără spațiu atunci când multe obiecte mici trebuie numărate precis. SAM 3 încă învinge aici.

- O singură imagine: Implementarea actuală a modelului este fundamental limitată la intrări statice, dintr-o singură vedere, fără capacitate de procesare spatio-temporală sau multi-view. Raționamentul temporal este desemnat pentru lucrări viitoare de către autori.

- Implementare black-box: Nu puteți sonda, modifica sau rula modelul în privat. Acest lucru contează în contexte reglementate sau sensibile la PI în care rularea unui API de vârf nu este o opțiune.

Gânduri finale

Vision Banana este o demonstrație concretă că generatorii de imagini deja fac partea grea pentru înțelegerea vizuală și că aducerea acestor capabilități la suprafață necesită aliniere, nu arhitecturi noi.

Contribuțiile specifice ale lucrării sunt

- Codificare RGB bijectivă care face din adâncime și segmentare probleme de generare de imagini inversabile

- Rețetă ușoară de instruction-tuning care adaugă abilități de viziune fără a arde priorul de generare

- Estimare metrică a adâncimii fără parametri intrinseci ai camerei, care îi depășește pe specialiștii ce îi necesită

- Protocol strict de transfer zero-shot care face afirmația de generalist măsurabilă pe benchmark-urile standard.

Lucrarea promovează, de asemenea, un model mental „generation-first” în care sarcinile sunt specificate prin prompt, iar ieșirile sunt decodate înapoi din imagini RGB, iar aceleași greutăți se ocupă atât de producerea, cât și de interpretarea conținutului vizual.

Puteți testa prompturile de pe pagina proiectului pe Nano Banana Pro de bază sau pe Nano Banana 2 pentru a vedea ce este deja accesibil fără instruction tuning, să construiți funcționalități de reasoning-segmentation cu modele de clasa NBP și un router LLM multimodal, în loc să antrenați direct fluxuri personalizate.

Întrebări frecvente despre Vision Banana

Cum pot folosi Vision Banana astăzi?

Nu. Lucrarea și pagina proiectului sunt publice, dar greutățile modelului sunt la Google DeepMind. Modelul de bază, Nano Banana Pro, este disponibil în Gemini API și AI Studio, iar teza propriei lucrări sugerează că promptarea directă a NBP cu prompturile de pe pagina proiectului ar trebui să producă deja rezultate semnificative.

Poate Vision Banana să înlocuiască SAM 3 sau Depth Anything?

Nu astăzi, în principal din cauza costurilor. Pentru aplicații în care trebuie să rulați inferență vizuală ieftin, la scară (video, timp real, mobil), specialiștii câștigă încă din punct de vedere economic.

Cum se compară acest lucru cu MLLM-uri precum GPT-5V sau Gemini 2.5?

LLM-urile multimodale primesc o imagine și produc text. Vision Banana primește o imagine și un prompt pentru a produce o imagine. Rezolvă probleme diferite.

De ce nu folosește Vision Banana parametrii intrinseci ai camerei pentru adâncime?

Majoritatea specialiștilor folosesc intrinseci pentru a dezambiguiza scara monoculară (un obiect mic de aproape și un obiect mare de departe pot produce pixeli identici). Totuși, Vision Banana deduce scara din priori vizuali învățați în timpul preantrenării generative despre dimensiunile obiectelor, contextul scenelor și cunoașterea lumii.