Lernpfad

In der Computer Vision gab es lange eine klare Trennung zwischen Modellen, die Bilder erzeugen, und Modellen, die sie verstehen. Generative Frameworks waren die erste Wahl für Synthese, während diskriminative Architekturen sich auf Klassifikation, Segmentierung oder Tiefenschätzung konzentrierten. Das Standardvorgehen für neue Vision-Aufgaben war: Architektur wählen, einen aufgabenspezifischen Kopf anflanschen und auf gelabelten Daten feinabstimmen.

Genau diese Annahme stellt Vision Banana von Google DeepMind auf den Kopf. Das Paper argumentiert, dass Bildgeneratoren bereits alles gelernt haben, was ein generalistisches Vision-Modell braucht – inklusive Segmentierung, Tiefe, Oberflächennormalen und mehr. Aus Sicht der Autorinnen und Autoren fehlt nur noch eine dünne Instruction-Tuning-Schicht, damit sich diese latenten Fähigkeiten in Benchmarks messen lassen.

In diesem Beitrag starte ich mit dem, was Vision Banana tatsächlich ist und warum das Paper die Aufmerksamkeit des Feldes auf sich zieht, erkläre dann Schritt für Schritt, wie das Modell funktioniert. Zum Schluss geht es darum, was gut klappt, was nicht – und was Praktiker daraus mitnehmen sollten. Unterwegs greife ich die Fragen auf, die ich beim Lesen hatte. Viele dürften die gleichen haben.

Hinweis: Vision Banana selbst ist nicht öffentlich zugänglich. Verfügbar sind das Paper und die Projektseite. Das Basismodell baut auf Nano Banana Pro auf und ist über die Gemini API und Google AI Studio erreichbar.

Was ist Vision Banana?

Vision Banana ist ein Forschungsmodell von Google DeepMind. Es nimmt Nano Banana Pro (einen Text-zu-Bild-Generator) und führt ein leichtgewichtiges Instruction Tuning auf einer Mischung aus den ursprünglichen Trainingsdaten plus einer kleinen Menge klassischer Computer-Vision-Aufgaben durch.

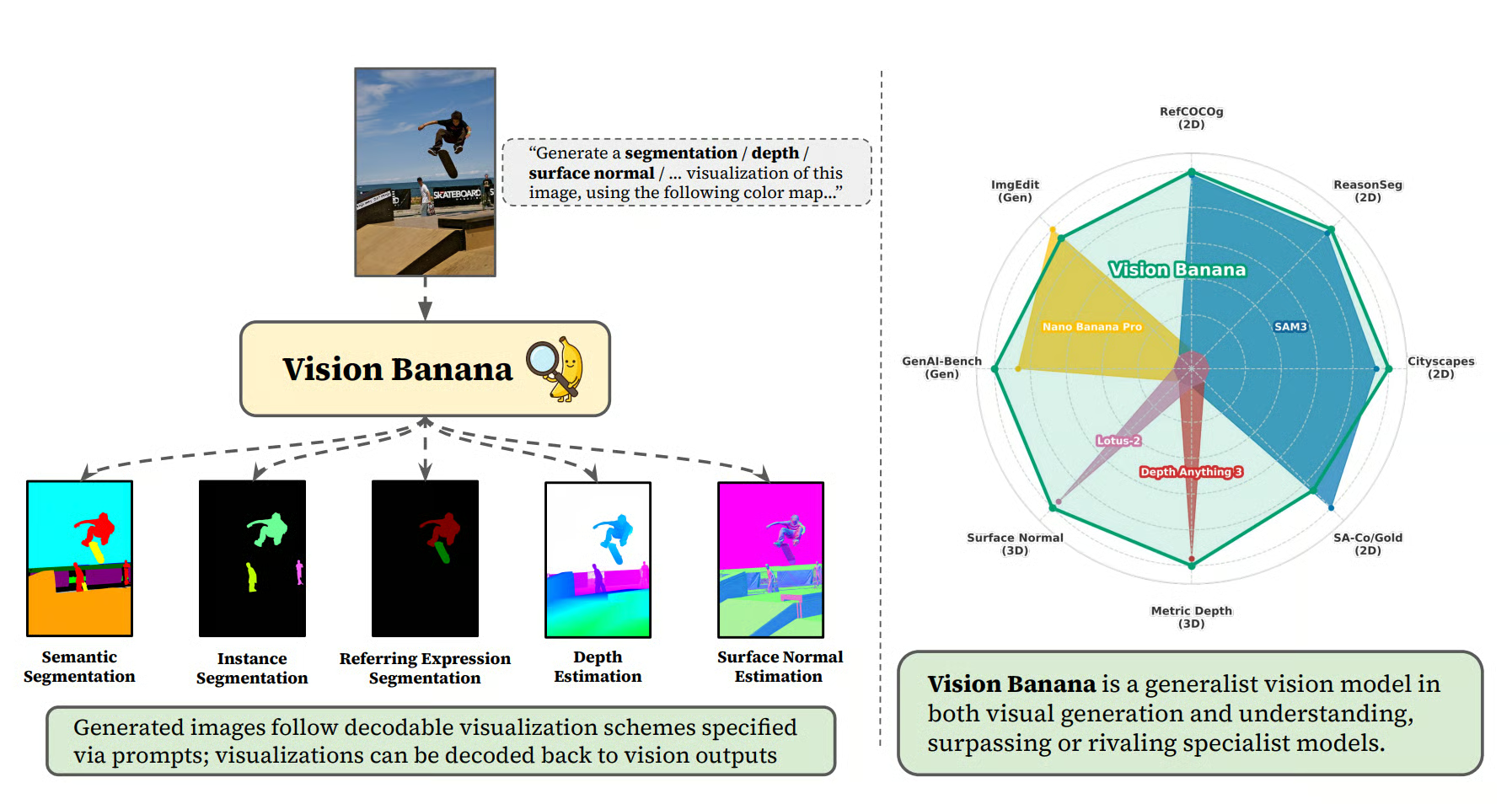

Abbildung 1: Verborgenes visuelles Verständnis in Bildgeneratoren durch Instruction Tuning von Nano Banana Pro (Quelle)

Das Rezept lautet:

- Die Architektur des Basismodells unverändert lassen

- Segmentation-, Tiefen- und Oberflächennormalen-Daten in geringem Anteil in die Trainingsverteilung mischen

- Instruction-Tuning durchführen

Die gesamte Trainingsmethodik benötigt keine neue Architektur, keine Custom-Heads, keine Zusatzverluste und keine spezialisierten Decoder.

Das resultierende Modell:

- Übertrifft SAM 3 auf drei Segmentierungs-Benchmarks

- Übertrifft Depth Anything V3 bei metrischer Tiefenschätzung

- Übertrifft Lotus-2 bei der Schätzung von Oberflächennormalen

- Behält die Bildgenerierungsqualität des Basismodells bei (statistisch gleichauf auf GenAI-Bench und ImgEdit)

All das unter einem strikten Zero-Shot-Transfer-Protokoll, das sicherstellt, dass das Modell die Trainingssplits der evaluierten Benchmarks nie gesehen hat.

Warum ist das wichtig?

Das Lernen von Vision-Repräsentationen hat viele Pretraining-Ziele ausprobiert. Übliche sind:

- Überwachte Klassifikation (ImageNet, JFT)

- Kontrastives Lernen (CLIP, SigLIP)

- Selbst-Distillation (DINO, DINOv2)

- Maskiertes Autoencoding (MAE, BEiT)

Wichtig ist: Keines davon ist generativ. Bildgenerierung wurde historisch als nachgelagerte Fähigkeit behandelt, nicht als Fundament fürs Verständnis. Frühe generative Pretraining-Versuche (iGPT, LVM) lagen bei Repräsentationsbenchmarks konstant hinter kontrastiven Methoden.

Das Skalieren generativer autoregressiver Ziele über Next-Token-Vorhersage hat in Modellen wie GPT-3 das Entstehen von Zero-Shot-Generalisten ausgelöst. Komplexe Downstream-Verhaltensweisen waren latent im hochdimensionalen Gewichtsraum vorhanden und wurden anschließend durch leichtes überwachtens Fine-Tuning und Instruction Alignment freigelegt. Beispiele:

- Neuronale maschinelle Übersetzung

- Polyglotte Code-Synthese

- Abstrakte Zusammenfassungen

- Arithmetisches Schlussfolgern

Vision Banana behauptet, dass wir an demselben Punkt für Vision angekommen sind. Das Paper zieht explizit die Analogie zwischen Bildgenerierungs-Pretraining und Sprachmodell-Pretraining sowie zwischen Instruction Tuning und dem Alignment-Schritt.

Hält die Analogie, hören wir auf, aufgabenspezifische Pipelines zu bauen, und verwenden einen einzigen großen Bildgenerator als Fundament, wobei Aufgaben per Prompt spezifiziert werden.

Wie funktioniert Vision Banana?

Der Mechanismus ist simpel: Jede Vision-Aufgabe wird als „Erzeuge ein RGB-Bild mit diesen Eigenschaften“ umgedeutet, und zur Decodierzeit wandelst du dieses RGB-Bild deterministisch in Aufgabenprädiktionen zurück.

So wird jede Aufgabe abgebildet:

Semantische Segmentierung

Das Modell wird mit klassenweisen Farbzuweisungen gepromptet; beim Decodieren werden Pixel auf die nächstgelegene angegebene Farbe geclustert. Das Vokabular ist, was immer du in den Prompt schreibst – Open Vocabulary per Konstruktion.

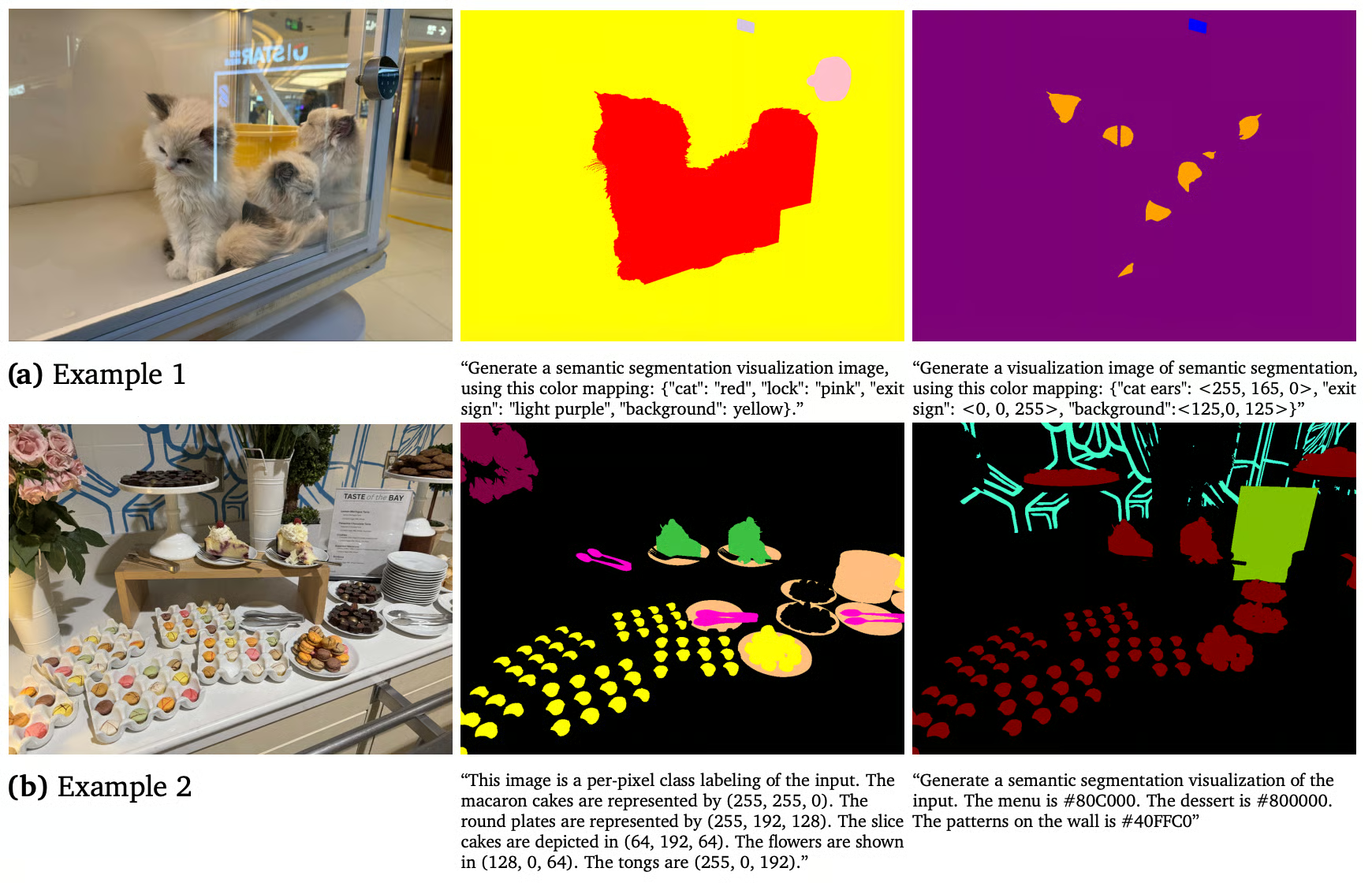

Das wird klarer mit einem Beispiel. Hier ist ein Prompt aus dem Paper:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Abbildung 2: Semantische Segmentierung (Quelle)

Instanzsegmentierung

Instanzsegmentierung ist schwieriger als semantische Segmentierung, weil die Anzahl der Instanzen nicht im Voraus bekannt ist. Farben lassen sich daher nicht vorab zuweisen.

Die Lösung von Vision Banana: Pro Inferenz eine Klasse, das Modell weist unterschiedlichen Instanzen dynamisch unterschiedliche Farben zu, und beim Decodieren werden Pixel auf die Farbmoden geclustert.

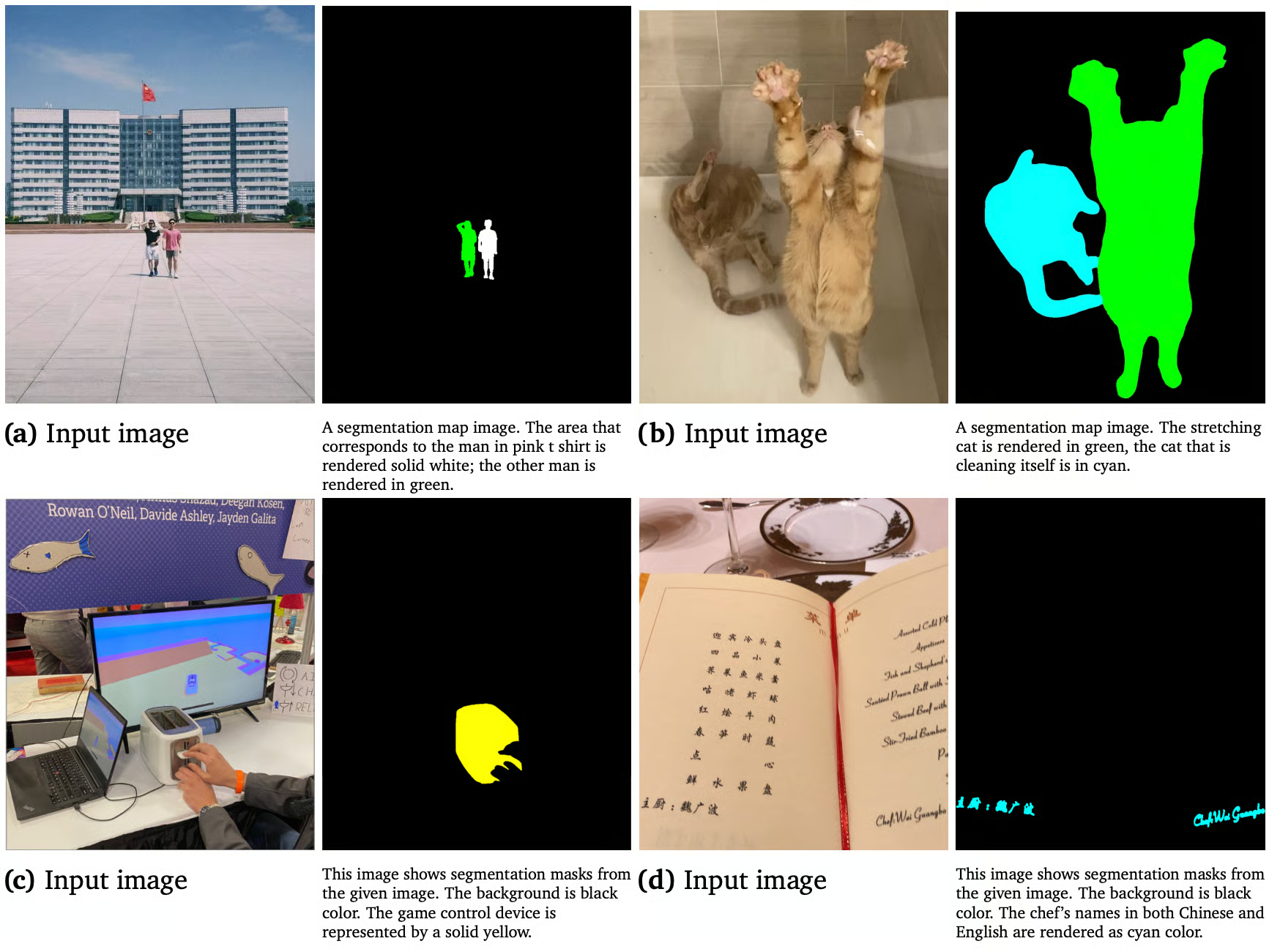

Expression-Segmentierung

Vision Banana kann einen Prompt mit einer natürlichen Sprachbeschreibung dessen, was segmentiert werden soll, entgegennehmen und eine Maske zurückgeben. Hier ein Beispielprompt aus dem Paper:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Hier glänzt das in der generativen Vortrainierung verankerte multimodale Denken. Diskriminative Modelle tun sich mit referenziellen Ausdrücken schwer, weil die Aufgabe gemeinsames sprachliches und visuelles Schlussfolgern erfordert. Generative Modelle, die auf Milliarden Bild-Untertitel-Paaren trainiert wurden, bewältigen das natürlich.

Abbildung 3: Vision Banana versteht natürliche Sprachprompts und kann darüber schlussfolgern (Quelle)

Tiefe und Oberflächennormalen

Sowohl Tiefe als auch Oberflächennormalen werden über bijektive Abbildungen in den RGB-Raum projiziert, sodass die latenten geometrischen Eigenschaften ohne Informationsverlust erhalten bleiben. Im nächsten Abschnitt zerlegen wir die Details der Tiefen-zu-RGB-Codierung.

Dieses einheitliche Inferenzparadigma behandelt jede Computer-Vision-Aufgabe als deterministisches Bildgenerationsproblem. Durchgängig eine konsistente RGB-Schnittstelle zu halten, vermeidet aufgabenspezifische Architekturzweige und verlässt sich vollständig auf Prompt-Conditioning, um die Output-Semantik zu definieren.

Schauen wir uns nun Tiefe etwas genauer an. Hier könnte der Ansatz am ehesten scheitern.

Unbegrenzte Tiefe in RGB codieren

Wenn die Codierung nicht bijektiv ist, kannst du metrische Distanzen beim Decodieren nicht zurückgewinnen – und damit fällt die gesamte These „Bildgenerierung als universelle Schnittstelle“ in sich zusammen. Das zu verstehen lohnt sich, weil es zeigt, ob der Ansatz grundsolide oder nur ein Hack ist.

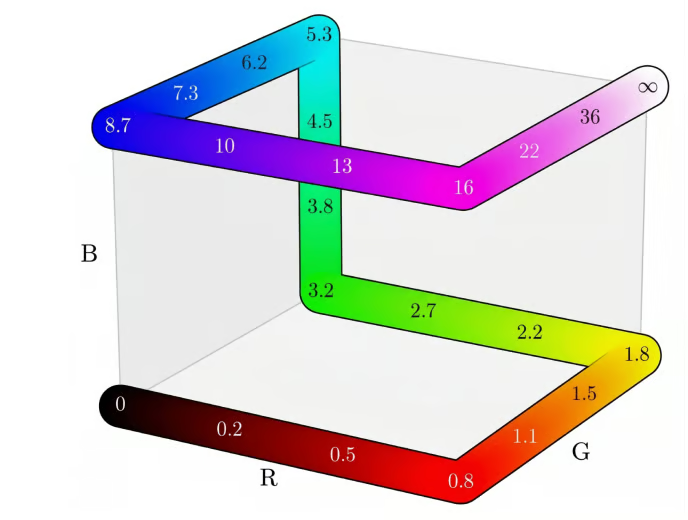

Das Problem: Tiefenwerte sind unbeschränkte reelle Zahlen in [0, ∞), während RGB auf [0, 1] begrenzt ist. Um „erzeuge die Tiefenkarte“ als Trainingssignal zu nutzen, brauchst du eine bijektive Abbildung, bei der jede metrische Tiefe genau einem RGB-Wert entspricht und sich zur Inferenzezeit wieder in Meter invertieren lässt.

Der Ansatz von Vision Banana hat zwei Stufen:

Stufe 1: Unbeschränkte Tiefe auf [0, 1) komprimieren

Die Autorinnen und Autoren verwenden die Power-Transformation nach Barron (2025) mit Formparameter λ = -3, die dem Nahbereich mehr Auflösung gibt als dem Fernbereich. Ein Objekt in 2 Metern Entfernung bekommt mehr Präzision als eines in 200 Metern. Das passt zu den meisten Anwendungen: greifbare Objekte sind wichtiger als ferne.

Stufe 2: [0, 1) auf die Kanten des RGB-Würfels abbilden

Anschließend wird entlang eines stückweise linearen Pfads interpoliert, der die Kanten des RGB-Würfels nachzeichnet – im Wesentlichen die erste Iteration einer 3D-Hilbertkurve. Das erzeugt weiche, wahrnehmbar sinnvolle Farbverläufe ohne Mehrdeutigkeit, welche Farbe welcher Tiefe entspricht.

Da beide Stufen strikt invertierbar sind, ist die Komposition eine Bijektion. Trainiert wird auf RGB-codierter Ground Truth; zur Inferenz projiziert man das vorhergesagte RGB auf die nächste Würfelkante und invertiert zurück in Meter.

Abbildung 4: Visualisierung der Bijektion zwischen skalaren metrischen Distanzen d ≥ 0 und RGB-Farbwerten (Quelle)

Für Robustheit wird mit alternativen Colormaps wie Plasma, Inferno, Viridis und Graustufen augmentiert, damit das Modell die jeweils im Prompt gewünschte Visualisierung verarbeiten kann.

Oberflächennormalen sind einfacher, weil sie bereits Einheitsvektoren mit Komponenten in [-1, 1] sind – das lässt sich direkt mittels der Standardkonvention im Kameraraum auf RGB abbilden (+x rechts, +y oben, +z aus der Bildebene heraus). Hellgrün bedeutet „nach oben“, rötlich-rosa „nach links“ und hellblau/violett „zur Kamera“. Keine Verzerrung nötig.

Hinweis: Vision Banana verwendet keine Kameraintrinsiken – weder im Training noch in der Inferenz. Die meisten SOTA-Tiefenmethoden (Depth Anything V3, MoGe-2, UniK3D, DepthLM) nutzen Intrinsiken irgendwo in der Schleife, weil sie helfen, die monokulare Skala zu entwirren.

Dass Vision Banana die absolute Skala allein aus visuellen Priors erschließt – und dabei gewinnt – ist das stärkste Indiz im Paper, dass generatives Pretraining tatsächlich Geometrie lernt und nicht nur Visualisierungen aus dem Training wiedererkennt.

Spezialisten vs. Vision Banana: Ein Vergleich

Am saubersten sieht man die Unterschiede, wenn man beide Paradigmen an einer Aufgabe direkt vergleicht. Nehmen wir Tiefenschätzung mit dem Spezialistenansatz (Marigold, Lotus, Depth Anything V3) vs. Vision Banana.

Die Paradigmen erzeugen unterschiedliche Artefakte. Marigold ist ein Spezialwerkzeug, Vision Banana ein Generalist, dessen Breite aus einem einzigen Trainingsschritt stammt.

Die Unterschiede wirken sich darauf aus, wie das Modell in der Praxis eingesetzt wird:

|

Aspekt |

Spezialist (Marigold-Stil) |

Vision Banana |

|

Ausgabeformat |

Aufgabenspezifischer Tensor |

RGB-Bild |

|

Vokabular |

Beim Training festgelegt |

Im Prompt definiert |

|

Multitask |

Ein Modell pro Aufgabe |

Ein Modell, viele Aufgaben |

|

Kameraintrinsiken |

Oft erforderlich |

Nicht verwendet |

|

Generierungsfähigkeit |

Geht im Finetuning verloren |

Bleibt erhalten |

|

Inference-Kosten |

Niedrig |

Hoch (voller Bildgenerator) |

Die Benchmark-Ergebnisse sind ein Mix aus klaren Siegen und einer ehrlichen Niederlage – alles unter Zero-Shot-Transfer, d. h. das Modell hat die Trainingssplits der Evaluationsbenchmarks nie gesehen.

Überlegene Leistungen:

- Semantische Segmentierung (Cityscapes): Erreicht 0,699 mIoU (mean Intersection over Union) und übertrifft das spezialisierte Segment Anything Model (SAM 3) mit 0,652.

- Referring-Segmentierung (RefCOCOg): Erzielt 0,738 cIoU (kumulative IoU) und liegt über der SAM-3-Agent-Baseline von 0,734.

- Komplexes visuelles Schlussfolgern (ReasonSeg): In Kombination mit Gemini 2.5 Pro werden 0,793 gIoU erreicht – besser als der SAM-3-Agent mit 0,770 und ein neuer Zero-Shot-Stand der Technik, sogar gegenüber nicht‑Zero‑Shot, vollüberwachten Methoden.

- Metrische Tiefenschätzung: Durchschnittliches

δ(Threshold Accuracy) von 0,929 über vier unterschiedliche Datensätze, besser als Depth Anything V3 mit 0,918. - Schätzung von Oberflächennormalen: Niedrigerer durchschnittlicher mittlerer Winkel-Fehler von 15,549° über drei Indoor-Datensätze und damit höhere geometrische Treue als Lotus-2 (16,558°).

Leistungsdefizit:

- Instanzsegmentierung (SA-Co/Gold): 0,540 pmF1 (auf einer 500-Query-Stichprobe von SA-Co/Gold evaluiert, nicht auf dem vollständigen Benchmark), hinter dem nicht‑Zero‑Shot SAM 3 (0,661) und auf Augenhöhe mit dem Zero-Shot DINO-X (0,552). Ursache ist vermutlich die Einschränkung diskreter Farbzuweisung für die Anzahl der Instanzen, was die Auflösung in sehr dichten Szenen begrenzt.

Auf GenAI-Bench gewinnt Vision Banana 53,5% der menschlichen Vergleiche gegen das Basismodell Nano Banana Pro. Hier ein Beispiel für einen Grounding-Test „in the wild“ aus dem Paper:

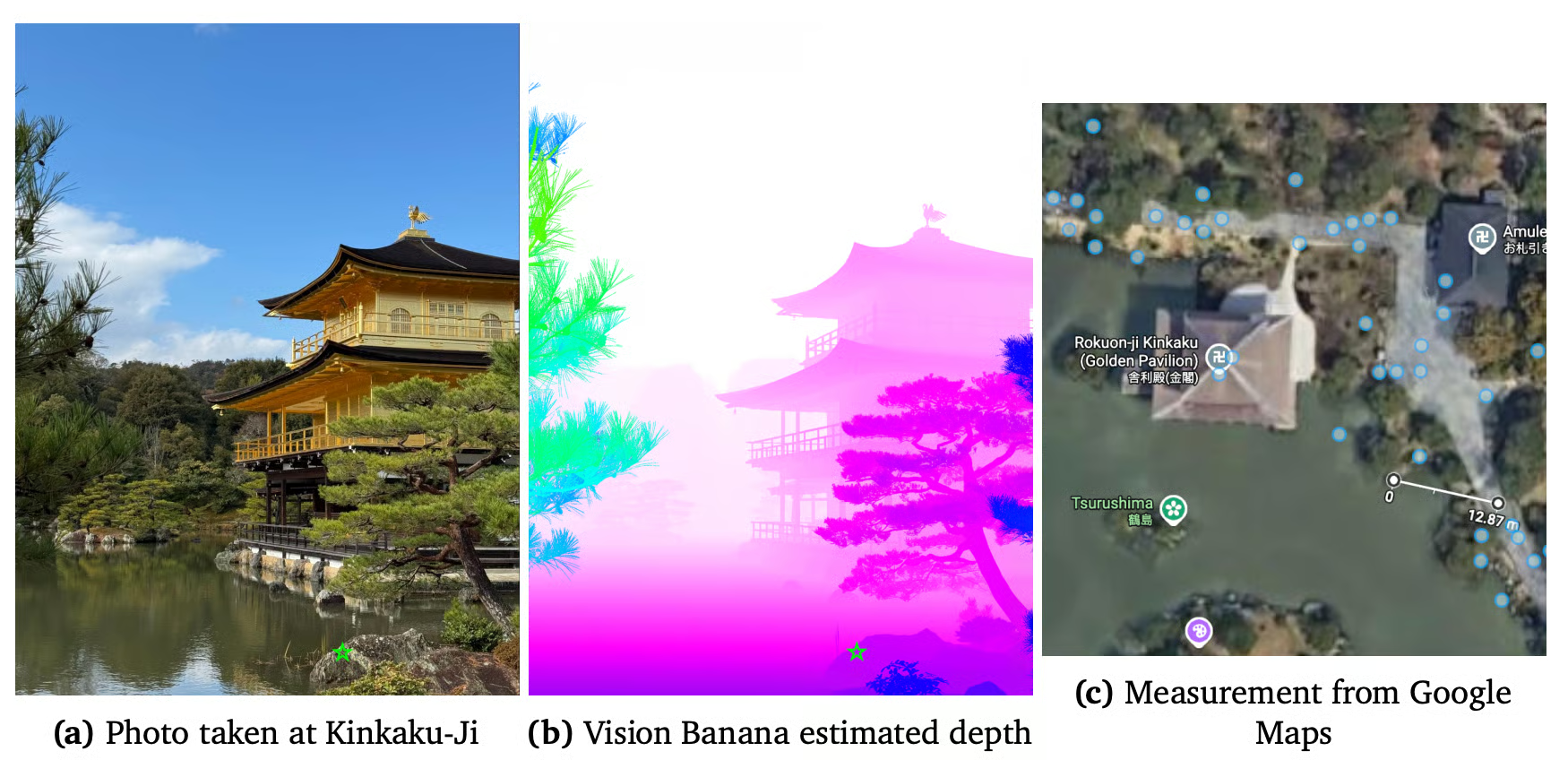

Abbildung 5: Vision Banana Tiefenschätzung (Quelle)

Eine Autorin nahm ein Smartphone-Foto nahe Kinkaku‑Ji auf. Vision Banana schätzte einen bestimmten Punkt auf 13,71 Meter. Google Maps meldet 12,87 – das sind 6,5% absoluter relativer Fehler auf einem Handyfoto ohne Kalibrierung, ohne Intrinsiken, ohne Setup. Solche Tests sagen das Verhalten im Einsatz oft besser voraus als Benchmarkzahlen.

Einschränkungen von Vision Banana

Vision Banana hat vier nennenswerte Einschränkungen:

- Kosten: Ein Modell in der Größenordnung von Nano Banana Pro für jede Inferenz auszuführen, ist deutlich teurer als ein destillierter Tiefenspezialist. Das Paper benennt das im Abschnitt „Future Work“ klar. Für 10.000 Videoframes ist der Ansatz heute wirtschaftlich nicht konkurrenzfähig. Distillation in kleinere Spezialisten ist der naheliegende nächste Schritt.

- Instanzreiche Szenen: SA-Co/Gold ist die klare Niederlage. Pro‑Klasse‑Farbzuweisung stößt an Grenzen, wenn viele kleine Objekte präzise gezählt werden müssen. Hier gewinnt SAM 3 weiterhin.

- Einzelbild: Die aktuelle Implementierung ist grundsätzlich auf statische Einzelansichten begrenzt und kann weder spatio‑temporale noch Multi‑View‑Eingaben verarbeiten. Zeitliche Modellierung steht laut Autorinnen und Autoren auf der Roadmap.

- Black-Box-Einsatz: Du kannst das Modell nicht untersuchen, modifizieren oder privat ausführen. Das ist relevant in regulierten oder IP-sensiblen Kontexten, in denen ein Frontier-API-Einsatz nicht in Frage kommt.

Fazit

Vision Banana zeigt konkret: Bildgeneratoren leisten bereits die Schwerarbeit fürs visuelle Verständnis – und um diese Fähigkeiten nutzbar zu machen, braucht es Alignment statt neuer Architekturen.

Die spezifischen Beiträge des Papers sind

- Bijektive RGB-Codierung, die Tiefe und Segmentierung zu invertierbaren Bildgenerationsproblemen macht

- Leichtgewichtiges Instruction-Tuning, das Visionskills ergänzt, ohne den Generierungs-Prior zu zerstören

- Metrische Tiefenschätzung ohne Kameraintrinsiken, die Spezialisten übertrifft, die diese benötigen

- Striktes Zero-Shot-Transfer-Protokoll, das die Generalisten-These auf Standardbenchmarks messbar macht

Das Paper propagiert zudem ein „Generation-first“-Denkmuster, bei dem Aufgaben per Prompt spezifiziert und Outputs aus RGB-Bildern zurückdecodiert werden – und bei dem dieselben Gewichte sowohl das Erzeugen als auch das Parsen visueller Inhalte übernehmen.

Du kannst die Prompts der Projektseite gegen das Basismodell Nano Banana Pro oder Nano Banana 2 testen, um zu sehen, was ohne Instruction Tuning bereits möglich ist – und Reasoning‑Segmentierungsfunktionen mit NBP‑Klasse‑Modellen und einem multimodalen LLM-Router bauen, statt sofort eigene Pipelines zu trainieren.

Vision Banana FAQs

Wie kann ich Vision Banana heute nutzen?

Nein. Das Paper und die Projektseite sind veröffentlicht, aber die Modellgewichte liegen bei Google DeepMind. Das Basismodell, Nano Banana Pro, ist in der Gemini API und im AI Studio verfügbar. Laut der These des Papers sollten schon direktes Prompten von NBP mit den Prompts der Projektseite sinnvolle Ergebnisse liefern.

Kann Vision Banana SAM 3 oder Depth Anything ersetzen?

Heute noch nicht, vor allem aus Kostengründen. Für Anwendungen, in denen du Vision-Inferenz günstig in großem Maßstab benötigst (Video, Echtzeit, Mobile), gewinnen Spezialisten wirtschaftlich weiterhin.

Wie vergleicht sich das mit MLLMs wie GPT-5V oder Gemini 2.5?

Multimodale LLMs nehmen ein Bild und erzeugen Text. Vision Banana nimmt ein Bild und einen Prompt und erzeugt ein Bild. Sie lösen unterschiedliche Probleme.

Warum nutzt Vision Banana keine Kameraintrinsiken für Tiefe?

Die meisten Spezialisten nutzen Intrinsiken, um die monokulare Skala zu entwirren (ein kleines nahes Objekt und ein großes fernes können identische Pixel erzeugen). Vision Banana hingegen leitet die Skala aus visuellen Priors ab, die während der generativen Vortrainierung über Objektgrößen, Szenenkontext und Weltwissen gelernt wurden.

Ich bin Google Developers Expertin für ML (Gen AI), dreifache Kaggle-Expertin und Women-Techmakers-Botschafterin mit über drei Jahren Erfahrung in der Tech-Branche. 2020 habe ich ein Health-Tech-Startup mitgegründet und absolviere derzeit einen Master in Informatik an der Georgia Tech mit Schwerpunkt Machine Learning.