programa

La visión por computador siempre ha mantenido una separación nítida entre los modelos que generan imágenes y los que las entienden. Los marcos generativos eran la fuente principal para la síntesis, mientras que las arquitecturas discriminativas se centraban en clasificación, segmentación o regresión de profundidad. El manual habitual para cualquier tarea nueva de visión era elegir una arquitectura, añadir una cabeza específica para la tarea y afinar con datos etiquetados.

Esa suposición es justo lo que quiere romper Vision Banana de Google DeepMind. El paper sostiene que los generadores de imágenes ya han aprendido todo lo que necesita un modelo de visión generalista, incluida la segmentación, la profundidad, las normales de superficie y más. En opinión de los autores, solo falta una fina capa de ajuste por instrucciones para hacer que esas capacidades latentes sean medibles en benchmarks.

En este post, empezaré por qué es exactamente Vision Banana y por qué el paper ha llamado la atención del sector, para luego explicar cómo funciona el modelo. Terminaré con lo que funciona, lo que no y qué deberían sacar en claro los profesionales. Por el camino, destacaré las preguntas que me surgieron al leer el paper. Es probable que otros lectores tengan las mismas.

Nota: Vision Banana en sí no es público. Lo que está disponible es el paper y la página del proyecto. El modelo base se construye sobre Nano Banana Pro y está disponible a través de la API de Gemini y Google AI Studio.

¿Qué es Vision Banana?

Vision Banana es un modelo de investigación de Google DeepMind, creado partiendo de Nano Banana Pro (generador texto-a-imagen) y aplicando un ajuste ligero por instrucciones con una mezcla de sus datos de entrenamiento originales y una pequeña cantidad de datos de tareas de visión por computador.

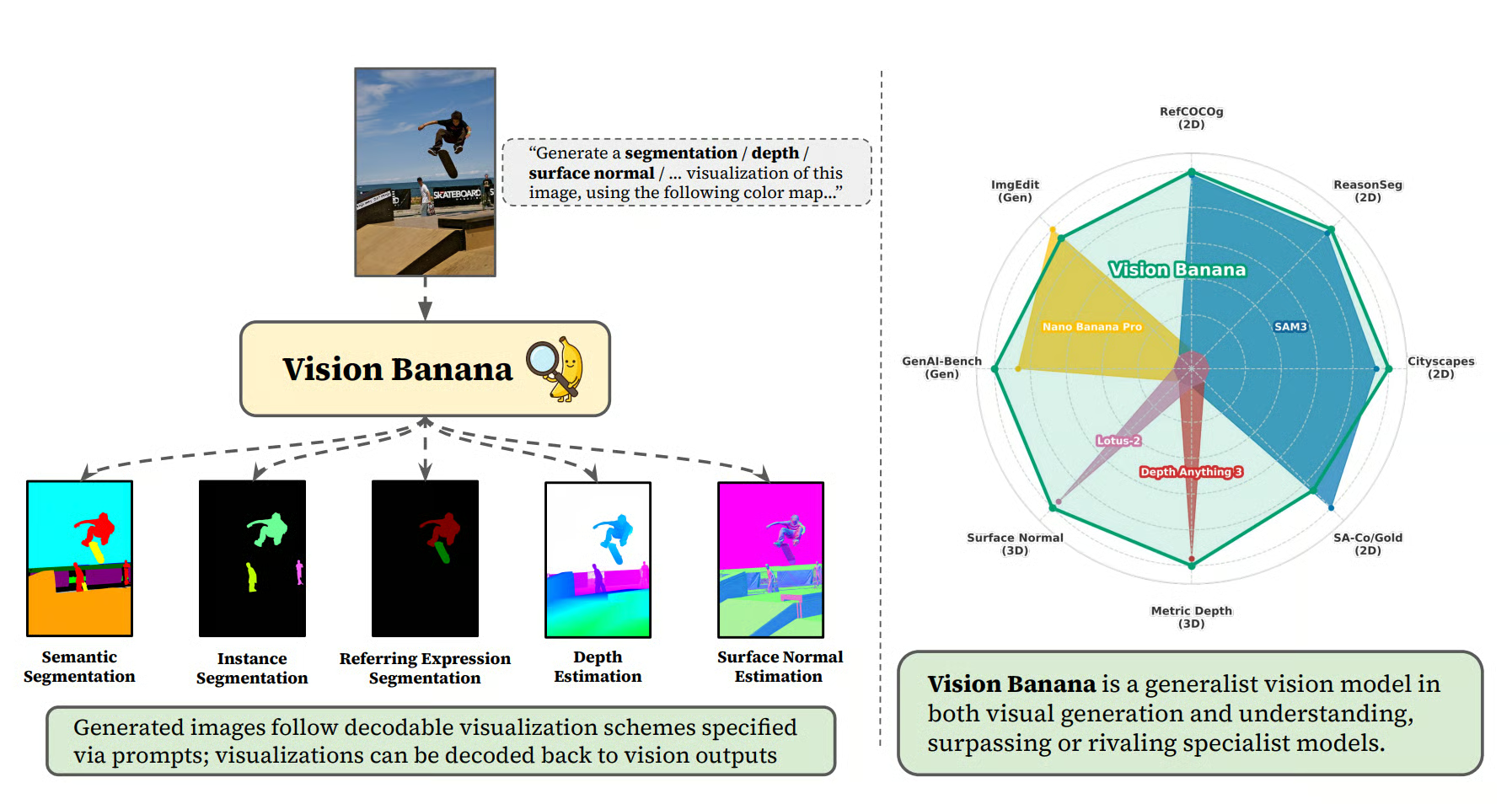

Figura 1: Capacidades ocultas de comprensión visual de los generadores de imágenes al ajustar por instrucciones Nano Banana Pro (Fuente)

La receta es:

- Mantener sin cambios la arquitectura del modelo base

- Mezclar datos de segmentación, profundidad y normales de superficie en la distribución de entrenamiento a una proporción baja

- Ajustar por instrucciones

Toda la metodología de entrenamiento no requiere arquitectura nueva, ni cabezas personalizadas, ni pérdidas auxiliares, ni decodificadores especializados.

El modelo resultante:

- Supera a SAM 3 en tres benchmarks de segmentación

- Supera a Depth Anything V3 en estimación de profundidad métrica

- Supera a Lotus-2 en estimación de normales de superficie

- Mantiene la calidad de generación de imágenes de su modelo base (empate estadístico en GenAI-Bench e ImgEdit)

Todo ello bajo un protocolo estricto de transferencia zero-shot, garantizando que el modelo nunca ha visto las particiones de entrenamiento de los benchmarks en los que se evalúa.

¿Por qué importa?

El aprendizaje de representaciones visuales ha probado muchos objetivos de preentrenamiento a lo largo de los años. Entre los más comunes:

- Clasificación supervisada (ImageNet, JFT)

- Aprendizaje contrastivo (CLIP, SigLIP)

- Autodestilación (DINO, DINOv2)

- Autoencoder enmascarado (MAE, BEiT)

Lo importante es que ninguno de ellos es generativo. La generación de imágenes se ha tratado históricamente como una capacidad downstream, no como base para la comprensión. Los primeros intentos de preentrenamiento generativo (iGPT, LVM) quedaban consistentemente por detrás de los métodos contrastivos en benchmarks de calidad de representación.

La escalada de objetivos generativos autorregresivos vía predicción del siguiente token catalizó la aparición de capacidades generalistas zero-shot en modelos como GPT-3. Se descubrió que conductas complejas downstream estaban latentes en el espacio de pesos de alta dimensión y se afloraban después mediante un ajuste supervisado ligero y alineación por instrucciones. Ejemplos:

- Traducción automática neuronal

- Síntesis de código multilingüe

- Resumen abstractivo

- Razonamiento aritmético

Vision Banana defiende que estamos en el mismo punto para la visión. El paper traza explícitamente una analogía entre el preentrenamiento de generación de imágenes y el preentrenamiento de modelos de lenguaje, y entre el ajuste por instrucciones y el paso de alineación.

Si la analogía se mantiene, dejaremos de construir pipelines específicos por tarea y trataremos a un único gran generador de imágenes como la capa fundacional, especificando las tareas mediante prompts.

¿Cómo funciona Vision Banana?

El mecanismo es simple: cada tarea de visión se reformula como "genera una imagen RGB con estas propiedades", y en la decodificación conviertes esa imagen RGB de nuevo en predicciones de la tarea de forma determinista.

Así mapea cada tarea:

Segmentación semántica

Pide al modelo asignaciones de color por clase y, en la decodificación, agrupa los píxeles al color especificado más cercano. El vocabulario es lo que pongas en el prompt; por construcción es de vocabulario abierto.

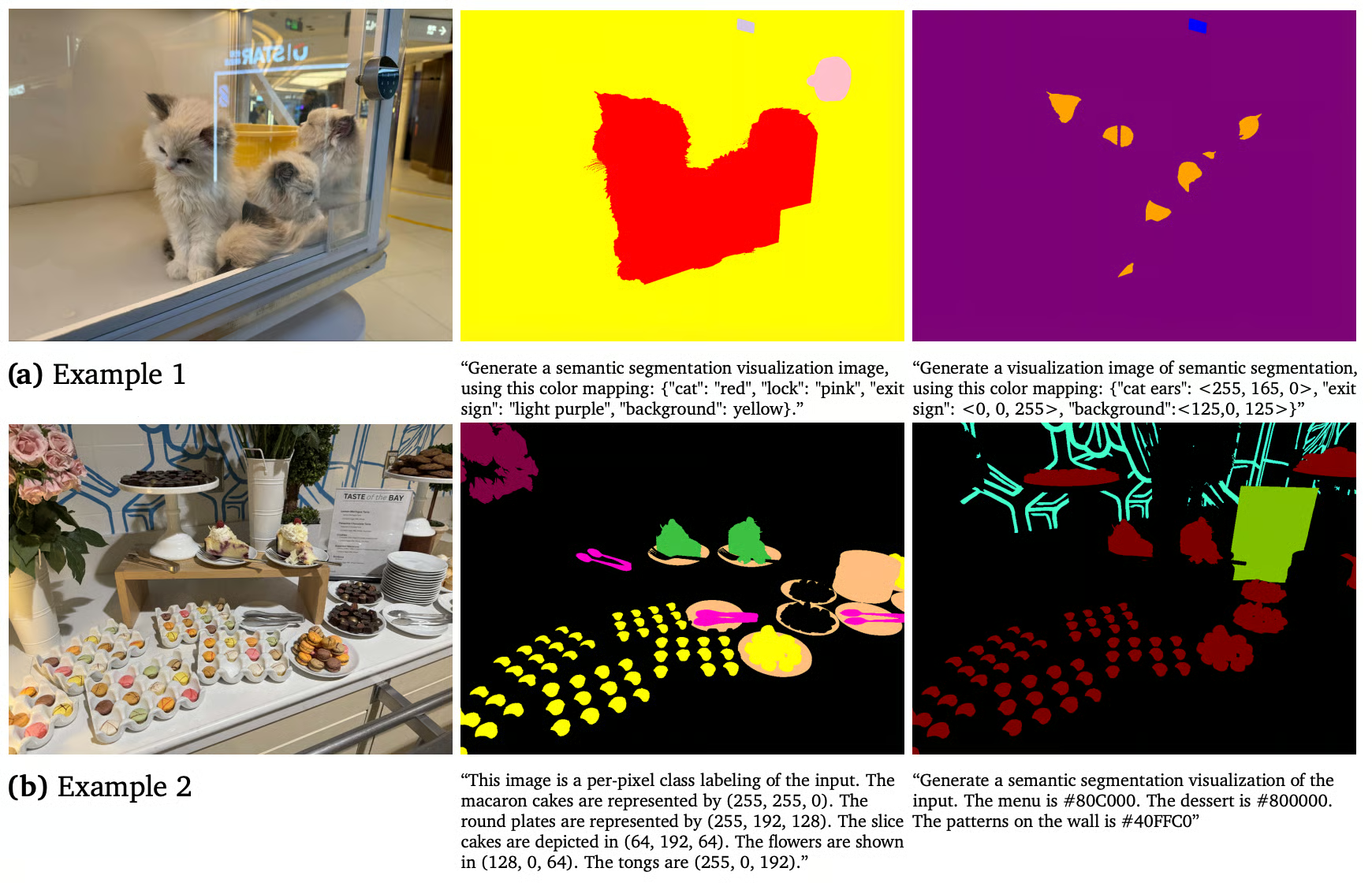

Se entenderá mejor con un ejemplo. Este es un prompt del paper:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Figura 2: Segmentación semántica (Fuente)

Segmentación de instancias

La segmentación de instancias es más complicada que la semántica porque el número de instancias no se conoce de antemano. Así que no puedes preasignar colores.

La solución de Vision Banana es hacer una clase por inferencia, dejar que el modelo asigne dinámicamente colores distintos a instancias distintas y, en la decodificación, agrupar los píxeles por modos de color.

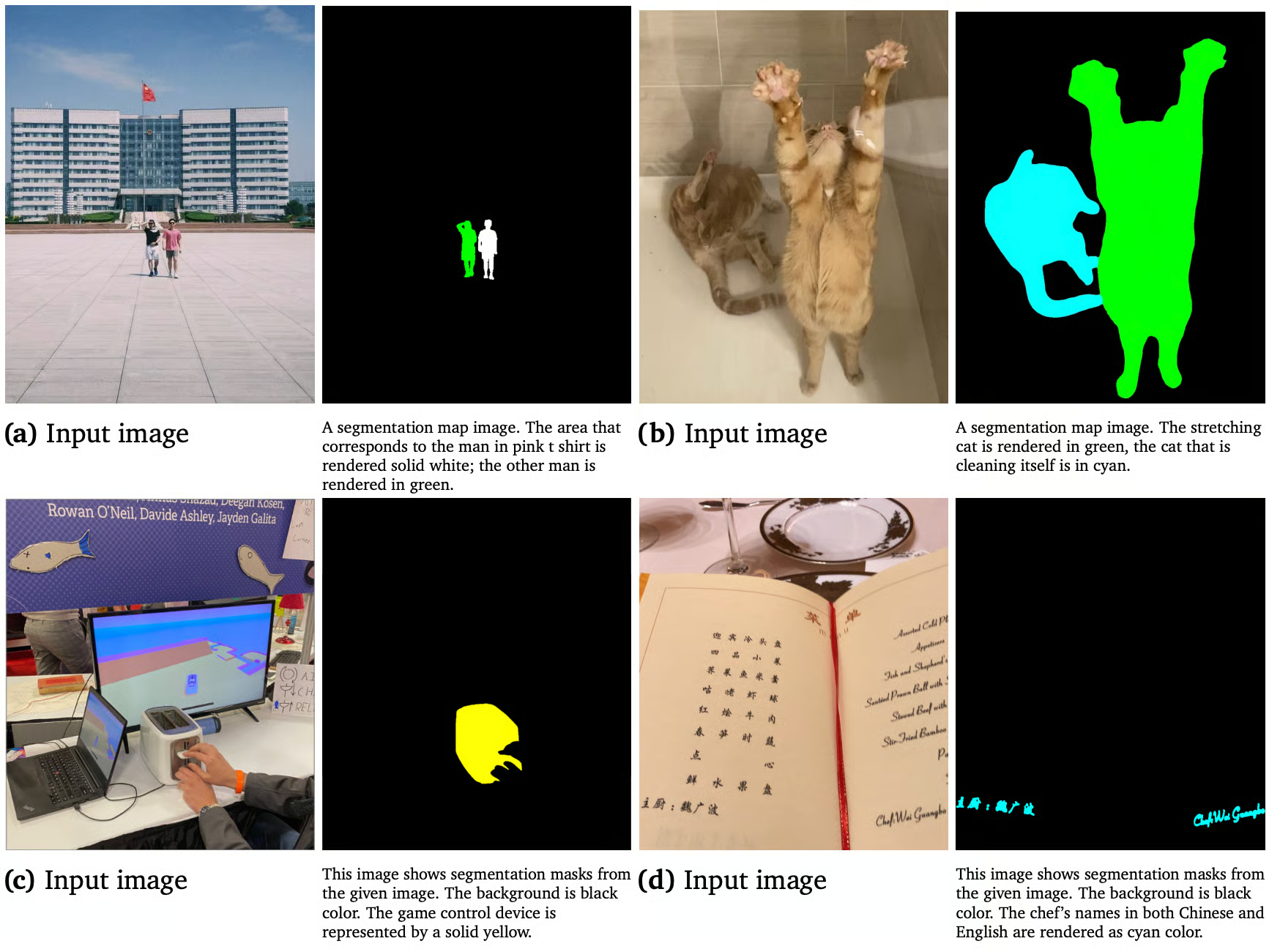

Segmentación por expresión

Vision Banana puede recibir un prompt con una descripción en lenguaje natural de qué segmentar y devolver una máscara. Aquí tienes un ejemplo de prompt del paper:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Aquí brilla el razonamiento multimodal incorporado en el preentrenamiento generativo. Los modelos discriminativos sufren con las expresiones referenciales porque requieren razonamiento lingüístico y visual conjunto. Los modelos generativos entrenados con miles de millones de pares imagen-subtítulo lo manejan con naturalidad.

Figura 3: Vision Banana comprende prompts en lenguaje natural y razona sobre ellos (Fuente)

Profundidad y normales de superficie

Tanto la profundidad como las normales de superficie se proyectan al espacio RGB mediante mapeos biyectivos, asegurando que las propiedades geométricas latentes se conserven sin pérdida de información durante la transformación. En la siguiente sección desglosaremos los detalles del codificado de profundidad a RGB.

Este paradigma unificado de inferencia trata cada tarea de visión por computador como un problema determinista de generación de imágenes. Al mantener una interfaz RGB coherente a lo largo del pipeline, el modelo evita ramas arquitectónicas específicas por tarea y se apoya totalmente en el condicionamiento por prompt para definir la semántica de salida.

Ahora, entendamos la profundidad con algo más de detalle. Es donde este enfoque podría hacerse trizas con más facilidad.

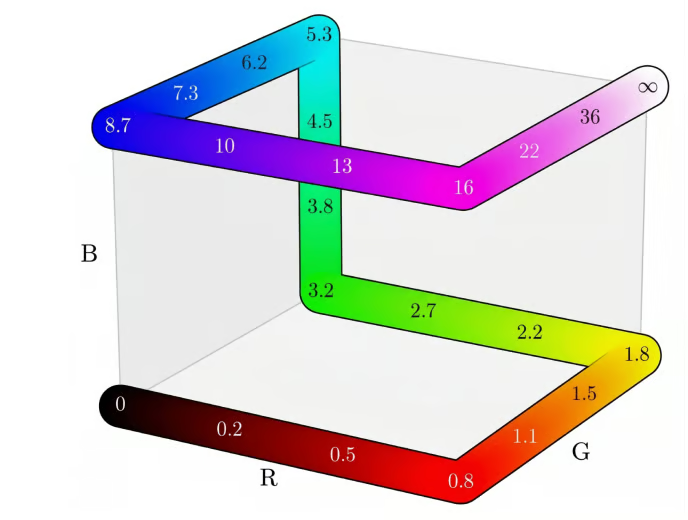

Codificar profundidad ilimitada en RGB

Si la codificación no es biyectiva, no podrás recuperar distancias métricas al decodificar y toda la afirmación de "la generación de imágenes como interfaz universal" se viene abajo. Merece la pena entenderlo porque te dice si el enfoque es sólido o un apaño.

El problema aquí es que los valores de profundidad son números reales no acotados en [0, ∞), mientras que RGB está acotado en [0, 1]. Así que, para usar "genera el mapa de profundidad" como señal de entrenamiento, necesitas un mapeo biyectivo en el que cada profundidad métrica corresponda exactamente a un valor RGB, y que al decodificar puedas invertirlo de vuelta a metros.

El enfoque de Vision Banana tiene dos etapas:

Etapa 1: comprimir la profundidad ilimitada en [0, 1)

Los autores usan la transformación potenciadora de Barron (2025) con parámetro de forma λ = -3, que da más resolución a regiones cercanas que lejanas. Un objeto a 2 metros recibe más precisión que uno a 200 metros. Encaja con lo que más importa en la práctica: objetos manipulables, no lejanos.

Etapa 2: mapear [0, 1) a los bordes del cubo RGB

Después interpolan a lo largo de una trayectoria lineal a trozos que recorre los bordes del cubo RGB, esencialmente la primera iteración de una curva de Hilbert 3D. Esto produce transiciones de color suaves y perceptualmente coherentes, sin ambigüedad sobre qué color corresponde a qué profundidad.

Como ambas etapas son estrictamente invertibles, la composición es una biyección. Luego entrenan con verdad terreno codificada en RGB y, en inferencia, proyectan el RGB predicho al borde más cercano del cubo e invierten a metros.

Figura 4: Visualización de la biyección entre distancias métricas escalares d ≥ 0 y valores de color RGB (Fuente)

Para ganar robustez, el entrenamiento se aumenta con mapas de color alternativos como Plasma, Inferno, Viridis y escala de grises, de modo que el modelo pueda manejar el estilo de visualización que pidas en el prompt.

Las normales de superficie son más sencillas porque ya son vectores unitarios con componentes en [-1, 1], que se mapean directamente a RGB con la convención estándar del espacio de cámara (+x derecha, +y arriba, +z hacia fuera del plano de imagen). Así, el verde claro significa mirando hacia arriba, el rojo rosado mirando a la izquierda y el azul/lila claro mirando a cámara. No hace falta ninguna deformación.

Nota: Vision Banana no usa parámetros intrínsecos de cámara en ningún momento, ni en entrenamiento ni en inferencia. La mayoría de métodos SOTA de profundidad (Depth Anything V3, MoGe-2, UniK3D, DepthLM) emplean intrínsecos en algún punto del bucle porque ayudan a desambiguar la escala monocular.

Que Vision Banana infiera la escala absoluta solo con priors visuales, y aun así gane, es la evidencia más contundente del paper de que el preentrenamiento generativo está haciendo trabajo geométrico y no solo reconociendo patrones de visualizaciones vistas en el entrenamiento.

Modelos especialistas vs. Vision Banana: comparación

La forma más clara de ver qué cambia realmente es comparar ambos paradigmas en una sola tarea. Comparemos la estimación de profundidad con el enfoque especialista (Marigold, Lotus, Depth Anything V3) y con Vision Banana.

Los dos paradigmas producen artefactos distintos. Marigold es una herramienta especializada, mientras que Vision Banana es un generalista cuya amplitud proviene de un único paso de entrenamiento.

Las diferencias se traducen en cómo se usa el modelo en la práctica:

|

Aspecto |

Especialista (estilo Marigold) |

Vision Banana |

|

Formato de salida |

Tensor específico de la tarea |

Imagen RGB |

|

Vocabulario |

Fijo en entrenamiento |

Definido en el prompt |

|

Multitarea |

Un modelo por tarea |

Un modelo, muchas tareas |

|

Intrínsecos de cámara |

A menudo necesarios |

No se usan |

|

Capacidad de generación |

Se pierde al afinar |

Se conserva |

|

Coste de inferencia |

Bajo |

Alto (generador de imágenes completo) |

Los benchmarks son una mezcla de victorias claras y una derrota honesta. Todo bajo transferencia zero-shot, es decir, el modelo no ha visto las particiones de entrenamiento de los benchmarks de evaluación.

Perfiles de rendimiento superiores:

- Segmentación semántica (Cityscapes): Logró un mIoU (intersección sobre unión media) de 0,699, superando al Segment Anything Model (SAM 3) especializado con 0,652.

- Segmentación referencial (RefCOCOg): Consiguió 0,738 cIoU (IoU acumulado), por encima del baseline SAM 3 Agent con 0,734.

- Razonamiento visual complejo (ReasonSeg): Al combinarse con Gemini 2.5 Pro, alcanzó 0,793 gIoU, superando al SAM 3 Agent (0,770) y marcando un nuevo estado del arte zero-shot, incluso frente a metodologías totalmente supervisadas no zero-shot.

- Estimación de profundidad métrica: Registró una

δ(precisión umbral) media de 0,929 en cuatro datasets diversos, mejorando el 0,918 de Depth Anything V3. - Estimación de normales de superficie: Obtuvo un menor error angular medio de 15,549° en tres datasets indoor, mostrando mayor fidelidad geométrica que Lotus-2 (16,558°).

Déficit de rendimiento:

- Segmentación de instancias (SA-Co/Gold): 0,540 pmF1 (evaluado en una muestra de 500 consultas de SA-Co/Gold, no en el benchmark completo), por detrás del SAM 3 no zero-shot (0,661) y a la par del DINO-X zero-shot (0,552). Probablemente se deba a la restricción de asignación discreta de colores para la cardinalidad de instancias, que limita la resolución en escenas muy densas.

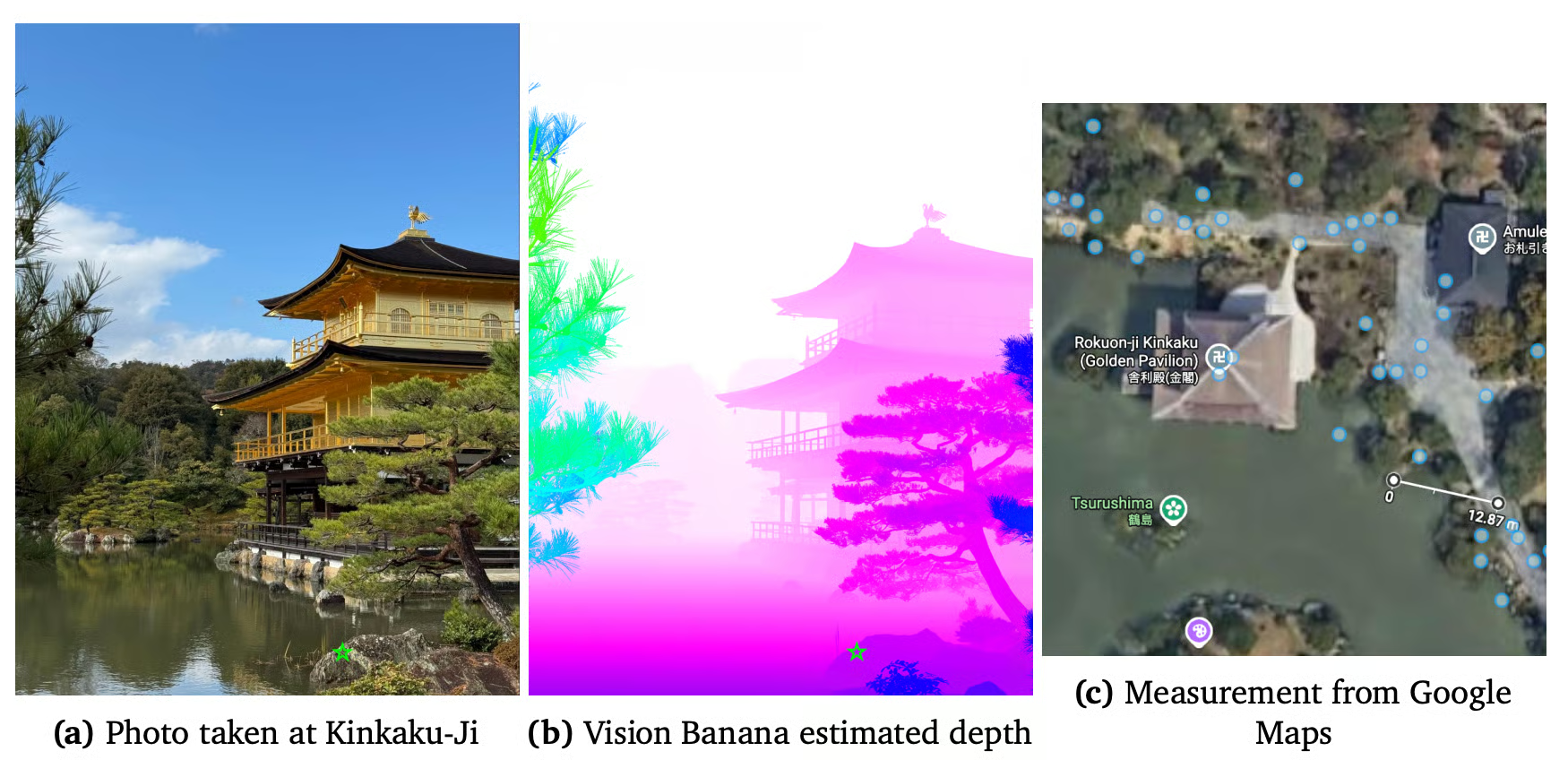

En GenAI-Bench, Vision Banana gana el 53,5% de las comparaciones humanas frente al Nano Banana Pro base. Este es un ejemplo de prueba de anclaje en el mundo real del paper:

Figura 5: Estimación de profundidad de Vision Banana (Fuente)

Un autor tomó una foto con el móvil cerca de Kinkaku-Ji. Vision Banana predijo un punto concreto a 13,71 metros. Google Maps marca 12,87, lo que supone un error relativo absoluto del 6,5% en una foto de móvil sin calibración, sin intrínsecos y sin preparación. Este tipo de prueba predice el comportamiento en despliegue con más fiabilidad que los números de benchmark.

Limitaciones de Vision Banana

Vision Banana tiene cuatro limitaciones que conviene señalar. Son:

- Coste: Ejecutar un modelo del tamaño de Nano Banana Pro en cada inferencia es mucho más caro que usar un especialista destilado de profundidad. El paper lo reconoce directamente en la sección de trabajo futuro. Para 10.000 fotogramas de vídeo, hoy este enfoque no es competitivo en costes. El siguiente paso obvio es destilar en especialistas más pequeños.

- Escenas con muchas instancias: SA-Co/Gold es la derrota clara. La asignación de color por clase se queda sin margen cuando hay que contar con precisión muchos objetos pequeños. SAM 3 sigue ganando aquí.

- Una sola imagen: La implementación actual está limitada de forma fundamental a entradas de imagen estáticas y de una sola vista, sin capacidad para procesar espacio-tiempo o multivista. Los autores dejan el razonamiento temporal para trabajo futuro.

- Despliegue como caja negra: No puedes sondear, modificar ni ejecutar el modelo de forma privada. Esto importa en contextos regulados o sensibles en propiedad intelectual donde no es viable usar una API de vanguardia.

Reflexiones finales

Vision Banana demuestra de forma tangible que los generadores de imágenes ya hacen el trabajo duro de la comprensión visual, y que aflorar esas capacidades requiere alineación más que nuevas arquitecturas.

Las contribuciones específicas del paper son

- Codificación RGB biyectiva que convierte la profundidad y la segmentación en problemas de generación de imágenes invertibles

- Receta ligera de ajuste por instrucciones que añade habilidades de visión sin quemar el prior generativo

- Estimación de profundidad métrica sin intrínsecos de cámara que supera a especialistas que sí los requieren

- Protocolo estricto de transferencia zero-shot que hace medible la apuesta generalista en benchmarks estándar.

El paper también impulsa un modelo mental centrado en la generación, donde las tareas se especifican por prompt y las salidas se decodifican a partir de imágenes RGB, y donde los mismos pesos sirven tanto para producir como para interpretar contenido visual.

Puedes probar los prompts de la página del proyecto con el Nano Banana Pro base o con Nano Banana 2 para ver qué ya es accesible sin ajuste por instrucciones, y construir funciones de razonamiento-segmentación con modelos de la clase NBP y un enrutador MLLM en lugar de entrenar pipelines a medida desde cero.

Preguntas frecuentes sobre Vision Banana

¿Cómo puedo usar Vision Banana hoy?

No. Están disponibles el paper y la página del proyecto, pero los pesos del modelo están en Google DeepMind. El modelo base, Nano Banana Pro, está disponible en la API de Gemini y en AI Studio, y la propia tesis del paper sugiere que, si haces prompting de NBP directamente con los prompts de la página del proyecto, ya deberías obtener resultados relevantes.

¿Puede Vision Banana sustituir a SAM 3 o a Depth Anything?

Hoy no, sobre todo por coste. Para aplicaciones donde necesitas ejecutar visión a escala de forma barata (vídeo, tiempo real, móvil), los especialistas siguen ganando en economía.

¿Cómo se compara esto con MLLMs como GPT-5V o Gemini 2.5?

Los LLM multimodales toman una imagen y producen texto. Vision Banana toma una imagen y un prompt para producir una imagen. Resuelven problemas distintos.

¿Por qué Vision Banana no usa intrínsecos de cámara para la profundidad?

La mayoría de especialistas usan intrínsecos para desambiguar la escala monocular (un objeto pequeño cerca y uno grande lejos pueden producir píxeles idénticos). Sin embargo, Vision Banana infiere la escala a partir de priors visuales aprendidos durante el preentrenamiento generativo sobre tamaños de objetos, contexto de escena y conocimiento del mundo.

Soy experta Google Developers en ML (Gen AI), triple experta en Kaggle y embajadora de Women Techmakers, con más de tres años de experiencia en el sector tecnológico. Cofundé una startup de salud en 2020 y actualmente curso un máster en informática en Georgia Tech, con especialización en aprendizaje automático.