Tracks

คอมพิวเตอร์วิทัศน์ดำเนินงานด้วยการแยกหน้าที่อย่างชัดเจนเสมอระหว่างโมเดลที่สร้างภาพกับโมเดลที่เข้าใจภาพ เฟรมเวิร์กเชิงกำเนิดเป็นแหล่งหลักสำหรับการสังเคราะห์ ในขณะที่สถาปัตยกรรมเชิงจำแนกมุ่งเน้นไปที่การจัดประเภท การแยกส่วน หรือรีเกรสชันความลึก คู่มือมาตรฐานสำหรับงานมองเห็นใหม่ใด ๆ คือเลือกสถาปัตยกรรม ติดหัวงานเฉพาะ และปรับจูนด้วยข้อมูลที่มีป้ายกำกับ

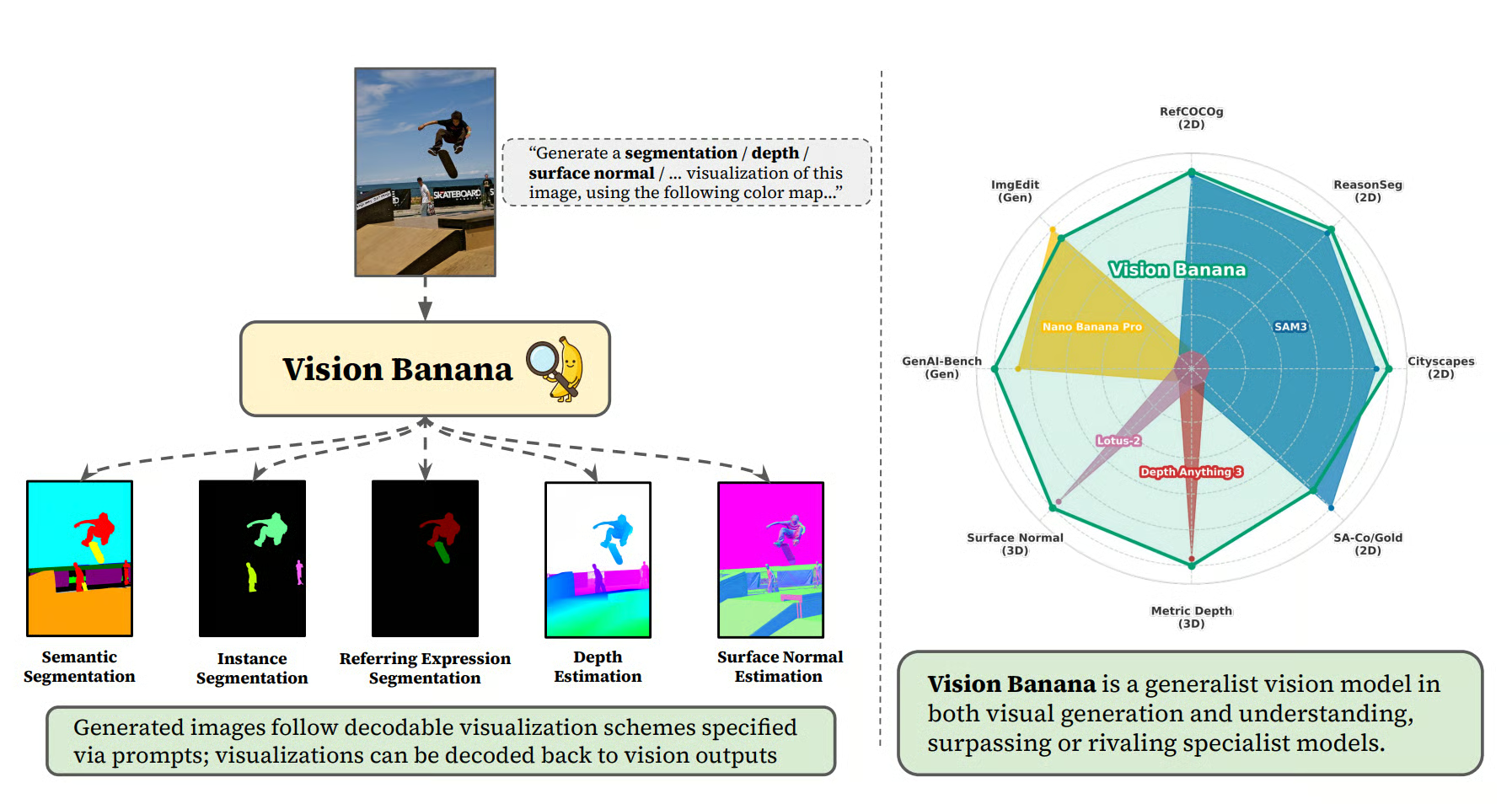

สมมติฐานนั้นคือสิ่งที่ Vision Banana จาก Google DeepMind ต้องการเข้ามาท้าทาย งานวิจัยชี้ว่าโมเดลสร้างภาพได้เรียนรู้ทุกอย่างที่โมเดลการมองเห็นสายทั่วไปต้องการแล้ว รวมถึงการแยกส่วน ความลึก นอร์มัลของพื้นผิว และอื่น ๆ ในมุมมองของผู้เขียน สิ่งที่ขาดอยู่มีเพียงชั้นการจูนตามคำสั่งที่บางมากเพื่อทำให้ความสามารถแฝงเหล่านั้นวัดผลได้บนเกณฑ์มาตรฐาน

ในโพสต์นี้ จะเริ่มจาก Vision Banana คืออะไรจริง ๆ และทำไมงานวิจัยนี้จึงดึงดูดความสนใจของวงการ จากนั้นจะอธิบายการทำงานของโมเดล ปิดท้ายด้วยสิ่งที่ได้ผล สิ่งที่ยังไม่ และข้อคิดที่ผู้ปฏิบัติควรนำไปใช้ ระหว่างทางจะหยิบยกคำถามที่เกิดขึ้นระหว่างอ่าน ซึ่งผู้อ่านคนอื่นก็น่าจะสงสัยเหมือนกัน

หมายเหตุ: ตัว Vision Banana เองยังไม่เปิดให้ใช้งานสาธารณะ สิ่งที่มีคือ งานวิจัย และหน้าโครงการ โมเดลฐานสร้างบน Nano Banana Pro และเข้าถึงได้ผ่าน Gemini API และ Google AI Studio

Vision Banana คืออะไร?

Vision Banana เป็นโมเดลวิจัยจาก Google DeepMind ที่สร้างขึ้นด้วยการนำ Nano Banana Pro (ตัวสร้างภาพจากข้อความ) มาใช้จูนตามคำสั่งแบบเบา ๆ บนส่วนผสมของข้อมูลฝึกเดิมของมัน ร่วมกับข้อมูลงานคอมพิวเตอร์วิทัศน์ปริมาณเล็กน้อย

ภาพที่ 1: ความสามารถด้านความเข้าใจภาพที่ซ่อนอยู่ของตัวสร้างภาพด้วยการจูนตามคำสั่งบน Nano Banana Pro (ที่มา)

สูตรคือ:

- คงสถาปัตยกรรมของโมเดลฐานไว้เหมือนเดิม

- ผสมข้อมูลการแยกส่วน ความลึก และนอร์มัลของพื้นผิวเข้ากับการกระจายของการฝึกในอัตราต่ำ

- จูนตามคำสั่ง

กระบวนการฝึกทั้งหมดไม่ต้องใช้สถาปัตยกรรมใหม่ หัวงานแบบกำหนดเอง การสูญเสียเสริม หรือดีโคเดอร์เฉพาะทาง

โมเดลที่ได้:

- ชนะ SAM 3 บนเกณฑ์มาตรฐานการแยกส่วนสามรายการ

- ชนะ Depth Anything V3 ในการประมาณค่าความลึกแบบมีหน่วย

- ชนะ Lotus-2 ในการประมาณค่านอร์มัลของพื้นผิว

- รักษาคุณภาพการสร้างภาพของโมเดลฐานไว้ได้ (เสมอกันทางสถิติบน GenAI-Bench และ ImgEdit)

ทั้งหมดนี้ทำภายใต้โปรโตคอลการถ่ายทอดแบบ zero-shot ที่เข้มงวด ทำให้มั่นใจว่าโมเดลไม่เคยเห็นส่วนฝึกของเกณฑ์มาตรฐานที่ใช้ประเมิน

ทำไมเรื่องนี้สำคัญ?

การเรียนรู้ตัวแทนเชิงภาพได้ทดลองวัตถุประสงค์การพรีเทรนมาหลายแบบตลอดหลายปี ตัวที่พบบ่อยได้แก่:

- การจัดประเภทแบบมีผู้สอน (ImageNet, JFT)

- การเรียนรู้แบบเปรียบเทียบ (CLIP, SigLIP)

- การกลั่นตัวเอง (DINO, DINOv2)

- การถอดรหัสอัตโนมัติแบบมาสก์ (MAE, BEiT)

สิ่งสำคัญคือไม่มีตัวไหนเป็นเชิงกำเนิด การสร้างภาพมักถูกมองว่าเป็นความสามารถปลายน้ำ ไม่ใช่รากฐานสำหรับความเข้าใจ ความพยายามพรีเทรนเชิงกำเนิดยุคแรก ๆ (iGPT, LVM) มักตามหลังวิธีเปรียบเทียบบนเกณฑ์คุณภาพของตัวแทน

การสเกลวัตถุประสงค์เชิงกำเนิดแบบอัตถานุกรมผ่านการทำนายโทเคนถัดไปได้จุดประกายความสามารถสายทั่วไปแบบ zero-shot ในโมเดลอย่าง GPT-3 พฤติกรรมปลายน้ำที่ซับซ้อนถูกพบว่าอยู่แฝงภายในสเปซน้ำหนักมิติสูง และถูกทำให้เด่นขึ้นผ่านการปรับจูนแบบมีผู้สอนที่เบาและการจัดแนวตามคำสั่ง ตัวอย่างเช่น:

- การแปลภาษาด้วยโครงข่ายประสาท

- การสังเคราะห์โค้ดหลายภาษา

- การสรุปเชิงนามธรรม

- การให้เหตุผลเชิงคณิตศาสตร์

Vision Banana กำลังชี้ว่าพื้นที่การมองเห็นก็มาถึงจุดเดียวกันแล้ว งานวิจัยเชื่อมโยงโดยตรงระหว่างการพรีเทรนการสร้างภาพกับการพรีเทรนโมเดลภาษา และระหว่างการจูนตามคำสั่งกับขั้นตอนการจัดแนว

หากอุปมาอุปมัยนี้ถือจริง เราจะเลิกสร้างไปป์ไลน์เฉพาะงาน และใช้ตัวสร้างภาพขนาดใหญ่ตัวเดียวเป็นชั้นรากฐาน โดยระบุงานผ่านพรอมป์ท

Vision Banana ทำงานอย่างไร?

กลไกนั้นเรียบง่าย: ทุกงานมองเห็นถูกตีความใหม่เป็น "สร้างภาพ RGB ที่มีคุณสมบัติเหล่านี้" และในช่วงถอดรหัส จะเปลี่ยนภาพ RGB นั้นกลับเป็นพยากรณ์ของงานแบบกำหนดแน่นอน

งานแต่ละแบบแมปอย่างไรบ้าง:

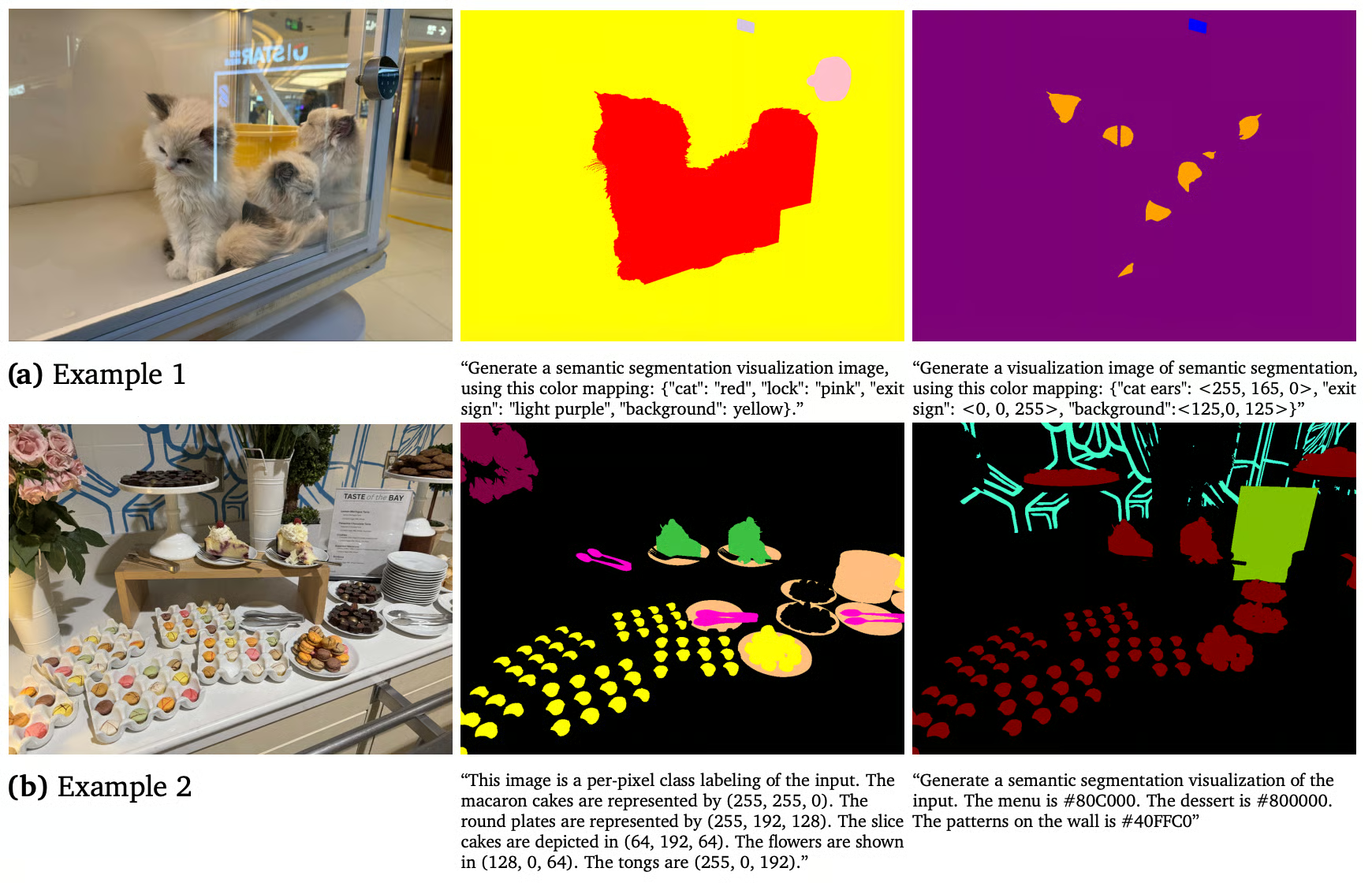

การแยกส่วนเชิงความหมาย

ป้อนพรอมป์ทที่กำหนดสีต่อคลาส และในช่วงถอดรหัส ให้จัดกลุ่มพิกเซลไปยังสีที่ระบุที่ใกล้ที่สุด คำศัพท์คือสิ่งที่ใส่ในพรอมป์ท โดยโครงสร้างเป็น open-vocabulary อยู่แล้ว

จะเห็นภาพชัดขึ้นเมื่อดูตัวอย่าง นี่คือตัวอย่างพรอมป์ทจากงานวิจัย:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

ภาพที่ 2: การแยกส่วนเชิงความหมาย(ที่มา)

การแยกส่วนเชิงอินสแตนซ์

การแยกส่วนเชิงอินสแตนซ์ยากกว่าการแยกส่วนเชิงความหมาย เพราะจำนวนอินสแตนซ์ไม่ทราบล่วงหน้า จึงไม่สามารถกำหนดสีไว้ก่อน

วิธีของ Vision Banana คือทำทีละคลาสต่อครั้ง ให้โมเดลกำหนดสีที่แตกต่างกันให้กับอินสแตนซ์ที่แตกต่างกันแบบไดนามิก แล้วในช่วงถอดรหัสจึงจัดกลุ่มพิกเซลไปยังโหมดสี

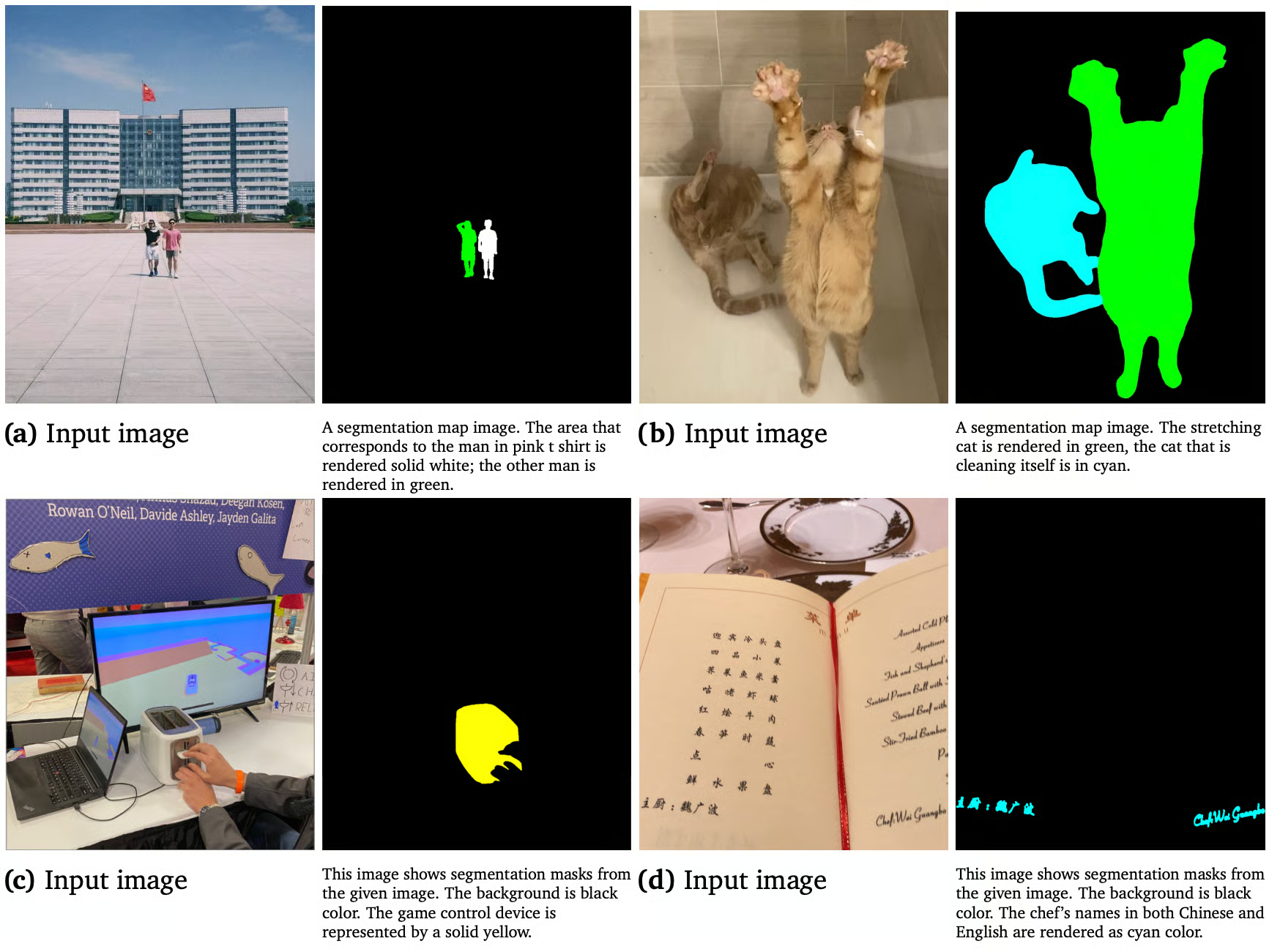

การแยกส่วนด้วยสำนวนอ้างอิง

Vision Banana รับพรอมป์ทที่อธิบายด้วยภาษาธรรมชาติว่าต้องการแยกอะไร แล้วส่งคืนมาสก์ นี่คือตัวอย่างพรอมป์ทจากงานวิจัย:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.นี่คือจุดที่การให้เหตุผลแบบมัลติโหมดที่ฝังอยู่ในพรีเทรนเชิงกำเนิดโดดเด่น โมเดลเชิงจำแนกมักลำบากกับสำนวนอ้างอิงเพราะงานต้องใช้เหตุผลทั้งภาษาและภาพควบคู่กัน โมเดลเชิงกำเนิดที่ฝึกด้วยคู่คำบรรยาย-ภาพนับพันล้านรับมือสิ่งนี้ได้เป็นธรรมชาติ

ภาพที่ 3: Vision Banana เข้าใจพรอมป์ทภาษาธรรมชาติและให้เหตุผลกับมันได้ (ที่มา)

ความลึกและนอร์มัลของพื้นผิว

ทั้งความลึกและนอร์มัลของพื้นผิวถูกฉายเข้าสู่สเปซ RGB ด้วยการแมปแบบไบเจกทีฟ เพื่อให้คุณสมบัติเรขาคณิตแฝงถูกรักษาไว้โดยไม่สูญเสียข้อมูลระหว่างการแปลง เราจะเจาะรายละเอียดการเข้ารหัสความลึกเป็น RGB ในหัวข้อถัดไป

พาราไดม์การอนุมานแบบหนึ่งเดียวนี้ปฏิบัติต่อทุกงานคอมพิวเตอร์วิทัศน์เป็นปัญหาการสร้างภาพแบบกำหนดแน่นอน โดยคงอินเทอร์เฟซ RGB สม่ำเสมอตลอดไปป์ไลน์ โมเดลจึงหลีกเลี่ยงกิ่งสถาปัตยกรรมเฉพาะงาน และพึ่งเงื่อนไขที่ขับเคลื่อนด้วยพรอมป์ทเพียงอย่างเดียวในการกำหนดความหมายของผลลัพธ์

ต่อไป มาดูรายละเอียดเรื่องความลึกกันอีกเล็กน้อย นี่คือจุดที่ทั้งแนวทางอาจพังได้ง่ายที่สุด

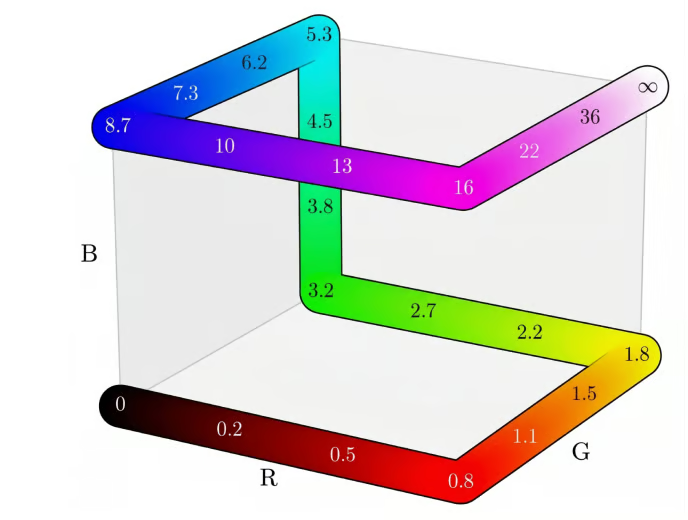

การเข้ารหัสความลึกไม่จำกัดลงใน RGB

ถ้าการเข้ารหัสไม่เป็นไบเจกทีฟ จะไม่สามารถกู้คืนระยะเชิงหน่วยได้ในช่วงถอดรหัส และข้ออ้าง "การสร้างภาพเป็นอินเทอร์เฟซสากล" ก็จะพังทลาย นี่ควรทำความเข้าใจเพราะมันบอกได้ว่าแนวทางนี้ตั้งอยู่บนหลักการหรือเป็นเพียงทริก

ปัญหาคือค่าความลึกเป็นจำนวนจริงไม่จำกัดใน [0, ∞) ขณะที่ RGB ถูกจำกัดใน [0, 1] ดังนั้นเพื่อใช้ "สร้างแผนที่ความลึก" เป็นสัญญาณการฝึก คุณต้องมีการแมปแบบไบเจกทีฟที่ทุกค่าความลึกเชิงหน่วยแมปไปยังค่า RGB ที่ไม่ซ้ำกันหนึ่งค่า และในช่วงถอดรหัสสามารถผกผันกลับเป็นหน่วยเมตรได้

แนวทางของ Vision Banana มีสองช่วง:

ช่วงที่ 1: อัดความลึกไม่จำกัดลงบน [0, 1)

ผู้เขียนใช้ power transform ของ Barron (2025) ด้วยพารามิเตอร์รูปร่าง λ = -3 ซึ่งให้ระยะใกล้มีความละเอียดมากกว่าระยะไกล วัตถุที่อยู่ห่าง 2 เมตรได้ความแม่นยำมากกว่าวัตถุที่อยู่ 200 เมตร ซึ่งสอดคล้องกับสิ่งที่แอปส่วนใหญ่ใส่ใจ กล่าวคือวัตถุที่หยิบจับได้ ไม่ใช่วัตถุไกลลิบ

ช่วงที่ 2: แมป [0, 1) ลงบนขอบลูกบาศก์ RGB

ต่อมา จะทำการอินเตอร์โพเลตตามเส้นทางเชิงเส้นแบบแบ่งช่วงที่ลากไปตามขอบของลูกบาศก์ RGB โดยพื้นฐานคือการวนครั้งแรกของเส้นโค้ง Hilbert 3 มิติ ผลลัพธ์คือการเปลี่ยนสีที่ราบรื่นและสมเหตุสมผลต่อการรับรู้ โดยไม่มีความกำกวมว่าสีใดสอดคล้องกับความลึกใด

เมื่อทั้งสองช่วงผกผันได้อย่างเคร่งครัด องค์ประกอบรวมกันจึงเป็นไบเจกทีฟ จากนั้นจึงฝึกบนข้อมูลจริงที่เข้ารหัสเป็น RGB และในช่วงอนุมานจะฉาย RGB ที่พยากรณ์ลงบนขอบลูกบาศก์ที่ใกล้ที่สุดแล้วผกผันกลับเป็นเมตร

ภาพที่ 4: การแสดงภาพของไบเจกชันระหว่างระยะทางเชิงหน่วยสเกลาร์ 𝑑 ≥ 0 และค่าสี RGB (ที่มา)

เพื่อความทนทาน การฝึกจะเสริมด้วยแผนสีทางเลือกอย่าง Plasma, Inferno, Viridis และเฉดเทา เพื่อให้โมเดลรองรับสไตล์การแสดงผลที่ร้องขอในพรอมป์ทได้หลากหลาย

นอร์มัลของพื้นผิวง่ายกว่าเพราะเป็นเวกเตอร์หน่วยที่มีคอมโพเนนต์ในช่วง [-1, 1] อยู่แล้ว ซึ่งแมปสู่ RGB ได้โดยตรงตามคอนเวนชันในปริภูมิกล้อง (แกน +x ไปทางขวา, +y ขึ้น, +z ออกนอกระนาบภาพ) ดังนั้น สีเขียวอ่อนหมายถึงหันขึ้น สีแดงอมชมพูหมายถึงหันซ้าย และฟ้า/ม่วงอ่อนหมายถึงหันเข้าหากล้อง โดยไม่ต้องบิดโค้ง

หมายเหตุ: Vision Banana ไม่ใช้ค่าวัดกล้อง (camera intrinsics) เลย ทั้งในช่วงฝึกและอนุมาน วิธีระดับแนวหน้าเรื่องความลึกส่วนใหญ่ (Depth Anything V3, MoGe-2, UniK3D, DepthLM) ใช้ intrinsics อยู่บ้าง เพราะช่วยแก้ความกำกวมของสเกลแบบกล้องตัวเดียว

การที่ Vision Banana อนุมานสเกลสัมบูรณ์จากปริยายเชิงภาพเพียงอย่างเดียว และยังชนะได้นั้น เป็นหลักฐานที่แข็งแรงที่สุดในงานวิจัยว่าพรีเทรนเชิงกำเนิดกำลังทำงานด้านเรขาคณิตจริง ๆ ไม่ได้แค่จำรูปแบบการแสดงผลที่เคยเห็นระหว่างฝึก

โมเดลเฉพาะทาง vs Vision Banana: การเปรียบเทียบ

วิธีที่ชัดที่สุดในการเห็นสิ่งที่ต่างจริง ๆ คือเปรียบเทียบสองพาราไดม์โดยตรงบนงานเดียว มาลองเทียบการประมาณความลึกระหว่างแนวทางเฉพาะทาง (Marigold, Lotus, Depth Anything V3) กับ Vision Banana

สองพาราไดม์นี้ให้ชิ้นงานผลลัพธ์ต่างกัน Marigold เป็นเครื่องมือเฉพาะทาง ในขณะที่ Vision Banana เป็นสายทั่วไปที่ได้ความกว้างมาจากขั้นตอนฝึกเพียงครั้งเดียว

ความต่างเหล่านี้ส่งผลต่อวิธีใช้งานจริงว่าเป็นอย่างไร:

|

มิติเปรียบเทียบ |

เฉพาะทาง (สไตล์ Marigold) |

Vision Banana |

|

รูปแบบเอาต์พุต |

เทนเซอร์เฉพาะงาน |

ภาพ RGB |

|

คำศัพท์ |

ตรึงไว้ตอนฝึก |

นิยามในพรอมป์ท |

|

หลายงานในโมเดลเดียว |

หนึ่งโมเดลต่อหนึ่งงาน |

หนึ่งโมเดล หลายงาน |

|

ค่าวัดกล้อง |

มักต้องใช้ |

ไม่ใช้ |

|

ความสามารถการสร้าง |

สูญเสียไประหว่างปรับจูน |

คงไว้ |

|

ต้นทุนอนุมาน |

ต่ำ |

สูง (ตัวสร้างภาพเต็มรูปแบบ) |

ผลเกณฑ์มาตรฐานเป็นส่วนผสมของชัยชนะที่ชัดเจนและความพ่ายแพ้อย่างตรงไปตรงมา ทั้งหมดทำภายใต้การถ่ายทอดแบบ zero-shot กล่าวคือโมเดลไม่เคยเห็นส่วนฝึกของเกณฑ์ที่ใช้ประเมิน

โปรไฟล์ประสิทธิภาพที่เหนือกว่า:

- การแยกส่วนเชิงความหมาย (Cityscapes): ได้ค่า mean Intersection over Union (mIoU) 0.699 แซง Segment Anything Model (SAM 3) ที่ 0.652

- การแยกส่วนโดยสำนวนอ้างอิง (RefCOCOg): ทำค่า cIoU (cumulative IoU) ได้ 0.738 เหนือกว่าเส้นฐาน SAM 3 Agent ที่ 0.734

- การให้เหตุผลเชิงภาพที่ซับซ้อน (ReasonSeg): เมื่อใช้ร่วมกับ Gemini 2.5 Pro ได้ค่า gIoU 0.793 เหนือกว่า SAM 3 Agent ที่ 0.770 และสร้างสถิติใหม่แบบ zero-shot แม้เทียบกับวิธีที่ไม่ใช่ zero-shot ที่กำกับเต็มรูปแบบ

- การประมาณความลึกแบบมีหน่วย: ได้ค่าเฉลี่ย

δ(threshold accuracy) ที่ 0.929 ครอบคลุมสี่ชุดข้อมูลที่หลากหลาย เหนือกว่า Depth Anything V3 ที่ 0.918 - การประมาณนอร์มัลของพื้นผิว: ทำค่า mean angular error เฉลี่ยต่ำกว่าอยู่ที่ 15.549° บนสามชุดข้อมูลในร่ม แสดงความซื่อสัตย์เชิงเรขาคณิตเหนือกว่า Lotus-2 (16.558°)

จุดด้อยด้านประสิทธิภาพ:

- การแยกส่วนเชิงอินสแตนซ์ (SA-Co/Gold): ได้ 0.540 pmF1 (ประเมินบนตัวอย่าง 500 คิวรีของ SA-Co/Gold ไม่ใช่เกณฑ์เต็ม) ตามหลัง SAM 3 แบบไม่ใช่ zero-shot (0.661) และใกล้เคียง DINO-X แบบ zero-shot (0.552) สาเหตุอาจมาจากข้อจำกัดของการกำหนดสีแบบไม่ต่อเนื่องเพื่อแทนจำนวนอินสแตนซ์ ซึ่งจำกัดความละเอียดในฉากที่หนาแน่นมาก

บน GenAI-Bench Vision Banana ชนะการเปรียบเทียบโดยมนุษย์ 53.5% เมื่อเทียบกับ Nano Banana Pro ฐาน นี่คือตัวอย่างการทดสอบการยึดโยงในสภาพจริงจากงานวิจัย:

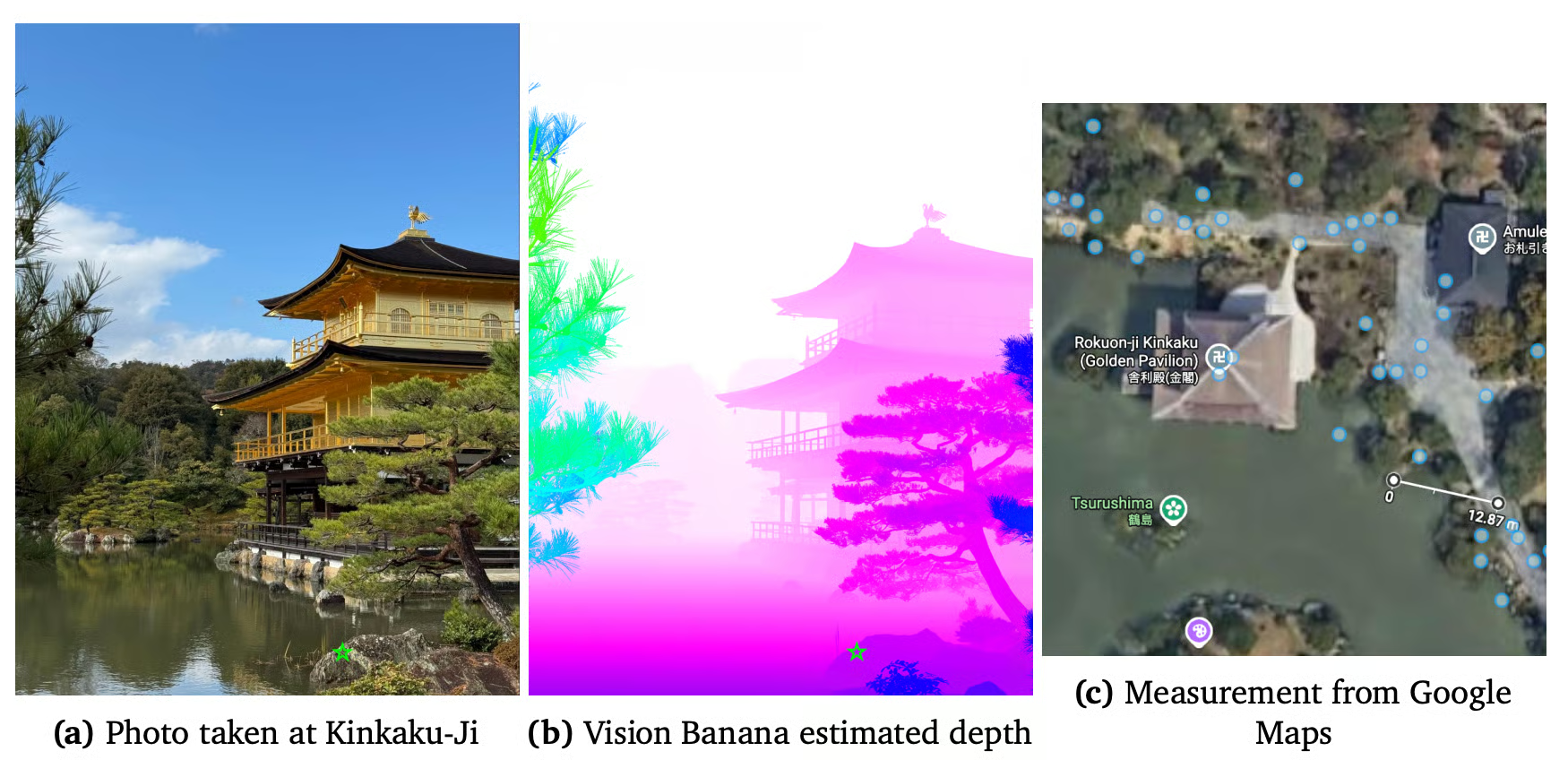

ภาพที่ 5: การประมาณความลึกของ Vision Banana (ที่มา)

ผู้เขียนคนหนึ่งถ่ายภาพด้วยสมาร์ตโฟนใกล้กับคินคะคุจิ Vision Banana ทำนายจุดหนึ่งว่าอยู่ห่าง 13.71 เมตร Google Maps ระบุ 12.87 เมตร ซึ่งเป็นข้อผิดพลาดสัมพัทธ์แบบสัมบูรณ์ 6.5% บนภาพจากโทรศัพท์ที่ไม่มีการคาลิเบรต ไม่มีค่าวัดกล้อง ไม่มีการตั้งค่า นี่คือตัวอย่างทดสอบที่คาดการณ์พฤติกรรมในการใช้งานจริงได้เชื่อถือกว่าตัวเลขเกณฑ์

ข้อจำกัดของ Vision Banana

Vision Banana มีข้อจำกัดสี่ประการที่ควรกล่าวถึง ได้แก่:

- ต้นทุน: การรันโมเดลขนาดระดับ Nano Banana Pro ทุกครั้งที่อนุมานมีค่าใช้จ่ายสูงกว่าการรันผู้เชี่ยวชาญด้านความลึกที่ถูกกลั่นอย่างมาก งานวิจัยระบุเรื่องนี้ตรง ๆ ในส่วนงานอนาคต สำหรับ 10K เฟรมวิดีโอ วิธีนี้ยังไม่คุ้มค่าทางเศรษฐศาสตร์ในวันนี้ การกลั่นลงเป็นโมเดลเฉพาะทางที่เล็กกว่าน่าจะเป็นก้าวต่อไปที่ชัดเจน

- ฉากที่มีอินสแตนซ์หนาแน่น: SA-Co/Gold คือความพ่ายแพ้ที่ชัดเจน การกำหนดสีต่อคลาสไปต่อไม่ไหวเมื่อมีวัตถุเล็กจำนวนมากที่ต้องนับอย่างแม่นยำ SAM 3 ยังชนะในจุดนี้

- ภาพเดี่ยว: การใช้งานโมเดลปัจจุบันถูกจำกัดโดยพื้นฐานไว้ที่อินพุตภาพนิ่งมุมมองเดียว ยังไม่รองรับการประมวลผลเชิงเวลา-ปริภูมิหรือหลายมุมมอง ผู้เขียนระบุว่าการให้เหตุผลตามเวลาเป็นงานอนาคต

- การใช้งานแบบกล่องดำ: ไม่สามารถสำรวจ ปรับแก้ หรือรันโมเดลแบบส่วนตัวได้ ประเด็นนี้สำคัญในบริบทที่ถูกกำกับดูแลหรืออ่อนไหวด้านทรัพย์สินทางปัญญาที่การรัน API ชั้นแนวหน้าทำไม่ได้

บทส่งท้าย

Vision Banana แสดงให้เห็นอย่างเป็นรูปธรรมว่าตัวสร้างภาพกำลังทำงานหนักด้านความเข้าใจเชิงภาพอยู่แล้ว และการทำให้ความสามารถเหล่านั้นออกดอกผลต้องการการจัดแนว มากกว่าสถาปัตยกรรมใหม่

ส่วนร่วมเฉพาะของงานวิจัยคือ

- การเข้ารหัส RGB แบบไบเจกทีฟที่ทำให้ความลึกและการแยกส่วนกลายเป็นปัญหาการสร้างภาพที่ผกผันได้

- สูตรการจูนตามคำสั่งแบบเบาที่เพิ่มทักษะเชิงภาพโดยไม่เผาไหม้ prior การสร้าง

- การประมาณความลึกแบบมีหน่วยโดยไม่ใช้ค่าวัดกล้องที่ชนะผู้เชี่ยวชาญที่ต้องพึ่งพามัน

- โปรโตคอลการถ่ายทอดแบบ zero-shot ที่เข้มงวดซึ่งทำให้ข้ออ้างเรื่องสายทั่วไปวัดผลได้บนเกณฑ์มาตรฐาน

งานวิจัยยังผลักดันกรอบคิดแบบเน้นการสร้างก่อน โดยระบุงานผ่านพรอมป์ท และถอดรหัสผลลัพธ์กลับจากภาพ RGB ที่ซึ่งน้ำหนักชุดเดียวกันจัดการทั้งการสร้างและการแปลความหมายเนื้อหาภาพ

สามารถทดสอบพรอมป์ทจากหน้าโครงการกับ Nano Banana Pro ฐาน หรือ Nano Banana 2 เพื่อดูว่าสิ่งใดเข้าถึงได้อยู่แล้วโดยไม่ต้องจูนตามคำสั่ง สร้างฟีเจอร์ reasoning-segmentation ด้วยโมเดลระดับ NBP และตัวกำหนดเส้นทางแบบ LLM มัลติโหมด แทนที่จะฝึกไปป์ไลน์แบบกำหนดเองโดยตรง

Vision Banana FAQs

วันนี้จะใช้ Vision Banana ได้อย่างไร?

ยังไม่ได้ โมเดลเปิดเป็นเพียงงานวิจัยและหน้าโครงการ แต่เวทของโมเดลอยู่ที่ Google DeepMind โมเดลฐาน Nano Banana Pro ใช้ได้ผ่าน Gemini API และ AI Studio และวิทยานิพนธ์ของงานวิจัยเองก็ชี้ว่า เพียงแค่พรอมป์ท NBP โดยตรงด้วยพรอมป์ทจากหน้าโครงการก็น่าจะได้ผลลัพธ์ที่มีความหมายแล้ว

Vision Banana จะแทนที่ SAM 3 หรือ Depth Anything ได้หรือไม่?

ยังไม่ สามารถทดแทนวันนี้ไม่ได้ ส่วนใหญ่เพราะต้นทุน สำหรับงานที่ต้องรันการอนุมานเชิงภาพราคาถูกในสเกลใหญ่ (วิดีโอ แบบเรียลไทม์ มือถือ) โมเดลเฉพาะทางยังชนะด้านเศรษฐศาสตร์อยู่

สิ่งนี้เทียบกับ MLLM อย่าง GPT-5V หรือ Gemini 2.5 อย่างไร?

MLLM แบบมัลติโหมดรับภาพแล้วสร้างข้อความ ส่วน Vision Banana รับภาพและพรอมป์ทเพื่อสร้างภาพ พวกมันแก้ปัญหาคนละแบบกัน

ทำไม Vision Banana ไม่ใช้ค่าวัดกล้องเพื่อความลึก?

ผู้เชี่ยวชาญส่วนใหญ่ใช้ intrinsics เพื่อแก้ความกำกวมของสเกลแบบกล้องตัวเดียว (วัตถุเล็กระยะใกล้กับวัตถุใหญ่ระยะไกลให้พิกเซลเหมือนกันได้) แต่ Vision Banana อนุมานสเกลจากปริยายเชิงภาพที่เรียนรู้ระหว่างพรีเทรนเชิงกำเนิดเกี่ยวกับขนาดวัตถุ บริบทฉาก และความรู้เกี่ยวกับโลก