Programa

A visão computacional sempre funcionou com uma separação clara entre modelos que geram imagens e modelos que as entendem. Frameworks generativos eram a principal fonte de síntese, enquanto arquiteturas discriminativas focavam em classificação, segmentação ou regressão de profundidade. O roteiro padrão para qualquer tarefa nova em visão era escolher uma arquitetura, acoplar uma cabeça específica para a tarefa e fazer fine-tuning com dados rotulados.

É essa suposição que o Vision Banana, do Google DeepMind, quer derrubar. O artigo defende que geradores de imagens já aprenderam tudo o que um modelo de visão generalista precisa, incluindo segmentação, profundidade, normais de superfície e muito mais. Na visão dos autores, o que falta é apenas uma camada leve de instruction tuning para tornar essas capacidades latentes mensuráveis em benchmarks.

Neste post, começo explicando o que é o Vision Banana e por que o artigo chamou a atenção da área, depois mostro como o modelo funciona. Encerrando, trago o que deu certo, o que ainda não funciona e os pontos que os profissionais devem levar daqui. Ao longo do texto, destaco as perguntas que tive ao ler o artigo — provavelmente as mesmas de outros leitores.

Observação: o Vision Banana em si não é público. O que temos é o artigo e a página do projeto. O modelo base é construído sobre o Nano Banana Pro e está disponível via Gemini API e Google AI Studio.

O que é o Vision Banana?

Vision Banana é um modelo de pesquisa do Google DeepMind, criado a partir do Nano Banana Pro (gerador texto-para-imagem) com uma camada leve de instruction tuning usando uma mistura dos dados originais de treino e uma pequena porção de dados de tarefas de visão computacional.

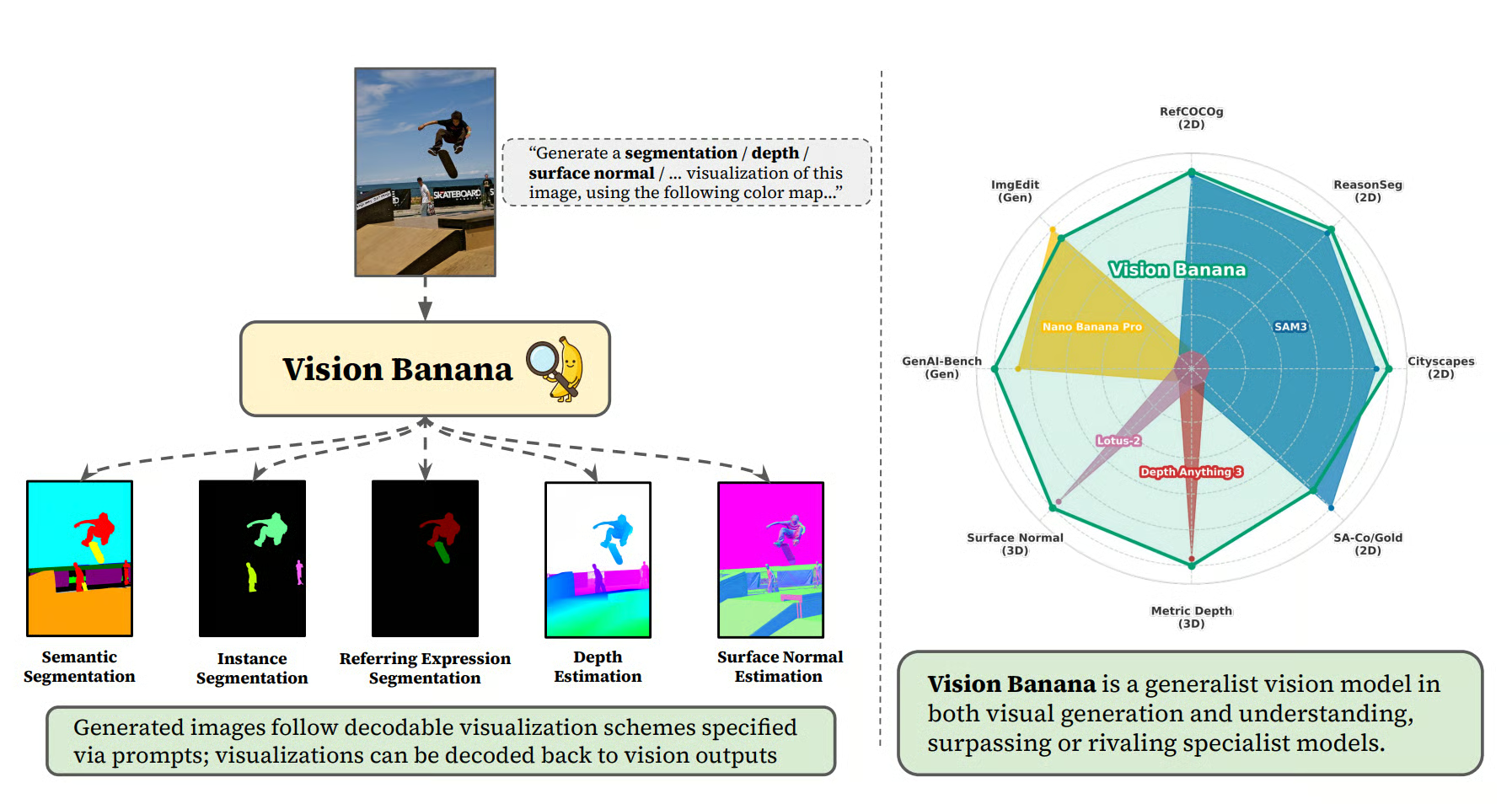

Figura 1: capacidades ocultas de entendimento visual em geradores de imagem via instruction-tuning no Nano Banana Pro (Fonte)

A receita é:

- Manter a arquitetura do modelo base inalterada

- Misturar dados de segmentação, profundidade e normais de superfície na distribuição de treino em baixa proporção

- Fazer instruction tuning

Toda a metodologia de treino não exige nova arquitetura, cabeças customizadas, perdas auxiliares ou decoders especializados.

O modelo resultante:

- Supera o SAM 3 em três benchmarks de segmentação

- Supera o Depth Anything V3 na estimativa de profundidade métrica

- Supera o Lotus-2 na estimativa de normais de superfície

- Mantém a qualidade de geração de imagens do modelo base (empate estatístico no GenAI-Bench e ImgEdit)

Tudo isso sob um protocolo rigoroso de transferência zero-shot, garantindo que o modelo nunca viu os conjuntos de treino dos benchmarks nos quais é avaliado.

Por que isso importa?

O aprendizado de representações visuais já testou muitos objetivos de pré-treinamento ao longo dos anos. Os mais comuns incluem:

- Classificação supervisionada (ImageNet, JFT)

- Aprendizado contrastivo (CLIP, SigLIP)

- Auto-destilação (DINO, DINOv2)

- Autoencoder com mascaramento (MAE, BEiT)

O importante é que nenhum deles é generativo. A geração de imagens sempre foi tratada como uma capacidade downstream, não como base para entendimento. As primeiras tentativas de pré-treinamento generativo (iGPT, LVM) ficaram atrás de métodos contrastivos em benchmarks de qualidade de representação.

A escala de objetivos generativos autorregressivos via predição do próximo token catalisou o surgimento de capacidades generalistas zero-shot em modelos como o GPT-3. Comportamentos complexos downstream mostraram-se latentes no espaço de pesos de alta dimensão e vieram à tona por meio de fine-tuning supervisionado leve e alinhamento por instruções. Exemplos incluem:

- Tradução automática neural

- Síntese de código em múltiplas linguagens

- Sumarização abstrata

- Raciocínio aritmético

O Vision Banana defende que estamos no mesmo momento para visão. O artigo traça explicitamente uma analogia entre o pré-treinamento por geração de imagens e o pré-treinamento de modelos de linguagem, e entre instruction tuning e a etapa de alinhamento.

Se a analogia se sustentar, vamos parar de construir pipelines específicos por tarefa e tratar um único grande gerador de imagens como a camada fundacional, especificando tarefas via prompts.

Como o Vision Banana funciona?

O mecanismo é simples: toda tarefa de visão é reformulada como "gerar uma imagem RGB com estas propriedades" e, no momento do decodificador, você transforma essa imagem RGB de volta em previsões da tarefa de forma determinística.

Veja como cada tarefa é mapeada:

Segmentação semântica

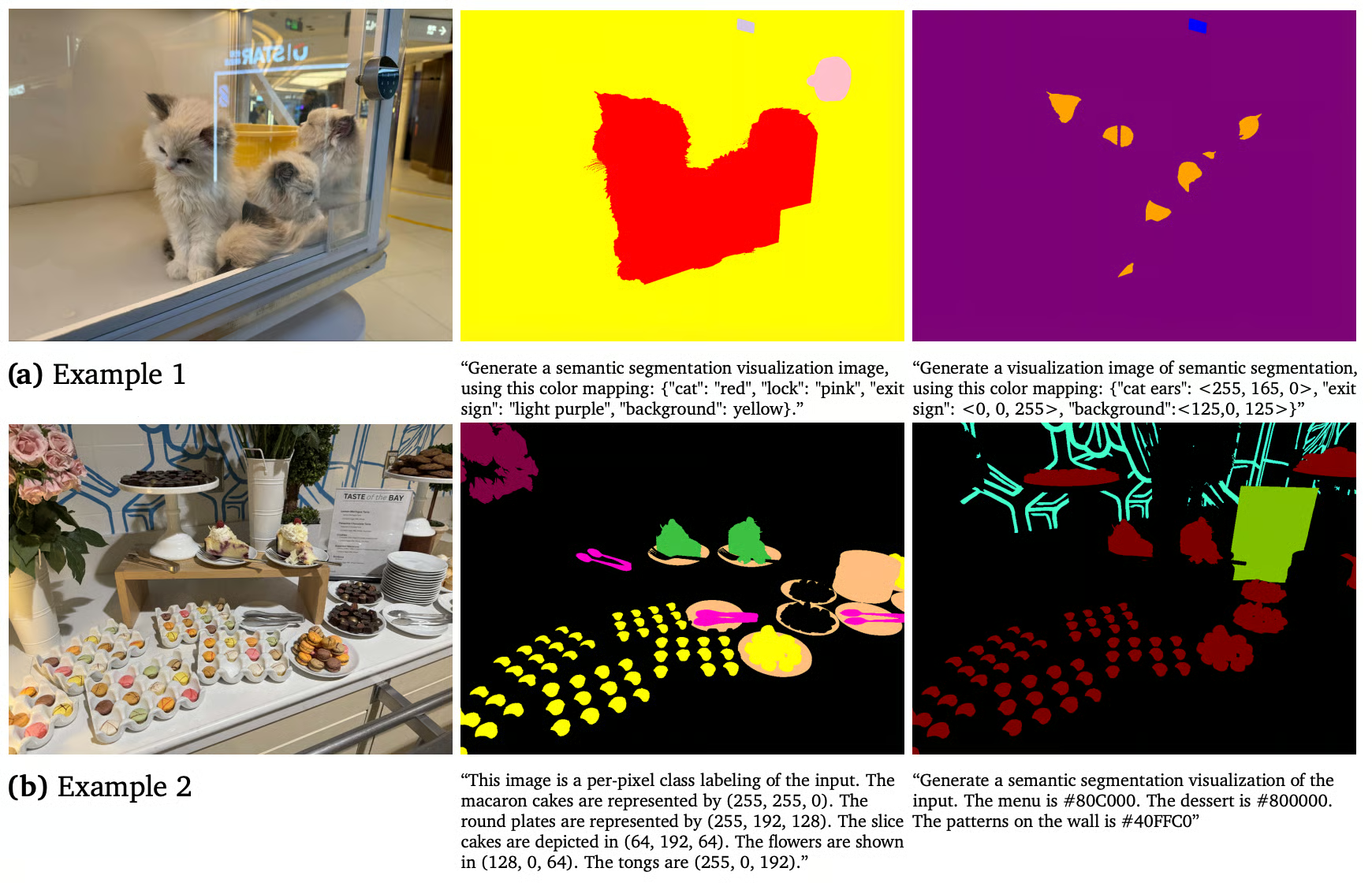

Faça um prompt com atribuições de cores por classe e, na decodificação, agrupe os pixels à cor especificada mais próxima. O vocabulário é o que você colocar no prompt; é open-vocabulary por construção.

Fica mais claro com um exemplo. Eis um prompt do artigo:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Figura 2: segmentação semântica (Fonte)

Segmentação por instância

Segmentação por instância é mais complexa que a semântica, porque o número de instâncias não é conhecido de antemão. Logo, não dá para pré-atribuir cores.

A solução do Vision Banana é processar uma classe por inferência, deixar o modelo atribuir dinamicamente cores distintas a instâncias distintas e, depois, na decodificação, agrupar pixels pelos modos de cor.

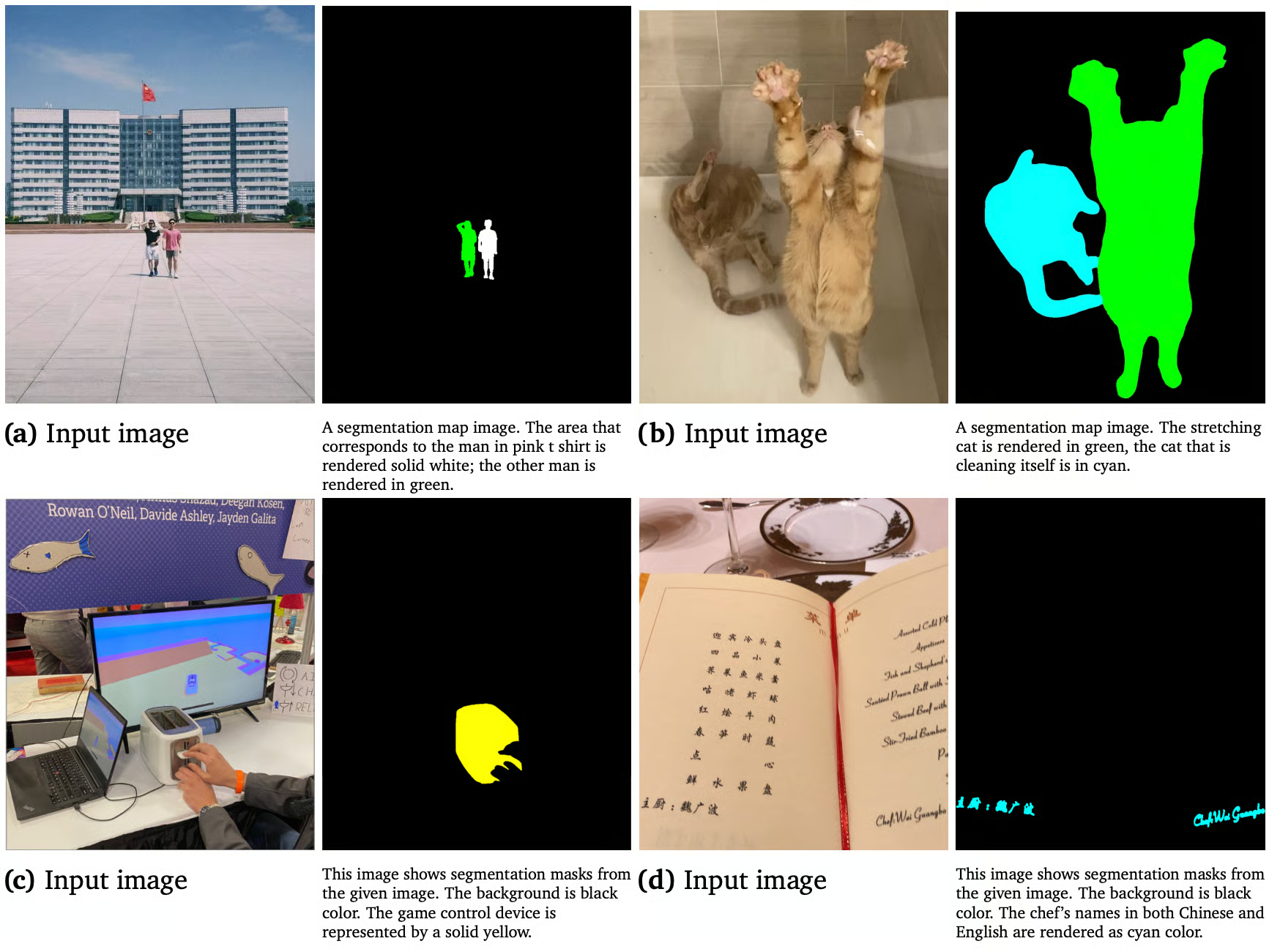

Segmentação por expressão

O Vision Banana aceita um prompt com uma descrição em linguagem natural do que segmentar e retorna uma máscara. Exemplo do artigo:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.É aqui que o raciocínio multimodal embutido no pré-treinamento generativo brilha. Modelos discriminativos sofrem com expressões referenciais porque a tarefa exige raciocínio linguístico e visual conjunto. Modelos generativos treinados em bilhões de pares legenda-imagem lidam com isso naturalmente.

Figura 3: o Vision Banana entende prompts em linguagem natural e raciocina sobre eles (Fonte)

Profundidade e normais de superfície

Tanto profundidade quanto normais de superfície são projetadas no espaço RGB via mapeamentos bijetivos, garantindo que as propriedades geométricas latentes sejam preservadas sem perda de informação durante a transformação. Vamos detalhar a codificação de profundidade para RGB na seção a seguir.

Esse paradigma unificado de inferência trata toda tarefa de visão computacional como um problema determinístico de geração de imagem. Ao manter uma interface RGB consistente em todo o pipeline, o modelo evita ramificações arquiteturais específicas por tarefa e depende totalmente do condicionamento por prompt para definir a semântica da saída.

Agora, vamos entender profundidade com um pouco mais de detalhe. É aqui que a abordagem pode desandar com mais facilidade.

Codificando profundidade ilimitada em RGB

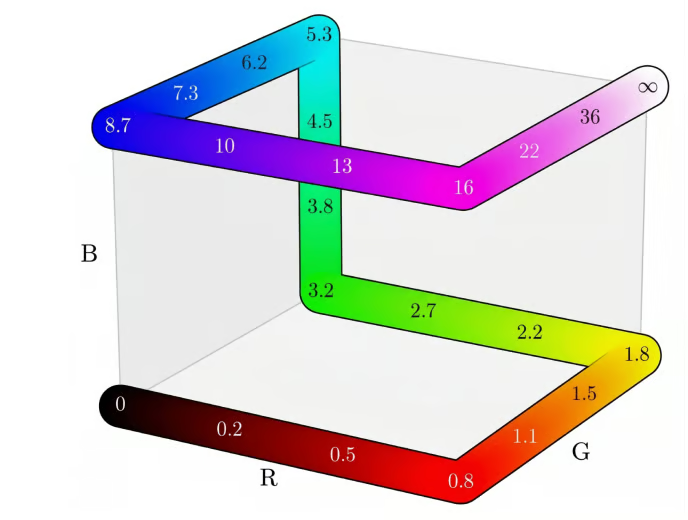

Se a codificação não for bijetiva, você não recupera distâncias métricas na decodificação e toda a tese de "geração de imagem como interface universal" cai por terra. Vale entender isso para saber se a abordagem é sólida ou apenas um truque.

O problema é que valores de profundidade são números reais ilimitados em [0, ∞), enquanto RGB é limitado a [0, 1]. Então, para usar "gerar o mapa de profundidade" como sinal de treino, você precisa de um mapeamento bijetivo no qual cada profundidade métrica corresponda a um único valor RGB e, na decodificação, seja possível invertê-lo de volta para metros.

A abordagem do Vision Banana tem duas etapas:

Etapa 1: comprimir a profundidade ilimitada em [0, 1)

Os autores usam a transformação de potência de Barron (2025) com parâmetro de forma λ = -3, o que dá mais resolução às regiões próximas do que às distantes. Um objeto a 2 metros recebe mais precisão do que um a 200 metros. Isso combina com o que a maioria das aplicações precisa: objetos manipuláveis, não os distantes.

Etapa 2: mapear [0, 1) nas arestas do cubo RGB

Em seguida, eles interpolam ao longo de um caminho linear por partes que percorre as arestas do cubo RGB, essencialmente a primeira iteração de uma curva de Hilbert 3D. Isso produz transições de cor suaves e perceptualmente coerentes, sem ambiguidade sobre qual cor corresponde a qual profundidade.

Como ambas as etapas são estritamente invertíveis, a composição é uma bijeção. Eles então treinam com verdade-terreno codificada em RGB e, na inferência, projetam o RGB previsto na aresta mais próxima do cubo e invertem de volta para metros.

Figura 4: uma visualização da nossa bijeção entre distâncias escalares métricas d ≥ 0 e valores de cor RGB (Fonte)

Para robustez, o treino é aumentado com colormaps alternativos como Plasma, Inferno, Viridis e escala de cinza, para que o modelo lide com o estilo de visualização que você pedir no prompt.

Normais de superfície são mais simples porque já são vetores unitários com componentes em [-1, 1], o que mapeia diretamente para RGB com a convenção padrão do espaço da câmera (+x para a direita, +y para cima, +z saindo do plano da imagem). Assim, verde claro significa voltado para cima, vermelho rosado para a esquerda e azul/roxo claro voltado para a câmera. Sem necessidade de warp.

Observação: o Vision Banana não usa parâmetros intrínsecos da câmera em nenhum lugar, nem no treino nem na inferência. A maioria dos métodos SOTA de profundidade (Depth Anything V3, MoGe-2, UniK3D, DepthLM) usa intrínsecos em alguma etapa porque ajudam a desambiguar a escala monocular.

O fato de o Vision Banana inferir escala absoluta apenas por priors visuais e ainda assim vencer é a evidência mais forte do artigo de que o pré-treinamento generativo está fazendo trabalho geométrico, e não apenas casando padrões de visualizações vistas no treino.

Modelos especialistas vs. Vision Banana: comparação

A forma mais limpa de ver o que muda de fato é comparar os dois paradigmas diretamente em uma única tarefa. Vamos comparar estimativa de profundidade com a abordagem especialista (Marigold, Lotus, Depth Anything V3) e o Vision Banana.

Os dois paradigmas produzem artefatos diferentes. Marigold é uma ferramenta especializada, enquanto o Vision Banana é um generalista cuja abrangência vem de uma única etapa de treino.

As diferenças se desdobram em como o modelo é usado na prática:

|

Aspecto |

Especialista (estilo Marigold) |

Vision Banana |

|

Formato de saída |

Tensor específico da tarefa |

Imagem RGB |

|

Vocabulário |

Fixo no treino |

Definido no prompt |

|

Multitarefa |

Um modelo por tarefa |

Um modelo, muitas tarefas |

|

Intrínsecos da câmera |

Frequentemente necessários |

Não usados |

|

Capacidade de geração |

Perdida no fine-tuning |

Preservada |

|

Custo de inferência |

Baixo |

Alto (gerador de imagem completo) |

Os benchmarks trazem um mix de vitórias claras e uma derrota honesta. Tudo em zero-shot transfer, ou seja, o modelo não viu os conjuntos de treino dos benchmarks de avaliação.

Destaques de desempenho:

- Segmentação semântica (Cityscapes): Alcançou 0,699 de mIoU (mean Intersection over Union), superando o Segment Anything Model (SAM 3) especializado, com 0,652.

- Segmentação referencial (RefCOCOg): Obteve 0,738 de cIoU (cumulative IoU), acima do baseline SAM 3 Agent (0,734).

- Raciocínio visual complexo (ReasonSeg): Quando combinado com o Gemini 2.5 Pro, atingiu 0,793 de gIoU, superando o SAM 3 Agent (0,770) e estabelecendo um novo estado da arte zero-shot, mesmo contra metodologias totalmente supervisionadas não zero-shot.

- Estimativa de profundidade métrica: Registrou

δ(acurácia por limiar) média de 0,929 em quatro datasets distintos, superando o Depth Anything V3 (0,918). - Estimativa de normais de superfície: Obteve menor erro angular médio de 15,549° em três datasets indoor, demonstrando maior fidelidade geométrica que o Lotus-2 (16,558°).

Déficit de desempenho:

- Segmentação por instância (SA-Co/Gold): Desempenho de 0,540 pmF1 (avaliado em uma amostra de 500 queries do SA-Co/Gold, não no benchmark completo), atrás do SAM 3 não zero-shot (0,661) e no mesmo nível do DINO-X zero-shot (0,552). Isso provavelmente decorre da restrição de atribuição discreta de cores para cardinalidade de instâncias, o que limita a resolução em cenas muito densas.

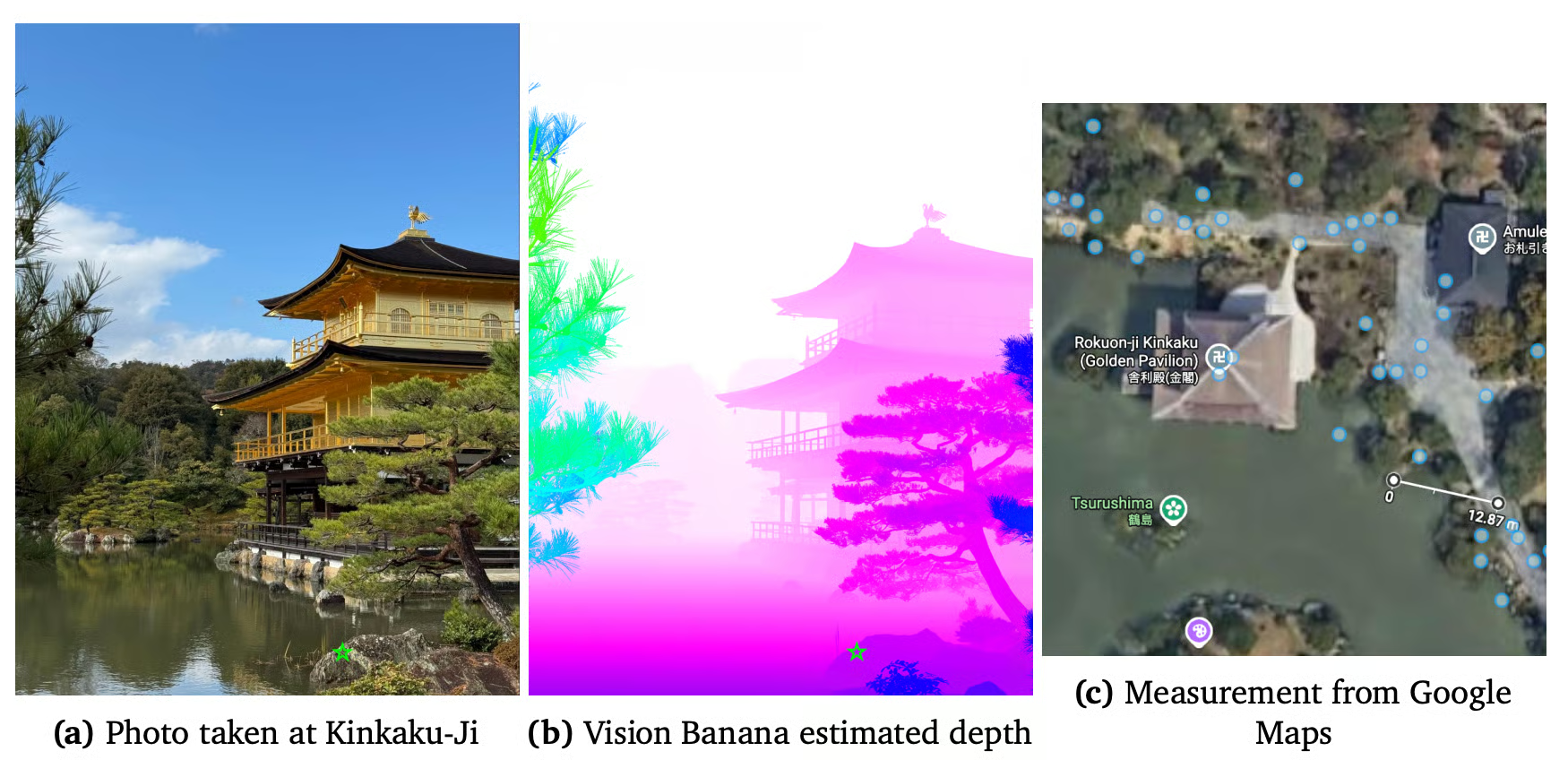

No GenAI-Bench, o Vision Banana vence 53,5% das comparações humanas contra o Nano Banana Pro base. Eis um exemplo de teste de grounding em cenário real do artigo:

Figura 5: estimativa de profundidade do Vision Banana (Fonte)

Um dos autores tirou uma foto de celular perto de Kinkaku-Ji. O Vision Banana previu um ponto específico a 13,71 metros. O Google Maps indica 12,87 — erro relativo absoluto de 6,5% numa foto de celular sem calibração, sem intrínsecos, sem setup. Esse é o tipo de teste que antecipa melhor o comportamento em produção do que números de benchmark.

Limitações do Vision Banana

O Vision Banana tem quatro restrições que vale destacar:

- Custo: Rodar um modelo do porte do Nano Banana Pro a cada inferência sai muito mais caro do que usar um especialista de profundidade destilado. O artigo reconhece isso diretamente na seção de trabalhos futuros. Para 10 mil quadros de vídeo, hoje essa abordagem não é competitiva economicamente. A destilação em especialistas menores é o próximo passo óbvio.

- Cenas com muitas instâncias: SA-Co/Gold é a derrota clara. A atribuição de cores por classe perde fôlego quando muitos objetos pequenos precisam ser contados com precisão. Aqui, o SAM 3 ainda vence.

- Imagem única: A implementação atual é fundamentalmente limitada a entradas estáticas de imagem única, sem capacidade para processamento espaço-temporal ou multivista. Raciocínio temporal fica para trabalhos futuros, segundo os autores.

- Implantação como caixa-preta: Você não consegue inspecionar, modificar ou rodar o modelo de forma privada. Isso pesa em contextos regulados ou sensíveis a PI, onde usar uma API de fronteira não é opção.

Considerações finais

O Vision Banana demonstra, de forma concreta, que geradores de imagens já fazem o grosso do trabalho de entendimento visual e que expor essas capacidades exige alinhamento, não novas arquiteturas.

As contribuições específicas do artigo são

- Codificação RGB bijetiva que torna profundidade e segmentação problemas invertíveis de geração de imagem

- Receita leve de instruction tuning que adiciona habilidades de visão sem destruir o prior de geração

- Estimativa de profundidade métrica sem intrínsecos de câmera que supera especialistas que dependem deles

- Protocolo rigoroso de transferência zero-shot que torna a tese generalista mensurável em benchmarks padrão.

O artigo também promove um modelo mental “generation-first”, no qual tarefas são especificadas por prompt e saídas são decodificadas de volta a partir de imagens RGB, e no qual os mesmos pesos lidam tanto com produzir quanto com interpretar conteúdo visual.

Você pode testar os prompts da página do projeto no Nano Banana Pro base ou no Nano Banana 2 para ver o que já é acessível sem instruction tuning, e construir recursos de reasoning+segmentation com modelos da classe NBP e um roteador LLM multimodal em vez de treinar pipelines customizados diretamente.

FAQs sobre o Vision Banana

Como posso usar o Vision Banana hoje?

Ainda não. O artigo e a página do projeto estão públicos, mas os pesos do modelo estão com o Google DeepMind. O modelo base, Nano Banana Pro, está disponível na Gemini API e no AI Studio, e a própria tese do artigo sugere que fazer prompts diretamente no NBP com os exemplos da página do projeto já deve gerar resultados significativos.

O Vision Banana pode substituir o SAM 3 ou o Depth Anything?

Hoje não, principalmente por custo. Para aplicações em que você precisa rodar visão em escala com baixo custo (vídeo, tempo real, mobile), especialistas ainda vencem em economia.

Como isso se compara a MLLMs como GPT-5V ou Gemini 2.5?

LLMs multimodais recebem uma imagem e produzem texto. O Vision Banana recebe uma imagem e um prompt para produzir uma imagem. Eles resolvem problemas diferentes.

Por que o Vision Banana não usa intrínsecos de câmera para profundidade?

A maioria dos especialistas usa intrínsecos para desambiguar a escala monocular (um objeto pequeno perto e um objeto grande longe podem gerar pixels idênticos). Já o Vision Banana infere escala a partir de priors visuais aprendidos no pré-treinamento generativo sobre tamanhos de objetos, contexto de cena e conhecimento de mundo.

Sou Especialista Google Developers em ML (Gen AI), tricampeã no Kaggle e Embaixadora Women Techmakers, com mais de três anos de experiência na área de tecnologia. Cofundei uma startup de saúde em 2020 e atualmente faço um mestrado em ciência da computação na Georgia Tech, com foco em aprendizado de máquina.