Track

Компьютерное зрение традиционно разделяло модели, которые генерируют изображения, и модели, которые их понимают. Генеративные фреймворки служили основным источником синтеза, а дискриминативные архитектуры фокусировались на классификации, сегментации или оценке глубины. Стандартный подход к новой задаче зрения: выбрать архитектуру, добавить специализированную «голову» под задачу и дообучить на размеченных данных.

Именно это предположение и намерена сломать Vision Banana от Google DeepMind. Авторы утверждают, что генераторы изображений уже выучили всё, что нужно универсальной модели зрения, включая сегментацию, глубину, нормали поверхности и многое другое. По их мнению, не хватает лишь тонкого слоя instruction-tuning, чтобы сделать эти латентные возможности измеримыми на бенчмарках.

В этом материале я начну с того, что такое Vision Banana и почему статья привлекла внимание сообщества, затем разберу, как работает модель. В конце — что получается, что нет и какие выводы стоит сделать практикам. По ходу отмечу вопросы, которые у меня возникали при чтении — вероятно, у других читателей они будут те же.

Примечание: сама Vision Banana публично недоступна. Опубликованы статья и страница проекта. Базовая модель построена на Nano Banana Pro и доступна через Gemini API и Google AI Studio.

Что такое Vision Banana?

Vision Banana — исследовательская модель Google DeepMind, полученная из Nano Banana Pro (генератор текста в изображение) с помощью лёгкого instruction-tuning на смеси её исходных обучающих данных и небольшого объёма данных по задачам компьютерного зрения.

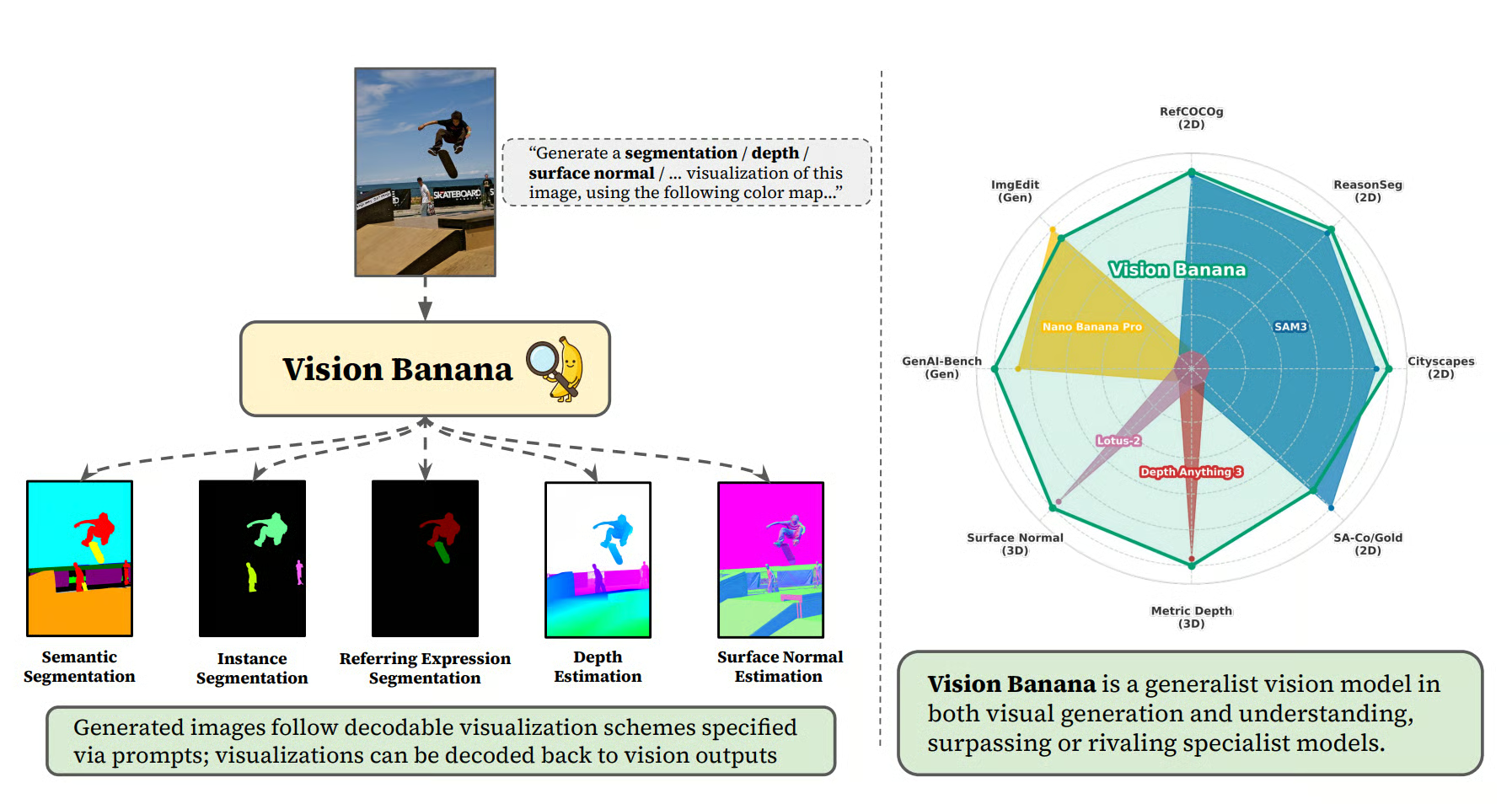

Рисунок 1: Скрытые способности генераторов изображений к визуальному пониманию при instruction-tuning Nano Banana Pro (Источник)

Рецепт следующий:

- Сохранить архитектуру базовой модели без изменений

- Смешать данные по сегментации, глубине и нормалям поверхности в обучающее распределение в низкой пропорции

- Выполнить instruction-tuning

Вся методология обучения не требует новой архитектуры, специальных «голов», вспомогательных лоссов или специализированных декодеров.

Результирующая модель:

- Обходит SAM 3 на трёх бенчмарках по сегментации

- Превосходит Depth Anything V3 в оценке метрической глубины

- Превосходит Lotus-2 в оценке нормалей поверхности

- Сохраняет качество генерации изображений базовой модели (статистическая ничья на GenAI-Bench и ImgEdit)

Всё это достигнуто в строгом протоколе zero-shot transfer, гарантирующем, что модель не видела обучающих частей бенчмарков, на которых её оценивают.

Почему это важно?

Обучение представлений для зрения пробовало множество целей предобучения. Распространённые варианты:

- Супервизируемая классификация (ImageNet, JFT)

- Контрастивное обучение (CLIP, SigLIP)

- Самодистилляция (DINO, DINOv2)

- Маскируемое автоэнкодирование (MAE, BEiT)

Важно, что ни один из этих подходов не является генеративным. Генерация изображений исторически считалась вторичной способностью, а не основой для понимания. Ранние попытки генеративного предобучения (iGPT, LVM) стабильно уступали контрастивным методам на бенчмарках качества представлений.

Масштабирование генеративных авторегрессионных целей через предсказание следующего токена стало толчком к появлению zero-shot универсальных способностей у моделей вроде GPT-3. Сложные поведенческие паттерны оказались латентно заложены в высокоразмерном весовом пространстве и впоследствии проявлялись через лёгкое супервизируемое дообучение и выравнивание инструкций. Примеры включают:

- Нейронный машинный перевод

- Многоязычный синтез кода

- Абстрактное суммирование

- Арифметическое рассуждение

Vision Banana утверждает, что мы пришли к тому же моменту в области зрения. В статье напрямую проводится аналогия между предобучением генераторов изображений и предобучением языковых моделей, а также между instruction-tuning и шагом выравнивания.

Если аналогия верна, мы перестанем строить конвейеры под конкретные задачи и будем считать один большой генератор изображений фундаментальным слоем, а задачи задавать через подсказки.

Как работает Vision Banana?

Механизм прост: любая задача зрения переформулируется как «сгенерировать RGB-изображение с такими свойствами», а при декодировании это RGB-изображение детерминированно превращается обратно в предсказания по задаче.

Соответствие для каждой задачи таково:

Семантическая сегментация

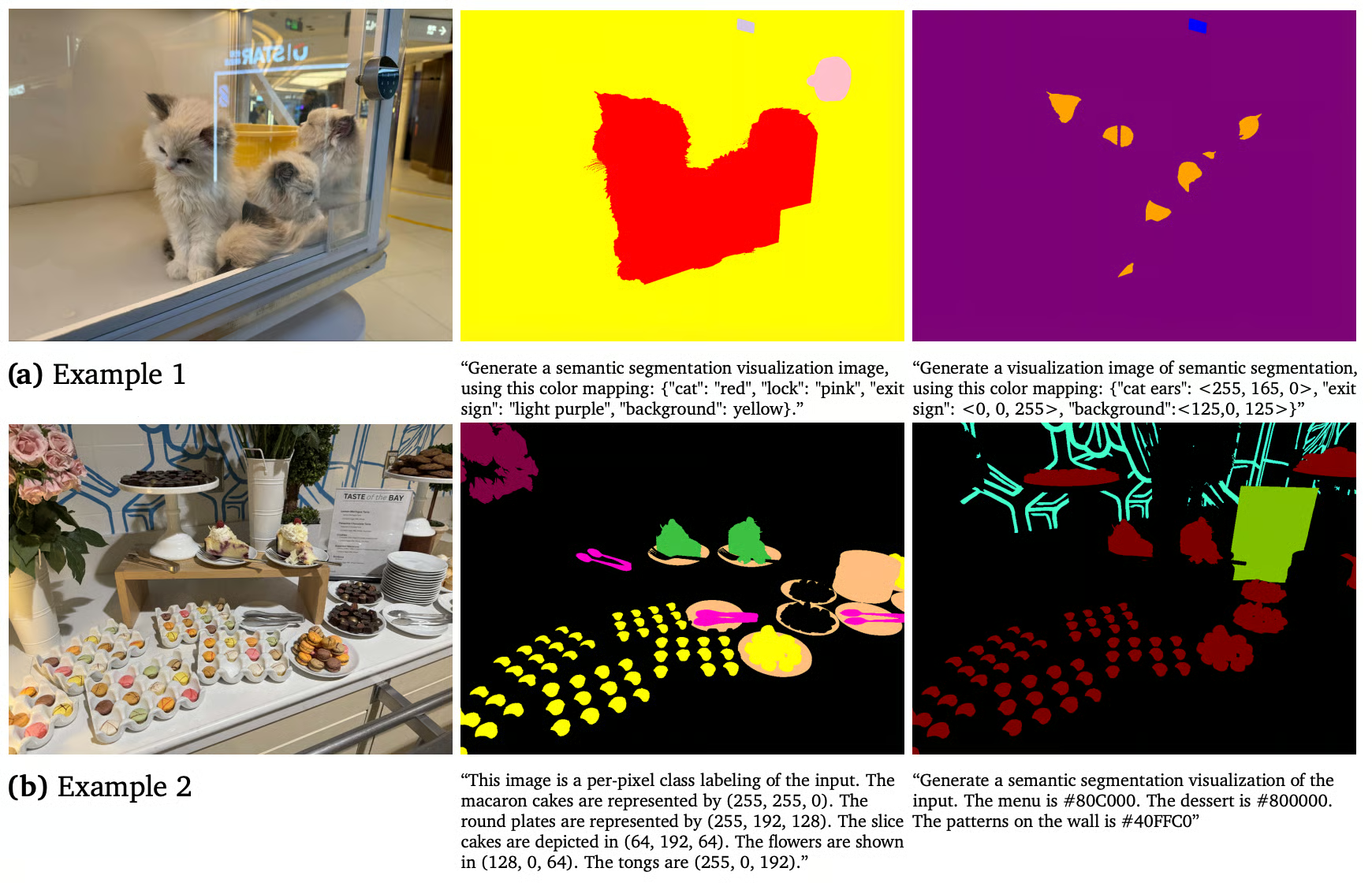

Задайте в подсказке цвет для каждого класса, а при декодировании кластеризуйте пиксели по ближайшему указанному цвету. Словарь — любой, который вы укажете в подсказке; по определению это open-vocabulary.

Это станет яснее на примере. Вот подсказка из статьи:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Рисунок 2: Семантическая сегментация (Источник)

Инстанс-сегментация

Инстанс-сегментация сложнее семантической, потому что число экземпляров заранее неизвестно. Значит, нельзя заранее назначить цвета.

Решение Vision Banana — обрабатывать по одному классу за инференс, позволять модели динамически назначать разные цвета разным экземплярам и затем кластеризовать пиксели по модам цвета при декодировании.

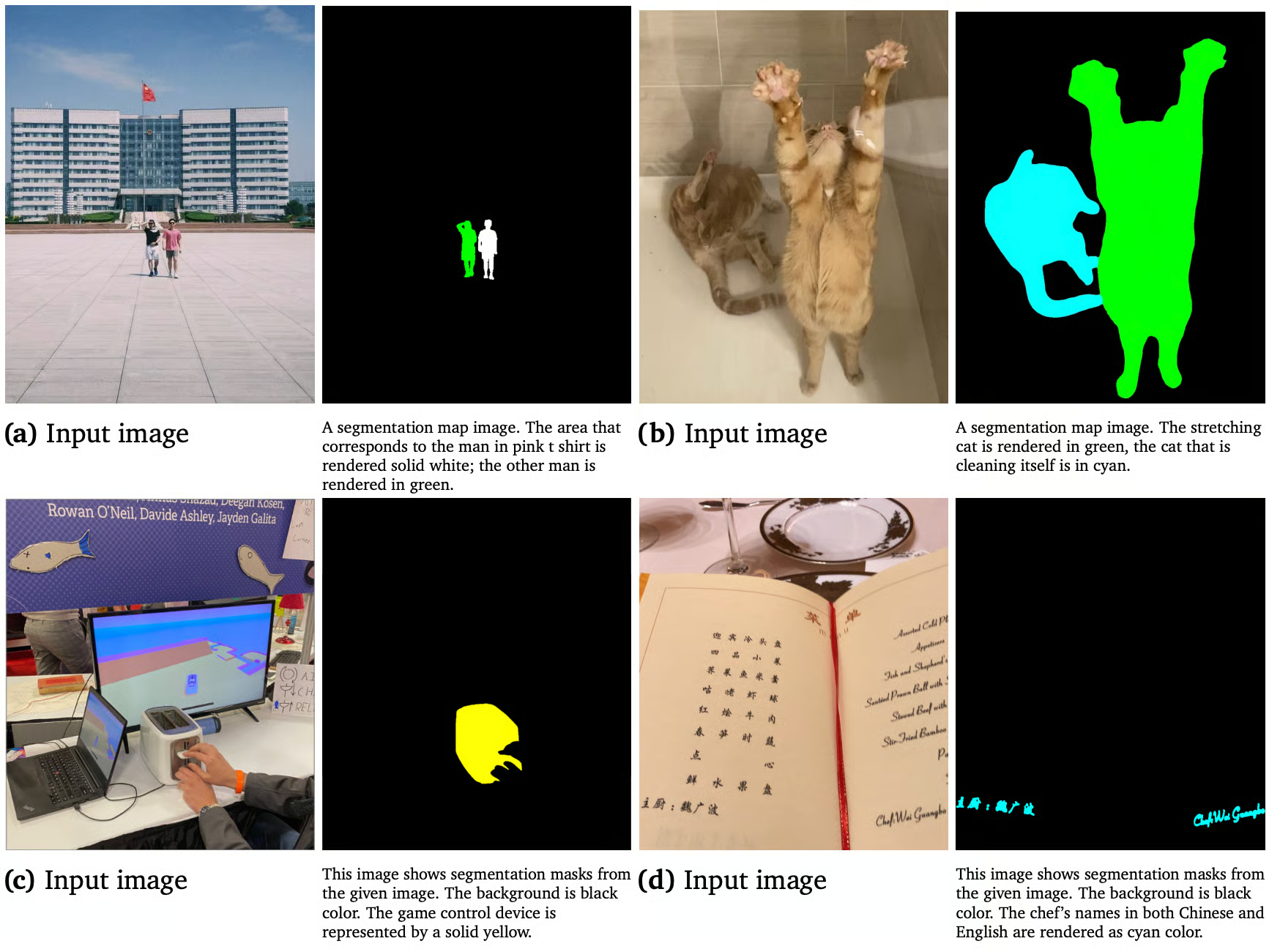

Сегментация по описанию

Vision Banana может принимать подсказку с описанием на естественном языке того, что нужно сегментировать, и возвращать маску. Вот пример подсказки из статьи:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Здесь раскрывается сила мультимодального рассуждения, заложенного в генеративном предобучении. Дискриминативным моделям трудно работать с референциальными выражениями, потому что задача требует совместного языкового и визуального рассуждения. Генеративные модели, обученные на миллиардах пар «подпись–изображение», справляются с этим естественно.

Рисунок 3: Vision Banana понимает подсказки на естественном языке и умеет по ним рассуждать (Источник)

Глубина и нормали поверхности

И глубина, и нормали проецируются в RGB-пространство через биективные отображения, что гарантирует сохранение латентных геометрических свойств без потерь информации при преобразовании. Подробности кодирования глубины в RGB разберём в следующем разделе.

Единая парадигма инференса трактует каждую задачу компьютерного зрения как детерминированную задачу генерации изображения. Поддерживая единый RGB-интерфейс по всему конвейеру, модель избегает архитектурных веток под конкретные задачи, полностью полагаясь на подсказку для задания семантики выхода.

Теперь разберём глубину подробней. Именно здесь подход легче всего может «сломаться».

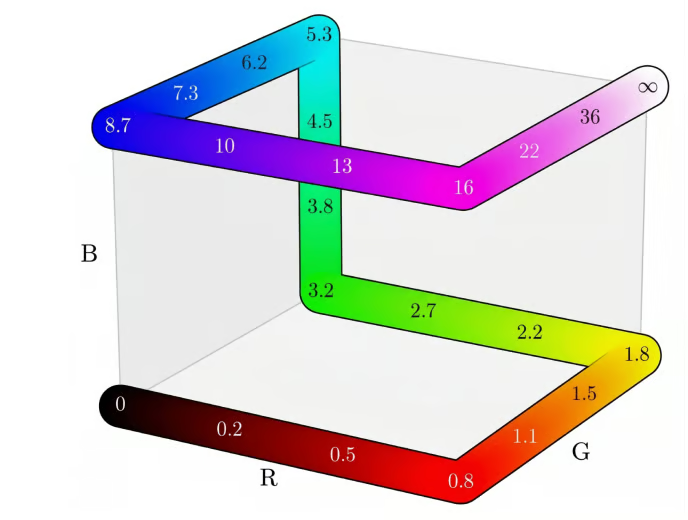

Кодирование неограниченной глубины в RGB

Если кодирование не биективно, вы не сможете восстановить метрические расстояния при декодировании, и вся идея «генерация изображения как универсальный интерфейс» разваливается. Это важно понять, чтобы оценить, принципиален ли подход или это просто хак.

Проблема в том, что значения глубины — неограниченные вещественные числа в [0, ∞), а RGB — ограниченное [0, 1]. Чтобы использовать «сгенерировать карту глубины» как обучающий сигнал, нужна биекция, где каждой метрической глубине соответствует ровно одно RGB-значение, а при декодировании вы можете обратить его обратно в метры.

В Vision Banana подход двухступенчатый:

Шаг 1: Сжать неограниченную глубину в [0, 1)

Авторы используют степенное преобразование Баррона (2025) с параметром формы λ = -3, которое даёт ближним областям больше разрешения, чем дальним. Объект на 2 метрах получает больше точности, чем на 200 метрах. Это соответствует большинству прикладных задач — нас интересуют объекты, с которыми можно взаимодействовать, а не далёкие.

Шаг 2: Отобразить [0, 1) на рёбра RGB-куба

Далее выполняется интерполяция вдоль кусочно-линейного пути по рёбрам RGB-куба — фактически первая итерация 3D-кривой Хильберта. Это даёт плавные, перцептуально осмысленные переходы цветов без неоднозначности, какой цвет соответствует какой глубине.

Поскольку обе стадии строго обратимы, их композиция — биекция. Обучение идёт на RGB-кодированной разметке, а при инференсе предсказанное RGB проецируется на ближайшее ребро куба и обращается обратно в метры.

Рисунок 4: Визуализация биективного соответствия между скалярными метрическими расстояниями d ≥ 0 и RGB-значениями цвета (Источник)

Для надёжности в обучение добавляют альтернативные цветовые карты — Plasma, Inferno, Viridis и градации серого, — чтобы модель справлялась с любым стилем визуализации, который вы попросите в подсказке.

С нормалями поверхности проще, потому что это уже единичные векторы с компонентами в [-1, 1], которые напрямую сопоставляются с RGB по стандартной камеро-ориентированной конвенции (+x вправо, +y вверх, +z из плоскости изображения). Светло-зелёный означает «смотрит вверх», розовато-красный — «влево», светло-голубой/фиолетовый — «в камеру». Никаких искажений не нужно.

Важно: Vision Banana не использует параметры камеры ни при обучении, ни при инференсе. Большинство SOTA-методов глубины (Depth Anything V3, MoGe-2, UniK3D, DepthLM) используют их где-то в цикле, поскольку это помогает снять неоднозначность монокулярного масштаба.

То, что Vision Banana выводит абсолютный масштаб лишь из визуальных приоров и при этом выигрывает, — самый сильный довод в статье в пользу того, что генеративное предобучение действительно «делает геометрию», а не просто сопоставляет знакомые визуализации из обучающей выборки.

Специалисты против Vision Banana: сравнение

Проще всего увидеть различия, сравнив парадигмы на одной задаче. Сравним оценку глубины в «специалистском» подходе (Marigold, Lotus, Depth Anything V3) и Vision Banana.

Парадигмы дают разные артефакты. Marigold — специализированный инструмент, тогда как Vision Banana — универсал, чья широта достигается одним шагом обучения.

Эти различия сказываются на том, как модель используется на практике:

|

Аспект |

Специалист (в стиле Marigold) |

Vision Banana |

|

Формат вывода |

Специализированный тензор |

RGB-изображение |

|

Словарь |

Фиксирован при обучении |

Задаётся в подсказке |

|

Мультизадачность |

Одна модель на задачу |

Одна модель, много задач |

|

Параметры камеры |

Часто требуются |

Не используются |

|

Способность к генерации |

Теряется при дообучении |

Сохраняется |

|

Стоимость инференса |

Низкая |

Высокая (полный генератор изображений) |

Бенчмарки — смешанная картина явных побед и одного честного поражения. Всё в zero-shot transfer, то есть модель не видела обучающие сплиты наборов, по которым её оценивают.

Профили превосходства:

- Семантическая сегментация (Cityscapes): Достигнуто 0,699 mIoU, что выше специализированной Segment Anything Model (SAM 3) с 0,652.

- Сегментация по описанию (RefCOCOg): Показано 0,738 cIoU (кумулятивный IoU), превышая базовый показатель SAM 3 Agent 0,734.

- Сложное визуальное рассуждение (ReasonSeg): При совместном использовании с Gemini 2.5 Pro достигнуто 0,793 gIoU, что выше SAM 3 Agent (0,770) и устанавливает новый zero-shot SOTA, даже по сравнению с не-zero-shot, полностью супервизируемыми методами.

- Метрическая оценка глубины: Среднее

δ(пороговая точность) 0,929 по четырём различным датасетам, лучше, чем у Depth Anything V3 (0,918). - Оценка нормалей поверхности: Ниже средняя средняя угловая ошибка 15,549° по трём indoor-датасетам, что демонстрирует лучшую геометрическую точность по сравнению с Lotus-2 (16,558°).

Дефицит производительности:

- Инстанс-сегментация (SA-Co/Gold): 0,540 pmF1 (оценка на 500-запросной подвыборке SA-Co/Gold, а не на полном бенчмарке), отстаёт от не-zero-shot SAM 3 (0,661) и сопоставима с zero-shot DINO-X (0,552). Вероятная причина — ограничение дискретного назначения цветов для количества экземпляров, что снижает разрешение в очень плотных сценах.

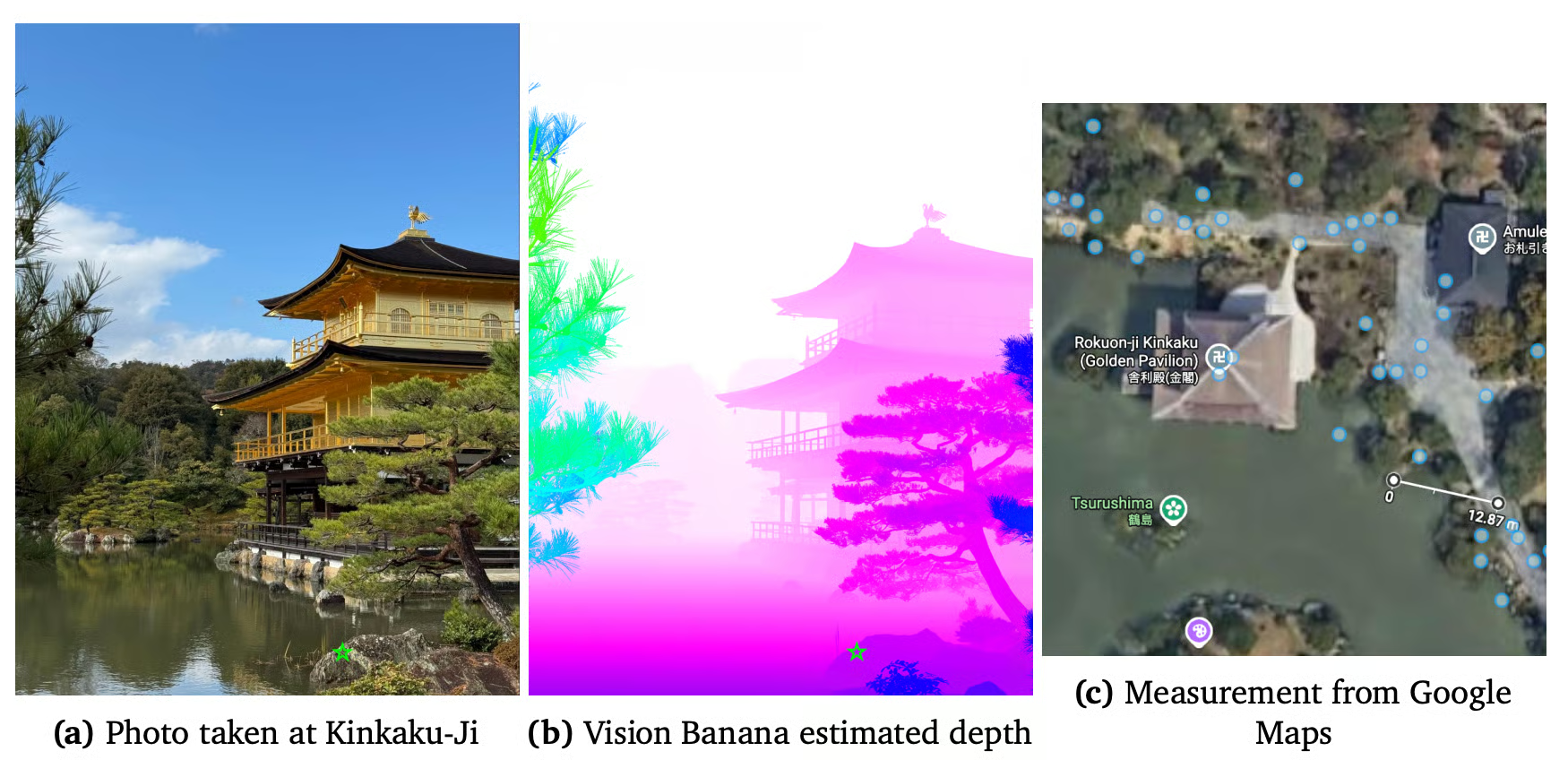

На GenAI-Bench Vision Banana выигрывает 53,5% человеческих сравнений против базовой Nano Banana Pro. Ниже — пример «полевого» теста привязки из статьи:

Рисунок 5: Оценка глубины Vision Banana (Источник)

Автор сделал фото на смартфон рядом с Кинкакудзи. Vision Banana предсказала конкретную точку на расстоянии 13,71 метра. Google Maps показывает 12,87 — это 6,5% абсолютной относительной ошибки на фото с телефона без калибровки, без параметров камеры, без подготовки. Такой тест надёжнее предсказывает поведение при внедрении, чем цифры бенчмарков.

Ограничения Vision Banana

У Vision Banana есть четыре ограничения, на которые стоит обратить внимание:

- Стоимость: Запуск модели масштаба Nano Banana Pro для каждого инференса существенно дороже, чем запуск дистиллированного «специалиста» по глубине. В разделе Future Work это прямо признаётся. Для 10 тыс. видеокадров такой подход экономически невыгоден сегодня. Очевидный следующий шаг — дистилляция в меньших специалистов.

- Сцены с множеством экземпляров: SA-Co/Gold — явное поражение. Назначение цветов по классам быстро упирается в потолок, когда нужно точно посчитать множество мелких объектов. Тут SAM 3 всё ещё впереди.

- Одна картинка: Текущая реализация принципиально ограничена статичными, одноракурсными входными изображениями и не поддерживает пространственно-временную или мультиракурсную обработку. Темпоральное рассуждение авторы относят к будущей работе.

- «Чёрный ящик» при развёртывании: Вы не можете исследовать, модифицировать или запускать модель приватно. Это важно в регулируемых или чувствительных к ИС контекстах, где запуск пограничного API невозможен.

Заключение

Vision Banana наглядно показывает, что генераторы изображений уже выполняют основную работу по визуальному пониманию, а раскрыть эти способности помогает выравнивание, а не новые архитектуры.

Конкретные вклады статьи:

- Биективное RGB-кодирование, превращающее глубину и сегментацию в обратимые задачи генерации изображений

- Лёгкий рецепт instruction-tuning, добавляющий «навыки зрения» без утраты генеративного приора

- Метрическая оценка глубины без параметров камеры, превосходящая «специалистов», которым они требуются

- Строгий протокол zero-shot transfer, делающий универсальные претензии измеримыми на стандартных бенчмарках.

Статья также продвигает ментальную модель «сначала генерация», где задачи задаются подсказкой, а выходы декодируются из RGB-изображений, и где одни и те же веса отвечают и за генерацию, и за разбор визуального контента.

Вы можете протестировать подсказки со страницы проекта на базовой Nano Banana Pro или Nano Banana 2, чтобы увидеть, что уже доступно без instruction-tuning, и строить функции «reasoning-сегментации» с моделями класса NBP и мультимодальным LLM-роутером, а не обучать с нуля собственные конвейеры.

Vision Banana: часто задаваемые вопросы

Как я могу использовать Vision Banana уже сегодня?

Нет. Опубликованы статья и страница проекта, но веса модели находятся у Google DeepMind. Базовая модель, Nano Banana Pro, доступна в Gemini API и AI Studio, и сама логика статьи предполагает, что прямое использование подсказок со страницы проекта с NBP уже должно давать содержательные результаты.

Может ли Vision Banana заменить SAM 3 или Depth Anything?

Пока нет, в основном из-за стоимости. В приложениях, где нужно дёшево запускать инференс зрения в масштабе (видео, реальное время, мобильные устройства), специалисты пока выигрывают по экономике.

Чем это отличается от MLLM вроде GPT-5V или Gemini 2.5?

Мультимодальные LLM принимают изображение и выдают текст. Vision Banana принимает изображение и подсказку и выдаёт изображение. Они решают разные задачи.

Почему Vision Banana не использует параметры камеры для глубины?

Большинство «специалистов» используют параметры камеры, чтобы снять неоднозначность монокулярного масштаба (маленький близкий объект и большой далёкий могут давать идентичные пиксели). Однако Vision Banana выводит масштаб из визуальных приоров, выученных в ходе генеративного предобучения об объектах, контексте сцен и знаниях о мире.