Program

Visi komputer sejak lama berjalan dengan pemisahan yang jelas antara model yang menghasilkan gambar dan model yang memahaminya. Kerangka generatif menjadi sumber utama untuk sintesis, sementara arsitektur diskriminatif berfokus pada klasifikasi, segmentasi, atau regresi kedalaman. Buku pedoman standar untuk tugas visi baru mana pun adalah memilih arsitektur, menambahkan head khusus tugas, dan melakukan finetuning pada data berlabel.

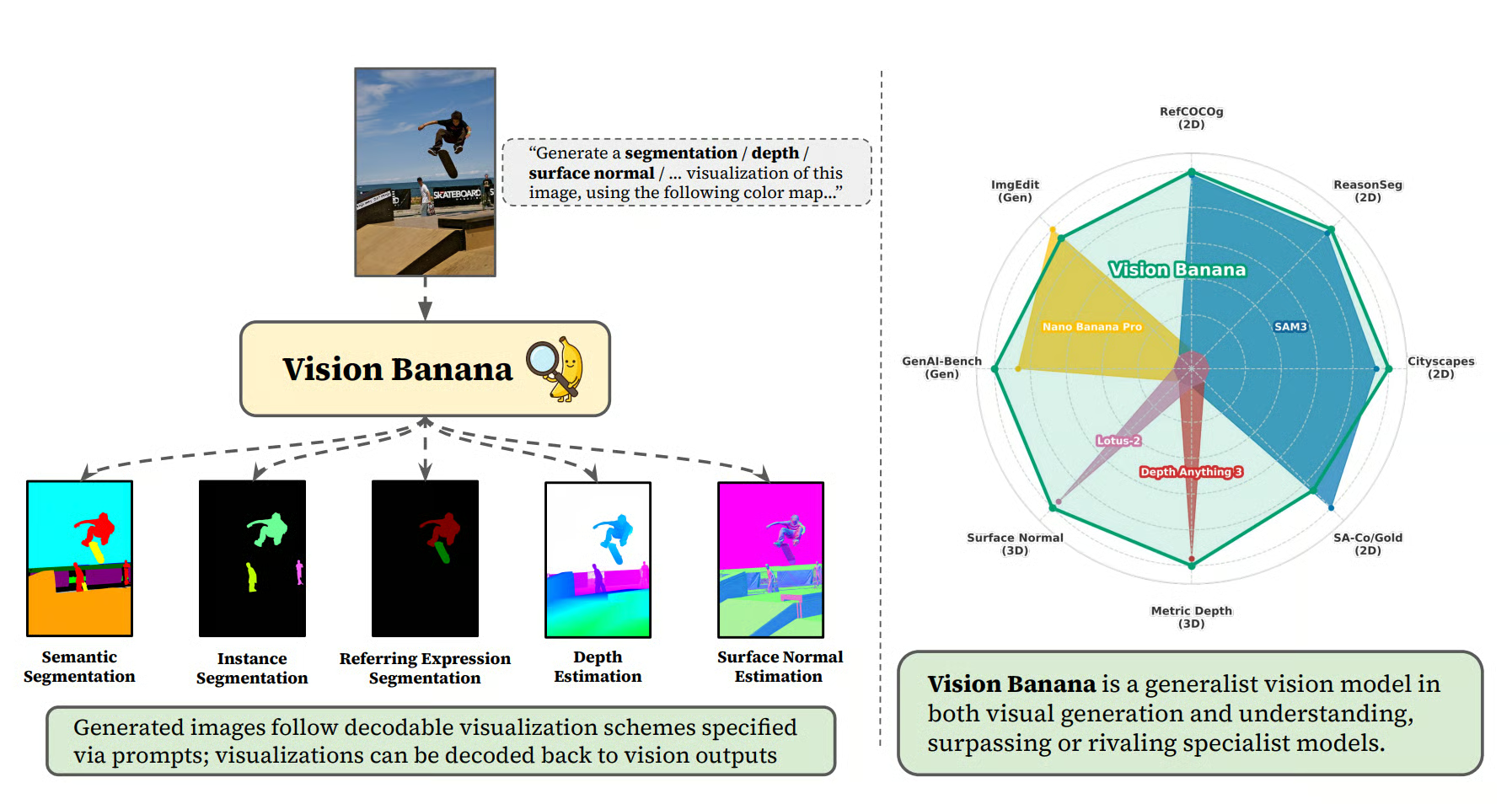

Asumsi itulah yang ingin dipatahkan oleh Vision Banana dari Google DeepMind. Makalah ini berargumen bahwa generator gambar sebenarnya telah mempelajari semua yang dibutuhkan model visi generalis, termasuk segmentasi, kedalaman, normal permukaan, dan lainnya. Menurut para penulis, yang kurang hanyalah lapisan instruction-tuning tipis untuk membuat kapabilitas laten tersebut dapat diukur di benchmark.

Dalam tulisan ini, saya akan mulai dari apa sebenarnya Vision Banana dan mengapa makalah ini menarik perhatian bidang ini, lalu menjabarkan cara kerja modelnya. Saya akan menutup dengan apa yang berhasil, apa yang belum, dan apa yang perlu dicermati praktisi. Sepanjang jalan, saya akan mengangkat pertanyaan yang saya miliki saat membaca makalah. Pembaca lain kemungkinan punya pertanyaan yang sama.

Catatan: Vision Banana sendiri belum dapat diakses publik. Yang tersedia adalah makalah dan laman proyek. Model dasar dibangun di atas Nano Banana Pro dan tersedia melalui Gemini API dan Google AI Studio.

Apa itu Vision Banana?

Vision Banana adalah model riset dari Google DeepMind, dibangun dengan mengambil Nano Banana Pro (generator teks-ke-gambar) dan menerapkan instruction tuning ringan pada campuran data pelatihan aslinya, ditambah sedikit data tugas visi komputer.

Gambar 1: Kapabilitas pemahaman visual tersembunyi dari generator gambar melalui instruction-tuning pada Nano Banana Pro (Sumber)

Resepnya adalah:

- Biarkan arsitektur model dasar tetap tidak berubah

- Campurkan data segmentasi, kedalaman, dan normal permukaan ke dalam distribusi pelatihan pada rasio rendah

- Instruction-tune

Seluruh metodologi pelatihan ini tidak memerlukan arsitektur baru, head khusus, loss tambahan, maupun decoder khusus.

Model yang dihasilkan:

- Mengungguli SAM 3 pada tiga benchmark segmentasi

- Mengungguli Depth Anything V3 pada estimasi kedalaman metrik

- Mengungguli Lotus-2 pada estimasi normal permukaan

- Mempertahankan kualitas pembuatan gambar dari model dasarnya (imbang secara statistik pada GenAI-Bench dan ImgEdit)

Semua itu dicapai di bawah protokol transfer zero-shot yang ketat, memastikan model tidak pernah melihat split pelatihan dari benchmark yang dievaluasi.

Mengapa ini penting?

Pembelajaran representasi visi telah mencoba banyak objektif pretraining selama bertahun-tahun. Yang umum meliputi:

- Klasifikasi terawasi (ImageNet, JFT)

- Pembelajaran kontrasif (CLIP, SigLIP)

- Self-distillation (DINO, DINOv2)

- Masked autoencoding (MAE, BEiT)

Yang penting adalah bahwa tidak satu pun dari ini yang bersifat generatif. Pembuatan gambar secara historis dianggap sebagai kapabilitas hilir, bukan fondasi untuk pemahaman. Upaya pretraining generatif awal (iGPT, LVM) secara konsisten tertinggal dari metode kontrasif pada benchmark kualitas representasi.

Skalabilitas objektif autoregresif generatif melalui prediksi token berikutnya memicu munculnya kapabilitas generalis zero-shot pada model seperti GPT-3. Perilaku hilir yang kompleks ternyata laten di dalam ruang bobot berdimensi tinggi, kemudian dimunculkan melalui fine-tuning terawasi ringan dan penyelarasan instruksi. Contohnya meliputi:

- Penerjemahan mesin neural

- Sintesis kode multibahasa

- Ringkasan abstrak

- Penalaran aritmetika

Vision Banana mengajukan bahwa kita berada pada momen yang sama untuk visi. Makalah ini secara eksplisit menarik analogi antara pretraining pembuatan gambar dan pretraining model bahasa, serta antara instruction tuning dan langkah alignment.

Jika analoginya berlaku, kita akan berhenti membangun pipeline khusus tugas dan memperlakukan satu generator gambar besar sebagai lapisan fondasi, dengan menetapkan tugas melalui prompt.

Bagaimana Cara Kerja Vision Banana?

Mekanismenya sederhana: setiap tugas visi dibingkai ulang sebagai "hasilkan gambar RGB dengan properti berikut," dan saat decode, Anda mengubah gambar RGB itu kembali menjadi prediksi tugas secara deterministik.

Berikut cara pemetaan tiap tugas:

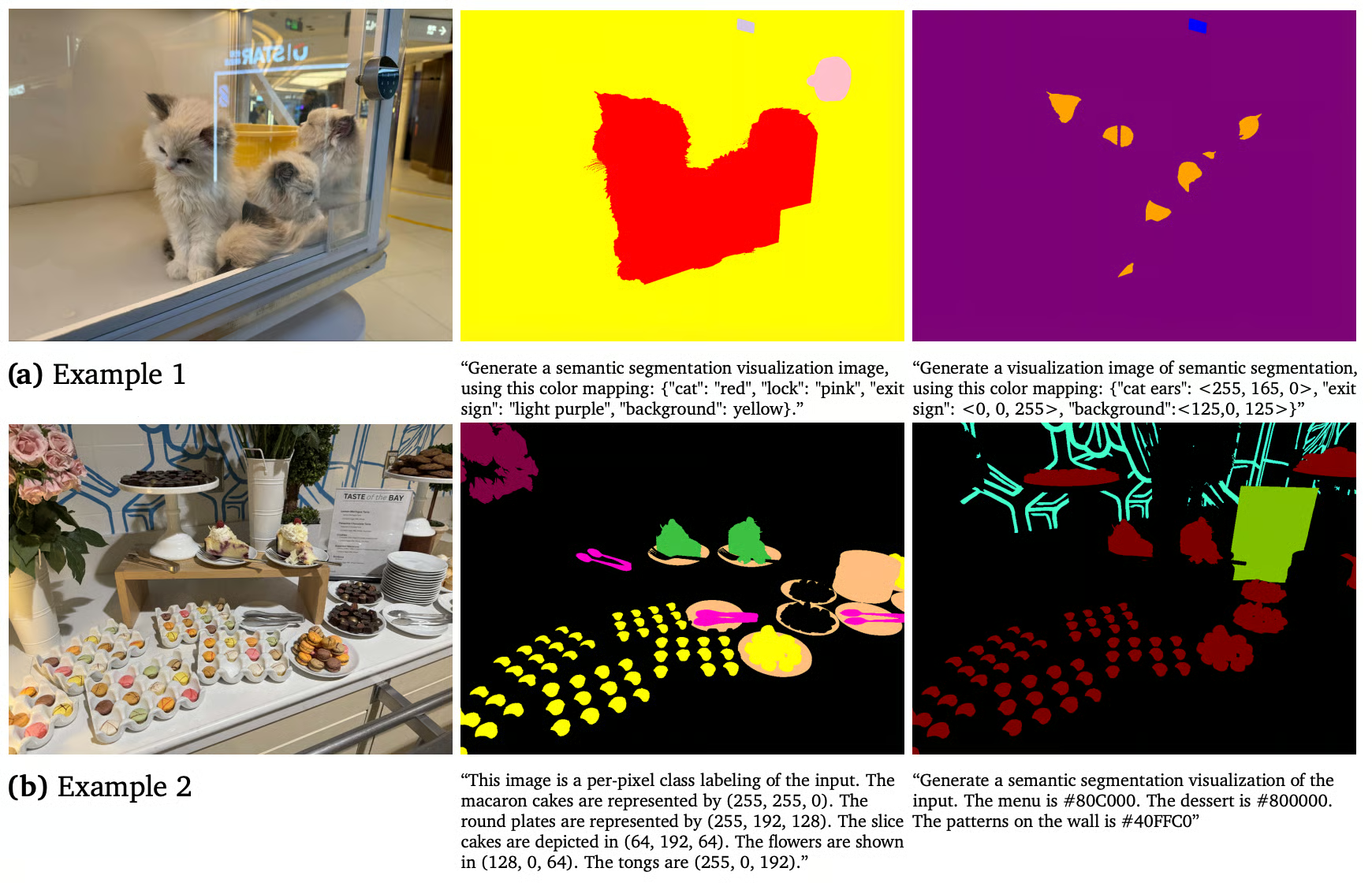

Segmentasi semantik

Berikan prompt ke model dengan penetapan warna per kelas, dan saat decode, klasterkan piksel ke warna terdekat yang ditentukan. Kosa kata adalah apa pun yang Anda masukkan di prompt; secara konstruksi ini bersifat open-vocabulary.

Ini akan lebih jelas saat kita melihat contoh. Berikut contoh prompt dari makalah:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Gambar 2: Segmentasi semantik(Sumber)

Segmentasi instance

Segmentasi instance lebih rumit daripada segmentasi semantik, karena jumlah instance tidak diketahui sebelumnya. Jadi, Anda tidak bisa menetapkan warna di awal.

Solusi Vision Banana adalah melakukan satu kelas per inferensi, membiarkan model menetapkan warna berbeda secara dinamis untuk instance berbeda, lalu mengklasterkan piksel ke modus warna saat decode.

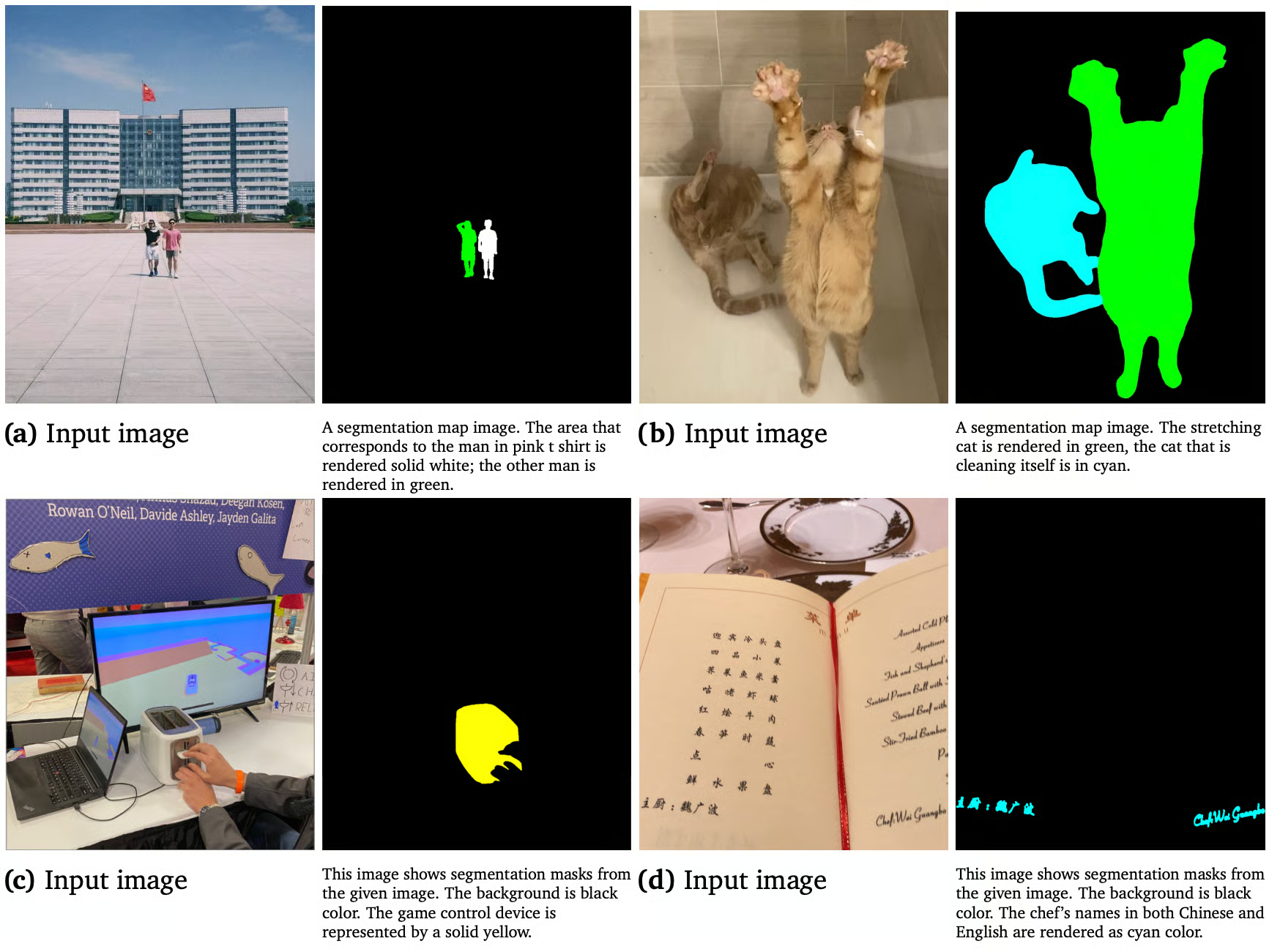

Segmentasi ekspresi

Vision Banana dapat menerima prompt dengan deskripsi bahasa alami tentang apa yang akan disegmentasi, dan mengembalikan mask. Berikut contoh prompt dari makalah:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Inilah titik di mana penalaran multimodal yang tertanam dalam pretraining generatif unggul. Model diskriminatif kesulitan dengan ekspresi referensial karena tugas ini membutuhkan penalaran linguistik dan visual secara bersama-sama. Model generatif yang dilatih pada miliaran pasangan keterangan-gambar menanganinya secara alami.

Gambar 3: Vision Banana dapat memahami prompt bahasa alami dan menalarinya (Sumber)

Kedalaman dan normal permukaan

Baik kedalaman maupun normal permukaan diproyeksikan ke ruang RGB melalui pemetaan bijektif, memastikan bahwa properti geometris laten dipertahankan tanpa kehilangan informasi selama transformasi. Kita akan membedah spesifik pengodean depth-ke-RGB pada bagian berikut.

Paradigma inferensi terpadu ini memperlakukan setiap tugas visi komputer sebagai masalah pembuatan gambar yang deterministik. Dengan mempertahankan antarmuka RGB yang konsisten di seluruh pipeline, model menghindari cabang arsitektur khusus tugas, sepenuhnya mengandalkan pengkondisian berbasis prompt untuk mendefinisikan semantik output.

Sekarang, mari pahami kedalaman sedikit lebih rinci. Di sinilah pendekatan ini paling mudah runtuh jika salah.

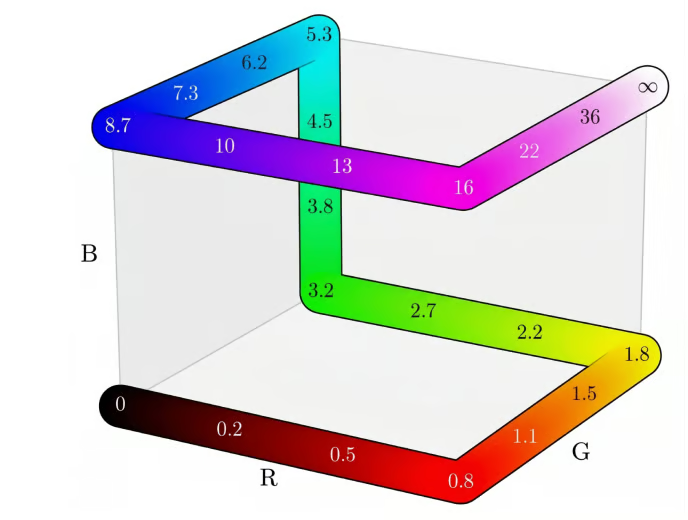

Mengodekan Kedalaman Tak Berbatas ke dalam RGB

Jika pengodeannya tidak bijektif, Anda tidak bisa memulihkan jarak metrik saat decode, dan seluruh klaim "pembuatan gambar sebagai antarmuka universal" ikut runtuh. Ini layak dipahami karena memberi tahu Anda apakah pendekatannya berprinsip atau sekadar akal-akalan.

Masalahnya di sini adalah nilai kedalaman berupa bilangan real tak berbatas pada [0, ∞), sedangkan RGB berbatas pada [0, 1]. Jadi, untuk menggunakan "hasilkan peta kedalaman" sebagai sinyal pelatihan, Anda memerlukan pemetaan bijektif di mana setiap kedalaman metrik memetakan tepat ke satu nilai RGB, dan saat decode, Anda bisa membaliknya kembali ke meter.

Pendekatan Vision Banana memiliki dua tahap:

Tahap 1: Kompresi kedalaman tak berbatas ke [0, 1)

Para penulis menggunakan transformasi pangkat Barron (2025) dengan parameter bentuk λ = -3, yang memberikan resolusi lebih untuk area jarak dekat daripada jarak jauh. Objek 2 meter mendapat presisi lebih tinggi daripada yang 200 meter. Ini selaras dengan kebutuhan sebagian besar aplikasi, yaitu objek yang dapat dijangkau, bukan yang jauh.

Tahap 2: Petakan [0, 1) ke tepi kubus RGB

Berikutnya, mereka melakukan interpolasi sepanjang jalur potongan-linear yang menelusuri tepi kubus RGB, pada dasarnya iterasi pertama dari kurva Hilbert 3D. Ini menghasilkan transisi warna yang mulus dan masuk akal secara perseptual tanpa ambiguitas warna mana yang berkaitan dengan kedalaman mana.

Karena kedua tahap tersebut ketat dapat dibalik, komposisinya adalah bijeksi. Lalu mereka melatih pada ground truth yang dikodekan RGB, dan saat inferensi, memproyeksikan RGB yang diprediksi ke tepi kubus terdekat dan membaliknya kembali ke meter.

Gambar 4: Visualisasi bijeksi antara jarak metrik skalar 𝑑 ≥ 0 dan nilai warna RGB (Sumber)

Untuk ketangguhan, pelatihan ditambah dengan colormap alternatif seperti Plasma, Inferno, Viridis, dan grayscale, sehingga model dapat menangani gaya visualisasi apa pun yang Anda minta di prompt.

Normal permukaan lebih mudah karena sudah berupa vektor satuan dengan komponen dalam [-1, 1], yang langsung dipetakan ke RGB dengan konvensi ruang kamera standar (+x ke kanan, +y ke atas, +z keluar dari bidang gambar). Jadi, hijau muda berarti menghadap ke atas, merah muda kemerahan berarti menghadap ke kiri, dan biru/persik muda berarti menghadap ke kamera. Tidak perlu distorsi.

Catatan: Vision Banana tidak menggunakan intrinsik kamera sama sekali, baik dalam pelatihan maupun inferensi. Sebagian besar metode depth SOTA (Depth Anything V3, MoGe-2, UniK3D, DepthLM) menggunakan intrinsik di suatu titik karena membantu mengurai skala monokular.

Vision Banana menyimpulkan skala absolut hanya dari prior visual, dan tetap unggul, adalah bukti terkuat dalam makalah bahwa pretraining generatif melakukan pekerjaan geometrik dan bukan sekadar mencocokkan pola visualisasi yang pernah dilihat saat pelatihan.

Model Spesialis vs Vision Banana: Perbandingan

Cara paling bersih untuk melihat apa yang benar-benar berbeda adalah membandingkan kedua paradigma secara langsung pada satu tugas. Mari bandingkan estimasi kedalaman dengan pendekatan spesialis (Marigold, Lotus, Depth Anything V3) dan Vision Banana.

Kedua paradigma menghasilkan artefak yang berbeda. Marigold adalah alat khusus, sementara Vision Banana adalah generalis yang keluasan kemampuannya datang dari satu langkah pelatihan.

Perbedaannya berimbas pada cara model digunakan dalam praktik:

|

Aspek |

Spesialis (gaya Marigold) |

Vision Banana |

|

Format keluaran |

Tensor khusus tugas |

Gambar RGB |

|

Kosa kata |

Tetap saat pelatihan |

Didefinisikan di prompt |

|

Multi-tugas |

Satu model per tugas |

Satu model, banyak tugas |

|

Intrinsik kamera |

Sering diperlukan |

Tidak digunakan |

|

Kapabilitas generasi |

Hilang saat finetuning |

Tetap terjaga |

|

Biaya inferensi |

Rendah |

Tinggi (generator gambar penuh) |

Benchmark menunjukkan kombinasi kemenangan jelas dan satu kekalahan jujur. Semua di bawah transfer zero-shot, yaitu model tidak pernah melihat split pelatihan benchmark evaluasi.

Profil kinerja unggul:

- Segmentasi semantik (Cityscapes): Mencapai mean Intersection over Union (mIoU) 0,699, melampaui Segment Anything Model (SAM 3) yang 0,652.

- Segmentasi referensial (RefCOCOg): Menunjukkan cIoU (cumulative IoU) 0,738, melampaui baseline SAM 3 Agent sebesar 0,734.

- Penalaran visual kompleks (ReasonSeg): Saat dimanfaatkan bersama Gemini 2.5 Pro, meraih gIoU 0,793, mengungguli SAM 3 Agent 0,770 dan menetapkan state-of-the-art zero-shot baru, bahkan dibandingkan metodologi fully supervised non-zero-shot.

- Estimasi kedalaman metrik: Mencatat rata-rata

δ(akurasi ambang) 0,929 di empat dataset beragam, lebih baik dari Depth Anything V3 yang 0,918. - Estimasi normal permukaan: Mencatat rata-rata mean angular error yang lebih rendah, 15,549° di tiga dataset indoor, menunjukkan fidelitas geometrik superior dibanding Lotus-2 (16,558°).

Defisit kinerja:

- Segmentasi instance (SA-Co/Gold): Kinerja 0,540 pmF1 (dievaluasi pada sampel 500 kueri dari SA-Co/Gold, bukan seluruh benchmark), tertinggal dari SAM 3 non-zero-shot (0,661) dan setara dengan DINO-X zero-shot (0,552). Hasil ini kemungkinan berasal dari kendala penetapan warna diskret untuk kardinalitas instance, yang membatasi resolusi pada adegan yang sangat padat.

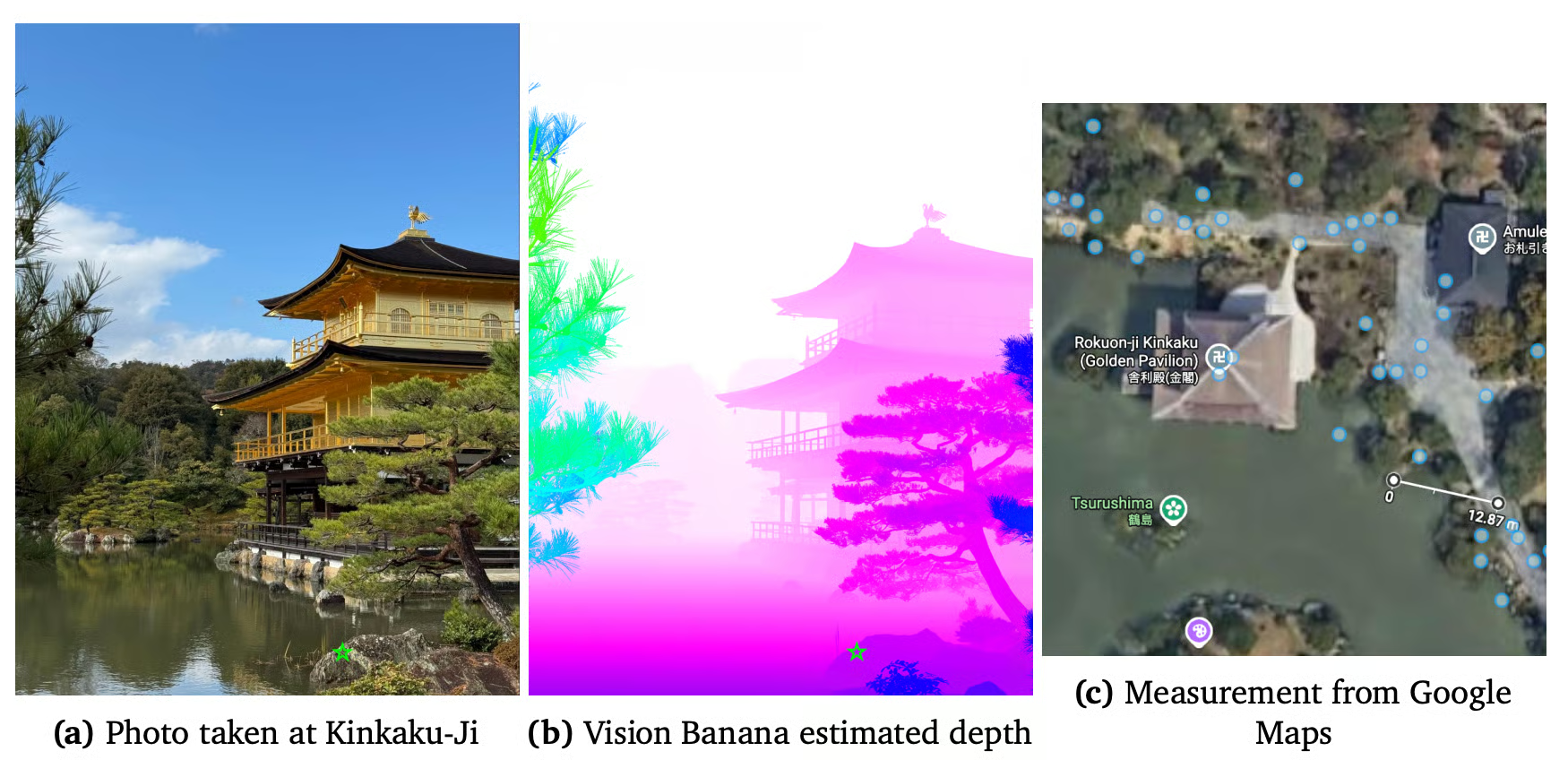

Pada GenAI-Bench, Vision Banana menang 53,5% dari perbandingan manusia melawan Nano Banana Pro dasar. Berikut contoh uji grounding di alam liar dari makalah:

Gambar 5: Estimasi kedalaman Vision Banana (Sumber)

Salah satu penulis mengambil foto ponsel di dekat Kinkaku-Ji. Vision Banana memprediksi satu titik pada 13,71 meter. Google Maps menunjukkan 12,87, yaitu 6,5% galat relatif absolut pada foto ponsel tanpa kalibrasi, tanpa intrinsik, tanpa penyiapan. Itulah jenis uji yang lebih andal memprediksi perilaku di deployment daripada angka benchmark.

Keterbatasan Vision Banana

Vision Banana memiliki empat kendala yang patut dicatat. Ini meliputi:

- Biaya: Menjalankan model skala Nano Banana Pro untuk setiap inferensi jauh lebih mahal daripada menjalankan spesialis kedalaman hasil distilasi. Makalah mengakui hal ini secara langsung di bagian Pekerjaan Masa Depan. Untuk 10 ribu frame video, pendekatan ini belum kompetitif secara ekonomi hari ini. Distilasi ke spesialis yang lebih kecil adalah langkah berikutnya yang jelas.

- Adegan padat instance: SA-Co/Gold adalah kekalahan yang jelas. Penetapan warna per kelas kehabisan ruang ketika banyak objek kecil harus dihitung secara presisi. SAM 3 masih unggul di sini.

- Gambar tunggal: Implementasi model saat ini secara fundamental dibatasi pada input gambar statis pandangan tunggal, tanpa kapasitas pemrosesan spatio-temporal atau multi-view. Penalaran temporal ditetapkan sebagai pekerjaan masa depan oleh para penulis.

- Deployment kotak hitam: Anda tidak bisa menyelidiki, memodifikasi, atau menjalankan model secara privat. Ini penting dalam konteks teratur atau sensitif terhadap IP di mana menjalankan API frontier bukan pilihan.

Pemikiran Akhir

Vision Banana adalah demonstrasi konkret bahwa generator gambar sudah melakukan pekerjaan berat untuk pemahaman visual, dan bahwa memunculkan kapabilitas tersebut memerlukan alignment alih-alih arsitektur baru.

Kontribusi spesifik makalah ini adalah

- Pengodean RGB bijektif yang membuat kedalaman dan segmentasi menjadi masalah pembuatan gambar yang dapat dibalik

- Resep instruction-tuning ringan yang menambahkan kemampuan visi tanpa membakar prior generasi

- Estimasi kedalaman metrik tanpa intrinsik kamera yang mengungguli para spesialis yang membutuhkannya

- Protokol transfer zero-shot yang ketat yang membuat klaim generalis dapat diukur pada benchmark standar.

Makalah ini juga mendorong model mental berbasis generasi, di mana tugas ditetapkan oleh prompt dan keluaran didekode kembali dari gambar RGB, serta bobot yang sama menangani baik pembuatan maupun penguraian konten visual.

Anda dapat menguji prompt di laman proyek terhadap Nano Banana Pro dasar atau Nano Banana 2 untuk melihat apa yang sudah dapat diakses tanpa instruction tuning, membangun fitur reasoning-segmentation dengan model kelas NBP dan router LLM multimodal alih-alih langsung melatih pipeline khusus.

Vision Banana FAQs

Bagaimana saya dapat menggunakan Vision Banana hari ini?

Belum. Makalah dan laman proyek sudah tersedia, tetapi bobot model ada di Google DeepMind. Model dasar, Nano Banana Pro, tersedia di Gemini API dan AI Studio, dan tesis makalah itu sendiri menyarankan bahwa mem-prompt NBP langsung dengan prompt dari laman proyek seharusnya sudah menghasilkan hasil yang bermakna.

Bisakah Vision Banana menggantikan SAM 3 atau Depth Anything?

Belum saat ini, terutama karena biaya. Untuk aplikasi yang perlu menjalankan inferensi visi secara murah dan skala besar (video, real-time, seluler), spesialis masih unggul secara ekonomi.

Bagaimana perbandingannya dengan MLLM seperti GPT-5V atau Gemini 2.5?

LLM multimodal menerima gambar dan menghasilkan teks. Vision Banana menerima gambar dan prompt untuk menghasilkan gambar. Mereka menyelesaikan masalah yang berbeda.

Mengapa Vision Banana tidak menggunakan intrinsik kamera untuk kedalaman?

Kebanyakan spesialis menggunakan intrinsik untuk mengurai skala monokular (objek kecil dari dekat dan objek besar dari jauh dapat menghasilkan piksel yang identik). Namun, Vision Banana menyimpulkan skala dari prior visual yang dipelajari selama pretraining generatif tentang ukuran objek, konteks adegan, dan pengetahuan dunia.

Saya adalah Google Developers Expert di ML (Gen AI), Kaggle 3x Expert, dan Women Techmakers Ambassador dengan pengalaman lebih dari 3 tahun di bidang teknologi. Saya ikut mendirikan startup health-tech pada 2020 dan sedang menempuh studi magister ilmu komputer di Georgia Tech dengan spesialisasi machine learning.