tracks

컴퓨터 비전은 전통적으로 이미지를 생성하는 모델과 이미지를 이해하는 모델을 명확히 구분해 왔습니다. 생성 모델은 합성을, 판별 아키텍처는 분류, 분할, 깊이 회귀에 집중했습니다. 새로운 비전 과제를 풀 때의 표준 절차는 아키텍처를 고르고, 과제 전용 헤드를 붙인 다음, 라벨이 있는 데이터로 파인튜닝하는 것이었습니다.

그 전제를 깨려는 것이 Google DeepMind의 Vision Banana입니다. 이 논문은 이미지 생성기가 이미 범용 비전 모델에 필요한 모든 것을 학습했다고 주장합니다. 예를 들어 분할, 깊이, 표면 노멀 등입니다. 저자들의 관점에서 부족한 것은, 잠재된 역량을 벤치마크에서 측정 가능하게 만드는 얇은 지시 튜닝 레이어뿐입니다.

이 글에서는 먼저 Vision Banana가 무엇인지, 왜 이 논문이 주목받는지부터 살펴보고, 모델이 어떻게 작동하는지 설명합니다. 마지막에는 무엇이 잘 되고 무엇이 잘 안 되는지, 실무자는 무엇을 가져가야 하는지로 마무리하겠습니다. 읽으면서 생겼던 질문들도 중간중간 짚어 보겠습니다. 다른 독자들도 비슷한 의문을 가질 가능성이 큽니다.

참고: Vision Banana 자체는 공개되어 있지 않습니다. 공개된 것은 논문과 프로젝트 페이지입니다. 베이스 모델은 Nano Banana Pro를 기반으로 하며 Gemini API와 Google AI Studio에서 사용할 수 있습니다.

Vision Banana란 무엇인가?

Vision Banana는 Google DeepMind의 연구 모델로, Nano Banana Pro(텍스트-투-이미지 생성기)를 가져와 원래 학습 데이터와 소량의 컴퓨터 비전 과제 데이터를 혼합해 경량의 지시 튜닝을 적용해 구축했습니다.

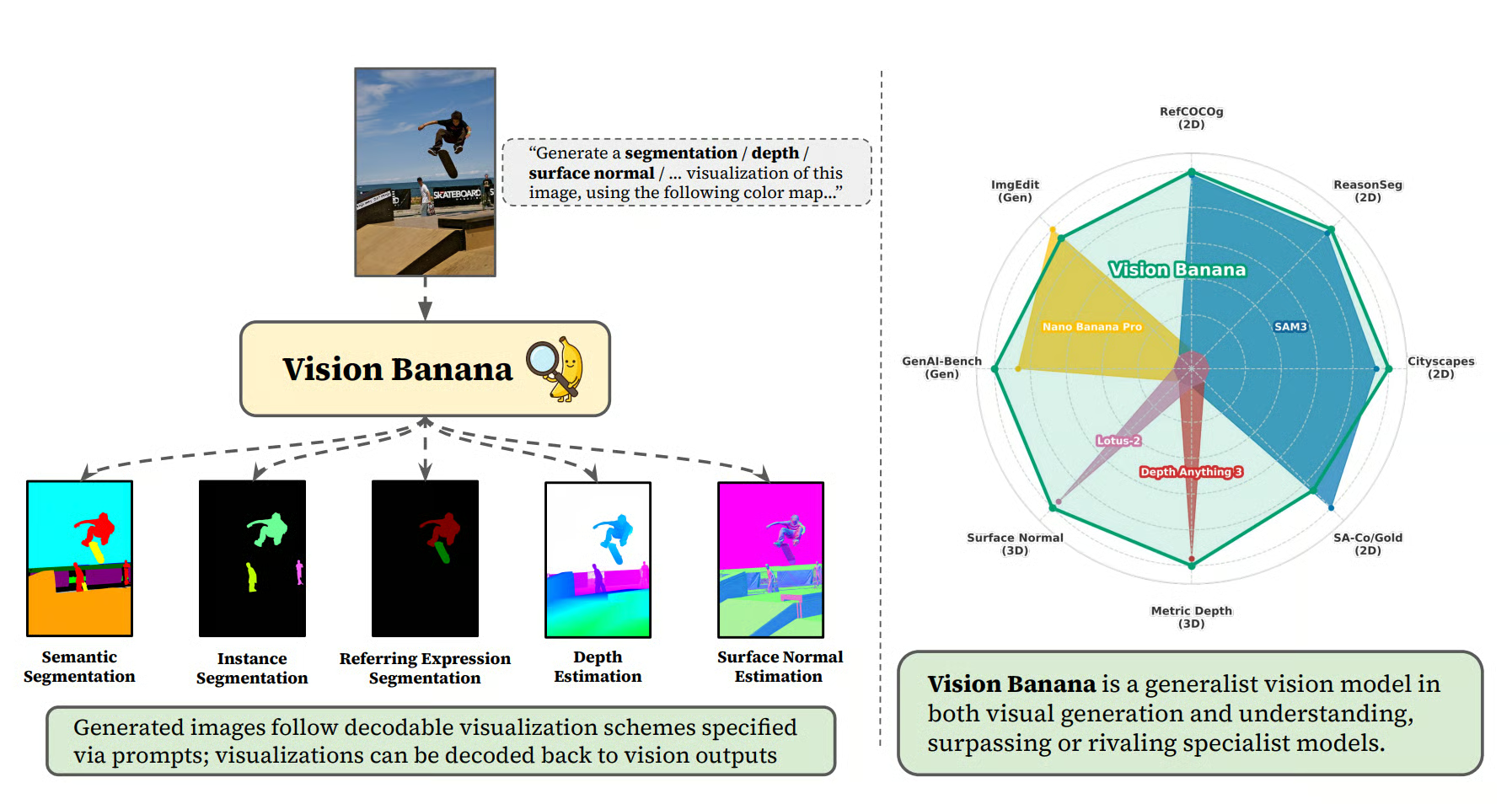

그림 1: Nano Banana Pro에 지시 튜닝을 적용해 드러난 이미지 생성기의 잠재적 시각 이해 역량(출처)

레시피는 다음과 같습니다.

- 베이스 모델 아키텍처는 변경하지 않기

- 학습 분포에 분할, 깊이, 표면 노멀 데이터를 낮은 비율로 혼합하기

- 지시 튜닝 적용하기

전체 학습 방법론은 새로운 아키텍처, 커스텀 헤드, 보조 손실, 특수 디코더를 전혀 필요로 하지 않습니다.

그 결과 모델은 다음을 달성합니다.

- 세 가지 분할 벤치마크에서 SAM 3를 능가

- 측정 깊이 추정에서 Depth Anything V3를 능가

- 표면 노멀 추정에서 Lotus-2를 능가

- 베이스 모델의 이미지 생성 품질 유지(GenAI-Bench와 ImgEdit에서 통계적으로 동률)

모든 평가는 엄격한 제로샷 전이 프로토콜하에 이루어졌으며, 모델이 평가된 벤치마크의 학습 분할을 본 적이 없음을 보장합니다.

왜 중요한가?

비전 표현 학습은 수년간 다양한 사전학습 목적을 시도해 왔습니다. 대표적인 것들은 다음과 같습니다.

중요한 점은 이들 어느 것도 생성적이지 않았다는 것입니다. 이미지 생성은 역사적으로 이해를 위한 토대가 아니라 다운스트림 역량으로 취급되어 왔습니다. 초기 생성 사전학습 시도(iGPT, LVM)는 표현 품질 벤치마크에서 대조 기반 방법보다 지속적으로 뒤처졌습니다.

다음 토큰 예측을 통한 생성적 자회귀 목적의 스케일링은 GPT-3 같은 모델에서 제로샷 범용 역량의 등장을 촉발했습니다. 복잡한 다운스트림 행동이 고차원 가중치 공간에 잠재된 채로 존재하다가, 경량의 지도 파인튜닝과 지시 정렬을 통해 드러났습니다. 예시는 다음과 같습니다.

- 신경기계번역

- 다국어 코드 합성

- 추상적 요약

- 산술적 추론

Vision Banana는 비전 분야가 지금 같은 전환점에 와 있다고 주장합니다. 논문은 이미지 생성 사전학습과 언어 모델 사전학습, 그리고 지시 튜닝과 정렬 단계를 명시적으로 비유합니다.

이 비유가 성립한다면, 과제별 파이프라인 구축을 멈추고 하나의 대형 이미지 생성기를 토대 계층으로 삼아 프롬프트로 과제를 지정하게 될 것입니다.

Vision Banana는 어떻게 작동하나?

메커니즘은 단순합니다. 모든 비전 과제를 "이러한 속성을 가진 RGB 이미지를 생성하라"로 재구성하고, 디코딩 시점에 그 RGB 이미지를 결정론적으로 과제 예측으로 되돌립니다.

각 과제가 다음과 같이 매핑됩니다.

의미론적 분할

클래스별 색상 할당을 프롬프트로 제공하고, 디코딩 시점에 픽셀을 가장 가까운 지정 색상으로 클러스터링합니다. 어휘는 프롬프트에 넣는 대로 정의되며, 설계상 오픈 보캐뷸러리입니다.

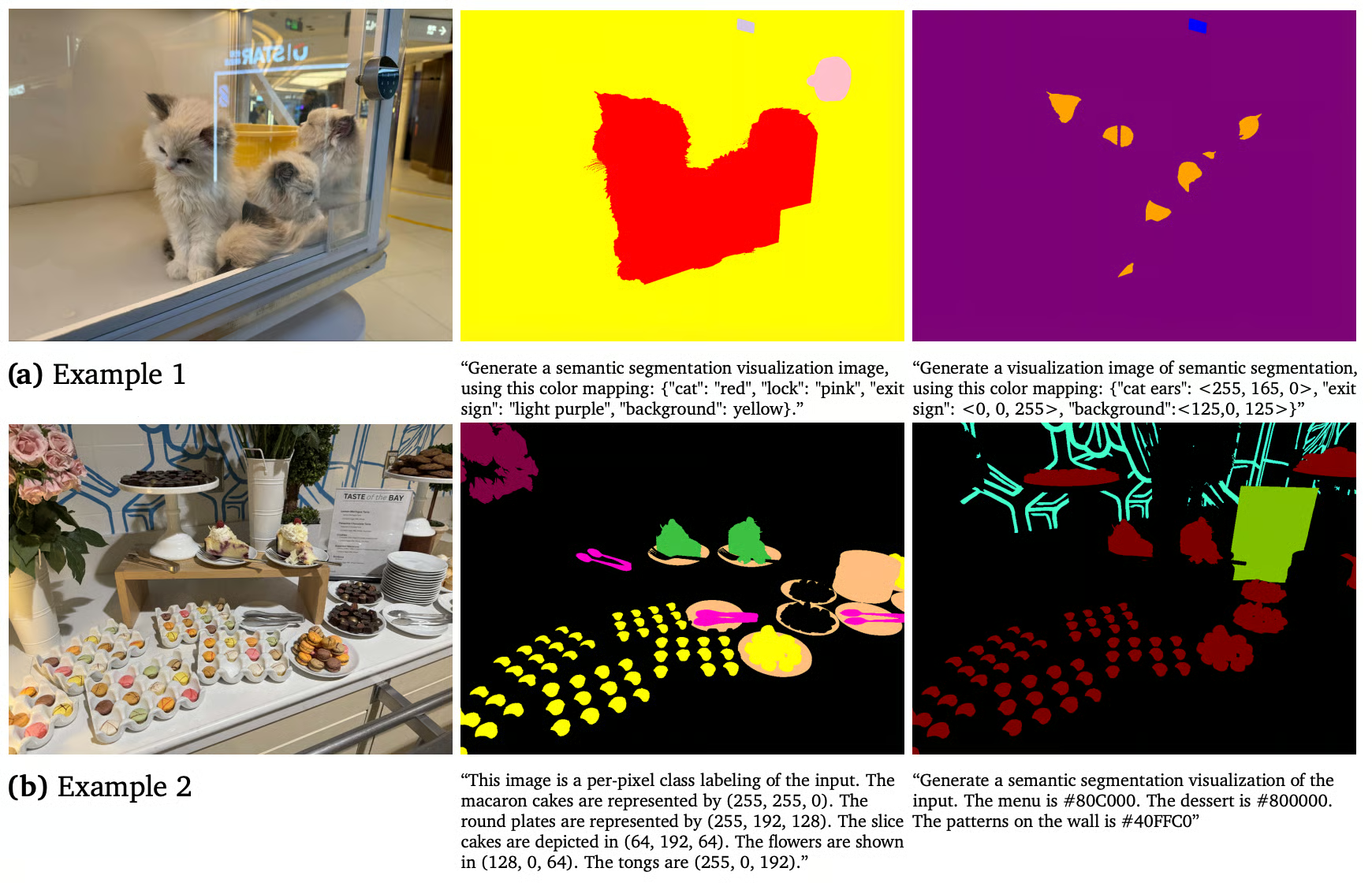

예시를 보면 더 명확해집니다. 논문에 나온 프롬프트는 다음과 같습니다.

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

그림 2: 의미론적 분할(출처)

인스턴스 분할

인스턴스 분할은 의미론적 분할보다 어렵습니다. 인스턴스의 개수를 사전에 알 수 없기 때문에 색상을 미리 할당할 수 없습니다.

Vision Banana의 해법은 클래스를 하나씩 추론하고, 모델이 서로 다른 인스턴스에 서로 다른 색을 동적으로 할당하도록 한 뒤, 디코딩 시점에 색 모드로 픽셀을 클러스터링하는 것입니다.

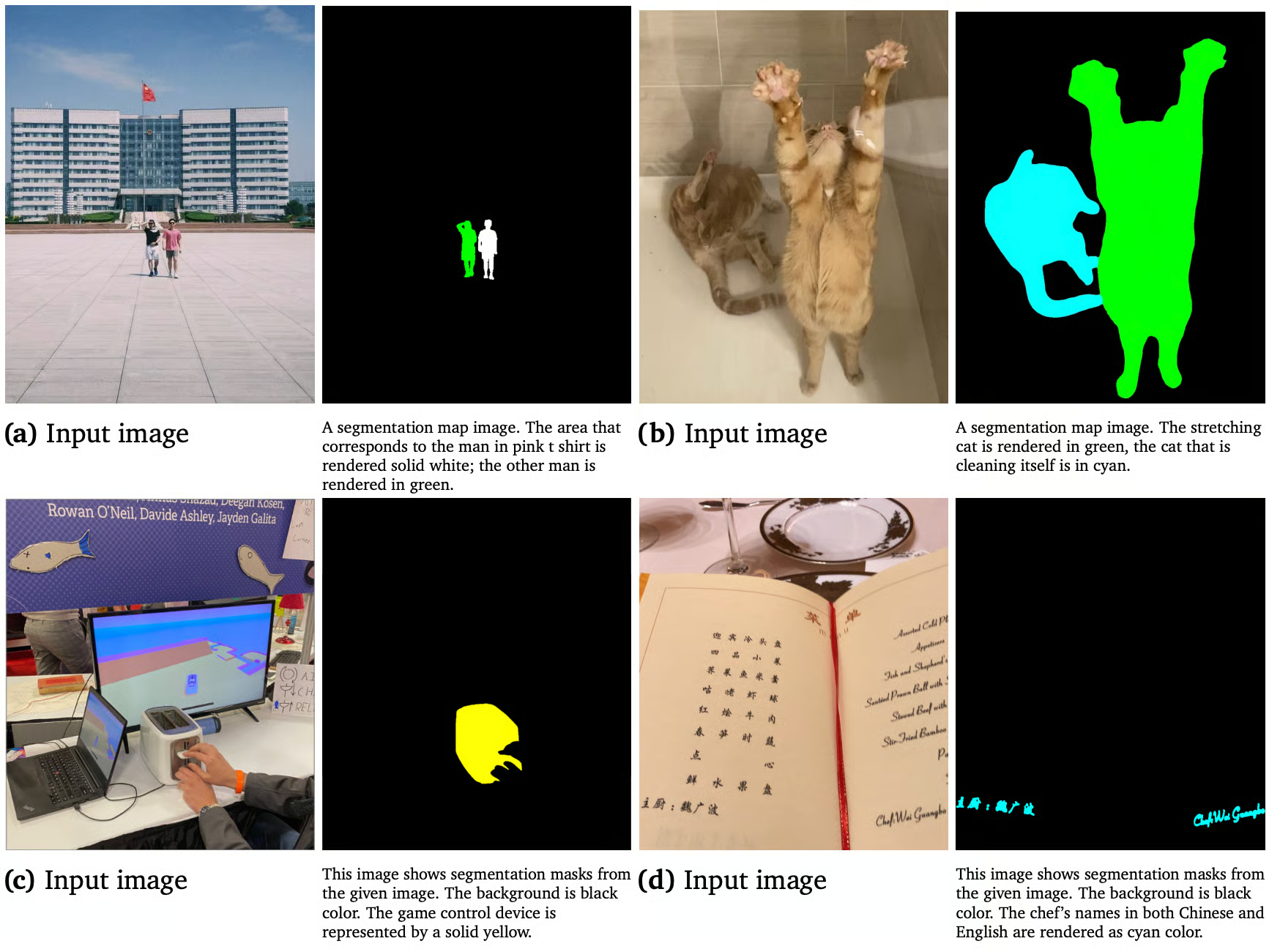

표현 분할

Vision Banana는 분할 대상에 대한 자연어 설명이 담긴 프롬프트를 받아 마스크를 반환할 수 있습니다. 논문에 나온 예시 프롬프트는 다음과 같습니다.

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.이는 생성 사전학습에 내장된 멀티모달 추론이 빛을 발하는 영역입니다. 판별 모델은 지시 표현(referring expression)에 취약한데, 언어적·시각적 추론을 공동으로 요구하기 때문입니다. 수십억 개의 캡션-이미지 쌍으로 학습한 생성 모델은 이를 자연스럽게 처리합니다.

그림 3: Vision Banana는 자연어 프롬프트를 이해하고 이에 대해 추론할 수 있습니다(출처)

깊이와 표면 노멀

깊이와 표면 노멀은 전단사(bijective) 매핑을 통해 RGB 공간으로 투영되며, 변환 과정에서 잠재 기하 정보가 손실 없이 보존됩니다. 다음 섹션에서 깊이→RGB 인코딩의 구체를 살펴보겠습니다.

이 통합 추론 패러다임은 모든 컴퓨터 비전 과제를 결정론적 이미지 생성 문제로 다룹니다. 파이프라인 전반에 걸쳐 일관된 RGB 인터페이스를 유지함으로써, 모델은 과제별 아키텍처 분기를 피하고 출력 의미를 정의하는 데 오로지 프롬프트 기반 컨디셔닝에 의존합니다.

이제 깊이를 좀 더 자세히 이해해 보겠습니다. 이 접근법이 가장 쉽게 무너질 수 있는 지점이기도 합니다.

무한 범위 깊이를 RGB로 인코딩하기

인코딩이 전단사가 아니라면 디코딩 시점에 계량적 거리를 복원할 수 없고, "범용 인터페이스로서의 이미지 생성"이라는 주장 전체가 무너집니다. 이 부분을 이해할 가치가 있는 이유는, 접근이 원칙적인지 임시방편인지 가늠할 수 있기 때문입니다.

문제는 깊이 값이 [0, ∞)의 무한 구간의 실수인 반면, RGB는 [0, 1]로 유한하다는 점입니다. 따라서 "깊이 맵을 생성하라"를 학습 신호로 쓰려면, 모든 계량적 깊이가 정확히 하나의 RGB 값으로 대응되고, 디코딩 시점에 이를 미터 단위로 역변환할 수 있는 전단사 매핑이 필요합니다.

Vision Banana의 접근은 두 단계로 이뤄집니다.

1단계: 무한 범위 깊이를 [0, 1)로 압축

저자들은 Barron(2025)의 멱 변환을 사용하며, 형상 파라미터 λ = -3으로 근거리 영역에 원거리보다 더 높은 해상도를 부여합니다. 2m 거리에 있는 물체가 200m에 있는 물체보다 더 높은 정밀도를 갖습니다. 이는 대부분의 응용이 관심을 갖는 것, 즉 멀리 있는 대상이 아니라 손이 닿는 물체에 부합합니다.

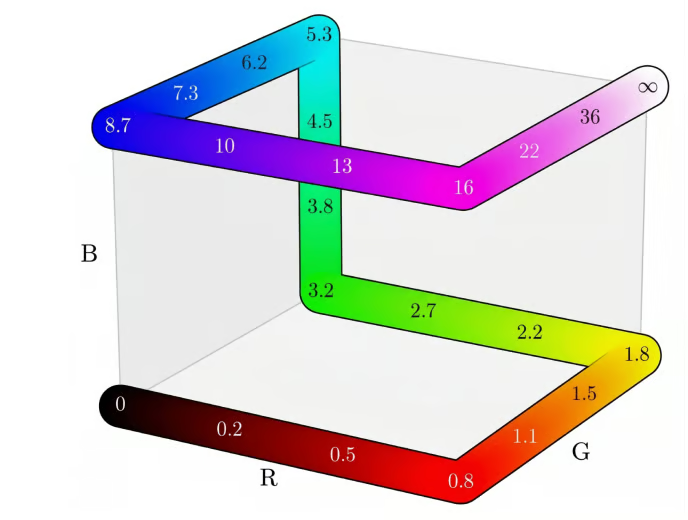

2단계: [0, 1)를 RGB 큐브의 모서리로 매핑

다음으로 RGB 큐브의 모서리를 따라가는 구간별 선형 경로를 보간합니다. 이는 사실상 3D 힐베르트 곡선의 1차 반복에 해당합니다. 그 결과 부드럽고 지각적으로 자연스러운 색 전이가 생성되며, 어떤 색이 어떤 깊이에 대응하는지 모호하지 않습니다.

두 단계 모두가 엄밀히 가역적이므로 합성 역시 전단사입니다. 이렇게 RGB로 인코딩된 정답으로 학습하고, 추론 시에는 예측된 RGB를 가장 가까운 큐브 모서리에 사영한 뒤 미터 단위로 역변환합니다.

그림 4: 스칼라 계량 거리 𝑑 ≥ 0와 RGB 색 값 사이의 전단사 시각화(출처)

견고성을 위해 Plasma, Inferno, Viridis, 그레이스케일 같은 대체 컬러맵으로 학습을 증강하여, 프롬프트에서 어떤 시각화 스타일을 요구하더라도 모델이 대응할 수 있게 했습니다.

표면 노멀은 이미 [-1, 1] 범위의 단위 벡터이므로, 표준 카메라 좌표계(+x 오른쪽, +y 위, +z 카메라 밖 방향) 관례에 따라 RGB로 직접 매핑할 수 있어 더 간단합니다. 연두색은 위를 향함, 붉은기 도는 분홍은 왼쪽, 옅은 파랑/보라는 카메라를 향함을 의미합니다. 왜곡은 필요 없습니다.

주의: Vision Banana는 카메라 내파라미터를 학습이나 추론 어디에서도 사용하지 않습니다. 대부분의 SOTA 깊이 기법(Depth Anything V3, MoGe-2, UniK3D, DepthLM)은 단안 스케일의 모호성을 줄이기 위해 루프 어딘가에서 내파라미터를 사용합니다.

Vision Banana가 시각적 사전지식만으로 절대 스케일을 추론하면서도 우수한 성능을 보인다는 점은, 생성 사전학습이 단지 학습 중 본 시각화 패턴을 흉내내는 것이 아니라 실제로 기하 정보를 학습하고 있음을 보여주는 가장 강력한 증거입니다.

전문가 모델과 Vision Banana: 비교

무엇이 다른지 가장 깔끔하게 보려면 하나의 과제에서 두 패러다임을 직접 비교하면 됩니다. 여기서는 깊이 추정을 전문가 접근(Marigold, Lotus, Depth Anything V3)과 Vision Banana로 비교해 보겠습니다.

두 패러다임은 서로 다른 산출물을 냅니다. Marigold는 전문 도구이고, Vision Banana는 하나의 학습 단계로 폭넓은 능력을 갖춘 범용 모델입니다.

이 차이는 실제 사용 방식에도 영향을 미칩니다.

|

측면 |

전문가(Marigold 스타일) |

Vision Banana |

|

출력 형식 |

과제 전용 텐서 |

RGB 이미지 |

|

어휘 |

학습 시 고정 |

프롬프트로 정의 |

|

멀티태스크 |

과제별로 모델 하나 |

하나의 모델로 여러 과제 |

|

카메라 내파라미터 |

자주 필요 |

미사용 |

|

생성 능력 |

파인튜닝 과정에서 소실 |

보존 |

|

추론 비용 |

낮음 |

높음(전체 이미지 생성기) |

벤치마크는 분명한 승리와 솔직한 패배가 섞여 있습니다. 모두 제로샷 전이 하에서, 즉 모델이 평가 벤치마크의 학습 분할을 본 적이 없는 상태에서의 결과입니다.

우수한 성능 프로필:

- 의미론적 분할(Cityscapes): 평균 IoU(mIoU) 0.699를 달성해, 특화된 Segment Anything Model(SAM 3)의 0.652를 상회.

- 지시 분할(RefCOCOg): 누적 IoU(cIoU) 0.738을 기록해, SAM 3 Agent 기준선 0.734를 초과.

- 복합 시각 추론(ReasonSeg): Gemini 2.5 Pro와 공동으로 활용 시 gIoU 0.793을 달성, SAM 3 Agent의 0.770을 능가하고 제로샷 기준 새로운 SOTA를 수립(비제로샷 완전 지도 방식 대비에서도 우위).

- 계량 깊이 추정: 네 가지 서로 다른 데이터셋에서 평균

δ(threshold accuracy) 0.929를 기록, Depth Anything V3의 0.918을 상회. - 표면 노멀 추정: 세 개의 실내 데이터셋에서 평균 평균 각도 오차 15.549°로 더 낮은 값을 기록, Lotus-2(16.558°) 대비 더 높은 기하 충실도를 보여줌.

성능 열세:

- 인스턴스 분할(SA-Co/Gold): SA-Co/Gold 500개 쿼리 샘플(전체 벤치마크 아님)에서 pmF1 0.540으로 평가되어, 비제로샷인 SAM 3(0.661)에는 뒤지고 제로샷 DINO-X(0.552)와 비슷한 수준. 이는 인스턴스 개수를 색상 이산화로 표현해야 하는 제약 탓에, 매우 밀집된 장면에서는 해상도가 제한되는 점에서 비롯된 결과로 보입니다.

GenAI-Bench에서 Vision Banana는 베이스 Nano Banana Pro 대비 사람 평가의 53.5%에서 승리했습니다. 아래는 논문에 나온 실제 환경에서의 그라운딩 테스트 예시입니다.

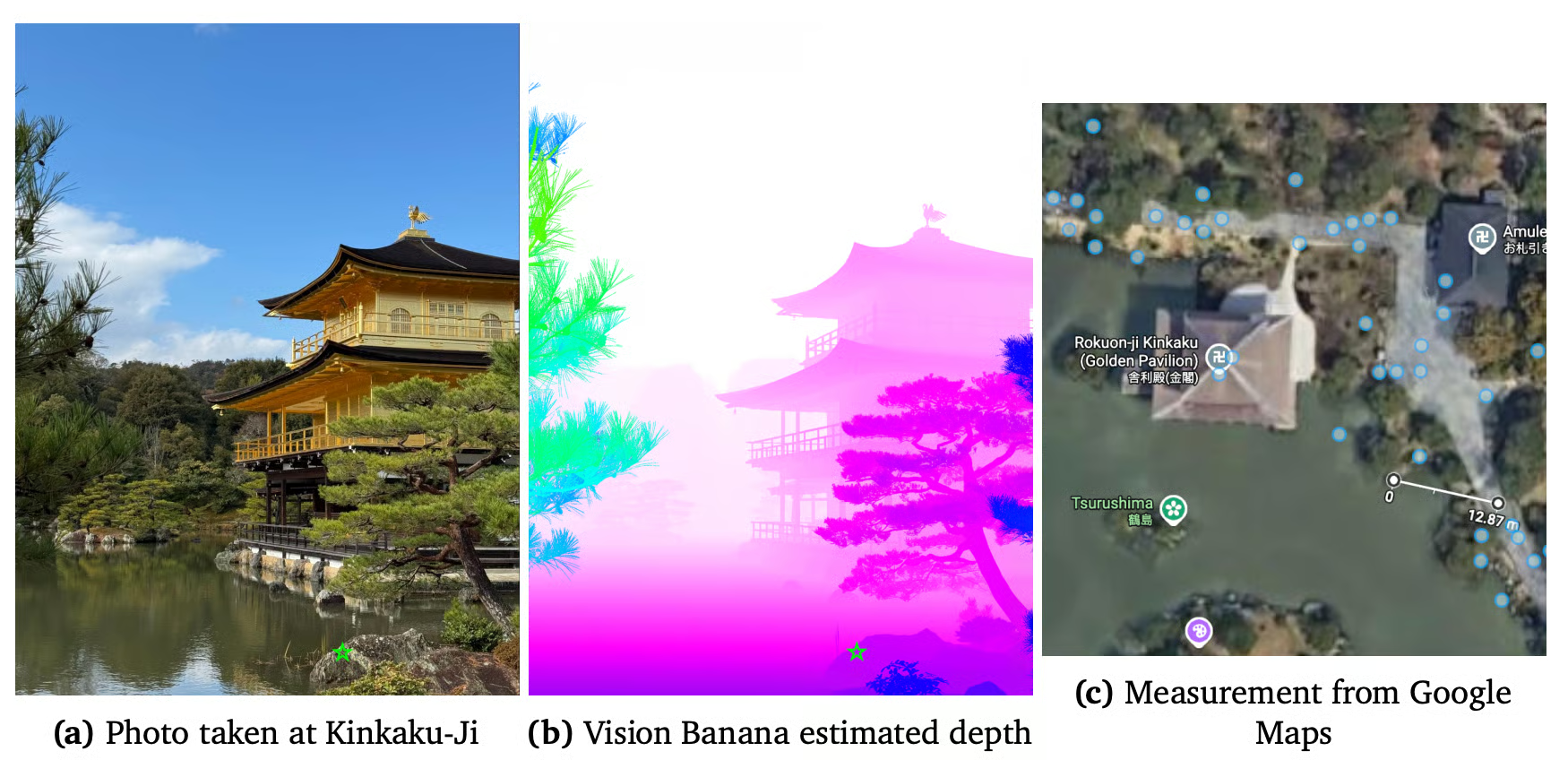

그림 5: Vision Banana 깊이 추정(출처)

저자 중 한 명이 금각사 근처에서 스마트폰으로 사진을 찍었습니다. Vision Banana는 특정 지점을 13.71m로 예측했습니다. Google 지도는 12.87m로, 보정도 내파라미터도 장비 세팅도 없는 휴대폰 사진에서 절대 상대 오차 6.5%입니다. 이런 테스트는 벤치마크 수치보다 실제 배포 시 동작을 더 잘 예측해 줍니다.

Vision Banana의 한계

Vision Banana에는 유의해야 할 제약이 네 가지 있습니다. 다음과 같습니다.

- 비용: 매 추론마다 Nano Banana Pro 규모의 모델을 돌리는 것은 증류된 깊이 특화 모델을 돌리는 것보다 훨씬 비쌉니다. 논문도 이를 미래 과제에서 직접 인정합니다. 1만 개의 비디오 프레임에 대해 오늘 시점에서는 경제성이 떨어집니다. 더 작은 전문가 모델로의 증류가 분명한 다음 단계입니다.

- 인스턴스가 많은 장면: SA-Co/Gold는 분명한 패배입니다. 클래스별 색상 할당은 수많은 작은 객체를 정확히 세어야 할 때 한계에 부딪힙니다. 이 영역에서는 여전히 SAM 3가 우세합니다.

- 단일 이미지: 현재 모델 구현은 본질적으로 정적 단일 뷰 입력에 한정되어, 시공간적 또는 다중 뷰 처리가 불가능합니다. 시간적 추론은 저자들이 향후 과제로 지정했습니다.

- 블랙박스 배포: 모델을 탐침하거나 수정하거나 사설로 실행할 수 없습니다. 최전선 API를 사용할 수 없는 규제·IP 민감 환경에서는 이 점이 중요합니다.

마무리

Vision Banana는 이미지 생성기가 이미 시각 이해를 위해 무거운 짐을 지고 있으며, 그 역량을 표면으로 끌어올리는 데는 새로운 아키텍처가 아니라 정렬이 필요함을 구체적으로 보여줍니다.

논문의 구체적 기여는 다음과 같습니다.

- 깊이와 분할을 가역적 이미지 생성 문제로 만드는 전단사 RGB 인코딩

- 생성 프라이어를 훼손하지 않고 비전 기술을 더하는 경량 지시 튜닝 레시피

- 내파라미터 없이 계량 깊이를 추정해, 이를 요구하는 전문가 모델을 능가

- 표준 벤치마크에서 범용 모델 주장을 측정 가능하게 하는 엄격한 제로샷 전이 프로토콜

또한 프롬프트로 과제를 지정하고 출력을 RGB 이미지에서 역디코딩하는 생성 중심 사고방식을 제시하며, 동일한 가중치로 시각 콘텐츠의 생성과 해석을 모두 다루는 그림을 그립니다.

프로젝트 페이지의 프롬프트를 베이스 Nano Banana Pro나 Nano Banana 2에 그대로 적용해, 지시 튜닝 없이도 어느 정도 가능한 수준을 확인해 보세요. 커스텀 파이프라인을 직접 학습하기보다 NBP급 모델과 멀티모달 LLM 라우터로 추론-분할 기능을 구축하는 것도 방법입니다.

Vision Banana FAQ

오늘 당장 Vision Banana를 어떻게 사용할 수 있나요?

아니요. 논문과 프로젝트 페이지는 공개되었지만, 모델 가중치는 Google DeepMind에 있습니다. 베이스 모델인 Nano Banana Pro는 Gemini API와 AI Studio에서 사용할 수 있으며, 논문의 주장대로 프로젝트 페이지의 프롬프트를 NBP에 직접 입력해도 이미 유의미한 결과를 얻을 수 있습니다.

Vision Banana가 SAM 3나 Depth Anything을 대체할 수 있나요?

오늘 시점에서는 어렵습니다. 주된 이유는 비용입니다. 비디오, 실시간, 모바일처럼 대규모로 저렴하게 비전 추론을 실행해야 하는 응용에서는, 경제성 면에서 여전히 전문가 모델이 유리합니다.

GPT-5V나 Gemini 2.5 같은 MLLM과는 어떻게 다른가요?

멀티모달 LLM은 이미지를 입력으로 받아 텍스트를 출력합니다. Vision Banana는 이미지와 프롬프트를 입력으로 받아 이미지를 출력합니다. 서로 다른 문제를 풀고 있습니다.

깊이 추정에 카메라 내파라미터를 사용하지 않는 이유는 무엇인가요?

대부분의 전문가 모델은 단안 스케일의 모호성(가까운 작은 물체와 먼 큰 물체가 동일한 픽셀을 만들 수 있음)을 줄이기 위해 내파라미터를 사용합니다. 반면 Vision Banana는 생성 사전학습을 통해 학습한 객체 크기, 장면 맥락, 세계 지식 등 시각적 사전지식으로 스케일을 추론합니다.