Tracks

Thị giác máy tính từ trước đến nay luôn tách bạch giữa các mô hình tạo ảnh và mô hình hiểu ảnh. Các khung sinh (generative) là nguồn chính cho tổng hợp, trong khi các kiến trúc phân biệt (discriminative) tập trung vào phân loại, phân đoạn hoặc hồi quy độ sâu. Cách làm chuẩn cho bất kỳ tác vụ thị giác mới nào là chọn một kiến trúc, gắn phần đầu (head) chuyên biệt cho tác vụ và tinh chỉnh trên dữ liệu gán nhãn.

Giả định đó chính là điều mà Vision Banana của Google DeepMind muốn phá vỡ. Bài báo lập luận rằng các bộ sinh ảnh đã học được mọi thứ mà một mô hình thị giác đa năng cần, bao gồm phân đoạn, độ sâu, pháp tuyến bề mặt và hơn thế nữa. Theo các tác giả, điều còn thiếu chỉ là một lớp tinh chỉnh theo hướng dẫn mỏng để biến những năng lực tiềm ẩn đó thành kết quả đo lường được trên các bộ chuẩn.

Trong bài viết này, tôi sẽ bắt đầu với việc Vision Banana thực chất là gì và vì sao bài báo thu hút sự chú ý của giới chuyên môn, sau đó đi qua cách mô hình vận hành. Tôi sẽ kết lại bằng những gì hiệu quả, những gì chưa và điều mà người làm thực tế nên rút ra. Trong quá trình đó, tôi sẽ nêu ra các câu hỏi tôi có khi đọc bài báo. Nhiều độc giả khác có lẽ cũng có các câu hỏi tương tự.

Lưu ý: Bản thân Vision Banana chưa được công bố rộng rãi. Hiện có bài báo và trang dự án. Mô hình nền tảng được xây trên Nano Banana Pro và có sẵn qua Gemini API và Google AI Studio.

Vision Banana là gì?

Vision Banana là một mô hình nghiên cứu từ Google DeepMind, được xây dựng bằng cách lấy Nano Banana Pro (bộ sinh văn bản-thành-ảnh) và áp dụng tinh chỉnh theo hướng dẫn gọn nhẹ trên hỗn hợp dữ liệu huấn luyện gốc của nó cùng một lượng nhỏ dữ liệu tác vụ thị giác máy tính.

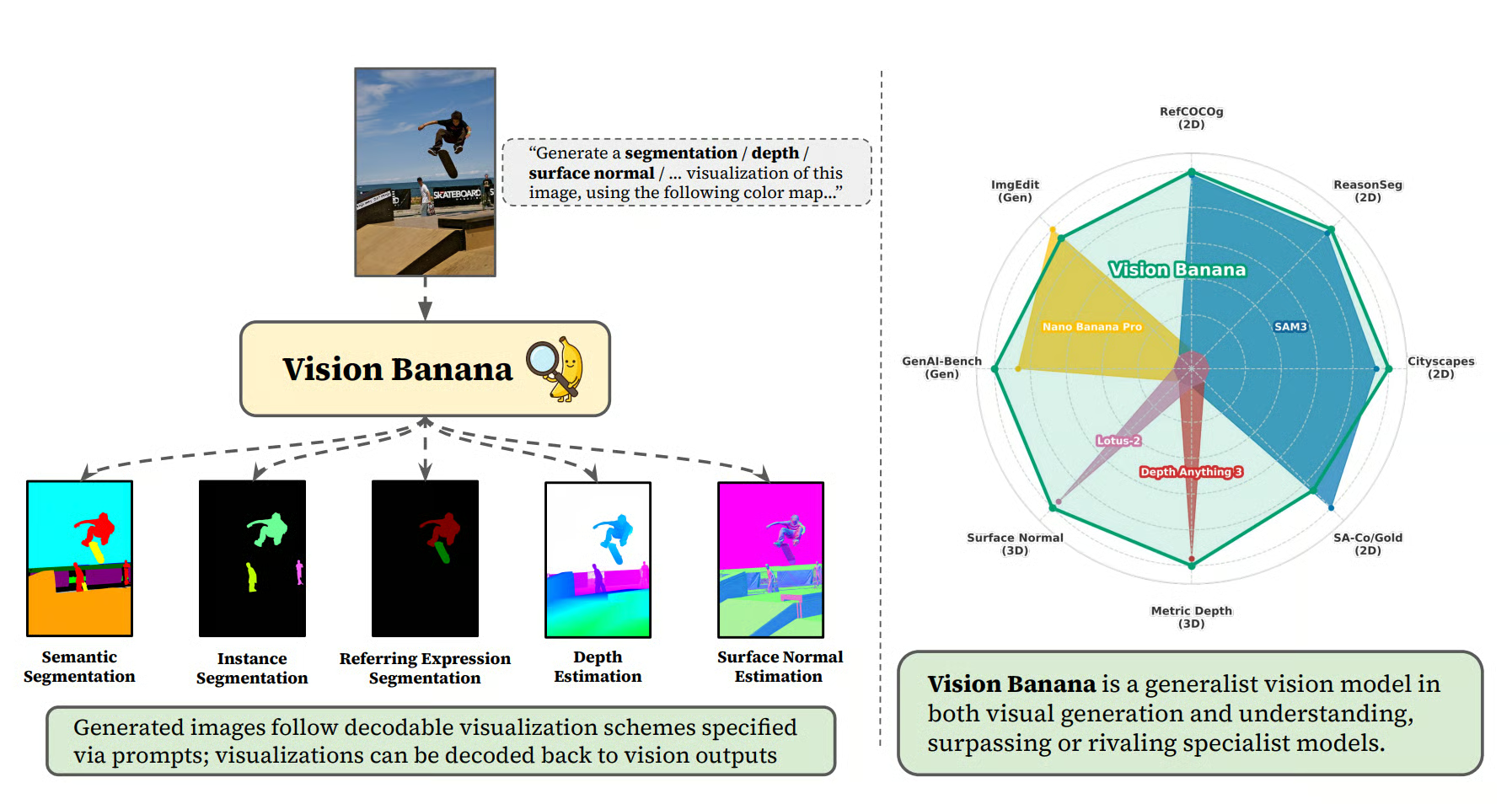

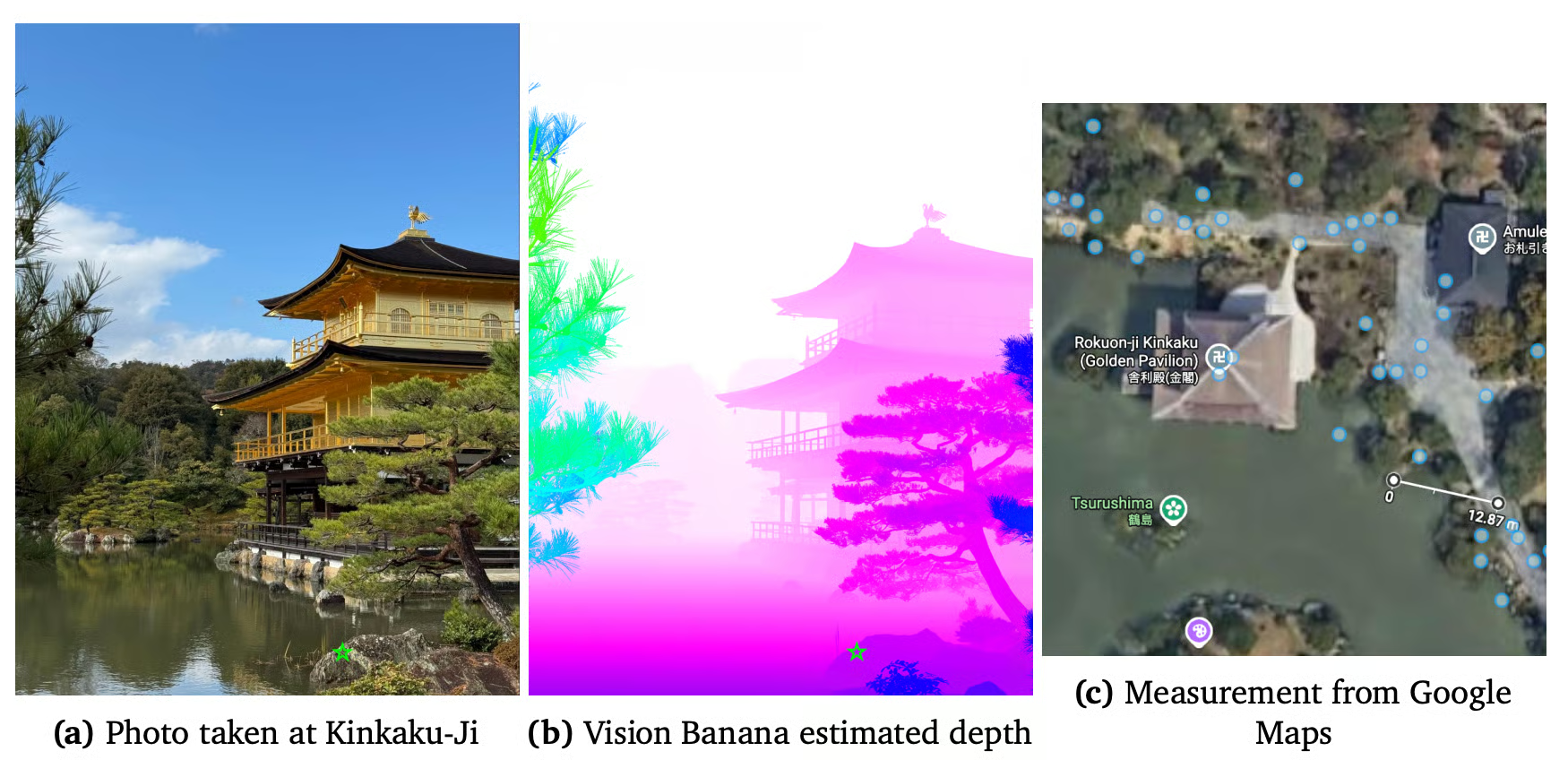

Hình 1: Khả năng hiểu thị giác ẩn của các bộ sinh ảnh nhờ tinh chỉnh theo hướng dẫn trên Nano Banana Pro (Nguồn)

Công thức là:

- Giữ nguyên kiến trúc mô hình nền

- Trộn dữ liệu phân đoạn, độ sâu và pháp tuyến bề mặt vào phân phối huấn luyện ở tỷ lệ thấp

- Tinh chỉnh theo hướng dẫn

Toàn bộ phương pháp huấn luyện không cần kiến trúc mới, không cần head tùy biến, không có hàm mất mát phụ trợ và không có bộ giải mã chuyên biệt.

Mô hình thu được:

- Vượt SAM 3 trên ba bộ chuẩn phân đoạn

- Vượt Depth Anything V3 ở ước lượng độ sâu có thang đo

- Vượt Lotus-2 ở ước lượng pháp tuyến bề mặt

- Giữ nguyên chất lượng sinh ảnh của mô hình nền (hòa về mặt thống kê trên GenAI-Bench và ImgEdit)

Tất cả đạt được dưới giao thức truyền chuyển không ví dụ (zero-shot) nghiêm ngặt, đảm bảo mô hình chưa từng thấy các phần huấn luyện của các bộ chuẩn mà nó được đánh giá.

Vì sao điều này quan trọng?

Học biểu diễn thị giác đã thử nhiều mục tiêu tiền huấn luyện qua các năm. Những mục tiêu phổ biến gồm:

- Phân loại có giám sát (ImageNet, JFT)

- Học tương phản (CLIP, SigLIP)

- Tự chưng cất (DINO, DINOv2)

- Tự mã hóa che mặt (MAE, BEiT)

Điều quan trọng là không mục tiêu nào trong số đó mang tính sinh. Sinh ảnh từ trước đến nay được xem là năng lực hạ nguồn, không phải nền tảng cho hiểu biết. Các nỗ lực tiền huấn luyện sinh sớm (iGPT, LVM) liên tục kém hơn các phương pháp tương phản trên các bộ chuẩn chất lượng biểu diễn.

Việc mở rộng mục tiêu tự hồi quy sinh thông qua dự đoán token tiếp theo đã xúc tác sự xuất hiện năng lực đa năng zero-shot ở các mô hình như GPT-3. Các hành vi hạ nguồn phức tạp được phát hiện là tiềm ẩn trong không gian trọng số chiều cao, sau đó được làm lộ diện thông qua tinh chỉnh có giám sát gọn nhẹ và căn chỉnh theo hướng dẫn. Ví dụ gồm:

- Dịch máy thần kinh

- Tổng hợp mã đa ngôn ngữ

- Tóm tắt trừu tượng

- Lập luận số học

Vision Banana cho rằng chúng ta đang ở thời khắc tương tự đối với thị giác. Bài báo vẽ ra phép so sánh rõ ràng giữa tiền huấn luyện sinh ảnh và tiền huấn luyện mô hình ngôn ngữ, và giữa tinh chỉnh theo hướng dẫn và bước căn chỉnh.

Nếu phép so sánh đúng, chúng ta sẽ ngừng xây dựng các pipeline đặc thù tác vụ và xem một bộ sinh ảnh lớn duy nhất là lớp nền tảng, đặc tả tác vụ qua prompt.

Vision Banana hoạt động như thế nào?

Cơ chế rất đơn giản: mọi tác vụ thị giác được diễn giải lại thành "sinh một ảnh RGB với các thuộc tính này", và ở thời điểm giải mã, bạn biến đổi ảnh RGB đó trở lại thành dự đoán tác vụ một cách tất định.

Cách ánh xạ cho từng tác vụ như sau:

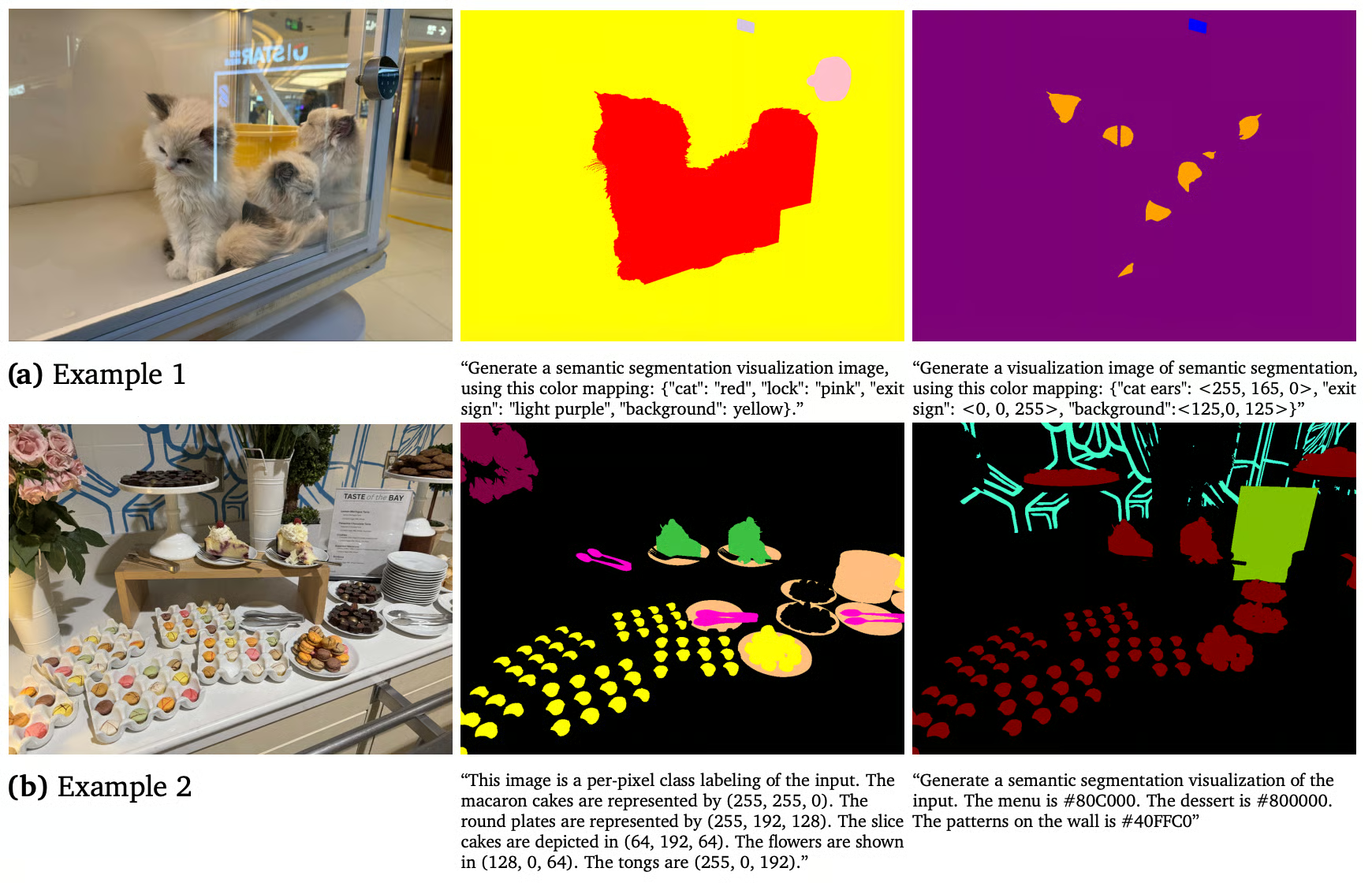

Phân đoạn theo ngữ nghĩa

Nhắc mô hình với gán màu theo từng lớp, và ở thời điểm giải mã, gom cụm pixel về màu gần nhất đã chỉ định. Từ vựng là bất cứ thứ gì bạn đặt trong prompt; theo cấu trúc thì đây là từ vựng mở.

Sẽ rõ hơn khi xem ví dụ. Đây là một prompt trong bài báo:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Hình 2: Phân đoạn theo ngữ nghĩa (Nguồn)

Phân đoạn theo thể hiện

Phân đoạn theo thể hiện khó hơn phân đoạn ngữ nghĩa, vì số lượng thể hiện không biết trước. Do đó, bạn không thể gán màu từ trước.

Giải pháp của Vision Banana là suy luận theo từng lớp một, để mô hình tự gán các màu khác nhau cho các thể hiện khác nhau một cách động, rồi ở thời điểm giải mã thì gom cụm pixel theo các mode màu.

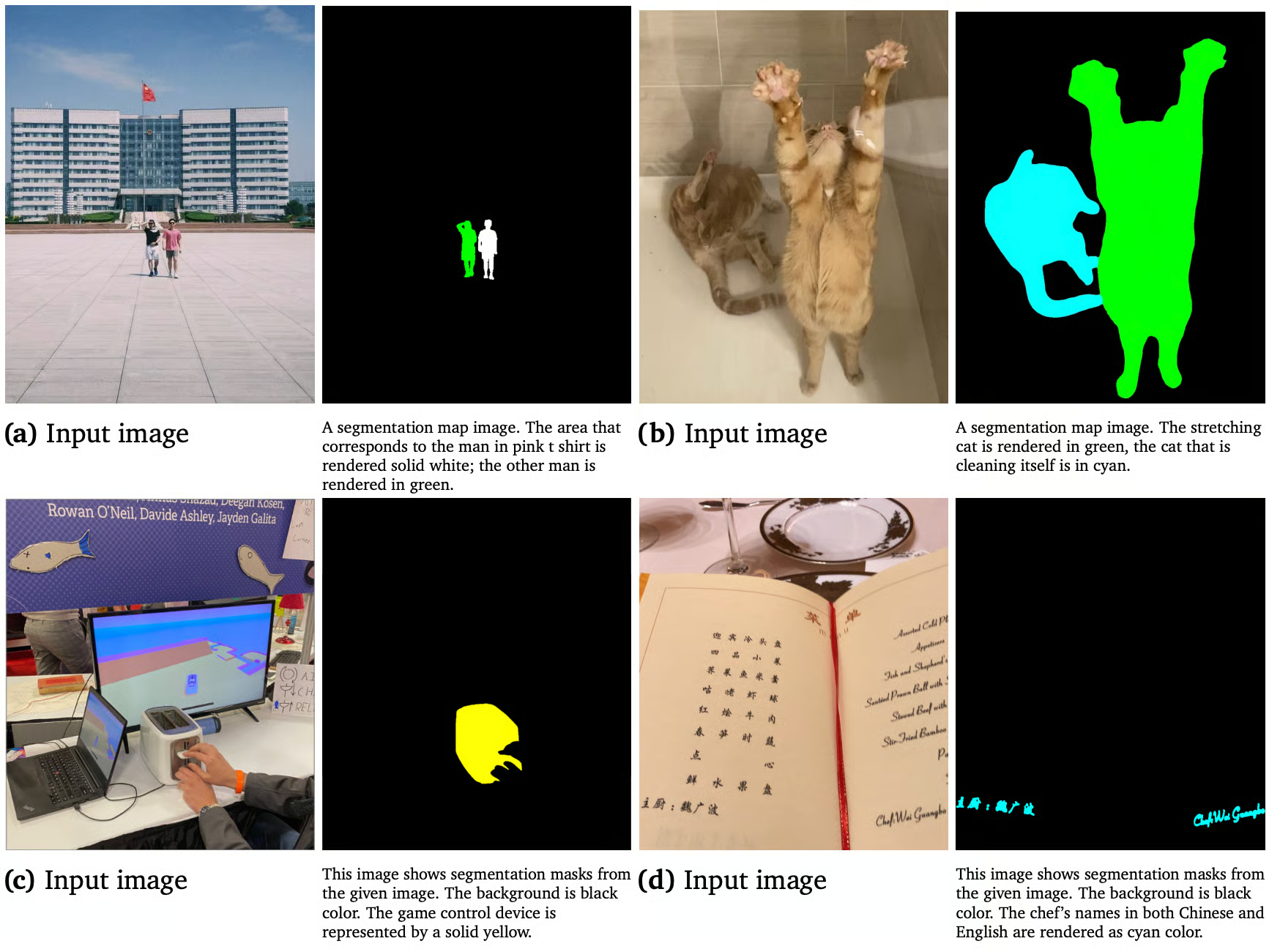

Phân đoạn theo mô tả

Vision Banana có thể nhận một prompt với mô tả ngôn ngữ tự nhiên về thứ cần phân đoạn và trả về một mặt nạ. Đây là ví dụ prompt từ bài báo:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Đây là nơi lý luận đa phương thức được ươm sẵn trong tiền huấn luyện sinh phát huy. Các mô hình phân biệt gặp khó với biểu đạt tham chiếu vì tác vụ đòi hỏi suy luận kết hợp ngôn ngữ và thị giác. Các mô hình sinh được huấn luyện trên hàng tỷ cặp chú thích-ảnh xử lý điều này một cách tự nhiên.

Hình 3: Vision Banana hiểu prompt ngôn ngữ tự nhiên và suy luận về chúng (Nguồn)

Độ sâu và pháp tuyến bề mặt

Cả độ sâu lẫn pháp tuyến bề mặt đều được chiếu vào không gian RGB thông qua các ánh xạ song ánh, đảm bảo thuộc tính hình học tiềm ẩn được giữ nguyên mà không mất thông tin khi biến đổi. Chúng ta sẽ mổ xẻ chi tiết mã hóa độ sâu-thành-RGB ở phần tiếp theo.

Mô hình suy luận thống nhất này coi mọi tác vụ thị giác máy tính là một bài toán sinh ảnh tất định. Bằng cách duy trì giao diện RGB nhất quán xuyên suốt pipeline, mô hình tránh các nhánh kiến trúc đặc thù tác vụ, hoàn toàn dựa vào điều kiện hóa bằng prompt để xác định ngữ nghĩa đầu ra.

Giờ hãy hiểu sâu hơn một chút về độ sâu. Đây là chỗ cách tiếp cận này dễ đổ bể nhất.

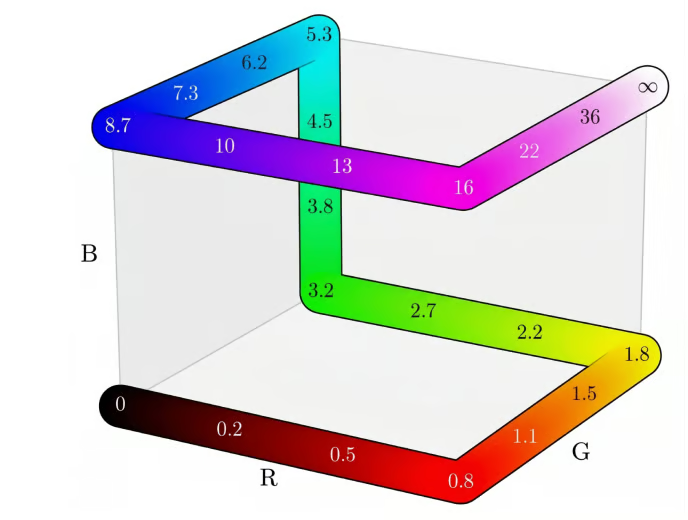

Mã hóa độ sâu không bị chặn vào RGB

Nếu mã hóa không phải song ánh, bạn không thể khôi phục khoảng cách có thang đo ở thời điểm giải mã, và toàn bộ tuyên bố "sinh ảnh như giao diện phổ quát" sụp đổ theo. Điều này đáng để hiểu vì nó cho biết cách tiếp cận là có nguyên tắc hay chắp vá.

Vấn đề ở đây là giá trị độ sâu là các số thực không bị chặn trong [0, ∞), trong khi RGB bị chặn trong [0, 1]. Vậy nên, để dùng "sinh bản đồ độ sâu" làm tín hiệu huấn luyện, bạn cần một ánh xạ song ánh nơi mỗi độ sâu có thang đo ánh xạ tới đúng một giá trị RGB, và khi giải mã, bạn có thể đảo ngược về mét.

Cách tiếp cận của Vision Banana có hai giai đoạn:

Giai đoạn 1: Nén độ sâu không bị chặn vào [0, 1)

Các tác giả dùng biến đổi lũy thừa của Barron (2025) với tham số hình dạng λ = -3, giúp vùng gần có độ phân giải cao hơn vùng xa. Một vật cách 2 mét nhận được độ chính xác cao hơn vật cách 200 mét. Điều này phù hợp với phần lớn ứng dụng quan tâm, tức các vật thể có thể thao tác, không phải những vật ở xa.

Giai đoạn 2: Ánh xạ [0, 1) lên các cạnh khối RGB

Tiếp theo, họ nội suy dọc theo một đường gấp khúc tuyến tính từng phần bám theo các cạnh của khối RGB, về bản chất là lần lặp đầu của đường cong Hilbert 3D. Điều này tạo ra các chuyển màu mượt, hợp lý về cảm nhận, và không mơ hồ về việc màu nào ứng với độ sâu nào.

Vì cả hai giai đoạn đều đảo ngược được nghiêm ngặt, phép hợp thành là song ánh. Sau đó họ huấn luyện trên dữ liệu chuẩn hóa sang RGB, và khi suy luận, chiếu RGB dự đoán lên cạnh khối gần nhất và đảo ngược về mét.

Hình 4: Trực quan hóa phép song ánh giữa khoảng cách vô hướng 𝑑 ≥ 0 và giá trị màu RGB (Nguồn)

Để tăng độ vững, huấn luyện được bổ sung các colormap thay thế như Plasma, Inferno, Viridis và thang xám, để mô hình có thể xử lý bất kỳ phong cách hiển thị nào bạn yêu cầu trong prompt.

Pháp tuyến bề mặt thì dễ hơn vì vốn là vector đơn vị với các thành phần trong [-1, 1], có thể ánh xạ trực tiếp sang RGB theo quy ước không gian camera chuẩn (+x sang phải, +y lên trên, +z hướng ra khỏi mặt phẳng ảnh). Vậy nên, xanh lục nhạt nghĩa là hướng lên, đỏ hồng nghĩa là hướng trái, và xanh lam/tím nhạt nghĩa là hướng về camera. Không cần biến dạng.

Lưu ý: Vision Banana không dùng nội tại camera ở bất kỳ đâu, cả khi huấn luyện lẫn suy luận. Hầu hết các phương pháp độ sâu SOTA (Depth Anything V3, MoGe-2, UniK3D, DepthLM) đều dùng nội tại ở đâu đó trong vòng lặp vì chúng giúp gỡ mơ hồ về tỉ lệ khi nhìn đơn mắt.

Vision Banana suy luận tỉ lệ tuyệt đối chỉ từ các tiên nghiệm thị giác, và vẫn thắng, là bằng chứng mạnh nhất trong bài báo rằng tiền huấn luyện sinh đang làm công việc hình học chứ không chỉ bắt chước các trực quan hóa đã thấy trong huấn luyện.

Mô hình chuyên biệt so với Vision Banana: So sánh

Cách rõ ràng nhất để thấy điều gì thực sự khác biệt là so sánh trực tiếp hai mô hình tư duy trên một tác vụ. Hãy so sánh ước lượng độ sâu với cách chuyên biệt (Marigold, Lotus, Depth Anything V3) và Vision Banana.

Hai mô hình tư duy tạo ra các tạo phẩm khác nhau. Marigold là công cụ chuyên dụng, trong khi Vision Banana là mô hình đa năng với độ rộng đến từ một bước huấn luyện duy nhất.

Những khác biệt này kéo theo cách mô hình được dùng trong thực tế:

|

Khía cạnh |

Chuyên biệt (kiểu Marigold) |

Vision Banana |

|

Định dạng đầu ra |

Tensor đặc thù tác vụ |

Ảnh RGB |

|

Từ vựng |

Cố định khi huấn luyện |

Xác định trong prompt |

|

Đa tác vụ |

Một mô hình mỗi tác vụ |

Một mô hình, nhiều tác vụ |

|

Nội tại camera |

Thường cần |

Không dùng |

|

Khả năng sinh |

Mất khi tinh chỉnh |

Được giữ |

|

Chi phí suy luận |

Thấp |

Cao (bộ sinh ảnh đầy đủ) |

Các bộ chuẩn là một bức tranh pha trộn giữa những chiến thắng rõ ràng và một thất bại thẳng thắn. Tất cả đều trong chế độ truyền chuyển zero-shot, tức mô hình chưa từng thấy các phần huấn luyện của bộ chuẩn đánh giá.

Những hồ sơ hiệu năng vượt trội:

- Phân đoạn theo ngữ nghĩa (Cityscapes): Đạt mIoU 0,699, vượt Segment Anything Model (SAM 3) chuyên biệt ở mức 0,652.

- Phân đoạn theo tham chiếu (RefCOCOg): Đạt cIoU 0,738, nhỉnh hơn mốc SAM 3 Agent là 0,734.

- Lý luận thị giác phức tạp (ReasonSeg): Khi kết hợp với Gemini 2.5 Pro, đạt gIoU 0,793, vượt SAM 3 Agent ở mức 0,770 và thiết lập SOTA zero-shot mới, thậm chí so với các phương pháp không zero-shot, giám sát đầy đủ.

- Ước lượng độ sâu có thang đo: Đạt trung bình

δ(độ chính xác ngưỡng) 0,929 trên bốn bộ dữ liệu đa dạng, cải thiện so với Depth Anything V3 ở mức 0,918. - Ước lượng pháp tuyến bề mặt: Ghi nhận trung bình sai số góc nhỏ hơn, 15,549° trên ba bộ dữ liệu trong nhà, thể hiện độ trung thực hình học vượt Lotus-2 (16,558°).

Thiếu hụt hiệu năng:

- Phân đoạn theo thể hiện (SA-Co/Gold): Hiệu năng đạt 0,540 pmF1 (đánh giá trên mẫu 500 truy vấn của SA-Co/Gold, không phải toàn bộ bộ chuẩn), kém SAM 3 không zero-shot (0,661) và ngang với DINO-X zero-shot (0,552). Kết quả này nhiều khả năng bắt nguồn từ ràng buộc gán màu rời rạc cho số lượng thể hiện, hạn chế độ phân giải trong các cảnh rất dày đặc.

Trên GenAI-Bench, Vision Banana thắng 53,5% so sánh do con người đánh giá so với Nano Banana Pro nền. Đây là một ví dụ kiểm tra bám theo thực tế từ bài báo:

Hình 5: Ước lượng độ sâu của Vision Banana (Nguồn)

Một tác giả chụp ảnh bằng điện thoại gần Kinkaku-Ji. Vision Banana dự đoán một điểm cụ thể ở 13,71 mét. Google Maps cho 12,87, tức sai số tương đối tuyệt đối 6,5% trên một ảnh điện thoại không hiệu chuẩn, không nội tại, không thiết lập gì. Đây là kiểu thử nghiệm dự báo hành vi triển khai đáng tin hơn con số bộ chuẩn.

Hạn chế của Vision Banana

Vision Banana có bốn ràng buộc đáng lưu ý. Bao gồm:

- Chi phí: Chạy một mô hình tầm Nano Banana Pro cho mỗi lần suy luận đắt hơn rất nhiều so với chạy một mô hình chuyên biệt độ sâu đã chưng cất. Bài báo thừa nhận trực tiếp điều này trong phần Công việc Tương lai. Với 10 nghìn khung hình video, cách làm này hiện chưa cạnh tranh về kinh tế. Chưng cất xuống các chuyên gia nhỏ hơn là bước tiếp theo hiển nhiên.

- Cảnh dày đặc thể hiện: SA-Co/Gold là thất bại rõ ràng. Gán màu theo lớp cạn biên khi cần đếm chính xác nhiều vật thể nhỏ. SAM 3 vẫn thắng ở đây.

- Ảnh đơn: Triển khai mô hình hiện tại bị ràng buộc cơ bản ở đầu vào ảnh tĩnh, đơn góc nhìn, thiếu năng lực xử lý không-thời gian hoặc đa góc nhìn. Lý luận theo thời gian được các tác giả để cho công việc tương lai.

- Triển khai hộp đen: Bạn không thể thăm dò, sửa đổi hoặc chạy mô hình riêng tư. Điều này quan trọng trong các bối cảnh bị quản lý hoặc nhạy cảm về IP, nơi không thể chạy API tuyến đầu.

Lời kết

Vision Banana là một minh chứng cụ thể rằng các bộ sinh ảnh đã làm phần việc nặng cho hiểu biết thị giác, và việc bộc lộ các năng lực đó cần căn chỉnh hơn là kiến trúc mới.

Đóng góp cụ thể của bài báo là

- Mã hóa RGB song ánh biến độ sâu và phân đoạn thành các bài toán sinh ảnh có thể đảo ngược

- Công thức tinh chỉnh theo hướng dẫn gọn nhẹ bổ sung kỹ năng thị giác mà không đốt cháy tiên nghiệm sinh

- Ước lượng độ sâu có thang đo không dùng nội tại camera nhưng vượt các chuyên gia vốn cần chúng

- Giao thức truyền chuyển zero-shot nghiêm ngặt giúp tuyên bố đa năng đo lường được trên các bộ chuẩn tiêu chuẩn.

Bài báo cũng thúc đẩy một mô hình tư duy lấy sinh làm trước, nơi tác vụ được đặc tả bằng prompt và đầu ra được giải mã ngược từ ảnh RGB, và nơi cùng một bộ trọng số xử lý cả việc tạo và phân tích nội dung thị giác.

Bạn có thể thử các prompt trên trang dự án với Nano Banana Pro nền tảng hoặc Nano Banana 2 để xem có gì đã tiếp cận được mà không cần tinh chỉnh theo hướng dẫn, xây tính năng phân đoạn-lý luận với các mô hình lớp NBP và một bộ định tuyến LLM đa phương thức thay vì huấn luyện pipeline tùy biến trực tiếp.

Câu hỏi thường gặp về Vision Banana

Làm sao tôi có thể dùng Vision Banana hiện nay?

Chưa. Bài báo và trang dự án đã công bố, nhưng trọng số mô hình nằm tại Google DeepMind. Mô hình nền, Nano Banana Pro, có sẵn trong Gemini API và AI Studio, và chính luận điểm của bài báo gợi ý rằng nhắc NBP trực tiếp bằng các prompt trên trang dự án đã có thể cho kết quả có ý nghĩa.

Vision Banana có thể thay thế SAM 3 hoặc Depth Anything không?

Chưa thể, chủ yếu vì chi phí. Với các ứng dụng cần chạy suy luận thị giác rẻ ở quy mô lớn (video, thời gian thực, di động), các mô hình chuyên biệt vẫn thắng về kinh tế.

So với MLLM như GPT-5V hoặc Gemini 2.5 thì thế nào?

LLM đa phương thức nhận ảnh và tạo văn bản. Vision Banana nhận ảnh và một prompt để tạo ảnh. Họ giải quyết các bài toán khác nhau.

Vì sao Vision Banana không dùng nội tại camera cho độ sâu?

Hầu hết mô hình chuyên biệt dùng nội tại để gỡ mơ hồ về tỉ lệ đơn mắt (một vật nhỏ ở gần và một vật lớn ở xa có thể tạo pixel giống hệt nhau). Tuy nhiên, Vision Banana suy luận tỉ lệ từ các tiên nghiệm thị giác học được trong tiền huấn luyện sinh về kích thước vật thể, ngữ cảnh cảnh và tri thức thế giới.

Tôi là Chuyên gia Google Developers trong lĩnh vực ML (Gen AI), Chuyên gia Kaggle 3x và Đại sứ Women Techmakers với hơn 3 năm kinh nghiệm trong ngành công nghệ. Tôi đồng sáng lập một startup công nghệ y tế vào năm 2020 và hiện đang theo học thạc sĩ khoa học máy tính tại Georgia Tech, chuyên sâu về học máy.