track

Datorsyn har alltid byggt på en tydlig åtskillnad mellan modeller som producerar bilder och modeller som förstår dem. Generativa ramverk var primära källor för syntes, medan diskriminativa arkitekturer fokuserade på klassificering, segmentering eller djupregression. Standardupplägget för en ny synuppgift var att välja en arkitektur, koppla på ett uppgiftsspecifikt huvud och finjustera på märkt data.

Det är just den utgångspunkten som Vision Banana från Google DeepMind vill utmana. Artikeln hävdar att bildgeneratorer redan har lärt sig allt som en generalistisk synmodell behöver, inklusive segmentering, djup, yt-normals och mer. Enligt författarna är det enda som saknas ett tunt lager av instruktionstuning för att göra dessa latenta förmågor mätbara på benchmarktester.

I det här inlägget börjar jag med vad Vision Banana faktiskt är och varför artikeln har väckt fältets uppmärksamhet, går sedan igenom hur modellen fungerar. Jag avslutar med vad som fungerar, vad som inte gör det och vad praktiker bör ta med sig. Längs vägen lyfter jag de frågor jag hade när jag läste artikeln. Andra läsare lär ha samma frågor.

Obs: Själva Vision Banana är inte offentligt tillgänglig. Det som finns ute är artikeln och projektsidan. Basmodellen bygger på Nano Banana Pro och är tillgänglig via Gemini API och Google AI Studio.

Vad är Vision Banana?

Vision Banana är en forskningsmodell från Google DeepMind, byggd genom att ta Nano Banana Pro (text‑till‑bild‑generator) och tillämpa lätt instruktionstuning på en blandning av dess ursprungliga träningsdata tillsammans med en liten mängd data för datorsynsuppgifter.

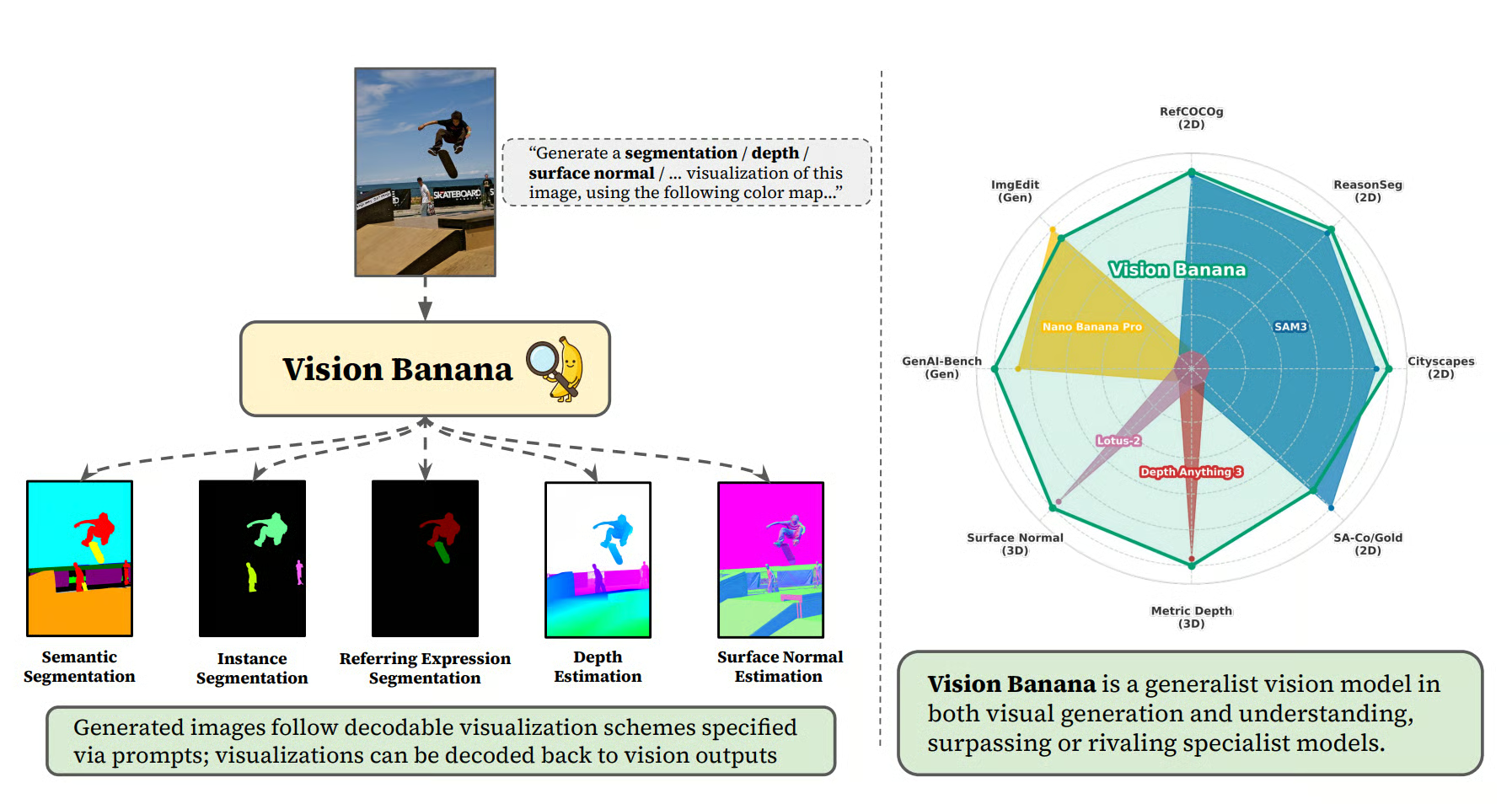

Figur 1: Dolda visuella förståelseförmågor hos bildgeneratorer genom instruktionstuning av Nano Banana Pro (Källa)

Upplägget är att:

- Behålla basmodellens arkitektur oförändrad

- Blanda in segmenterings-, djup- och yt‑normal‑data i träningsfördelningen i låg andel

- Instruktionstuna

Hela träningsmetodiken kräver ingen ny arkitektur, inga specialhuvuden, inga hjälpförluster och inga specialiserade avkodare.

Den resulterande modellen:

- Slår SAM 3 på tre segmenteringsbenchmark

- Slår Depth Anything V3 på metrisk djupskattning

- Slår Lotus‑2 på uppskattning av yt‑normals

- Behåller sin basmodells bildgenereringskvalitet (statistisk oavgjord på GenAI‑Bench och ImgEdit)

Allt detta uppnås under ett strikt zero‑shot‑överföringsprotokoll, vilket säkerställer att modellen aldrig har sett träningsdelarna av de benchmarktester den utvärderas på.

Varför spelar detta roll?

Representationer för visuella modeller har prövats med många pretraining‑mål genom åren. Vanliga inkluderar:

- Superv sedan klassificering (ImageNet, JFT)

- Kontrastiv inlärning (CLIP, SigLIP)

- Självdestillering (DINO, DINOv2)

- Maskerad autoenkodning (MAE, BEiT)

Det viktiga är att ingen av dem är generativ. Bildgenerering har historiskt setts som en nedströmsförmåga, inte en grund för förståelse. Tidiga försök med generativ pretraining (iGPT, LVM) låg konsekvent efter kontrastiva metoder på representationskvalitet.

Skalningen av generativa autoregressiva mål via nästa‑token‑förutsägelse katalyserade framväxten av zero‑shot‑generalistiska förmågor i modeller som GPT‑3. Komplexa nedströmsbeteenden visade sig vara latenta i den högdimensionella viktutrymmet och kunde sedan lyftas fram via lätt övervakad finjustering och instruktionsanpassning. Exempel inkluderar:

- Neuronal maskinöversättning

- Flerspråkig kodsyntes

- Abstrakt sammanfattning

- Aritmetiskt resonemang

Vision Banana menar att vi befinner oss i samma ögonblick för vision. Artikeln drar uttryckligen en analogi mellan pretraining för bildgenerering och språkmodeller, samt mellan instruktionstuning och alignmentssteget.

Om analogin håller kommer vi att sluta bygga uppgiftsspecifika pipelines och istället behandla en enda stor bildgenerator som grundlager, där uppgifter specificeras via promptar.

Hur fungerar Vision Banana?

Mekanismen är enkel: varje synuppgift omformuleras som ”generera en RGB‑bild med dessa egenskaper”, och vid avkodning omvandlar du den RGB‑bilden tillbaka till uppgiftsförutsägelser deterministiskt.

Så här mappas varje uppgift:

Semantisk segmentering

Prompta modellen med färgtilldelningar per klass, och vid avkodningstid klustrar du pixlar till närmaste angivna färg. Vokabulären är vad du lägger i prompten; den är öppen per konstruktion.

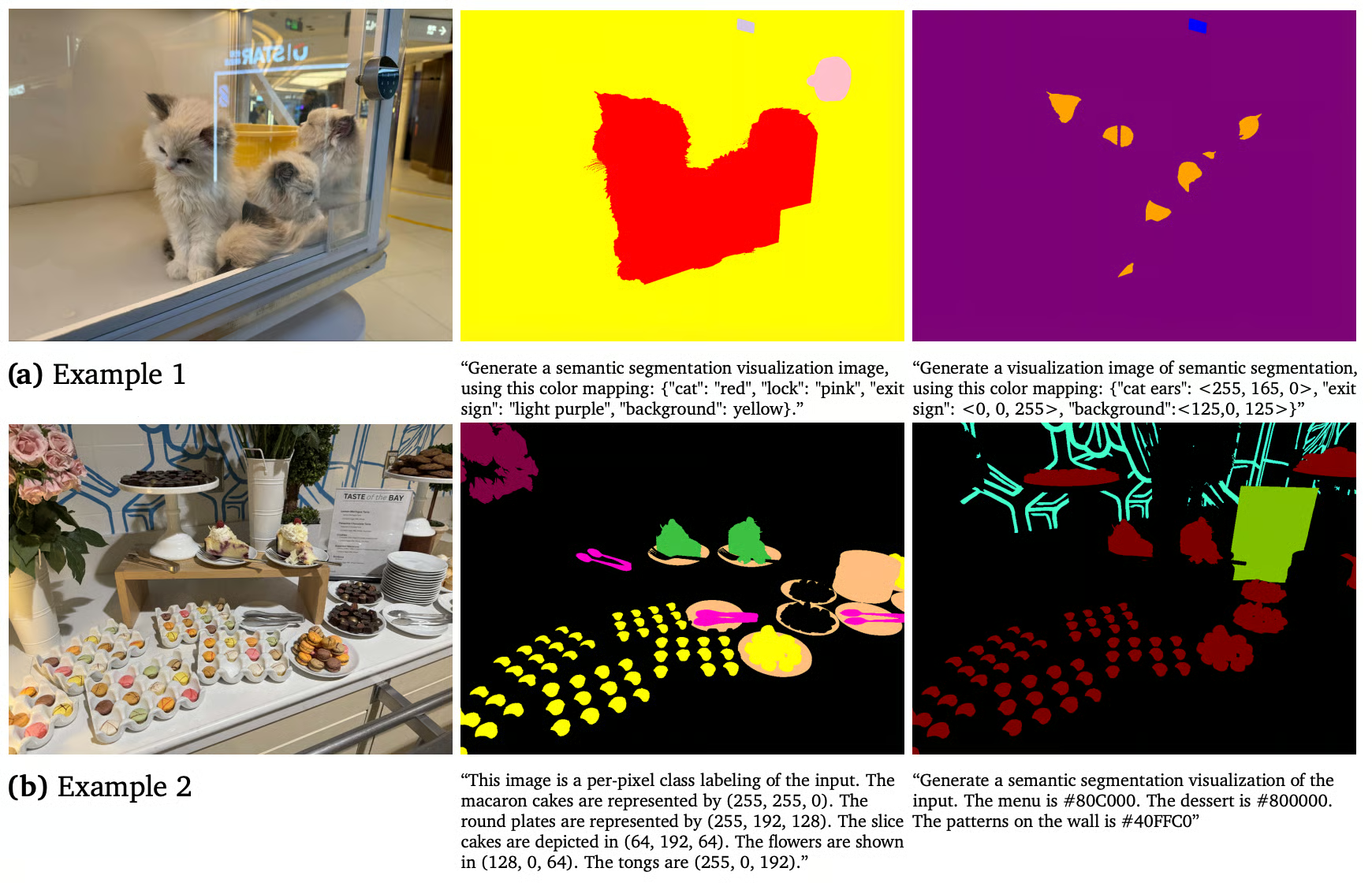

Det blir tydligare vad jag menar när vi tittar på ett exempel. Här är en prompt från artikeln:

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

Figur 2: Semantisk segmentering (Källa)

Instanssegmentering

Instanssegmentering är knepigare än semantisk segmentering, eftersom antalet instanser inte är känt i förväg. Du kan alltså inte förtilldela färger.

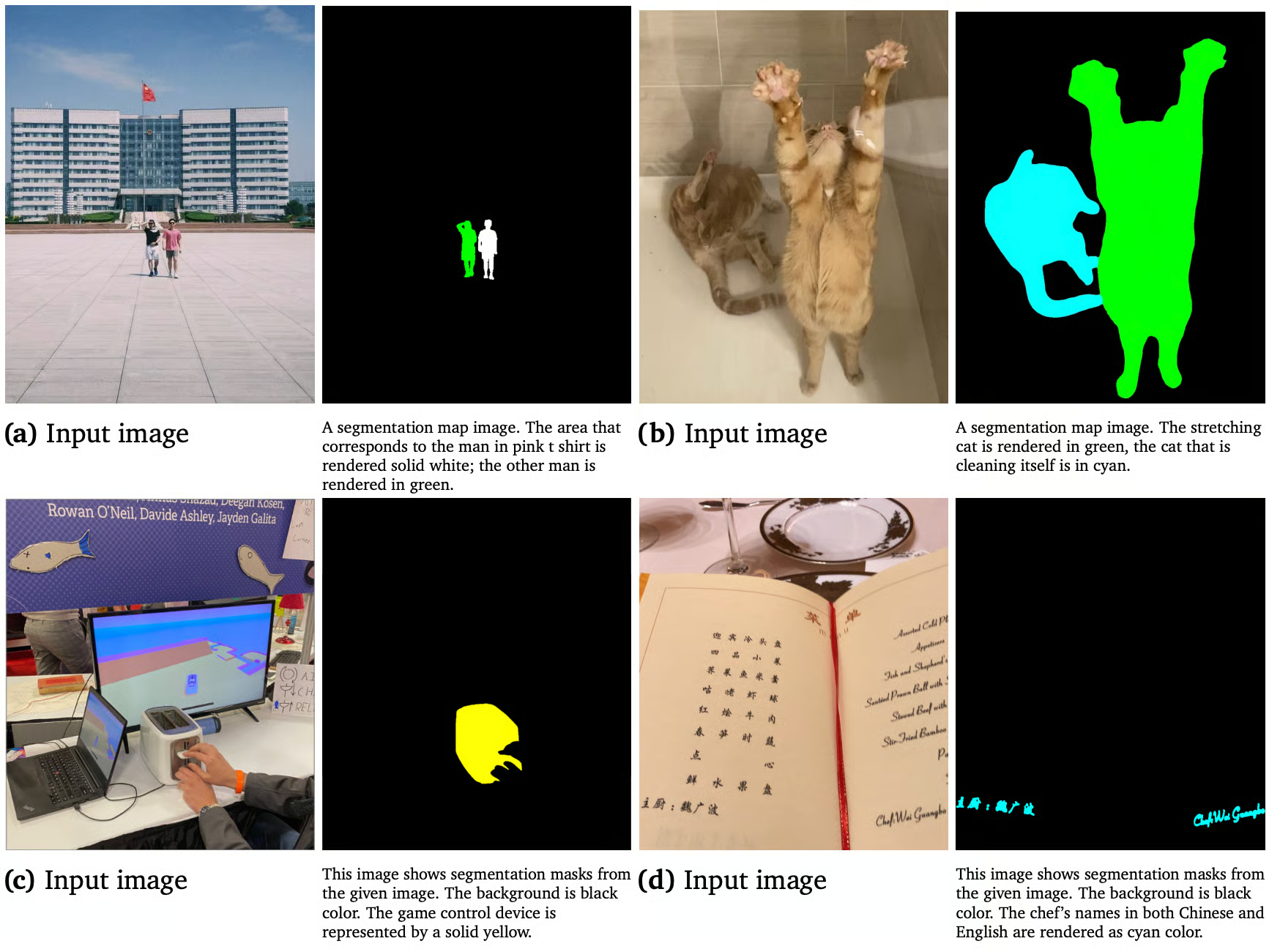

Vision Bananas lösning är att köra en klass per inferens, låta modellen dynamiskt tilldela distinkta färger till distinkta instanser och sedan klustra pixlar till färglägen vid avkodning.

Expressionssegmentering

Vision Banana kan ta in en prompt med en naturlig språklig beskrivning av vad som ska segmenteras och returnera en mask. Här är en exempelprompt från artikeln:

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.Det är här multimodalt resonemang, inbakat i generativ pretraining, glänser. Diskriminativa modeller kämpar med refererande uttryck eftersom uppgiften kräver gemensamt språkligt och visuellt resonemang. Generativa modeller tränade på miljarder bild‑text‑par hanterar det naturligt.

Figur 3: Vision Banana kan förstå naturliga språkpromptar och resonera kring dem (Källa)

Djup och yt‑normals

Både djup och yt‑normals projiceras till RGB‑utrymmet via bijektiva avbildningar, vilket säkerställer att de latenta geometriska egenskaperna bevaras med noll informationsförlust under transformationen. Vi dissekerar specifikt kodningen från djup till RGB i nästa avsnitt.

Detta enhetliga inferensparadigm behandlar varje datorsynsuppgift som ett deterministiskt bildgenereringsproblem. Genom att behålla ett konsekvent RGB‑gränssnitt genom hela pipelinen undviker modellen uppgiftsspecifika arkitekturgrenar och förlitar sig helt på promptstyrning för att definiera outputsemantiken.

Låt oss nu förstå djup lite mer i detalj. Det är här hela angreppssättet enklast skulle kunna fallera.

Koda obegränsat djup till RGB

Om kodningen inte är bijektiv kan du inte återställa metriska avstånd vid avkodning, och hela idén om ”bildgenerering som universellt gränssnitt” faller med den. Det är värt att förstå, eftersom det visar om angreppssättet är principfast eller ett hack.

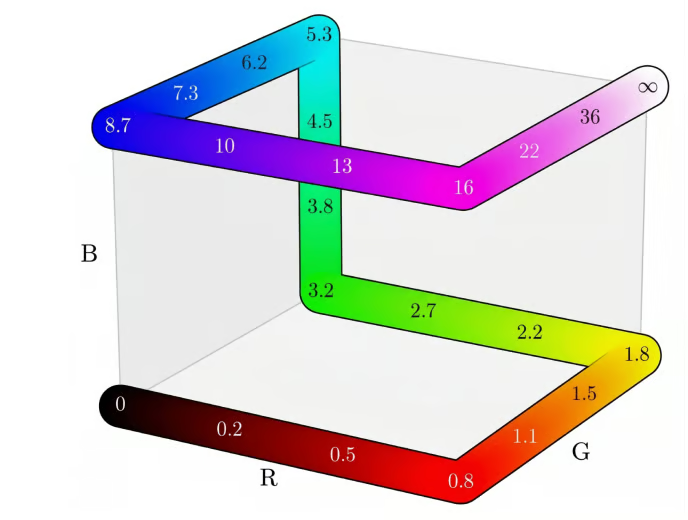

Problemet här är att djupvärden är obegränsade reella tal i [0, ∞), medan RGB är begränsat [0, 1]. För att kunna använda ”generera djupkartan” som träningssignal behöver du en bijektiv avbildning där varje metrisk djupnivå mappas till exakt ett RGB‑värde, och att du vid avkodning kan invertera det tillbaka till meter.

Vision Bananas angreppssätt har två steg:

Steg 1: Komprimera obegränsat djup till [0, 1)

Författarna använder Barrons (2025) krafttransform med formparametern λ = -3, vilket ger närfältet högre upplösning än fjärrfältet. Ett objekt på 2 meters avstånd får högre precision än ett på 200 meter. Detta matchar vad de flesta tillämpningar bryr sig om, dvs gripbara objekt och inte avlägsna.

Steg 2: Mappa [0, 1) till RGB‑kubens kanter

Därefter interpolerar de längs en bitvis linjär bana som följer RGB‑kubens kanter, i praktiken första iterationen av en 3D‑Hilbertkurva. Detta ger mjuka, perceptuellt rimliga färgövergångar utan tvetydighet om vilken färg som motsvarar vilket djup.

Eftersom båda stegen är strikt inverterbara är kompositionen en bijektion. De tränar sedan på RGB‑kodad mark‑sanning och projicerar vid inferens den förutsagda RGB‑färgen till närmaste kubkant och inverterar tillbaka till meter.

Figur 4: En visualisering av vår bijektion mellan skalära metriska avstånd d ≥ 0 och RGB‑färgvärden (Källa)

För robusthet augmenteras träningen med alternativa färgkartor som Plasma, Inferno, Viridis och gråskala, så att modellen kan hantera vilken visualiseringsstil du än ber om i prompten.

Yt‑normals är enklare eftersom de redan är enhetsvektorer med komponenter i [-1, 1], vilket mappar direkt till RGB med standardkonventionen i kamerarummet (+x höger, +y upp, +z ut ur bildplanet). Så ljusgrönt betyder uppåtriktad, rosarött betyder vänster och ljusblått/lila betyder mot kameran. Ingen deformation behövs.

Obs: Vision Banana använder inga kameraparametrar (intrinsics) någonstans, varken i träning eller inferens. De flesta SOTA‑djupmetoder (Depth Anything V3, MoGe‑2, UniK3D, DepthLM) använder intrinsics någonstans i loopen eftersom de hjälper till att avlägsna tvetydigheter i monokulär skala.

Att Vision Banana härleder absolut skala enbart från visuella priorer och ändå vinner är den starkaste evidensen i artikeln för att den generativa pretrainingen gör geometriskt arbete och inte bara mönstermatchar visualiseringar den sett under träning.

Specialistmodeller vs Vision Banana: en jämförelse

Det renaste sättet att se vad som faktiskt skiljer dem är att jämföra de två paradigmen direkt på en enskild uppgift. Låt oss jämföra djupskattning med specialistupplägget (Marigold, Lotus, Depth Anything V3) och Vision Banana.

De två paradigmen ger olika artefakter. Marigold är ett specialiserat verktyg, medan Vision Banana är en generalist vars bredd kommer från ett enda träningssteg.

Skillnaderna spiller över i hur modellen används i praktiken:

|

Aspekt |

Specialist (Marigold‑stil) |

Vision Banana |

|

Utdataformat |

Uppgiftsspecifikt tensorformat |

RGB‑bild |

|

Ordförråd |

Fast vid träning |

Definieras i prompt |

|

Multiuppgift |

En modell per uppgift |

En modell, många uppgifter |

|

Kameraparametrar |

Ofta nödvändiga |

Används ej |

|

Genereringsförmåga |

Förloras vid finjustering |

Bevaras |

|

Inferenskostnad |

Låg |

Hög (full bildgenerator) |

Benchmarkresultaten är en blandning av tydliga vinster och en ärlig förlust. Allt under zero‑shot‑överföring, dvs modellen har aldrig sett utvärderingsbenchmarksens träningsdelar.

Överlägsna prestandaprofiler:

- Semantisk segmentering (Cityscapes): Nådde 0,699 mIoU (mean Intersection over Union), och överträffade den specialiserade Segment Anything Model (SAM 3) på 0,652.

- Refererande segmentering (RefCOCOg): Visade 0,738 cIoU (kumulativ IoU), över SAM 3 Agent‑baslinjens 0,734.

- Komplext visuellt resonemang (ReasonSeg): När den utnyttjas tillsammans med Gemini 2.5 Pro, uppnådde 0,793 gIoU, slog SAM 3 Agent på 0,770 och satte en ny zero‑shot‑SOTA, även mot icke‑zero‑shot, fullt övervakade metoder.

- Metrisk djupskattning: Registrerade ett genomsnittligt

δ(tröskelträffsäkerhet) på 0,929 över fyra olika dataset, en förbättring jämfört med Depth Anything V3:s 0,918. - Uppskattning av yt‑normals: Uppvisade lägre genomsnittligt medelvinkel‑fel på 15,549° över tre inomhusdataset, med bättre geometrisk trohet än Lotus‑2 (16,558°).

Prestandaunderläge:

- Instanssegmentering (SA‑Co/Gold): Prestandan var 0,540 pmF1 (utvärderad på ett 500‑frågeprov av SA‑Co/Gold, inte hela benchmarken), efter den icke‑zero‑shot SAM 3 (0,661) och i nivå med zero‑shot DINO‑X (0,552). Resultatet beror sannolikt på begränsningen med diskret färgtilldelning för instansantal, vilket begränsar upplösningen i mycket täta scener.

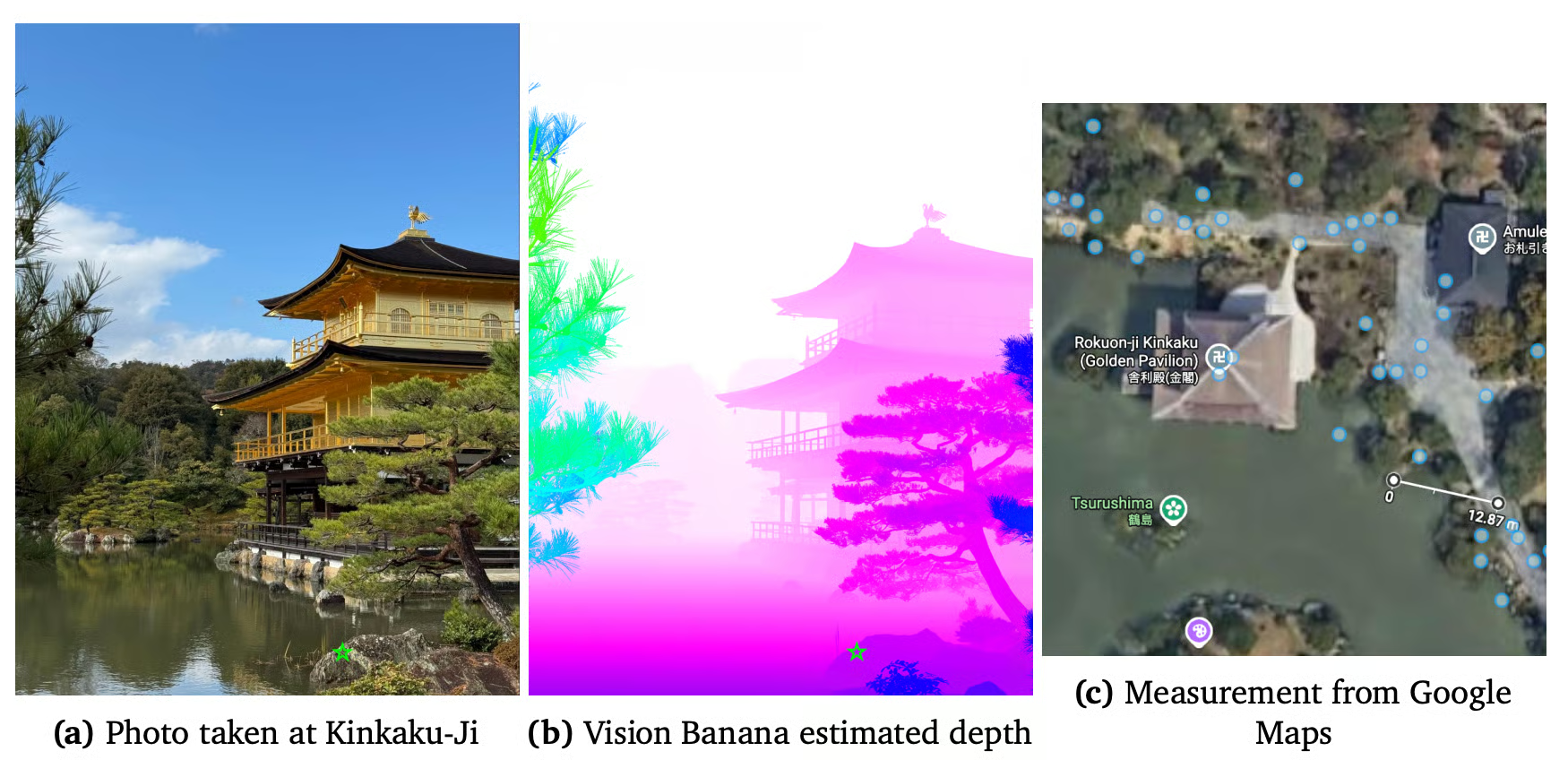

På GenAI‑Bench vinner Vision Banana 53,5 % av mänskliga jämförelser mot basen Nano Banana Pro. Här är ett exempel på ett test i det vilda från artikeln:

Figur 5: Vision Banana djupskattning (Källa)

En av författarna tog ett smartphonefoto nära Kinkaku‑Ji. Vision Banana förutsade en specifik punkt på 13,71 meter. Google Maps anger 12,87, vilket är 6,5 % absolut relativt fel på ett mobilfoto utan kalibrering, utan intrinsics, utan setup. Den typen av test förutsäger driftsbeteende mer tillförlitligt än benchmark‑siffror.

Begränsningar hos Vision Banana

Vision Banana har fyra begränsningar som är värda att flagga. Dessa inkluderar:

- Kostnad: Att köra en modell i Nano Banana Pro‑skala för varje inferens är avsevärt dyrare än att köra en destillerad djupspecialist. Artikeln medger detta direkt i avsnittet om framtida arbete. För 10 000 videorutor är detta angreppssätt inte ekonomiskt konkurrenskraftigt i dag. Destillering till mindre specialister är nästa självklara steg.

- Instans‑täta scener: SA‑Co/Gold är den tydliga förlusten. Färgtilldelning per klass får slut på utrymme när många små objekt måste räknas exakt. SAM 3 vinner fortfarande här.

- Enstaka bild: Den nuvarande modellimplementationen är i grunden begränsad till statiska, enkelvy‑bildinmatningar och saknar kapacitet för spatio‑temporal eller multivy‑bearbetning. Temporal resonemang är utpekat som framtida arbete av författarna.

- Svartlåde‑driftsättning: Du kan inte undersöka, modifiera eller köra modellen privat. Detta spelar roll i reglerade eller IP‑känsliga sammanhang där det inte är ett alternativ att köra ett front‑API.

Avslutande tankar

Vision Banana är en konkret demonstration av att bildgeneratorer redan gör grovjobbet för visuell förståelse, och att lyfta fram dessa förmågor handlar om alignment snarare än nya arkitekturer.

Artiklens specifika bidrag är

- Bijektiv RGB‑kodning som gör djup och segmentering till inverterbara bildgenereringsproblem

- Lättviktig instruktionstuning som adderar synfärdigheter utan att förstöra genereringspriorn

- Metrisk djupskattning utan kameraparametrar som slår specialister som kräver dem

- Strikt zero‑shot‑överföringsprotokoll som gör generalistpåståendet mätbart på standardbenchmarks.

Artikeln driver också en generation‑först‑mental modell där uppgifter specificeras med prompt och utdata avkodas tillbaka från RGB‑bilder, och där samma vikter hanterar både produktion och tolkning av visuellt innehåll.

Du kan testa projektsidans promptar mot basen Nano Banana Pro eller Nano Banana 2 för att se vad som redan är tillgängligt utan instruktionstuning, bygga resonemangs‑segmenteringsfunktioner med NBP‑klassade modeller och en multimodal LLM‑router snarare än att direkt träna specialanpassade pipelines.

Vision Banana: vanliga frågor

Hur kan jag använda Vision Banana idag?

Nej. Artikeln och projektsidan finns ute, men modellvikterna ligger hos Google DeepMind. Basmodellen, Nano Banana Pro, finns i Gemini API och AI Studio, och artikelns egna tes antyder att direkt promptning av NBP med projektsidans promptar redan bör ge meningsfulla resultat.

Kan Vision Banana ersätta SAM 3 eller Depth Anything?

Inte idag, mest på grund av kostnaden. För tillämpningar där du behöver köra syninferens billigt i stor skala (video, realtid, mobil) vinner specialister fortfarande på ekonomin.

Hur står detta sig mot MLLM:er som GPT-5V eller Gemini 2.5?

Multimodala LLM:er tar en bild och producerar text. Vision Banana tar en bild och en prompt och producerar en bild. De löser olika problem.

Varför använder inte Vision Banana kameraparametrar för djup?

De flesta specialister använder intrinsics för att avlägsna tvetydigheter i monokulär skala (ett litet objekt nära och ett stort objekt långt bort kan ge identiska pixlar). Vision Banana härleder däremot skala från visuella priorer som lärts in under generativ pretraining om objektstorlekar, scenkontext och världskunskap.