Tracks

コンピュータビジョンの世界では長らく、画像を「生成する」モデルと「理解する」モデルがきれいに分かれていました。生成系フレームワークは合成のため、識別系アーキテクチャは分類・セグメンテーション・深度推定などに特化。新しいタスクに取り組む標準手順は、アーキテクチャを選び、タスク固有のヘッドを付け、ラベル付きデータでファインチューニングすることでした。

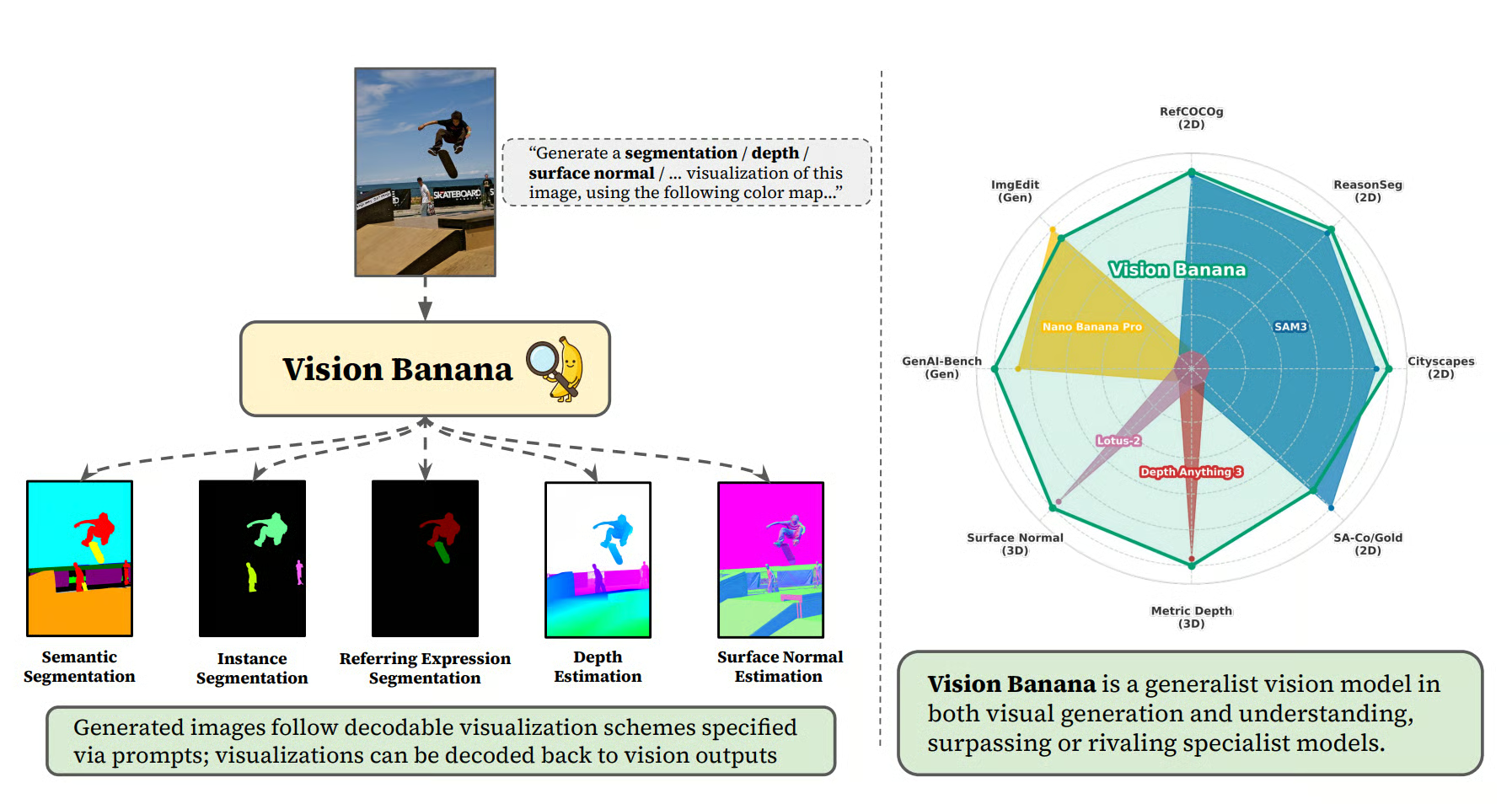

その前提を打ち破ろうとしているのが、Google DeepMind の Vision Banana です。論文は、画像生成モデルはすでに汎用ビジョンモデルに必要なすべて(セグメンテーション、深度、サーフェス法線など)を学んでおり、欠けているのは、そうした潜在能力をベンチマークで測定可能にする薄い指示チューニング層だけだと主張します。

本稿では、まず Vision Banana の正体と注目を集める理由を述べ、その後に仕組みを解説します。最後に、うまくいく点・そうでない点・実務家が持ち帰るべき示唆をまとめます。読み進める中で、筆者が論文を読んで抱いた疑問も併せて提示します。同じ疑問を持つ読者は多いはずです。

注記:Vision Banana 自体は公開されていません。公開されているのは 論文 とプロジェクトページです。ベースモデルは Nano Banana Pro を用いており、Gemini API と Google AI Studio から利用可能です。

Vision Banana とは?

Vision Banana は Google DeepMind の研究モデルで、Nano Banana Pro(テキストから画像の生成器)に対し、元の学習データと少量のコンピュータビジョンタスク用データを混ぜた軽量な指示チューニングを施して作られています。

図1:Nano Banana Pro の指示チューニングによる画像生成器の潜在的な視覚理解能力の顕在化(出典)

レシピは次のとおりです。

- ベースモデルのアーキテクチャは変更しない

- セグメンテーション・深度・サーフェス法線のデータを低比率で学習分布に混ぜる

- 指示チューニングを行う

学習手法全体に新しいアーキテクチャやカスタムヘッド、補助損失、専用デコーダは不要です。

得られたモデルは次を達成します。

- 3つのセグメンテーションベンチマークで SAM 3 を上回る

- メトリック深度推定で Depth Anything V3 を上回る

- サーフェス法線推定で Lotus-2 を上回る

- ベースモデルの画像生成品質を保持(GenAI-Bench と ImgEdit で統計的には同等)

これらはすべて厳密なゼロショット転移プロトコルの下で達成されており、評価に用いたベンチマークの学習分割をモデルが一度も見ていないことを保証しています。

なぜ重要か?

視覚表現学習は、これまで多様な事前学習目標を試してきました。一般的なものは次のとおりです。

重要なのは、どれも生成的ではないという点です。画像生成は歴史的に下流の能力とみなされ、理解の土台とは見なされてきませんでした。初期の生成的事前学習(iGPT、LVM)は、表現品質のベンチマークでコントラスト法に一貫して劣っていました。

一方、言語では次トークン予測による生成的自己回帰目標のスケーリングが、GPT-3 のようなモデルにゼロショットの汎用能力をもたらしました。複雑な下流挙動が高次元の重み空間に潜在していることがわかり、軽量な教師あり微調整や指示整合で表面化されました。例としては以下があります。

- ニューラル機械翻訳

- 多言語コード生成

- 抽象的要約

- 算術的推論

Vision Banana は、ビジョン分野でも同じ局面に来ていると論じます。論文は、画像生成による事前学習と言語モデルの事前学習、指示チューニングとアライメント工程を明確に類比しています。

この類比が成り立つなら、タスク固有のパイプライン構築をやめ、単一の大規模画像生成器を基盤層として、プロンプトでタスクを指定するようになるでしょう。

Vision Banana はどう動くのか?

仕組みは単純です。すべてのビジョンタスクを「所定の性質を持つ RGB 画像を生成せよ」として再定式化し、デコード時にその RGB 画像を決定的にタスクの予測へ戻します。

各タスクの写像は次のとおりです。

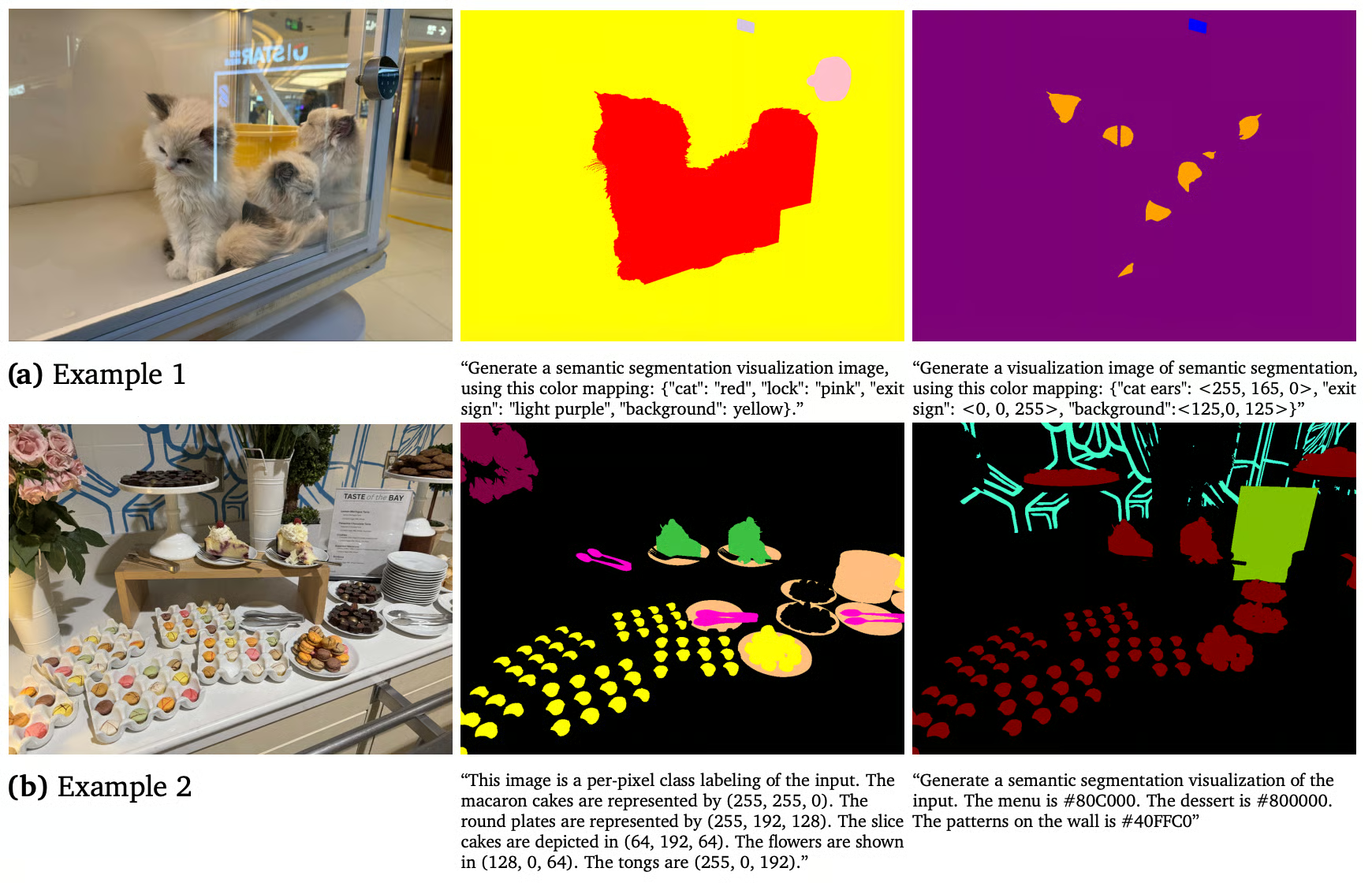

セマンティックセグメンテーション

クラスごとの色割り当てをプロンプトで与え、デコード時にピクセルを指定色に最も近い色へクラスタリングします。語彙はプロンプトに書いたとおりで、設計的にオープンボキャブラリです。

例を見るとより明確になります。論文のプロンプト例は以下です。

This image is a per-pixel class labeling of the input. The macaron cakes are represented by (255, 255, 0). The round plates are represented by (255, 192, 128). The slice cakes are depicted in (64, 192, 64). The flowers are shown in (128, 0, 64). The tongs are (255, 0, 192).

図2:セマンティックセグメンテーション(出典)

インスタンスセグメンテーション

インスタンスセグメンテーションはセマンティックより難しく、インスタンス数は事前に分かりません。そのため色を事前割り当てできません。

Vision Banana の解法は、推論あたり1クラスずつ処理し、モデルにインスタンスごとに異なる色を動的に割り当てさせ、デコード時に色のモードへピクセルをクラスタリングすることです。

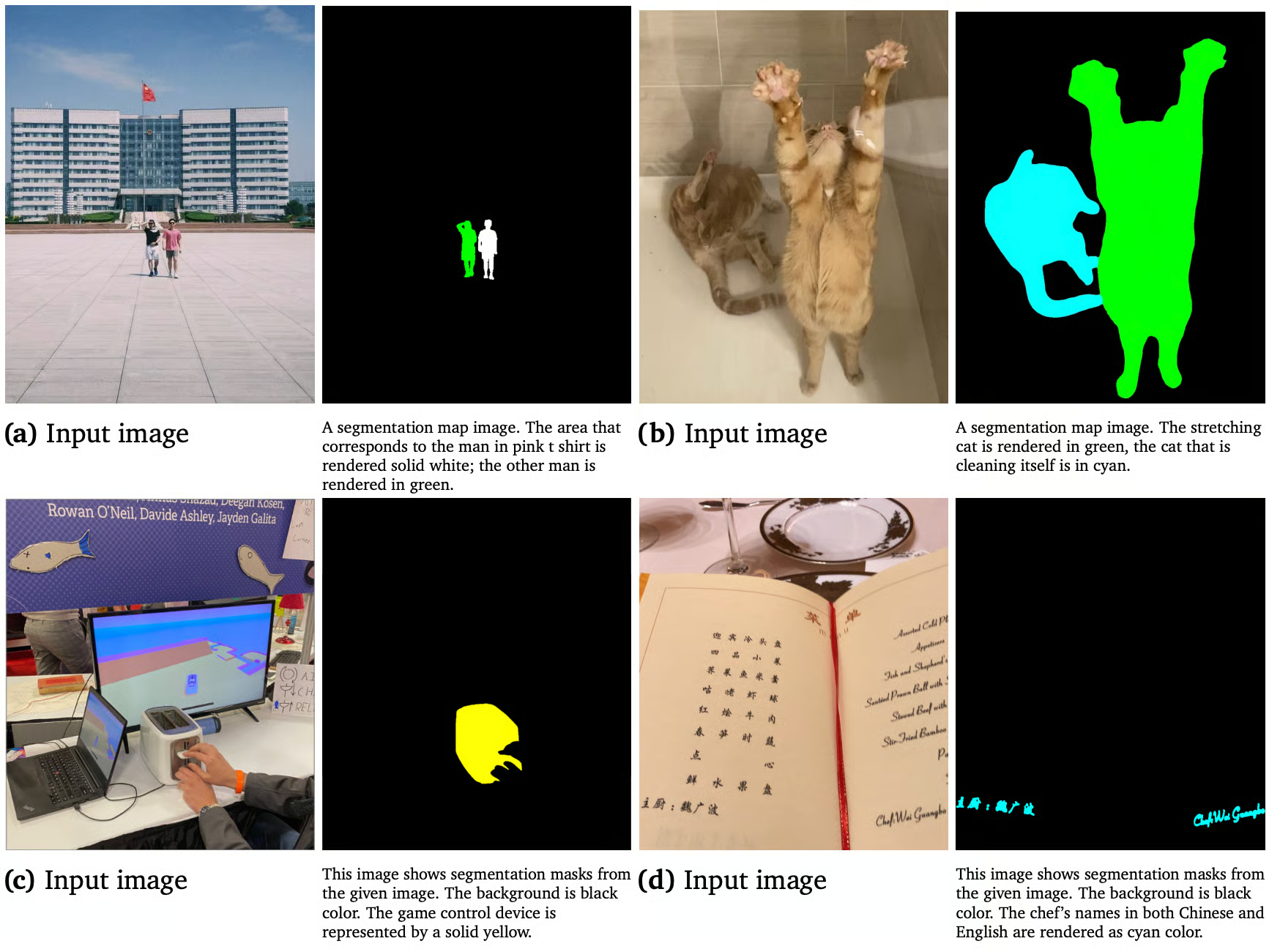

表現セグメンテーション

Vision Banana は、セグメント対象の自然言語説明を含むプロンプトを受け取り、マスクを返せます。論文のプロンプト例は以下です。

A segmentation map image. The stretching cat is rendered in green, the cat that is cleaning itself is in cyan.ここで生きるのが、生成的事前学習に組み込まれたマルチモーダル推論です。識別モデルは参照表現を苦手としますが、これは言語と視覚の結合推論を要するためです。何十億ものキャプションと画像のペアで学習した生成モデルは、これを自然に扱えます。

図3:Vision Banana は自然言語のプロンプトを理解し、それに基づいて推論できる(出典)

深度とサーフェス法線

深度とサーフェス法線はいずれも双方向写像で RGB 空間に投影し、変換時に潜在的な幾何特性が情報損失ゼロで保存されるようにします。次節で深度から RGB へのエンコードの詳細を分解します。

この統一的な推論パラダイムでは、すべてのコンピュータビジョンタスクを決定的な画像生成問題として扱います。パイプライン全体で一貫した RGB インターフェースを保つことで、タスク固有の分岐を避け、出力の意味付けを完全にプロンプト駆動の条件付けに委ねます。

では、深度をもう少し詳しく見ていきましょう。 この手法全体が最も破綻しやすい箇所でもあります。

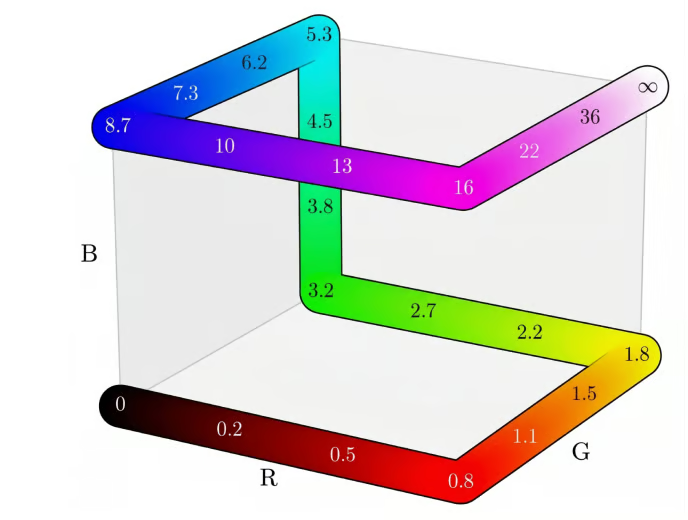

無界な深度を RGB にエンコードする

エンコードが全単射でないと、デコード時にメートル単位の距離を復元できず、「画像生成を普遍インターフェースに」という主張が崩れてしまいます。これはアプローチが原理的なのか場当たり的なのかを見極める指標でもあります。

問題は、深度は [0, ∞) の無界な実数である一方、RGB は [0, 1] に有界だという点です。したがって「深度マップを生成せよ」を学習信号として使うには、各メトリック深度が正確に1つの RGB 値に対応し、デコード時にメートルへ反転できる全単射が必要です。

Vision Banana の手法は2段階です。

段階1:無界な深度を [0, 1) に圧縮

著者らは Barron(2025)のべき変換 を shape パラメータ λ = -3 で用い、近距離に遠距離より高い分解能を与えます。2メートル先の物体は200メートル先より高精度になります。多くの用途が重視するのは遠景ではなく把持可能な近接物体であるという実情に合致します。

段階2:[0, 1) を RGB 立方体の稜線へマッピング

次に、RGB 立方体の稜線をなぞる区分的線形の経路に沿って補間します。実質的には 3D ヒルベルト曲線の初回反復で、滑らかで知覚的に妥当な色遷移が得られ、どの色がどの深度に対応するか曖昧さがありません。

両段階が厳密に可逆であるため、合成も全単射になります。RGB にエンコードした正解で学習し、推論時は予測 RGB を最も近い稜線へ射影してメートルに反転します。

図4:スカラーのメートル距離 𝑑 ≥ 0 と RGB 値の全単射の可視化(出典)

堅牢性のため、学習時に Plasma、Inferno、Viridis、グレースケールといった代替カラーマップで拡張し、プロンプトでどの可視化スタイルを求められても対応できるようにしています。

サーフェス法線は容易です。すでに [-1, 1] の単位ベクトルであり、標準的なカメラ座標系(+x 右、+y 上、+z 画像面外向き)で直接 RGB にマップできます。淡い緑は上向き、赤みがかったピンクは左向き、薄い青/紫はカメラ正面を意味します。ワープは不要です。

注: Vision Banana は カメラ内部パラメータを学習・推論のいずれでも一切使用しません。多くの SOTA 深度法(Depth Anything V3、MoGe-2、UniK3D、DepthLM)は、単眼スケールの曖昧さ解消のためにどこかで内部パラメータを使います。

Vision Banana が視覚的事前知識だけで絶対スケールを推定し、なおかつ勝っていることは、生成的事前学習が幾何をきちんと捉えており、学習時に見た可視化のパターン照合にとどまらないことを示す強い根拠です。

特化モデル vs Vision Banana:比較

違いを最もすっきり理解するには、単一タスクで両パラダイムを直接比べるのがよいでしょう。ここでは深度推定を、特化型(Marigold、Lotus、Depth Anything V3)と Vision Banana で比較します。

両パラダイムは生成するアーティファクトが異なります。Marigold は専用ツールであり、Vision Banana は単一の学習工程から幅広さを得た汎用モデルです。

この違いは、実運用での使い方にも波及します。

|

観点 |

特化型(Marigold 方式) |

Vision Banana |

|

出力形式 |

タスク固有テンソル |

RGB 画像 |

|

語彙 |

学習時に固定 |

プロンプトで定義 |

|

マルチタスク |

タスクごとに別モデル |

1モデルで多タスク |

|

カメラ内部パラメータ |

必要な場合が多い |

不使用 |

|

生成能力 |

微調整で喪失 |

保持 |

|

推論コスト |

低い |

高い(フル画像生成器) |

ベンチマークは、明確な勝利と率直な敗北が混在しています。すべてゼロショット転移、すなわち評価ベンチマークの学習分割をモデルが見ていない条件です。

優れたパフォーマンス:

- セマンティックセグメンテーション(Cityscapes):平均 IoU(mIoU)0.699 を達成し、特化型のSegment Anything Model(SAM 3)の 0.652 を上回った。

- 参照セグメンテーション(RefCOCOg):累積 IoU(cIoU)0.738 を示し、SAM 3 Agent の 0.734 を上回った。

- 複雑な視覚推論(ReasonSeg):Gemini 2.5 Pro と併用時に gIoU 0.793 を達成。SAM 3 Agent の 0.770 を上回り、ゼロショットで最新 SOTA を樹立(非ゼロショットの完全教師あり法に対しても優位)。

- メトリック深度推定:4つの多様なデータセットで平均

δ(しきい値精度)0.929 を記録し、Depth Anything V3 の 0.918 を上回った。 - サーフェス法線推定:屋内3データセット平均で平均角度誤差 15.549° と低く、Lotus-2(16.558°)よりも高い幾何忠実度を示した。

不利な点:

- インスタンスセグメンテーション(SA-Co/Gold):500 クエリのサンプル評価で pmF1 が 0.540。非ゼロショットの SAM 3(0.661)には及ばず、ゼロショットの DINO-X(0.552)と同程度。インスタンス数の離散的な色割り当てという制約が、極めて高密度なシーンで解像度を制限することが要因と考えられる。

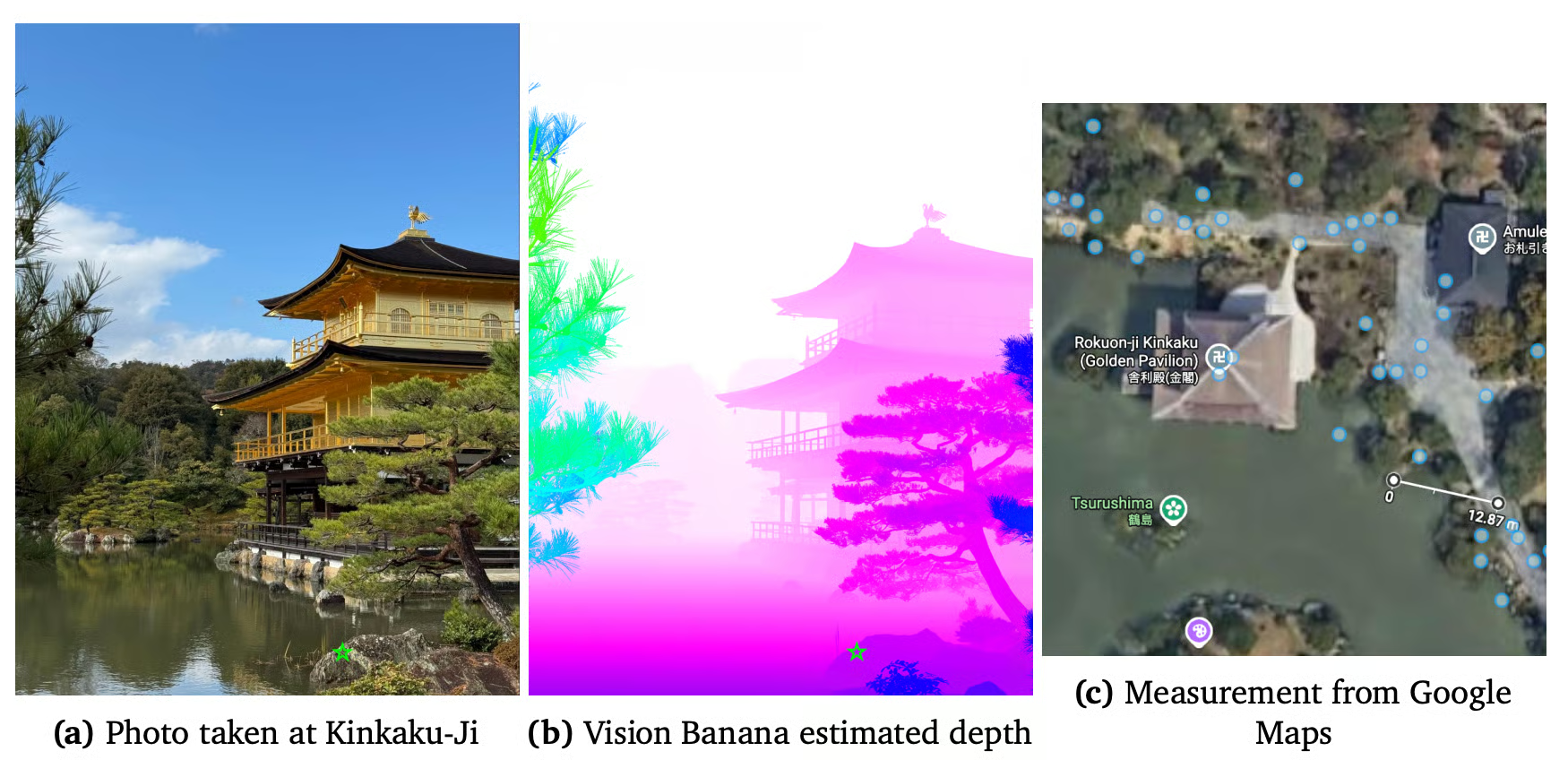

GenAI-Bench では、Vision Banana はベースの Nano Banana Pro に対する人間比較で 53.5% 勝利しました。以下は論文の野外グラウンディングテストの例です。

図5:Vision Banana の深度推定(出典)

著者の一人が金閣寺付近でスマホ写真を撮影。Vision Banana は特定点を 13.71 m と予測。Google マップは 12.87 m で、キャリブレーション・内部パラメータ・特別なセットアップなしのスマホ写真で絶対相対誤差 6.5%。これはベンチマーク数値よりもデプロイ時の挙動をよく示唆するテストと言えます。

Vision Banana の制約

Vision Banana には留意すべき4つの制約があります。

- コスト:Nano Banana Pro 規模のモデルを毎回の推論で回すのは、蒸留済みの深度特化モデルに比べて桁違いに高価です。論文の将来課題でも明言されています。1万フレーム規模の動画では、現状この手法は経済性で不利です。小型特化モデルへの蒸留が当然の次の一手です。

- インスタンスが多いシーン:SA-Co/Gold は明確な敗北。多数の小物体を厳密にカウントする場面では、クラス別の色割り当てに限界があります。ここは依然として SAM 3 が優位です。

- 単一画像:現行実装は本質的に静的な単一視点入力に制約され、時空間・多視点処理はできません。時系列推論は将来課題とされています。

- ブラックボックス運用:モデルの内部を観察・改変・私的運用することはできません。規制産業や IP センシティブな文脈では、フロンティア API を使えないケースがあります。

まとめ

Vision Banana は、画像生成器がすでに視覚理解の重荷を担っており、その能力を引き出すのに必要なのは新規アーキテクチャではなくアライメントであることを、具体的に示しました。

論文の具体的貢献は以下です。

- 深度とセグメンテーションを可逆な画像生成問題にする全単射な RGB エンコード

- 生成の事前分布を損なわずに視覚スキルを付与する軽量な指示チューニング手法

- 内部パラメータなしのメトリック深度推定で、内部パラメータを要する特化モデルを上回ること

- 汎用性の主張を標準ベンチマークで測定可能にする厳密なゼロショット転移プロトコル

また、プロンプトでタスクを指定し、出力を RGB 画像からデコードする「生成ファースト」の思考様式を推し進め、同一の重みがビジュアルの生成と解釈を兼ねる姿を提示しています。

プロジェクトページのプロンプトを、ベースの Nano Banana Pro や Nano Banana 2 にそのまま投げて、指示チューニングなしでどこまでできるかを試し、カスタムパイプラインの学習に直行する代わりに、NBP クラスのモデルとマルチモーダル LLM ルータで推論セグメンテーション機能を構築するのも一手です。

Vision Banana よくある質問

Vision Banana を今日使うには?

いいえ。公開されているのは論文とプロジェクトページのみで、モデル重みは Google DeepMind が保有しています。ベースモデルの Nano Banana Pro は Gemini API と AI Studio で利用可能で、論文の主張どおり、プロジェクトページのプロンプトをそのまま NBP に与えるだけでも有意味な結果が得られるはずです。

Vision Banana は SAM 3 や Depth Anything の代わりになる?

現時点では難しく、その主因はコストです。大規模に安価な推論が必要な用途(動画、リアルタイム、モバイル)では、経済性の面で特化モデルが優勢です。

GPT-5V や Gemini 2.5 のような MLLM と比べると?

マルチモーダル LLM は画像を入力してテキストを出力します。Vision Banana は画像とプロンプトを入力して画像を出力します。解いている問題が異なります。

なぜ深度でカメラ内部パラメータを使わないの?

多くの特化モデルは、単眼スケールの曖昧さ(近くの小物体と遠くの大物体が同じ見え方をする)を解くために内部パラメータを使います。一方で Vision Banana は、生成的事前学習で得た物体サイズ・シーン文脈・世界知識といった視覚的事前情報からスケールを推定します。