Programa

Os sistemas operacionais (SO) tradicionais, como Windows, macOS e Linux, há muito tempo dominam o cenário da computação. No entanto, imagine um cenário em que você digita "Organize minha área de trabalho desorganizada e defina um papel de parede relaxante" e isso acontece em segundos.

Esse futuro não está longe, graças ao desenvolvimento de sistemas operacionais de modelo de linguagem grande (LLM OS).

Diferentemente dos sistemas operacionais tradicionais, que dependem de comandos predefinidos e interfaces gráficas, um sistema operacional LLM é centrado em um modelo de IA que pode ser usado para criar um sistema operacional. modelo de IA que interpreta e executa comandos com base em linguagem natural.

Essa mudança de paradigma é um movimento em direção a um modelo de interação mais conversacional e intuitivo, em que o sistema operacional se torna mais um assistente inteligente do que uma ferramenta que exige entrada manual constante. Como resultado, os computadores se tornarão mais acessíveis a um público mais amplo, independentemente de sua proficiência técnica.

Neste artigo, você aprenderá sobre o que é um LLM são, como eles diferem dos sistemas tradicionais, os marcos que moldaram seu desenvolvimento e os desafios e considerações éticas que acompanham sua adoção.

Desenvolver aplicativos de IA

O que são sistemas operacionais LLM?

Um sistema operacional LLM (LLM OS) representa uma evolução significativa na forma como os computadores funcionam, passando de sistemas tradicionais e rigidamente estruturados para ambientes mais fluidos e orientados por IA.

Basicamente, um sistema operacional LLM é um sistema operacional em que as principais funcionalidades, como interação com o usuário, gerenciamento de tarefas e controle do sistema, são alimentadas por um LLM.

Isso significa que, em vez de interagir com o computador por meio de comandos ou menus predefinidos, você interage por meio de linguagem natural. Você pode falar ou digitar instruções em linguagem cotidiana, e o LLM interpreta essas instruções para executar tarefas, gerenciar aplicativos e até mesmo automatizar fluxos de trabalho complexos.

Por exemplo, você poderia dizer: "Instale a versão mais recente do Photoshop", e o LLM cuidaria de todo o processo, incluindo a localização do software, o download e a configuração correta.

Principais características do sistema operacional LLM

Vamos explorar mais detalhadamente as principais características de um sistema operacional LLM.

Interface de linguagem natural

O recurso mais importante de um sistema operacional LLM é sua capacidade de entender e executar comandos fornecidos em linguagem natural. Isso significa que, em vez de precisar conhecer comandos específicos ou navegar por menus complexos, os usuários podem simplesmente instruir o sistema da mesma forma que falariam com outra pessoa.

Exemplo: Se quiser enviar um e-mail, em vez de abrir um cliente de e-mail e digitar tudo manualmente, você pode simplesmente dizer: "Envie um e-mail para John dizendo que chegarei atrasado à reunião", e o sistema cuidará do resto.

Execução de tarefas orientada por IA

O LLM não apenas interpreta o que você pede para ele fazer, mas também decide a melhor maneira de executar essas tarefas. Isso envolve a compreensão do contexto, o gerenciamento de recursos e a possível manipulação de vários aplicativos para alcançar o resultado desejado.

Exemplo: Uma solicitação como "Organize todos os meus arquivos por projeto e envie os últimos rascunhos para a equipe" pode envolver a classificação de arquivos, a criação de pastas, a seleção de documentos relevantes e o envio de e-mails - todas as tarefas gerenciadas sem problemas pelo sistema operacional do LLM.

Adaptabilidade e flexibilidade

Ao contrário dos sistemas tradicionais, que exigem personalização manual e têm adaptabilidade limitada, um sistema operacional LLM pode aprender com suas interações e ajustar seu comportamento para melhor atender às suas preferências e fluxos de trabalho. Com o tempo, ele se torna mais alinhado às suas necessidades, oferecendo sugestões e automatizando tarefas repetitivas sem instruções explícitas.

Exemplo: Se você trabalha com frequência em relatórios todas as segundas-feiras, o sistema operacional do LLM poderá começar a preparar rascunhos de relatórios para você automaticamente, com base nos dados e formatos que você usou no passado.

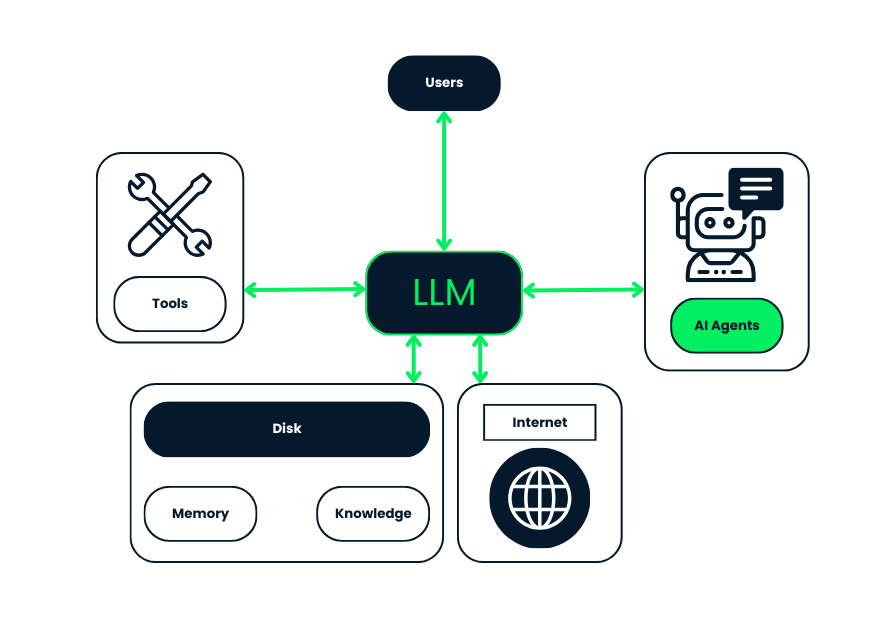

Este diagrama ilustra a arquitetura de um sistema operacional LLM, mostrando como os diferentes componentes interagem dentro do sistema.

- LLM: Ele funciona como o mecanismo principal do sistema. Ele processa e compreende entradas de linguagem natural, dando ao sistema operacional a capacidade de interpretar comandos do usuário, gerenciar tarefas e se comunicar com outros componentes.

- Usuários: Eles podem interagir com o sistema por meio de comandos de linguagem natural. O LLM interpreta essas entradas para executar tarefas.

- Ferramentas: O sistema operacional do LLM integra-se a várias ferramentas e aplicativos de software, que ele pode acessar para executar tarefas específicas. O LLM coordena-se com essas ferramentas para executar as instruções do usuário de forma eficiente.

- Agentes de IA: Eles podem lidar com tarefas específicas de forma autônoma. O LLM se comunica com esses agentes de IA para delegar tarefas ou coletar informações, melhorando a funcionalidade geral e a capacidade de resposta do sistema.

- Disco: Essa parte do sistema são os recursos de armazenamento, incluindo memória e bases de conhecimento. O LLM acessa esses recursos para manter o contexto, recuperar informações e aprender com as interações anteriores, melhorando suas respostas ao longo do tempo.

- Internet: O acesso do sistema à Internet permite que o LLM pesquise informações, execute tarefas que exijam conectividade on-line e integre dados e recursos externos em suas operações.

Na próxima seção, exploraremos como os sistemas operacionais LLM diferem dos sistemas operacionais tradicionais, aprofundando-nos em seus paradigmas de interação e recursos de execução de tarefas exclusivos.

LLM OS vs. LLM OS. Sistema operacional tradicional

Os sistemas operacionais LLM diferem dos tradicionais em três áreas principais: paradigma de interação, execução de tarefas e adaptabilidade.

Paradigma de interação

A diferença mais significativa entre um SO LLM e os sistemas operacionais tradicionais está no paradigma de interação. Os sistemas operacionais tradicionais, como Windows, macOS e Linux, dependem de GUIs e CLIs para facilitar a interação do usuário. Normalmente, os usuários interagem com esses sistemas clicando em ícones, navegando em menus ou inserindo comandos específicos por meio de um terminal.

Um sistema operacional LLM introduz uma interface de linguagem natural no núcleo do sistema, permitindo que os usuários interajam por meio de comandos de conversação.

Isso significa que você pode simplesmente instruir o sistema usando a linguagem cotidiana - como dizer a ele para "criar um novo documento e resumir as últimas anotações da reunião" - e o LLM OS entenderá e executará esses comandos sem precisar abrir aplicativos específicos ou seguir uma série de etapas manuais. O sistema orientado por IA interpreta a intenção por trás das palavras do usuário e executa as ações apropriadas.

Execução de tarefas

Nos sistemas operacionais tradicionais, a execução de tarefas é normalmente linear e compartimentada. Os usuários executam tarefas abrindo aplicativos específicos projetados para determinadas funções (por exemplo, usar um processador de texto para escrever, um navegador para acessar a Internet). Cada tarefa requer instruções explícitas e navegação manual pelo sistema operacional.

Os sistemas operacionais LLM lidam com tarefas de forma mais integrada e fluida. O LLM interpreta solicitações complexas do usuário e pode executar várias tarefas relacionadas simultaneamente ou em sequência, sem exigir que o usuário gerencie cada etapa individualmente.

Por exemplo, em vez de abrir separadamente uma planilha, um cliente de e-mail e um aplicativo de calendário para organizar um projeto, você poderia simplesmente pedir ao LLM OS para "preparar o orçamento do projeto, agendar uma reunião de equipe e enviar a agenda", e ele executaria todas essas tarefas em segundo plano, coordenando entre diferentes ferramentas conforme necessário.

Adaptabilidade

Os sistemas operacionais tradicionais oferecem opções de personalização, mas elas geralmente são estáticas e exigem entrada manual. Por exemplo, os usuários podem alterar o layout da área de trabalho, personalizar temas ou instalar softwares específicos, mas o sistema operacional em si não se adapta inerentemente ao comportamento do usuário ao longo do tempo.

Em um sistema operacional LLM, a adaptabilidade é um recurso essencial. O sistema aprende com cada interação, compreendendo gradualmente as preferências, as rotinas e os padrões de fluxo de trabalho do usuário. Esse processo de aprendizado contínuo permite que o sistema operacional LLM ofereça sugestões cada vez mais personalizadas e automatize tarefas repetitivas sem a necessidade de comandos explícitos do usuário.

Vamos resumir o que abordamos nesta seção:

|

Aspecto |

Sistema operacional tradicional |

LLM OS |

|

Paradigma de interação |

Os usuários interagem por meio de GUIs e CLIs, usando ícones, menus e linhas de comando. |

Os usuários interagem por meio de linguagem natural, dando comandos por meio de conversas. |

|

Execução de tarefas |

As tarefas são executadas linearmente e exigem instruções explícitas em aplicativos específicos. |

As tarefas são gerenciadas em conjunto, com o LLM lidando com várias tarefas relacionadas ao mesmo tempo ou uma após a outra, sem a necessidade de instruções detalhadas. |

|

Adaptabilidade |

A personalização é possível, mas estática, exigindo entrada e configuração manuais. |

O sistema aprende e se adapta ao longo do tempo, oferecendo sugestões personalizadas e automatizando tarefas repetitivas com base no comportamento do usuário. |

Na próxima seção, exploraremos os principais marcos no desenvolvimento dos sistemas operacionais LLM, destacando alguns dos projetos pioneiros e suas contribuições para esse campo.

Do AIOS ao MemGPT: Principais marcos no desenvolvimento do sistema operacional do LLM

O desenvolvimento do sistema operacional LLM foi caracterizado por vários marcos importantes que fizeram com que esses sistemas avançassem significativamente. Veja a seguir alguns dos principais projetos e inovações que contribuíram para a evolução do sistema operacional LLM.

AIOS: Pioneirismo no conceito

AIOS (AI Operating System) é uma das primeiras tentativas de integrar grandes modelos de linguagem ao núcleo de um sistema operacional. Desenvolvido como um projeto de pesquisa, o AIOS foi projetado para demonstrar como os LLMs poderiam funcionar como o cérebro de um sistema operacional, lidando com tarefas que normalmente exigem intervenção humana ou instruções pré-programadas.

O AIOS se concentra na incorporação de LLMs diretamente no kernel do sistema operacional, permitindo que eles gerenciem recursos, executem comandos e interajam com aplicativos de forma mais inteligente.

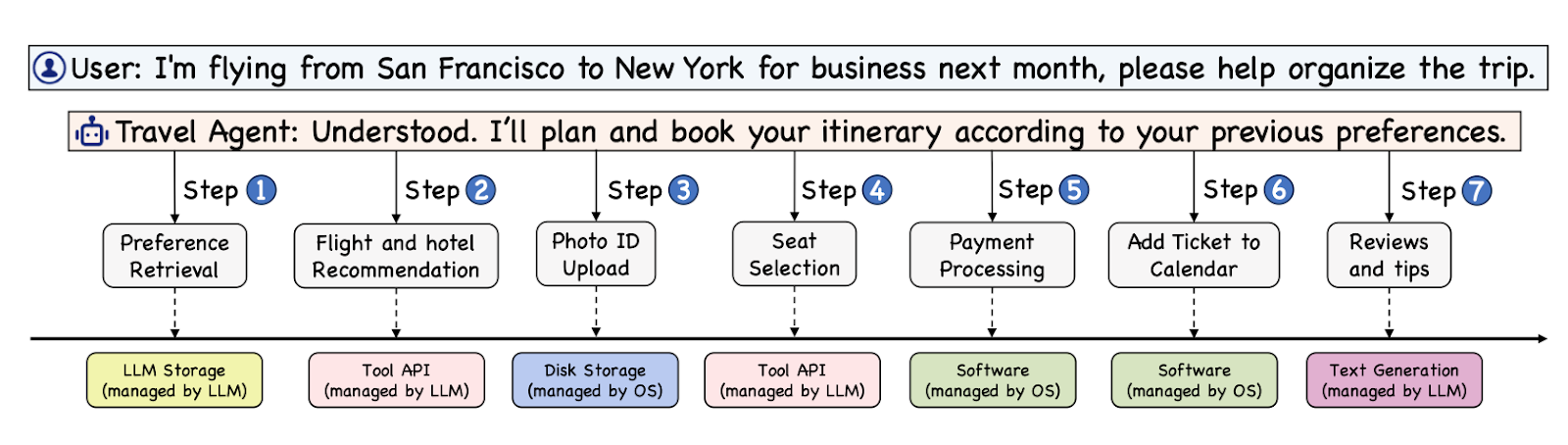

Exemplo ilustrativo extraído do documento de pesquisa original pesquisa original.

Um dos recursos de destaque do AIOS é o kernel específico para LLM, que é otimizado para lidar com as demandas exclusivas das tarefas baseadas em LLM, como priorizar solicitações de agentes e gerenciar a memória de forma eficiente. O sistema foi projetado para lidar com as complexidades da execução simultânea de vários agentes LLM, garantindo uma operação tranquila sem os gargalos típicos associados a tarefas computacionais de alta demanda.

Você pode saber mais sobre ele aqui.

BabyAGI: O agente autônomo

O BabyAGI é outro projeto importante no desenvolvimento do LLM OS, introduzindo o conceito de agentes autônomos alimentados por LLMs. Esse sistema amplia os recursos dos LLMs, permitindo que eles executem tarefas de forma autônoma, como navegar na Web, coletar informações e executar processos de várias etapas sem a entrada contínua do usuário.

Logotipo da BabyAGI.

A importância do BabyAGI está em sua capacidade de automatizar fluxos de trabalho e processos de tomada de decisão. Por exemplo, um usuário pode instruir a BabyAGI a pesquisar as melhores opções de viagem e reservar um voo, e o sistema cuidaria autonomamente de cada etapa - desde a pesquisa de voos até a conclusão do processo de reserva.

Você pode saber mais sobre ele aqui.

MemGPT: Preenchendo a lacuna entre memória e inteligência

O MemGPT representa um avanço mais recente no desenvolvimento de sistemas operacionais LLM, concentrando-se na integração da memória de longo prazo e em recursos de raciocínio aprimorados em sistemas orientados por LLM. Um dos desafios dos LLMs tradicionais são suas janelas de contexto limitadas, que restringem a quantidade de informações que eles podem processar de uma só vez. O MemGPT resolve isso introduzindo uma arquitetura de memória multinível que imita as técnicas tradicionais de gerenciamento de memória do sistema operacional, como a memória virtual.

Logotipo do MemGPT.

A arquitetura do MemGPT inclui um "contexto principal" (análogo à RAM) e um "contexto externo" (semelhante ao armazenamento em disco), permitindo que o sistema gerencie conjuntos de dados maiores e mantenha o contexto em interações mais longas. Isso é particularmente útil em aplicativos que exigem conversas contínuas e com reconhecimento de contexto ou análise detalhada de documentos.

Você pode saber mais sobre ele aqui.

Na próxima seção, exploraremos o potencial dos sistemas operacionais LLM, discutindo como esses sistemas podem transformar a produtividade, a acessibilidade e as experiências do usuário.

Desafios e limitações da adoção do sistema operacional LLM

Os sistemas operacionais LLM trazem possibilidades interessantes de maneiras mais naturais e poderosas de interagir com a tecnologia. No entanto, há desafios importantes que precisam ser resolvidos antes que esses sistemas possam ser amplamente utilizados. Esses desafios, inclusive técnicos, éticoséticos e práticas e práticas, influenciam a eficácia e a viabilidade do sistema operacional LLM em diferentes cenários.

Confiabilidade e segurança

Uma das maiores preocupações com os sistemas operacionais LLM é garantir que seus resultados sejam confiáveis e seguros. Às vezes, os LLMs podem gerar informações incorretas ou enganosas que parecem confiáveis, mas que são factualmente erradas ou não fazem sentido.

Em um sistema operacional, esses erros podem causar sérios problemas, especialmente se o LLM interpretar mal os comandos ou fornecer informações incorretas durante tarefas importantes, como transações financeiras ou processamento de dados médicos. Garantir que os sistemas operacionais de LLM consigam distinguir consistentemente entre informações precisas e imprecisas e fazer escolhas seguras é um grande desafio.

Desempenho e eficiência

O desempenho dos LLMs é uma preocupação fundamental, especialmente quando se trata de responder em tempo real. Esses modelos exigem uma poder computacionalespecialmente ao lidar com comandos complexos ou grandes quantidades de dados.

Essa demanda pode levar a atrasos, nos quais o sistema leva mais tempo do que o esperado para responder, afetando negativamente a experiência do usuário. Além disso, o alto consumo de energia necessário para os LLMs gera preocupações ambientais. Garantir que o sistema operacional LLM possa ser dimensionado para suportar vários usuários e tarefas simultaneamente sem grandes quedas no desempenho é o foco principal da pesquisa e do desenvolvimento em andamento.

Privacidade e segurança

Privacidade e segurança são cruciais em qualquer sistema operacional, e o LLM OS enfrenta desafios específicos nessas áreas. Esses sistemas geralmente precisam de acesso a grandes quantidades de dados pessoais e confidenciais para operar com eficiência.

É essencial proteger esses dados contra acesso não autorizado e evitar que o LLM vaze acidentalmente informações confidenciais. Além disso, como os LLMs podem ser vulneráveis a ataques em que entradas mal-intencionadas manipulam a saída do modelo, você pode desenvolver defesas sólidas para que os LLMs possam ser usados para proteger o modelo, desenvolver defesas fortes contra essas ameaças é muito importante.

Considerações éticas e legais

A implantação do sistema operacional LLM também levanta questões éticas e questões legaisparticularmente com relação a preconceitos e propriedade intelectual.

Os LLMs podem propagar involuntariamente vieses presentes em seus dados de treinamento, levando a resultados discriminatórios ou injustos. Além disso, como os LLMs são treinados em vastos conjuntos de dados que podem incluir conteúdo protegido por direitos autorais, seu uso em um ambiente de sistema operacional pode levar a desafios legais relacionados a direitos de propriedade intelectual. A abordagem desses desafios éticos e legais é importante para a adoção responsável do sistema operacional LLM.

O futuro dos sistemas operacionais LLM

O futuro dos sistemas operacionais LLM está definido para redefinir a forma como interagimos com a tecnologia. Aqui está o que você pode esperar à medida que esses sistemas evoluem.

Expansão dos recursos do LLM

À medida que os LLMs se tornarem mais avançados, eles provavelmente serão integrados aos sistemas operacionais de forma que possam lidar com tarefas cada vez mais complexas. Esses sistemas podem gerenciar tudo, desde interações básicas com o usuário até operações mais sofisticadas, como criação automatizada de conteúdo, análise de dados e até mesmo tomada de decisões estratégicas.

Essa expansão de recursos permitirá que o LLM OS funcione como assistentes avançados que não apenas executam comandos, mas também fornecem ótimas percepções e recomendações com base em grandes conjuntos de dados.

Modelos especializados e menores

Além dos avanços no sistema operacional LLM, também estamos observando uma tendência para o desenvolvimento de modelos de linguagem pequenos (SLMs). Esses modelos são mais eficientes e podem ser implantados em dispositivos de borda com poder de processamento limitadocomo smartphones ou dispositivos de IoT.

Os SLMs oferecem a vantagem de serem mais especializados, permitindo soluções personalizadas que são mais adequadas a tarefas ou setores específicos. Isso pode levar a uma abordagem mais descentralizada da IA, em que diferentes modelos gerenciam vários aspectos de um sistema operacional, todos trabalhando juntos para proporcionar uma experiência de usuário unificada e tranquila.

Impacto nos negócios e na produtividade

A integração do LLM OS em ambientes de negócios deverá gerar ganhos significativos de produtividade. Esses sistemas podem automatizar tarefas de rotina, melhorar as operações e fornecer insights orientados por dados em tempo real, permitindo que as empresas operem com mais eficiência e tomem decisões mais bem informadas.

À medida que os LLMs continuarem a melhorar em áreas como compreensão de contexto e processamento de linguagem natural, sua função na estratégia de negócios e nas interações com os clientes provavelmente se tornará ainda mais proeminente, transformando os modelos de negócios e os fluxos de trabalho tradicionais.

Conclusão

O desenvolvimento de sistemas operacionais LLM representa uma evolução significativa na forma como interagimos com a tecnologia, marcando uma mudança em direção a sistemas mais intuitivos, eficientes e adaptáveis.

Esses sistemas operacionais usam os recursos dos LLMs para oferecer aos usuários uma experiência de computação mais natural e responsiva, transformando os fluxos de trabalho pessoais e profissionais.

Perguntas frequentes

Os sistemas operacionais LLM podem ser executados em dispositivos móveis ou em hardware de baixo consumo de energia?

Sim, os sistemas operacionais LLM podem ser executados em dispositivos móveis e hardware de baixo consumo de energia, mas há desafios. Os avanços recentes permitiram que LLMs menores fossem implantados em dispositivos móveis por meio de aplicativos otimizados, como o MLC LLM, compatível com iOS e Android. No entanto, o desempenho pode ser limitado, especialmente em dispositivos mais antigos. Por exemplo, alguns modelos podem gerar resultados em taxas mais lentas devido à capacidade limitada de processamento disponível nos dispositivos móveis. Há esforços contínuos para otimizar esses sistemas, como o aproveitamento de unidades de processamento dedicadas, como NPUs, em smartphones modernos para melhorar o desempenho.

Como os sistemas operacionais LLM lidam com a privacidade dos dados em comparação com os sistemas operacionais tradicionais?

O LLM OS pode implementar recursos avançados de privacidade, como privacidade diferencial, em que os dados são anonimizados antes do processamento. Esses sistemas também adaptam as configurações de privacidade com base no comportamento do usuário, oferecendo uma abordagem mais dinâmica e proativa para proteger as informações pessoais em comparação com os sistemas operacionais tradicionais. No entanto, esses sistemas também enfrentam desafios, como garantir que a IA não exponha inadvertidamente informações confidenciais por meio de seus resultados, fazendo com que os avanços contínuos na tecnologia de privacidade sejam cruciais para a implantação segura do sistema operacional LLM.

Como um sistema operacional LLM gerencia as atualizações de software e a compatibilidade com os aplicativos existentes?

Os sistemas operacionais LLM gerenciam atualizações e compatibilidade por meio de uma combinação de mecanismos de compatibilidade com versões anteriores e design modular. Esses sistemas estão sendo desenvolvidos para se integrarem perfeitamente aos ambientes de software existentes, permitindo atualizações regulares que aprimoram seus recursos. As camadas ou módulos de compatibilidade garantem que os aplicativos mais antigos ainda possam funcionar em um sistema operacional LLM, mesmo com a evolução dos principais componentes orientados por IA.

Como os sistemas operacionais LLM aproveitam os serviços de nuvem e quais são os benefícios?

Os sistemas operacionais LLM podem usar os serviços de nuvem para aprimorar seus recursos, transferindo tarefas com uso intensivo de recursos, como cálculos complexos e processamento de dados em grande escala, para a infraestrutura baseada em nuvem. Isso permite que o sistema operacional acesse mais potência computacional e armazenamento do que o que pode estar disponível localmente no dispositivo do usuário, possibilitando um desempenho mais suave e a manipulação de conjuntos de dados maiores.

Você pode usar diferentes tipos de LLMs em sistemas operacionais LLM?

Sim, você pode usar diferentes tipos de LLMs em sistemas operacionais LLM, cada um adaptado para tarefas e funcionalidades específicas. Por exemplo. A flexibilidade de integrar diferentes LLMs permite que os sistemas operacionais LLM lidem com uma gama mais ampla de tarefas, desde a criação de conteúdo até a interpretação de dados complexos, usando os pontos fortes de cada tipo de modelo. Essa modularidade permite que o sistema operacional ofereça uma experiência de usuário mais personalizada e eficiente.