Curso

Cursor lanzó Composer 2 el 19 de marzo de 2026, la tercera generación de su modelo propio para programación. El lanzamiento llega solo seis semanas después de Composer 1.5, que multiplicó por 20 el aprendizaje por refuerzo sobre el mismo modelo base sin cambiar la arquitectura. Esa ampliación de RL incluso superó el presupuesto de cómputo del preentrenamiento original, señal de que estaba exprimiendo la base existente al máximo. Composer 2 adopta otra vía: primero continúa el preentrenamiento para reforzar la base y después aplica RL encima. Por eso el salto en benchmarks es tan grande pese al poco tiempo entre versiones.

También llega con una ventana de contexto de 200.000 tokens y dos variantes de precio: Standard a $0.50 por millón de tokens de entrada (aprox. un 86% más barato que Composer 1.5) y Fast para sesiones interactivas en tiempo real.

En este artículo desglosamos qué es Composer 2, cómo se compara con Composer 1.5 en benchmarks y coste, y cómo queda frente a Claude Opus 4.6 y GPT-5.4. También veremos cómo usarlo dentro de Cursor y cuáles son sus limitaciones conocidas.

Si te interesan los modelos punteros con los que compite Composer 2, echa un vistazo a nuestras guías de:

¿Qué es Composer?

Composer es la familia de modelos de IA de programación de Cursor, diseñada para programación agentiva dentro del IDE de Cursor. A diferencia de modelos de propósito general como Claude Opus 4.6 o GPT-5.4, los modelos Composer están hechos específicamente para edición multiarchivo, ejecución de comandos de terminal y refactorización a escala de la base de código. No están pensados para escribir emails, responder trivialidades ni tareas no relacionadas con código.

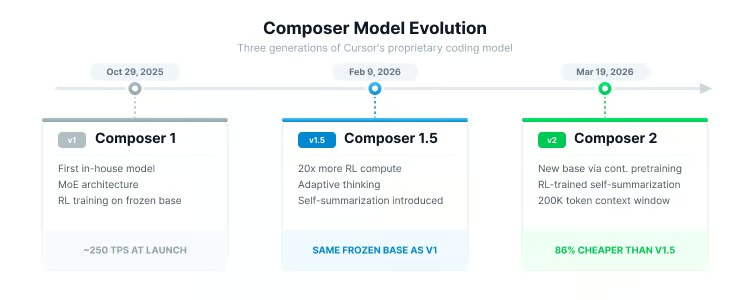

La línea comenzó con un prototipo interno llamado Cheetah, y evolucionó con tres lanzamientos públicos:

|

Modelo |

Fecha de lanzamiento |

Innovación clave |

|

29 de octubre de 2025 |

Primer modelo propio; arquitectura MoE con entrenamiento por RL |

|

|

9 de febrero de 2026 |

20x más cómputo de RL sobre la misma base; razonamiento adaptativo; introducción de auto-resumen |

|

|

Composer 2 |

19 de marzo de 2026 |

Primer ciclo de preentrenamiento continuo creando una nueva base; auto-resumen mejorado; coste muy inferior |

Cada generación se construyó sobre la anterior, pero Composer 2 marca el mayor cambio de arquitectura hasta la fecha.

Visualización de la evolución temporal de los modelos Composer. Imagen del autor.

¿Qué es Composer 2?

Composer 2 es la tercera generación del modelo agentivo de programación de Cursor y el primero de la familia en someterse a preentrenamiento continuo.

Arquitectura y enfoque de entrenamiento

Los Composer anteriores se construían añadiendo aprendizaje por refuerzo a un modelo base congelado. Es como enseñar nuevas habilidades sin mejorar su comprensión de fondo. Composer 2 cambia esto: primero actualiza los pesos fundamentales del modelo base con datos específicos de código y luego aplica RL encima.

El modelo usa una arquitectura Mixture-of-Experts (MoE), lo que significa que solo se activa un subconjunto de parámetros para cada entrada. Así mantiene una inferencia rápida con un conteo total de parámetros elevado. Cursor no ha publicado el número exacto de parámetros.

La identidad del modelo base no se reveló en el lanzamiento, pero se hizo pública el 20 de marzo de 2026, cuando un usuario la encontró en encabezados de solicitudes API. Lee Robinson, VP de Developer Education en Cursor, confirmó que Composer 2 se basa en Kimi K2.5, un modelo de código abierto de Moonshot AI. Señaló que aproximadamente tres cuartas partes del cómputo total provienen del propio entrenamiento de Cursor (preentrenamiento continuo y RL), no del modelo base, lo que explica por qué las evaluaciones difieren de una ejecución de Kimi K2.5 sin ajustes.

Moonshot AI confirmó más tarde el acuerdo como una colaboración comercial autorizada a través de Fireworks AI, que gestionó tanto la infraestructura de RL como la inferencia. El cofundador Aman Sanger dijo que el equipo evaluó varios modelos base con benchmarks basados en perplejidad antes de elegir Kimi K2.5, y describió el entrenamiento posterior como preentrenamiento continuo seguido de una ampliación 4x del cómputo de RL.

La infraestructura de entrenamiento se ejecuta sobre PyTorch y Ray, con kernels de cuantización MXFP8 personalizados optimizados para GPUs NVIDIA Blackwell.

Auto-resumen

El auto-resumen, o lo que Cursor llama "compaction-in-the-loop RL", funciona así: cuando la ventana de contexto de 200.000 tokens empieza a llenarse, el modelo hace una pausa, comprime su propio contexto a unos 1.000 tokens y continúa. Como esta compresión forma parte de la función de recompensa del RL, el modelo aprende qué variables, decisiones de arquitectura y logs de errores conservar y cuáles descartar.

El blog de investigación de Cursor informa de que este enfoque reduce los errores de compactación un 50% frente al resumen por prompt, usando además alrededor de una quinta parte de los tokens. En una demo práctica, Composer 2 resolvió el problema "make-doom-for-mips" de Terminal-Bench 2.0 en 170 turnos, comprimiendo más de 100.000 tokens de contexto en el proceso.

Capacidades principales

Durante una sesión, Composer 2 tiene acceso a:

- Búsqueda semántica en toda la base de código para localizar fragmentos relevantes

- Lectura, edición y creación multiarchivo con precisión a nivel de línea

- Ejecución de comandos de terminal con interpretación de resultados

- MCP (Model Context Protocol) para integraciones con servicios externos

- Una herramienta de navegador nativa para probar cambios de UI directamente en el editor

Con todo ello, el agente puede trabajar a través de múltiples archivos y pasos en una sola sesión.

Variantes de Composer 2

Cursor distribuye Composer 2 en dos variantes que comparten la misma inteligencia subyacente.

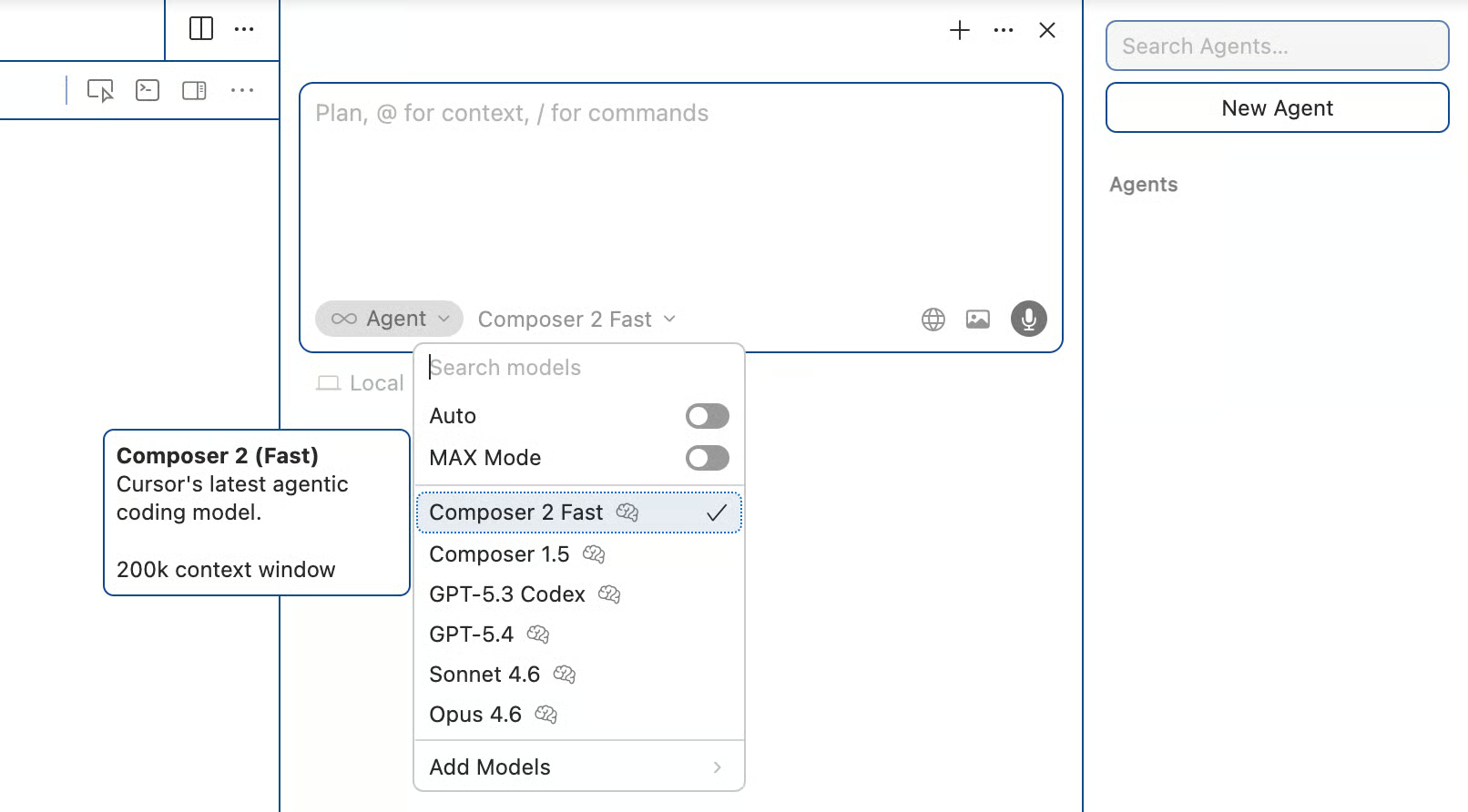

Composer 2 Fast

La variante Fast es la predeterminada al seleccionar Composer 2 en el desplegable de modelos. Está pensada para sesiones interactivas de baja latencia en las que programas en tiempo real y quieres respuestas casi instantáneas.

Composer 2 Standard

La variante Standard funciona a menor velocidad pero cuesta significativamente menos por token, por lo que es más adecuada para tareas en segundo plano, refactorizaciones por lotes o bucles agentivos de larga duración donde no necesitas feedback inmediato.

Este es el desglose de precios:

|

Variante |

Entrada (por 1M tokens) |

Lectura de caché (por 1M tokens) |

Salida (por 1M tokens) |

|

Composer 2 Standard |

$0.50 |

$0.20 |

$2.50 |

|

Composer 2 Fast (predeterminado) |

$1.50 |

$0.35 |

$7.50 |

Puedes usar la variante Fast cuando estás programando activamente y cambiar a Standard para operaciones nocturnas o masivas para reducir el consumo de créditos. Más adelante profundizaremos en las diferencias de precio.

Benchmarks de Composer 2

Cursor evalúa Composer 2 con tres benchmarks, cada uno cubriendo un aspecto distinto del rendimiento en programación.

Entendiendo los benchmarks

CursorBench es el benchmark interno propietario de Cursor, actualmente en la versión CursorBench-3. Las tareas provienen de sesiones reales de Cursor y se obtienen con una herramienta llamada Cursor Blame, que rastrea el código confirmado hasta la petición del agente que lo generó. El benchmark mide corrección de soluciones, calidad de código, eficiencia y comportamiento de interacción, y el alcance de los problemas se ha duplicado aproximadamente desde la versión inicial hasta CursorBench-3 tanto en líneas de código como en número de archivos. Cursor complementa CursorBench con experimentos controlados en tráfico real para detectar regresiones que el grading offline podría pasar por alto. La salvedad obvia: CursorBench no es reproducible públicamente, así que estas puntuaciones no pueden verificarse de forma independiente.

Terminal-Bench 2.0 lo mantiene el Laude Institute y prueba la capacidad de un agente de IA para realizar tareas reales en un entorno de terminal: navegar directorios, ejecutar scripts, interpretar errores e iterar hasta la solución. Cursor usó el framework oficial Harbor con ajustes por defecto y ejecutó cinco iteraciones por modelo, reportando la media.

SWE-bench Multilingual es un subconjunto de SWE-bench con 300 tareas en 9 lenguajes de programación. Mide la capacidad de resolver issues reales de GitHub, siendo una prueba razonable de programación multilenguaje.

Resultados de benchmarks a lo largo de las generaciones

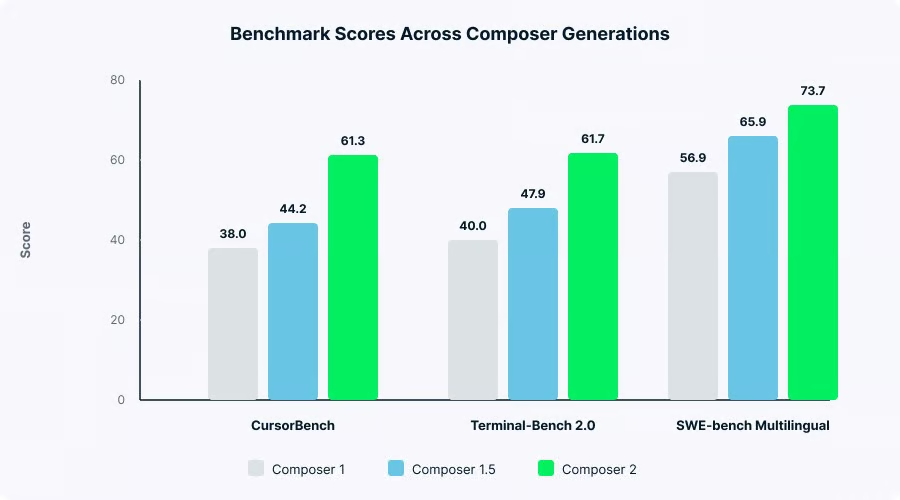

Las puntuaciones han mejorado en cada generación:

|

Benchmark |

Composer 1 |

Composer 1.5 |

Composer 2 |

|

CursorBench |

38.0 |

44.2 |

61.3 |

|

Terminal-Bench 2.0 |

40.0 |

47.9 |

61.7 |

|

SWE-bench Multilingual |

56.9 |

65.9 |

73.7 |

Puntuaciones de benchmarks en tres generaciones de Composer. Imagen del autor.

Nota sobre las limitaciones de los benchmarks

- CursorBench es de código cerrado y no es reproducible de forma independiente. Cursor no publica puntuaciones en benchmarks establecidos como SWE-bench Verified, lo que parte de la comunidad considera inconsistente.

- SWE-bench Verified ya no lo reporta OpenAI tras detectar que los modelos punteros podían reproducir parches de test de memoria y que casi el 60% de los problemas no resueltos tenían tests defectuosos.

- Terminal-Bench incluye tareas tipo puzzle (como encontrar la mejor jugada de ajedrez) que no reflejan el trabajo real de desarrollo. Aun así es el más transparente de los tres, ya que usa un framework público con métodos de evaluación documentados.

¿Cuánto mejor es Composer 2 frente a Composer 1.5?

La mejora de Composer 1.5 a Composer 2 es la mayor hasta ahora, tanto en rendimiento como en coste.

Como se ve en la tabla anterior, Composer 2 obtiene 61.3 en CursorBench frente a 44.2 de Composer 1.5, una mejora de aprox. el 39%. En Terminal-Bench 2.0 la brecha es de un 29% aprox. (61.7 frente a 47.9) y en SWE-bench Multilingual mejora alrededor de un 12% (73.7 frente a 65.9).

La bajada de costes es aún mayor que las ganancias en benchmarks. Según el blog de lanzamiento de Cursor, Composer 2 Standard es aprox. un 86% más barato que Composer 1.5 en tokens de entrada y alrededor de un 57% más barato incluso en la variante Fast. Cursor no ha publicado una página de precios independiente para Composer 1.5; estos porcentajes provienen de la comparación que hizo en el lanzamiento.

Las diferencias técnicas clave son:

- Enfoque de entrenamiento: Composer 1.5 amplió el RL 20x sobre la misma base congelada, y el cómputo de RL posterior superó al usado para preentrenar la propia base. Composer 2 tomó otro camino: primero creó una base más sólida con preentrenamiento continuo y después aplicó una ampliación 4x del cómputo de RL.

- Calidad del auto-resumen: Composer 1.5 introdujo el auto-resumen pero con compresión basada en prompts con miles de tokens de instrucciones, generando resúmenes de unos 5.000 tokens de media. La compactación entrenada por RL de Composer 2 produce ~1.000 tokens con un 50% menos de errores y además reutiliza la caché KV de tokens anteriores, reduciendo más el coste de inferencia.

- Capacidad de largo horizonte: Composer 2 maneja tareas que requieren cientos de acciones secuenciales. Como comenté antes, esto va más allá de lo que 1.5 gestionaba de forma fiable.

La recepción de Composer 1.5 en la comunidad fue desigual. Algunos desarrolladores lo veían útil solo para tareas pequeñas como commits y ediciones sencillas. Las cifras de los benchmarks muestran mejora justo en las áreas más criticadas.

Composer 2 vs. Claude Opus 4.6 vs. GPT-5.4

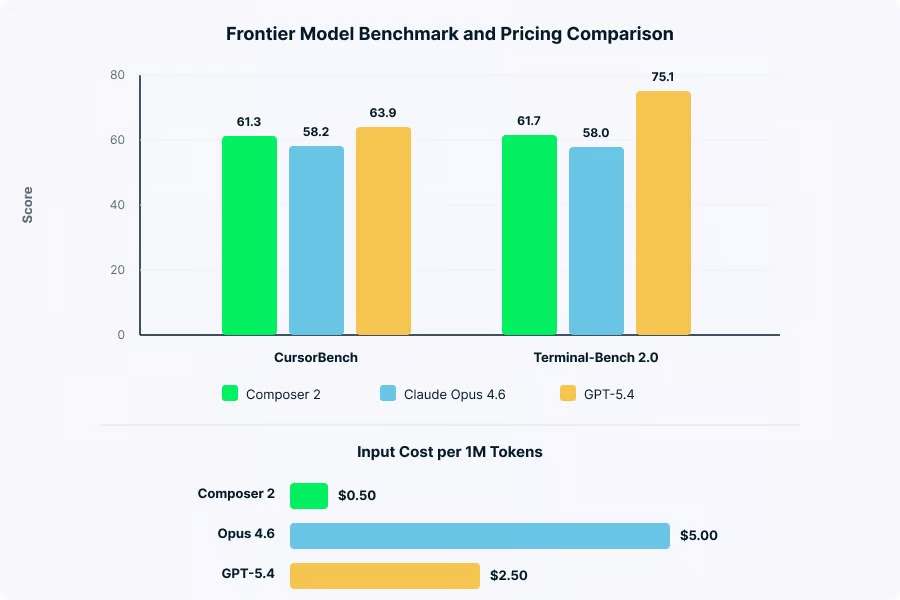

Esta es la comparación que más gente busca. Composer 2 supera a Claude Opus 4.6 en algunos benchmarks de código, queda por detrás de GPT-5.4 en la mayoría y cuesta mucho menos que ambos.

Comparativa de benchmarks

Las cifras cuentan casi toda la historia:

|

Benchmark |

Composer 2 |

Claude Opus 4.6 |

GPT-5.4 |

|

CursorBench |

61.3 |

~58.2 |

~63.9 |

|

Terminal-Bench 2.0 |

61.7 |

58.0 |

75.1 |

|

SWE-bench Verified |

No reportado |

~80.8% |

~80.0% |

Composer 2 vs. Claude Opus 4.6 vs. GPT-5.4

Composer 2 adelanta a Opus 4.6 en CursorBench y Terminal-Bench 2.0, pero GPT-5.4 lidera ambos con margen claro. En Terminal-Bench 2.0, la brecha entre Composer 2 (61.7) y GPT-5.4 (75.1) es de 13 puntos.

Un apunte: las puntuaciones de Terminal-Bench 2.0 miden parejas agente+modelo, no modelos en bruto. Cursor usó el framework Harbor para su puntuación, mientras que el 75.1 de GPT-5.4 corresponde al harness Simple Codex en el leaderboard oficial. Distintos harness pueden producir resultados distintos para el mismo modelo.

Comparativa de precios

Así quedan los precios:

|

Modelo |

Entrada (por 1M tokens) |

Salida (por 1M tokens) |

|

Composer 2 Standard |

$0.50 |

$2.50 |

|

Composer 2 Fast |

$1.50 |

$7.50 |

|

Claude Opus 4.6 |

$5.00 |

$25.00 |

|

GPT-5.4 |

$2.50 |

$15.00 |

Comparativa de benchmarks y precio por token. Imagen del autor.

Composer 2 Standard es aprox. un 90% más barato que Opus 4.6 y cerca de un 80% más barato que GPT-5.4 por token. Para equipos que ejecutan miles de peticiones agentivas al día, la diferencia se acumula rápido.

En qué destaca cada modelo

Composer 2 es un modelo solo de código, ligado al IDE de Cursor. Resuelve tareas rutinarias de programación con rapidez y bajo coste, pero no puede hacer nada fuera del código.

Claude Opus 4.6 ofrece una ventana de contexto de 200.000 tokens (con beta de 1M a mayor coste), sobresale en planificación arquitectónica multiarchivo y admite orquestación multiagente con Agent Teams. Es un modelo generalista que, además, es muy bueno con código.

GPT-5.4 lidera los benchmarks de programación más exigentes, tiene uso de ordenador nativo y admite una ventana experimental de 1,05 millones de tokens. Es el modelo más capaz de forma individual, pero también el más caro a escala.

La propuesta de Cursor es el valor por tarea dentro del IDE, no liderar en benchmarks brutos.

Composer 2 vs. Claude Code vs. GitHub Copilot

La sección anterior compara Composer 2 contra modelos en bruto. Así queda a nivel de producto.

Claude Code es el agente de programación basado en terminal de Anthropic. Según una encuesta de desarrolladores de 2026, ahora lidera como la herramienta de IA para programar más utilizada por profesionales: el 46% la señala como su favorita, frente al 19% de Cursor. Muchos usan Cursor para edición diaria en el IDE y pasan a Claude Code para tareas autónomas complejas. Se complementan más de lo que compiten.

GitHub Copilot sigue siendo la herramienta con mayor adopción, con más de 20 millones de usuarios históricos y un precio de entrada más bajo de $10/mes. Recientemente añadió el modo Agent para acciones multi-paso, pero muchos desarrolladores comentan que la edición multiarchivo de Cursor llega más lejos.

Aproximadamente el 70% de desarrolladores ya usa entre dos y cuatro herramientas de IA a la vez. La pregunta no es "¿qué herramienta?" sino "¿qué combinación?"

Cómo usar Composer 2

Composer 2 vive por completo dentro del IDE de Cursor, así que no hay nada que instalar aparte.

Configuración paso a paso

Para empezar con Composer 2, descarga o actualiza Cursor desde cursor.com. Composer 2 está disponible en todos los planes de pago (Pro, Pro+, Ultra, Teams, Enterprise). Abre el panel del agente con Cmd+I en Mac o Ctrl+I en Windows y Linux, y luego selecciona "Composer 2" o "Composer 2 Fast" en el desplegable de modelos. La variante Fast está seleccionada por defecto.

Dónde encontrar el desplegable de modelos de Cursor. Imagen del autor.

Desde ahí, escribe en lenguaje natural la descripción de la tarea que quieres realizar. Composer 2 opera en modo Agent por defecto, es decir, puede explorar tu base de código de forma autónoma, hacer cambios, ejecutar comandos de terminal y usar todas las herramientas disponibles. Tú revisas y aceptas o rechazas cambios a medida que el agente trabaja.

Atajos clave

Estos son los atajos que usarás más a menudo con Composer 2:

|

Acción |

Mac |

Windows/Linux |

|

Abrir Agent/Composer |

Cmd+I |

Ctrl+I |

|

Nueva conversación |

Cmd+N |

Ctrl+N |

|

Cambiar modos (Agent/Ask/Edit) |

Cmd+. |

Ctrl+. |

|

Modo Ask (solo lectura) |

Cmd+L |

Ctrl+L |

|

Edición inline |

Cmd+K |

Ctrl+K |

|

Abrir historial |

Cmd+Opt+L |

Ctrl+Alt+L |

Trabajo con contexto

Composer 2 admite varias formas de controlar el contexto que ve. Escribe @ seguido de un nombre de archivo, carpeta o URL para inyectar contexto específico en el prompt. El símbolo # focaliza un archivo concreto. Las "píldoras" de contexto en la parte superior del chat muestran lo que el agente está usando como referencia.

En proyectos grandes, activar Autocontext en Ajustes permite a Cursor recuperar automáticamente código relevante mediante embeddings. También puedes añadir documentación personalizada en Ajustes para contexto específico de frameworks.

Auto-resumen en la práctica

En tareas de larga duración, el auto-resumen se activa automáticamente cuando se llena la ventana de contexto. También puedes forzar la compresión manualmente con el comando /compress . Si el agente sugiere empezar una conversación nueva, normalmente significa que el contexto se ha hecho demasiado grande para un resumen eficaz.

Precios de Composer 2

Ya cubrimos el coste por token en la sección de Variantes, así que no repetiremos cifras. Veamos cómo funciona la tarificación en la práctica.

Niveles de suscripción de Cursor

Cursor usa un sistema por niveles con créditos que determinan cuánto puedes usar modelos de terceros. Este es el desglose actual:

|

Plan |

Precio |

Incluye |

|

Hobby |

Gratis |

Peticiones de agente y autocompletados limitados |

|

Pro |

$20/mes ($16/mes con facturación anual) |

Bolsa de $20 en créditos, autocompletado ilimitado, agentes en la nube |

|

Pro+ |

$60/mes ($48/mes con facturación anual) |

3x uso en todos los modelos |

|

Ultra |

$200/mes |

20x uso en todos los modelos, acceso prioritario |

|

Teams |

$40/usuario/mes ($32 con anual) |

Facturación centralizada, SAML/OIDC SSO, analítica |

|

Enterprise |

Personalizado |

SOC 2, revisión legal, controles avanzados de seguridad |

Cómo funcionan los créditos con Composer 2

Este punto suele generar dudas. El uso de Composer en planes individuales se descuenta de una bolsa de uso independiente, separada de la bolsa de créditos para modelos de terceros como Claude o GPT. Cursor describe esta bolsa como con "uso generoso incluido", aunque no ha publicado límites exactos.

Cuando usas el modo "Auto", que deja a Cursor elegir el modelo en cada petición, el uso de los modelos Composer es ilimitado en planes de pago sin descontar créditos. Si seleccionas manualmente modelos premium de terceros, el consumo se resta de tu bolsa mensual de créditos. Cuando se agota, puedes habilitar pagos por exceso según consumo.

Contexto de precios

La tarificación de Cursor ha cambiado varias veces en el último año. En junio de 2025 sustituyeron el sistema plano de "500 peticiones rápidas al mes" por facturación basada en créditos, que en la práctica redujo las peticiones de ~500 a ~225 al mes en el nivel Pro.

A marzo de 2026, los modelos punteros como GPT-5.4 y Opus 4.6 se descuentan de tu bolsa mensual con precios dinámicos por token. El uso de Composer 2 sigue en su bolsa separada. Si presupuestas para un equipo, prioriza Composer 2 para el trabajo rutinario y reserva los créditos de terceros para las tareas que lo requieran.

Limitaciones conocidas de Composer 2

Como se mencionó en la comparativa, Composer 2 es solo para código. El cofundador Aman Sanger lo dijo claro: "No te ayudará con los impuestos. No sabrá escribir poemas." Para tareas de propósito general, sigue necesitando Claude o GPT dentro de Cursor.

Algunas personas han reportado que, en planes de ejecución rígidos y multi-paso, Composer 2 a veces omite verificaciones intermedias y se precipita hacia la implementación. Probablemente es un artefacto de entrenamiento en el que el modelo prioriza terminar antes que verificar.

Algunos usuarios han indicado que en macOS, el watcher de archivos en segundo plano de Cursor ignora directivas de .gitignore en monorepos muy grandes, haciendo que el agente indexe carpetas de dependencias como node_modules y agote los tokens de forma inesperada.

CursorBench sigue siendo de código cerrado. Para Terminal-Bench 2.0, Cursor tomó "la puntuación máxima entre la del leaderboard oficial y la registrada ejecutando en nuestra infraestructura" para modelos no Composer, una decisión metodológica a tener en cuenta.

Sobre transparencia: Cursor no reveló el modelo base Kimi K2.5 en su post de lanzamiento. La omisión salió a la luz el 20 de marzo de 2026, cuando un usuario encontró el ID del modelo en encabezados de API, generando un breve debate público sobre el cumplimiento de licencias. Lin Qiao, CEO de Fireworks AI, aclaró que Cursor cumplió desde el primer día a través de la plataforma de Fireworks. Moonshot AI confirmó el acuerdo como colaboración comercial autorizada. Tanto Lee Robinson como el cofundador Aman Sanger reconocieron que no haberlo revelado fue "un fallo" y se comprometieron a ser más transparentes con los modelos base en adelante.

Conclusión

Cursor lo ha dicho claramente: Composer 2 no pretende ser el modelo más capaz en términos absolutos. Su foco es reducir costes para el trabajo cotidiano en el IDE.

Los benchmarks lo respaldan: Composer 2 supera a Claude Opus 4.6 en Terminal-Bench 2.0 con un coste por token un 90% más bajo, pero sigue por detrás de GPT-5.4 en pruebas más duras.

El mercado avanza hacia flujos con varios modelos, y la forma en que Cursor tarifa Composer 2 sugiere que están construyendo con esa premisa.

Si quieres saber más sobre las herramientas de IA que están transformando el desarrollo de software, revisa nuestra comparativa de GPT-5.4 vs. Claude Opus 4.6.

Soy ingeniero de datos y creador de comunidades. Trabajo con canalizaciones de datos, nube y herramientas de IA, al tiempo que escribo tutoriales prácticos y de gran impacto para DataCamp y programadores emergentes.

Composer 2: preguntas frecuentes

¿Composer 2 está disponible en el plan gratuito?

El blog de Cursor menciona "planes individuales" sin aclarar si incluye el nivel Hobby. En la práctica, el plan Hobby tiene una bolsa de peticiones de agente limitada que se agota rápido, así que probablemente podrás probar unas pocas tareas antes de llegar al tope. Si quieres usar Composer 2 para algo más que pruebas rápidas, Pro a $20/mes es el punto de partida realista.

¿Qué tan rápido es Composer 2 comparado con el Composer original?

Cursor no ha publicado cifras exactas de tokens por segundo para Composer 2. Composer 1 funcionaba alrededor de 250 TPS en su lanzamiento. En Composer 2, la variante Fast es perceptiblemente más rápida para sesiones interactivas, mientras que Standard sacrifica velocidad por menor coste y funciona mejor para tareas largas en segundo plano donde no esperas en tiempo real. No hay cifras oficiales comparativas.

¿Puedo ejecutar Composer 2 en varios archivos a la vez?

Sí, la edición multiarchivo es uno de sus usos principales. En una sola sesión, Composer 2 puede leer, crear y modificar archivos en toda tu base de código. Si necesitas trabajar en dos o tres funcionalidades independientes a la vez, Cursor también permite ejecutar hasta 8 agentes en paralelo usando git worktrees, cada uno en su rama aislada. Es útil cuando las tareas no dependen entre sí.

¿Qué ocurre cuando se llena la ventana de contexto de Composer 2?

El auto-resumen se activa automáticamente. El modelo comprime su contexto de trabajo a unos 1.000 tokens y continúa. También puedes forzarlo con /compress si quieres recuperar espacio de contexto a mitad de tarea. Si el agente recomienda empezar una conversación nueva, suele significar que la tarea ha crecido más allá de lo que la compresión puede manejar con limpieza y que una sesión nueva será más fiable.

¿Debo usar Composer 2 o Claude Opus 4.6 dentro de Cursor?

Regla aproximada: si la tarea cabe en unos pocos archivos y puedes describirla con claridad, Composer 2 es más rápido y cuesta una fracción de lo que cuesta Opus 4.6. Si trabajas en algo que requiere razonar sobre una base de código grande, valorar decisiones de diseño o producir resultados donde la precisión importa más que la velocidad, Opus 4.6 compensa el coste extra. Muchos desarrolladores usan ambos según la tarea, que es justo para lo que está diseñado el selector de modelos de Cursor.