Kurs

Verilerinizi doğru şekilde hazırlamak hem modellerin performansı hem de sonuçların yorumlanması için önemlidir. İşte normalize etme ve standartlaştırmanın devreye girdiği temel zorluk: Verileri daha iyi performans için ayarlamak veya sonuçların yorumlanmasına yardımcı olmak amacıyla kullanılan iki temel özellik ölçekleme tekniği.

Bu yazıda, farklı terimleri adım adım ele alacak ve normalize etme ile standartlaştırma arasındaki pratik farkları görmenize yardımcı olacağım. Yazının sonunda, veri ön işleme sürecinizde hangisini ne zaman kullanmanız gerektiğini anlayacaksınız. Normalize etme ve standartlaştırmaya aşina olarak modellerinizin performansını artıracak, sonuçları daha iyi yorumlayacak ve ölçeklenmemiş verilerin beraberinde getirdiği yaygın tuzaklardan kaçınacaksınız. Buradaki ince farklar, makine öğrenmesi alanında çok önemlidir. Ciddi biçimde uzmanlaşmak istiyorsanız, bugün Python ile Makine Öğrenmesi Bilimcisi kariyer yolumuza kaydolun.

Özellik Ölçeklemeyi Anlamak

Normalize etme ve standartlaştırma, özellik ölçekleme fikrine veya kategorisine dahildir. Özellik ölçekleme, makine öğrenmesi modelleri için verileri hazırlamada önemli bir adımdır. Bir veri kümesindeki özelliklerin değerlerini benzer bir ölçeğe dönüştürmeyi içerir; böylece tüm özellikler modelin öğrenme sürecine eşit şekilde katkıda bulunur.

Özellik ölçekleme önemlidir çünkü, özellikler çok farklı ölçeklerde olduğunda, örneğin biri 1 ile 10 arasında, diğeri 1.000 ile 10.000 arasında değiştiğinde, modeller büyük değerleri önceliklendirebilir ve bu da tahminlerde önyargıya yol açar. Bu durum, zayıf model performansına ve eğitim sırasında daha yavaş yakınsamaya neden olabilir.

Özellik ölçekleme, değerler arasındaki farkları bozmadan verilerin aralığını ayarlayarak bu sorunları giderir. Birkaç ölçekleme tekniği vardır ve en yaygın kullanılanlar normalize etme ve standartlaştırmadır. Her iki yöntem de özelliklerin etkisini dengeleyerek, aykırı değerlerin etkisini azaltarak ve bazı durumlarda yakınsama hızlarını iyileştirerek makine öğrenmesi modellerinin en iyi şekilde performans göstermesine yardımcı olur.

Normalize Etme Nedir?

Normalize etme geniş bir kavramdır ve verileri normalize etmenin farklı yolları vardır. Genel olarak normalize etme, farklı ölçeklerde ölçülen değerleri ortak bir ölçeğe ayarlama sürecine atıfta bulunur. Bazen en iyisi bir örnekle açıklamaktır. Aşağıdaki her normalize etme türü için, bir evin fiyatı ile boyutu arasındaki ilişkiyi anlamaya yönelik bir model düşüneceğiz.

Normalize etme türleri

Başlıca türlerin bazılarına bakalım. Bunun kapsamlı bir liste olmadığını unutmayın:

Min-maks normalize etme

Min-maks normalize etmede, evlerin boyutlarını 0 ile 1 arasındaki bir aralığa yeniden ölçekleyebiliriz. Bu, en küçük ev boyutunun 0 ve en büyük ev boyutunun 1 olarak temsil edileceği anlamına gelir.

Log normalize etme

Log normalize etme başka bir normalize etme tekniğidir. Log normalize etmeyi kullanarak ev fiyatlarına logaritmik bir dönüşüm uygularız. Bu teknik, özellikle aralarında önemli farklar varsa, daha büyük fiyatların etkisini azaltmaya yardımcı olur.

Ondalık ölçekleme

Ondalık ölçekleme başka bir normalize etme tekniğidir. Bu örnekte, değerleri küçültmek için ondalık noktayı kaydırarak evlerin boyutlarını ayarlayabiliriz. Bu, ev boyutlarının, göreli farklılıkları korunurken daha yönetilebilir bir ölçeğe dönüştürüldüğü anlamına gelir.

Ortalama normalize etme (ortalamaya göre merkezleme)

Bu bağlamda ortalama normalize etme, her bir evin fiyatından ortalama fiyatı çıkararak ev fiyatlarını ayarlamayı içerir. Bu işlem fiyatları sıfıra merkezler ve her evin boyutunun ortalamaya göre nasıl konumlandığını gösterir. Böylece hangi ev boyutlarının ortalamadan büyük veya küçük olduğunu analiz etmek mümkün olur ve göreli fiyatlarını yorumlamak kolaylaşır.

Verileri ne zaman normalize etmelisiniz?

Yukarıdaki örneklerden de çıkarabileceğiniz gibi, normalize etme özellikle verilerin dağılımı bilinmediğinde veya bir Gaussian dağılımını takip etmediğinde kullanışlıdır. Ev fiyatları burada iyi bir örnektir çünkü bazı evler çok, çok pahalıdır ve modeller aykırı değerlerle her zaman iyi başa çıkamaz.

Dolayısıyla normalize etmenin amacı daha iyi bir model oluşturmaktır. Hataların daha eşit dağılması için bağımlı değişkeni normalize edebilir veya daha büyük ölçekli özelliklerin daha küçük ölçeklileri baskılamamasını sağlamak için giriş değişkenlerini normalize edebiliriz.

Normalize etme aşağıdaki senaryolarda en etkilidir:

- Bilinmeyen veya Gaussian Olmayan Dağılım: Verilerin dağılımı bilinmediğinde veya normal (Gaussian) bir deseni izlemediğinde. Örneğin doğrusal regresyonda, bağımlı değişkeni çan eğrisine daha çok benzeyecek şekilde normalize etmek isteyebiliriz; bu da tahminlerimize daha fazla güven sağlar.

- Mesafeye Dayalı Algoritmalar: k-En Yakın Komşu (k-NN) gibi veri noktaları arasındaki mesafelere dayanan makine öğrenmesi algoritmaları kullanıldığında, daha büyük ölçekli özelliklerin mesafe hesaplamalarına hakim olmasını önlemek için normalize etme gereklidir.

Standartlaştırma Nedir?

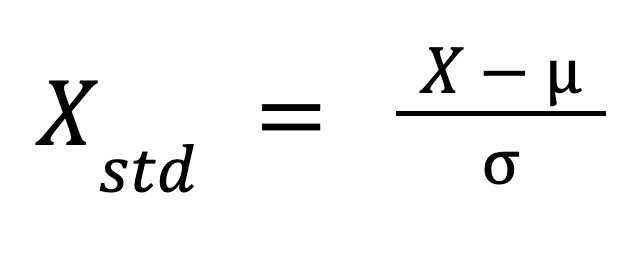

Normalize etme özellikleri belirli bir aralığa ölçeklerken, aynı zamanda z-skoru ölçekleme olarak da adlandırılan standartlaştırma, verileri ortalaması 0 ve standart sapması 1 olacak şekilde dönüştürür. Bu süreç, özellik değerlerini ortalamayı çıkarıp standart sapmaya bölerek ayarlar. ‘Merkezleme ve ölçekleme’ kavramını duymuş olabilirsiniz. Aslında standartlaştırma aynı şeye karşılık gelir: önce merkezleme, sonra ölçekleme.

Standartlaştırmanın formülü şudur:

Burada:

- X orijinal değerdir,

- mu özellik ortalamasıdır ve

- sigma özelliğin standart sapmasıdır.

Bu formül, verilerin dağılımını ortalaması 0 ve standart sapması 1 olacak şekilde yeniden ölçekler.

Verileri ne zaman standartlaştırmalısınız?

Standartlaştırma aşağıdaki durumlarda en uygunudur:

- Gradyana dayalı algoritmalar: Destek Vektör Makineleri (SVM) en iyi performans için standartlaştırılmış veriler gerektirir. Doğrusal regresyon ve lojistik regresyon gibi modeller standartlaştırmayı varsaymasa da, özellikle özelliklerin büyüklükleri büyük ölçüde değiştiğinde bundan fayda görebilir; bu da her bir özelliğin dengeli katkı yapmasını sağlar ve optimizasyonu iyileştirir.

- Boyut indirgeme: Standartlaştırma, PCA gibi boyut indirgeme tekniklerinde önemlidir; çünkü PCA, verideki varyansın en çok olduğu yönü belirler. Yalnızca ortalama normalize etme yeterli değildir; zira PCA hem ortalamayı hem de varyansı dikkate alır ve farklı özellik ölçekleri analizi bozabilir.

Normalize Etme vs. Standartlaştırma: Temel Farklar

Bazen normalize etme ile standartlaştırmayı ayırt etmek zor olabilir. Bir yandan normalize etme bazen daha genel bir terim olarak kullanılırken, standartlaştırmanın anlamı biraz daha belirli ya da teknik olarak daha spesifiktir. Ayrıca, terimlere aşina olan veri analistleri ve veri bilimcileri bile kullanım durumlarını ayırt etmekte zorlanabilir.

Her ikisi de özellik ölçekleme teknikleri olsa da yaklaşımları ve uygulamaları farklıdır. Bu farkları anlamak, makine öğrenmesi modeliniz için doğru tekniği seçmenin anahtarıdır.

Yeniden ölçekleme yöntemleri

Normalize etme, özellik değerlerini önceden tanımlanmış bir aralıkta, genellikle 0 ile 1 arasında yeniden ölçekler; bu, özellikle özelliklerin ölçeklerinin büyük ölçüde değiştiği modeller için faydalıdır. Buna karşılık standartlaştırma, verileri ortalama (0) etrafında merkezler ve standart sapmaya (1) göre ölçekler.

Aykırı değerlere duyarlılık

Farklı normalize etme tekniklerinin aykırı değerlerle başa çıkma etkinliği değişir. Ortalama normalize etme bazı senaryolarda aykırı değerler için başarılı bir ayarlama sağlayabilir; ancak diğer teknikler o kadar etkili olmayabilir. Genel olarak normalize etme teknikleri, standartlaştırma kadar aykırı değer sorununu etkin biçimde ele almaz; çünkü standartlaştırma açıkça hem ortalamaya hem de standart sapmaya dayanır.

Kullanım durumları

Normalize etme, k-En Yakın Komşu (k-NN) gibi mesafeye dayalı algoritmalarda yaygın olarak kullanılır; burada mesafe hesaplamalarının doğruluğu için özelliklerin aynı ölçekte olması gerekir. Standartlaştırma ise Destek Vektör Makineleri (SVM) gibi gradyana dayalı algoritmalar için kritiktir ve PCA gibi boyut indirgeme tekniklerinde sıkça uygulanır; çünkü doğru özellik varyansının korunması önemlidir.

Farkların özet tablosu

Normalize etme ile standartlaştırmayı karşılaştırmayı kolaylaştırmak için tüm bu temel farklara bir özet tabloda bakalım:

| Kategori | Normalize Etme | Standartlaştırma |

|---|---|---|

| Yeniden Ölçekleme Yöntemi | Verileri minimum ve maksimum değerlere göre bir aralığa (genellikle 0 ile 1) ölçekler. | Verileri ortalama (0) etrafında merkezler ve standart sapmaya (1) göre ölçekler. |

| Aykırı Değerlere Duyarlılık | Normalize etme, tekniğe bağlı olarak doğru kullanıldığında aykırı değerlere uyum sağlamaya yardımcı olabilir. | Standartlaştırma, aykırı değer sorunlarını gidermek için daha tutarlı bir yaklaşımdır. |

| Yaygın Algoritmalar | Verilerin tutarlı bir ölçekte olmasını gerektiren k-NN ve sinir ağları gibi algoritmalarda sıklıkla uygulanır. | Lojistik regresyon, SVM ve PCA gibi özelliklerin ortak bir ölçekte olmasını gerektiren algoritmalar için en uygunudur. |

Farkları Görselleştirme

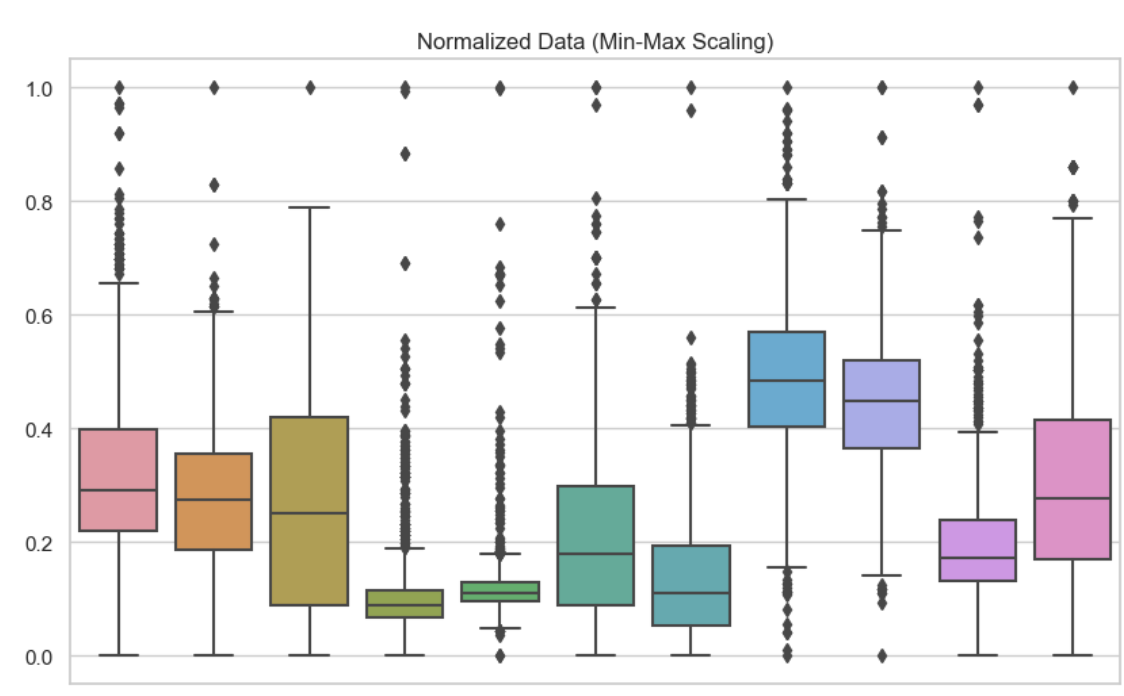

Normalize etme ile standartlaştırma arasındaki farkları anlamak için, etkilerini görsel olarak ve model performansı açısından görmek faydalıdır. Burada bu farklı özellik ölçekleme tekniklerini göstermek üzere kutu grafikleri (boxplot) ekledim. Veri kümemdeki değişkenlerin her birine min-maks normalize etme uyguladım. Hiçbir değerin 0'dan küçük veya 1'den büyük olmadığını görebiliriz.

Normalize edilmiş veriler. Görsel: Yazar

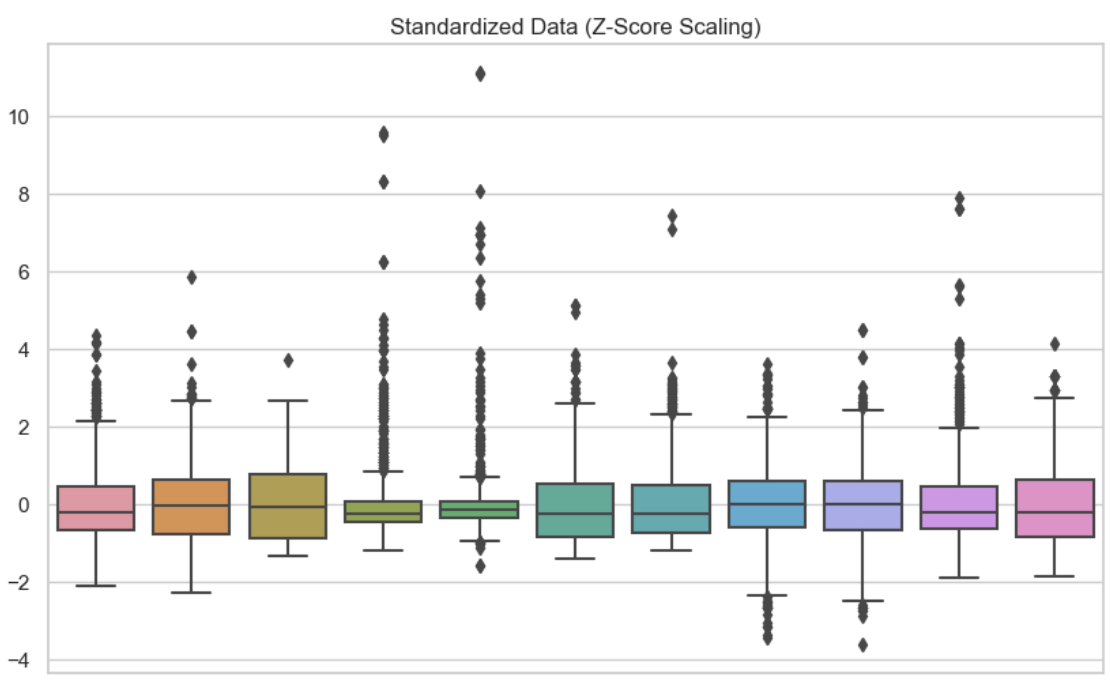

İkinci görselde ise değişkenlerin her birine standartlaştırma uyguladım. Verilerin sıfıra merkezlendiğini görebiliriz.

Standartlaştırılmış veriler. Görsel: Yazar

Standartlaştırılmış veriler. Görsel: Yazar

Avantajlar ve dezavantajlar

Avantajlar arasında geliştirilmiş model performansı ve dengeli özellik katkıları yer alır. Ancak normalize etme, sabit ölçek nedeniyle yorumlanabilirliği sınırlayabilir; standartlaştırma da değerler artık orijinal birimlerini yansıtmadığından yorumlamayı zorlaştırabilir. Model karmaşıklığı ile doğruluğu arasında her zaman bir ödünleşim vardır.

Doğrusal Regresyonda Normalize Etme ve Standartlaştırma

Basit doğrusal regresyon modelinin yorumunu normalize etmenin (bu durumda ortalama normalize etme) ve standartlaştırmanın nasıl değiştirebileceğini ele alalım. Her model için R-kare veya düzeltilmiş R-kare aynı olacaktır; dolayısıyla burada özellik ölçekleme yalnızca modelimizin yorumuyla ilgilidir.

| Uygulanan Dönüşüm | Bağımsız Değişken (Ev Boyutu) | Bağımlı Değişken (Ev Fiyatı) | Yorum |

|---|---|---|---|

| Ortalama Normalize Etme | Ortalamaya Göre Normalize Edildi | Orijinal | Ortalamanın göreli olarak ev boyutundaki her değişim için orijinal ev fiyatını tahmin ediyorsunuz. |

| Standartlaştırma | Standartlaştırıldı | Orijinal | Ev boyutundaki her bir standart sapmalık değişim için orijinal ev fiyatını tahmin ediyorsunuz. |

| Ortalama Normalize Etme | Orijinal | Ortalamaya Göre Normalize Edildi | Orijinal ev boyutunda her bir birimlik artış için ortalamaya göre ev fiyatını tahmin ediyorsunuz. |

| Standartlaştırma | Orijinal | Standartlaştırıldı | Orijinal ev boyutunda her bir birimlik artış için standartlaştırılmış ev fiyatını tahmin ediyorsunuz. |

| Ortalama Normalize Etme (Her İki Değişken) | Ortalamaya Göre Normalize Edildi | Ortalamaya Göre Normalize Edildi | Ev boyutundaki ortalamaya göre her değişim için ortalamaya göre ev fiyatını tahmin ediyorsunuz. |

| Standartlaştırma (Her İki Değişken) | Standartlaştırıldı | Standartlaştırıldı | Ev boyutundaki her bir standart sapmalık değişim için standartlaştırılmış ev fiyatını tahmin ediyorsunuz. |

Başka önemli bir not olarak, doğrusal regresyonda bağımsız ve bağımlı değişkenleri standartlaştırırsanız R-kare aynı kalır. Bunun nedeni, R-karenin y’deki varyansın x tarafından açıklanan oranını ölçmesidir ve bu oran, değişkenler standartlaştırılsa da standartlaştırılmasa da aynı kalır. Ancak bağımlı değişkeni standartlaştırmak RMSE’yi değiştirecektir; çünkü RMSE, bağımlı değişkenle aynı birimlerde ölçülür. y artık standartlaştırıldığı için, standartlaştırmadan sonra RMSE daha düşük olacaktır. Özellikle hata, orijinal birimler yerine standartlaştırılmış değişkenin standart sapması cinsinden yansıtılacaktır. Regresyon özellikle ilginizi çekiyorsa, uzmanlaşmak için Python’da statsmodels ile Regresyona Giriş kursumuzu alın.

Sonuç

Normalize etme ve standartlaştırmayı da içeren özellik ölçekleme, makine öğrenmesinde veri ön işlemenin kritik bir bileşenidir. Her tekniğin hangi bağlamlarda uygulanacağını anlamak, modellerinizin performansını ve doğruluğunu önemli ölçüde artırabilir.

Özellik ölçekleme ve makine öğrenmesindeki rolü konusundaki bilginizi genişletmek ve derinleştirmek istiyorsanız, DataCamp’te sizi başlatacak birkaç mükemmel kaynağımız var. Temel kavramlar için Makine Öğrenmesinde Normalize Etme makalemizi inceleyebilir veya gerçek uygulamaları kapsayan Uçtan Uca Makine Öğrenmesi kursumuzu değerlendirebilirsiniz.

Veri alanında deneyimli bir profesyonel ve yazar; veri dünyasında uzmanlaşmak isteyenleri güçlendirmeye tutkuyla bağlı.