Courses

Một câu hỏi thường gặp trong lĩnh vực AI tự triển khai là làm thế nào để trò chuyện với các tài liệu riêng tư mà không cần gửi chúng đến API đám mây.

AnythingLLM là một câu trả lời phổ biến. Công cụ này xử lý mọi thứ (tải tài liệu, nhúng, tìm kiếm và trò chuyện) trong một giao diện và kết nối với nhiều nhà cung cấp LLM. Nó cho phép bạn xây dựng các quy trình AI riêng tư mà không phụ thuộc vào dịch vụ đám mây.

Trong hướng dẫn này, tôi sẽ giải thích AnythingLLM là gì, đi qua kiến trúc của nó, chỉ bạn cách cài đặt bằng Docker và Ollama, và trình diễn một pipeline Retrieval-Augmented Generation (RAG) đang hoạt động. Tôi cũng sẽ so sánh nó với Open WebUI và ChatGPT.

AnythingLLM là gì?

AnythingLLM là một ứng dụng mã nguồn mở do Mintplex Labs xây dựng theo giấy phép MIT. Dự án có cộng đồng GitHub năng động, phát hành thường xuyên và được sử dụng rộng rãi trong lĩnh vực AI tự triển khai.

Nó làm gì: nó biến tài liệu của bạn thành ngữ cảnh mà một mô hình ngôn ngữ lớn (LLM) có thể sử dụng trong hội thoại. Bạn tải tệp lên, hệ thống xử lý và lưu trữ chúng, sau đó LLM có thể trả lời câu hỏi dựa trên dữ liệu của bạn. Dự án phát triển nhanh, có cộng đồng Discord sôi động và các bản cập nhật hàng tháng bổ sung nhà cung cấp LLM và tính năng mới.

Có hai điều cần hiểu trước. Thứ nhất, AnythingLLM không phải là một mô hình. Nó là cầu nối kết nối bạn với các nhà cung cấp LLM bên ngoài, dù là cục bộ (như Ollama) hay trên đám mây (như OpenAI hoặc Anthropic).

Thứ hai, nền tảng tổ chức mọi thứ thành workspace. Hãy coi đây là các phòng riêng cho từng dự án. Mỗi workspace có tài liệu và hội thoại riêng, được cách ly trừ khi bạn cấu hình để chia sẻ.

Giao diện workspace AnythingLLM với tài liệu. Ảnh: Tác giả.

AnythingLLM trên desktop và Docker

Ứng dụng desktop (macOS, Windows, Linux) dành cho người dùng đơn chạy mọi thứ cục bộ. Nó đi kèm động cơ LLM tích hợp, bộ embedder chạy trên CPU và LanceDB đóng gói sẵn. Cài đặt một cú nhấp, không cần cấu hình.

Phiên bản Docker được xây cho đội nhóm và máy chủ. Nó bổ sung kiểm soát truy cập đúng nghĩa với vai trò Admin, Manager và Default, cùng widget chat có thể nhúng cho website và gắn nhãn trắng. Nếu bạn cần truy cập theo nhóm hoặc widget chat hướng công chúng, Docker là lựa chọn duy nhất.

|

Tính năng |

Desktop |

Docker |

|

Hỗ trợ đa người dùng |

Không |

Có (vai trò Admin, Manager, Default) |

|

Động cơ LLM tích hợp |

Có |

Không (kết nối nhà cung cấp bên ngoài) |

|

Widget chat có thể nhúng |

Không |

Có |

|

Gắn nhãn trắng |

Không |

Có |

|

Độ phức tạp thiết lập |

Cài đặt một cú nhấp |

Cần kiến thức Docker |

Tính năng cốt lõi của AnythingLLM

Giờ bạn đã biết AnythingLLM là gì và cách chọn giữa Desktop và Docker, cùng đi qua các tính năng khiến nó hữu ích cho quy trình AI dựa trên tài liệu.

Nạp tài liệu

Hoạt động với PDF, DOCX, TXT, Markdown, CSV, XLSX, PPTX, HTML, hơn 50 loại tệp mã và tệp âm thanh (dùng chuyển âm Whisper). Bạn cũng có thể kéo nội dung trực tiếp từ repo GitHub, bản chép YouTube, trang Confluence và website bằng trình thu thập tích hợp.

Cơ sở dữ liệu vector

LanceDB được tích hợp sẵn và không cần thiết lập. Nếu cần tính năng doanh nghiệp, bạn có thể chuyển sang Chroma, Milvus, Pinecone, Qdrant, Weaviate, Zilliz, AstraDB hoặc PGVector.

Hỗ trợ nhiều LLM

Hỗ trợ nhiều nhà cung cấp, gồm Ollama, LM Studio, OpenAI, Anthropic, Azure OpenAI, Google Gemini, AWS Bedrock, Groq và DeepSeek. Bạn chọn mô hình theo từng workspace, vì vậy một workspace có thể dùng mô hình Ollama cục bộ cho nội dung nhạy cảm trong khi workspace khác dùng GPT-4o qua OpenAI.

Tác tử AI

Gõ @agent trong bất kỳ cuộc chat nào để kích hoạt trình dựng tác tử không cần mã. Nó có sẵn kỹ năng tìm kiếm tài liệu, tóm tắt và thu thập web. Agent Flows cung cấp canvas trực quan để chuỗi các lời gọi API, hướng dẫn LLM và thao tác tệp. Công cụ cũng hỗ trợ Model Context Protocol (MCP) để kết nối công cụ bên ngoài.

Truy cập API

API cho nhà phát triển nằm tại /api/docs (tài liệu Swagger). Bạn có thể quản lý workspace, nhúng tài liệu và gửi tin nhắn chat bằng lập trình.

Cách AnythingLLM hoạt động (Tổng quan Kiến trúc)

Ứng dụng có ba phần: frontend (React/ViteJS) cung cấp giao diện bạn thấy và tương tác. Server (backend Express) xử lý toàn bộ tương tác LLM, công việc cơ sở dữ liệu vector và yêu cầu API. Nó dùng SQLite để lưu cấu hình. Collector là dịch vụ riêng phân tích và xử lý tài liệu bạn tải lên. Khi bạn tải PDF, collector trích xuất văn bản, sau đó server chia nhỏ, nhúng và lưu trữ nó.

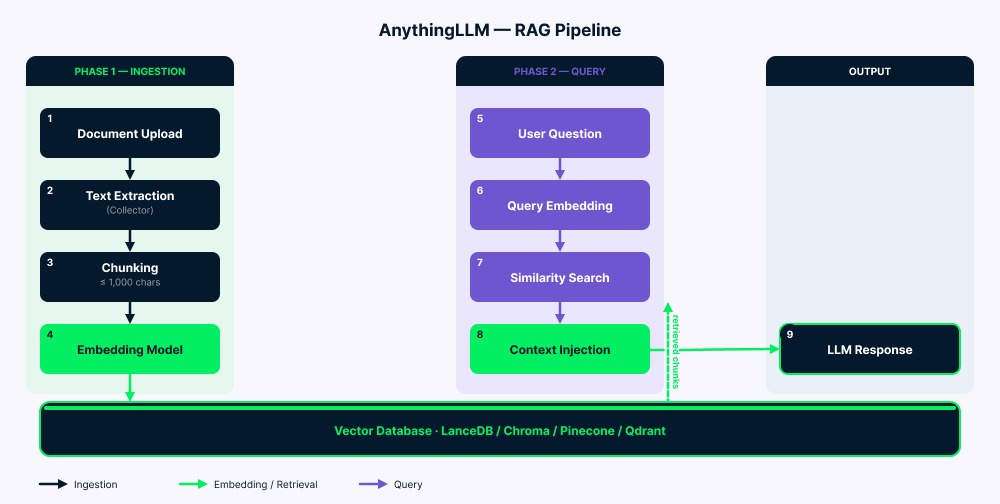

Pipeline RAG

Pipeline hoạt động qua hai giai đoạn.

Ingestion: Tài liệu của bạn đến collector để trích xuất văn bản. Server sau đó chia văn bản thành các đoạn (tối đa 1.000 ký tự với chút chồng lấn để giữ ngữ cảnh). Mỗi đoạn được chuyển thành vector bởi mô hình embedding, rồi lưu vào cơ sở dữ liệu vector. Thư mục vector-cache/ giảm việc nhúng lại không cần thiết trong nhiều trường hợp.

Truy vấn: Câu hỏi của bạn được chuyển thành vector bằng cùng mô hình embedding. Hệ thống sau đó tìm các đoạn tương đồng nhất (thường bốn đến sáu). Sau khi lọc theo điểm tương đồng, văn bản khớp được thêm vào prompt của LLM cùng câu hỏi và lịch sử chat. LLM đọc tất cả (hướng dẫn hệ thống, ngữ cảnh truy xuất, câu hỏi của bạn và tin nhắn trước đó) và tạo câu trả lời.

Tổng quan kiến trúc pipeline RAG của AnythingLLM. Ảnh: Tác giả.

Cài đặt AnythingLLM với Docker

Như bạn sẽ thấy trong mục FAQ, AnythingLLM khá nhẹ: khoảng 2GB RAM, CPU 2 nhân và khoảng 5GB lưu trữ. Chạy một LLM cục bộ song song sẽ cần nhiều hơn (mô hình 7B thường cần 8GB+ RAM/VRAM). Trong hướng dẫn này, tôi dùng mô hình 3B phù hợp phần cứng hạn chế. Hãy đảm bảo Docker đã cài và chạy trước khi bắt đầu. Người dùng Windows cần WSL.

Bước 1: Cài Ollama và kéo mô hình

Tải Ollama từ ollama.com/download, sau đó kéo một mô hình chat và một mô hình embedding:

ollama pull llama3.2:3b

ollama pull nomic-embed-text

ollama serveTôi dùng llama3.2:3b vì nó chạy tốt trên máy có VRAM hạn chế (như RTX 3050 với 6GB). Để có chất lượng tốt hơn, hãy thử llama3.2:8b hoặc deepseek-r1:7b nếu phần cứng cho phép. Xem thêm hướng dẫn về chạy LLM cục bộ để có thêm lựa chọn mô hình.

Bước 2: Tạo tệp Docker Compose

mkdir anythingllm-setup && cd anythingllm-setup

touch .envTạo docker-compose.yml:

services:

anythingllm:

image: mintplexlabs/anythingllm:latest

container_name: anythingllm

ports:

- "3001:3001"

cap_add:

- SYS_ADMIN

volumes:

- anythingllm_storage:/app/server/storage

- ./.env:/app/server/.env

environment:

- STORAGE_DIR=/app/server/storage

extra_hosts:

- "host.docker.internal:host-gateway"

restart: unless-stopped

volumes:

anythingllm_storage:Một vài điểm cần lưu ý về cấu hình này. Cờ cap_add: SYS_ADMIN là bắt buộc cho trình thu thập web PuppeteerJS tích hợp, sử dụng trình duyệt Chromium trong sandbox.

Dòng extra_hosts giải quyết vấn đề mạng Docker phổ biến nhất: cho phép container truy cập Ollama chạy trên máy chủ của bạn. Nếu không có dòng này, mọi nỗ lực kết nối đến localhost:11434 từ trong container sẽ thất bại vì các container có namespace mạng riêng.

Tôi dùng volume Docker có tên (anythingllm_storage) thay vì bind mount để tăng tương thích đa nền tảng, đặc biệt trên Windows và macOS, nơi quyền bind mount có thể gây vấn đề.

Bước 3: Khởi chạy và cấu hình

Chờ khoảng 30 giây để container khởi tạo, sau đó mở http://localhost:3001. Bạn sẽ thấy trình hướng dẫn thiết lập lần đầu. Nhưng trước tiên, chạy lệnh này:

docker compose up -d

Trình hướng dẫn thiết lập ban đầu của AnythingLLM trên Docker. Ảnh: Tác giả.

Trong trình hướng dẫn, chọn Ollama làm cả nhà cung cấp LLM và embedding, đặt base URL là http://host.docker.internal:11434, chọn llama3.2:3b làm mô hình chat, và nomic-embed-text làm embedder. Giữ LanceDB là cơ sở dữ liệu vector mặc định.

Với lựa chọn Desktop, tải ứng dụng từ anythingllm.com. Ứng dụng đóng gói mọi thứ và hoạt động ngay, không cần cấu hình. Lý tưởng cho cá nhân, nhưng như đã đề cập, thiếu tính năng đa người dùng và doanh nghiệp có trong Docker.

Kết nối nhà cung cấp LLM

Ngoài Ollama, bạn có thể kết nối nhà cung cấp đám mây qua Settings (như nêu trong FAQ 1, hữu ích nếu phần cứng hạn chế).

OpenAI

Chọn OpenAI làm nhà cung cấp LLM, nhập API key từ platform.openai.com, và chọn mô hình (GPT-4o, GPT-4o-mini, v.v.). Tài khoản của bạn cần thiết lập thanh toán, nếu không sẽ không hoạt động (và thông báo lỗi sẽ không rõ ràng).

Anthropic

Nhập key từ console.anthropic.com. Tất cả mô hình Claude dùng được cho chat, nhưng Anthropic không có mô hình embedding, nên bạn vẫn cần embedder riêng như nomic-embed-text của Ollama.

Cấu hình Ollama

Nếu bạn đã cấu hình Ollama khi cài đặt như trên, bạn đã sẵn sàng. Với thiết lập khác, dùng http://host.docker.internal:11434 trên Windows/macOS, hoặc http://172.17.0.1:11434 trên Linux. Nếu Ollama không truy cập được, đặt OLLAMA_HOST=0.0.0.0:11434 trước khi khởi động.

Sử dụng AnythingLLM để trò chuyện với tài liệu

Nhấp "New Workspace" ở thanh bên và đặt tên. Tải tệp bằng nút tải ở thanh bên hoặc kéo-thả.

AnythingLLM hỗ trợ hai chế độ tài liệu. Attach (kéo vào khung chat) đưa toàn bộ văn bản vào cuộc trò chuyện, nhưng chỉ cho luồng chat đó. Mô hình thấy mọi thứ, nhưng bạn bị giới hạn bởi dung lượng token. Embed (cách RAG tiêu chuẩn) chia tài liệu thành đoạn, chuyển thành vector và lưu trong workspace. Khi đã embed, tài liệu hoạt động trên mọi cuộc chat trong workspace đó. Với hầu hết trường hợp, embed là lựa chọn tốt hơn. Nhấp "Move to Workspace" để bắt đầu quá trình embed.

Tinh chỉnh chất lượng truy xuất

Gõ câu hỏi của bạn và hệ thống tự động tìm các đoạn liên quan rồi gửi cho LLM. Nếu câu trả lời chưa tốt, đây là các thiết lập chính cần điều chỉnh:

Ngưỡng tương đồng

Như đề cập trong FAQ 5, hãy bắt đầu với "No Restriction" nếu bạn gặp vấn đề, rồi tăng dần để lọc nhiễu.

Số đoạn ngữ cảnh tối đa

Mặc định là bốn đến sáu đoạn. Tăng lên 10 hoặc 12 cho các mô hình có cửa sổ ngữ cảnh lớn như Claude.

Ưu tiên tìm kiếm

"Accuracy Optimized" trên LanceDB bật reranking, cải thiện kết quả nhưng có thể thêm độ trễ tùy mô hình và phần cứng.

Ghim tài liệu

Ghim tài liệu quan trọng để bỏ qua việc chia đoạn. Toàn bộ văn bản sẽ được thêm vào mọi truy vấn (miễn là vừa trong giới hạn token).

AnythingLLM so với Open WebUI

Cả hai công cụ đều tốt, nhưng được xây cho những người dùng khác nhau.

|

Khía cạnh |

AnythingLLM |

Open WebUI |

|

Đối tượng chính |

Người dùng doanh nghiệp, đội nhỏ |

Lập trình viên, người dùng kỹ thuật |

|

Ứng dụng desktop |

Có (macOS, Windows, Linux) |

Không (chỉ web) |

|

Độ phức tạp thiết lập |

Desktop: một cú nhấp; Docker: đơn giản |

Cần Docker hoặc thiết lập máy chủ |

|

Triển khai RAG |

Tích hợp sẵn với đa cơ sở dữ liệu vector, reranking |

RAG phong phú, mở rộng qua plugin |

|

Đa người dùng |

Chỉ Docker; ba vai trò RBAC |

Tính năng cộng tác hạn chế |

|

Hệ sinh thái plugin |

Đang phát triển; kỹ năng tùy chỉnh qua Node.js |

Trưởng thành và phong phú hơn |

|

Giấy phép |

MIT |

BSD-3-Clause sửa đổi với bảo vệ thương hiệu từ v0.6.6 |

AnythingLLM thường phù hợp với đội nhóm ưu tiên quản lý workspace và widget có thể nhúng, trong khi Open WebUI phù hợp hơn với người dùng muốn hệ plugin lớn và khả năng mở rộng hướng lập trình viên. Một số đội dùng cả hai: Open WebUI cho dev cần kiểm soát chi tiết, và AnythingLLM cho người dùng doanh nghiệp cần workspace tài liệu nhanh.

AnythingLLM so với ChatGPT

So sánh này nói về ưu tiên, không phải công cụ nào "tốt hơn".

|

Khía cạnh |

AnythingLLM |

ChatGPT |

|

Quyền riêng tư dữ liệu |

Toàn quyền sở hữu với mô hình cục bộ |

Dữ liệu gửi đến máy chủ OpenAI |

|

Chi phí |

Miễn phí (tự triển khai); đám mây từ $50/tháng |

Gói miễn phí; Plus $20/tháng; Pro $200/tháng |

|

Tùy biến |

Bất kỳ LLM, embedder, cơ sở dữ liệu vector, tác tử |

Giới hạn ở các mô hình OpenAI |

|

Khả năng ngoại tuyến |

Có (với mô hình cục bộ) |

Không |

|

Công sức thiết lập |

Cần cài đặt |

Không cần thiết lập, chạy trên trình duyệt |

|

Trò chuyện tài liệu |

Kiểm soát RAG đầy đủ (ngưỡng, chia đoạn, reranking) |

Tải tệp với giới hạn sử dụng |

ChatGPT nhấn mạnh trải nghiệm lưu trữ hoàn toàn và chất lượng mô hình mặc định mạnh, trong khi AnythingLLM nhấn mạnh quyền riêng tư, tính linh hoạt và kiểm soát cài đặt RAG. Bạn cũng có thể kết nối GPT-4o với AnythingLLM qua OpenAI API. Điều đó mang đến chất lượng mô hình kiểu ChatGPT cùng các tính năng workspace và RAG của AnythingLLM.

Trường hợp sử dụng AnythingLLM

AnythingLLM phát huy tốt nhất trong các trường hợp sau:

Kho tri thức nội bộ

Nhân viên có thể đặt câu hỏi về tài liệu công ty thay vì lần mò qua các thư mục. Tải lên chính sách, quy trình và tài liệu, rồi để mọi người tìm kiếm bằng ngôn ngữ tự nhiên.

Quy trình nghiên cứu

Giới học thuật có thể tìm kiếm tức thì trong hàng trăm bài báo. Embed thư viện nghiên cứu của bạn và hiển thị phát hiện liên quan mà không cần tìm kiếm từ khóa thủ công.

Triển khai doanh nghiệp riêng tư

Các nhóm y tế, tài chính và pháp lý có thể dùng AI trong khi giữ toàn bộ dữ liệu trên máy chủ của chính mình. Phổ biến trong ngành tuân thủ nghiêm ngặt nơi dữ liệu phải lưu trữ on-premises.

Kiểm thử cho lập trình viên

Thử các LLM khác nhau (Ollama, OpenAI, Claude) trên cùng tài liệu bằng cách chuyển mô hình theo workspace. Không cần thay đổi hạ tầng.

Widget chat cho khách hàng

Nhúng giao diện chat lên website của bạn bằng Docker. Cấu hình danh sách miền cho phép và giới hạn theo phiên cho người dùng công khai.

Chuyển âm cuộc họp

Tính năng Meeting Assistant hoạt động như các công cụ ghi chú đám mây nhưng chạy cục bộ. Cần khoảng 16GB RAM để vận hành mượt.

Hạn chế

Như đã bàn, Desktop và Docker có tính năng khác nhau, điều này dễ gây bối rối cho người mới.

Chất lượng RAG cần tinh chỉnh (tôi đã nêu các thiết lập chính) vì tìm kiếm tương đồng dựa trên toán học và không thực sự hiểu nghĩa.

Hệ thống plugin nhỏ hơn Open WebUI, và xây kỹ năng tác tử tùy chỉnh đòi hỏi kiến thức Node.js.

Cuối cùng, không có fine-tuning tích hợp. Bạn chỉ có thể tùy biến qua system prompt, temperature và giới hạn token.

Bảo mật và Quyền riêng tư của AnythingLLM

Triển khai cục bộ giữ toàn bộ dữ liệu trên thiết bị của bạn. (Tôi có thêm chi tiết ở FAQ thứ ba bên dưới.) Khi dùng nhà cung cấp đám mây, chỉ prompt và các đoạn văn bản được truy xuất được gửi trong quá trình suy luận. Vector và embedding vẫn ở trên máy chủ của bạn. Hãy cân nhắc kỹ workspace nào dùng mô hình đám mây và mô hình cục bộ.

Phiên bản Docker bao gồm Simple SSO qua SIMPLE_SSO_ENABLED, tạo token truy cập tạm thời. API key cấp quyền truy cập đầy đủ mà không có phân quyền chi tiết, vì vậy hãy coi chúng như mật khẩu admin và thay đổi thường xuyên. Nếu bạn mở AnythingLLM ra internet, hãy đặt một reverse proxy Nginx với SSL phía trước (ứng dụng không tự xử lý HTTPS). Có thể tắt telemetry bằng DISABLE_TELEMETRY=true trong tệp .env của bạn.

Kết luận

AnythingLLM giải quyết một vấn đề thực trong lĩnh vực AI tự triển khai. Nó cung cấp giao diện để trò chuyện với tài liệu của bạn, kết nối hầu như mọi nhà cung cấp LLM và giữ dữ liệu trong tầm kiểm soát của bạn. Như đã bàn, chọn Desktop cho sử dụng cá nhân hoặc Docker cho triển khai đội nhóm.

Giống mọi công cụ, nó có đánh đổi. Chất lượng RAG phụ thuộc vào cách bạn cấu hình, và khác biệt tính năng Desktop/Docker có thể gây nhầm lẫn cho người mới.

Bước tiếp theo, hãy xem AI Fundamentals hoặc hướng dẫn về xây dựng AI cục bộ với Docker và n8n.

Tôi là một kỹ sư dữ liệu và người xây dựng cộng đồng, làm việc với pipeline dữ liệu, đám mây và công cụ AI, đồng thời viết các hướng dẫn thực hành, tác động cao cho DataCamp và các nhà phát triển mới nổi.

FAQs

Tôi có thể chạy cái này trên laptop cũ không có GPU không?

Có! Bản thân AnythingLLM khá nhẹ: khoảng 2GB RAM, CPU 2 nhân và khoảng 5GB lưu trữ. Phần nặng là chạy LLM cục bộ qua Ollama. Nếu phần cứng của bạn hạn chế, hãy kết nối với nhà cung cấp đám mây như OpenAI hoặc Groq. Bạn vẫn có cùng workspace và tính năng RAG, nhưng suy luận diễn ra trên đám mây. Nói cách khác, AnythingLLM quản lý quy trình, còn bạn chọn mô hình chạy cục bộ hay trên đám mây.

Điều gì xảy ra nếu sau này tôi đổi cơ sở dữ liệu vector?

Hãy lên kế hoạch trước. Không có di chuyển tự động giữa các cơ sở dữ liệu vector. Chuyển từ LanceDB sang Pinecone đồng nghĩa phải nhúng lại toàn bộ tài liệu. Tệp gốc của bạn vẫn an toàn, nhưng các vector cần tạo lại. Lời khuyên thực tế: gắn bó với LanceDB trừ khi bạn có nhu cầu doanh nghiệp cụ thể. Thường thì nó ít cần cấu hình và phù hợp cho nhiều triển khai đội nhỏ.

Dữ liệu của tôi có thực sự riêng tư nếu tôi dùng OpenAI làm LLM không?

Điểm mấu chốt: tài liệu và embedding của bạn không bao giờ rời máy chủ của bạn. Nhưng khi bạn đặt câu hỏi, các đoạn văn bản được truy xuất và prompt của bạn sẽ được gửi đến API của OpenAI để suy luận. Với dữ liệu thực sự nhạy cảm, hãy dùng Ollama. Mọi thứ ở lại cục bộ. Với tài liệu công việc nói chung, AnythingLLM cùng OpenAI vẫn riêng tư hơn so với việc tải tệp trực tiếp lên ChatGPT.

Đội của tôi có thể dùng chung một thiết lập AnythingLLM không?

Có, nhưng chỉ với phiên bản Docker. Nó hỗ trợ đa người dùng với ba vai trò: Admin, Manager và Default. Ứng dụng Desktop chỉ dành cho một người dùng. Quan trọng: chế độ đa người dùng được thiết kế như thay đổi cấu hình một chiều. Hãy quyết định xem bạn có cần truy cập theo nhóm hay không trước khi bật.

Tại sao đôi khi công cụ bỏ qua tài liệu của tôi khi trả lời?

Thường có ba lý do: ngưỡng tương đồng đặt quá cao, truy vấn mơ hồ, hoặc tài liệu không phải tiếng Anh nhưng dùng embedder tiếng Anh mặc định. Cách khắc phục nhanh: thử "No Restriction" cho ngưỡng trước. Nếu tài liệu của bạn không phải tiếng Anh, hãy chuyển sang mô hình embedding đa ngôn ngữ có sẵn trong Ollama (ví dụ một trong các mô hình dựa trên e5) để có kết quả tốt hơn nhiều.