Lernpfad

KI verändert unsere Welt schneller als je zuvor - von Durchbrüchen im Gesundheitswesen bis hin zu selbstfahrenden Autos hat sie das Potenzial, ganze Branchen umzugestalten. Aber diese Macht birgt auch Risiken wie Voreingenommenheit, Datenschutzprobleme und Verdrängung von Arbeitsplätzen. Ohne die richtigen Leitplanken können diese Risiken zu ernsthaften sozialen, wirtschaftlichen und ethischen Problemen führen.

Die Länder gehen die KI-Regulierung auf sehr unterschiedliche Weise an. Die EU übernimmt die Führung mit detaillierten Gesetzen wie dem EU-KI-Gesetz, das KI nach Risiken einstuft. Die USA halten sich eher zurück und überlassen es der Industrie, sich selbst zu regulieren. China hingegen verfolgt eine rasante KI-Innovation, während es gleichzeitig eine strenge staatliche Kontrolle ausübt, insbesondere in sensiblen Bereichen wie der Überwachung.

Diese unterschiedlichen Ansätze zeigen, wie schwierig es ist, eine Technologie zu regulieren, die Grenzen und Branchen überschreitet. In diesem Artikel gehen wir der Frage nach, warum es wichtig ist, wirksame und ausgewogene KI-Regulierungen zu schaffen, um sicherzustellen, dass KI der Gesellschaft nützt und gleichzeitig den Schaden minimiert.

Bereite dein Team auf das EU-KI-Gesetz vor

Stelle die Einhaltung von Vorschriften sicher und fördere Innovationen, indem du dein Team mit den nötigen KI-Fähigkeiten ausstattest. Beginne noch heute mit dem Aufbau deines KI-Schulungsprogramms mit DataCamp for Business.

Was ist eine KI-Regulierung?

Die KI-Regulierung bezieht sich auf die Gesetze, Politiken und Richtlinien, mit denen die Entwicklung, der Einsatz und die Nutzung von KI-Systemen überwacht werden. Das Ziel der KI-Regulierung ist es, sicherzustellen, dass KI-Technologien ethisch, sicher und verantwortungsbewusst eingesetzt werden und gleichzeitig potenzielle Risiken wie Voreingenommenheit, Verletzung der Privatsphäre und Schaden für den Einzelnen oder die Gesellschaft minimiert werden.

Die KI-Ethik befasst sich mit der Frage, wie KI so entwickelt und eingesetzt werden kann, dass sie fair, verantwortungsbewusst und transparent ist und die menschlichen Werte respektiert. Lies dir unsere KI-Ethik durch: Ein Einführungsblog zum Verständnis der kurz- und langfristigen Risiken von KI .

Die Regulierung von KI umfasst ein breites Spektrum an Themen, darunter:

- Datenschutz: Sicherstellen, dass KI-Systeme personenbezogene Daten in Übereinstimmung mit den Datenschutzgesetzen verarbeiten.

- Vorurteile und Fairness: Verhindern, dass KI Diskriminierung und Vorurteile aufrechterhält oder verstärkt.

- Transparenz: KI-Systeme erklärbar und verständlich machen, damit ihre Entscheidungen klar und nachvollziehbar sind.

- Sicherheit: Sicherstellen, dass KI-Technologien keinen Schaden anrichten, insbesondere in kritischen Sektoren wie dem Gesundheitswesen, dem Finanzwesen und autonomen Systemen.

- Rechenschaftspflicht: Festlegung einer klaren Verantwortung für die von KI-Systemen getroffenen Entscheidungen, einschließlich eines rechtlichen Rahmens für die Haftung.

- Wirtschaftliche, ökologische und soziale Auswirkungen: Umgang mit potenziellen Arbeitsplatzverlagerungen und wirtschaftlichen Ungleichheiten, Umwelt und gesellschaftlichen Veränderungen, die sich aus der KI ergeben.

Folge dem Datacamp KI-Grundlagen-Track um die Grundlagen der KI zu entdecken, in Modelle wie ChatGPT einzutauchen und die Geheimnisse der generativen KI zu entschlüsseln, um sich in der dynamischen KI-Landschaft zurechtzufinden.

Warum ist eine KI-Regulierung notwendig?

Das Potenzial der KI birgt erhebliche Risiken, weshalb eine Regulierung notwendig ist. Eine der größten Sorgen ist die Möglichkeit schädlicher Folgen. Ein Beispiel, KI-Systeme, die in der Strafjustiz eingesetzt werden, haben Voreingenommenheit gezeigt, die sich unverhältnismäßig stark auf marginalisierte Gemeinschaften auswirken. Wenn sie nicht richtig gehandhabt wird, könnte KI die bestehenden sozialen Ungleichheiten noch verschärfen.

Außerdem ist das "Blackbox"-Problem eine einzigartige Herausforderung für KI. Viele KI-Systeme funktionieren auf eine Art und Weise, die selbst ihre Schöpfer nicht vollständig erklären können. Ohne Transparenz ist es schwierig zu verstehen, wie diese Systeme Entscheidungen treffen, was Bedenken hinsichtlich der Rechenschaftspflicht aufkommen lässt.

Voreingenommenheit ist ein weiterer kritischer Punkt. KI-Systeme sind nur so gut wie die Daten, auf denen sie trainiert werden, und wenn diese Daten gesellschaftliche Vorurteile widerspiegeln, wird das auch die KI tun. Dies kann zu ungerechten Ergebnissen in Bereichen wie Einstellung, Kreditvergabe und Strafverfolgung führen.

Im Jahr 2023 berichtete Forbes über eine Sammelklage gegen UnitedHealthcare (dem größten Krankenversicherer in den USA), in der behauptet wird, dass älteren Patienten durch den Einsatz eines KI-Algorithmus zu Unrecht erweiterte Pflegeleistungen verweigert werden.

Ohne einen ordnungspolitischen Rahmen ist die Gesellschaft möglicherweise nicht auf diese wirtschaftlichen Veränderungen vorbereitet, was zu Ungleichheit und Instabilität führt. Sieh dir unbedingt unseren Artikel KI im Gesundheitswesen an: Enhancing Diagnostics, Personalizing Treatment, and Streamlining Operations; es wird untersucht, wie KI die Zukunft des Gesundheitswesens beeinflusst und wie Unternehmen mit neuen KI-Fähigkeiten und -Technologien überleben können .

Und schließlich könnte KI den Arbeitsmarkt durcheinanderbringen und Arbeitnehmer/innen verdrängen, wenn sich die Automatisierung durchsetzt. McKinsey berichtet dass aktuelle Generative KI und andere KI-Technologien das Potenzial haben, Arbeitstätigkeiten zu automatisieren, die heute bis zu 70 Prozent der Zeit der Beschäftigten in Anspruch nehmen.

Diese Verschiebungen bedeuten, dass bis zu 12 Millionen Beschäftigte in Europa und den Vereinigten Staaten ihren Arbeitsplatz wechseln müssen. Einige Arbeitnehmer benötigen möglicherweise Unterstützung bei Umschulung und Höherqualifizierung um auf dem neuen Markt wettbewerbsfähig zu sein.

Der aktuelle Stand der KI-Regulierung

Werfen wir einen Blick auf die aktuellen Gesetze und Vorschriften, die den fairen Einsatz von KI-Tools gewährleisten:

Die KI-Verordnung der Europäischen Union

Das im April 2021 vorgeschlagene KI-Gesetz der Europäischen Union stellt den ersten umfassenden Rechtsrahmen zur Regulierung von KI in der Europäischen Union (EU) dar. Der EU AI Act ist eine bahnbrechende Initiative, die vom EU AI Office ausgearbeitet wurde, um die Zukunft der KI in Europa zu regeln. Ihr Ziel ist es, die potenziellen Risiken von KI-Systemen zu mindern und gleichzeitig die Innovation und Wettbewerbsfähigkeit auf dem europäischen KI-Markt zu fördern.

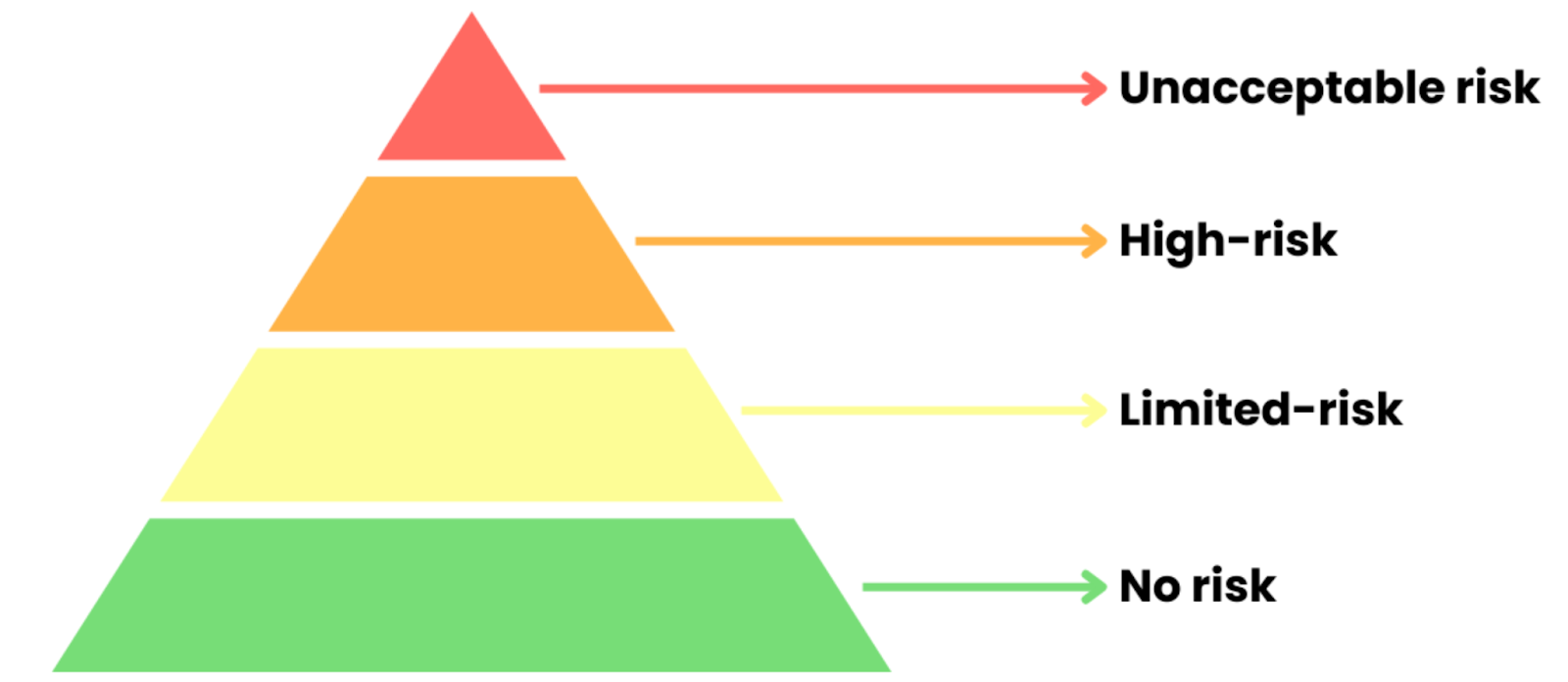

Das EU-KI-Gesetz basiert auf einem risikobasierten Ansatz für die Regulierung, der KI-Systeme nach dem Grad des Risikos kategorisiert, das sie für den Einzelnen und die Gesellschaft darstellen. Das Gesetz unterteilt KI-Systeme in vier verschiedene Risikokategorien:

Quelle: Datacamp-Kurs "Das EU-KI-Gesetz verstehen

- Inakzeptables Risiko: KI-Systeme, die Sicherheit, Rechte oder demokratische Werte bedrohen, sind verboten (z. B. Social Scoring, schädliche Manipulation).

- AI mit hohem Risiko: KI in kritischen Bereichen wie dem Gesundheitswesen oder der Strafverfolgung. Erfordert strenge Tests, Transparenz und menschliche Aufsicht, um die EU-Standards vor der Verwendung zu erfüllen.

- Begrenztes Risiko AI: Dazu gehören Chatbots und virtuelle Assistenten. Die Nutzer müssen informiert sein, wenn sie mit KI interagieren, aber mit weniger Vorschriften.

- Minimales Risiko AI: Anwendungen mit geringem Risiko wie Spamfilter oder Spiele-KI. Weitgehend von der Regulierung ausgenommen.

Beachten Sie unbedingt unsere EU-KI-Gesetz Grundlagen um das EU-KI-Gesetz und die KI-Grundlagen zu beherrschen. In diesem Kurs lernst du, wie du mit Vorschriften umgehst und das Vertrauen in verantwortungsvolle KI förderst.

Das EU-KI-Gesetz legt einen starken Fokus auf Transparenz, insbesondere bei generativen KI-Systemen wie ChatGPT, die Inhalte erstellen und direkt mit den Nutzern interagieren. Je nachdem, wie sie eingesetzt werden, können diese Systeme nach dem Gesetz entweder als risikoreich oder als begrenzt risikoreich eingestuft werden. Eine wichtige Voraussetzung ist, dass die Nutzerinnen und Nutzer klar informiert werden, wenn sie mit einer KI interagieren. Für generative Modelle bedeutet dies:

- KI Offenlegung: Die Entwickler müssen klar angeben, wann Inhalte von KI generiert wurden. Das hilft den Nutzern zu verstehen, dass sie mit einer Maschine und nicht mit einer Person kommunizieren.

- Erklärbarkeit: Obwohl generative KI-Systeme komplex sein können, verlangt das EU-KI-Gesetz ein gewisses Maß an Klarheit. Die Anbieter von KI-Modellen müssen genügend Informationen bereitstellen, damit Nutzer und Regulierungsbehörden verstehen können, wie das System funktioniert und Entscheidungen trifft. Dazu gehört auch die Weitergabe von Details zu den zugrunde liegenden Algorithmen und Trainingsdaten, wenn nötig.

Um diese Regeln durchzusetzen, richtet die EU sowohl auf nationaler als auch auf EU-Ebene Aufsichtsgremien ein, die die Einhaltung der Regeln überwachen. Diese Stellen können KI-Systeme prüfen, Verstöße untersuchen und Strafen von bis zu 30 Millionen Euro oder 6% des weltweiten Umsatzes verhängen, je nachdem, welcher Betrag höher ist.

Um mehr über das EU-KI-Gesetz zu erfahren, solltest du unseren Kurs Kurs zum Verständnis des EU-KI-Gesetzesin dem du die KI-Risikokategorien und die Einhaltung der Vorschriften anhand von Beispielen aus den Bereichen biometrische KI, Bildung und Allzweckmodelle kennenlernst.

KI-Regulierung in den Vereinigten Staaten

Die Vereinigten Staaten verfolgen bei der Regulierung von KI einen flexibleren, sektoralen Ansatz. Es gibt zwar kein umfassendes KI-Gesetz auf Bundesebene, aber mehrere bestehende Gesetze, Gesetzesentwürfe und Richtlinien auf Bundes- und Länderebene prägen die Steuerung von KI-Systemen.

Bestehende Bundesgesetze und Vorschriften

Hier sind die Gesetze und Vorschriften, die derzeit in den USA gelten:

Gesetz der Federal Trade Commission (FTC)

Die FTC hat weitreichende Befugnisse, um Verbraucher vor unlauteren oder irreführenden Praktiken zu schützen. Dazu gehört auch die Regulierung von KI-Systemen, die möglicherweise zu diskriminierenden Praktiken oder irreführenden Ergebnissen führen könnten, insbesondere in der Werbung und bei der Nutzung von Verbraucherdaten.

Bürgerrechtsgesetze

Verschiedene Bürgerrechtsgesetze verbieten Diskriminierung in den Bereichen Beschäftigung, Wohnen und Kreditvergabe. Diese Gesetze sind für KI-Anwendungen relevant, die unbeabsichtigt zu Vorurteilen führen können, wie z. B. Algorithmen, die für Einstellungen oder Kreditwürdigkeitsprüfungen verwendet werden. Behörden wie die Equal Employment Opportunity Commission (EEOC) nehmen KI-Systeme zunehmend auf die Einhaltung dieser Gesetze hin unter die Lupe.

Health Insurance Portability and Accountability Act (HIPAA)

Im Gesundheitswesen müssen KI-Anwendungen die HIPAA-Bestimmungen zum Datenschutz und zur Sicherheit von Gesundheitsdaten einhalten. Dazu gehört auch, dass jede KI, die bei der Patientenversorgung eingesetzt wird, die Vertraulichkeit und die Rechte der Patienten respektiert.

Vorgeschlagene Bundesgesetzgebung

Es gibt auch Gesetzesentwürfe, die noch nicht bestätigt wurden:

Algorithmic Accountability Act

Vorgeschlagen im Jahr 2022, dieser Gesetzentwurf soll Unternehmen dazu verpflichten, die Auswirkungen automatisierter Entscheidungsfindungssysteme auf die Verbraucher zu bewerten. Sie schreibt Prüfungen für Algorithmen vor, die in Bereichen mit hohen Anforderungen eingesetzt werden, um Verzerrungen zu erkennen und zu verringern.

AI Bill of Rights

Ende 2022 veröffentlichte die Biden-Administration einen Entwurf für eineAI Bill of Rightsdie Grundsätze für den verantwortungsvollen Einsatz von KI festlegt, darunter Fairness, Transparenz und das Recht, gegen automatisierte Entscheidungen Einspruch zu erheben.

Vorschriften auf Staatsebene

Auf staatlicher Ebene haben verschiedene Gerichtsbarkeiten die Initiative ergriffen, um eigene KI-Vorschriften einzuführen, die sich oft auf den Datenschutz und die Verringerung von Vorurteilen konzentrieren:

Kalifornisches Verbraucherschutzgesetz (CCPA)

Dieses bahnbrechende Gesetz gibt den Verbraucherinnen und Verbrauchern das Recht zu erfahren, wie ihre persönlichen Daten gesammelt, verwendet und weitergegeben werden. Sie wirkt sich direkt auf KI-Systeme aus, die personenbezogene Daten nutzen, und erfordert Transparenz und die Zustimmung der Verbraucher.

New York City Gesetz über automatisierte Entscheidungshilfen für die Beschäftigung

Wirksam im Jahr 2023, dieses Gesetz schreibt vor, dass Unternehmen, die automatisierte Tools für die Personalbeschaffung einsetzen, jährliche Bias-Audits durchführen müssen, um die Auswirkungen ihrer KI-Systeme auf verschiedene demografische Gruppen zu bewerten.

Sektorspezifische Vorschriften

Neben den Vorschriften auf Bundes- und Landesebene gibt es auch einige branchenspezifische KI-Vorschriften:

Autonome Fahrzeuge

Die U.S.A. Das Verkehrsministerium hat Richtlinien für die Erprobung und den Einsatz von autonomen Fahrzeugenherausgegeben, in denen Sicherheit und Verantwortlichkeit betont werden. Diese Richtlinien verlangen von den Unternehmen, dass sie nachweisen, dass ihre selbstfahrenden Technologien den Sicherheitsstandards entsprechen, bevor sie auf öffentlichen Straßen eingesetzt werden können.

Gesundheitswesen

KI-Anwendungen im Gesundheitswesen, wie z.B. Diagnoseinstrumente und Behandlungsempfehlungen, werden von der Food and Drug Administration (FDA) unter die Lupe genommen, die daran arbeitet, Regulierungswege für KI-Technologien zu schaffen, um sicherzustellen, dass sie sicher und effektiv sind.

Chinas Ansatz zur KI-Regulierung

Chinas Ansatz für die KI-Governance ist staatlich gelenkt und schafft einen Ausgleich zwischen schneller Innovation und strenger Regulierung. Es geht darum, eine starke staatliche Kontrolle aufrechtzuerhalten und gleichzeitig die Sicherheit zu gewährleisten und die ethische Nutzung zu fördern.

Der Rahmen umfasst eine Reihe von Strategien und Richtlinien, die die Entwicklung und Nutzung von KI bestimmen. Die wichtigsten Merkmale sind:

Zentralisierte Verwaltung

Die chinesische Regierung spielt über verschiedene Ministerien wie das Ministerium für Wissenschaft und Technologie eine entscheidende Rolle bei der Regulierung von KI. Diese zentrale Kontrolle ermöglicht eine einheitliche Durchsetzung der Vorschriften in verschiedenen Sektoren und Regionen.

Gesetzgebung und Richtlinien

Bedeutende Gesetze wie das Datensicherheitsgesetz und das Gesetz zum Schutz persönlicher Daten setzen klare Standards für den Umgang mit Daten in KI-Anwendungen. Außerdem sind die Ethischen Richtlinien für KI Grundsätze, an die sich KI-Systeme halten müssen, und betonen die Menschenrechte, den Datenschutz und die Sicherheit.

Fokus auf nationale Sicherheit

Die Regulierungslandschaft legt großen Wert auf die nationale Sicherheit. KI-Anwendungen werden einer strengen Prüfung unterzogen, um sicherzustellen, dass sie die öffentliche Ordnung oder die Sicherheit des Staates nicht gefährden. Diese Aufsicht ist besonders wichtig für Technologien, die Auswirkungen auf die gesellschaftliche Stabilität oder die Regierungsführung haben könnten.

Das zentralisierte Steuerungsmodell wirft Bedenken hinsichtlich der Transparenz und Rechenschaftspflicht auf, da eine eingeschränkte öffentliche Kontrolle möglicherweise unkontrollierte staatliche Macht im Bereich der KI ermöglicht.

Im Jahr 2023 führte China die Vorschriften für die Verwaltung von Dienstleistungen im Bereich der generativen künstlichen Intelligenzeingeführt, die einen Rahmen für die Entwicklung, den Einsatz und die Nutzung von generativen KI-Technologien vorgeben. Einige seiner herausragenden Eigenschaften sind:

- Obligatorische Sicherheitskontrollen: Unternehmen brauchen eine staatliche Genehmigung, bevor sie inhaltsgenerierende KI einführen, um sicherzustellen, dass die Systeme keine Risiken für nationale Interessen oder die Stabilität darstellen.

- Strenge Inhaltskontrolle: Generative KI-Outputs werden streng reguliert, um Fehlinformationen oder Inhalte, die das soziale Gleichgewicht stören, zu verhindern und gegebenenfalls zu zensieren.

- Hohe Compliance-Standards: Unternehmen müssen ihre Algorithmen, Datenquellen und Prozesse transparent machen, um strenge Vorschriften zu erfüllen, die Rechenschaftspflicht zu erhöhen und Missbrauch zu verhindern.

Da KI die Industrie verändert, ist es wichtig, ihre ethischen und geschäftlichen Risiken zu verstehen. Unternehmen müssen nicht nur das Potenzial der KI nutzen, sondern auch sicherstellen, dass sie verantwortungsvoll und transparent eingesetzt wird.

In unserem Webinar, "Vorschriften für KI in den USA, der EU und der ganzen Welt verstehen" ( ) erläutern Shalini Kurapati (CEO, Clearbox AI) und Nick Reiners (Senior Analyst, Eurasia Group) die wichtigsten KI-Richtlinien, regulatorische Trends und Compliance-Strategien. Du erfährst, wie sich neue Vorschriften auf Unternehmen auswirken, und erhältst praktische Tipps für die KI-Governance, wobei der Schwerpunkt auf den USA, der EU und globalen Rahmenbedingungen liegt.

Die Zukunft der KI-Regulierung

Nachdem wir nun die aktuelle Landschaft der Vorschriften rund um KI kennen, ist es an der Zeit, einen Blick auf das zu werfen, was als Nächstes kommt. So wie sich diese Instrumente weiterentwickeln, müssen sich auch unsere Gesetze und Vorschriften weiterentwickeln.

Die Notwendigkeit einer internationalen Zusammenarbeit und eines globalen Regulierungsrahmens

KI ist eine globale Technologie, und eine wirksame Regulierung erfordert internationale Zusammenarbeit. KI-Systeme sind häufig grenzüberschreitend, was es für ein einzelnes Land schwierig macht, sie umfassend zu regulieren.

KI-Anwendungen in Bereichen wie autonome Fahrzeuge, Gesundheitswesen, Finanzen und Sicherheit sind oft mit grenzüberschreitenden Datenströmen verbunden, was Bedenken hinsichtlich Privatsphäre, Datenschutz und ethischen Standards aufwirft. Dieser globale Charakter erfordert einen koordinierten Ansatz für die KI-Governance. Ziele der internationalen Zusammenarbeit sind:

- Standardausrichtung: Gemeinsame Grundsätze wie Transparenz, Rechenschaftspflicht und Fairness aufstellen, um einheitliche globale Richtlinien für den Einsatz von KI zu schaffen.

- Datenschutz und Datensicherheit: Gemeinsame Regeln für den grenzüberschreitenden Datenaustausch aufstellen, um die Privatsphäre zu schützen und ethische KI-Anwendungen zu gewährleisten und gleichzeitig die nationalen Gesetze zu respektieren.

- KI-Voreingenommenheit bekämpfen: Zusammenarbeit auf globaler Ebene, um bewährte Verfahren auszutauschen, Vorurteile aufzudecken und Strategien für fairere KI-Systeme und gerechte Ergebnisse zu entwickeln.

Schau dir unseren Kurs an, Verantwortungsvolles KI-Datenmanagementin dem du die Grundlagen eines verantwortungsvollen Umgangs mit Daten lernst, einschließlich der Datenerfassung, der wichtigsten Vorschriften und der Strategien zur Datenvalidierung und Bias-Minderung. Y

Du kannst diese Fähigkeiten anwenden, um bei jedem Datenprojekt kritisch zu denken und sicherzustellen, dass du ein erfolgreiches, verantwortungsvolles und gesetzeskonformes Projekt von Anfang bis Ende durchführst.

Herausforderungen für einen globalen KI-Rechtsrahmen

Trotz der Notwendigkeit einer internationalen Zusammenarbeit steht die Schaffung eines einheitlichen globalen Rahmens für die KI-Regulierung vor mehreren Herausforderungen:

- Unterschiedliche nationale Prioritäten: Verschiedene Länder setzen unterschiedliche Prioritäten bei der Regulierung von KI - die USA z.B. konzentrieren sich auf Innovation, die EU auf Datenschutz und China auf staatliche Kontrolle - was einen einheitlichen globalen Ansatz schwierig macht.

- Geopolitische Spannungen: Rivalitäten zwischen großen KI-Akteuren wie den USA und China führen zu konkurrierenden Rahmenbedingungen und Bedenken hinsichtlich Technologietransfer und nationaler Sicherheit, was die Zusammenarbeit erschwert.

- Ethische und kulturelle Unterschiede: Unterschiedliche Ansichten zu Überwachung, Datenschutz und Menschenrechten machen es schwierig, universelle ethische Standards für die Regulierung von KI zu schaffen.

Bemühungen um einen globalen KI-Rahmen

Trotz der Herausforderungen gibt es laufende Bemühungen, die internationale Zusammenarbeit bei der KI-Governance zu fördern:

Vereinte Nationen und AI for Good

Die Vereinten Nationen haben Diskussionen über die globale KI-Regulierung durch Foren wie AI for Goodinitiiert, die Experten, politische Entscheidungsträger und Branchenführer zusammenbringen, um die potenziellen Vorteile und Risiken von KI zu untersuchen. Diese Diskussionen zielen darauf ab, internationale Normen für die KI-Entwicklung zu gestalten, insbesondere in Bereichen wie Nachhaltigkeit und Menschenrechte.

Globale Partnerschaften für KI (GPAI)

Start im Jahr 2020, GPAI ist eine internationale Initiative, die die verantwortungsvolle Entwicklung von KI durch grenzüberschreitende Zusammenarbeit fördert. Ihr gehören u.a. führende KI-Länder wie Kanada, Frankreich, Japan und Indien an. Ziel ist es, bewährte Verfahren zu fördern, Daten auszutauschen und Innovationen zu unterstützen und gleichzeitig ethische Standards einzuhalten.

KI-Sicherheitsgipfel

Das Vereinigte Königreich war Gastgeber des ersten globalen KI-Sicherheitsgipfel im November 2023. Sie brachte weltweit führende Persönlichkeiten, Technikexperten und politische Entscheidungsträger zusammen, um sich mit den kritischen Herausforderungen der sicheren und ethischen Entwicklung von KI auseinanderzusetzen. Die Veranstaltung unterstrich, wie wichtig es ist, einen Rahmen für die Sicherheit von KI zu schaffen. Dabei geht es vor allem darum, die Entwicklung von KI mit globalen Sicherheits- und Ethikstandards in Einklang zu bringen und gleichzeitig Innovationen zu fördern.

Wenn die Öffentlichkeit keinen Druck für stärkere ethische Standards und Transparenz ausübt, können Unternehmen ihre Gewinne über die Sicherheit stellen, und Regierungen können Regulierungen vermeiden, bis der Schaden offensichtlich ist. Aber wenn die Menschen Rechenschaft fordern, zwingt das die Gesetzgeber zum Handeln und zur Schaffung von Richtlinien, die sicherstellen, dass KI der Gesellschaft nützt und nicht die Privatsphäre oder Fairness untergräbt.

Wie Bruce Schneier in unserer DataFramed-Folge über Vertrauen und Regulierung in der KI:

Nichts wird sich ändern, wenn die Regierung es nicht erzwingt, und die Regierung wird es nicht erzwingen, wenn wir, das Volk, es nicht fordern.

Bruce Schneier, Security Technologist

Der Bedarf an Fortbildung und Umschulung

Nicht nur die Gesetzgebung muss im Zuge der KI aktualisiert werden, auch die Arbeitskräfte müssen sich anpassen. In dem Maße, in dem Automatisierung und intelligente Systeme Routineaufgaben übernehmen, werden neue Fähigkeiten erforderlich.

Wie wir in unserem State of Data & AI Literacy Reporthervorheben, wird es immer wichtiger, die Arbeitskräfte mit KI-Kenntnissen, technischen Fähigkeiten und Datenkompetenz auszustatten, um in der sich entwickelnden Arbeitswelt erfolgreich zu sein.

62 % der Führungskräfte sind der Meinung, dass KI-Kenntnisse für die täglichen Aufgaben ihrer Teams wichtig sind. Für Unternehmen besteht die Herausforderung nicht nur darin, mit dem technologischen Wandel Schritt zu halten, sondern auch sicherzustellen, dass ihre Teams in der Lage sind, diese Tools verantwortungsvoll und strategisch zu nutzen.

Dies erfordert einen strukturierten Lernansatz, der grundlegende KI-Konzepte, ethische Überlegungen und fortgeschrittene technische Schulungen umfasst.

Organisationen, die in die Fortbildung und Umschulung sind besser in der Lage, die Verlagerung von Arbeitsplätzen abzumildern, Innovationen zu fördern und wettbewerbsfähig zu bleiben. Umfassende Lernprogramme, die auf diese Bedürfnisse eingehen, können die Lücke schließen und sowohl technische als auch nicht-technische Teams darauf vorbereiten, KI-Systeme zu verstehen, einzusetzen und effektiv zu steuern.

DataCamp für Unternehmen kann deinen Teams helfen, sich im Bereich KI weiterzubilden, unabhängig von der Größe deines Unternehmens. Mit maßgeschneiderten Lernpfaden, detaillierten Berichten und einem engagierten Erfolgsteam kannst du deine KI-Ziele in kürzester Zeit erreichen.

Verbessere die KI-Fähigkeiten deines Teams

Verändere dein Unternehmen, indem du deinem Team mit dem DataCamp for Business fortgeschrittene KI-Kenntnisse vermittelst. Erreiche bessere Einblicke und mehr Effizienz.

Fazit

Die Regulierung von KI ist der Schlüssel, um sicherzustellen, dass sie der Gesellschaft nützt und gleichzeitig ihre Risiken beherrscht. Da sich KI in allen Sektoren so schnell weiterentwickelt, können die bestehenden Vorschriften oft nicht Schritt halten.

Wenn KI in Bereiche wie generative Modelle, autonome Entscheidungsfindung und Deep Learning vordringt, reichen die alten Regeln vielleicht nicht mehr aus. Die eigentliche Herausforderung besteht darin, anpassungsfähige Vorschriften zu schaffen, die sich mit der Technologie weiterentwickeln können - ein Gleichgewicht zwischen Innovation und verantwortungsvoller Aufsicht.

Wenn du ein tieferes Verständnis von KI und ihren Auswirkungen erlangen möchtest, schau dir unsere KI-Grundlagen um dein Wissen zu vertiefen und der Entwicklung einen Schritt voraus zu sein.

Ich habe in verschiedenen Branchen gearbeitet und mehrere Aufgaben übernommen: Softwareentwickler, Forscher für maschinelles Lernen, Datenwissenschaftler und Produktmanager. Aber im Grunde bin ich ein Programmierer, der es liebt, zu lernen und sein Wissen zu teilen!