Curso

En noviembre de 2022, OpenAI lanzó ChatGPT. Bastaron unos pocos días para que tomara al mundo por asalto con sus capacidades sin precedentes. La revolución de la IA generativa había comenzado, y todo el mundo se hacía la misma pregunta: ¿qué es lo siguiente?

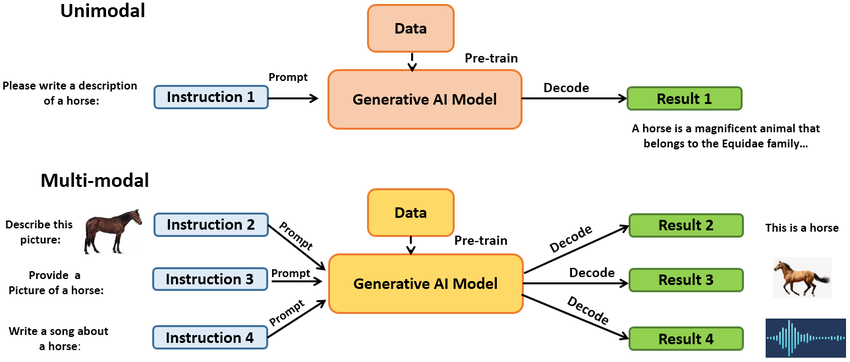

En aquel momento, ChatGPT y muchas otras herramientas de IA generativa basadas en grandes modelos lingüísticos (LLM) se diseñaron para procesar entradas de texto de los usuarios y generar salidas de texto. En otras palabras, se consideraban herramientas de IA unimodales.

Sin embargo, esto era sólo el principio. Sólo estábamos arañando la superficie de lo que los LLM pueden hacer. Sólo un año después del lanzamiento de ChatGPT, el progreso de la industria es sencillamente asombroso, lo que hace muy difícil localizar las fronteras de lo posible, como analizamos en nuestro artículo separado sobre los impactos a largo plazo de ChatGPT y la IA Generativa.

Hoy en día, si tuviéramos que responder a la pregunta de ¿qué es lo próximo? la mejor respuesta es probablemente el aprendizaje multimodal. Ésta es una de las tendencias más prometedoras de la actual revolución de la IA. Los modelos de IA generativa multimodal son capaces de combinar varios tipos de entradas y crear una salida que también puede incluir varios tipos de salidas.

En esta guía, te llevaremos a través del concepto de IA multimodal. Analizaremos la definición de IA multimodal, sus conceptos básicos, las tecnologías subyacentes y sus aplicaciones, así como la forma de aplicarlas en escenarios del mundo real. ¿Preparado para la multimodalidad? ¡Empecemos!

Comprender la IA Multimodal

Aunque la mayoría de las herramientas avanzadas de IA generativa siguen siendo incapaces de pensar como los humanos, están ofreciendo resultados revolucionarios que nos acercan un poco más al umbral de la Inteligencia Artificial General (IAG). Este término se refiere a un hipotético sistema de IA que puede comprender, aprender y aplicar conocimientos en una amplia gama de tareas, de forma muy parecida a un ser humano.

En el debate sobre cómo lograr la AGI, una cuestión central que debemos abordar es cómo aprenden los humanos. Y esto nos lleva a cómo funciona el cerebro humano. Para abreviar, nuestro cerebro se basa en nuestros cinco sentidos para recoger todo tipo de información del entorno que nos rodea. Esa información se almacena en nuestra memoria, se procesa para aprender nuevas ideas y se aprovecha para tomar decisiones.

Los primeros modelos modernos de IA generativa, como ChatGPT, se consideraban unimodales; es decir, sólo podían tomar un tipo de datos como entrada y generar el mismo tipo de salida. En concreto, la mayoría de estos modelos se diseñaron para procesar indicaciones textuales y generar una respuesta textual.

Esto tiene sentido, ya que estos modelos necesitan grandes cantidades de datos para ser entrenados, y el texto no sólo es un tipo de datos que se puede almacenar y procesar fácilmente, sino que también está fácilmente disponible. No es sorprendente que la mayoría de los datos de entrenamiento de herramientas como ChatGPT procedan de distintas fuentes de Internet. Explicamos todos estos tecnicismos en nuestro artículo Qué es ChatGPT , donde formulamos las preguntas directamente a ChatGPT.

Sin embargo, la lectura es sólo una de las diversas formas que tiene el ser humano de aprender cosas nuevas y, para muchas tareas, no es la más eficaz.

El aprendizaje multimodal es un subcampo de la IA que intenta aumentar la capacidad de aprendizaje de las máquinas entrenándolas con grandes cantidades de texto, así como con otros tipos de datos, también conocidos como datos sensoriales, como imágenes, vídeos o grabaciones de audio. Esto permite a los modelos aprender nuevos patrones y correlaciones entre las descripciones de texto y sus imágenes, vídeos o audio asociados.

El aprendizaje multimodal está abriendo nuevas posibilidades a los sistemas inteligentes. La combinación de múltiples tipos de datos durante el proceso de entrenamiento hace que los modelos multimodales de IA sean adecuados para recibir múltiples modalidades de tipo de entrada y generar múltiples tipos de salida. Por ejemplo, GPT-4, el modelo base de ChatGPT, puede aceptar tanto entradas de imagen como de texto y generar salidas de texto, y el modelo de texto a vídeo Sora de OpenAI, anunciado recientemente.

Conceptos básicos de la IA multimodal

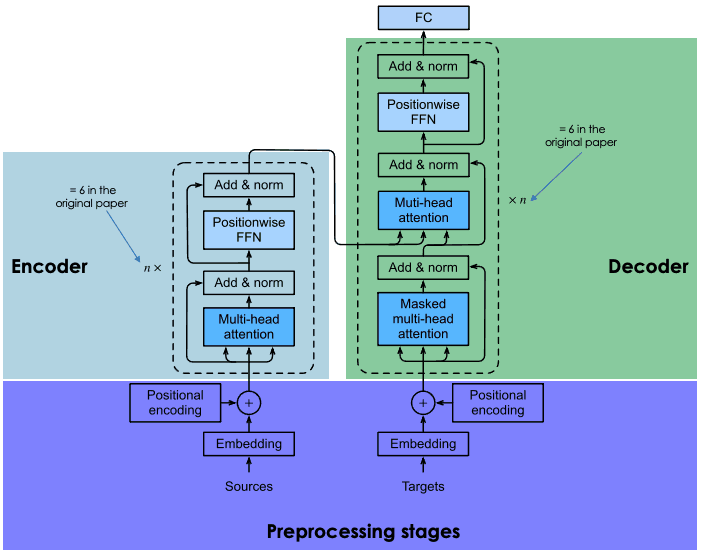

Los modelos de IA generativa multimodal añaden una nueva capa de complejidad a los LLM de última generación. Estos modelos se basan en un tipo de arquitectura neuronal llamada Transformador. Desarrollados por investigadores de Google, los transformadores se basan en la arquitectura codificador-decodificador y en el mecanismo de atención para permitir un procesamiento eficaz de los datos.

Se trata de un proceso bastante complejo que puede resultar difícil de entender. Si quieres obtener más detalles sobre cómo funcionan los LLM y los transformadores, te recomendamos encarecidamente que leas nuestra guía Cómo funcionan los transformadores o, si quieres ponerte manos a la obra y aprender a crear LLM paso a paso, consulta nuestro Curso de Conceptos sobre Modelos de Lenguaje Amplios (LLM).

Fuente: DataCamp

La IA multimodal se basa en técnicas de fusión de datos para integrar tipos de datos dispares y construir una comprensión más completa y precisa de los datos subyacentes. El objetivo final es hacer mejores predicciones combinando la información complementaria que proporcionan las distintas modalidades de datos.

IA Unimodal vs Multimodal. Fuente: ResearchGate

Se pueden aplicar varias técnicas de fusión de datos para abordar los retos multimodales. En función de la fase de procesamiento en la que se produce la fusión, podemos clasificar las técnicas de fusión de datos en tres categorías:

- Fusión precoz. Se trata de codificar las distintas modalidades en el modelo para crear un espacio de representación común. Este proceso da como resultado una única salida invariante de la modalidad que encapsula la información semántica de todas las modalidades.

- Fusión media. Consiste en combinar modalidades en distintas fases de preprocesamiento. Esto se consigue creando capas especiales en la red neuronal diseñadas específicamente para la fusión de datos.

- Fusión tardía. Implica crear múltiples modelos para procesar las distintas modalidades y combinar la salida de cada modelo en una nueva capa algorítmica.

No existe una única técnica de fusión de datos que sea la mejor para todo tipo de escenarios. En cambio, la técnica elegida dependerá de la tarea multimodal de que se trate. Por lo tanto, es probable que sea necesario un proceso de prueba y error para encontrar el conducto de IA multimodal más adecuado.

Tecnologías que potencian la IA multimodal

La IA multimodal es el resultado del conocimiento acumulado en múltiples subcampos de la IA. En los últimos años, los profesionales y estudiosos de la IA han hecho progresos impresionantes en el almacenamiento y procesamiento de datos en múltiples formatos y modalidades.

A continuación encontrarás una lista de los dominios que están alimentando el auge de la IA multimodal:

Aprendizaje profundo

El aprendizaje profundo es un subcampo de la IA que emplea un tipo de algoritmo llamado red neuronal artificial para abordar tareas complejas. La actual revolución de la IA generativa está impulsada por modelos de aprendizaje profundo, en particular transformadores, que son un tipo de arquitectura neuronal.

El futuro de la IA multimodal también dependerá de los nuevos avances en este ámbito. En particular, es muy necesaria la investigación para encontrar nuevas formas de aumentar las capacidades de los transformadores, así como nuevas técnicas de fusión de datos.

Consulta nuestro Curso de Aprendizaje Profundo en Python para profundizar en este prometedor campo.

Procesamiento del Lenguaje Natural (PLN)

La PNL es una tecnología fundamental de la inteligencia artificial, que tiende un puente entre la comunicación humana y la comprensión informática. Es un ámbito multidisciplinar que capacita a los ordenadores para interpretar, analizar y generar lenguaje humano, permitiendo una interacción fluida entre humanos y máquinas.

Dado que la principal forma de comunicarse con las máquinas es a través del texto, no es de extrañar que la PNL sea fundamental para garantizar el alto rendimiento de los modelos generativos de IA, incluidos los multimodales.

¿Te interesa la PNL? Consulta nuestro Curso de Procesamiento del Lenguaje Natural en Python para adquirir los conocimientos básicos de PLN necesarios para convertir datos no estructurados en información valiosa.

Visión por ordenador

El análisis de imágenes, también conocido como visión por ordenador, comprende un conjunto de técnicas mediante las cuales los ordenadores pueden "ver" y comprender una imagen. Los avances en este sector han permitido el desarrollo de modelos multimodales de IA que pueden procesar imágenes y vídeos como entradas y salidas.

Si estás interesado en profundizar en este fascinante tema, consulta nuestro Curso de Procesamiento de Imágenes con Python para incorporar conocimientos de procesamiento de imágenes a tu caja de herramientas de la ciencia de datos.

Procesamiento de audio

Algunos de los modelos de IA generativa más avanzados son capaces de procesar archivos de audio como entradas y salidas. Las posibilidades del procesamiento de audio van desde la interpretación de mensajes de voz a la traducción simultánea y la creación de música.

Consulta nuestro Curso de Procesamiento del Lenguaje Hablado en Python para aprender a cargar, transformar y transcribir el habla a partir de archivos de audio sin procesar en Python.

Aplicaciones de la IA Multimodal

El aprendizaje multimodal permite a las máquinas adquirir nuevos "sentidos", aumentando su precisión y capacidad de interpretación. Estos poderes están abriendo la puerta a una miríada de nuevas aplicaciones en todos los sectores e industrias, entre ellas:

IA generativa aumentada

La mayoría de la primera generación de modelos generativos de IA eran de texto a texto, capaces de procesar las indicaciones textuales de los usuarios y proporcionar respuestas textuales. Los modelos multimodales, como GPT-4 Turbo, Google Gemini o DALL-E, ofrecen nuevas posibilidades que pueden mejorar la experiencia del usuario tanto en la entrada como en la salida. Ya sea aceptando indicaciones en múltiples modalidades o generando contenidos en varios formatos, las posibilidades de los agentes de IA multimodales parecen ilimitadas.

Coches autónomos

Los coches autoconducidos dependen en gran medida de la IA multimodal. Estos coches están equipados con múltiples sensores para procesar la información del entorno en varios formatos. El aprendizaje multimodal es clave para que estos vehículos combinen estas fuentes de forma eficaz y eficiente para tomar decisiones de inteligencia en tiempo real.

Biomedicina

La creciente disponibilidad de datos biomédicos procedentes de biobancos, historiales médicos electrónicos, imágenes clínicas y sensores médicos, así como de datos genómicos, está impulsando la creación de modelos multimodales de IA en el campo de la medicina. Estos modelos son capaces de procesar estas diversas fuentes de datos procedentes de múltiples modalidades para ayudarnos a desentrañar los misterios de la salud y la enfermedad humanas, así como a tomar decisiones clínicas inteligentes.

Ciencias de la Tierra y cambio climático

La rápida expansión de los sensores terrestres, drones, datos de satélite y otras técnicas de medición está aumentando nuestras capacidades para comprender el planeta. La IA multimodal es fundamental para combinar esta información con precisión y crear nuevas aplicaciones y herramientas que puedan ayudarnos en diversas tareas, como el control de las emisiones de gases de efecto invernadero, la previsión de fenómenos climáticos extremos y la agricultura de precisión.

Los retos de implantar soluciones multimodales de IA

El auge de la IA multimodal conlleva infinitas posibilidades para empresas, gobiernos y particulares. Sin embargo, como ocurre con cualquier tecnología incipiente, implantarlas en tus operaciones diarias puede ser todo un reto.

En primer lugar, tienes que encontrar los casos de uso que se ajusten a tus necesidades específicas. Pasar del concepto al despliegue no siempre es fácil, sobre todo si te faltan personas que entiendan bien los tecnicismos que hay detrás de la IA multimodal. Sin embargo, dada la actual falta de competencias en materia de datos, encontrar a las personas adecuadas para poner tus modelos en producción puede resultar difícil y costoso, ya que las empresas están dispuestas a pagar cifras elevadas para atraer a un talento tan limitado.

Por último, al hablar de IA generativa, es obligatorio mencionar la asequibilidad. Estos modelos, especialmente los multimodales, requieren considerables recursos informáticos para funcionar, y eso significa dinero. Por eso, antes de adoptar cualquier solución de IA generativa, es importante calcular los recursos que quieres invertir.

Riesgos de la IA multimodal

Como ocurre con cualquier tecnología nueva, hay varios escollos potenciales que debemos sortear con los modelos multimodales de IA:

- Falta de transparencia. La opacidad algorítmica es una de las principales preocupaciones asociadas a la IA generativa. Esto se aplica también a la IA multimodal. Estos modos suelen etiquetarse como modelos de "caja negra" debido a su complejidad, que hace imposible controlar su razonamiento y funcionamiento interno.

- Monopolio multimodal de la IA. Dados los considerables recursos necesarios para desarrollar, formar y hacer funcionar un modelo multimodal, el mercado está muy concentrado en un puñado de grandes empresas tecnológicas con los conocimientos y recursos necesarios. Afortunadamente, cada vez llegan al mercado más LLM de código abierto , lo que facilita a los desarrolladores, a los investigadores de IA y a la sociedad la comprensión y el funcionamiento de los LLM.

- Prejuicios y discriminación. Dependiendo de los datos utilizados para entrenar los modelos multimodales de IA, éstos pueden contener sesgos que pueden dar lugar a decisiones injustas que a menudo exacerban la discriminación, sobre todo contra los grupos minoritarios. Como ya se ha mencionado, la transparencia es esencial aquí para comprender mejor y abordar los posibles sesgos.

- Cuestiones de privacidad. Los modelos de IA multimodal se entrenan con grandes cantidades de datos procedentes de múltiples fuentes y formatos. En muchos casos, puede contener datos personales. Esto puede dar lugar a problemas y riesgos relacionados con la privacidad y la seguridad de los datos.

- Consideraciones éticas. La IA multimodal a veces puede llevar a decisiones que tienen graves implicaciones en nuestras vidas, con importantes repercusiones en nuestros derechos fundamentales. Exploramos la ética de la IA generativa en otro post.

- Consideraciones medioambientales. Los investigadores y los defensores del medio ambiente están expresando su preocupación por la huella medioambiental asociada al entrenamiento y funcionamiento de los modelos generativos de IA. Los propietarios de modelos de IA multimodal patentados rara vez publican información sobre la energía y los recursos consumidos por los modelos, ni sobre la huella medioambiental asociada, lo que resulta extremadamente problemático con la rápida adopción de estas herramientas.

El futuro de la IA multimodal

La IA multimodal es sin duda la próxima frontera de la revolución de la IA generativa. El rápido desarrollo del campo del aprendizaje multimodal está impulsando la creación de nuevos modelos y aplicaciones para todo tipo de fines. Sólo estamos al principio de esta revolución. A medida que se desarrollen nuevas técnicas para combinar más y nuevas modalidades, se ampliará el alcance de la IA multimodal.

Sin embargo, un gran poder conlleva una gran responsabilidad. La IA multimodal conlleva serios riesgos y retos que deben abordarse para garantizar un futuro justo y sostenible.

Si quieres iniciarte en la IA generativa, DataCamp te lo pone fácil. Consulta nuestros cursos, blogs y materiales dedicados:

Soy analista de datos autónomo y colaboro con empresas y organizaciones de todo el mundo en proyectos de ciencia de datos. También soy instructor de ciencia de datos con más de 2 años de experiencia. Escribo regularmente artículos relacionados con la ciencia de datos en inglés y español, algunos de los cuales se han publicado en sitios web consolidados como DataCamp, Towards Data Science y Analytics Vidhya Como científico de datos con formación en ciencias políticas y derecho, mi objetivo es trabajar en la interacción de las políticas públicas, el derecho y la tecnología, aprovechando el poder de las ideas para promover soluciones y narrativas innovadoras que puedan ayudarnos a abordar retos urgentes, como la crisis climática. Me considero autodidacta, aprendiz constante y firme partidaria de la multidisciplinariedad. Nunca es demasiado tarde para aprender cosas nuevas.