Kurs

GLM 4.7 Flash yerel vekil tabanlı kodlama için hızla popüler bir seçenek haline geliyor. Birçok geliştirici bunu llama.cpp ve LM Studio gibi araçlarla kullanıyor. Ancak, kurulum sırasında, modeli doğru şekilde çalıştırmada ve araç çağırmanın beklendiği gibi işlediğinden emin olmada hâlâ birçok kişi sorun yaşıyor.

Bu eğitim, Claude Code ve Ollama kullanarak GLM 4.7 Flash’i yerelde çalıştırmanın en basit ve en güvenilir yoluna odaklanır. Amaç, sürtünmeyi ortadan kaldırmak ve gereksiz karmaşıklık olmadan çalışan bir kurulum elde etmenize yardımcı olmaktır.

Bu kılavuz tüm işletim sistemlerinde çalışır. Linux, Windows veya macOS kullanmanız fark etmez. Sonunda, GLM 4.7 Flash’i yerelde çalışır durumda ve Ollama üzerinden Claude Code ile doğru şekilde entegre edilmiş hâlde elde edeceksiniz.

Önkoşullar

Başlamadan önce, sisteminizin aşağıdaki asgari donanım ve yazılım gereksinimlerini karşıladığından emin olun.

Donanım:

- En az 16 GB VRAM’e sahip NVIDIA GPU

- Daha büyük bağlam boyutlarında daha akıcı çıkarım için 24 GB VRAM önerilir

- 16–32 GB sistem RAM’i

- En az 25 GB boş disk alanı

GPU’nuz yoksa model CPU’da da çalışabilir; ancak performans ciddi ölçüde daha yavaş olur ve yüksek RAM gerekir.

Yazılım:

- Linux veya macOS önerilir. Windows kullanıcıları: GPU aktarımı etkin WSL2 kullanın.

- NVIDIA GPU sürücüsü kurulu olmalı ve CUDA sürümünüzle uyumlu olmalı

- CUDA Toolkit 13.1’i kurun

- CUDA/sürücü eksikse veya uyumsuzsa, Ollama genellikle çok daha yavaş olan CPU’ya geri döner.

CUDA araç seti veya NVIDIA sürücüleri eksikse ya da uyumsuzsa, Ollama çok daha yavaş olan CPU moduna geri döner.

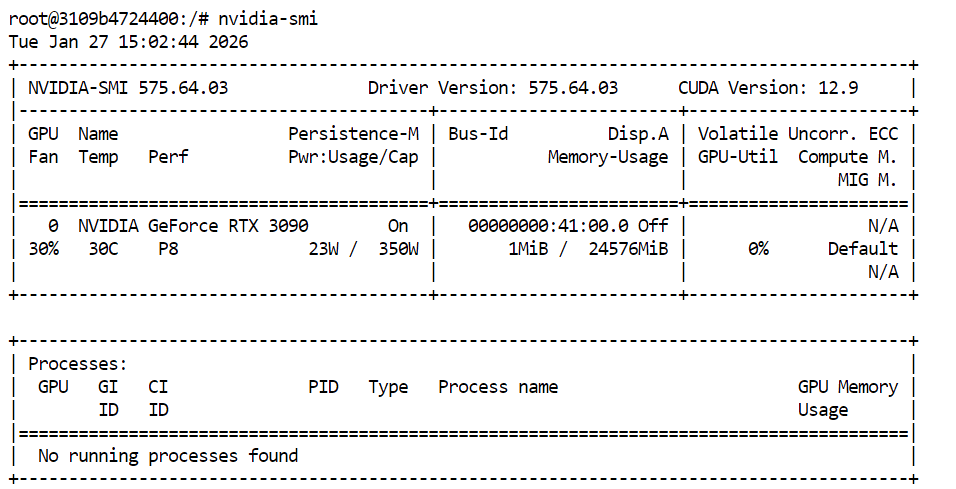

GPU ve CUDA sürücülerinizin doğru kurulduğunu doğrulamak için terminalinizde aşağıdaki komutu çalıştırın:

nvidia-smiHer şey doğru kurulduysa, GPU’nuzun listelendiğini; mevcut VRAM ve CUDA sürümüyle birlikte göreceksiniz.

1. Ollama’yı Kurun

Ollama, GLM 4.7 Flash’i yerelde çalıştırmak ve Claude Code’un güvenilir şekilde etkileşime geçebileceği bir biçimde sunmak için kullanacağımız çalışma zamanı ortamıdır. Kurulum, desteklenen tüm platformlarda basittir.

Linux’ta Ollama’yı tek komutla kurabilirsiniz:

curl -fsSL https://ollama.com/install.sh | shmacOS ve Windows için yükleyiciyi doğrudan Ollama web sitesinden indirin ve ekrandaki talimatları izleyin.

Kaynak: Ollama

Ollama arka plan hizmeti olarak çalışır ve güncellemeleri otomatik olarak kontrol eder. Bir güncelleme mevcut olduğunda, Ollama menüsünden “Güncellemek için yeniden başlat” seçeneğini belirleyerek uygulayabilirsiniz.

Kurulumdan sonra bir terminal açın ve Ollama’nın doğru kurulduğunu kontrol edin:

ollama -vBuna benzer bir çıktı görmelisiniz:

ollama version is 0.15.2ollama -v komutunu çalıştırırken hata görürseniz, genellikle Ollama hizmeti henüz çalışmıyor demektir. Ollama sunucusunu elle başlatın:

ollama serveBunu çalışır durumda bırakın, yeni bir terminal penceresi açın ve ardından şunu çalıştırın:

ollama -vSürüm komutu çalıştığında, Ollama eğitimin sonraki adımlarında kullanılmaya hazır demektir.

2. GLM-4.7-Flash’i İndirin ve Çalıştırın

Ollama kurulduktan ve çalıştıktan sonra bir sonraki adım GLM 4.7 Flash modelini indirmek ve doğru çalıştığını doğrulamaktır. Bu adım, Claude Code ile entegre etmeden önce modelin yerelde çalıştığından emin olur.

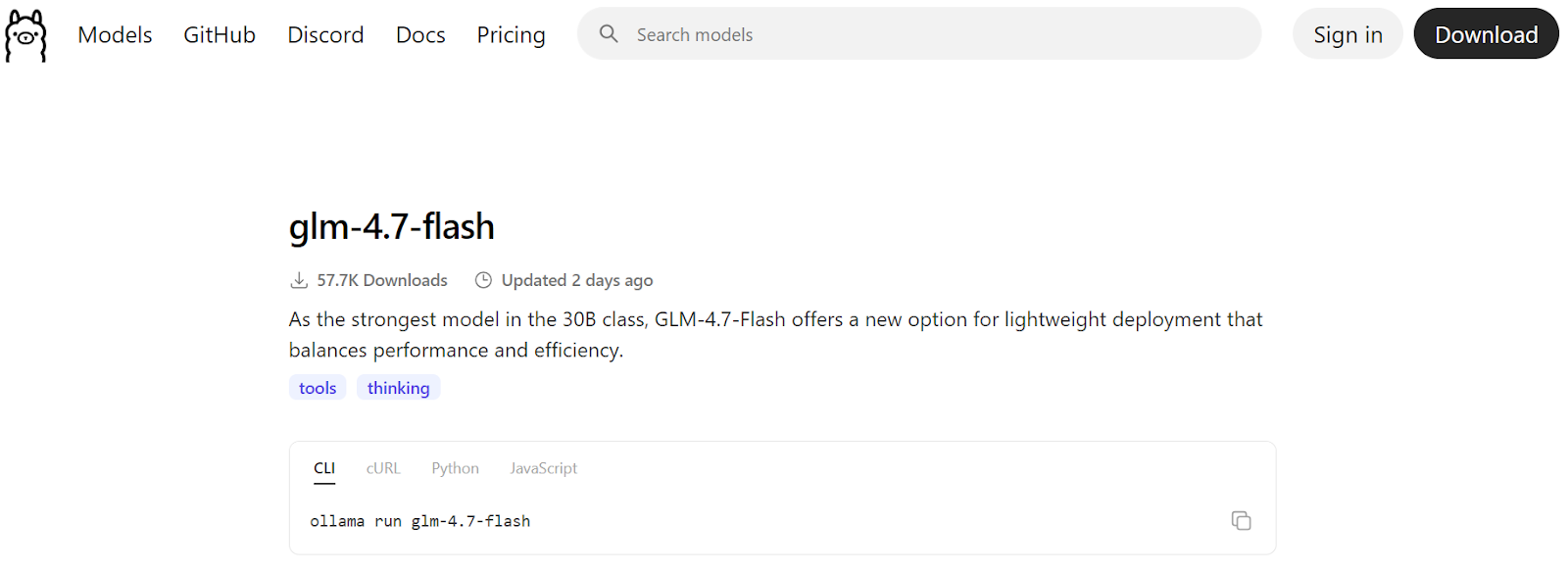

Kaynak: glm-4.7-flash

Modeli Ollama’nın kaydından indirerek başlayın:

ollama pull glm-4.7-flashBu, model dosyalarını indirir ve yerelde depolar. İnternet hızınıza bağlı olarak birkaç dakika sürebilir.

![]()

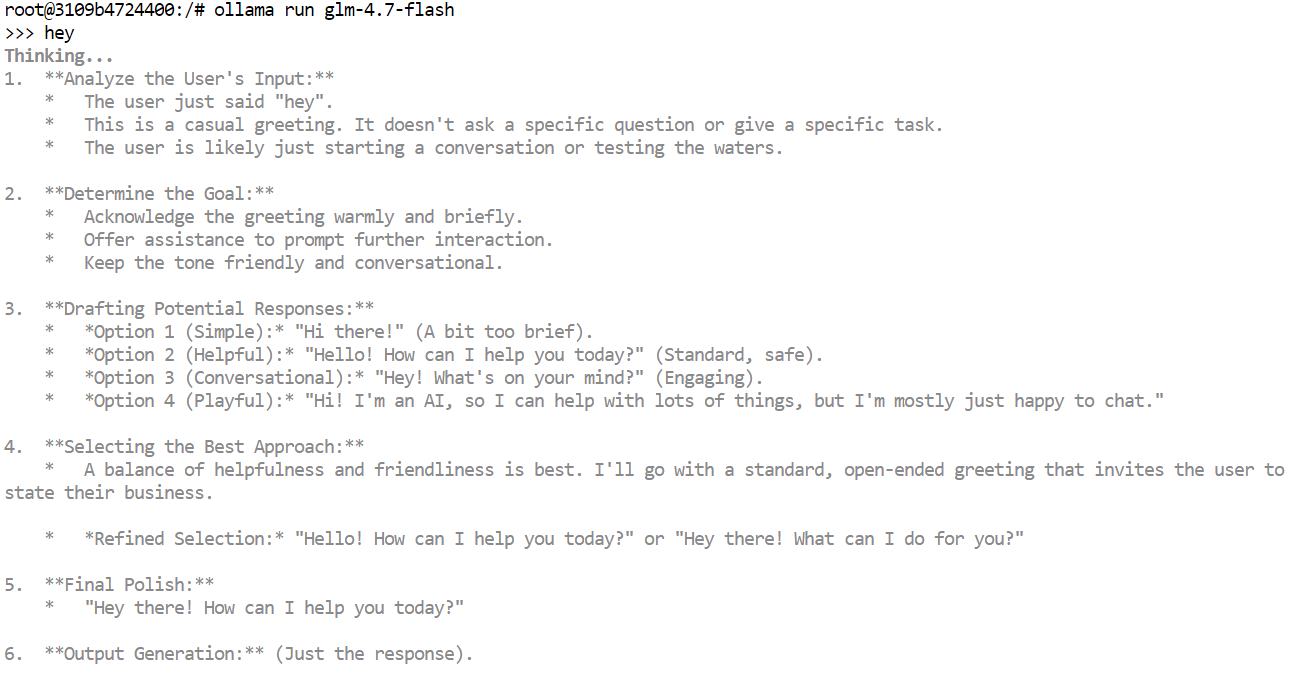

İndirme tamamlandıktan sonra, hızlı bir sağlık kontrolü olarak modeli etkileşimli sohbet modunda çalıştırın:

ollama run glm-4.7-flashBasit bir komut yazın, örneğin bir selamlama, ve enter’a basın. Birkaç saniye içinde yanıt almalısınız.

GPU üzerinde çalıştırıyorsanız, yanıtların çok hızlı olduğunu fark edeceksiniz ve çıktı, model yapılandırmasına bağlı olarak dahili düşünme belirteçleri veya akıl yürütme izleri içerebilir.

Modeli Ollama’nın yerel HTTP API’si üzerinden de test edebilirsiniz. Bu, harici araçların modelle iletişim kurabildiğini doğrulamak açısından yararlıdır.

Aşağıdaki komutu çalıştırın:

curl http://localhost:11434/api/chat -d '{

"model": "glm-4.7-flash",

"messages": [{"role":"user","content":"Hello!"}]

}'3. Bağlam Uzunluğunu Ayarlayın

Claude Code ve çoğu vekil tabanlı kodlama aracı, sıklıkla 64 bin belirtece kadar büyük bağlam pencereleriyle en iyi şekilde çalışır. Ancak GLM 4.7 Flash ile doğru bağlam uzunluğunu seçmek hem performans hem de stabilite için önemlidir.

Çok büyük bağlam boyutları kullanmak üretim hızını ciddi şekilde yavaşlatabilir. Pratikte, belirteç çıktısı saniyede 100’ün üzerinde belirteçten 2 belirtece kadar düşebilir. Bazı durumlarda, bağlam penceresi çok yüksek ayarlanırsa model uzun düşünme döngülerinde takılabilir.

Birden çok bağlam boyutunu test ettik ve 10 binlik bağlamın Claude Code iş akışları için yeterli olmadığını gördük. 20 binlik bağlam iyi bir denge sağladı. Kodlama görevleri için yeterince büyüktü; aynı zamanda hızlı yanıt sürelerini korurken gereksiz düşünme döngülerini azalttı.

Önce çalışan Ollama sunucusunu durdurun. Bunu terminalde Ctrl + C tuşlarına basarak veya süreci sonlandırarak yapabilirsiniz.

Ardından, sunucuyu başlatmadan önce ortam değişkenini ayarlayarak özel bir bağlam uzunluğuyla Ollama’yı yeniden başlatın:

OLLAMA_CONTEXT_LENGTH=20000 ollama serveBu, Ollama’ya modelleri en fazla 20.000 belirteçlik bağlam penceresiyle yüklemesini söyler.

Yeni bir terminal penceresinde şunu çalıştırın:

ollama psBu, GLM 4.7 Flash’in GPU üzerinde çalıştığını ve bağlam uzunluğunun doğru ayarlandığını doğrular. Bu noktada, model Claude Code ile kararlı ve hızlı kullanım için yapılandırılmıştır.

NAME ID SIZE PROCESSOR CONTEXT UNTIL

glm-4.7-flash:latest d1a8a26252f1 21 GB 100% GPU 20000 About a minute from now 4. Claude Code’u Kurun

Claude Code; kodu doğal dille yazmanıza, düzenlemenize, yeniden yapılandırmanıza ve anlamanıza yardımcı olan, Anthropic’in terminal tabanlı kodlama aracıdır. Vekil tabanlı iş akışları için geliştirilmiştir ve çok adımlı kodlama görevlerini doğrudan komut satırınızdan yürütebilir.

Ollama ile birlikte kullanıldığında, Claude Code GLM 4.7 Flash gibi yerel modellerle kolayca kullanılabilir; böylece her şeyi yerelde çalıştırır ve kodunuzu makinenizde tutarsınız.

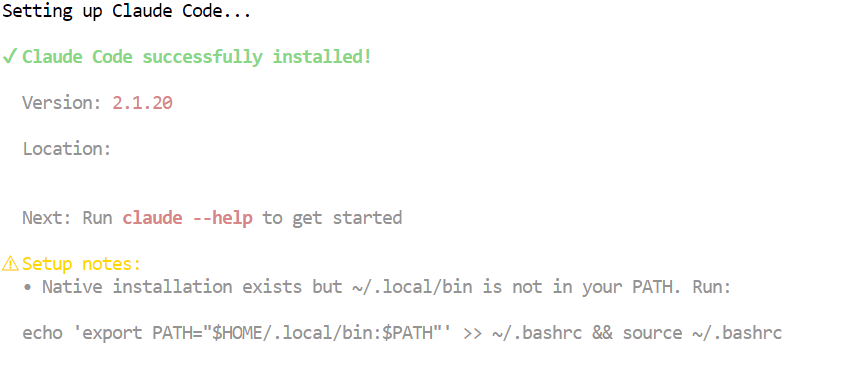

macOS, Linux veya WSL kullanan Windows’ta Claude Code’u resmi yükleme betiğiyle kurun:

curl -fsSL https://claude.ai/install.sh | bashBu komut, Claude Code’u gerekli bağımlılıklarla birlikte indirip kurar. Kurulum tamamlandıktan sonra, terminalinizde claude komutu kullanılabilir olacaktır.

5. Claude Code’u Ollama’ya Bağlayın

Artık hem Ollama hem de Claude Code kurulu olduğuna göre, bir sonraki adım Claude Code’u yerel Ollama sunucunuza bağlamak ve GLM 4.7 Flash modelini kullanacak şekilde yapılandırmaktır.

Projeniz için bir çalışma dizini oluşturarak başlayın. Claude Code burada çalışacak ve dosyaları yönetecektir:

mkdir <project-name>

cd <project-name>Ollama artık Claude Code’u başlatmanın ve onu yerel Ollama çalışma zamanıyla konuşacak şekilde otomatik olarak yapılandırmanın yerleşik bir yolunu sunuyor. Önerilen ve en güvenilir yaklaşım budur.

Claude Code’u Ollama kullanarak etkileşimli başlatmak için:

ollama launch claudeClaude Code’u doğrudan GLM 4.7 Flash modeliyle başlatmak için şunu çalıştırın:

ollama launch claude --model glm-4.7-flashBu, Claude Code’un uzak ya da varsayılan bir model yerine yerel GLM 4.7 Flash modelinizi kullanmasını sağlar.

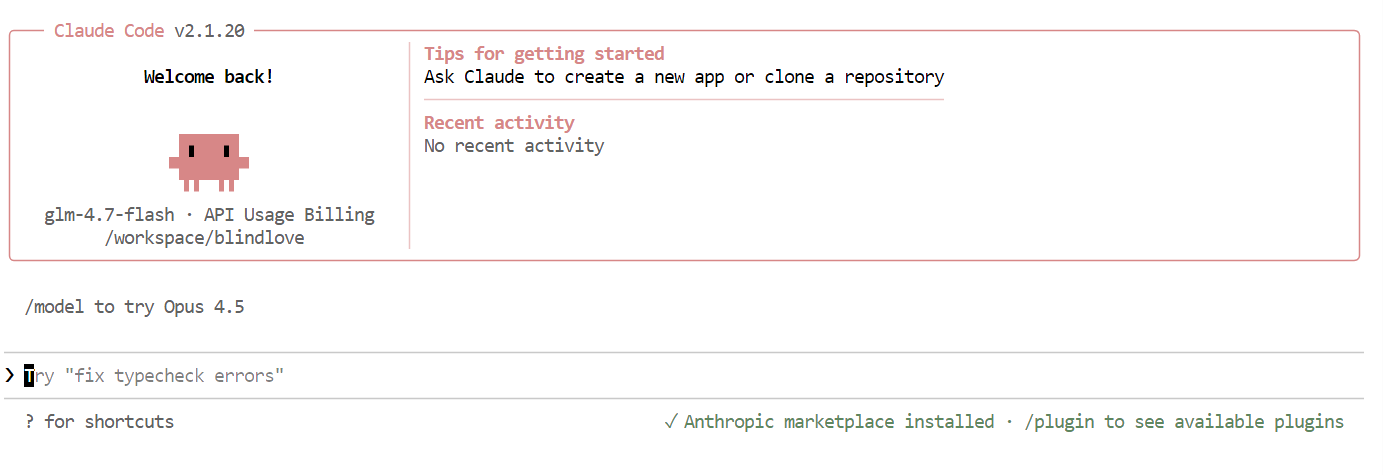

Her şey kurulduktan sonra, Claude Code arayüzünü doğrudan terminalinizde göreceksiniz.

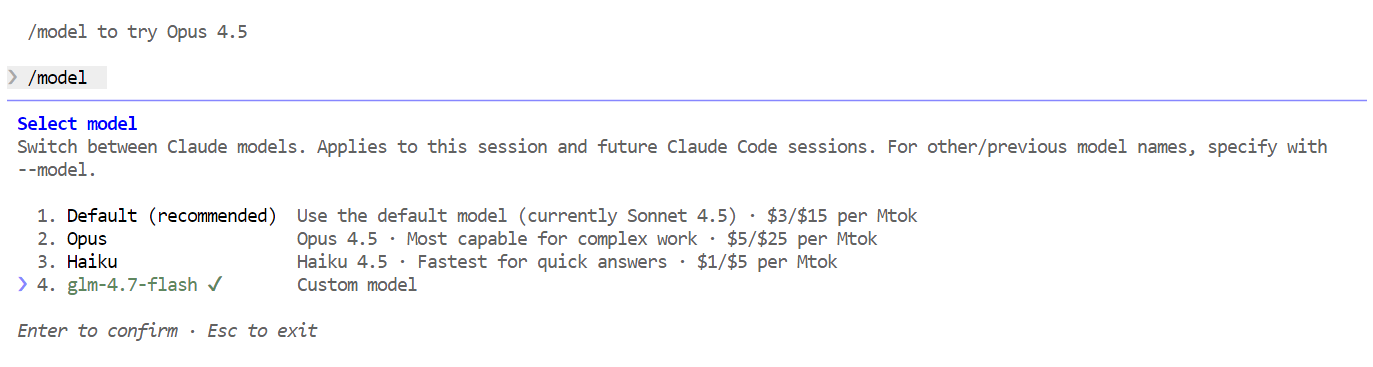

Claude Code içinde, yerel modelinizi kullandığını doğrulamak için aşağıdaki komutu kullanın:

/modelÇıktıda glm-4.7-flash görünüyorsa, kurulumunuz tamamlanmış demektir ve Claude Code yerel Ollama modeliniz üzerinde başarıyla çalışmaktadır.

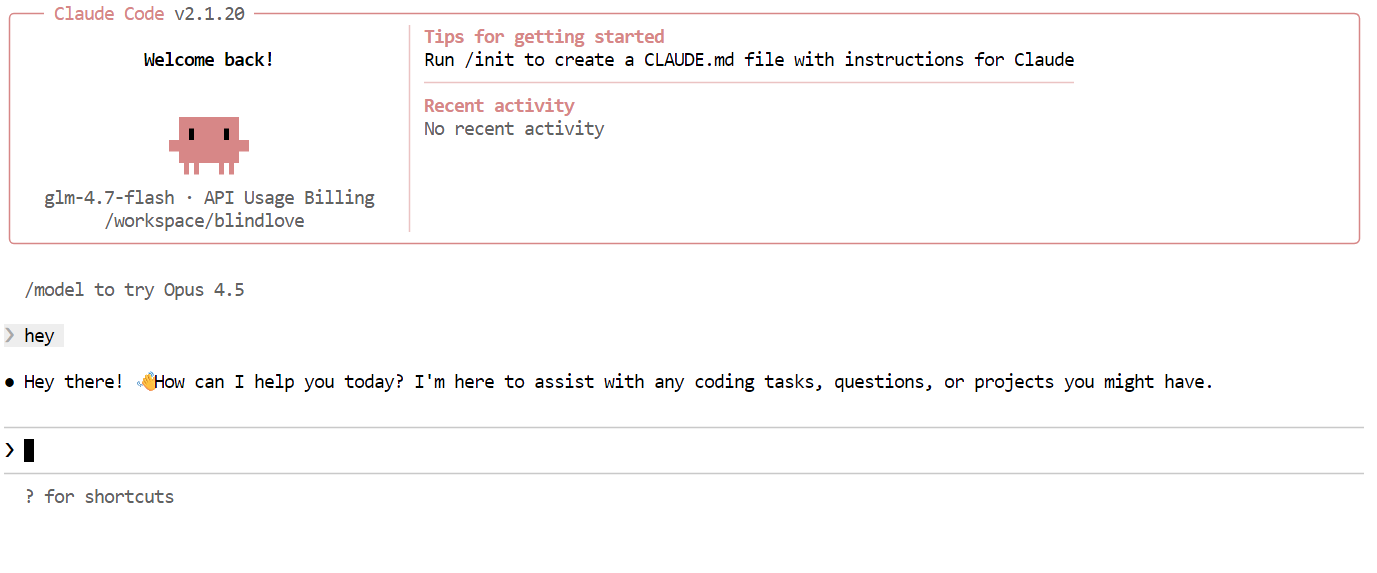

7. Claude Code’u Ollama ile Kullanma

Her şey kurulduğuna göre, artık yerel GLM 4.7 Flash modeliniz tarafından desteklenen Claude Code’u kullanmaya başlayabilirsiniz. İlk deneme olarak basit bir selamlama yapın. Bir iki saniye içinde yanıt almalısınız. Özellikle GPU’da çalıştırırken hız belirgin şekilde yüksektir.

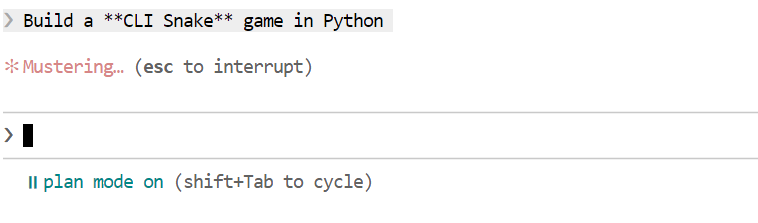

Sonraki adımda daha gerçekçi bir kodlama görevi deneyin. Claude Code’dan Python’da bir CLI Yılan oyunu (Snake) oluşturmasını isteyin. Kod üretmeden önce planlama moduna geçerek modelin önce yaklaşımını özetlemesini sağlayın. Planlama modunu Shift + Tab tuşlarına iki kez basarak açabilirsiniz.

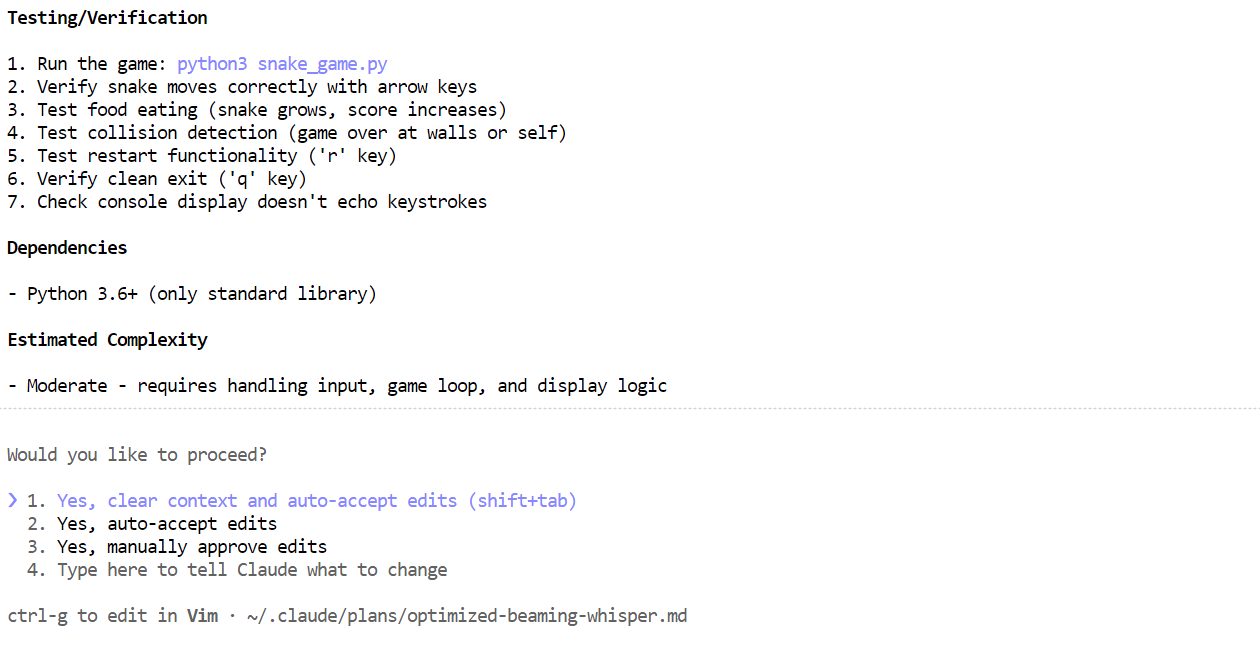

Plan oluşturulduktan sonra gözden geçirin. Yaklaşım mantıklı görünüyorsa Claude Code’a planı yürütmesini söyleyin.

Plan oluşturulduktan sonra gözden geçirin. Yaklaşım mantıklı görünüyorsa Claude Code’a planı yürütmesini söyleyin.

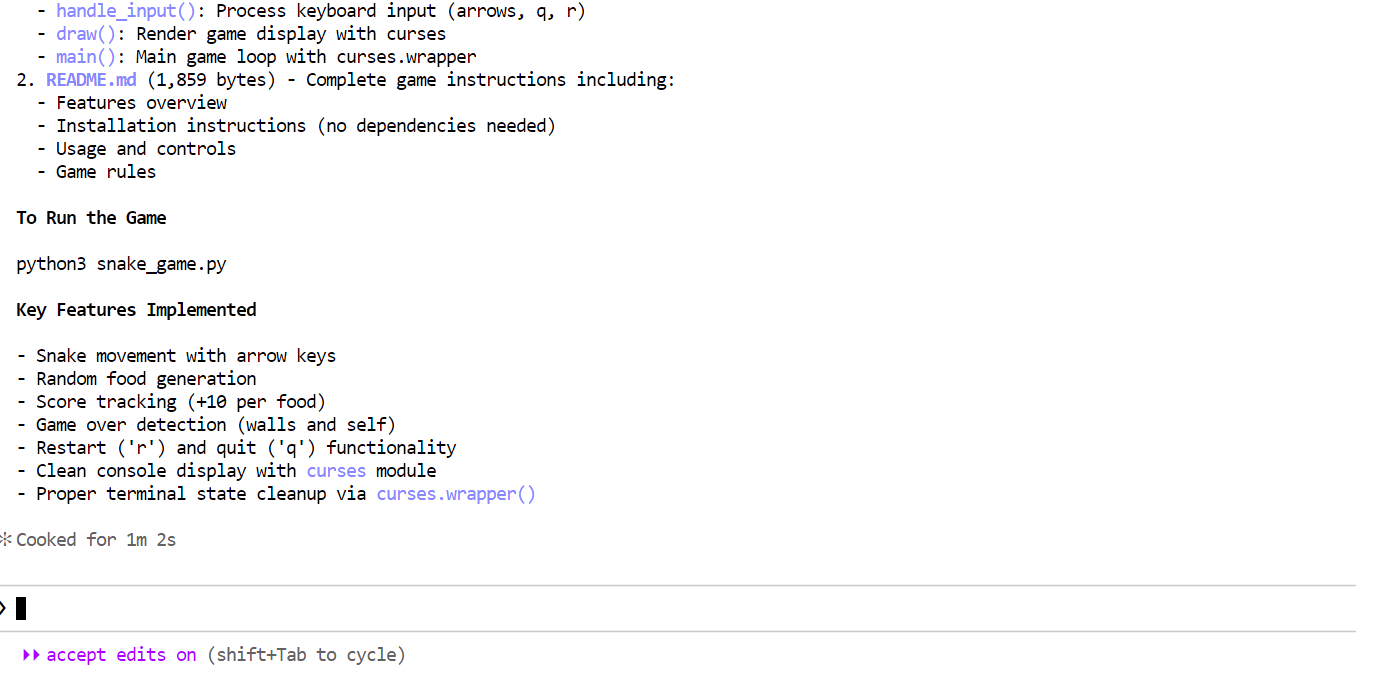

Birkaç dakika içinde gerekli dosyaları oluşturdu, Yılan oyununun ne yaptığını açıkladı ve nasıl çalıştırılacağına dair net talimatlar verdi.

Birkaç dakika içinde gerekli dosyaları oluşturdu, Yılan oyununun ne yaptığını açıkladı ve nasıl çalıştırılacağına dair net talimatlar verdi.

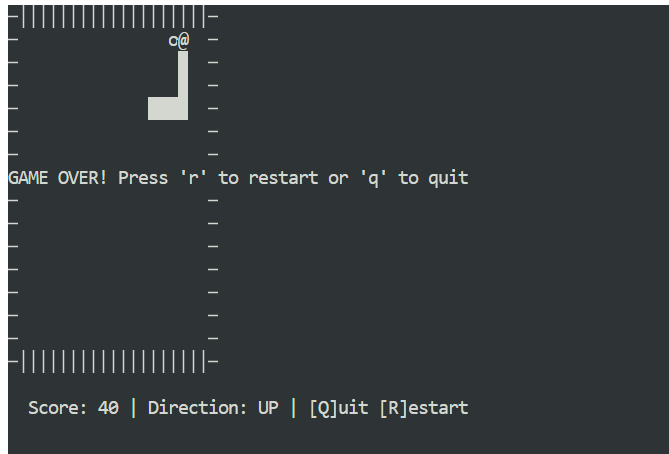

Yeni bir terminal penceresi açın ve aynı proje dizininde olduğunuzdan emin olun. Ardından oyunu şu komutla başlatın:

Yeni bir terminal penceresi açın ve aynı proje dizininde olduğunuzdan emin olun. Ardından oyunu şu komutla başlatın:

python3 snake_game.pyOyun, ek bir kurulum gerektirmeden kutudan çıkar çıkmaz çalışır. Klasik Nokia 3310 sürümüne çok benzeyen basit bir terminal tabanlı Yılan oyunudur. Sadeliklerine rağmen, Claude Code ve Ollama ile yerel vekil tabanlı kodlamanın ne kadar hızlı ve etkili olabileceğine dair harika bir örnektir.

Son Düşünceler

Claude Code’u Ollama üzerinde GLM 4.7 Flash ile çalıştırmak, yerel vekil tabanlı kodlamanın ne kadar yol kat ettiğini gösteriyor. Hızlı yanıtlar, güçlü kod üretimi ve verileriniz üzerinde tam kontrol elde edersiniz; üstelik bulut barındırmalı modellere güvenmeden.

Yapılandırıldıktan sonra iş akışı, çok adımlı kodlama görevlerinde bile akıcı ve güvenilir hissi verir.

Önemli bir çıkarım, daha büyük bağlam pencereleri ve daha karmaşık kurulumların her zaman daha iyi olmadığıdır. Makul varsayılanlarla, model indirme süresi hariç tüm kurulum yaklaşık beş dakika sürer; indirme süresi internet bağlantınıza bağlıdır.

Model için GGUF dosyasını zaten indirdiyseniz, kurulum daha da hızlanır. Bu durumda, model indirmeyi tamamen atlayabilir ve aynı GGUF dosyasını bir Modelfile oluşturarak Ollama’ya yalnızca kaydedebilirsiniz.

Bu, üretim parametrelerini bir kez tanımlamanıza ve modeli çalıştırmalar ve araçlar arasında tutarlı şekilde yeniden kullanmanıza olanak tanır.

GGUF dosyanızla aynı dizinde Modelfile adlı bir dosya oluşturun:

FROM ./glm-4.7-flash.gguf

PARAMETER temperature 0.8

PARAMETER top_p 0.95

PARAMETER repeat_penalty 1.0Parametreleri ihtiyaçlarınıza göre ayarlayabilirsiniz:

- Sıcaklık (Temperature): 0.7 – 1.0

- Top-p: 0.95 – 1.0

- Tekrar cezası (Repeat penalty): devre dışı veya 1.0

Modeli Ollama’ya kaydedin:

ollama create glm-4.7-flash-local -f ModelfileModel oluşturulduktan sonra, doğrudan sohbet modunda çalıştırabilirsiniz:

ollama run glm-4.7-flash-localModel artık diğer Ollama modelleri gibi kullanılabilir ve Claude Code ile sorunsuz şekilde entegre edilebilir.

GLM 4.7 Flash’i Claude Code içinde kullanarak uygulamalar ve oyunlar geliştirmekten çok keyif aldım. İnternetin olmadığı ya da bağlantının kararsız olduğu uzak bir yerde çalışmak gerçekten güçlendirici hissettiriyor. Her şey yerelde çalışıyor, hiçbir şey bozulmuyor ve yine de elinizin altında güçlü bir kodlama ajanı var. Bu kontrol ve bağımsızlık hissini aşmak zor.

Bu yazıda ele aldığımız araçlar hakkında daha fazla bilgi edinmek istiyorsanız aşağıdaki kaynakları öneririm:

FAQs

Vekil tabanlı kodlama için en iyi yerel modeller hangileri?

Claude Code’u Ollama ile çalıştırmak, 2026 için en güçlü “vibe-coding” kurulumlarından biridir. Anthropic’in gelişmiş terminal ajanını kullanırken kaynak kodunuzu tamamen özel tutmanıza ve maliyetli API ücretlerinden kaçınmanıza olanak tanır.

Ollama v0.14’ten beri, Anthropic Messages API ile yerel uyumluluğa sahiptir; bu da birkaç ortam değişkeniyle bulut arka ucunu yerel bir arka uçla değiştirebileceğiniz anlamına gelir.

Claude Code + Ollama için 5 Genel SSS

1. Claude Code’u yerel Ollama sunucuma nasıl yönlendiririm?

Claude Code varsayılan olarak Anthropic API’sini arar. Onu Ollama’ya yönlendirmek için, claude komutunu çalıştırmadan önce terminalinizde şu üç ortam değişkenini ayarlamanız gerekir:

- Linux/macOS:

Bash

export ANTHROPIC_BASE_URL="http://localhost:11434" export ANTHROPIC_AUTH_TOKEN="ollama" export ANTHROPIC_API_KEY="" - Windows (PowerShell):

PowerShell

$env:ANTHROPIC_BASE_URL = "http://localhost:11434" $env:ANTHROPIC_AUTH_TOKEN = "ollama" $env:ANTHROPIC_API_KEY = ""

İpucu: En güncel Ollama’yı kullanıyorsanız, bu değişkenlerin sizin için otomatik olarak yapılandırılması için doğrudan

ollama launch claudekomutunu çalıştırabilirsiniz.

2. Vekil tabanlı kodlama için en iyi yerel modeller hangileri?

Her yerel model, Claude Code’un gerektirdiği karmaşık “vekil” talimatlarını (araç çağırma, dosya okuma ve çok adımlı planlama) kaldıramaz. 2026’nın başı itibarıyla topluluk favorileri şunlardır:

- GLM 4.7 Flash: Hız ve büyük bağlam pencereleri (128k) için yüksek düzeyde optimize edilmiştir.

- Qwen 2.5 Coder (32B veya 7B): Açık kaynak kodlama akıl yürütmesi için şu anki altın standart.

- Codestral: Python ve karmaşık mantıkta mükemmel, ancak donanım açısından daha ağırdır.

Asgari donanım gereksinimleri nelerdir?

Claude Code, davranışını tanımlamak için yaklaşık ~16 bin belirteçlik dev bir sistem istemi gönderdiğinden, asıl dar boğaz donanımdır:

- Önerilen: 16GB-24GB VRAM’li NVIDIA GPU (ör. RTX 3090/4090) veya 32GB+ RAM’li Apple M serisi Mac.

- Asgari: Toplam 16GB RAM. GPU’nuz yoksa daha küçük modelleri (ör. Qwen 7B) CPU’nuzda çalıştırabilirsiniz; ancak “Planlama Modu”ndaki her adımın birkaç dakika sürmesini bekleyin.

Claude Code neden sürekli internete bağlanmaya çalışıyor?

Yerel bir model ile bile, Claude Code “temel olmayan” trafiği, örneğin telemetri veya güncelleme kontrolleri göndermeye çalışabilir. Kesinlikle çevrimdışı bir ortamdaysanız veya azami gizlilik istiyorsanız, şu ek değişkeni ayarlayın:

export CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC=1

Bu, ajanın “eve telefon açmamasını” ve yerel ağınızda kalmasını sağlar.

Yerel modellerle "Planlama Modu"nu kullanabilir miyim?

Evet. Araç kullanımı destekleyen yerel modeller (GLM 4.7 Flash veya Qwen 2.5 Coder gibi) Claude Code’un planlama modunu yönetebilir. Ancak model yeterince güçlü değilse, aynı adımı tekrarladığı bir “düşünme döngüsüne” takılabilir.

- Çözüm: Bu olursa, daha büyük bir quantization’a geçmeyi deneyin (ör. modelin

q4sürümündenq8veyafp16sürümüne geçmek) ya da Ollama Modelfile’ınızdanum_ctx(bağlam penceresi) değerini en az 32.000’e çıkarın.

Sertifikalı bir veri bilimcisi olarak, yenilikçi makine öğrenimi uygulamaları oluşturmak için en son teknolojileri kullanmaya büyük ilgi duyuyorum. Konuşma tanıma, veri analizi ve raporlama, MLOps, konuşma yapay zekası ve NLP alanlarında güçlü bir geçmişe sahip olarak, gerçek bir etki yaratabilecek akıllı sistemler geliştirme becerilerimi geliştirdim. Teknik uzmanlığımın yanı sıra, karmaşık kavramları açık ve özlü bir dille ifade etme yeteneğine sahip, becerikli bir iletişimciyim. Sonuç olarak, veri bilimi konusunda aranan bir blog yazarı oldum ve giderek büyüyen veri profesyonelleri topluluğuyla görüşlerimi ve deneyimlerimi paylaşıyorum. Şu anda, içerik oluşturma ve düzenlemeye odaklanıyorum. Büyük dil modelleriyle çalışarak, hem işletmelerin hem de bireylerin verilerinden en iyi şekilde yararlanmalarına yardımcı olabilecek güçlü ve ilgi çekici içerikler geliştiriyorum.