Curso

Até março de 2026, a Mistral tinha construído apenas metade de um pipeline de voz. Seus modelos Voxtral Transcribe cuidavam de fala para texto, mas não havia como ir na direção oposta. Se você queria que seu aplicativo falasse, precisava recorrer a outro provedor — geralmente o ElevenLabs para clonagem de voz expressiva, o TTS-1 da OpenAI para uma integração mínima ou o Neural2 do Google Cloud se você já estivesse nesse ecossistema.

O Voxtral TTS preenche essa lacuna. É o primeiro modelo de texto para fala da Mistral, um sistema com 4,1 bilhões de parâmetros que gera fala em nove idiomas a partir de uma breve referência de áudio. Os pesos do modelo estão disponíveis no Hugging Face, e a API em nuvem está ativa por US$ 0,016 a cada 1.000 caracteres, com pesos abertos para auto-hospedagem.

Uma observação sobre a nomenclatura: os modelos Voxtral de julho de 2025 são modelos de fala para texto. O Voxtral TTS, lançado em 26 de março de 2026, faz o caminho inverso.

O que é o Voxtral TTS?

O Voxtral TTS é um modelo de texto para fala que converte texto escrito em áudio falado em nove idiomas: inglês, francês, alemão, espanhol, holandês, português, italiano, hindi e árabe. Você pode usar uma das 20 vozes pré-definidas ou fornecer um clipe de áudio de referência para clonar a voz de um locutor específico. O comprimento recomendado do clipe para clonagem é de 5 a 25 segundos, embora o modelo aceite a partir de 3 segundos.

A principal aposta da Mistral é o baixo footprint combinado com o que descreve como qualidade de ponta. Os pesos BF16 padrão no Hugging Face têm cerca de 8 GB, e a auto-hospedagem requer uma GPU com pelo menos 16 GB de VRAM para cobrir a sobrecarga de inferência. O artigo de pesquisa observa que versões quantizadas podem reduzir os pesos para cerca de 3 GB, embora essas não sejam as versões padrão. Pierre Stock, VP de Science da Mistral, disse ao VentureBeat que o modelo pode até rodar em um smartphone, mas isso depende da quantização e eu não consegui verificar de forma independente.

O modelo também oferece o que a Mistral chama de "voz como instrução". Em vez de depender de tags SSML ou rótulos explícitos de emoção para controlar como a fala gerada soa, o Voxtral TTS deduz o tom, o ritmo e a entrega emocional diretamente da referência de voz que você fornece. Dê a ele um clipe de alguém falando de forma empolgada e a fala gerada tende a refletir essa entrega. É uma abordagem diferente do ElevenLabs, que usa tags explícitas de emoção para direcionar a geração.

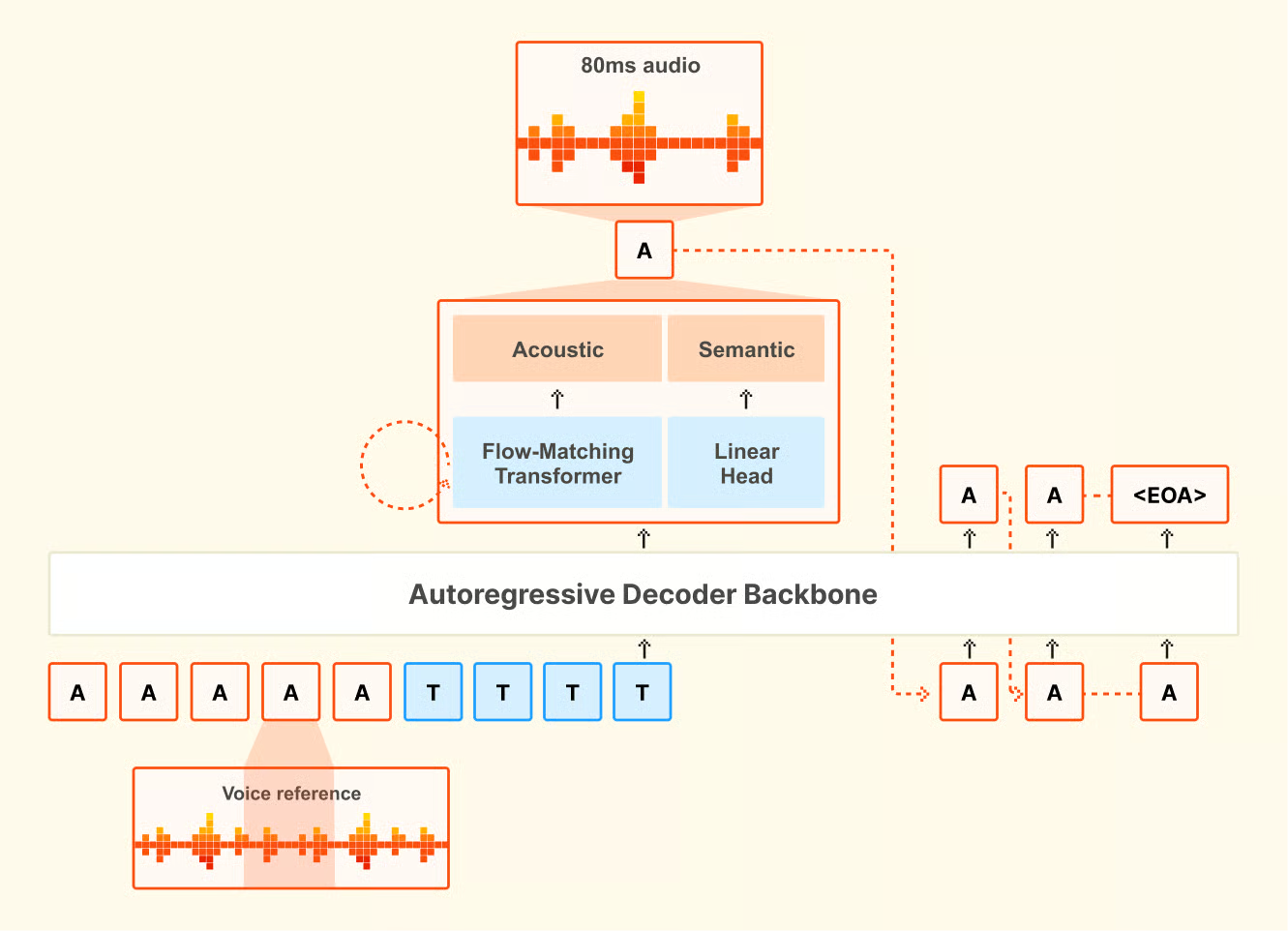

Visão geral da arquitetura

O Voxtral TTS é um modelo autoregressivo de transformer com flow matching, construído sobre o Ministral 3B. Ele tem três componentes: um backbone decodificador transformer com 3,4B de parâmetros que prevê tokens semânticos a partir de texto e voz; um transformer acústico com flow matching de 390M de parâmetros que converte esses tokens em representações de áudio; e um codec neural de áudio de 300M de parâmetros, criado do zero pela Mistral, operando a 12,5 Hz com quadros de 80 milissegundos. O codec é o que mantém a representação de áudio eficiente: ele opera em um espaço latente fortemente comprimido, por isso o modelo completo de 4,1B de parâmetros consegue gerar áudio de alta qualidade mantendo os pesos BF16 em ~8 GB.

Visão geral da arquitetura do Voxtral TTS. Fonte: Mistral AI.

Essa pipeline em três estágios também é o que viabiliza a clonagem de voz: o codec captura as características do locutor no espaço latente, que o backbone e o transformer acústico usam para reproduzir essa voz em novos textos.

Clonagem de voz zero-shot

Na clonagem de voz, você fornece um clipe curto de referência e o modelo gera fala que capta o sotaque, a entonação e o ritmo do locutor, incluindo pausas e cadência naturais.

O que me surpreendeu na pesquisa foi a capacidade multilíngue cruzada. Se você fornecer uma referência de voz em francês e digitar seu prompt em alemão, o modelo tende a gerar fala em alemão que soa semelhante ao falante francês, absorvendo boa parte do sotaque e das características vocais. Isso não é algo para o que o modelo foi explicitamente treinado. É um comportamento emergente e pode ser útil em tradução fala-para-fala quando manter a voz original do locutor entre idiomas faz diferença.

Um detalhe prático: a clonagem de voz personalizada requer a API da Mistral. A versão com pesos abertos fica limitada às mesmas 20 vozes pré-definidas. Se você quiser clonar uma voz específica na versão auto-hospedada, precisa do endpoint de criação de vozes da API.

Benchmarks do Voxtral TTS

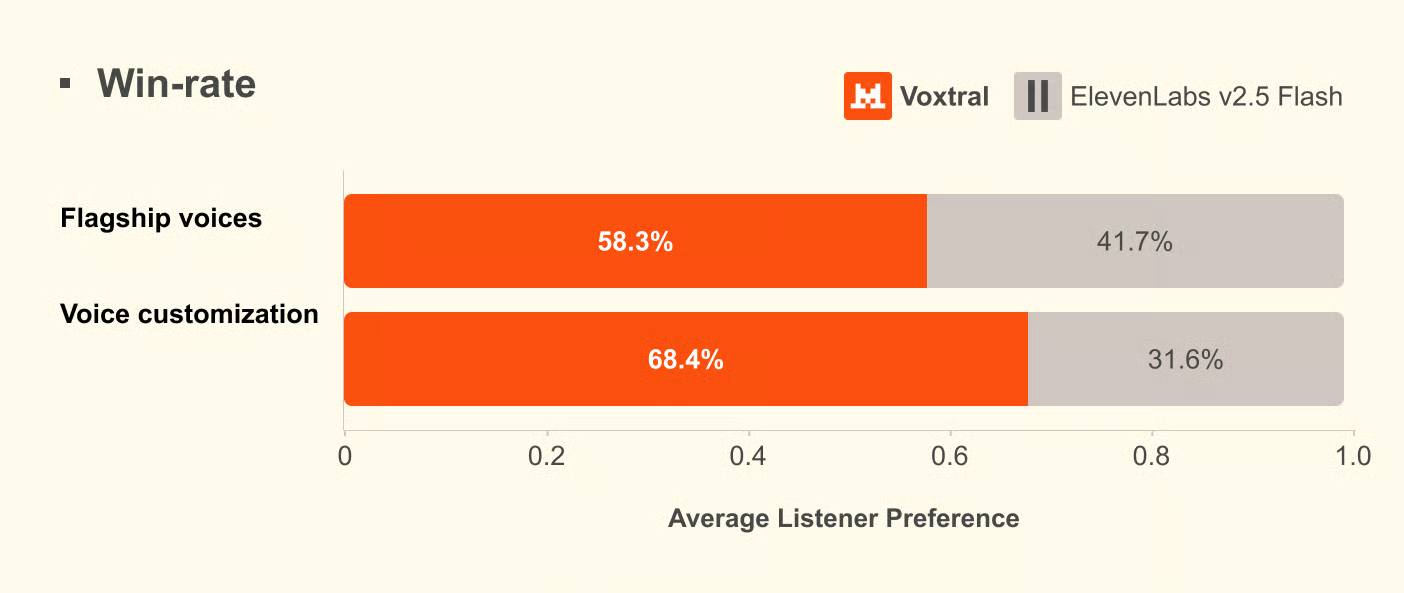

Todos os dados de benchmark aqui vêm das avaliações internas da própria Mistral. O modelo é recente o suficiente para que, até o momento desta publicação, não existam benchmarks independentes de terceiros. O Artificial Analysis Speech Arena Leaderboard, um ranking independente de TTS, ainda não incluiu o Voxtral TTS.

A Mistral usou avaliações de preferência humana, e não métricas automatizadas como o Mean Opinion Score (MOS), argumentando no artigo de pesquisa que escores automatizados não capturam de forma confiável a naturalidade entre idiomas e culturas. Os testes foram comparações de escuta às cegas, conduzidas por anotadores nativos nos nove idiomas suportados.

Em testes usando as vozes principais pré-definidas de cada modelo, o Voxtral TTS foi preferido por anotadores humanos em 58,3% das comparações. Nos testes de clonagem de voz zero-shot, em que ambos os modelos receberam um clipe curto de referência e geraram fala a partir do mesmo texto, essa taxa subiu para 68,4%. A diferença foi maior em hindi (cerca de 80% de preferência) e espanhol (cerca de 88%). Holandês foi um ponto fraco, com 49,4%, indicando que o ElevenLabs Flash v2.5 levou vantagem nesse idioma.

Resultados de preferência humana nas avaliações da Mistral. Fonte: Mistral AI.

A Mistral também executou um conjunto separado de testes de controle de emoção, desta vez comparando com o ElevenLabs v3 e o Gemini 2.5 Flash TTS em vez do Flash v2.5. Contra o ElevenLabs v3, os dois modelos ficaram praticamente empatados no controle explícito; o Voxtral teve leve vantagem no controle implícito. Contra o Gemini 2.5 Flash TTS, o Gemini ficou à frente com cerca de 65%, sendo o melhor desempenho nessa comparação. Esses números, como todos desta seção, vêm do artigo da própria Mistral.

Em latência, a Mistral reporta 70 milissegundos em uma única NVIDIA H200. O tempo de ponta a ponta até o primeiro áudio via API é de cerca de 0,8 segundo com PCM e aproximadamente 1,5 a 2 segundos com MP3.

Testando o Voxtral TTS: exemplos práticos

Eu foquei em três cenários. Primeiro, se uma voz pré-definida dá conta de narração geral, especialmente se a naturalidade se perde nos pontos onde sistemas de TTS costumam falhar. Segundo, o quão bem a clonagem de voz captura um locutor real a partir de um clipe curto e quanto o tamanho do clipe realmente importa. Terceiro, quanto o formato de saída afeta a latência na prática.

Preparando o ambiente

Primeiro, instale o SDK oficial em Python e defina sua chave de API. Você vai precisar de uma conta Mistral com cobrança ativada.

pip install mistralaiDefina sua chave de API como variável de ambiente:

export MISTRAL_API_KEY="your-api-key-here"Exemplo 1: geração básica de fala

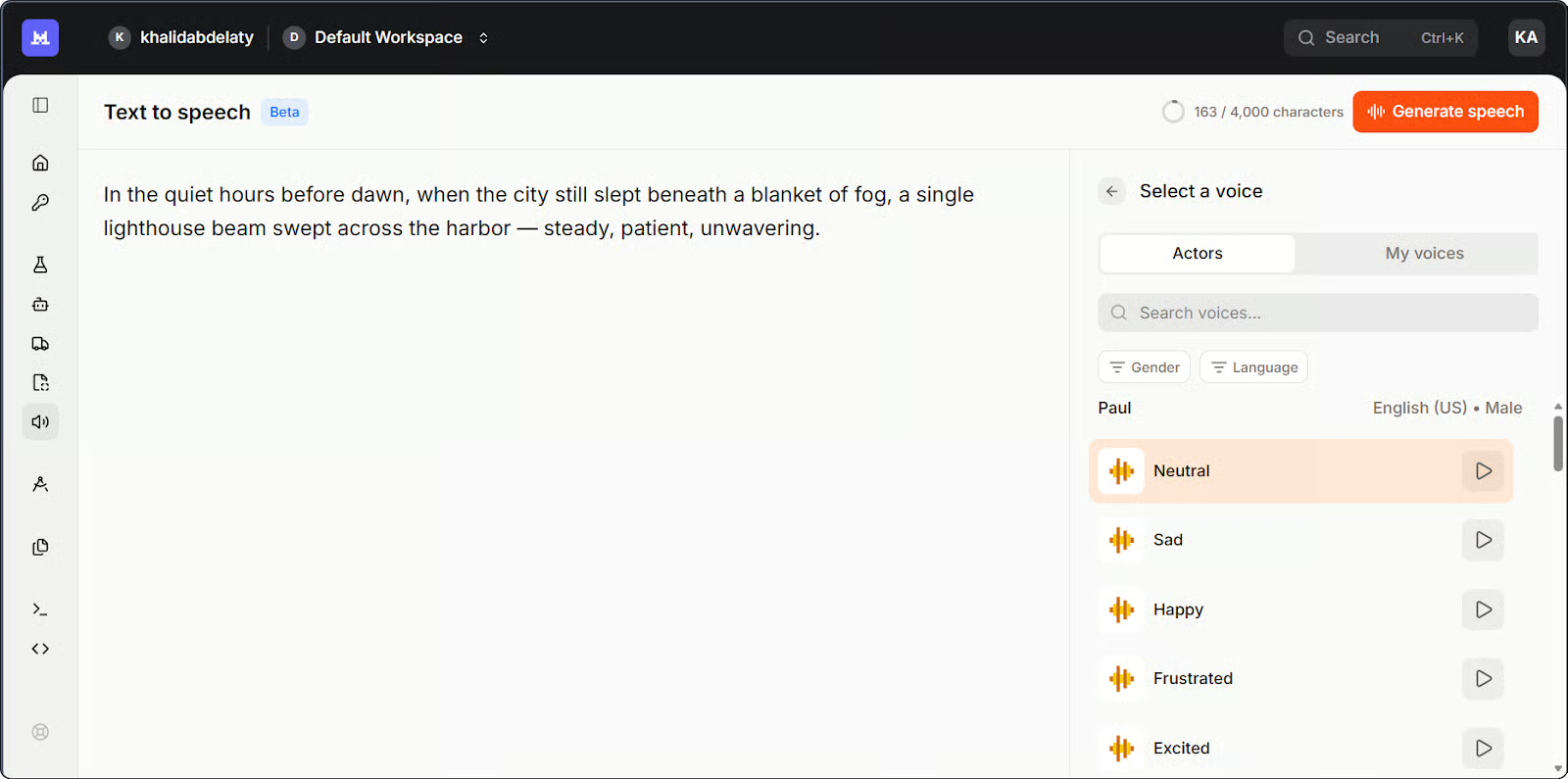

As vozes pré-definidas cobrem inglês americano, inglês britânico e dialetos franceses e são um ponto de partida razoável para narração geral quando a identidade do locutor não é relevante.

Playground do Mistral Studio para Voxtral TTS. Imagem do autor.

Aqui vai a versão mais simples, usando uma voz pré-definida:

import base64

import os

from pathlib import Path

from mistralai.client import Mistral

client = Mistral(api_key=os.getenv("MISTRAL_API_KEY"))

# Gerar fala a partir de texto

response = client.audio.speech.complete(

model="voxtral-mini-tts-2603",

input="Welcome to Voxtral TTS. This is a basic speech generation test.",

voice_id="your-voice-id", # Use um ID de voz da sua conta

response_format="mp3",

)

# Salvar o arquivo de áudio

Path("basic_output.mp3").write_bytes(base64.b64decode(response.audio_data))

print("Saved to basic_output.mp3")Alguns pontos de atenção. O método é .complete(), não .create() como você pode esperar se vem da API de TTS da OpenAI. A resposta retorna o áudio em base64 em response.audio_data, então é preciso decodificar antes de salvar em disco.

A primeira coisa que verifiquei foi o ritmo no fim das frases. Muitos modelos de TTS caem mecanicamente no ponto final, uma cadência plana que entrega que é sintético. Aqui, isso se manteve natural. O que me surpreendeu foram as pausas nas vírgulas no meio das frases: sistemas mais simples tendem a tratá-las como paradas bruscas, mas o andamento continuou fluido. A pronúncia foi precisa o tempo todo, inclusive da palavra "Voxtral", onde eu esperava tropeço.

Exemplo 2: criando uma voz personalizada

Quando a identidade do locutor importa, a API permite criar um perfil de voz reutilizável a partir de um clipe curto de referência.

import base64

import os

from pathlib import Path

from mistralai.client import Mistral

client = Mistral(api_key=os.getenv("MISTRAL_API_KEY"))

# Codificar seu áudio de referência em base64

sample_audio_b64 = base64.b64encode(

Path("reference_voice.mp3").read_bytes()

).decode()

# Criar um perfil de voz reutilizável

voice = client.audio.voices.create(

name="my-custom-voice",

sample_audio=sample_audio_b64,

sample_filename="reference_voice.mp3",

languages=["en"],

gender="male",

)

print(f"Created voice with ID: {voice.id}")

# Gerar fala usando a voz clonada

response = client.audio.speech.complete(

model="voxtral-mini-tts-2603",

input="This sentence was generated using a cloned voice from just a few seconds of reference audio.",

voice_id=voice.id,

response_format="mp3",

)

Path("cloned_output.mp3").write_bytes(base64.b64decode(response.audio_data))

print("Saved to cloned_output.mp3")

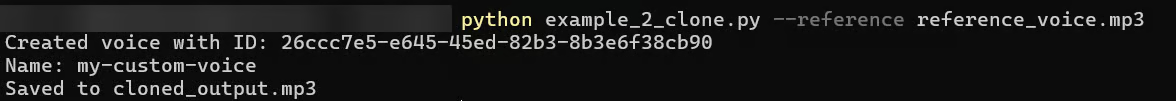

Saída do terminal do script de clonagem de voz. Imagem do autor.

Minha primeira tentativa usou um clipe de cerca de três segundos. O resultado soou plausível, mas genérico: faixa vocal certa, porém sem as inflexões específicas que tornam uma voz identificável. Poderia ser qualquer pessoa. Ao trocar para um clipe de oito segundos, a diferença ficou clara: a saída clonada capturou o sotaque, o ritmo e a leve subida no fim de perguntas que o clipe curto havia achatado completamente.

A voz clonada não soou idêntica à fonte, mas estava claramente no mesmo registro e com cadência semelhante. Pelos meus testes, de 8 a 15 segundos é um bom meio-termo entre esforço e qualidade do resultado.

Exemplo 3: comparação de formatos para latência

O formato de saída afeta a velocidade de chegada do primeiro chunk de áudio. Testei dois formatos.

import os

import time

from mistralai.client import Mistral

client = Mistral(api_key=os.getenv("MISTRAL_API_KEY"))

text = "This is a latency test comparing PCM and MP3 output formats from Voxtral TTS."

voice_id = "your-voice-id"

def time_to_first_chunk(response_format):

start = time.time()

stream = client.audio.speech.complete(

model="voxtral-mini-tts-2603",

input=text,

voice_id=voice_id,

response_format=response_format,

stream=True,

)

for _ in stream:

return time.time() - start # return on first chunk

pcm_time = time_to_first_chunk("pcm")

mp3_time = time_to_first_chunk("mp3")

print(f"PCM latency: {pcm_time:.2f}s")

print(f"MP3 latency: {mp3_time:.2f}s")

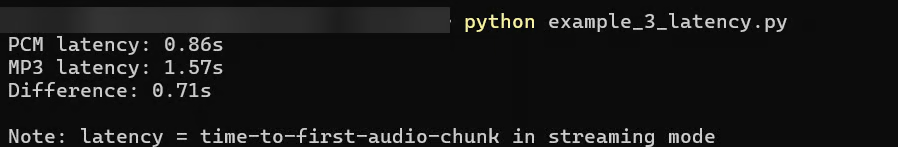

Comparação de latência entre dois formatos de saída. Imagem do autor.

Eu rodei o teste com MP3 primeiro, já que é o padrão natural para a maioria dos fluxos de áudio. O resultado foi funcional, em torno de 1,5 a 2 segundos, mas para um agente de voz é uma pausa perceptível antes de qualquer áudio começar a tocar. A documentação da Mistral cita até 3 segundos para MP3; não vi isso na prática, embora as condições de rede variem. O PCM ficou entre ~0,6 e 0,9 segundo, consistente com a marca de ~0,8 segundo reportada pela Mistral.

A troca é que PCM é áudio cru, sem compressão, então seu aplicativo precisa tratá-lo ou convertê-lo antes da reprodução padrão. Se você está salvando em arquivo ou usando um player comum, MP3 é mais simples. Se você controla a pilha de áudio diretamente, como em um pipeline de agente de voz, PCM é a escolha prática em latência.

A API suporta cinco formatos de saída: MP3, WAV, PCM (float32 cru), FLAC e Opus. O modelo gera até dois minutos de áudio em uma única passagem. Para conteúdos mais longos, a API gerencia automaticamente usando o que a Mistral chama de "interleaving inteligente": divide o texto em trechos, sintetiza cada um e junta tudo sem lacunas audíveis.

Também montei um pequeno app em Streamlit que reúne os três exemplos em uma interface. Aqui vai um rápido passo a passo de como ele funciona:

Todo o código deste tutorial está disponível neste repositório no GitHub.

Preços do Voxtral TTS

O Voxtral TTS custa US$ 16 por milhão de caracteres via API em nuvem. Há uma camada gratuita para testes e os pesos abertos no Hugging Face são gratuitos para uso não comercial sob a licença CC BY-NC 4.0.

Veja como isso se compara às principais alternativas no início de 2026.

|

Provedor |

Modelo |

Preço por 1M de caracteres |

Pesos abertos |

|

Mistral |

Voxtral TTS |

US$ 16 |

Sim (não comercial) |

|

OpenAI |

TTS-1 |

US$ 15 |

Não |

|

OpenAI |

TTS-1-HD |

US$ 30 |

Não |

|

Google Cloud |

Neural2 |

US$ 16 |

Não |

|

Google Cloud |

Chirp 3 HD |

US$ 30 |

Não |

|

Amazon Polly |

Neural |

US$ 16 |

Não |

|

Azure Speech |

Neural TTS |

US$ 15–16 |

Não |

|

Deepgram |

Aura-2 |

US$ 30 |

Não |

|

ElevenLabs |

Flash v2.5 |

~US$ 25–110 (varia por plano) |

Não |

O Voxtral TTS se alinha aos provedores intermediários na nuvem em preço, não ao tier mais barato. A Mistral o descreveu como "uma fração de qualquer outra coisa no mercado", mas isso vale principalmente em comparação ao ElevenLabs. Em relação ao OpenAI TTS-1, Google Neural2 e Amazon Polly, o preço é essencialmente o mesmo.

Os pesos abertos são o grande diferencial: nenhum outro provedor na tabela oferece pesos auto-hospedáveis. Para projetos não comerciais, isso significa implantação local gratuita via vLLM-Omni. Para empresas, a Mistral oferece opções on-premise pela plataforma Forge.

A contrapartida é a cobertura de idiomas. Nove idiomas contra mais de 70 no ElevenLabs. Se seu caso de uso vai além da lista suportada, essa diferença pesa.

Conclusão

Neste tutorial, executamos três exemplos com a API: geração básica de fala, clonagem de voz e latência por formato de saída. Mas dá para ir muito além.

Esteja você criando um agente de voz, uma ferramenta de narração multilíngue ou qualquer solução em que o áudio precise permanecer na sua infraestrutura, o Voxtral TTS é uma opção prática para avaliar. Antes de ir para produção, note que os benchmarks são auto-reportados, a licença CC BY-NC restringe a auto-hospedagem comercial e a auto-hospedagem atualmente requer o vLLM-Omni. A documentação da Mistral e o artigo de pesquisa são ótimos pontos de partida.

Sou engenheiro de dados e criador de comunidades que trabalha com pipelines de dados, nuvem e ferramentas de IA, além de escrever tutoriais práticos e de alto impacto para o DataCamp e desenvolvedores iniciantes.

FAQs

O Voxtral TTS precisa de GPUs?

Para a API em nuvem, não. Requisitos de GPU só entram em cena se você for auto-hospedar os pesos abertos. Os pesos BF16 padrão têm cerca de 8 GB e precisam de pelo menos 16 GB de VRAM para inferência. O artigo de pesquisa menciona uma versão quantizada em torno de 3 GB, mas essa não é a publicação padrão no Hugging Face.

Posso usar os pesos abertos comercialmente?

Os pesos estão sob CC BY-NC 4.0, ou seja, apenas para uso não comercial. A API em nuvem não tem essa restrição. Se você precisa de implantação comercial on-premise, a Mistral oferece licenciamento empresarial. Observe que os modelos de fala para texto deles usam a licença mais permissiva Apache 2.0, que é um caso diferente.

Como o Voxtral TTS lida com idiomas que não suporta?

Ele não gera erro. Segundo relatos, a entrada em idioma não suportado tende a produzir saída degradada sem aviso. Valide o idioma do seu lado antes de enviar a solicitação.

Posso usar o Voxtral TTS para agentes de voz em tempo real?

Sim. O tempo até o primeiro áudio fica em cerca de 0,8 segundo com PCM e entre 1,5 e 2 segundos com MP3, com base nos números da Mistral e nos meus testes. Isso é viável para agentes de voz, embora PCM seja a melhor escolha se velocidade de resposta importar.

A qualidade da clonagem de voz varia por idioma?

Sim. Segundo as próprias avaliações da Mistral, hindi e espanhol tiveram os melhores resultados, enquanto holandês foi o ponto fraco. Esses dados são auto-reportados, então encare como indicativos, mas vale saber se você está construindo para um idioma específico.