programa

Todos hemos oído hablar de las CPU (Unidades Centrales de Procesamiento) y las GPU (Unidades de Procesamiento Gráfico), pero ¿conoces las diferencias en cómo gestionan el procesamiento? Aunque ambos son esenciales para la informática moderna, están diseñados para fines distintos.

En esta guía, desglosaré las diferencias, los casos de uso y la evolución de las funciones de las CPU y las GPU.

¿Qué es una CPU?

La CPU, a menudo llamada el "cerebro" del ordenador, es la unidad central que ejecuta las tareas informáticas de propósito general. Está optimizado para gestionar instrucciones secuenciales complejas e implica casi todos los aspectos de la informática, desde el manejo de aplicaciones hasta la ejecución del sistema operativo. Las aplicaciones incluyen todo, desde tu navegador hasta programas de chat y correo electrónico.

Las CPU son realmente buenas en tareas que exigen precisión y fiabilidad, como realizar operaciones aritméticas, ejecutar decisiones basadas en la lógica y controlar el flujo de datos.

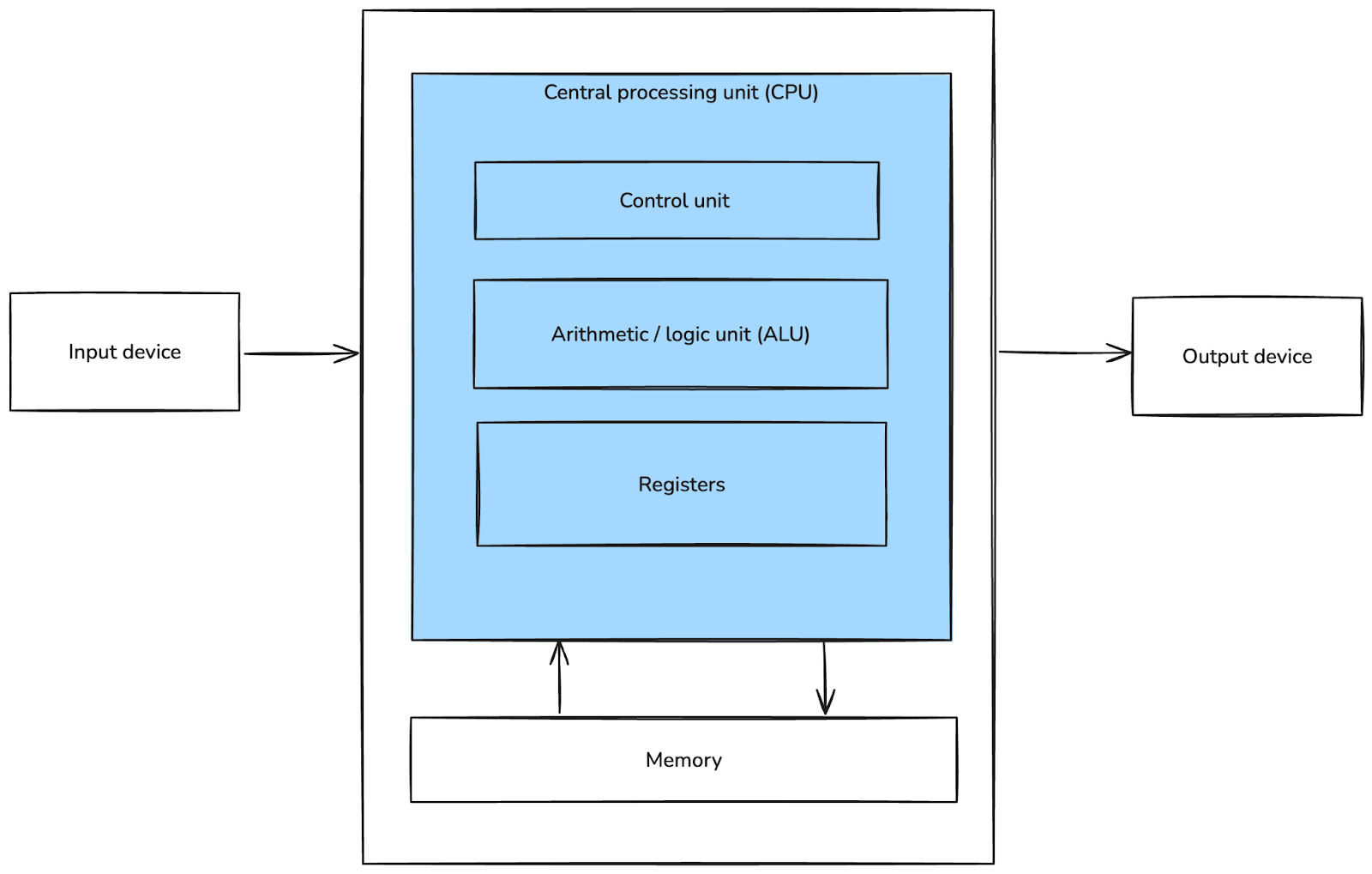

Arquitectura Von Neumann básica. Imagen del autor.

Las CPU modernas suelen tener varios núcleos, lo que les permite ejecutar varias tareas simultáneamente (aunque a menor escala que las GPU). También incorporan tecnologías avanzadas como hyper-threading y jerarquías de caché para mejorar la eficiencia y reducir la latencia durante la ejecución de tareas.

Cómo funciona una CPU

Las CPU procesan tareas secuencialmente, siguiendo un ciclo de instrucciones que implica la obtención, descodificación, ejecución y almacenamiento de datos. Este enfoque paso a paso permite una gran precisión y fiabilidad, lo que hace que las CPU sean ideales para tareas de un solo hilo, como consultas a bases de datos, compilación de código y simulaciones complejas.

Aunque las CPU modernas pueden realizar varias tareas a la vez hasta cierto punto, su fuerza reside en realidad en su capacidad para realizar cálculos complejos en los que la precisión y el orden son esenciales.

Las CPU también disponen de sólidos mecanismos de gestión de errores para realizar cálculos sin corrupción de datos ni fallos lógicos.

Características de las CPU

Las CPU se caracterizan por unos pocos núcleos con altas velocidades de reloj. Cada núcleo se centra en uno o unos pocos hilos a la vez, lo que los hace muy eficientes para tareas que requieren una gran potencia de procesamiento pero un paralelismo limitado.

Las características principales de las CPU son

- Velocidad de reloj: Medido en GHz, determina cuántos ciclos puede ejecutar un núcleo por segundo, lo que influye directamente en el rendimiento de las tareas de un solo hilo.

- Memoria caché: Las CPU tienen cachés integradas (L1, L2 y L3) que almacenan los datos a los que se accede con frecuencia, reduciendo el tiempo necesario para obtener los datos de la RAM.

- Conjuntos de instrucciones: Las CPU utilizan complejos conjuntos de instrucciones (como x86) para realizar una amplia gama de tareas, desde cálculos matemáticos hasta procesamiento multimedia.

A pesar de su precisión y versatilidad, las CPU están limitadas en su capacidad para manejar cargas de trabajo masivamente paralelas de forma eficiente, como el entrenamiento de grandes modelos de aprendizaje automático o el renderizado de gráficos de alta resolución. Para estas tareas, los procesadores especializados como las GPU suelen tomar la delantera. Examinemos por qué es así en la siguiente sección.

¿Qué es una GPU?

Una GPU es un procesador especializado optimizado para tareas que implican el procesamiento paralelo o el procesamiento simultáneo de varios paquetes de información.

Las GPU se desarrollaron inicialmente para manejar el renderizado de imágenes para videojuegos y aplicaciones visuales, pero han evolucionado hasta convertirse en potentes herramientas utilizadas en diversos campos, como la ciencia de datos, el aprendizaje automático, la minería de criptomonedas y las simulaciones científicas. Su capacidad para procesar enormes cantidades de datos en paralelo los ha convertido en fundamentales para la informática de alto rendimiento y el desarrollo de la IA.

Cómo funciona una GPU

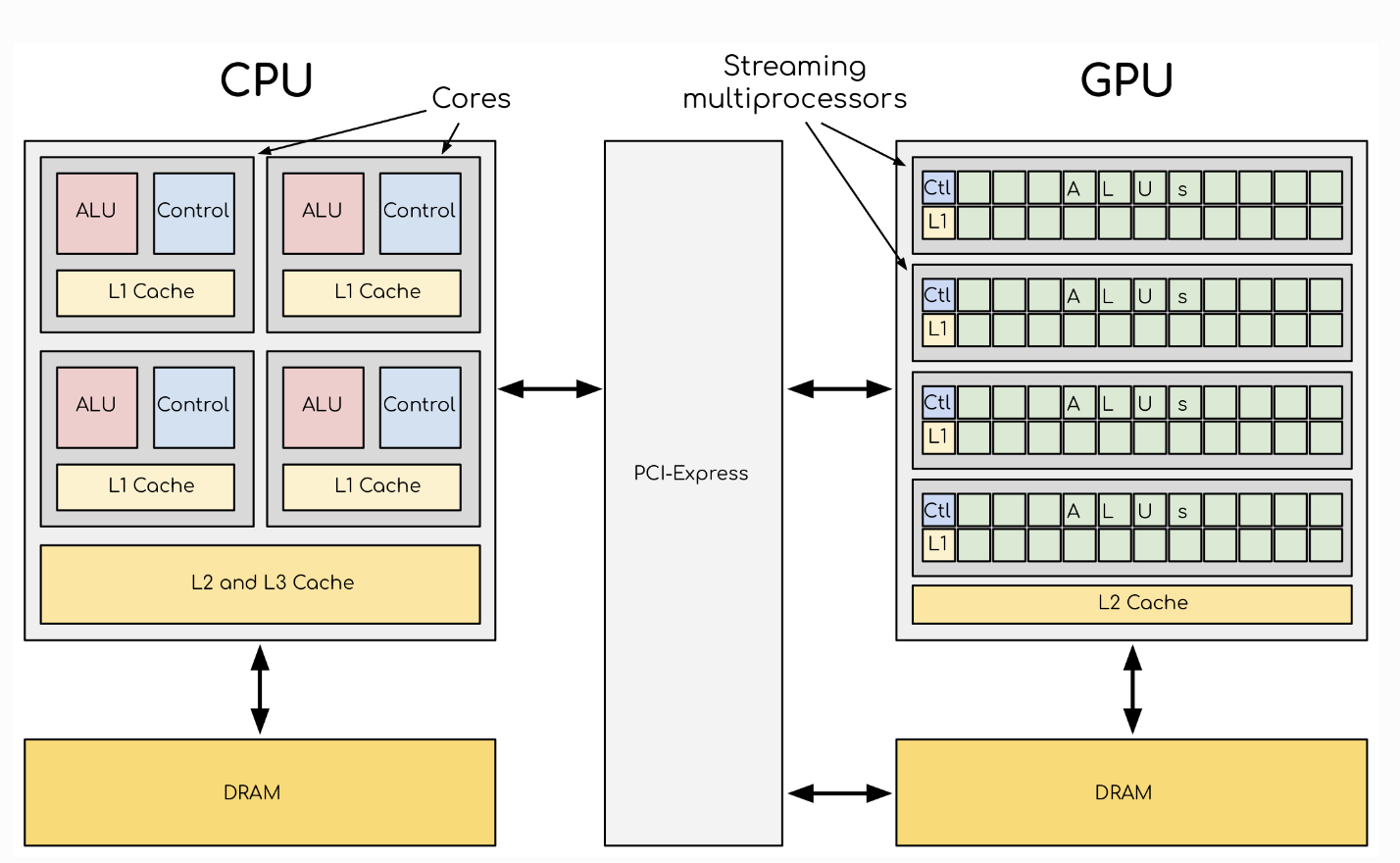

Las GPU tienen miles de núcleos más pequeños que pueden ejecutar tareas sencillas de forma independiente, lo que las hace ideales para cargas de trabajo paralelas.

A diferencia de las CPU, que se centran en la precisión y el orden, las GPU dividen los grandes problemas en tareas más pequeñas, las procesan en paralelo y agregan los resultados. Esta arquitectura permite a las GPU destacar en operaciones en las que se aplican repetidamente las mismas instrucciones en grandes conjuntos de datos.

Por ejemplo, al renderizar una imagen, una GPU asigna cada píxel a un núcleo distinto para procesarlo simultáneamente, lo que acelera considerablemente la operación. En el aprendizaje automático, este paralelismo permite un entrenamiento más rápido procesando lotes de datos y realizando cálculos como multiplicaciones de matrices en muchos núcleos a la vez.

Las GPU modernas también incluyen funciones como Tensor Cores (en las GPU NVIDIA) u otras unidades especializadas diseñadas para acelerar las tareas de IA, lo que las hace aún más eficientes para tareas como el entrenamiento de redes neuronales.

Características de las GPU

En resumen, éstas son las características que distinguen a las GPU:

- Recuento de núcleos: Una GPU puede tener miles de núcleos, lo que le permite manejar grandes cargas de trabajo paralelas. Aunque estos núcleos son menos potentes individualmente que los núcleos de la CPU, su rendimiento combinado es inmenso.

- Velocidad de reloj: Las GPU tienen velocidades de reloj más bajas que las CPU. Esta compensación permite que quepan más núcleos en un chip, dando más importancia al rendimiento que al rendimiento de un solo subproceso.

- Ancho de banda de la memoria: Las GPU están equipadas con memoria de gran ancho de banda (como la GDDR6 o la HBM) para manejar las demandas de datos intensivos del procesamiento paralelo.

- Escalabilidad: Las GPU modernas admiten configuraciones multi-GPU, en las que las tareas se distribuyen entre varias GPU para obtener mayores ganancias de rendimiento.

Aprende Python desde cero

Diferencias entre CPU y GPU

Veamos ahora las diferencias específicas entre CPU y GPU. Uno de los principales que debatimos fue el de la computación en serie frente a la paralela, pero hay otros importantes.

Arquitectura y diseño

Las CPU se construyen con menos núcleos, más potentes y optimizados para el procesamiento monohilo y secuencial. Estos núcleos incorporan unidades de control avanzadas, cachés más grandes (L1, L2 y, a veces, L3) y compatibilidad con conjuntos de instrucciones sofisticados como x86-64 o ARM.

En cambio, las GPU tienen un enorme conjunto de núcleos más pequeños diseñados para manejar tareas paralelas. Estos núcleos funcionan según un modelo de Instrucción Única, Datos Múltiples (SIMD), en el que la misma operación se aplica a varios puntos de datos simultáneamente.

Una comparación de la arquitectura de la GPU y la CPU. Fuente de la imagen .

Rendimiento y eficacia

Como puedes imaginar, las diferencias de arquitectura influyen directamente en el rendimiento.

Con sus altas velocidades de reloj y su manejo avanzado de instrucciones, las CPU destacan en tareas de baja latencia que requieren gran precisión y operaciones lógicas. Algunos ejemplos son la gestión del sistema operativo, las consultas a bases de datos y la ejecución de hilos de aplicaciones. Las CPU también son más versátiles y capaces de cambiar eficazmente entre diversas cargas de trabajo gracias a sus capacidades de descodificación de instrucciones y predicción de bifurcaciones.

Como ya se ha dicho, las GPU prosperan en tareas en las que el paralelismo es clave. Su capacidad para procesar múltiples flujos de datos simultáneamente los hace indispensables para operaciones de alto rendimiento, como la codificación de vídeo, las simulaciones científicas y el entrenamiento de redes neuronales. Por ejemplo, en el aprendizaje profundo, las GPU aceleran las multiplicaciones matriciales y la retropropagación, reduciendo drásticamente los tiempos de entrenamiento en comparación con las CPU.

La compensación radica en la naturaleza de la carga de trabajo: Las CPU superan a las GPU en las tareas secuenciales, mientras que las GPU dominan en las tareas paralelas con muchos datos.

Consumo de energía

Por lo general, las GPU consumen más energía debido a su elevado número de núcleos y a las intensas demandas de procesamiento paralelo, mientras que las CPU suelen tener menores requisitos energéticos.

Una GPU de gama alta puede consumir varios cientos de vatios bajo carga, especialmente durante operaciones intensivas como el entrenamiento de modelos de aprendizaje automático o el renderizado de gráficos 4K. Además, sus elevados requisitos de ancho de banda de memoria aumentan aún más el consumo de energía.

Funciones de la CPU como el escalado dinámico de voltaje y frecuencia (DVFS), los estados de bajo consumo (estados C) y los mecanismos de refrigeración eficientes permiten a las CPU equilibrar eficazmente el rendimiento con el consumo de energía. Esto hace que las CPU sean más adecuadas para dispositivos que requieren una mayor duración de la batería o un menor rendimiento térmico, como los portátiles y los dispositivos móviles.

Coste y disponibilidad

Las CPU están ampliamente disponibles en los dispositivos de consumo y suelen ser más asequibles. Su amplia utilidad y la saturación del mercado hacen que sean relativamente baratos para los consumidores. Las CPU básicas pueden costar menos de 100 $, mientras que los modelos de alto rendimiento para servidores o estaciones de trabajo pueden llegar a los miles.

Las GPU, especialmente los modelos de alto rendimiento, son más caras y suelen encontrarse en estaciones de trabajo, sistemas de juegos y entornos informáticos de alto rendimiento. Las GPU de consumo para juegos pueden oscilar entre 200 y 1.000 dólares, mientras que las GPU especializadas para centros de datos o investigación científica, como la serie A100 de NVIDIA o la Instinct de AMD, pueden costar decenas de miles de dólares.

La siguiente tabla ofrece una comparación detallada entre CPU y GPU, para que sea más fácil ver sus diferencias de un vistazo:

|

CPU (Unidad Central de Proceso) |

GPU (Unidad de procesamiento gráfico) |

|

|

Función principal |

Procesamiento de propósito general para tareas secuenciales |

Especializado para procesamiento paralelo y tareas intensivas en datos |

|

Arquitectura |

Menos núcleos potentes optimizados para el rendimiento de un solo hilo |

Miles de núcleos más pequeños y sencillos optimizados para el paralelismo |

|

Modelo de procesamiento |

Ejecución en serie: tareas procesadas de una en una |

Ejecución paralela: múltiples tareas procesadas simultáneamente |

|

Recuento de núcleos |

Normalmente, de 4 a 64 núcleos en CPU de consumo |

Puede tener miles de núcleos en GPUs de alto rendimiento |

|

Velocidad de reloj |

Velocidades de reloj más altas (hasta ~5 GHz) |

Velocidades de reloj más bajas (~1-2 GHz) |

|

Puntos fuertes |

Precisión, tareas secuenciales, versatilidad y operaciones lógicas |

Alto rendimiento para operaciones a gran escala como matemáticas matriciales |

|

Casos prácticos |

Ejecución de sistemas operativos, lógica de aplicaciones, bases de datos |

Renderizado gráfico, aprendizaje automático, computación científica |

|

Consumo de energía |

Más bajo debido a menos núcleos y diseños de bajo consumo energético |

Mayor debido a los núcleos densos y a las demandas de ancho de banda de la memoria |

|

Ancho de banda de la memoria |

Más bajo, normalmente optimizado para la latencia |

Más alto, optimizado para el rendimiento (por ejemplo, GDDR6, memoria HBM) |

|

Coste |

Relativamente asequible y ampliamente disponible |

Más caro, especialmente para los modelos de alto rendimiento |

|

Aplicaciones |

Portátiles, ordenadores de sobremesa, servidores, dispositivos móviles |

Sistemas de juego, estaciones de trabajo, entornos HPC, cargas de trabajo de IA |

|

Flexibilidad |

Amplia compatibilidad para diversas tareas |

Optimizado para cargas de trabajo específicas que requieren paralelismo |

Casos de uso de la CPU

Analicemos brevemente algunos casos de uso más específicos de las CPU:

- Informática de propósito general: Las CPU son perfectas para las tareas cotidianas, como navegar por Internet, utilizar aplicaciones de productividad y usar el ordenador para el día a día. La mayor parte de la carga de trabajo de tu ordenador se basa en la CPU.

- Aplicaciones monohilo: Las tareas que requieren un procesamiento monohilo, como los cálculos financieros específicos, son más adecuadas para las CPU. Otras aplicaciones de un solo hilo son los procesadores de texto, los navegadores y las aplicaciones de música.

- Gestión del sistema operativo: Las CPU se encargan de los procesos esenciales del sistema, gestionando las entradas, salidas y tareas en segundo plano que mantienen el sistema funcionando sin problemas.

Casos de uso de la GPU

Repasemos brevemente algunos casos de uso específicos de la GPU:

- Procesamiento gráfico y de vídeo: Las GPU están diseñadas para renderizar gráficos de alta calidad, lo que las hace indispensables en juegos, edición de vídeo y aplicaciones de uso intensivo de gráficos. Esto es posible gracias a su capacidad de procesamiento paralelo, como he mencionado a lo largo del artículo. Muchos juegos con gráficos intensivos requieren una GPU razonablemente potente para jugar sin lag ni problemas.

- Aprendizaje automático e IA: Las GPU se utilizan a menudo para entrenar modelos de aprendizaje automático y procesar grandes conjuntos de datos con rapidez, satisfaciendo las necesidades de alto rendimiento de los algoritmos de IA. Debido al volumen de cálculos, son especialmente necesarios para los proyectos que utilizan redes neuronales. Dado que muchos cálculos pueden realizarse en paralelo, las GPU son un componente crítico del aprendizaje automático complejo.

- Ciencia de datos e informática científica: Las GPU pueden acelerar los cálculos a gran escala y las operaciones matriciales en la ciencia de datos, lo que las hace muy valiosas para los análisis y simulaciones de datos intensivos. Calcular cosas como tensores, análisis de imágenes y capas convolucionales requiere un cálculo masivo. Por ejemplo, Polars ofrece un motor GPU para acelerar las consultas.

El futuro de las CPU y las GPU

¡Tanto las CPU como las GPU siguen creciendo en potencia y complejidad! Sus futuros muestran un aumento de la capacidad de cálculo y un uso generalizado.

CPUs que se adaptan a más núcleos

Las CPU están aumentando el número de núcleos para satisfacer las exigencias de la multitarea moderna. Esto mejora su capacidad de computación en serie y ofrece cierta computación paralela mediante multihilo.

Algunas tendencias en el desarrollo de CPUs son:

- Aumento del número de núcleos: Las CPU de consumo suelen tener entre 8 y 16 núcleos, mientras que los procesadores de servidor pueden tener 64 o más núcleos. Esto permite mejorar las capacidades de computación paralela mediante tecnologías como el multihilo simultáneo (SMT) y el hiperhilo.

- Arquitecturas heterogéneas: Las CPU modernas, como la serie Alder Lake de Intel o el diseño big.LITTLE de ARM, combinan núcleos de alto rendimiento con núcleos de bajo consumo para optimizar tanto el consumo de energía como el rendimiento de las tareas.

- Integración con unidades especializadas: Las CPU integran cada vez más aceleradores, como motores de inferencia de IA o unidades de procesamiento gráfico, directamente en el chip para mejorar el rendimiento en cargas de trabajo específicas.

Desarrollo de GPU para computación de propósito general

Las GPU están evolucionando para manejar tareas de propósito general, lo que las hace cada vez más versátiles para operaciones con muchos datos. Fabricantes como NVIDIA y AMD están invirtiendo en ecosistemas de software agnósticos del hardware (por ejemplo, CUDA, ROCm) para ampliar la aplicabilidad de las GPU más allá de los gráficos.

Muchos paquetes de aprendizaje automático son ahora capaces de utilizar GPUs. Frameworks como TensorFlow y PyTorchsoportan ahora de forma nativala aceleración en la GPU, reduciendo drásticamente los tiempos de cálculo.

Unidades de procesamiento especializadas

El futuro del procesamiento no se limita a las CPU y las GPU. El auge de los procesadores especializados, como las TPU (Unidades de Procesamiento Tensorial) y las NPU (Unidades de Procesamiento Neuronal), refleja una creciente demanda de hardware específico para cada tarea:

- Unidades de Procesamiento Tensorial (TPU): Desarrolladas por Google, las TPU están diseñadas específicamente para acelerar los cálculos de las redes neuronales. A diferencia de las GPU, las TPU se centran en operaciones matriciales pesadas y están optimizadas para tareas de IA a gran escala. Si tienes más preguntas, lee el artículo de sobre TPUs vs. TPUs. GPUs.

- Unidades de Procesamiento Neuronal (NPU): Las NPU, que se encuentran en los dispositivos móviles y en la computación periférica, están diseñadas para realizar tareas relacionadas con la IA, como el reconocimiento de imágenes, el procesamiento del habla y la comprensión del lenguaje natural, con un consumo mínimo de energía.

- Avances en FPGA y ASIC: Las matrices de puertas programables en campo (FPGA) y los circuitos integrados específicos para aplicaciones (ASIC) también están ganando adeptos por su capacidad de personalización para aplicaciones específicas, como la minería de criptomonedas, el procesamiento de paquetes de red y el análisis en tiempo real.

Conclusión

Las CPU y las GPU aportan cada una puntos fuertes únicos a la informática: Las CPU destacan en tareas de propósito general y precisas, mientras que las GPU brillan en el procesamiento paralelo y las cargas de trabajo con muchos datos. Comprender estas diferencias ayuda a los científicos de datos, a los jugadores y a los profesionales a elegir el hardware con conocimiento de causa.

Si te interesa explorar cómo las GPU potencian los modelos de aprendizaje profundo, consulta Introducción al aprendizaje profundo con PyTorch. Para una comprensión más amplia de las tecnologías de IA y sus aplicaciones, el tema Fundamentos de la IA proporciona una visión general completa. Para profundizar en la mecánica del aprendizaje automático, explora el curso Comprender el Aprendizaje Automático.

Conviértete en un Científico ML

Preguntas frecuentes

¿Puede una GPU sustituir a una CPU en las tareas informáticas cotidianas?

No, las GPU no sustituyen a las CPU. Aunque las GPU destacan en tareas de procesamiento paralelo, carecen de la versatilidad y el rendimiento de un solo hilo que ofrecen las CPU para tareas de propósito general.

¿Cuándo debo utilizar conjuntamente una CPU y una GPU?

Un enfoque híbrido puede proporcionar un rendimiento óptimo aprovechando los puntos fuertes de ambos tipos de procesador para tareas como la edición de vídeo y las redes neuronales.

¿Por qué se utilizan GPUs en el aprendizaje automático y la IA en lugar de CPUs?

Las tareas de aprendizaje automático e IA a menudo implican procesar grandes conjuntos de datos y ejecutar numerosos cálculos simultáneamente. Las GPU, con su elevado número de núcleos y su capacidad de procesamiento paralelo, pueden realizar estas tareas mucho más rápido que las CPU.

¿Existen procesadores especializados, además de CPU y GPU, para tareas específicas?

Sí, los procesadores especializados como las TPU (Unidades de Procesamiento Tensorial) están diseñados para manejar cargas de trabajo específicas como el aprendizaje automático. Las TPU combinan elementos de las arquitecturas de CPU y GPU para optimizar el rendimiento de determinados tipos de procesamiento de datos.

Soy un científico de datos con experiencia en análisis espacial, aprendizaje automático y canalización de datos. He trabajado con GCP, Hadoop, Hive, Snowflake, Airflow y otros procesos de ciencia/ingeniería de datos.