Cursus

Nous avons tous entendu parler des CPU (Central Processing Units) et des GPU (Graphics Processing Units), mais connaissez-vous les différences dans la manière dont ils traitent les données ? Bien qu'ils soient tous deux essentiels à l'informatique moderne, ils sont conçus à des fins différentes.

Dans ce guide, j'analyserai les différences, les cas d'utilisation et l'évolution des rôles des CPU et des GPU.

Qu'est-ce qu'une unité centrale ?

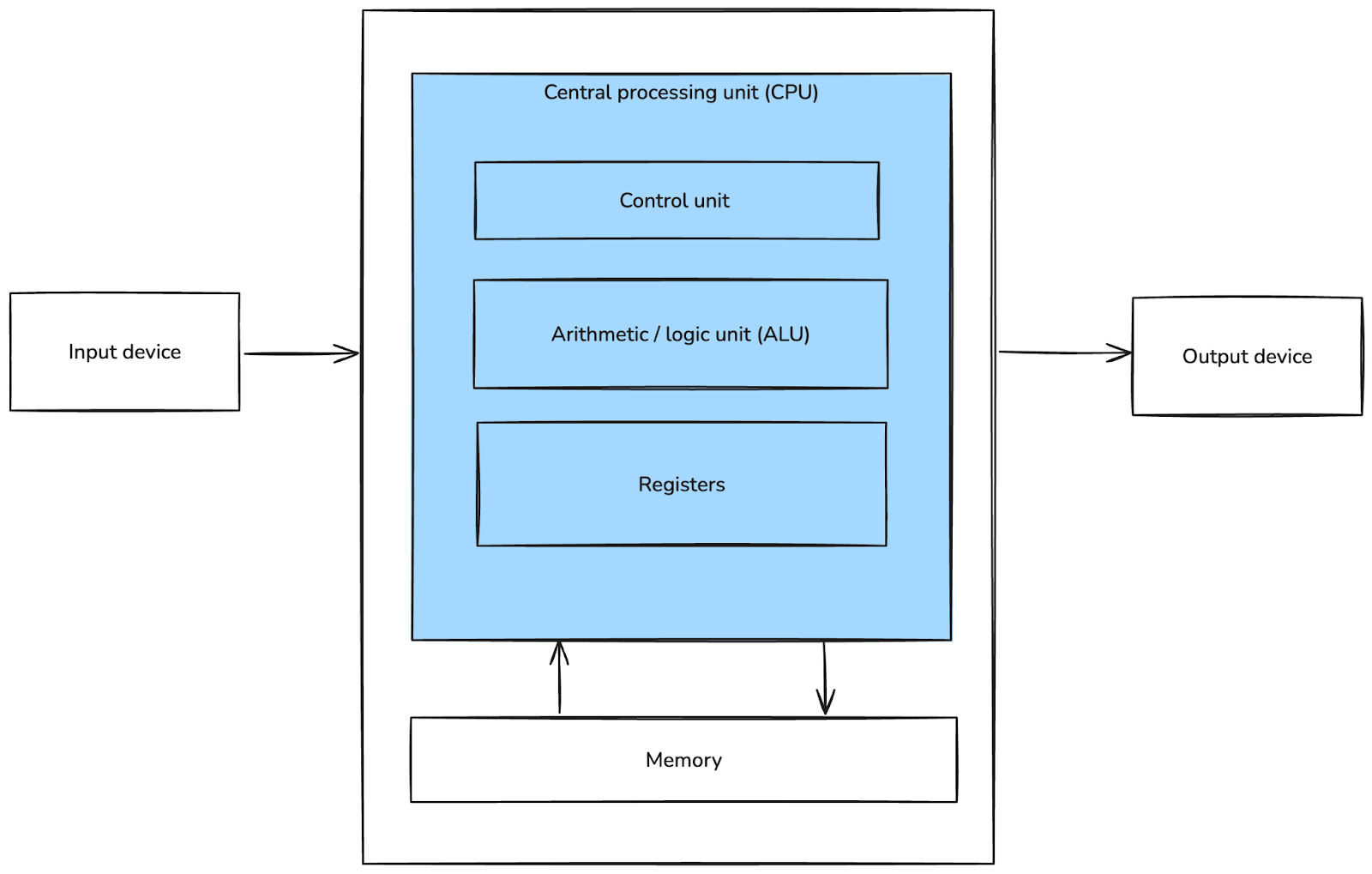

L'unité centrale, souvent appelée "cerveau" de l'ordinateur, est l'unité centrale qui exécute les tâches informatiques générales. Il est optimisé pour gérer des instructions séquentielles complexes et concerne presque tous les aspects de l'informatique, de la gestion des applications à l'exécution du système d'exploitation. Les applications vont de votre navigateur aux programmes de chat en passant par le courrier électronique.

Les unités centrales de traitement sont très performantes dans les tâches qui exigent précision et fiabilité, telles que les opérations arithmétiques, l'exécution de décisions logiques et le contrôle du flux de données.

Architecture de base de Von Neumann. Image par l'auteur.

Les processeurs modernes sont souvent dotés de plusieurs cœurs, ce qui leur permet d'exécuter plusieurs tâches simultanément (bien qu'à une échelle plus réduite par rapport aux GPU). Ils intègrent également des technologies avancées telles que l'hyperthreading et les hiérarchies de cache pour améliorer l'efficacité et réduire la latence lors de l'exécution des tâches.

Fonctionnement d'une unité centrale

Les CPU traitent les tâches de manière séquentielle, en suivant un cycle d'instructions qui implique la récupération, le décodage, l'exécution et le stockage des données. Cette approche progressive permet d'obtenir une précision et une fiabilité élevées, ce qui rend les unités centrales de traitement idéales pour les tâches à un seul fil telles que les requêtes de bases de données, la compilation de code et les simulations complexes.

Bien que les unités centrales de traitement modernes puissent être multitâches dans une certaine mesure, leur force réside en fait dans leur capacité à traiter des calculs complexes où la précision et l'ordre sont essentiels.

Les unités centrales de traitement sont également dotées de mécanismes robustes de traitement des erreurs qui permettent d'effectuer des calculs sans corruption de données ni fautes logiques.

Caractéristiques des CPU

Les unités centrales de traitement se caractérisent par un petit nombre de cœurs avec des vitesses d'horloge élevées. Chaque cœur se concentre sur un ou quelques threads à la fois, ce qui les rend très efficaces pour les tâches qui nécessitent une puissance de traitement importante mais un parallélisme limité.

Les principales caractéristiques des unités centrales de traitement sont les suivantes

- Vitesse d'horloge : Mesuré en GHz, il détermine le nombre de cycles qu'un cœur peut exécuter par seconde, ce qui a un impact direct sur les performances des tâches à un seul fil.

- Mémoire cache : Les CPU disposent de caches intégrés (L1, L2 et L3) qui stockent les données fréquemment consultées, réduisant ainsi le temps nécessaire pour extraire les données de la mémoire vive.

- Ensembles d'instructions : Les unités centrales de traitement utilisent des jeux d'instructions complexes (comme x86) pour gérer un large éventail de tâches, des calculs mathématiques au traitement multimédia.

Malgré leur précision et leur polyvalence, les processeurs sont limités dans leur capacité à gérer efficacement des charges de travail massivement parallèles, telles que l'apprentissage de grands modèles d'apprentissage automatique ou le rendu de graphiques à haute résolution. Pour ces tâches, les processeurs spécialisés tels que les GPU prennent souvent l'avantage. Nous verrons pourquoi dans la section suivante.

Qu'est-ce qu'un GPU ?

Un GPU est un processeur spécialisé optimisé pour les tâches qui impliquent un traitement parallèle ou le traitement simultané de plusieurs ensembles d'informations.

Les GPU ont été initialement développés pour gérer le rendu d'images pour les jeux vidéo et les applications visuelles, mais ils ont évolué pour devenir des outils puissants utilisés dans divers domaines, notamment la science des données, l'apprentissage automatique, le minage de crypto-monnaies et les simulations scientifiques. Leur capacité à traiter d'énormes quantités de données en parallèle les a rendues essentielles pour le calcul à haute performance et le développement de l'IA.

Fonctionnement d'un GPU

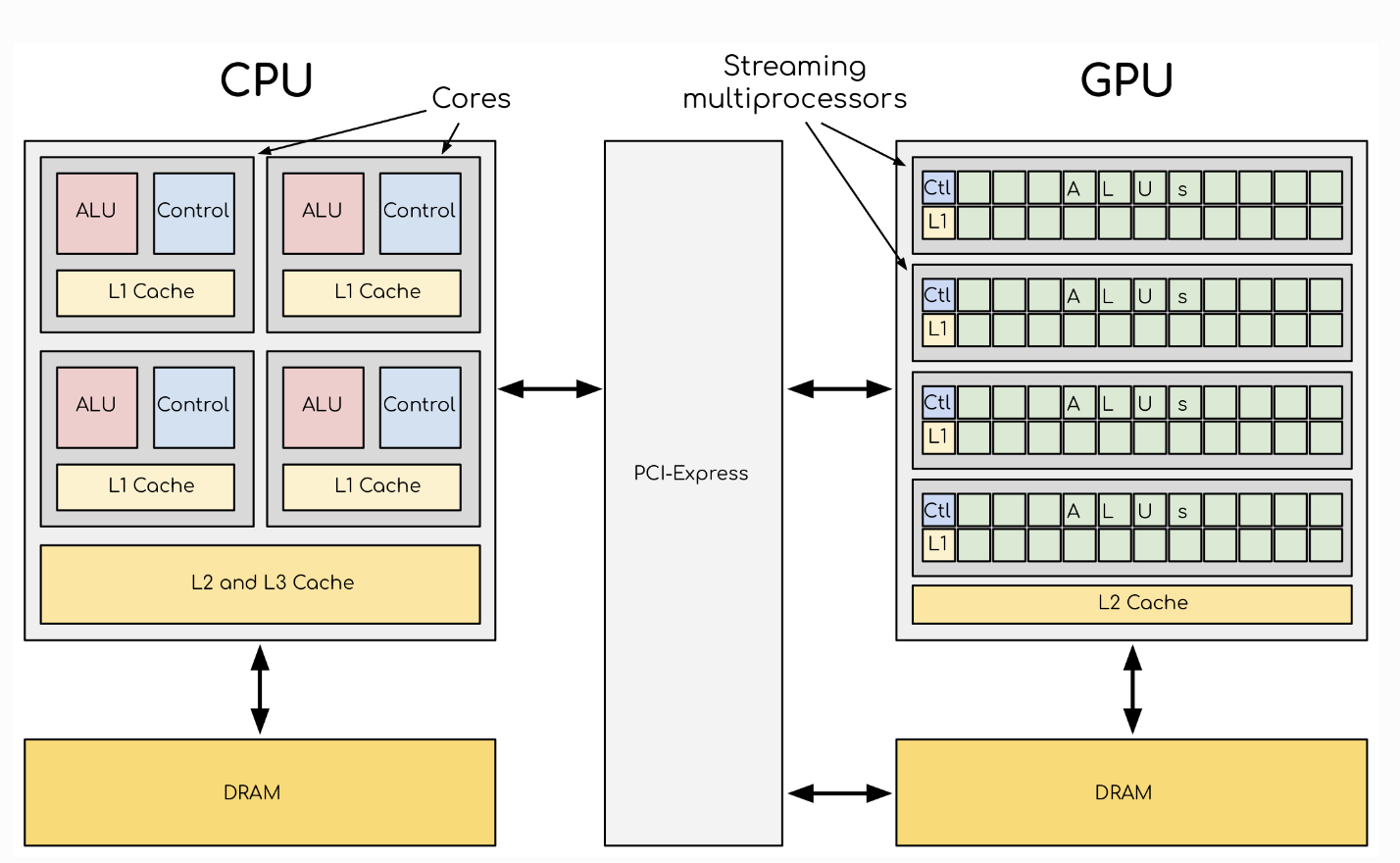

Les GPU possèdent des milliers de petits cœurs qui peuvent exécuter des tâches simples de manière indépendante, ce qui les rend idéaux pour les charges de travail parallèles.

Contrairement aux CPU, qui se concentrent sur la précision et l'ordre, les GPU divisent les grands problèmes en tâches plus petites, les traitent en parallèle et agrègent les résultats. Cette architecture permet aux GPU d'exceller dans les opérations où les mêmes instructions sont appliquées de manière répétée sur de grands ensembles de données.

Par exemple, lors du rendu d'une image, un GPU affecte chaque pixel à un cœur distinct pour un traitement simultané, ce qui accélère considérablement l'opération. Dans le domaine de l'apprentissage automatique, ce parallélisme permet d'accélérer l'apprentissage en traitant des lots de données et en effectuant des calculs tels que des multiplications de matrices sur plusieurs cœurs à la fois.

Les GPU modernes intègrent également des fonctions telles que les Tensor Cores (dans les GPU NVIDIA) ou d'autres unités spécialisées conçues pour accélérer les tâches d'IA, ce qui les rend encore plus efficaces pour des tâches telles que l'entraînement des réseaux neuronaux.

Caractéristiques des GPU

En résumé, voici les caractéristiques qui distinguent les GPU :

- Nombre de noyaux : Un GPU peut avoir des milliers de cœurs, ce qui lui permet de gérer des charges de travail parallèles importantes. Bien que ces cœurs soient moins puissants individuellement que les cœurs de l'unité centrale, leur puissance combinée est immense.

- Vitesse d'horloge : Les GPU ont des vitesses d'horloge inférieures à celles des CPU. Ce compromis permet d'intégrer davantage de cœurs dans une puce, en privilégiant le débit par rapport à la performance d'un seul fil d'Ariane.

- Largeur de bande de la mémoire : Les GPU sont équipés d'une mémoire à large bande passante (comme GDDR6 ou HBM) pour gérer les demandes de traitement parallèle à forte intensité de données.

- Évolutivité : Les GPU modernes prennent en charge les configurations multi-GPU, dans lesquelles les tâches sont réparties entre plusieurs GPU afin d'améliorer les performances.

Apprenez Python à partir de zéro

Différences entre les CPU et les GPU

Examinons maintenant les différences spécifiques entre les CPU et les GPU. L'un des principaux sujets abordés a été l'opposition entre le calcul sériel et le calcul parallèle, mais il y a d'autres sujets importants.

Architecture et design

Les CPU sont construits avec des cœurs moins nombreux et plus puissants, optimisés pour le traitement séquentiel et à fil unique. Ces cœurs sont dotés d'unités de contrôle avancées, de caches plus importants (L1, L2 et parfois L3) et prennent en charge des jeux d'instructions sophistiqués tels que x86-64 ou ARM.

En revanche, les GPU disposent d'un réseau massif de petits cœurs conçus pour traiter des tâches parallèles. Ces cœurs fonctionnent selon le modèle SIMD (Single Instruction, Multiple Data), où la même opération est appliquée simultanément à plusieurs points de données.

Comparaison de l'architecture du GPU et du CPU. Image source.

Performance et efficacité

Comme vous pouvez l'imaginer, les différences d'architecture influencent directement les performances.

Grâce à leur vitesse d'horloge élevée et à leur traitement avancé des instructions, les CPU excellent dans les tâches à faible latence qui requièrent une grande précision et des opérations logiques. Les exemples incluent la gestion du système d'exploitation, les requêtes de base de données et l'exécution de threads d'application. Les CPU sont également plus polyvalents et capables de passer efficacement d'une charge de travail à l'autre grâce à leurs capacités de décodage des instructions et de prédiction des branchements.

Comme nous l'avons mentionné, les GPU sont très performants dans les tâches où le parallélisme est essentiel. Leur capacité à traiter simultanément plusieurs flux de données les rend indispensables pour les opérations à haut débit, telles que l'encodage vidéo, les simulations scientifiques et l'entraînement des réseaux neuronaux. Par exemple, dans le domaine de l'apprentissage profond, les GPU accélèrent les multiplications de matrices et la rétropropagation, ce qui réduit considérablement les temps d'apprentissage par rapport aux CPU.

Le compromis réside dans la nature de la charge de travail : Les CPU sont plus performants que les GPU dans les tâches séquentielles, tandis que les GPU dominent dans les tâches parallèles à forte intensité de données.

Consommation électrique

Les GPU consomment généralement plus d'énergie en raison de leur nombre élevé de cœurs et des exigences de traitement parallèle intensif, tandis que les CPU ont tendance à avoir des besoins énergétiques moindres.

Un GPU haut de gamme peut consommer plusieurs centaines de watts en charge, en particulier lors d'opérations intensives telles que l'entraînement de modèles d'apprentissage automatique ou le rendu de graphiques 4K. En outre, leurs exigences en matière de largeur de bande de la mémoire augmentent encore la consommation d'énergie.

Les caractéristiques des processeurs, telles que la mise à l'échelle dynamique de la tension et de la fréquence (DVFS), les états de faible consommation (états C) et les mécanismes de refroidissement efficaces, permettent aux processeurs d'équilibrer efficacement les performances et la consommation d'énergie. Les processeurs sont ainsi mieux adaptés aux appareils nécessitant une plus longue durée de vie de la batterie ou une puissance thermique plus faible, tels que les ordinateurs portables et les appareils mobiles.

Coût et disponibilité

Les CPU sont largement disponibles dans les appareils grand public et sont généralement plus abordables. Leur large utilité et la saturation du marché les rendent relativement peu coûteux pour les consommateurs. Les CPU d'entrée de gamme peuvent coûter moins de 100 dollars, tandis que les modèles haute performance pour serveurs ou stations de travail peuvent atteindre des milliers d'euros.

Les GPU, en particulier les modèles à haute performance, sont plus chers et se trouvent généralement dans les stations de travail, les systèmes de jeu et les environnements informatiques à haute performance. Les GPU grand public pour les jeux vont de 200 à 1 000 dollars, tandis que les GPU spécialisés pour les centres de données ou la recherche scientifique, tels que le A100 de NVIDIA ou la série Instinct d'AMD, peuvent coûter des dizaines de milliers de dollars.

Le tableau suivant propose une comparaison détaillée entre les CPU et les GPU, ce qui permet de voir plus facilement leurs différences en un coup d'œil :

|

CPU (unité centrale de traitement) |

GPU (unité de traitement graphique) |

|

|

Fonction principale |

Traitement polyvalent pour les tâches séquentielles |

Spécialisé dans le traitement parallèle et les tâches à forte intensité de données |

|

L'architecture |

Des cœurs moins nombreux et plus puissants, optimisés pour les performances à un seul fil. |

Des milliers de cœurs plus petits et plus simples, optimisés pour le parallélisme |

|

Modèle de traitement |

Exécution en série : les tâches sont traitées une par une |

Exécution parallèle : traitement simultané de plusieurs tâches |

|

Nombre de noyaux |

Généralement 4 à 64 cœurs dans les unités centrales grand public |

Les GPU haute performance peuvent comporter des milliers de cœurs. |

|

Vitesse d'horloge |

Vitesses d'horloge plus élevées (jusqu'à ~5 GHz) |

Vitesses d'horloge plus faibles (~1-2 GHz) |

|

Points forts |

Précision, tâches séquentielles, polyvalence et opérations logiques |

Débit élevé pour les opérations à grande échelle telles que les calculs matriciels |

|

Cas d'utilisation |

Exécution de systèmes d'exploitation, logique d'application, bases de données |

Rendu graphique, apprentissage automatique, calcul scientifique |

|

Consommation électrique |

Plus faible grâce à un nombre réduit de cœurs et à des conceptions économes en énergie |

Plus élevé en raison de la densité des cœurs et des exigences en matière de bande passante de la mémoire |

|

Largeur de bande de la mémoire |

Plus bas, généralement optimisé pour la latence |

Plus élevé, optimisé pour le débit (par exemple, GDDR6, mémoire HBM) |

|

Coût |

Relativement abordable et largement disponible |

Plus cher, surtout pour les modèles à haute performance |

|

Applications |

Ordinateurs portables, ordinateurs de bureau, serveurs, appareils mobiles |

Systèmes de jeux, stations de travail, environnements HPC, charges de travail AI |

|

Flexibilité |

Large compatibilité pour diverses tâches |

Optimisé pour des charges de travail spécifiques nécessitant du parallélisme |

Cas d'utilisation de l'unité centrale

Examinons brièvement quelques cas d'utilisation plus spécifiques des processeurs :

- Informatique à usage général : Les CPU sont parfaits pour les tâches quotidiennes, telles que la navigation sur Internet, l'utilisation d'applications de productivité et l'utilisation quotidienne de votre ordinateur. La majeure partie de la charge de travail de votre ordinateur repose sur le processeur.

- Applications monothématiques : Les tâches qui nécessitent un traitement à un seul fil, comme les calculs financiers spécifiques, sont mieux adaptées aux unités centrales. Les traitements de texte, les navigateurs et les applications musicales sont d'autres applications à fil unique.

- Gestion du système d'exploitation : Les unités centrales de traitement traitent les processus essentiels du système, gérant les entrées, les sorties et les tâches d'arrière-plan qui assurent le bon fonctionnement du système.

Cas d'utilisation du GPU

Passons brièvement en revue quelques cas d'utilisation spécifiques aux GPU :

- Traitement graphique et vidéo : Les GPU sont conçus pour produire des graphiques de haute qualité, ce qui les rend indispensables dans les jeux, le montage vidéo et les applications gourmandes en ressources graphiques. Cela est possible grâce à leur capacité de traitement parallèle, comme je l'ai mentionné tout au long de l'article. De nombreux jeux aux graphismes intensifs nécessitent un GPU assez puissant pour pouvoir être joués sans décalage ni problème.

- L'apprentissage automatique et l'IA : Les GPU sont souvent utilisés pour former des modèles d'apprentissage automatique et traiter rapidement de grands ensembles de données, répondant ainsi aux besoins de haute performance des algorithmes d'IA. En raison du volume des calculs, ils sont particulièrement nécessaires pour les projets utilisant des réseaux neuronaux. Étant donné que de nombreux calculs peuvent être effectués en parallèle, les GPU sont un élément essentiel de l'apprentissage automatique complexe.onent.

- Science des données et informatique scientifique : Les GPU peuvent accélérer les calculs à grande échelle et les opérations matricielles dans le domaine de la science des données, ce qui les rend précieux pour les analyses et les simulations à forte intensité de données. Le calcul de choses telles que les tenseurs, l'analyse d'images et les couches convolutionnelles nécessite des calculs massifs. Par exemple, Polars offre un moteur GPU pour l'accélération des requêtes.

L'avenir des CPU et des GPU

La puissance et la complexité des CPU et des GPU ne cessent de croître ! Leur avenir montre une augmentation de la capacité de calcul et une utilisation répandue.

Adaptation des unités centrales à un plus grand nombre de cœurs

Les processeurs augmentent le nombre de cœurs afin de répondre aux exigences modernes en matière de multitâches. Cela permet d'améliorer leur capacité de calcul en série et d'offrir un certain niveau de calcul parallèle grâce au multithreading.

Parmi les tendances en matière de développement de l'unité centrale, on peut citer

- Augmentation du nombre de noyaux : Les processeurs grand public sont souvent dotés de 8 à 16 cœurs, tandis que les processeurs pour serveurs peuvent comporter 64 cœurs ou plus. Cela permet d'améliorer les capacités de calcul parallèle grâce à des technologies telles que le multithreading simultané (SMT) et l'hyperthreading.

- Architectures hétérogènes : Les processeurs modernes, tels que la série Alder Lake d'Intel ou la conception big.LITTLE d'ARM, combinent des cœurs à haute performance avec des cœurs à faible consommation d'énergie afin d'optimiser à la fois la consommation d'énergie et la performance des tâches.

- Intégration avec des unités spécialisées : Les processeurs intègrent de plus en plus d'accélérateurs, tels que des moteurs d'inférence d'IA ou des unités de traitement graphique, directement sur la puce afin d'améliorer les performances dans des charges de travail spécifiques.

Développement de GPU pour l'informatique générale

Les GPU évoluent pour gérer des tâches générales, ce qui les rend de plus en plus polyvalents pour les opérations nécessitant beaucoup de données. Des fabricants comme NVIDIA et AMD investissent dans des écosystèmes logiciels agnostiques (par exemple, CUDA, ROCm) pour étendre l'applicabilité des GPU au-delà du graphisme.

De nombreux logiciels d'apprentissage automatique sont désormais capables d'utiliser les GPU. Des frameworks comme TensorFlow et PyTorchprennent désormaisen charge de manière nativel'accélération GPU, ce qui permet de réduire considérablement les temps de calcul.

Unités de traitement spécialisées

L'avenir du traitement ne se limite pas aux CPU et aux GPU. L'essor des processeurs spécialisés, tels que les TPU (Tensor Processing Units) et les NPU (Neural Processing Units), reflète une demande croissante de matériel spécifique à une tâche :

- Unités de traitement tensoriel (TPU) : Développées par Google, les TPU sont spécialement conçues pour accélérer les calculs des réseaux neuronaux. Contrairement aux GPU, les TPU se concentrent sur les opérations à forte intensité matricielle et sont optimisées pour les tâches d'intelligence artificielle à grande échelle. Si vous avez d'autres questions, lisez l'article de sur TPUs vs. GPUs.

- Unités de traitement neuronal (NPU) : Présents dans les appareils mobiles et l'informatique de pointe, les NPU sont conçus pour gérer des tâches liées à l'IA telles que la reconnaissance d'images, le traitement de la parole et la compréhension du langage naturel, tout en consommant un minimum d'énergie.

- Les progrès en matière de FPGA et d'ASIC : Les réseaux de portes programmables (FPGA) et les circuits intégrés à application spécifique (ASIC) gagnent également du terrain en raison de leur capacité à être personnalisés pour des applications spécifiques, telles que le minage de crypto-monnaies, le traitement des paquets de données sur le réseau et l'analyse en temps réel.

Conclusion

Les CPU et les GPU apportent chacun des atouts uniques à l'informatique : Les CPU excellent dans les tâches générales et précises, tandis que les GPU brillent dans le traitement parallèle et les charges de travail à forte intensité de données. Comprendre ces différences permet aux scientifiques des données, aux joueurs et aux professionnels de faire des choix éclairés en matière de matériel.

Si vous souhaitez découvrir comment les GPU alimentent les modèles d'apprentissage profond, consultez Introduction à l'apprentissage profond avec PyTorch. Pour une compréhension plus large des technologies de l'IA et de leurs applications, le cursus AI Fundamentals offre un aperçu complet. Pour approfondir les mécanismes de l'apprentissage automatique, explorez le cours Comprendre l'apprentissage automatique.

Devenez un scientifique ML

FAQ

Un GPU peut-il remplacer un CPU pour les tâches informatiques quotidiennes ?

Non, les GPU ne remplacent pas les CPU. Si les GPU excellent dans les tâches de traitement parallèle, ils n'ont pas la polyvalence et les performances à un seul fil que les CPU offrent pour les tâches générales.

Quand dois-je utiliser à la fois un processeur et un processeur graphique ?

Une approche hybride peut offrir des performances optimales en tirant parti des atouts des deux types de processeurs pour des tâches telles que le montage vidéo et les réseaux neuronaux.

Pourquoi les GPU sont-ils utilisés dans l'apprentissage automatique et l'IA plutôt que les CPU ?

Les tâches d'apprentissage automatique et d'IA impliquent souvent le traitement de grands ensembles de données et l'exécution simultanée de nombreux calculs. Les GPU, avec leur nombre élevé de cœurs et leurs capacités de traitement parallèle, peuvent effectuer ces tâches beaucoup plus rapidement que les CPU.

Existe-t-il des processeurs spécialisés en dehors des CPU et des GPU pour des tâches spécifiques ?

Oui, des processeurs spécialisés comme les TPU (Tensor Processing Units) sont conçus pour gérer des charges de travail spécifiques comme l'apprentissage automatique. Les TPU combinent des éléments des architectures CPU et GPU afin d'optimiser les performances pour des types particuliers de traitement de données.

Je suis un data scientist avec de l'expérience dans l'analyse spatiale, l'apprentissage automatique et les pipelines de données. J'ai travaillé avec GCP, Hadoop, Hive, Snowflake, Airflow et d'autres processus d'ingénierie et de science des données.