Lernpfad

KI geht über einfache Chatbots hinaus und beginnt, eigenständig zu handeln – in Form von Agenten.

Trotz technologischer Fortschritte erzielen die meisten Unternehmen jedoch keine greifbaren Ergebnisse. Bis zu 95% der KI-Pilotprojekte liefern keinen klaren Business-Mehrwert. Häufig liegt das daran, dass Systeme nicht gut zusammenarbeiten oder nicht richtig angebunden sind.

Hier setzt OpenAI Frontier an – eine Plattform, die genau dieses Problem lösen soll. Sie wurde gemeinsam mit OpenAIs neuestem und leistungsfähigstem Modell GPT-5.3 Codex vorgestellt. Um bei OpenAIs neuesten Modellen auf dem Laufenden zu bleiben, wirf auch einen Blick in unseren Guide zu GPT-5.4.

In diesem Artikel erkläre ich, wie Frontier funktioniert, welche Features es bietet, wie es im Vergleich zum Wettbewerb abschneidet und wie es die Zukunft von Business-Software verändern könnte.

Für einen Einstieg in diesen Wandel empfehle ich unseren Kurs Introduction to AI Agents.

Was ist OpenAI Frontier?

OpenAI Frontier ist eine Business-Plattform, mit der Unternehmen Gruppen von KI-Agenten – oder „KI-Kolleg:innen“, wie OpenAI sie im Einleitungsartikel nennt – erstellen, bereitstellen, verwalten und überwachen können.

Statt als eigenständiger Conversational-Bot zu agieren, ist Frontier eine Schicht, die KI direkt in Unternehmensworkflows integriert.

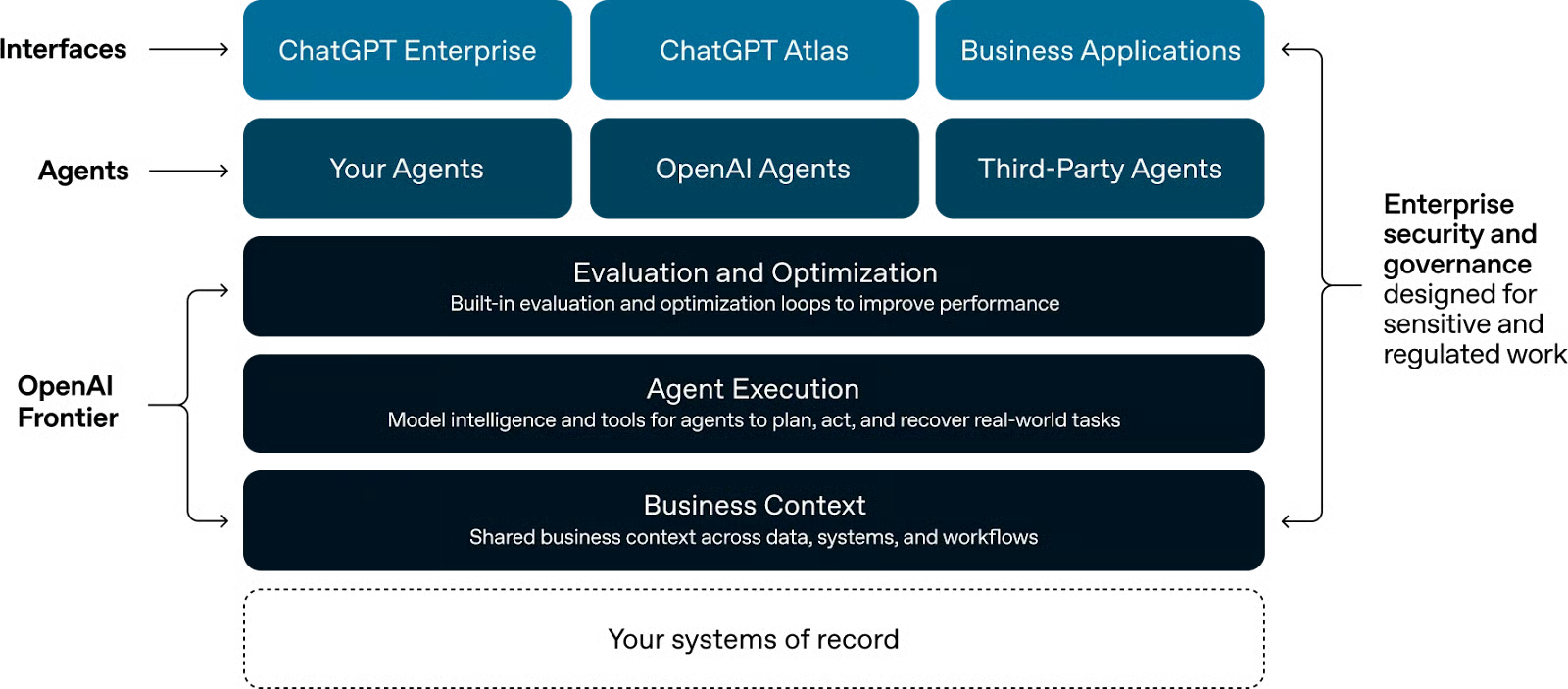

Auf hoher Ebene ist die Architektur der Plattform dafür von Grund auf ausgelegt, wie das folgende Diagramm zeigt:

Schauen wir uns die einzelnen Ebenen an:

- Business Context: Als Basis verknüpft Frontier unterschiedliche Daten, Systeme und Workflows. So entsteht ein einheitliches, präzises Abbild der Unternehmensabläufe.

- Agent Execution: Darauf aufbauend erhalten KI-Agenten die notwendige Denk- und Werkzeugkompetenz. Sie können komplexe Aufgaben planen, echte Aktionen ausführen und eigene Fehler korrigieren.

- Evaluation and Optimization: Diese Ebene fügt integrierte Feedback-Schleifen hinzu. So lernen die Agenten kontinuierlich und verbessern sich im Tagesgeschäft.

- Die Agenten: Unterstützt durch die unteren Ebenen verwaltet dieser Bereich die eigentliche KI-Belegschaft. Er organisiert eine Mischung aus maßgeschneiderten Agenten, offiziellen OpenAI-Agenten und Agenten externer Entwickler:innen.

- Business Applications: Ganz oben stehen die Oberflächen und Programme, mit denen Mitarbeitende täglich mit der KI arbeiten. Dazu gehören Tools wie ChatGPT Enterprise, ChatGPT Atlas und interne Unternehmensanwendungen.

Aufgrund von Tools wie Frontier wird das Bauen von KI-Agenten zu einer grundlegenden Kompetenz. Eine Schritt-für-Schritt-Anleitung findest du in unserem OpenAI AgentKit Tutorial.

Warum ist OpenAI Frontier wichtig?

Tools wie Frontier sind entscheidend, weil sie die unternehmensweite „KI-Chance-Lücke“ direkt adressieren. Zwischen dem, was moderne KI-Modelle leisten können, und dem, was Unternehmen stabil in Produktion bringen, klafft derzeit eine große Lücke.

Viele Firmen haben mit standalone-KI-Tools gekämpft, die nicht über kleine Pilotprojekte hinauswachsen. Wenn du als Führungskraft diese Falle vermeiden willst, lies unseren Guide zum Skalieren von KI in deiner Organisation.

Die eigentliche Herausforderung ist nicht mehr der Zugang zu KI-Modellen, sondern deren sichere Einbettung in zentrale Prozesse. Frontier ändert die Perspektive: KI ist nicht nur ein weiteres Feature, sondern wird zur Kerninfrastruktur, die das gesamte Unternehmen trägt.

Unternehmen, die KI auf diese Weise in ihre Infrastruktur integrieren, bauen einen wachsenden Wettbewerbsvorsprung auf. Je mehr Aufgaben Agenten übernehmen, desto besser lernt und optimiert das System. Mit der Zeit entsteht so ein operativer Vorteil, der sich schwer kopieren lässt.

Statt pro Nutzer:in abzurechnen, orientiert sich dieses Modell an greifbaren Ergebnissen. Unternehmen zahlen für die Arbeit, die autonome KI-Agenten tatsächlich erledigen – nicht nur für den Softwarezugang. Das könnte die Monetarisierung von Software und den Einsatz digitaler Arbeitskräfte grundlegend verändern.

Zentrale Features von OpenAI Frontier

OpenAI Frontier ist um Kernfähigkeiten herum aufgebaut, die KI-Agenten wie Mitarbeitende behandeln. Die Plattform umfasst:

- Strukturiertes Onboarding

- Zugriffs- und Rechteverwaltung

- Leistungsbeurteilungen

Gemeinsamer Unternehmenskontext

Frontier verbindet verschiedene Unternehmenssysteme zu einer gemeinsamen Schicht, zum Beispiel:

- Datenhaltung

- CRM

- Support-Tools

- Interne Apps

So erhalten KI-Kolleg:innen ein konsistentes Verständnis für Prozesse, Begriffe und Ziele – eine zuverlässige Teamgedächtnis-Schicht.

Planen, handeln, Probleme lösen

Agenten in OpenAI Frontier beantworten nicht nur Fragen. Sie analysieren autonom Dateien, führen Code aus und bedienen Unternehmenssoftware. Dadurch können sie handeln und komplexe, mehrstufige Projekte über verschiedene Abteilungen hinweg zuverlässig abschließen.

Um die technische Grundlage dahinter zu verstehen und praktisch zu üben, empfehle ich unseren Kurs Developing AI Systems with the OpenAI API.

Kontinuierliches Lernen und Feedback

Wie bei menschlichen Teams steigt die Qualität eines Agenten über integrierte Evaluations-Tools. Manager können Aktionen prüfen, direktes Feedback geben und Verhalten optimieren, sodass das System mit jeder erledigten Aufgabe genauer und hilfreicher wird.

Eindeutige Identitäten, Berechtigungen und Leitplanken

Agenten skalieren, ohne die Kontrolle zu verlieren, ist eine Kernaufgabe beim Wechsel zu agentischer KI. Deshalb wird Sicherheit strikt durchgesetzt.

Jeder Agent erhält eine eindeutige Identität mit klaren Grenzen, was er darf und was nicht. So greifen Agenten nur auf die für ihre Aufgabe nötigen Daten zu – bei lückenloser Protokollierung für Audits und Compliance.

Nahtlose Einbindung ins Ökosystem via offene Standards

Mit Frontier musst du bestehende Systeme nicht neu aufbauen. Offene Anschlussstandards sorgen dafür, dass die Plattform direkt an die vorhandenen Anwendungen und Cloud-Services andockt. Das beschleunigt die Einführung und senkt das technische Risiko.

Expertenunterstützung durch Forward-Deployed Engineers (FDEs)

Die Implementierung in großem Maßstab erfordert tiefes Know-how. OpenAI stellt dedizierte Engineers zur Seite, die direkt mit deinem Team arbeiten. Sie entwerfen die Architektur, definieren Sicherheitsregeln und sorgen für einen stabilen, zuverlässigen Betrieb im Alltag.

So bekommst du Zugang zu OpenAI Frontier

Aktuell ist OpenAI Frontier nur für eine begrenzte Zahl früher Enterprise-Anwender verfügbar, darunter HP, Oracle und Uber. Eine breitere Verfügbarkeit folgt in den nächsten Monaten.

Der Zugang erfolgt über den Enterprise-Vertrieb von OpenAI; es gibt keine öffentliche Preisliste oder Self-Service-Anmeldung. Einführungen sind stark maßgeschneidert und laufen oft über die „Frontier Alliance“ mit großen Beratungshäusern wie McKinsey, BCG, Accenture und Capgemini.

OpenAI Frontier im Vergleich

Der Markt für Künstliche Intelligenz ist voll von Enterprise-Plattformen zur Arbeitsautomatisierung. Für einen breiteren Überblick lies unseren Vergleich der besten KI-Agenten 2026.

So schneidet Frontier im Vergleich zu anderen großen Tools ab – und wo die jeweiligen Stärken liegen.

OpenAI Frontier vs Claude Cowork

Claude Cowork punktet mit No-Code-Automatisierungen und tiefen Integrationen in Alltags-Apps wie Slack, Figma und Asana. Zudem setzt es auf Constitutional AI, um sichere, zuverlässige Abläufe zu gewährleisten.

Allerdings fehlen Claude Cowork einige Schlüsselfunktionen, die Frontier bietet. Es kann keine Agenten unterschiedlicher Anbieter orchestrieren und verfügt über keine gemeinsame semantische Business-Kontextschicht, um isolierte Daten zu verbinden.

Damit eignet sich Claude Cowork hervorragend für Experimente in kleinen Teams, während Frontier für Enterprise-weite Koordination über getrennte Systeme hinweg konzipiert ist.

Wenn du mehr über Anthropic’s Agentenplattform erfahren willst, findest du alles Nötige in unserem Claude Cowork Tutorial.

OpenAI Frontier vs Google Vertex AI

Google Vertex AI überzeugt mit cloud-nativem, multimodalem Skalieren. Dadurch ist die Google-Plattform extrem stark für datenintensive, Echtzeit-Deployments.

Im Vergleich zu Frontier fehlen Vertex AI ein integriertes Agenten-Onboarding und identitätsbasierte Berechtigungen, die speziell auf autonome KI-Arbeitskräfte zugeschnitten sind. Vertex AI ist die bessere Wahl für schwere Datenverarbeitung und Infrastrukturskalierung, während Frontier speziell für Multi-Agenten-Orchestrierung und Aufgabenmanagement entwickelt wurde.

OpenAI Frontier vs Microsoft Copilot Studio

Microsoft Copilot Studio bietet eine Low-Code-Umgebung zum Erstellen von KI-Agenten mit strenger Governance. Der größte Vorteil ist die nahtlose Integration in das Microsoft-Ökosystem – ideal für hybride Setups mit Cloud und On-Premises. Ein Praxisbeispiel findest du in unserem Guide zum Copilot App Builder.

Wie Claude Cowork kann Copilot Studio keine Agenten mehrerer Anbieter steuern und verfügt nicht über eine gemeinsame semantische Business-Kontextschicht. Copilot Studio ist optimal für Unternehmen mit starkem Microsoft-Fokus, während Frontier eine komplett modellagnostische Steuerung für eine diverse Agentenflotte bietet.

|

Plattform |

Kernstärken & Features |

Was im Vergleich zu Frontier fehlt |

Am besten geeignet für |

|

OpenAI Frontier |

Orchestrierung von Agenten mehrerer Anbieter, gemeinsame semantische Business-Kontextschicht, integriertes Agenten-Onboarding, identitätsbasierte Berechtigungen, modellagnostisch. |

N/A (Baseline) |

Enterprise-weite Koordination und Management einer diversen KI-Arbeitsflotte über getrennte Systeme. |

|

Claude Cowork |

No-Code-Automatisierung, tiefe App-Integrationen (Slack, Figma, Asana), Sicherheit via Constitutional AI. |

Keine Orchestrierung von Anbietern übergreifenden Agenten; keine gemeinsame semantische Business-Kontextschicht. |

Experimente in kleinen Teams und sichere, zuverlässige Alltagsabläufe. |

|

Google Vertex AI |

Cloud-natives, multimodales Skalieren; starke Fähigkeiten für schwere Datenverarbeitung. |

Integriertes Agenten-Onboarding; identitätsbasierte Berechtigungen für autonome KI-Arbeitskräfte. |

Datenintensive Echtzeit-Deployments und Infrastrukturskalierung. |

|

Microsoft Copilot Studio |

Low-Code-Umgebung, strenge Governance, nahtlose Microsoft-Integration. |

Keine Orchestrierung von Anbietern übergreifenden Agenten; keine gemeinsame semantische Business-Kontextschicht. |

Hybride Setups (Cloud/On-Premises) und Unternehmen mit starkem Microsoft-Fokus. |

Anwendungsfälle für OpenAI Frontier

Frontier liefert bereits messbare Ergebnisse in operativ komplexen Branchen:

- Finanzen & Versicherungen: Unternehmen wie State Farm und Intuit automatisieren mit Frontier die Schadenbearbeitung und das Finanzworkflow-Management. Agenten erfassen Eingaben, prüfen Dokumente und gleichen Konten ab.

- Sales & Revenue Operations: Globale Investmentfirmen setzen Agenten durchgängig entlang der Vertriebspipeline ein – für Datenerfassung und Forecasting. So bleibt bis zu 90% mehr Zeit für Kundengespräche.

- IT & Technologie: Unternehmen wie HP nutzen Frontier für IT-Management, z. B. Ticket-Triage und Softwarebereitstellung. In Hardwaretests sank die Zeit für Root-Cause-Analysen von vier Stunden auf wenige Minuten.

- Energie & Fertigung: Energieerzeuger steigern mit agentischen Workflows die Produktion um bis zu 5% (Umsatzeffekte in Milliardenhöhe), während Hersteller die Zeit für Produktionsoptimierung von 6 Wochen auf 1 Tag reduzieren.

So holst du das Maximum aus OpenAI Frontier

Um eine Plattform wie OpenAI Frontier optimal zu nutzen, braucht es zwei Dinge:

- Saubere, vernetzte Daten: Frontier ist auf gut organisierte, unternehmensweite Daten angewiesen, um Kontext zu verstehen und Entscheidungen zu treffen. Ohne das können Agenten nicht performant arbeiten.

- Eine KI-bereite Belegschaft: Mitarbeitende wechseln von Routineaufgaben zur Steuerung und Zusammenarbeit mit Agenten. Dafür müssen sie lernen, KI anzuleiten, Performance zu überwachen und auf Basis der Ergebnisse zu entscheiden.

Ersteres ist längst Voraussetzung für klassische Informationssysteme, doch der zweite Punkt ist entscheidend. In unserem Report The State of Data + AI Literacy 2026 sagen 72% der befragten Enterprise-Führungskräfte, dass KI-Kompetenz für die tägliche Arbeit wichtig ist.

Dennoch berichten 59% von einer deutlichen KI-Kompetenzlücke, die die Einführung bremst. Dagegen hilft unternehmensweite KI-Kompetenzschulung: Organisationen mit einem ausgereiften KI-Literacy-Programm erzielen fast doppelt so häufig einen signifikanten ROI aus KI-Investitionen.

Angebote wie DataCamp for Business helfen Teams, diese Kompetenzen aufzubauen – von Datenmanagement bis KI-Controlling. Mit starken Datenpraktiken und geschulten Teams holen Unternehmen maximalen Nutzen aus autonomen KI-Systemen und machen aus Piloten echten Business-Impact.

Egal ob Startup oder Konzern: DataCamp for Business liefert die Tools für Upskilling und Reskilling und fördert eine datengetriebene Kultur, damit du im Markt die Nase vorn behältst. Fordere heute eine Demo an, um mehr zu erfahren.

Fazit

OpenAI Frontier markiert einen klaren Wandel der Arbeitswelt: von isolierten Produktivitätstools hin zu einer voll gemanagten digitalen Belegschaft.

Mit ergebnisbasierter Rechenleistung stellt Frontier traditionelle SaaS-Preismodelle pro Sitzplatz infrage und zwingt Unternehmen, die Ausführung von Business-Logik neu zu denken.

Wenn KI-Agenten zur neuen Einheit der enterprise-Arbeit werden, erzielen Unternehmen mit Orchestrierungsplattformen wie Frontier einen kumulativen Vorsprung bei Geschwindigkeit, Kosten und Skalierung.

Weiterführende Ressourcen

- Bereit für deine digitale Belegschaft? Schau dir die Lernpfade Associate AI Engineer for Developers und Associate AI Engineer for Data Scientists an.

- Lerne plattformübergreifende Tools zu bauen mit den Kursen Working with the OpenAI API und Multi-Modal Systems with the OpenAI API.

- Lies, wie sich Coding-Modelle entwickeln: GPT-5.3 Codex: From Coding Assistant to General Work Agent.

OpenAI Frontier: FAQs

Kann OpenAI Frontier mit der bestehenden Unternehmenssoftware verbunden werden?

Ja. Das System basiert auf offenen Anschlussstandards. Es lässt sich direkt an bestehende Anwendungen, Datenspeicher und Cloud-Services anbinden, ohne dass die bestehende IT-Architektur neu aufgebaut werden muss.

Wer kann OpenAI Frontier heute nutzen?

Derzeit ist der Zugang auf eine Auswahl früher Enterprise-Anwender beschränkt. Es gibt keine öffentliche Anmeldeseite. Implementierungen erfolgen direkt über das Enterprise-Salesteam und strategische Beratungspartner.

Wie schützt OpenAI Frontier Unternehmensdaten?

Die Sicherheit wird über strenge Identitäts- und Zugriffskontrollen gewährleistet. Jeder KI-Agent erhält eine eindeutige Identität mit klaren Grenzen für Datenzugriff und Handlungen. Sämtliche Aktivitäten werden umfassend protokolliert und sind leicht zu prüfen.

Wie funktioniert das Preismodell von OpenAI Frontier?

Die Plattform verabschiedet sich von klassischen Nutzerlizenzmodellen. Stattdessen gibt es ergebnisbasierte Preise: Unternehmen zahlen für die tatsächlich erledigte Arbeit und die abgeschlossenen Tasks der autonomen Agenten.

Worin unterscheidet sich OpenAI Frontier von ähnlichen Tools?

Der Hauptunterschied: OpenAI Frontier fungiert als zentrale Basisschicht, die isolierte Unternehmenssysteme verbindet. Es kann eine heterogene Flotte von KI-Kolleg:innen als integrierte digitale Belegschaft orchestrieren und steuern – statt als isolierte Anwendung zu laufen.