Cursus

L'IA dépasse le simple stade des chatbots et commence à agir de manière autonome sous la forme d'agents.

Cependant, même si la technologie progresse, la plupart des entreprises ne voient pas d'impact concret. Jusqu'à 95 % des projets pilotes en IA n'apportent aucune valeur métier claire. En cause : des systèmes qui s'intègrent mal entre eux ou qui ne sont pas correctement connectés.

C'est là qu'intervient OpenAI Frontier, une plateforme conçue pour répondre à ce problème. Elle a été présentée en même temps que le modèle le plus récent et le plus performant d'OpenAI, GPT-5.3 Codex. Pour suivre les dernières versions d'OpenAI, consultez également notre guide sur GPT-5.4.

Dans cet article, j'explique son fonctionnement, ses fonctionnalités, ses avantages face aux concurrents, et son potentiel pour transformer les logiciels d'entreprise.

Pour comprendre les bases de cette évolution, nous vous recommandons notre cours Introduction to AI Agents.

Qu'est-ce qu'OpenAI Frontier ?

OpenAI Frontier est une plateforme destinée aux entreprises pour créer, déployer, gérer et superviser des groupes d'agents d'IA ou « coéquipiers IA », comme OpenAI les appelle dans son article de présentation.

Au lieu de fonctionner comme un simple bot conversationnel autonome, Frontier agit comme une couche qui intègre l'IA directement dans les workflows de l'entreprise.

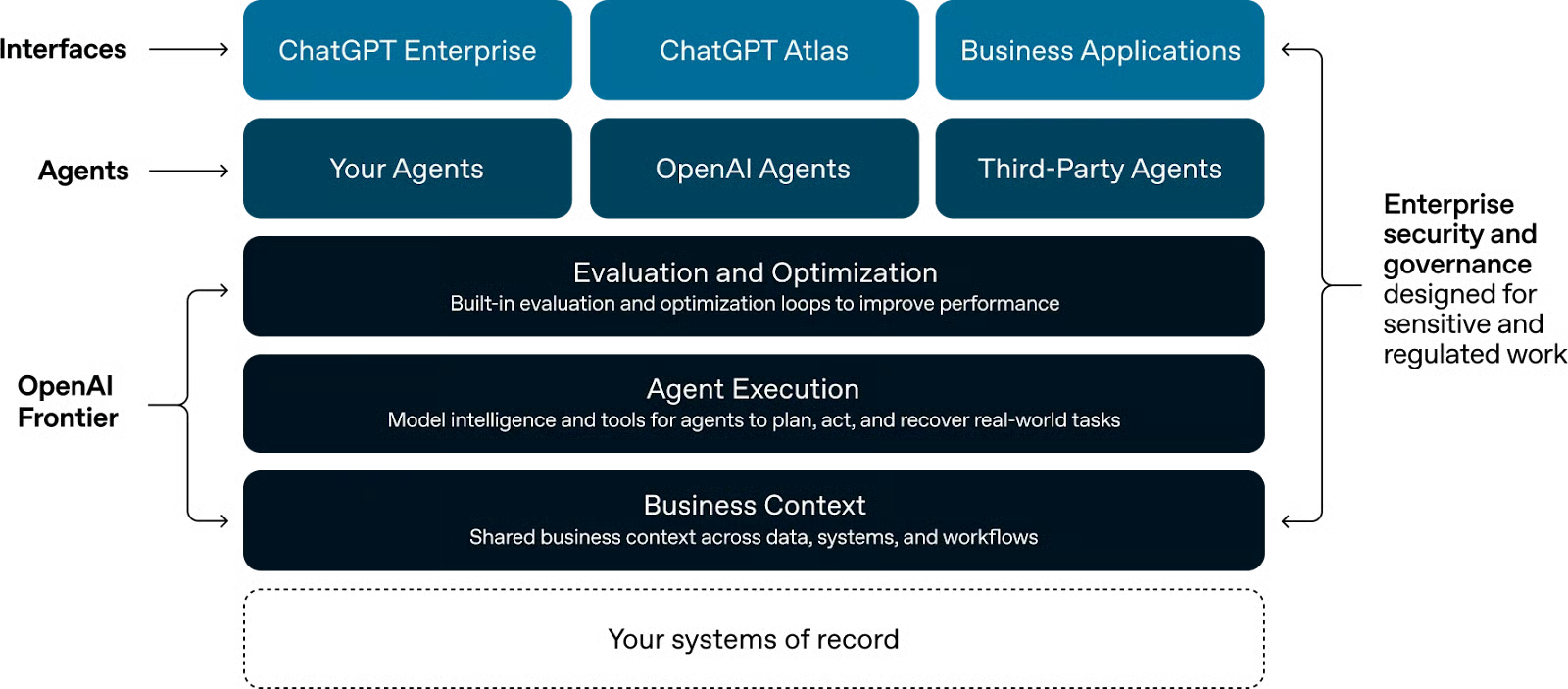

À haut niveau, l'architecture de la plateforme est conçue de bout en bout pour cela, comme l'illustre le schéma ci-dessous :

Voyons les différentes couches :

- Contexte métier : à la base, Frontier relie entre eux données, systèmes et workflows. On obtient ainsi une vue unifiée et fiable du fonctionnement de l'entreprise.

- Exécution des agents : sur cette fondation, cette couche fournit aux agents d'IA l'intelligence et les outils nécessaires. Elle leur permet de planifier des tâches complexes, d'agir réellement et de corriger leurs erreurs en cas d'écart.

- Évaluation et optimisation : la couche suivante ajoute des boucles de feedback intégrées. Elle garantit que les agents d'IA apprennent en continu et gagnent en efficacité avec le temps.

- Les agents : s'appuyant sur les couches inférieures, cette section gère la main-d'œuvre d'IA. Elle orchestre un ensemble d'agents sur mesure, d'agents officiels d'OpenAI et d'agents développés par des tiers.

- Applications métier : au sommet se trouvent les interfaces et programmes utilisés par les collaborateurs pour travailler avec l'IA : ChatGPT Enterprise, ChatGPT Atlas et les applications internes, entre autres.

Avec des outils comme Frontier, savoir construire des agents d'IA devient une compétence essentielle. Pour apprendre pas à pas, consultez notre tutoriel OpenAI AgentKit.

Pourquoi OpenAI Frontier est-il important ?

Des outils comme Frontier sont clés car ils s'attaquent directement au « fossé d'opportunités IA » dans l'entreprise. Aujourd'hui, il existe un décalage massif entre ce que les modèles d'IA avancés permettent et ce que les entreprises parviennent réellement à déployer en production.

Beaucoup d'organisations peinent avec des outils d'IA isolés qui ne dépassent jamais le stade du POC. Si vous souhaitez éviter cet écueil, nous vous recommandons de lire notre guide sur la mise à l'échelle de l'IA dans votre organisation.

Le véritable enjeu n'est plus d'accéder aux modèles d'IA, mais de les intégrer en toute sécurité au cœur des processus métier. Frontier change la donne en traitant l'IA non pas comme une simple fonctionnalité logicielle, mais comme une infrastructure centrale au service de toute l'entreprise.

Les entreprises qui intègrent l'IA à leur infrastructure de cette manière créent un avantage cumulatif. À mesure que les agents accomplissent davantage de tâches, le système apprend et s'optimise en continu. Avec le temps, cela génère un avantage opérationnel difficile à reproduire pour la concurrence.

Plutôt que de facturer par utilisateur, ce modèle s'appuie sur les résultats effectivement livrés par l'IA. Les entreprises paient pour le travail réalisé par des agents autonomes, et non pour un simple droit d'accès. De quoi bouleverser les modèles économiques du logiciel et la façon dont les « travailleurs numériques » sont utilisés.

Fonctionnalités clés d'OpenAI Frontier

OpenAI Frontier s'articule autour de capacités qui traitent les agents d'IA comme des collaborateurs. La plateforme propose :

- Un onboarding structuré

- Des contrôles d'accès aux systèmes

- Des revues de performance

Contexte métier partagé

Frontier connecte les systèmes de l'entreprise au sein d'une couche commune :

- Stockage de données

- CRM

- Outils de support

- Applications internes

Les coéquipiers IA partagent ainsi une compréhension homogène des processus, de la terminologie et des objectifs de l'entreprise, constituant une mémoire fiable pour toute l'équipe.

Planifier, agir et résoudre des problèmes

Les agents d'OpenAI Frontier ne se contentent pas de répondre aux questions. Ils peuvent analyser des fichiers de manière autonome, exécuter du code et piloter les logiciels de l'entreprise. Ils sont ainsi capables d'agir et de mener à bien des projets complexes en plusieurs étapes, impliquant différents départements.

Pour comprendre les bases techniques derrière ces capacités et vous exercer, nous vous recommandons le cours Developing AI Systems with the OpenAI API.

Apprentissage continu et feedback de performance

Comme pour des collaborateurs humains, la qualité d'un agent s'améliore avec le temps grâce à des outils d'évaluation intégrés. La plateforme permet aux managers de revoir les actions des agents, de donner un feedback direct et d'optimiser les comportements, pour un système toujours plus précis et utile à chaque tâche accomplie.

Identification, permissions et garde-fous clairs

Faire passer les agents à l'échelle sans perdre le contrôle est un défi central de l'IA agentique. C'est pourquoi la sécurité est strictement appliquée.

Chaque agent se voit attribuer une identité unique avec des limites précises sur ce qu'il peut ou non faire. Les agents n'accèdent qu'aux données nécessaires à leurs missions, avec une traçabilité complète de leurs actions pour faciliter audit et conformité.

Intégration fluide à l'écosystème via des standards ouverts

Avec Frontier, nul besoin de reconstruire le système d'information existant. La plateforme adopte des standards d'interconnexion ouverts pour se brancher directement sur vos applications et services cloud actuels. Résultat : un déploiement accéléré et un risque technique réduit.

Accompagnement d'experts (FDE)

Déployer ces systèmes à grande échelle nécessite une expertise pointue. OpenAI associe chaque entreprise à des ingénieurs dédiés, intégrés aux équipes. Ils contribuent à la conception de l'architecture, à la définition des règles de sécurité et veillent à la fiabilité opérationnelle des agents au quotidien.

Comment accéder à OpenAI Frontier

À ce jour, OpenAI Frontier est proposé à un nombre restreint d'entreprises pionnières, dont HP, Oracle et Uber, avant une ouverture plus large dans les prochains mois.

L'accès nécessite un contact direct avec l'équipe commerciale d'OpenAI : il n'existe ni tarification publique ni inscription en libre-service. Les déploiements sont très personnalisés et souvent facilités via le « Frontier Alliance », un programme de partenariats stratégiques avec des cabinets de conseil tels que McKinsey, BCG, Accenture et Capgemini.

OpenAI Frontier face aux concurrents

Le marché de l'intelligence artificielle regorge de plateformes d'entreprise dédiées à l'automatisation du travail. Pour une vue d'ensemble, consultez notre comparatif des meilleurs agents d'IA en 2026.

Voici comment Frontier se positionne face aux autres grands outils du moment et dans quels cas chacun excelle.

OpenAI Frontier vs Claude Cowork

Claude Cowork se distingue par une automatisation sans code et de profondes intégrations avec les outils du quotidien comme Slack, Figma et Asana. Il s'appuie aussi sur la constitutional AI pour garantir des workflows sûrs et fiables.

Cependant, Claude Cowork n'intègre pas certaines fonctionnalités clés de Frontier. Il ne peut pas orchestrer des agents de plusieurs fournisseurs et ne propose pas de couche sémantique partagée pour relier des données d'entreprise isolées.

Claude Cowork est donc excellent pour l'expérimentation en petite équipe, tandis que Frontier est conçu pour une coordination de niveau entreprise entre des systèmes complètement distincts.

Si vous souhaitez en savoir plus sur la plateforme d'agents d'Anthropic, notre tutoriel Claude Cowork couvre tout ce qu'il faut pour démarrer.

OpenAI Frontier vs Google Vertex AI

Google Vertex AI se démarque par son approche cloud native et sa montée en charge multimodale. La plateforme Google est ainsi redoutable pour les déploiements temps réel à forte intensité de données.

Comparé à Frontier, Vertex AI n'intègre pas nativement l'onboarding des agents ni des permissions par identité spécifiquement adaptées aux travailleurs IA autonomes. Vertex AI est le meilleur choix pour le traitement massif de données et la scalabilité d'infrastructure, tandis que Frontier est pensé pour l'orchestration multi-agents et la gestion des tâches.

OpenAI Frontier vs Microsoft Copilot Studio

Microsoft Copilot Studio offre un environnement low-code pour créer des agents d'IA avec une gouvernance stricte. Son atout majeur : une intégration transparente à l'écosystème Microsoft, idéale pour des environnements hybrides cloud/on-premise. Découvrez-le en action dans notre guide Copilot App Builder.

Comme Claude Cowork, Copilot Studio ne peut pas gérer des agents multi-fournisseurs et ne propose pas de couche sémantique métier partagée. Copilot Studio convient aux entreprises très investies dans l'écosystème Microsoft, tandis que Frontier offre une gestion véritablement agnostique des modèles pour piloter un ensemble hétérogène d'agents d'IA.

|

Plateforme |

Forces et fonctionnalités clés |

Manques par rapport à Frontier |

Idéal pour |

|

OpenAI Frontier |

Orchestration multi-fournisseurs, couche sémantique métier partagée, onboarding intégré des agents, permissions basées sur l'identité, agnostique aux modèles. |

N/A (référence) |

Coordination de niveau entreprise et gestion d'un parc hétérogène d'agents d'IA sur des systèmes distincts. |

|

Claude Cowork |

Automatisation sans code, intégrations profondes (Slack, Figma, Asana), sécurité via Constitutional AI. |

Pas d'orchestration multi-fournisseurs ; pas de couche sémantique métier partagée. |

Expérimentation en petite équipe et workflows quotidiens sûrs et fiables. |

|

Google Vertex AI |

Montée en charge multimodale cloud native, puissantes capacités de traitement massif de données. |

Onboarding intégré des agents ; permissions par identité adaptées aux travailleurs IA autonomes. |

Déploiements temps réel intensifs en données et montée en charge d'infrastructure. |

|

Microsoft Copilot Studio |

Environnement low-code, gouvernance stricte, intégration fluide à l'écosystème Microsoft. |

Pas d'orchestration multi-fournisseurs ; pas de couche sémantique métier partagée. |

Environnements hybrides (cloud/on-premise) et entreprises fortement engagées dans Microsoft. |

Cas d'usage d'OpenAI Frontier

Frontier génère déjà des résultats mesurables dans des secteurs à forte complexité opérationnelle :

- Finance & assurance : des entreprises comme State Farm et Intuit automatisent le traitement des sinistres et la gestion des workflows financiers : ingestion des dossiers, validation des pièces et rapprochements comptables.

- Ventes & opérations revenus : des acteurs mondiaux déploient des agents sur l'ensemble du pipeline commercial pour la saisie de données et la prévision, libérant jusqu'à 90 % de temps en plus pour les interactions client.

- IT & technologies : des groupes comme HP utilisent Frontier pour la gestion IT, en automatisant le tri des tickets et le provisioning logiciel. En test matériel, les agents ont réduit l'identification des causes racines de quatre heures à quelques minutes.

- Énergie & industrie : des énergéticiens utilisent des workflows agentiques pour augmenter la production jusqu'à 5 % (à l'impact chiffré en milliards), tandis que des industriels ont ramené l'optimisation de production de 6 semaines à 1 journée.

Comment tirer le meilleur parti d'OpenAI Frontier

Pour exploiter pleinement une plateforme comme OpenAI Frontier, les entreprises ont besoin de deux leviers :

- Des données propres et connectées : Frontier s'appuie sur des données bien organisées à l'échelle de l'entreprise pour comprendre le contexte et décider. Sans cela, les agents d'IA ne peuvent pas être performants.

- Des équipes prêtes pour l'IA : dans le même temps, les collaborateurs doivent passer de tâches numériques répétitives à la supervision et la collaboration avec des agents d'IA. Il s'agit d'apprendre à guider l'IA, suivre ses performances et décider à partir de ses résultats.

Si le premier point est déjà indispensable pour tout SI, le second est crucial. Dans notre rapport The State of Data + AI Literacy 2026, 72 % des dirigeants interrogés estiment que la culture de l'IA est importante au quotidien dans leur organisation.

Pourtant, 59 % déclarent un déficit de compétences qui freine l'adoption. Pour combler cet écart, une formation à la culture de l'IA à l'échelle de l'organisation est efficace : les entreprises dotées d'un programme mature ont presque deux fois plus de chances de constater un ROI significatif de leurs investissements IA.

Des ressources comme DataCamp for Business proposent des cours pour développer ces compétences, de la gestion des données à la supervision de l'IA. En combinant bonnes pratiques data et équipes formées, les organisations maximisent la valeur des systèmes d'IA autonomes et transforment les pilotes en résultats concrets.

Que vous soyez une startup ou un grand groupe, DataCamp for Business vous aide à monter en compétences et à instaurer une culture data qui vous permet de rester compétitif sur votre marché. Vous pouvez demander une démo dès aujourd'hui pour en savoir plus.

Conclusion

OpenAI Frontier marque un tournant décisif pour le futur du travail : l'IA passe d'outils de productivité isolés à une main-d'œuvre numérique entièrement managée.

Avec l'« outcome-based computing », la plateforme remet en question la tarification SaaS par siège et pousse les organisations à repenser l'exécution de leur logique métier.

À mesure que les agents d'IA deviennent la nouvelle unité de travail dans l'entreprise, celles qui maîtrisent des plateformes d'orchestration comme Frontier bénéficieront d'avantages cumulatifs en rapidité opérationnelle, en réduction des coûts et en scalabilité massive.

Pour aller plus loin

- Prêt à bâtir une main-d'œuvre numérique ? Découvrez les parcours Associate AI Engineer for Developers et Associate AI Engineer for Data Scientists.

- Apprenez à créer des outils cross-plateformes avec les cours Working with the OpenAI API et Multi-Modal Systems with the OpenAI API.

- Lisez notre analyse de l'évolution des modèles de code dans GPT-5.3 Codex : from Coding Assistant to General Work Agent.

FAQ sur OpenAI Frontier

OpenAI Frontier peut-il se connecter au logiciel existant de l'entreprise ?

Oui. Le système repose sur des standards d'interconnexion ouverts. Il est conçu pour se brancher directement sur les applications, stockages de données et services cloud existants, sans exiger de reconstruire l'architecture technique en place.

Qui peut accéder à OpenAI Frontier aujourd'hui ?

Actuellement, l'accès est limité à un groupe restreint d'entreprises pilotes. Il n'existe pas de page d'inscription publique. Les déploiements sont gérés directement par l'équipe commerciale entreprise et des partenaires de conseil stratégiques.

Comment OpenAI Frontier sécurise-t-il les données de l'entreprise ?

La sécurité est assurée par des contrôles stricts d'identité et d'accès. Chaque agent d'IA dispose d'une identité unique avec des limites précises sur les informations consultables et les actions possibles. Toutes les activités sont largement journalisées pour simplifier les audits.

Comment fonctionne le modèle de tarification d'OpenAI Frontier ?

La plateforme s'éloigne des licences logicielles traditionnelles facturées par utilisateur. Elle adopte une tarification basée sur les résultats, où l'entreprise paie pour le travail et les tâches réellement effectués par les agents autonomes.

Quelle est la principale différence entre OpenAI Frontier et des outils similaires ?

La principale différence est qu'OpenAI Frontier agit comme une couche fondatrice centralisée qui connecte des systèmes d'entreprise isolés. Il peut orchestrer et gouverner un ensemble diversifié d'agents coéquipiers d'IA comme une main-d'œuvre numérique intégrée, plutôt que de fonctionner comme une application autonome.