Programa

Historicamente, muitos modelos de machine learning foram projetados para aprendizado específico de tarefas, exigindo grandes conjuntos de dados para cada nova tarefa. Dadas as limitações técnicas da época, a abordagem mais eficaz era treinar modelos de machine learning com um enorme conjunto de dados específicos de tarefas. Como resultado, os modelos de última geração foram extremamente eficazes na previsão do resultado do problema para o qual foram treinados. No entanto, esses modelos ainda estavam muito distantes dos seres humanos e de nossa surpreendente capacidade de aprender novas tarefas com base em nossa experiência anterior.

Adicionar estratégias de aprendizagem adaptativa aos modelos de aprendizado de máquina é a missão central da metaaprendizagem, um subcampo do aprendizado de máquina que se concentra em melhorar a forma como os modelos aprendem novas tarefas com eficiência. A meta-aprendizagem se concentra em ensinar os modelos a se adaptarem rapidamente com retreinamento e intervenção humana limitados, além de melhorar o desempenho ao longo do tempo.

Neste artigo, apresentaremos uma introdução à metaaprendizagem e como ela está revolucionando o machine learning. Abordaremos os aspectos técnicos dos modelos de meta-aprendizagem, as abordagens e os aplicativos mais comuns, bem como os benefícios e os desafios. Depois disso, recomendo que você experimente o nosso programa de habilidades AI Fundamentals para realmente se tornar hábil em falar sobre os diferentes conceitos relacionados à IA.

O que é meta-aprendizagem?

A pesquisa sobre meta-aprendizagem remonta à década de 1980, mas o campo ganhou relevância na década de 2010, com o surgimento das redes neurais e, mais recentemente, com o desenvolvimento da IA generativa. A meta-aprendizagem, como subcampo do machine learning, concentra-se em ensinar aos modelos como aprender novas tarefas de forma rápida e eficiente. Ele é inspirado na capacidade dos seres humanos de "aprender a aprender", por assim dizer.

Imagine que você queira aprender a resolver problemas de matemática rapidamente. Uma abordagem tradicional seria memorizar as soluções para muitos problemas diferentes, de modo que, quando você vir um problema familiar, possa se lembrar da resposta imediatamente. No entanto, essa abordagem tem dificuldades quando você encontra um problema totalmente novo.

Em vez disso, e se você se concentrasse em aprender estratégias para resolver problemas em geral, em vez de memorizar soluções específicas? Você pode estudar técnicas de solução de problemas, identificar padrões e desenvolver uma intuição para enfrentar novos desafios. Dessa forma, ao se deparar com um novo problema, você pode se adaptar rapidamente e aplicar o método certo, mesmo que nunca tenha visto esse problema exato antes.

Essa é a essência da meta-aprendizagem. O machine learning tradicional memoriza padrões de grandes conjuntos de dados para uma única tarefa, enquanto o meta-aprendizado treina modelos para se adaptarem rapidamente a novas tarefas, aprendendo a aprender de forma eficaz.

Como funciona o Meta Learning

Você pode pensar em modelos de meta-aprendizagem como um sistema que inclui um subsistema de aprendizagem que é adaptado dinamicamente pela exploração da experiência de episódios de aprendizagem anteriores ou de diferentes tarefas.

Em contraste com os modelos tradicionais de machine learning que consideram apenas uma única tarefa com um conjunto de dados grande e fixo, os metamodelos são expostos a uma variedade de tarefas para extrair padrões generalizáveis. Normalmente, cada problema está associado a um conjunto de dados de treinamento menor e específico da tarefa.

O objetivo do processo de meta-treinamento é extrair informações gerais sobre o processo de aprendizagem em tarefas individuais para melhorar a capacidade do modelo de lidar com novas tarefas com pouco retreinamento.

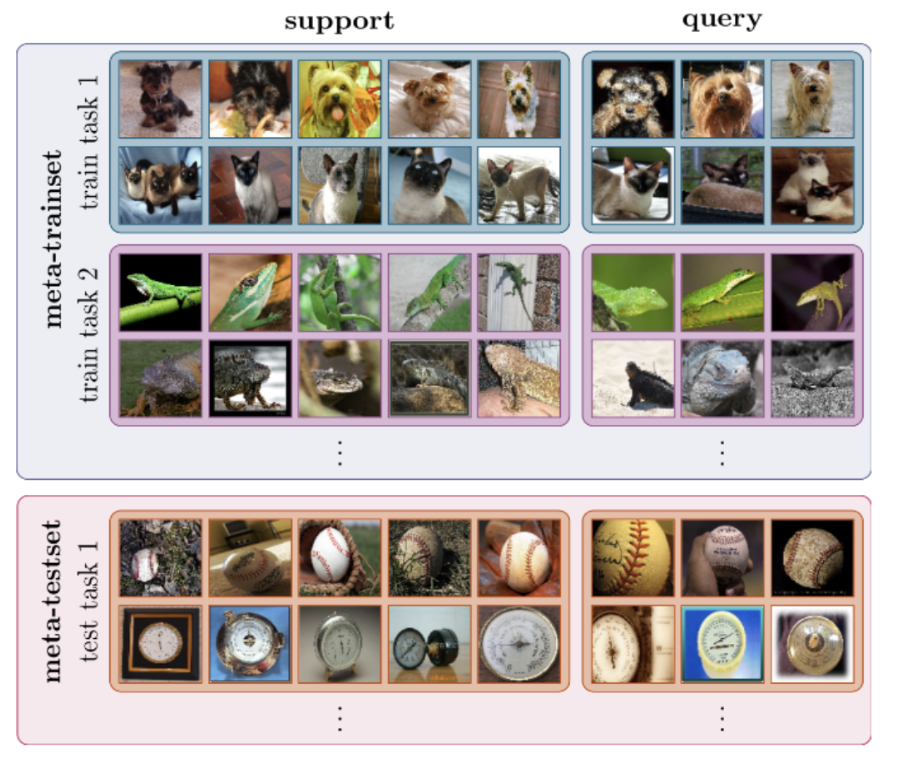

O desenvolvimento de modelos de meta-aprendizagem segue um processo de duas etapas que repete o processo de treinamento do machine learning tradicional:

- Meta-treinamento. Nessa fase, o modelo é treinado em várias tarefas, sendo que cada tarefa consiste em uma amostra de dados de treinamento (juntos, eles formam o conjunto de dados de meta-treinamento) e, em muitos casos, metadados do modelo, como parâmetros do modelo e medidas de desempenho. O objetivo é descobrir padrões comuns e generalizáveis para equipar o modelo com um conhecimento amplo que possa ser usado em novas tarefas.

- Meta-teste. Durante o meta-teste, o modelo é exposto a novas tarefas que nunca foram encontradas durante o treinamento. O objetivo é avaliar seu desempenho medindo a qualidade e a rapidez com que ele se adapta a novos ambientes e tarefas.

O processo de meta-treinamento e meta-teste é ilustrado na imagem a seguir.

Meta-aprendizagem para classificação de imagens. Fonte: Dida

A meta-aprendizagem pode ser usada para resolver qualquer tipo de machine learning, seja aprendizagem supervisionada, aprendizagem não supervisionada ou aprendizagem por reforço.

Abordagens comuns ao meta-aprendizado

Há várias abordagens para a meta-aprendizagem. Abaixo você encontra os três mais comuns:

Meta-aprendizagem baseada em modelos

Os modelos de meta-aprendizagem baseados em modelos são projetados especificamente para aprendizagem rápida, ou seja, eles podem atualizar rapidamente seus parâmetros com poucas etapas de treinamento. Essa atualização rápida pode ser obtida por sua arquitetura interna ou controlada por outro modelo de meta-aprendizado.

Aqui está uma lista das estratégias de meta-aprendizagem baseadas em modelos mais comuns:

- Redes neurais com memória aumentada (MANNs). Apresentados pelos pesquisadores do Google em um artigo de 2016, os MANNs são modelos neurais equipados com um módulo de memória externa que lhes permite codificar e recuperar rapidamente novas informações e fazer previsões precisas após apenas algumas amostras. À medida que novos dados são inseridos no modelo, essas redes mudam sua tendência por meio de atualizações de peso, mas também modulam sua saída aprendendo a armazenar rapidamente as representações em cache nos repositórios de memória.

- Redes Meta. As meta-redes, ou MetaNets, são um tipo de modelo de meta-aprendizagem proposto por Munkhdalai e Yu em um artigo de 2017. As meta-redes são compostas por dois modelos: um meta-aprendiz e um aprendiz básico. O aprendiz básico funciona como uma rede neural tradicional: ele recebe uma tarefa de entrada e envia meta informações sobre o espaço da tarefa atual para o metaaprendiz. Essas informações são usadas pelo metaaprendiz para atualizar rapidamente os pesos do modelo.

Meta-aprendizagem baseada em métricas

A meta-aprendizagem baseada em métricas concentra-se em aprender uma métrica de distância que calcula a similaridade ou dissimilaridade entre pares de pontos de dados. Uma pontuação alta é retornada quando os objetos são semelhantes e uma pontuação baixa é retornada quando as imagens ou os objetos são diferentes.

A ideia central dessa abordagem é semelhante aos algoritmos de vizinho mais próximo, como K-NN ou K-means, que usam a distância entre os pontos de dados para fazer a classificação ou o agrupamento.

Em comparação com os problemas de classificação tradicionais, em que é necessário um grande volume de dados de treinamento, os modelos baseados em métricas podem funcionar com apenas algumas instâncias.

Alguns dos modelos mais comuns que utilizam estratégias de meta-aprendizagem baseadas em métricas são:

- Rede neural siamesa convolucional. As redes siamesas são um tipo de rede neural projetada para tarefas que envolvem medição de similaridade ou aprendizado métrico, como a verificação facial. O modelo é composto por duas redes gêmeas e suas saídas são treinadas em conjunto com uma função para aprender a relação entre pares de amostras de dados de entrada. As redes gêmeas são semelhantes, compartilhando os mesmos pesos e parâmetros de rede.

- Correspondência de redes. Desenvolvidas por pesquisadores do Google em um artigo de 2016, as redes de correspondência usam uma distância métrica chamada similaridade de cosseno entre duas amostras para fazer classificações. A arquitetura da rede de correspondência usa redes neurais com memória aumentada que incluem uma memória externa e um mecanismo de atenção para acessar a memória.

- Redes prototípicas. Apresentadas em um artigo de 2017 por Snell et al., 2017, as redes prototípicas aprendem um espaço métrico em que a classificação pode ser executada calculando distâncias para representações prototípicas de cada classe. Eles se baseiam na premissa de que existe uma incorporação na qual vários pontos se agrupam em torno de uma única representação de protótipo para cada classe.

Meta-aprendizagem baseada em otimização

As redes neurais usam a retropropagação de gradientes para reduzir progressivamente o erro do modelo e melhorar seu desempenho. A função de otimização é responsável por encontrar a maneira mais eficaz de recalcular os pesos e as tendências da rede. No entanto, as funções de otimização mais populares são projetadas para lidar com grandes quantidades de dados de treinamento, em vez de pequenos conjuntos de dados.

A meta-aprendizagem baseada em otimização concentra-se no projeto de funções de otimização inovadoras que podem atualizar os parâmetros do modelo apenas com um pequeno conjunto de dados de treinamento, para que possam se adaptar rapidamente a novas tarefas.

Entre os modelos de meta-aprendizagem baseados em otimização mais populares estão:

- Meta-aprendiz LSTM. Essa abordagem, apresentada por Ravi e Larochelle em 2017, usa redes de memória de longo e curto prazo (LSTM) para treinar um meta-aprendiz que pode aprender o algoritmo de otimização exato usado para treinar outro classificador de rede neural de aprendiz, acelerando assim a atualização de parâmetros para convergência rápida de treinamento em cenários de novas tarefas com dados de treinamento limitados.

- Meta-aprendizagem com diagnóstico de modelo (MAML). Apresentado por Finn et al. em um artigo de 2017, o MAML é compatível com qualquer modelo treinado com descida de gradiente e aplicável a uma variedade de problemas de aprendizagem diferentes, incluindo classificação, regressão e aprendizagem por reforço. O MAML baseia-se na suposição de que o treinamento dos parâmetros iniciais do modelo em apenas algumas atualizações de gradiente resultará em aprendizado rápido em uma nova tarefa. O objetivo é determinar os parâmetros do modelo que são sensíveis às alterações em uma tarefa, de modo que pequenas alterações nesses parâmetros levem a grandes melhorias na função de perda da tarefa.

- Répteis. Desenvolvido pela OpenAI, o Reptile é um algoritmo de meta-aprendizagem baseado em gradiente de primeira ordem. Ele coleta repetidamente amostras de uma tarefa, executa a descida de gradiente estocástico nela e atualiza os parâmetros iniciais em direção aos parâmetros finais aprendidos nessa tarefa. O Reptile é a aplicação do algoritmo Shortest Descent à configuração de meta-aprendizagem e é matematicamente semelhante ao MAML, com eficiência computacional e desempenho semelhantes.

Meta-aprendizagem e outros tipos de aprendizagem

Em contraste com os métodos tradicionais de aprendizagem supervisionada, que exigem grandes quantidades de dados, a metaaprendizagem oferece uma mudança de paradigma, capacitando os modelos de IA a generalizar tarefas, adaptar-se rapidamente com o mínimo de dados e melhorar o desempenho ao longo do tempo.

Vamos analisar alguns dos aplicativos mais promissores:

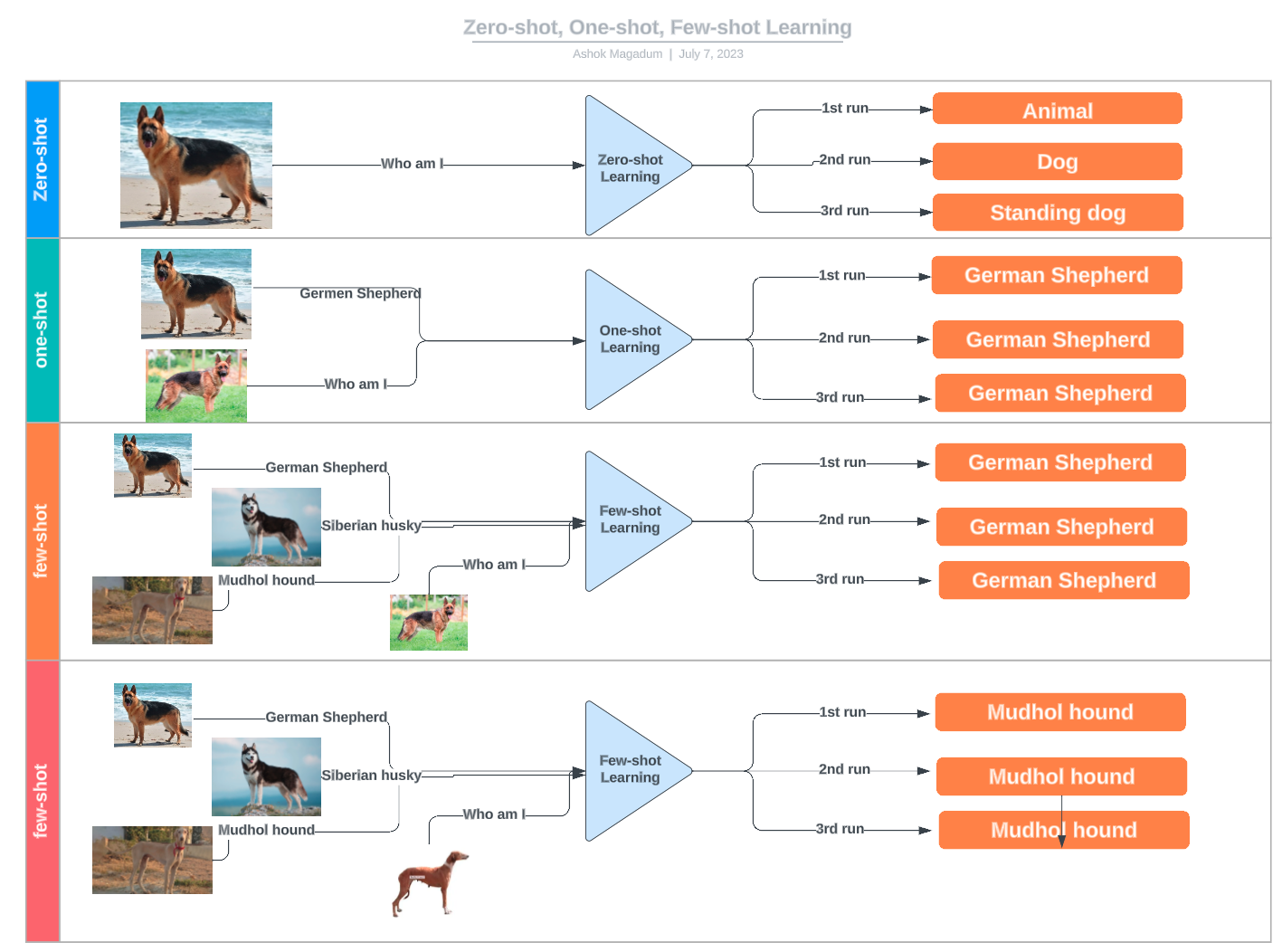

Aprendizagem com poucos disparos

O aprendizado de poucos disparos é um subcampo do machine learning em que os modelos aprendem a reconhecer padrões e a fazer previsões com base em um número limitado de exemplos de treinamento. O aprendizado de poucos disparos enfatiza a generalização em vez da memorização, desafiando a necessidade de um ajuste fino extenso. Para os defensores dessa abordagem, a chave está na capacidade de discernir a estrutura subjacente e os recursos que definem uma categoria.

A aprendizagem de poucas tentativas se enquadra no conceito mais amplo de aprendizagem de n tentativas, abrangendo várias técnicas com base no número de exemplos fornecidos:

- Aprendizagem de tiro zero: Não são fornecidos exemplos; o modelo se baseia apenas em conhecimento prévio ou descrições.

- Aprendizagem em uma única oportunidade: É fornecido apenas um exemplo por classe.

- Aprendizagem em duas etapas: Dois exemplos por classe são usados para treinamento.

- Aprendizado com poucos disparos: Um pequeno número de exemplos (normalmente entre 3 e 10) está disponível para cada classe.

Exemplos de aprendizado com zero, um e poucos disparos. Fonte: LinkedIn

Aprendizagem por transferência

A aprendizagem por transferência permite que um modelo treinado para uma tarefa seja reaproveitado para uma tarefa diferente, mas relacionada, geralmente por meio do ajuste fino de um modelo pré-treinado. A meta-aprendizagem, por outro lado, concentra-se em ensinar os modelos a se adaptarem rapidamente a novas tarefas com o mínimo de retreinamento. Embora a meta-aprendizagem possa aprimorar a aprendizagem por transferência em alguns casos, como a otimização de hiperparâmetros ou a seleção da melhor estratégia de ajuste fino, ela não é um componente necessário da aprendizagem por transferência. Muitas abordagens de aprendizagem por transferência dependem exclusivamente de técnicas convencionais de ajuste fino em vez de metaaprendizagem.

Sistemas de recomendação

Os sistemas de recomendação usam o feedback dos usuários para encontrar novos itens relevantes para eles ou para outros com a suposição de que os usuários que têm preferências semelhantes no passado provavelmente terão preferências semelhantes no futuro.

O objetivo de um sistema de recomendação é fornecer aos usuários recomendações personalizadas com base em suas preferências e comportamento anterior. O meta-aprendizado pode ajudar a atingir esse objetivo, aprendendo a otimizar o algoritmo de recomendação para cada usuário.

Os sistemas de meta-recomendação consistem em duas camadas: um sistema de recomendação básico e um otimizador de meta-nível. O sistema de recomendação básico gera recomendações para os usuários com base em seu comportamento anterior, enquanto o otimizador de meta-nível aprende a otimizar o sistema de recomendação básico para cada usuário.

Machine learning automatizado (AutoML)

O machine learning automatizado, também conhecido como AutoML, é o processo de automatizar o processo de ponta a ponta da criação de modelos de machine learning. Isso inclui tarefas como pré-processamento de dados, engenharia de recursos, seleção de modelos e ajuste de hiperparâmetros.

As técnicas de meta-aprendizagem podem dar suporte a esses processos, por exemplo, automatizando a otimização e a adaptação de hiperparâmetros ou até mesmo encontrando o modelo mais adequado para resolver uma tarefa específica.

Benefícios e desafios do meta-aprendizado

Há vários motivos convincentes pelos quais os pesquisadores de machine learning estão se voltando cada vez mais para as estratégias de meta-aprendizagem para desenvolver seus modelos.

-

Eficiência do treinamento: A meta-aprendizagem reduz o tempo de treinamento, evitando a necessidade de treinar modelos com conjuntos de dados enormes e permite o ajuste fino com dados limitados.

-

Redução dos custos operacionais: A meta-aprendizagem reduz os custos ao evitar a necessidade de treinar modelos a partir do zero, onde tanto a aquisição de dados quanto o uso de recursos computacionais para treinar um modelo podem ser caros.

-

Adaptabilidade e reutilização aprimoradas: A meta-aprendizagem é uma técnica fundamental que permite que os modelos se adaptem a vários cenários e tarefas, aumentando assim seu potencial e usabilidade.

-

Desempenho do modelo: Além de aumentar a adaptabilidade, a metaaprendizagem também pode melhorar a precisão dos modelos de machine learning existentes.

No entanto, a meta-aprendizagem não é uma estratégia única para todos. Ele tem limitações e possíveis armadilhas que devem ser abordadas com cuidado. Alguns dos desafios mais comuns na meta-aprendizagem são:

-

Incompatibilidade de domínio: É mais provável que a meta-aprendizagem funcione bem quando as tarefas de origem e de destino estiverem relacionadas de alguma forma. Se a nova tarefa for muito diferente, o conhecimento generalizável transferido pode não ser suficiente para executar a nova tarefa com precisão e pode até reduzir o desempenho em todas as tarefas.

-

Escassez de dados: Sempre é necessária uma certa quantidade de dados de treinamento. Se os dados de treinamento forem extremamente limitados ou a qualidade dos dados for ruim, é provável que o modelo sofra de subajuste.

-

Ajuste excessivo: A meta-aprendizagem também não é imune ao excesso de ajuste. Se o modelo for muito bem ajustado em uma tarefa, ele poderá aprender recursos específicos da tarefa que não se generalizam bem para novos dados.

-

Complexidade e custo: Às vezes, a tarefa-alvo é tão complexa que o processo de ajuste fino pode ser desafiador, computacionalmente caro e demorado.

Orientações futuras e oportunidades de pesquisa

A meta-aprendizagem é uma abordagem de projeto essencial para aumentar a eficiência e o potencial das redes neurais. É justo dizer que a atual revolução da IA não teria sido possível sem as muitas técnicas de aprendizagem por transferência disponíveis.

O campo está evoluindo rapidamente, com algumas áreas que exigem mais pesquisas, incluindo:

- Eficiência da amostra. Quantos dados são necessários para que um modelo se torne eficaz em novas tarefas? Essa é uma questão central na meta-aprendizagem. Embora as estratégias de aprendizagem de curto prazo mostrem que é possível que um modelo aprenda com dados limitados, ainda há uma ampla margem de melhoria para tornar os modelos mais eficientes e versáteis.

- Diversidade de tarefas. As técnicas de meta-aprendizagem tendem a funcionar melhor quando as tarefas em questão estão relacionadas de alguma forma. No entanto, é fundamental que haja mais pesquisas para avançar nos modelos de meta-aprendizagem que podem ser generalizados em uma ampla gama de tarefas sem excesso de ajuste.

- Técnicas avançadas. A meta-aprendizagem é um catalisador central da inovação em algumas das tecnologias mais promissoras e valiosas da atualidade, incluindo a aprendizagem por reforço, a robótica e os transformadores.

Conclusão

À medida que os modelos de machine learning se tornam maiores e mais complexos, encontrar novas técnicas para torná-los mais eficientes e versáteis é crucial para que o setor de IA cumpra suas promessas, faça os números funcionarem e avance na sustentabilidade do setor.

O meta-aprendizado tem muito a dizer a esse respeito. Esse campo de pesquisa está evoluindo rapidamente, oferecendo um conjunto de técnicas e estratégias que são cruciais para o avanço dos recursos da IA. Fique ligado no DataCamp para saber as últimas notícias sobre metaaprendizagem, IA e muito mais:

Sou analista de dados freelancer, colaborando com empresas e organizações em todo o mundo em projetos de ciência de dados. Também sou instrutor de ciência de dados com mais de 2 anos de experiência. Escrevo regularmente artigos relacionados à ciência de dados em inglês e espanhol, alguns dos quais foram publicados em sites consagrados, como DataCamp, Towards Data Science e Analytics Vidhya Como cientista de dados com formação em ciência política e direito, meu objetivo é trabalhar na interação de políticas públicas, direito e tecnologia, aproveitando o poder das ideias para promover soluções e narrativas inovadoras que possam nos ajudar a enfrentar desafios urgentes, como a crise climática. Eu me considero uma pessoa autodidata, um aprendiz constante e um firme defensor da multidisciplinaridade. Nunca é tarde demais para aprender coisas novas.

Perguntas frequentes sobre o Meta Learning

O que é meta-aprendizagem?

A meta-aprendizagem é um subcampo do machine learning focado em ensinar modelos a aprender novas tarefas de forma rápida e eficiente. Ele é inspirado na capacidade dos seres humanos de "aprender a aprender".

Quais são as estratégias de meta-aprendizagem mais comuns?

Dependendo de como a meta-aprendizagem é implementada, podemos identificar três abordagens principais: meta-aprendizagem baseada em modelo, baseada em métrica e baseada em otimização.

Quais são as aplicações da meta-aprendizagem?

Algumas das aplicações mais promissoras da meta-aprendizagem em IA são a aprendizagem de poucos disparos, a aprendizagem por transferência, os sistemas de recomendação e a aprendizagem automática de machine learning (AutoML).

Qual é a diferença entre meta-aprendizagem e aprendizagem por transferência?

Aprendizagem por transferência é uma técnica em que um modelo treinado em uma tarefa é usado como ponto de partida para um modelo em uma segunda tarefa. Isso envolve o uso dos parâmetros do modelo pré-treinado da tarefa geral como inicialização para o ajuste fino dos parâmetros do modelo para a tarefa específica. Por outro lado, a meta-aprendizagem concentra-se em estratégias de aprendizagem para tornar um modelo rapidamente adaptável a novas tarefas.

Quais são os benefícios da meta-aprendizagem?

A aprendizagem por transferência é uma excelente técnica de otimização, que pode aumentar a eficiência do treinamento e o desempenho do modelo, melhorar a adaptabilidade e a reutilização e reduzir os custos operacionais.