Kurs

Ist das der “DeepSeek‑Moment” der Videogenerierung? ByteDance hat soeben still und leise sein Videogenerierungsmodell Seedance 2.0 veröffentlicht, und die ersten damit erstellten Beispiele gehen viral.

In diesem Guide erkläre ich dir, was Seedance ist, welche Kernfunktionen es bietet und wie es unter der Haube arbeitet. Außerdem zeige ich dir Beispiele des neuen Videogenerierungsmodells in Aktion und vergleiche seine Stärken und Schwächen mit anderen prominenten Modellen. Kann es Googles Veo 3.1, OpenAI’s Sora 2 und Kuaishous Kling 3.0 herausfordern?

Was ist Seedance 2.0?

Seedance 2.0 ist ByteDances neuestes generatives KI‑Modell für Text‑zu‑Video und Bild‑zu‑Video, veröffentlicht am 10. Februar 2026.

Quelle: Aleena Amir auf X

Da ByteDance keine offizielle englische Release Note zu Seedance 2.0 veröffentlicht hat, wurden die meisten öffentlich kursierenden Spezifikationen und Feature‑Angaben aus chinesischer Berichterstattung zum Jimeng‑Rollout rekonstruiert. Viele “Spec Sheets” auf Drittanbieter‑Wrapper‑Websites scheinen dieselben Quellen zu spiegeln statt offizielle ByteDance‑Dokumentation.

Laut Tests chinesischer Medien und früher Partnerdokumente verspricht Seedance 2.0 2K‑Videoausgabe in Kinoqualität mit exzellenter Charakterkonsistenz.

Wie bekomme ich Zugriff auf Seedance 2.0?

Offiziell ist Seedance 2.0 in ByteDances Jimeng auf dem chinesischen Festland live und für zahlende Mitglieder verfügbar (z. B. ≥69 RMB‑Stufen laut chinesischen Medien). In der Praxis ist der Jimeng‑Zugang stark China‑zentriert; Kontoverifizierung und lokale Zahlungswege sind typische Hürden.

Die Seedance‑2.0‑Landingpage ist bereits sichtbar. Der tatsächliche Zugang ist jedoch derzeit beschränkt: Die meisten Nutzer sehen bis zum vollständigen Rollout eine Meldung "Coming Soon". Branchenquellen erwarten diesen um den 24. Februar 2026.

In der Zwischenzeit ist der beliebteste Workaround unter internationalen Nutzerinnen und Nutzern ChatCut, eine Drittanbieter‑App für KI‑Video, die Seedance 2.0 direkt integriert hat und frühen globalen Zugriff bietet, ohne dass eine chinesische Telefonnummer nötig ist. Aktuell gibt es eine Warteliste zur Anmeldung.

Wie funktioniert Seedance?

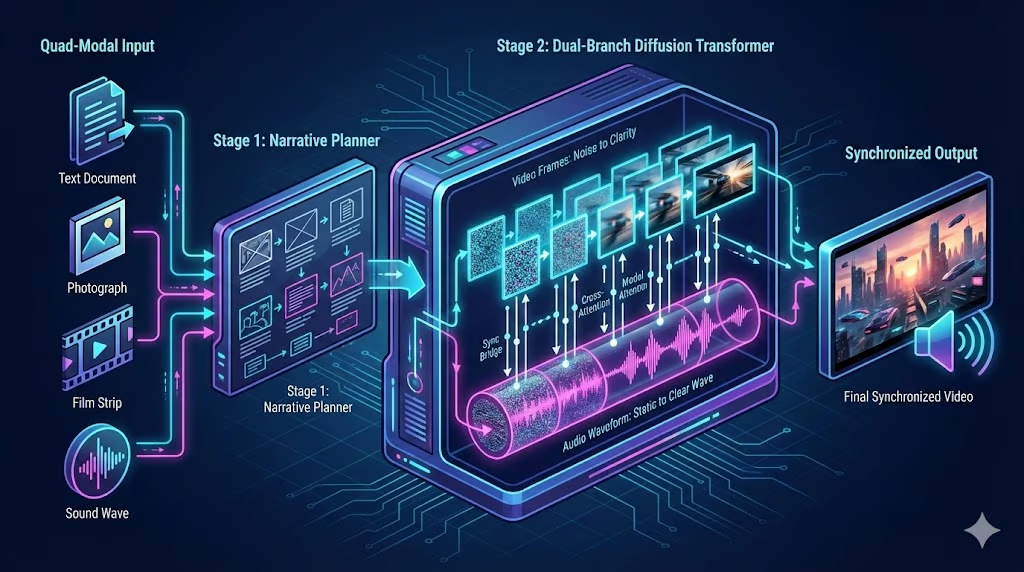

Wie Sora 2 und Veo 3.1 ist Seedance 2.0 ein Diffusionsmodell. Das bedeutet, es erzeugt Videos, indem es mit Bildfolgen aus statischem Rauschen startet und diese schrittweise in eine konsistente Videosequenz transformiert.

Im Unterschied zu früheren Text‑zu‑Video‑Modellen, die Video als stummen One‑Shot‑Clip behandelten, ist Seedance 2.0 als “multimodaler Regisseur” aufgebaut, der Ton, Erzählstruktur und komplexe visuelle Referenzen in einem Durchlauf verarbeiten kann.

Die Szene mit quad‑modalen Inputs dirigieren

Früher brauchte es “Prompt Engineering”, um der KI genau beizubringen, was du willst: lange, komplexe Textbeschreibungen tippen und hoffen, dass die KI es versteht. Seedance 2.0 ersetzt dieses Rätselraten, indem es die Szene mit einem quad‑modalen Eingabesystem dirigiert.

“Quad‑modal” bedeutet, dass Seedream Text, Bild, Video und Audio verarbeiten kann. Der quad‑modale Encoder ist kein einziger Trichter, sondern ein Set vortrainierter Encoder für jeden Datentyp:

- Text wird mit einem LLM‑basierten Encoder semantisch ausgewertet

- Bilder werden in visuelle Feature‑Tokens (Patches) kodiert

- Video‑Referenzclips werden in raum‑zeitliche Tokens (3D‑Patches) kodiert

- Audio wird in Wellenform‑ oder Spektrogramm‑Tokens kodiert

So werden alle vier Rohinputs in eine einheitliche Sprache latenter Vektoren überführt, um die Eingaben mathematisch zu repräsentieren.

Erzählungen mit Multi‑Shot‑Logik planen

Eine der größten Frustrationen mit älteren KI‑Videotools war die Ein‑Shot‑Grenze. Wenn du eine Geschichte wolltest, versuchte die KI, alles in einen einzigen, ungeschnittenen Take zu quetschen. Bei wenigen Sekunden Laufzeit führte das oft zu seltsamen Verzerrungen oder ignorierten Prompt‑Teilen.

Seedance 2.0 führt einen Erzählplaner mit Multi‑Shot‑Logik ein. Bevor ein einziger Pixel generiert wird, agiert dieser Planer wie ein Storyboard‑Artist. Er liest deinen Prompt und zerlegt ihn in eine Abfolge eigener Kameraeinstellungen.

Beispielsweise beginnt er mit einer Weitaufnahme der Stadt, schneidet zu einer Halbtotalen einer Person und endet mit einer Nahaufnahme ihres Gesichts – ganz ohne detaillierte Anweisungen. Anschließend orchestriert er die Generierung dieser Shots in Sequenz.

Er verwendet gemeinsame Konsistenzdaten, damit Gesicht, Kleidung und Licht dieser Person in jedem Schnitt identisch bleiben. Das Ergebnis wirkt wie eine geschnittene Filmszene statt eines rohen, halluzinierten Videoclips.

Diffusion mit zwei Transformer‑Modellen kombinieren

Die meisten KI‑Videomodelle arbeiten wie eine Stummfilmkamera: Erst wird das Video erzeugt, den Ton fügst du später mit einem separaten Tool hinzu. Das führt oft zu “Drift”, wenn z. B. Schritte oder eine zuschlagende Tür nicht exakt zur Aktion im Bild passen.

Seedance 2.0 löst dies mit einem Dual‑Branch‑Diffusion‑Transformer – einem Transformer für Video und einem für Audio.

Stell dir das wie ein Gehirn mit zwei Hemisphären vor, die perfekt synchron arbeiten. Eine Hemisphäre fokussiert sich voll auf die Videoframes, die andere auf die Audiowellenform. Weil sie während der Generierung ständig kommunizieren, stellt das Modell sicher, dass bei einem visuellen Ereignis (etwa Glasbruch) der passende Ton auf die Millisekunde genau entsteht.

Seedance 2.0: Die wichtigsten Funktionen

Nun, da wir wissen, wie es funktioniert, schauen wir uns an, was Seedance 2.0 kann. Zwei der spannendsten Features sind das quad‑modale Rundum‑Referenzsystem und das native Multi‑Shot‑Storyboarding.

Multimodales Rundum‑Referenzsystem

Seedream 2.0 lässt dich es zeigen, was du willst – nicht nur beschreiben. Du kannst bis zu 12 Dateien hochladen (9 Bilder, 3 Videos und 3 Audiodateien) und ihnen mit einem @‑Referenzsystem gezielt Rollen zuweisen.

- Brauchst du eine bestimmte Darstellerin oder einen Darsteller? Lade ein Foto hoch und markiere es als Charakterreferenz.

- Willst du eine bestimmte Kamerabewegung? Lade ein Beispielvideo hoch und markiere es als Bewegungsreferenz.

- Hast du einen bestimmten Beat? Lade einen Song hoch und markiere ihn als Rhythmusreferenz.

Das Modell trennt diese Eingaben und führt sie zusammen, sodass du die Szene mit konkreten Assets “regieren” kannst, statt auf Glück angewiesen zu sein.

Um dir ein klareres Bild der Praxis zu geben, hier ein Beispiel:

Prompt: “Ersetze das Model im Werbevideo @Video1 durch ein westliches Model und orientiere dich dabei am Aussehen in @Image2. Ändere die gesprochene Sprache vollständig auf Englisch.” (Quelle: SD AI Animation Storyteller auf X)

Das Ergebnis ist sehr beeindruckend. Seedance hat die Anweisungen vollständig befolgt, das Aussehen des referenzierten Models nahezu perfekt getroffen und die Lippensynchronität beim Übersetzen der Audiospur ins Englische angepasst. Bemerkenswert: Das Reflexionsverhalten der Brille bleibt vollständig erhalten.

Multi‑Shot‑Storyboarding

Das Multi‑Shot‑Storyboarding macht Seedance 2.0 gleichzeitig zum Regisseur und Cutter. So funktioniert es:

- Das Modell zerlegt eine Erzählung automatisch in mehrere verbundene Shots.

- Für jeden Shot wählt es die passende Kameraeinstellung.

- Abschließend komponiert es die Shots und fügt Übergänge hinzu.

Prompt: “Avengers: Endgame während der großen Kampfszene, aber Thanos stoppt alles und sagt allen Superhelden, dass es ihm leid tut. Alle akzeptieren das sofort und gehen weg, doch dann sagt Spiderman: \"Oh hell no, er hat gefühlt eine Bazillion Leute umgelegt!\" Und alle stürmen zurück und treten auf ihn ein, während er am Boden liegt.” (Quelle: Christopher Fryant auf X)

Das ist ein gutes Beispiel für Storyboarding in Aktion. Die Weitaufnahme am Anfang, der Zoom auf Thanos, der Tilt zu Thor und der harte Schnitt zu Spiderman – all das wirkt sehr stimmig und trifft das Avengers‑Gefühl, ohne dass diese Kamerabewegungen explizit gefordert wurden.

Native Soundeffekte und Voice Cloning

Noch vor Kurzem wäre native Audiogenerierung für sich allein ein Killer‑Feature gewesen, heute ist sie eher Standard. Dennoch erzeugt Seedance 2.0 nicht nur synchron Video und Audio, sondern enthält mehrsprachige Dialoge, Umgebungsgeräusche und aktionsgebundene Soundeffekte.

Ein besonders cooles Feature, das durch die Audioeingaben möglich wird, ist Voice Cloning – offenbar mehrstimmig, also bis zu 3 individuelle Stimmen pro Szene (entsprechend der Audio‑Dateigrenze). Nutzende können reale Stimmen hochladen, um Akzent, Tonfall und sogar Mehrpersonen‑Dialoge zu steuern.

Nachdem wir Sprach‑ und Lip‑Sync‑Fähigkeiten bereits in Übersetzungsbeispielen gesehen haben, schauen wir uns an, wie Seedance Hintergrundmusik und Soundeffekte von Grund auf erzeugt.

Prompt (mit Referenzdateien): “Die Frau in @Image1 geht zum Spiegel und betrachtet ihr Spiegelbild. Ihre Pose soll sich an @Image2 orientieren. Nach einem Moment des Nachdenkens bricht sie plötzlich zusammen und beginnt zu schreien. Die Aktion des Spiegelgreifens sowie Emotionen und Gesichtsausdrücke beim Zusammenbruch und Schrei sollen vollständig @Video1 referenzieren.” (Quelle: Feyber auf X)

Das Beispiel zeigt, dass das Modell mehrere, teils widersprüchliche Emotionen innerhalb derselben Szene beherrscht – nicht nur visuell, sondern auch akustisch.

Die traurige Hintergrundmusik zu Beginn spiegelt den Gesichtsausdruck der Figur gut wider und kippt in einen eher Horror‑artigen Ton, als sie wütend in den Spiegel schreit. Die Hintergrundmusik überlagert weder den Schrei noch das Griffgeräusch, sondern ergänzt beides stimmig.

Hochauflösende, cineastische Visuals

Seedance unterstützt Ausgaben bis 2K, mehrere Seitenverhältnisse und Bildraten von 24–60 fps – je nach Plattform. Der cineastische Look wird betont durch Details wie:

- Feine Texturen

- Robustes globales Licht

- Filmähnliches Color Grading

Ein weiterer Fokus in der Entwicklung von Seedance 2.0 war die Beachtung physikalischer Gesetzmäßigkeiten. Beides greift ineinander, wie das nächste Beispiel zeigt:

Prompt: “Eine energiegeladene, cineastische Actionsequenz bei Nacht in einer neonbeleuchteten Stadt. Die Kamera folgt einer einzelnen Figur, die durch regengetränkte Straßen sprintet, während Polizeidrohnen und Scheinwerfer vorbeiziehen. Schnelle Schnitte zwischen Nahaufnahmen entschlossener Augen, Stiefeln, die durch Pfützen spritzen, und Weitwinkelaufnahmen von haarscharf verfehlendem Verkehr. Die Kamera whip‑panned, während er über Barrieren springt, über Motorhauben rutscht und Explosionen hinter ihm ausweicht. Intensiver Motion Blur und dynamisches Licht, Handkamera‑Gefühl mit aggressiven Push‑ins, dramatischer Kontrast, schnelle Choreografie, harte Einschläge und zum Schluss ein Slow‑Motion‑Beat, als er von einem Dach in die Dunkelheit springt, während Lichter der Stadt unter ihm verwischen.” (Quelle: Txori auf X)

Das Ergebnis wirkt wie direkt aus einem Actionfilm. Kamerabewegung, Licht und sogar die Physik des Wasserspritzens aus der Pfütze sitzen. Unplausibel ist, dass die Figur kurz nach dem Sprint durch die Straße vom Hausdach springt.

Eine offensichtliche, aber interessante Eigenheit: Obwohl die Figur nur als “allein” beschrieben wurde, ist sie eine exakte Keanu‑Reeves‑Kopie.

Angesichts des actionlastigen Prompts mit dystopischem Setting (“neonbeleuchtete Stadt”, “regengetränkt”, “Polizeidrohnen”) ist das nachvollziehbar. Die Frage bleibt nur, ob die Inspiration aus The Matrix, John Wick, oder Cyberpunk 2077 (oder einer Mischung daraus) stammt.

Wie gut ist Seedance 2.0?

Ehrlich gesagt sprechen die Videos aus der Feature‑Einführung für sich. In diesem Abschnitt konzentriere ich mich auf zwei Probleme der Videogenerierung, die die Stärken von Seedance 2.0 abmildern.

Schluss mit Abhängigkeit von “Magic Prompts”

Ein großer Schmerzpunkt der ersten KI‑Video‑Generation war Black‑Box‑Prompting: Kreative mussten “Magic Prompts” und trickreiche Formulierungen entdecken, um aus Modellen mit schwachem Sprachverständnis und wenigen Stellschrauben brauchbare Ergebnisse zu holen.

Hier helfen das Rundum‑Referenzsystem und das Multi‑Shot‑Storyboarding enorm. Die Kombination aus der Rollenvergabe für Assets und einem Modell, das Kontext über verschiedene Shots einer Szene hinweg versteht, erzeugt beeindruckende Resultate – ganz ohne “Prompt‑Maxxing”. Gleichzeitig wird der Prompt nicht überladen (und das Modell nicht überfordert).

Ein gutes Beispiel sind 3x3‑Bilderraster. Mit 9 Referenzbildern, die verschiedene Shots einer Szene repräsentieren, erhältst du solide Ergebnisse, selbst wenn du in den Prompt kaum Arbeit steckst. Schauen wir, was das Modell aus folgendem Raster in Kombination mit einem ultraknappen Prompt erzeugt hat:

Prompt: “Video aus Storyboard generieren.” (Quelle: Mr.Iancu auf X)

Wieder ein sehr starkes Ergebnis. Das Modell versteht den Kontext der Szene natürlich und füllt die Lücken zwischen Einzelbildern. Unlogisch ist, dass zur Mitte des Videos einer der Angreifer für ein paar Frames hinter ihr in der Ecke zu stehen scheint.

Ein weiterer kleiner Fehler, den ich (zunächst) gesehen zu haben glaubte: Der Tisch steht aufrecht, was der Figur keine Deckung geben würde – aber im linken unteren Bildrand sieht man, dass der Fehler schon im Bilderraster vorhanden war, das von wurde von Nano Banana Pro generiert.

Das Problem der “Wegwerf‑Clips” lösen

Mit früheren Modellen glich Videogenerierung oft einer Lotterie: den passenden Clip zufällig zu treffen – mit vielen (teuren) “Wegwerf”‑Versuchen. Das automatische Multi‑Shot‑Storyboarding geht dieses Problem an und zerlegt narrative Prompts sehr gut in mehrere Shots.

Seedance 2.0 liefert im Vergleich zu früheren Modellen deutlich bessere Identitäts‑ und Szenenkonsistenz. Das reduziert lästige Artefakte wie Character Drift, plötzliche Erscheinungswechsel oder Flimmern, die viele ansonsten vielversprechende Clips unbrauchbar machten, drastisch.

Prompt: “Eine Naturdoku über einen Otter, der ein Flugzeug steuert.” (Quelle: ChinaTechTrend auf X)

Wo liegen die Grenzen von Seedance 2.0?

Bei all den Stärken schauen wir uns ein paar Einschränkungen von Seedance 2.0 an.

Komplexe, geschichtete Szenen mit Glas

Es wurde berichtet, dass Seedance 2.0 bei mehreren bewegten Ebenen hinter Glas Schwierigkeiten hat – zugegeben eine harte Nuss für jedes Videogenerierungsmodell (und zudem ein eher seltener Edge Case).

Das einzige Beispiel, das ich finden konnte, wird in diesem YouTube‑Review besprochen. Es zeigt “eine typische Außenszene für eine Diner‑Szene, cyberpunkig, Blick durch die Scheibe, Figur innen, draußen vorbeifahrende Autos”. Das Ergebnis wirkte teils sehr natürlich, mit Regentropfen am Fenster und Atembewegung, aber die gesamte Szene bewegte sich unnatürlich (als wäre sie “an ein Auto gebunden”).

Offenbar war eine Szene mit Glas auf beiden Seiten der Figur und zusätzlichem Hintergrund hinter der zweiten Glasschicht zu viel für Seedream 2.0, sodass es statischen Hintergrund und vorbeifahrende Autos nicht mehr korrekt unterscheiden konnte.

In unserem früheren Beispiel mit dem Model und der Brille waren Transparenz und Reflexion beiderseits stimmig; allerdings war a) das Beispiel deutlich einfacher und b) diente ein Referenzvideo als Vorlage.

Kleine Inkonsistenzen und Hintergrundtext

Einige Inkonsistenzen sind eher Folgen einer Fehlinterpretation des kodierten Kontexts als schlechter Videogenerierung. Ein Beispiel: In einer angefragten Game of Thrones‑/Friends‑Crossover‑Szene tauchte versehentlich eine Figur aus How I Met Your Mother auf:

Prompt: “Der Cast von Friends spielt in der Game‑of‑Thrones‑Sitcom. Chandler ist König Joffrey. Joey ist die Hand.” (Quelle: Gavin Purcell auf X)

Wie im Keanu‑Reeves‑Beispiel lässt sich die Ursache erahnen: Beide Serien sind sehr ähnliche Sitcoms, ihre Vektorrepräsentationen liegen also extrem dicht beieinander.

Während Hintergrundtexte in der Regel auch bei schnellen Bewegungen lesbar sind (vgl. Keanu‑Reeves‑Beispiel), wirken sie in manchen Fällen etwas pixelig. Schau dir etwa die Werbetafeln in diesem Basketball‑Video an, in dem ein Kind gegen LeBron James punktet und das viral ging:

Prompt unbekannt (Quelle: Serge Bulaev auf X)

Auch hier ist das Gesamtergebnis sehr beeindruckend: Die Bewegungen der Spielenden wirken realistisch, die Kamera hält den Fokus auf dem dribbelnden Mädchen, und sowohl Schatten als auch Hintergrundgeräusche passen zum Bild. Leider wurde der verwendete Prompt nicht geteilt.

Musik‑Performance‑Szenarien

Schwer zu begründen, aber Szenen mit Musikauftritten – etwa Konzerte – haben für mich noch etwas von der guten alten Uncanny Valley. Hier ein Beispiel einer K‑Pop‑Konzertszene:

Prompt: “Epische K‑Pop‑Konzertszene – Dramatische Bühne mit Lichtern, Effekten und Energie, ohne reale Personen darzustellen.” (Quelle: Ankit Patel auf X)

Ein paar Dinge fallen auf. Erstens enthält der Ton den Song (inklusive passendem Echo und Publikumslärm). Für mich klingt er dennoch etwas hölzern. Die Bewegungen der Bandmitglieder wirken leicht seltsam, zudem verschmilzt die Background‑Sängerin links teilweise mit der Bühne.

Seedance 2.0 im Vergleich

Schauen wir, wie Seedance 2.0 im Vergleich zu seinen drei wichtigsten Konkurrenten abschneidet.

|

Feature‑Kategorie |

Seedance 2.0 |

OpenAI Sora 2 |

Google Veo 3.1 |

Kuaishou Kling 3.0 |

|

Kinoqualität & Auflösung |

Kommerzielles 2K: Optimiert für einen scharfen, digitalen Look; ideal für kurze, prägnante Clips. |

World‑Sim‑Fidelity: Fokus auf Langzeit‑Kohärenz (20 s) und hochfidele Simulation. |

Choice der Kameraleute: Überlegene filmische Farbwissenschaft, HDR und professionelles Bokeh. |

Hochwertiges 1080p: Exzellente Prompt‑Treue, jedoch niedrigere Auflösung als Seedance. |

|

Bewegungsrealismus & Physik |

Gelerntes Vorwissen: Stabile Figurenbewegungen, abgeleitet aus Videoreferenzen. |

Physik‑Leader: Am besten bei Schwerkraft, Fluiden, Kollisionen und Objekt‑Permanenz (auch off‑screen). |

Kamera‑Meister: Überzeugt bei realistischen, cineastischen Bewegungen (Pan, Dolly) und zeitlicher Konsistenz (60 s). |

Motion‑Master: Bewältigt komplexe menschliche Aktionen (Essen, Kämpfen) und physische Interaktionen (Wippen). |

|

Regiekontrolle & Inputs |

Quad‑modale Referenz: Einzigartiges Graph‑System zur Rollenzuweisung für Text‑, Foto‑, Video‑ und Audioeingaben. |

Textgetrieben: Vor allem Textprompts mit begrenzter Bildunterstützung; keine Multi‑File‑Zuweisung. |

Masked Editing: Präzise Steuerung per Maskierung und textbasierter Iteration. |

Omni Mode & Brush: Enthält den “Motion Brush” für Pfade und bindet mehrere Charaktere/Elemente. |

|

Audiokompetenzen |

Dual‑Branch‑Sync: Generiert Audio/Video gleichzeitig für straffe, framegenaue Synchronisation. |

Post‑Process: Erst Video, Audio später; fehlende enge Synchronität. |

Externe Tools: Stützt sich auf separate Technik (z. B. AudioSet), weniger präzise Synchronisation. |

Native Audio: Erzeugt Ton mit klar unterscheidbaren Stimmfarben und Sprachen. |

|

Produktionsgeschwindigkeit & Zugang |

Hoher Durchsatz: <60 s für 5‑Sekunden‑Clips. Offiziell nur in China verfügbar. |

Premium/Langsam: Rechenintensiv und langsamer; als Research/Premium‑Tool positioniert. |

Restriktiert: Langsamere Generierung (Minuten); Zugang auf vertrauenswürdige Tester/Partner begrenzt. |

Zugänglich: Schnelle Web‑Plattform mit besserem globalem Zugang, jedoch ~30% langsamer als Seedance. |

Seedance 2.0 vs Sora 2

Einer der Hauptpunkte von Sora 2 ist sein Aufbau als “Realitätssimulator” mit tiefem physikalischem Verständnis, stark bei Schwerkraft, Fluiddynamik und Objektpermanenz. Auch wenn das nicht der Hauptfokus von Seedance 2.0 ist, zeigen erste Ergebnisse, dass es Sora 2 hier nicht signifikant hinterherhinkt und mithalten kann.

Seedances quad‑modales Referenzsystem fehlt Sora hingegen. Sora dient primär als Text‑zu‑Video und Bild‑zu‑Video. Das Klonen bestimmter Stile oder Charaktere bleibt in Sora daher recht statisch – verglichen mit der Möglichkeit in Seedance, Bewegungen ganzer Szenen zu übertragen oder Stimmen zu klonen.

Sora 2 kann hochwertiges Video erzeugen, behandelt Audio jedoch als separaten, nachgelagerten Prozess. Seedance 2.0s Dual‑Branch‑Transformer generiert Video und Audio simultan in einem Durchlauf. Das ermöglicht engere, framegenaue Synchronität (z. B. Schritte genau beim Fußaufsetzen) als bei Veo.

Seedance 2.0 vs Google Veo 3.1

Veo 3.1 gibt Regisseurinnen und Regisseuren präzise Kontrolle über das Tool “Masked Editing”, mit dem sich gezielt Bereiche eines Videos verändern lassen (z. B. Kleidung), während der Rest unberührt bleibt. Zudem gibt es spezifische Kamera‑Kommandos (Pan, Tilt, Zoom), um traditionelle Filmtechnik zu imitieren.

Seedance 2.0 setzt bei der Kontrolle anders an – mit dem Quad‑modale‑Referenzsystem. Statt Masken zu editieren, können Nutzende Stile oder Bewegungen klonen, indem sie Referenzvideos und ‑bilder hochladen. Wenn Veo eine digitale Editingsuite ist, ist Seedance ein “Style‑Transfer”‑Motor auf Steroiden – ideal, um eine bestimmte Stimmung oder Kamerabewegung zu replizieren.

Wie Sora 2 kann Veo 3.1 bei der exakten Synchronisation von Audio und Video nicht mit Seedance 2.0 mithalten.

Seedance 2.0 vs Kling 3.0

Beide Modelle sind stark in der Charakterkonsistenz, erreichen das aber unterschiedlich. Kling 3.0 nutzt den Omni Mode, um bestimmte Charaktere (Gesichter, Kleidung) zu “binden” und über mehrere Shots/Szenen wiederzuverwenden. Es entsteht im Grunde eine Asset‑Bibliothek, die du mit @ abrufen kannst.

Verglichen mit Seedance 2.0s quad‑modalem Referenzsystem liegt der Unterschied darin, ob du von außen klonst oder generierte Artefakte beibehältst. Kling ist besser, um einen wiederverwendbaren Cast für eine Serie aufzubauen, Seedance besser, um eine spezifische Stimmung oder Kamerabewegung aus einem existierenden Clip auf ein neues Motiv zu übertragen.

Kling 3.0 bietet präzise Steuerung über Tonfall und Emotion generierter Dialoge (z. B. “flüsternd”, “aufgeregt”, “sarkastisch”) und unterstützt mehrsprachige Sprachausgabe nativ – mit beeindruckenden Ergebnissen. Obwohl seine Audio‑Video‑Synchronität Veo 3.1 und Sora 2 übertrifft, hat Seedance 2.0 hier noch einen kleinen Vorsprung.

Fazit

Die ersten Ergebnisse von ByteDances Seedance‑2.0‑Modell sind sehr beeindruckend und deuten auf einen Sprung in der KI‑Videogenerierung hin. Besonders die Kombination aus quad‑modalem Input und automatischem Multi‑Shot‑Storyboarding könnte ein echter Gamechanger für Use Cases von Werbung und Prototyping bis Film und Gaming sein.

Diese Power bringt jedoch unmittelbare Reibung mit sich. Die Fähigkeit des Modells, Stimmen aus einem einzigen Foto zu klonen und unbeabsichtigt urheberrechtlich geschützte Figuren zu erzeugen (wie der ungefragte Keanu‑Reeves‑Doppelgänger), hat ByteDance bereits dazu gezwungen, bestimmte “Real‑Person”‑Referenzfunktionen kurzfristig zu sperren und die Identitätsprüfung zu verschärfen.

Spannend wird sein, wie große Player wie Google und OpenAI auf die Veröffentlichung von Seedance reagieren und ob globale Zugriffsbeschränkungen irgendwann fallen – sodass Nutzerinnen und Nutzer nicht mehr auf Drittanbieter‑API‑Wrapper angewiesen sind. Wir beobachten die Lage genau und liefern einen ausführlichen Hands‑on‑Test, sobald wir direkten Zugang haben, um die Fähigkeiten des Modells selbst zu prüfen.

Wenn dich die Konzepte hinter fortgeschrittenen Tools wie Seedream 2.0 interessieren, empfehle ich dir unseren AI Fundamentals Lernpfad.

Seedance 2.0: FAQs

Ist Seedance 2.0 kostenlos nutzbar?

Nein. Aktuell ist Seedance 2.0 über ByteDances Plattform “Jimeng” in China verfügbar, die ein kostenpflichtiges Abo erfordert (Berichten zufolge ab ca. 69 RMB). Internationale Nutzer greifen meist über Drittanbieter‑APIs oder Wrapper zu, die eigene Preisstrukturen haben.

Wie kann ich außerhalb Chinas auf Seedance 2.0 zugreifen?

Direkter Zugang zu Jimeng erfordert oft eine chinesische Telefonnummer und Zahlungsmethode. Die meisten Nutzer außerhalb Chinas verwenden derzeit inoffizielle Wrapper‑Websites oder API‑Services, die das Seedance‑Modell integrieren und eigene Limits/Kosten haben können. Zugang über CapCuts Dreamina wird für Ende Februar 2026 erwartet.

Kann ich in Seedance 2.0 eine bestimmte Person oder einen Stil klonen?

Ja, mit Einschränkungen. Du kannst Referenzbilder hochladen, um das Aussehen einer Figur zu “klonen”, oder ein Video, um eine bestimmte Kamerabewegung zu übernehmen. Nach der unbeabsichtigten Erzeugung von Promi‑Doppelgängern hat ByteDance jedoch Berichten zufolge die Nutzung realer Personen als Referenz verschärft, um Deepfakes und Urheberrechtsverletzungen zu verhindern.

Erzeugt Seedance 2.0 Ton?

Ja. Anders als viele Wettbewerber, die erst Video und dann Ton erzeugen, nutzt Seedance 2.0 einen Dual‑Branch‑Diffusion‑Transformer, der Videoframes und Audiowellenformen gleichzeitig generiert. Das führt zu straffer Synchronität, bei der Soundeffekte (etwa Schritte oder Glasbruch) bildgenau zur Aktion passen.

Was unterscheidet Seedance 2.0 von OpenAI’s Sora 2?

Während Sora 2 die Simulation realer Physik und längerer Videos priorisiert, setzt Seedance 2.0 auf “Commercial Speed” und Regiekontrolle. Herausragend ist das quad‑modale Referenzsystem: Du kannst bis zu 12 Bilder, Videos und Audiodateien hochladen und präzise Rollen zuweisen (z. B. Charakterreferenz oder Kamerabewegung) – direkter steuerbar als Soras primär textbasiertes Prompting.

Datenwissenschaftsredakteur bei DataCamp | Prognosen erstellen und mit APIs arbeiten ist genau mein Ding.