Cours

Est‑ce le « moment DeepSeek » de la génération vidéo ? ByteDance vient de publier discrètement son modèle de génération vidéo Seedance 2.0, et les premières vidéos créées avec sont en train de devenir virales.

Dans ce guide, je vous présente Seedance, ses fonctionnalités clés et son fonctionnement en coulisses. Je vous montre aussi des exemples du nouveau modèle en action et je compare ses forces et faiblesses avec d’autres modèles de premier plan. Peut‑il rivaliser avec le Veo 3.1 de Google, le Sora 2 d’OpenAI et le Kling 3.0 de Kuaishou ?

Qu’est‑ce que Seedance 2.0 ?

Seedance 2.0 est le tout dernier modèle d’IA générative texte‑vers‑vidéo et image‑vers‑vidéo de ByteDance, publié le 10 février 2026.

Source : Aleena Amir sur X

Comme ByteDance n’a pas publié de note de version officielle en anglais pour Seedance 2.0, la plupart des spécifications publiques et des promesses de fonctionnalités sont reconstruites à partir d’articles en chinois sur le déploiement de Jimeng. Beaucoup de « fiches techniques » sur des sites tiers semblent reprendre les mêmes sources plutôt que de la documentation officielle de ByteDance.

D’après des tests de médias chinois et une documentation précoce destinée aux partenaires, Seedance 2.0 promet une sortie vidéo cinéma en 2K avec une excellente constance des personnages.

Comment accéder à Seedance 2.0 ?

Officiellement, Seedance 2.0 est disponible au sein de Jimeng, la plateforme de ByteDance en Chine continentale, accessible aux abonnés payants (par exemple, des paliers ≥ 69 RMB selon des médias chinois). En pratique, l’accès à Jimeng est centré sur la Chine, et la vérification de compte ainsi que les moyens de paiement locaux constituent des points de friction classiques.

La page de présentation de Seedance 2.0 est déjà visible. Toutefois, l’accès effectif est pour l’instant restreint : la plupart des utilisateurs verront un message « Bientôt disponible » jusqu’au déploiement complet, que des sources industrielles situent autour du 24 février 2026.

En attendant, la solution la plus répandue chez les utilisateurs internationaux est ChatCut, une application vidéo d’IA tierce qui a intégré Seedance 2.0 et propose un accès global anticipé sans numéro de téléphone chinois. Pour l’heure, il existe une liste d’attente pour s’inscrire.

Comment fonctionne Seedance ?

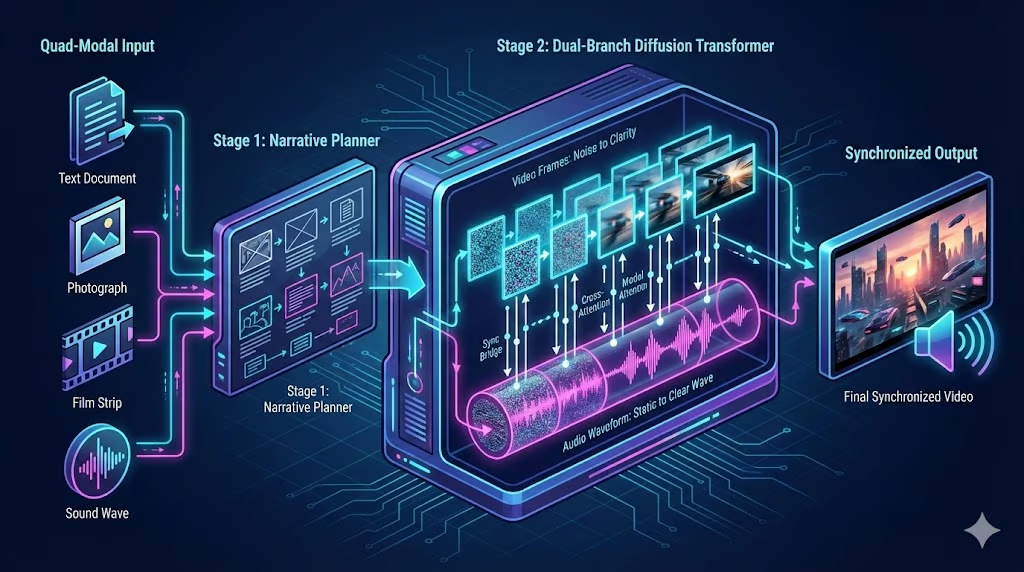

Comme Sora 2 et Veo 3.1, Seedance 2.0 est un modèle de diffusion. Autrement dit, il génère la vidéo en partant de trames de bruit statique qu’il transforme progressivement, en plusieurs étapes, pour faire émerger une séquence cohérente.

Cependant, à la différence des premiers modèles texte‑vers‑vidéo qui produisaient un clip muet et monobloc, Seedance 2.0 est pensé comme un « réalisateur multimodal » capable de gérer le son, la structure narrative et des références visuelles complexes en un seul passage.

Diriger la scène avec des entrées quadri‑modales

Jusqu’à récemment, obtenir exactement ce que vous vouliez d’une IA supposait du « prompt engineering » : saisir de longues descriptions complexes en espérant que l’IA comprenne. Seedance 2.0 remplace ces tâtonnements en « dirigeant » la scène grâce à un système d’entrée quadri‑modale.

« Quadri‑modale » signifie que Seedream accepte des entrées texte, image, vidéo et audio. L’encodeur quadri‑modale n’est pas un unique entonnoir, mais un ensemble d’encodeurs pré‑entraînés pour chaque type de donnée :

- Texte : encodé par un encodeur basé sur un LLM pour extraire le sens

- Images : encodées en jetons de caractéristiques visuelles (patchs)

- Vidéos : extraits de référence encodés en jetons spatio‑temporels (patchs 3D)

- Audio : encodé en jetons de forme d’onde ou de spectrogramme

Au final, ces quatre entrées brutes sont converties dans un langage unifié de vecteurs latents pour représenter mathématiquement les contenus.

Planifier les récits avec une logique multi‑plans

L’un des gros irritants des anciens outils vidéo d’IA était la contrainte du plan unique. Si vous demandiez une histoire, l’IA essayait de tout faire tenir en une seule prise continue, sans montage. Avec des durées limitées à quelques secondes, on obtenait souvent des déformations étranges ou des parties du prompt ignorées.

Seedance 2.0 introduit un planificateur narratif qui corrige cela grâce à une logique multi‑plans. Avant de générer le moindre pixel, ce planificateur agit comme un storyboarder : il lit votre prompt et le découpe en une séquence de plans caméra distincts.

Par exemple, il peut commencer par un plan large d’une ville, enchaîner sur un plan moyen d’un personnage, puis finir sur un gros plan de son visage, le tout sans instructions détaillées. Il orchestre ensuite la génération de ces plans dans l’ordre.

Il s’appuie sur des données de constance partagées pour que le visage, les vêtements et la lumière restent identiques d’un cut à l’autre. Le résultat ressemble davantage à une séquence montée qu’à un clip brut, halluciné.

Allier diffusion et deux modèles transformers

La plupart des modèles vidéo d’IA fonctionnent comme un film muet : ils génèrent d’abord l’image, puis vous ajoutez le son avec un autre outil. Cela crée souvent un « décalage », où les bruits de pas ou une porte qui claque ne collent pas exactement à l’action à l’écran.

Seedance 2.0 résout ce problème avec un transformeur de diffusion à double branche, avec un transformer dédié à la vidéo et un autre à l’audio.

Imaginez un cerveau à deux hémisphères travaillant en parfaite synchronisation. L’un se concentre sur la génération des images, l’autre sur la forme d’onde audio. Comme ils communiquent en continu pendant la création, le modèle s’assure que lorsqu’un événement visuel se produit (un verre qui se brise), le son correspondant est généré à la même milliseconde.

Fonctionnalités clés de Seedance 2.0

Maintenant que l’on comprend son fonctionnement, voyons ce que Seedance 2.0 sait faire. Deux atouts majeurs : son système de référence quadri‑modale et son storyboard multi‑plans natif.

Système de référence multimodale tout‑terrain

Seedream 2.0 vous permet de montrer ce que vous voulez, plutôt que de seulement le décrire. Vous pouvez téléverser jusqu’à 12 fichiers (9 images, 3 vidéos et 3 pistes audio) et leur attribuer des rôles précis via un système de référence @.

- Besoin d’un acteur précis ? Téléversez sa photo et étiquetez‑la comme référence personnage.

- Envie d’un mouvement de caméra spécifique ? Téléversez une vidéo exemple et étiquetez‑la comme référence de mouvement.

- Un rythme particulier ? Téléversez un morceau et étiquetez‑le comme référence de tempo.

Le modèle dissocie ces entrées puis les combine, ce qui vous permet de « diriger » la scène avec des éléments concrets plutôt que de compter sur la chance.

Pour mieux visualiser le résultat en pratique, voici un exemple :

Prompt : « Remplacez le mannequin de la vidéo promotionnelle @Video1 par un mannequin occidental, en reprenant l’apparence de @Image2. Remplacez toute la langue parlée par de l’anglais. » (Source : SD AI Animation Storyteller sur X)

Le résultat est très impressionnant. Seedance a suivi les instructions à la lettre, a reproduit presque parfaitement l’apparence du modèle de référence et a ajusté la synchronisation labiale lors de la traduction de l’audio en anglais. À noter : le comportement des reflets sur les lunettes est parfaitement préservé.

Storyboard multi‑plans

La fonction de storyboard multi‑plans fait de Seedance 2.0 à la fois le réalisateur et le monteur. Voici comment cela fonctionne :

- Le modèle segmente automatiquement un récit en plusieurs plans reliés.

- Pour chaque plan, il choisit le type de caméra adapté.

- Enfin, il compose les plans et ajoute des transitions entre eux.

Prompt : « La bataille finale d’Avengers : Endgame, mais Thanos arrête tout et dit à tous les super‑héros qu’il est désolé. Tous acceptent aussitôt et s’en vont, mais Spiderman dit : \"Oh nooon, il a quand même tué des milliards de gens !\" Et tous reviennent en courant et lui règlent son compte alors qu’il est à terre. » (Source : Christopher Fryant sur X)

Un bon exemple du storyboard en action. Le plan large d’ouverture, le zoom sur Thanos, le panoramique vers Thor et le cut sec sur Spiderman : tout est cohérent et fidèle à l’esprit des Avengers, sans avoir eu besoin de préciser ces mouvements de caméra.

Génération native d’effets sonores et clonage de voix

Il n’y a pas si longtemps, la génération audio native aurait été une killer feature à elle seule ; aujourd’hui, c’est presque un standard attendu. Seedance 2.0 génère non seulement la vidéo et l’audio de façon synchronisée, mais inclut aussi des dialogues multilingues, des ambiances et des effets son liés à l’action.

Autre capacité rendue possible par l’entrée audio : le clonage de voix, a priori multi‑locuteurs, avec jusqu’à 3 voix personnalisées par scène (limite du nombre de fichiers audio). Les utilisateurs peuvent téléverser de vraies voix pour guider l’accent, le timbre et même des conversations à plusieurs personnages.

Nous avons déjà vu à l’œuvre les capacités de langue et de synchronisation labiale dans les exemples de traduction ; voyons maintenant comment Seedance crée la musique d’ambiance et les effets sonores à partir de zéro.

Prompt (avec fichiers de référence) : « La femme de @Image1 s’approche du miroir et regarde son reflet. Sa pose doit reprendre @Image2. Après un moment de réflexion, elle craque soudain et se met à crier. L’action de saisir le miroir, ainsi que les émotions et expressions faciales lors de l’effondrement et du cri, doivent reprendre fidèlement @Video1. » (Source : Feyber sur X)

Cet exemple montre que le modèle peut gérer plusieurs émotions contradictoires au sein d’une même scène, visuellement comme acoustiquement.

La musique d’ambiance au début reflète bien l’expression du personnage, puis vire au registre horrifique lorsqu’elle crie de colère face au miroir. La musique ne parasite ni son cri ni le bruit de sa main sur le miroir, mais les accompagne bien.

Visuels cinématographiques haute résolution

Seedance prend en charge des sorties jusqu’en 2K, plusieurs formats d’image et des cadences de 24 à 60 ips selon la plateforme. Il accentue l’esthétique cinéma en soignant notamment :

- Des textures détaillées

- Un éclairage global robuste

- Un étalonnage des couleurs proche du film

Autre axe majeur : le respect de la physique. Ces deux volets vont de pair, comme on le voit dans l’exemple suivant :

Prompt : « Une séquence d’action cinématographique à haute énergie, de nuit, dans une ville néonisée ; la caméra suit un personnage solitaire qui sprinte dans des rues détrempées tandis que drones de police et phares filent en traînées, cuts rapides entre gros plans sur des yeux déterminés, bottes éclaboussant des flaques, et plans larges où la circulation l’évite de justesse ; la caméra whippe lorsqu’il franchit des barrières, glisse sur des capots de voitures et esquive des explosions derrière lui ; motion blur intense et éclairages dynamiques, sensation caméra à l’épaule avec zooms agressifs, contraste dramatique, chorégraphie rapide, impacts nets, et un final en ralenti lorsqu’il saute d’un toit dans l’obscurité tandis que les lumières de la ville filent sous lui. » (Source : Txori sur X)

Le rendu évoque une scène d’un film d’action. Mouvement de caméra, éclairage, et même la physique de l’eau qui éclabousse sont réussis. En revanche, on remarque une incohérence : le personnage saute d’un toit juste après avoir couru dans la rue.

Autre bizarrerie : bien que décrit comme « seul », le personnage ressemble trait pour trait à Keanu Reeves.

Au vu d’un prompt très orienté action et dystopie (« ville néonisée », « sous la pluie », « drones de police »), on devine la source d’inspiration. Reste à savoir si elle vient de Matrix, de John Wick, ou de Cyberpunk 2077 (ou d’un mélange des trois).

Seedance 2.0, c’est bon à quel point ?

Honnêtement, les vidéos vues plus haut parlent d’elles‑mêmes. Ici, je veux me concentrer sur deux problèmes de la génération vidéo que Seedance 2.0 atténue particulièrement bien.

Mettre fin à la dépendance aux « prompts magiques »

Un point de douleur majeur des premières générations d’IA vidéo était le prompt engineering en boîte noire : il fallait découvrir des « prompts magiques » et des tournures bricolées pour obtenir des résultats exploitables de modèles à compréhension sémantique limitée et aux contrôles restreints.

Ici, le système de références tout‑terrain et le storyboard multi‑plans sont précieux. La possibilité d’associer des assets à des rôles, combinée à un modèle qui excelle dans la compréhension du contexte à travers différents plans, donne des résultats impressionnants sans « prompt‑maxxing ». Cela évite aussi de surcharger le prompt (et le modèle).

Un bon exemple : l’usage de grilles 3×3 d’images. En fournissant 9 images de référence représentant différents plans d’une scène, vous obtenez un rendu décent même avec un prompt minimal. Voyons ce que le modèle produit à partir de la grille ci‑dessous comme entrée, avec un prompt parmi les plus simples :

Prompt : « Générer une vidéo à partir du storyboard. » (Source : Mr.Iancu sur X)

Là encore, un résultat très convaincant. Le modèle comprend naturellement le contexte de la scène et comble les vides entre les images. Un élément incohérent : en milieu de vidéo, un des assaillants semble, pendant quelques frames, se tenir dans le coin derrière elle.

Autre petite erreur que j’ai cru repérer : la table semblait verticale, ce qui n’offrirait aucune couverture au personnage ; mais en regardant bien en bas à gauche, on voit que l’erreur figurait déjà sur la grille d’images, générée par Nano Banana Pro.

Résoudre le problème des « clips jetables »

Avec les modèles précédents, générer des vidéos revenait souvent à une loterie pour obtenir le bon clip par hasard, au prix de nombreuses tentatives (coûteuses) « jetables ». Le storyboard multi‑plans automatique s’attaque à ce problème et décompose très bien les prompts narratifs en plusieurs plans.

Seedance 2.0 offre une bien meilleure constance d’identité et de scène que les modèles antérieurs. Cela réduit fortement les artefacts gênants comme la dérive de personnage, les changements d’apparence soudains ou le scintillement, qui rendaient souvent inutilisables des clips pourtant prometteurs.

Prompt : « Un documentaire animalier sur une loutre qui pilote un avion. » (Source : ChinaTechTrend sur X)

Quelles sont les limites de Seedance 2.0 ?

Malgré ses nombreux atouts, regardons quelques limites du modèle Seedance 2.0.

Scènes complexes et superposées avec du verre

Il a été rapporté que Seedance 2.0 peine avec des scènes comportant plusieurs couches mobiles derrière une vitre, ce qui, il faut l’admettre, est un cas difficile pour tout modèle vidéo (et un cas limite peu fréquent).

Cependant, l’unique exemple que j’ai trouvé est discuté dans cette review YouTube. On y voit « une scène extérieure typique pour un diner, ambiance cyberpunk, à travers la vitre, personnage à l’intérieur, voitures en mouvement dehors ». Le rendu paraissait par moments très naturel (gouttes de pluie sur la fenêtre, respiration), mais l’ensemble de la scène bougeait de manière peu naturelle (comme « attachée à une voiture »).

Il semble qu’une scène avec du verre des deux côtés du personnage, plus un arrière‑plan supplémentaire derrière la seconde couche, soit trop complexe pour Seedream 2.0, qui ne distinguait plus l’arrière‑plan statique des voitures en mouvement.

Dans notre exemple précédent des lunettes, la transparence et les reflets étaient impeccables, mais il faut noter que a) l’exemple était bien plus simple, et b) il utilisait une vidéo de référence servant de gabarit au modèle.

Légères incohérences et textes en arrière‑plan

Certaines incohérences tiennent davantage à une mauvaise interprétation du contexte encodé qu’à une mauvaise génération en soi. Par exemple, lorsqu’on lui a demandé une scène crossover entre Game of Thrones et Friends, il a inséré par erreur un personnage de How I Met Your Mother :

Prompt : « Le casting de Friends joue dans la sitcom Game of Thrones. Chandler incarne le roi Joffrey. Joey est la Main. » (Source : Gavin Purcell sur X)

Comme pour l’exemple Keanu Reeves, on devine l’origine : les deux shows sont des sitcoms très proches, leurs représentations vectorielles sont donc extrêmement voisines.

Si les textes d’arrière‑plan restent généralement lisibles même lors de mouvements rapides (cf. l’exemple Keanu Reeves), ils apparaissent parfois un peu pixelisés. Voyez, par exemple, les panneaux publicitaires dans cette vidéo de basket d’un enfant marquant face à LeBron James, devenue virale :

Prompt inconnu (Source : Serge Bulaev sur X)

Là encore, le résultat global est très impressionnant : les mouvements des joueurs sont réalistes, la caméra garde le focus sur la jeune dribbleuse, et ombres comme bruit de fond correspondent à l’image. Dommage que le prompt utilisé n’ait pas été partagé.

Scènes de performance musicale

Difficile d’en identifier la cause, mais les scènes de performance musicale (concerts, etc.) conservent un léger effet de vallée dérangeante. Voici un exemple de scène de concert K‑pop :

Prompt : « Scène de concert K‑pop épique – scène dramatique avec lumières, effets et énergie, sans représenter de personnes réelles. » (Source : Ankit Patel sur X)

Quelques points à noter. D’abord, le son inclut le morceau (avec l’écho et le bruit de la foule). Cependant, il sonne un peu « boisé ». Les mouvements des membres du groupe paraissent aussi légèrement étranges, la choriste de gauche semblant se fondre dans la scène.

Seedance 2.0 face aux concurrents

Voyons comment Seedance 2.0 se compare à ses trois principaux concurrents.

|

Catégorie |

Seedance 2.0 |

OpenAI Sora 2 |

Google Veo 3.1 |

Kuaishou Kling 3.0 |

|

Qualité ciné & résolution |

2K commerciale : esthétique numérique nette, optimisée pour des clips courts et percutants. |

Fidélité de simulation : met l’accent sur la cohérence à long terme (20 s) et la haute fidélité. |

Choix du chef op’ : superbe colorimétrie façon film, HDR et profondeur de champ pro. |

1080p de qualité : excellente adhérence au prompt, mais résolution inférieure à Seedance. |

|

RÉalisme des mouvements & physique |

Priors appris : mouvement de personnages stable issu de références vidéo. |

Leader physique : meilleur pour gravité, fluides, collisions et permanence des objets (même hors champ). |

Maîtrise caméra : excellents mouvements cinématographiques (panos, travellings) et constance temporelle (60 s). |

Maître du mouvement : gère des actions humaines complexes (manger, combattre) et interactions physiques (balanciers). |

|

Contrôle réalisateur & entrées |

Référence quadri‑modale : graphe unique pour assigner des rôles à texte, photo, vidéo et audio. |

Piloté par texte : prompts surtout textuels, support image limité ; pas d’assignation multi‑fichiers. |

Édition masquée : contrôle précis via masques et itérations par texte. |

Omni Mode & Brush : « Motion Brush » pour tracer des trajectoires et lier plusieurs éléments/personnages. |

|

Capacités audio |

Synchronisation double branche : génère audio/vidéo simultanément avec une synchro à l’image près. |

Post‑traitement : vidéo d’abord, audio ensuite ; synchro moins serrée. |

Outils externes : s’appuie sur des tech séparées (ex. AudioSet), synchro moins précise. |

Audio natif : génère un audio avec des timbres et langues distincts. |

|

Vitesse & accès |

Haut débit : < 60 s pour 5 s de clip. Disponibilité officielle limitée à la Chine. |

Premium/lent : très coûteux en calcul, plus lent ; positionné en outil de recherche/premium. |

Restreint : génération plus lente (minutes) ; accès limité aux testeurs/partenaires de confiance. |

Accessible : plateforme web rapide et plus globale, mais ~30 % plus lente que Seedance. |

Seedance 2.0 vs Sora 2

L’un des principaux arguments de Sora 2 est son architecture de « simulateur de réalité » avec une compréhension physique poussée, excellente pour modéliser gravité, dynamique des fluides et permanence des objets. Même si ce n’est pas l’axe prioritaire de Seedance 2.0, les premiers résultats montrent qu’il n’est pas significativement en retrait et peut rivaliser.

En revanche, le système de références quadri‑modales de Seedance manque à Sora, qui reste texte‑vers‑vidéo et image‑vers‑vidéo. Le clonage de styles ou de personnages y est donc assez statique, comparé à la capacité de Seedance à reprendre les mouvements d’une scène entière ou à cloner des voix.

Sora 2 peut générer des vidéos de grande qualité, mais traite l’audio à part, en étape secondaire. L’architecture à double branche de Seedance 2.0 est fondamentalement différente : elle génère vidéo et audio simultanément en un seul passage, offrant une synchronisation plus serrée, image par image (par exemple, un pas qui touche le sol exactement au contact) que Veo.

Seedance 2.0 vs Google Veo 3.1

Veo 3.1 donne aux réalisateurs un contrôle fin via son outil d’édition masquée, qui permet de sélectionner et modifier des zones précises d’une vidéo (ex. changer les vêtements d’un personnage) en laissant le reste intact. Il offre aussi des commandes caméra spécifiques (panoramique, inclinaison, zoom) pour mimer les techniques de tournage traditionnelles.

Seedance 2.0 adopte une autre approche du contrôle avec son système de références quadri‑modales. Plutôt que des masques d’édition, on peut cloner styles ou mouvements en téléversant des vidéos et images de référence. Si Veo est une suite d’édition numérique, Seedance est un moteur de « transfert de style » sous stéroïdes, encore mieux adapté pour reproduire une ambiance ou un mouvement de caméra spécifiques.

Comme Sora 2, Veo 3.1 ne rivalise pas avec Seedance 2.0 en matière de synchronisation audio‑vidéo.

Seedance 2.0 vs Kling 3.0

Les deux modèles excellent à maintenir la constance des personnages, mais par des voies différentes. Kling 3.0 utilise Omni Mode pour « lier » des personnages (visages, vêtements) et les réutiliser sur plusieurs plans ou scènes. Il crée en quelque sorte une bibliothèque d’assets rappelables via une référence @.

Comparé au système quadri‑modale de Seedance 2.0, la différence tient à ce que vous voulez faire : cloner depuis l’existant, ou conserver des éléments générés. Kling est meilleur pour bâtir un casting réutilisable pour une série, tandis que Seedance est idéal pour « transférer » un style, une ambiance ou un mouvement de caméra d’un clip existant vers un nouveau sujet.

Kling 3.0 offre un contrôle précis du ton et de l’émotion des dialogues générés (ex. « murmuré », « enthousiaste », « sarcastique ») et prend en charge nativement la parole multilingue, avec des résultats impressionnants. Bien que sa synchronisation audio‑vidéo dépasse celle de Veo 3.1 et Sora 2, Seedance 2.0 garde une légère avance.

Conclusion

Les premiers résultats de Seedance 2.0 de ByteDance sont très convaincants et laissent présager un saut en avant pour la génération vidéo par IA. Surtout, la combinaison de ses entrées quadri‑modales et du storyboard multi‑plans automatique pourrait changer la donne pour des cas d’usage allant de la publicité et du prototypage au cinéma et au jeu vidéo.

Cette puissance s’accompagne toutefois de frictions immédiates. La capacité du modèle à cloner des voix à partir d’une seule photo et à générer par inadvertance des figures protégées par le droit d’auteur (comme un sosie de Keanu Reeves non demandé) a déjà poussé ByteDance à suspendre en urgence certaines fonctions de référence « personnes réelles » et à renforcer la vérification d’identité.

Il sera intéressant d’observer la réaction des grands acteurs comme Google et OpenAI à la sortie de Seedance, et de voir si les restrictions d’accès global finiront par s’assouplir, libérant les utilisateurs de leur dépendance vis‑à‑vis de wrappers API tiers. Nous suivons la situation de près et publierons un test complet dès que nous aurons un accès direct pour évaluer nous‑mêmes les capacités du modèle.

Si les concepts qui rendent possibles des outils avancés comme Seedream 2.0 vous intéressent, je vous recommande notre parcours de compétences AI Fundamentals.

FAQ sur Seedance 2.0

Seedance 2.0 est‑il gratuit ?

Non. À ce jour, Seedance 2.0 est disponible via la plateforme « Jimeng » de ByteDance en Chine, qui nécessite un abonnement payant (des paliers à partir d’environ 69 RMB sont rapportés). Les utilisateurs internationaux y accèdent généralement via des agrégateurs ou wrappers d’API tiers, qui appliquent leurs propres tarifs.

Comment accéder à Seedance 2.0 depuis l’étranger ?

L’accès direct à Jimeng requiert souvent un numéro de téléphone chinois et un moyen de paiement local. La plupart des utilisateurs hors de Chine passent actuellement par des sites wrappers d’IA ou des services d’API intégrant le modèle Seedance, bien que non officiels, avec des limites d’usage ou des coûts potentiellement différents. Un accès via la plateforme Dreamina de CapCut (Dreamina) est attendu pour fin février 2026.

Puis‑je cloner une personne ou un style précis dans Seedance 2.0 ?

Oui, mais avec réserves. Vous pouvez téléverser des images de référence pour « cloner » l’apparence d’un personnage ou une vidéo pour copier un mouvement de caméra spécifique. Toutefois, après la génération accidentelle de sosies de célébrités, ByteDance aurait durci les restrictions sur l’usage de références de personnes réelles afin d’éviter les deepfakes et les atteintes au droit d’auteur.

Seedance 2.0 génère‑t‑il du son ?

Oui. À la différence de nombreux concurrents qui génèrent d’abord la vidéo puis ajoutent le son, Seedance 2.0 utilise un transformeur de diffusion à double branche pour générer simultanément les images et la forme d’onde audio. Résultat : une synchronisation plus serrée, avec des effets son (pas, verre qui casse) calés à l’image près sur l’action.

Qu’est‑ce qui différencie Seedance 2.0 de Sora 2 d’OpenAI ?

Alors que Sora 2 met l’accent sur la simulation physique du monde réel et les vidéos longues, Seedance 2.0 privilégie la « vitesse commerciale » et le contrôle réalisateur. Son atout phare est le système de référence quadri‑modale, qui permet de téléverser jusqu’à 12 fichiers (images, vidéos, audio) et de leur assigner des rôles précis (référence personnage, mouvement de caméra, etc.), offrant un contrôle plus direct que l’approche surtout textuelle de Sora.

Rédacteur en chef Data Science chez DataCamp | Je suis passionné par la prévision et le développement à l'aide d'API.