Curso

Este é o “momento DeepSeek” da geração de vídeo? A ByteDance acabou de lançar, quase sem alarde, o modelo de geração de vídeo Seedance 2.0, e os primeiros exemplos criados com ele já estão viralizando.

Neste guia, vou explicar o que é o Seedance, seus principais recursos e como ele funciona por trás das câmeras. Também vou mostrar exemplos do novo modelo em ação e comparar seus pontos fortes e fracos com outros modelos de destaque. Será que ele consegue desafiar o Veo 3.1 do Google, o Sora 2 da OpenAI e o Kling 3.0 da Kuaishou?

O que é o Seedance 2.0?

Seedance 2.0 é o mais novo modelo de IA generativa de texto para vídeo e de imagem para vídeo da ByteDance, lançado em 10 de fevereiro de 2026.

Fonte: Aleena Amir no X

Como a ByteDance não publicou uma nota oficial de lançamento em inglês para o Seedance 2.0, a maior parte das especificações e promessas de recursos disponíveis ao público foi reconstruída a partir de reportagens em chinês sobre o lançamento do Jimeng. Muitas “fichas técnicas” em sites de terceiros parecem repetir as mesmas fontes, em vez de documentação oficial da ByteDance.

Segundo testes da mídia chinesa e documentação preliminar de parceiros, o Seedance 2.0 promete saída de vídeo em 2K com qualidade cinematográfica e excelente consistência de personagens.

Como posso acessar o Seedance 2.0?

Oficialmente, o Seedance 2.0 está disponível no Jimeng, plataforma da ByteDance na China continental, acessível para assinantes (por exemplo, níveis ≥69 RMB, segundo a mídia chinesa). Na prática, o acesso ao Jimeng é focado na China, e verificação de conta e meios de pagamento locais costumam ser pontos de fricção.

A landing page do Seedance 2.0 já está no ar. Porém, o acesso real ainda está restrito: a maioria dos usuários verá a mensagem "Coming Soon" até o lançamento completo, que fontes do setor estimam para cerca de 24 de fevereiro de 2026.

Enquanto isso, o caminho alternativo mais popular entre usuários internacionais é o ChatCut, um app de vídeo com IA de terceiros que integrou diretamente o Seedance 2.0 e oferece acesso global antecipado sem exigir número de celular chinês. No momento, há uma lista de espera para se cadastrar.

Como o Seedance funciona?

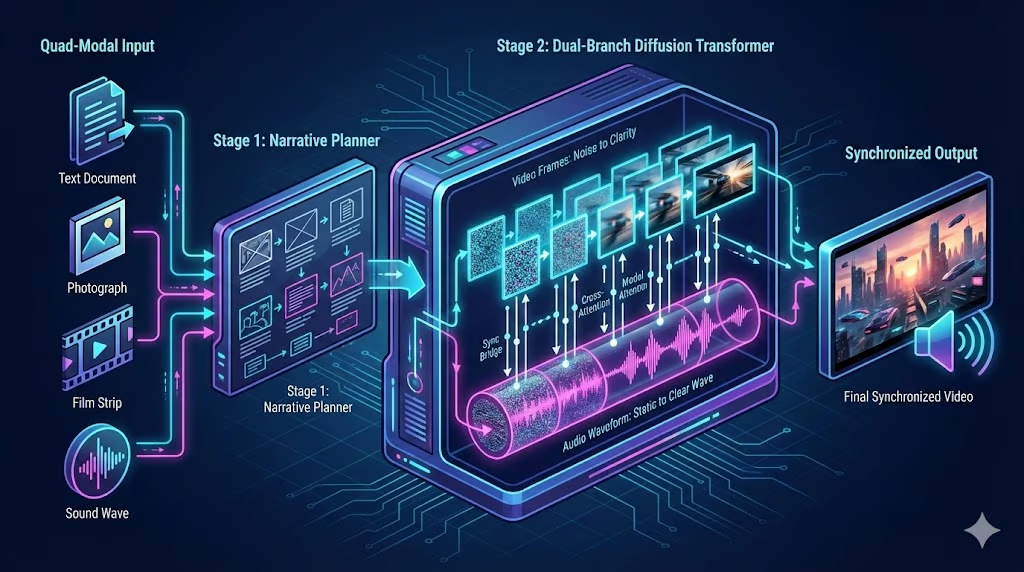

Assim como o Sora 2 e o Veo 3.1, o Seedance 2.0 é um modelo de difusão. Ou seja, ele gera vídeo começando por quadros de ruído estático e os transforma gradualmente, em várias etapas, até revelar uma sequência coerente.

Mas, diferente dos primeiros modelos de texto para vídeo que tratavam o vídeo como um clipe único e mudo, o Seedance 2.0 foi arquitetado como um “diretor multimodal”, capaz de lidar com som, estrutura narrativa e referências visuais complexas em um único passe.

Dirigindo a cena com entradas quadri-modais

No passado, fazer a IA criar exatamente o que você queria exigia “engenharia de prompt”: escrever descrições textuais longas e complexas e torcer para a IA entender. O Seedance 2.0 acaba com esse chute no escuro ao dirigir a cena com um sistema de entrada quadri-modal.

“Quadri-modal” significa que o Seedream pode lidar com entrada de texto, imagem, vídeo e áudio. O codificador quadri-modal não é um funil único, mas um conjunto de codificadores pré-treinados para cada tipo de dado:

- Texto é processado por um codificador baseado em LLM para extrair o significado semântico

- Imagens são codificadas em tokens de recursos visuais (patches)

- Vídeos de referência são codificados em tokens espaço-temporais (patches 3D)

- Áudio é codificado em tokens de forma de onda ou espectrograma

Assim, as quatro entradas brutas são convertidas em uma linguagem unificada de vetores latentes para representar matematicamente os insumos.

Planejamento narrativo com lógica multi‑take

Outra grande frustração com ferramentas antigas era o limite de um único take. Se você pedia uma história, a IA tentava enfiar tudo em uma tomada contínua e sem cortes. Com duração de poucos segundos, isso gerava deformações estranhas ou partes do prompt eram ignoradas.

O Seedance 2.0 resolve isso com um planejador narrativo que aplica lógica multi‑take. Antes de gerar um único pixel, esse planejador age como um artista de storyboard. Ele lê seu prompt e o divide em uma sequência de planos distintos de câmera.

Por exemplo, pode começar com um plano geral da cidade, cortar para um plano médio de uma pessoa e, por fim, um close no rosto, tudo isso sem instruções detalhadas. Depois, ele orquestra a geração desses planos em sequência.

Ele usa dados de consistência compartilhados para garantir que o rosto, as roupas e a iluminação da pessoa permaneçam idênticos em cada corte. O resultado parece uma sequência montada de filme, e não um vídeo cru e alucinado.

Combinando difusão com dois modelos transformer

A maioria dos modelos de vídeo em IA funciona como cinema mudo: geram o vídeo primeiro, e você adiciona o som depois com outra ferramenta. Isso costuma causar “desalinhamento”, quando o som de passos ou de uma porta batendo não coincide com a ação na tela.

O Seedance 2.0 resolve isso com um transformer de difusão de dois ramos, com um transformer dedicado ao vídeo e outro ao áudio.

Pense nisso como um cérebro com dois hemisférios trabalhando em sincronia. Um foca totalmente na geração dos quadros de vídeo, enquanto o outro gera a forma de onda do áudio. Como eles se comunicam o tempo todo durante a criação, o modelo garante que, quando um evento visual acontece (como um vidro quebrando), o som correspondente é gerado no mesmo milissegundo.

Principais recursos do Seedance 2.0

Agora que você já sabe como funciona, vamos ver do que o Seedance 2.0 é capaz. Dois recursos que mais chamam atenção são seu sistema de referência quadri‑modal e o storyboard nativo multi‑take.

Sistema multimodal de referências completo

O Seedream 2.0 permite que você mostre o que quer, e não apenas descreva. Você pode enviar até 12 arquivos (9 imagens, 3 vídeos e 3 áudios) e atribuir papéis específicos usando um sistema de referência com @.

- Precisa de um ator específico? Envie a foto dele e marque como referência de personagem.

- Quer um movimento de câmera específico? Envie um vídeo amostra e marque como referência de movimento.

- Tem um beat definido? Envie a música e marque como referência de ritmo.

O modelo separa e combina essas entradas, permitindo que você “dirija” a cena com ativos concretos, em vez de contar com a sorte.

Para ficar mais claro como isso funciona na prática, aqui vai um exemplo:

Prompt: “Substitua a modelo do vídeo promocional @Video1 por uma modelo ocidental, referenciando a aparência em @Image2. Altere todo o idioma falado para inglês.” (Fonte: SD AI Animation Storyteller no X)

O resultado impressiona. O Seedance seguiu todas as instruções, capturou quase perfeitamente o visual da modelo de referência e ajustou a sincronia labial ao traduzir o áudio para o inglês. Vale notar: o comportamento do reflexo nos óculos foi completamente preservado.

Storyboard multi‑take

O recurso de storyboard multi‑take coloca o Seedance 2.0 no papel de diretor e editor ao mesmo tempo. É assim que funciona:

- O modelo divide automaticamente uma narrativa única em vários planos conectados

- Para cada plano, escolhe o tipo de câmera adequado.

- Por fim, compõe os planos e adiciona transições entre eles.

Prompt: “A cena da grande batalha de Vingadores: Ultimato, mas Thanos interrompe tudo e diz a todos os super-heróis que está arrependido. Todos aceitam imediatamente e começam a ir embora, mas então o Homem-Aranha diz: \"Ah, nem pensar, ele matou uma galera!\" E aí todos voltam correndo e batem nele enquanto ele está no chão.” (Fonte: Christopher Fryant no X)

Um bom exemplo do storyboard em ação. O plano aberto no início, o zoom no Thanos, o tilt em direção ao Thor e o corte seco para o Homem‑Aranha — tudo soa muito coerente e com o clima de Avengers, sem precisar pedir explicitamente nenhum desses movimentos de câmera.

Geração nativa de efeitos sonoros e clonagem de voz

Até pouco tempo, a geração nativa de áudio já seria um superdiferencial; hoje, é quase esperado. Mesmo assim, o Seedance 2.0 não só gera vídeo e áudio sincronizados, como também inclui diálogos multilíngues, sons ambientes e efeitos sonoros ligados à ação.

Um recurso bem legal, viabilizado pelas entradas de áudio, é a clonagem de voz, supostamente multi‑speaker, permitindo até 3 vozes personalizadas por cena (limite de arquivos de áudio). Dá para enviar vozes reais para guiar sotaque, tom e até conversas entre vários personagens.

Já vimos as habilidades de idioma e lip‑sync nos exemplos de tradução; agora, vamos ver como o Seedance cria trilha e efeitos sonoros do zero.

Prompt (usando arquivos de referência): “A mulher em @Image1 caminha até o espelho e olha seu reflexo. Sua pose deve referenciar @Image2. Após um momento de contemplação, ela de repente desaba e começa a gritar. A ação de segurar o espelho, assim como as emoções e expressões faciais durante o desabafo e o grito, devem referenciar totalmente @Video1.” (Fonte: Feyber no X)

O exemplo mostra que o modelo lida com emoções conflitantes na mesma cena, não só visualmente, mas também no áudio.

A música triste no começo reflete bem a expressão da personagem e vira um tom mais de terror quando ela grita com raiva para o espelho. A trilha não interfere no grito nem no som de segurar o espelho; ela complementa a cena.

Visuais cinematográficos em alta resolução

O Seedance suporta saídas até 2K, múltiplas proporções e taxas de 24–60 fps, dependendo da plataforma. Ele privilegia a estética cinematográfica, cuidando de detalhes como:

- Texturas detalhadas

- Iluminação global robusta

- Color grading com cara de filme

Outro foco no desenvolvimento do Seedance 2.0 foi respeitar a física. Esses dois pontos andam juntos, como vemos no próximo exemplo:

Prompt: “Uma sequência de ação cinematográfica intensa, à noite, em uma cidade iluminada por neon; a câmera acompanha um personagem solitário correndo por ruas encharcadas de chuva, enquanto drones da polícia e faróis passam borrados; cortes rápidos entre close dos olhos determinados, botas espirrando poças e planos abertos de carros quase o atropelando; a câmera faz whip‑pan quando ele salta barreiras, desliza sobre capôs e desvia de explosões atrás dele; motion blur intenso e luz dinâmica; sensação de câmera na mão com push‑ins agressivos; contraste dramático, coreografias rápidas, impactos secos e, por fim, um momento em câmera lenta quando ele salta de um terraço para a escuridão, com as luzes da cidade riscando abaixo.” (Fonte: Txori no X)

O resultado parece cena de filme de ação. O movimento de câmera, a iluminação e até a física da água espirrando da poça estão no ponto. O que não bate é o personagem pular de um telhado logo após correr na rua.

Um detalhe curioso: embora o personagem tenha sido descrito apenas como “solitário”, ele acabou saindo um clone do Keanu Reeves.

Considerando o prompt cheio de ação e cenário distópico (“cidade iluminada por neon”, “encharcada de chuva”, “drones da polícia”), dá para entender a associação. Fica a dúvida se a inspiração vem de Matrix, John Wick ou Cyberpunk 2077 (ou um mix dos três).

Quão bom é o Seedance 2.0?

Sinceramente, os vídeos mostrados na apresentação de recursos falam por si. Aqui, quero focar em dois problemas da geração de vídeo que as forças do Seedance 2.0 ajudam a mitigar.

Fim da dependência de “prompts mágicos”

Um grande perrengue da 1ª geração de vídeo com IA era a engenharia de prompt em caixa‑preta: criadores tinham que descobrir “prompts mágicos” e gambiarras de redação para obter resultados usáveis de modelos com compreensão semântica fraca e poucos controles.

É aí que o sistema de referências e o storyboard multi‑take brilham. A combinação de mapear ativos a papéis e um modelo que entende o contexto entre diferentes planos gera resultados impressionantes sem “prompt‑maxxing”. Também evita sobrecarregar o prompt (e o modelo).

Um bom exemplo é o uso de grades 3x3 de imagens. Dadas 9 imagens de referência representando diferentes planos de uma cena, você consegue saídas decentes mesmo sem caprichar no prompt. Veja o que o modelo retornou a partir da grade abaixo como entrada, combinada com um prompt mínimo:

Prompt: “Gerar vídeo a partir do storyboard.” (Fonte: Mr.Iancu no X)

Mais um resultado impressionante. O modelo entende naturalmente o contexto da cena e preenche as lacunas entre os quadros. Um ponto que não faz sentido é que, no meio do vídeo, um dos atacantes parece ficar parado no canto atrás dela por alguns frames.

Outro errinho que (eu achei que) vi foi a mesa estar de pé, o que não daria cobertura à personagem — mas, olhando com atenção no canto inferior esquerdo, dá para ver que o erro já estava na grade de imagens, que foi gerada pelo Nano Banana Pro.

Resolvendo o problema dos “clipes descartáveis”

Em modelos anteriores, gerar vídeo era quase uma loteria para, por acaso, sair o clipe certo — com várias tentativas (caras) descartadas no caminho. O storyboard automático multi‑take ataca isso e decompõe muito bem prompts narrativos em múltiplos planos.

O Seedance 2.0 entrega consistência de identidade e de cena significativamente maior que modelos anteriores. Isso reduz drasticamente artefatos visuais chatos, como drift de personagem, mudanças repentinas de aparência ou flickering que tornavam clipes promissores inutilizáveis.

Prompt: “Um documentário de natureza sobre uma lontra pilotando um avião.” (Fonte: ChinaTechTrend no X)

Quais são as limitações do Seedance 2.0?

Mesmo com todos os pontos fortes, vale olhar algumas limitações do modelo Seedance 2.0.

Cenas complexas e em camadas envolvendo vidro

Relatos indicam que o Seedance 2.0 tem dificuldade com múltiplas camadas em movimento atrás de vidro — algo, de fato, desafiador para qualquer modelo de vídeo (e um caso de borda pouco comum).

No entanto, o único exemplo que encontrei é discutido nesta review no YouTube. Mostra “uma cena típica externa para lanchonete, vibe cyberpunk, olhando através do vidro, personagem dentro, carros passando fora”. A saída parecia em parte muito natural (pingos de chuva no vidro e respiração), mas a cena toda se movia de forma estranha (como se ‘amarrada a um carro’).

Pareceu que uma cena com vidro nos dois lados da personagem, e cenário adicional atrás da segunda camada, foi demais para o Seedream 2.0, que não distinguiu mais entre fundo estático e carros em movimento.

No exemplo anterior dos óculos, a transparência e o reflexo estavam no ponto, mas a) era um caso bem mais simples e b) usava um vídeo de referência que servia de template para o modelo.

Pequenas inconsistências e textos de fundo

Algumas inconsistências são mais consequência de má interpretação do contexto codificado do que de má geração em si. Por exemplo, ao criar um crossover de Game of Thrones com Friends, ele inseriu por engano um personagem de How I Met Your Mother:

Prompt: “O elenco de Friends estrela a sitcom Game of Thrones. Chandler faz o Rei Joffrey. Joey é a Mão.” (Fonte: Gavin Purcell no X)

Assim como no exemplo do Keanu Reeves, dá para imaginar a origem: ambos são sitcoms muito similares, então suas representações vetoriais ficam extremamente próximas.

Embora textos de fundo geralmente sejam legíveis até em cenas com movimentos rápidos (pense no exemplo do Keanu Reeves), às vezes eles ficam um pouco pixelados. Por exemplo, veja os painéis de anúncio neste vídeo de basquete de uma criança pontuando contra o Lebron James que viralizou:

Prompt desconhecido (Fonte: Serge Bulaev no X)

De novo, um resultado bem impressionante: os movimentos dos jogadores são realistas, a câmera mantém o foco na garota driblando, e as sombras e o ruído de fundo correspondem ao que vemos. Infelizmente, o prompt usado não foi compartilhado.

Cenários de performance musical

É difícil cravar o motivo, mas cenas de performance musical, como shows, ainda têm um quê de vale da estranheza. Aqui vai um exemplo de show de K‑pop:

Prompt: “Cena épica de show de K‑pop — palco dramático com luzes, efeitos e energia, sem retratar pessoas reais.” (Fonte: Ankit Patel no X)

Há alguns pontos a notar. Primeiro, o som traz a música (com eco adequado e barulho da plateia). Porém, me soa um pouco “duro”. O movimento dos integrantes também fica um tanto estranho, com a backing vocal à esquerda meio que se fundindo ao palco.

Seedance 2.0 vs concorrentes

Vamos ver como o Seedance 2.0 se compara aos três principais competidores.

|

Categoria de recurso |

Seedance 2.0 |

OpenAI Sora 2 |

Google Veo 3.1 |

Kuaishou Kling 3.0 |

|

Qualidade cinematográfica e resolução |

2K comercial: otimizado para estética digital nítida; ideal para clipes curtos e impactantes. |

Fidelidade de simulação do mundo: foca em coerência de longo prazo (20s) e alta fidelidade. |

Escolha do diretor de fotografia: ciência de cor com cara de filme, HDR e profundidade de campo profissional superiores. |

1080p de alta qualidade: excelente aderência ao prompt, embora com resolução menor que o Seedance. |

|

Realismo de movimento e física |

Priors aprendidos: movimento estável de personagens derivado de vídeos de referência. |

Líder em física: melhor em gravidade, fluidos, colisões e permanência de objetos (até fora de quadro). |

Domínio de câmera: se destaca em movimentos cinematográficos realistas (pans, dollies) e consistência temporal (60s). |

Mestre do movimento: lida com ações humanas complexas (comer, lutar) e interações físicas (gangorras). |

|

Controle do diretor e entradas |

Referência quadri‑modal: sistema exclusivo para atribuir papéis a Texto, Foto, Vídeo e Áudio. |

Guiado por texto: prompts sobretudo textuais, com suporte limitado a imagens; sem atribuição multi‑arquivo. |

Edição mascarada: controle preciso via máscaras e iteração por texto. |

Omni Mode e Brush: recurso “Motion Brush” para trajetórias e amarra múltiplos personagens/elementos. |

|

Capacidades de áudio |

Sincronia de dois ramos: gera áudio e vídeo simultaneamente com sincronização precisa ao frame. |

Pós‑processo: gera vídeo primeiro e adiciona áudio depois; sincronia menos justa. |

Ferramentas externas: depende de tech separada (ex.: AudioSet), com sincronização menos precisa. |

Áudio nativo: gera áudio com tons e idiomas distintos de personagens. |

|

Velocidade de produção e acesso |

Alto throughput: <60s para clipes de 5s. Disponibilidade oficial limitada à China. |

Premium/lento: computacionalmente pesado e mais lento; posicionado como pesquisa/premium. |

Restrito: geração mais lenta (minutos); acesso limitado a testers/parceiros de confiança. |

Acessível: plataforma web rápida com melhor acesso global, embora ~30% mais lenta que o Seedance. |

Seedance 2.0 vs Sora 2

Um dos diferenciais do Sora 2 é ser arquitetado como um “simulador de realidade” com compreensão física profunda, mandando bem em gravidade, dinâmica de fluidos e permanência de objetos. Embora isso não seja o foco principal do Seedance 2.0, os primeiros resultados mostram que ele não fica muito atrás do Sora 2 e consegue competir.

Já o sistema de referência quadri‑modal do Seedance é algo que falta no Sora, que funciona basicamente como texto para vídeo e imagem para vídeo. Assim, clonar estilos ou personagens no Sora é bem mais estático, se comparado à capacidade do Seedance de copiar o movimento de cenas inteiras ou clonar vozes.

Embora o Sora 2 gere vídeos de alta qualidade, ele trata o áudio como um processo separado e secundário. A arquitetura de transformer de dois ramos do Seedance 2.0 é fundamentalmente diferente, gerando vídeo e áudio simultaneamente em um único passe. Isso permite uma sincronização mais justa, precisa ao frame (como o impacto do passo exatamente quando o pé toca o chão), do que no Veo.

Seedance 2.0 vs Google Veo 3.1

Veo 3.1 dá controle preciso por meio do Masked Editing, que permite selecionar e modificar regiões específicas do vídeo (por exemplo, trocar a roupa de um personagem) sem mexer no resto. Também oferece comandos específicos de câmera (pan, tilt, zoom) para emular técnicas clássicas de filmagem.

O Seedance 2.0 segue outra abordagem com o sistema de referência quadri‑modal. Em vez de máscaras, usuários podem clonar estilos ou movimentos enviando vídeos e imagens de referência. Se o Veo é uma suíte de edição digital, o Seedance é um motor de “transferência de estilo” turbinado, ainda mais indicado para replicar um clima ou movimento específico.

Assim como o Sora 2, o Veo 3.1 não consegue competir com o Seedance 2.0 em sincronização de áudio e vídeo.

Seedance 2.0 vs Kling 3.0

Ambos se destacam em manter personagens consistentes, mas por caminhos diferentes. O Kling 3.0 usa o Omni Mode para “amarrar” personagens específicos (rostos, roupas) e reutilizá‑los em múltiplos planos ou cenas. Na prática, cria uma biblioteca de ativos que você chama com @.

Comparando com o sistema quadri‑modal do Seedance 2.0, a diferença está em clonar algo externo versus manter intactos os artefatos gerados. Kling é melhor para montar um elenco reutilizável para uma série; o Seedance é melhor para “transferir estilo” — um clima específico ou movimento de câmera — de um clipe existente para um novo assunto.

O Kling 3.0 oferece controle preciso sobre tom e emoção do diálogo gerado (ex.: “sussurrando”, “empolgado”, “sarcástico”) e suporta fala multilíngue nativamente, com resultados impressionantes. Embora sua sincronização áudio‑vídeo supere Veo 3.1 e Sora 2, o Seedance 2.0 ainda leva uma ligeira vantagem.

Considerações finais

Os primeiros resultados do Seedance 2.0 da ByteDance são muito impressionantes e indicam um salto na geração de vídeo com IA. Especialmente a combinação de entrada quadri‑modal com storyboard automático multi‑take tem potencial para mudar o jogo em casos que vão de publicidade e prototipagem a cinema e games.

Mas esse poder traz fricções imediatas. A capacidade do modelo de clonar vozes a partir de uma única foto e de gerar, sem querer, figuras protegidas por direitos (como o sósia não solicitado do Keanu Reeves) já forçou a ByteDance a suspender com urgência recursos específicos de referência a “pessoas reais” e a apertar a verificação de identidade.

Vai ser interessante ver como Google e OpenAI reagem ao lançamento do Seedance e se as restrições de acesso global vão cair com o tempo, livrando os usuários da dependência de wrappers de APIs de terceiros. Estamos acompanhando de perto e vamos trazer um review hands‑on completo assim que tivermos acesso direto para testar as capacidades do modelo.

Se você se interessa pelos conceitos por trás de ferramentas avançadas como o Seedream 2.0, recomendamos se inscrever na nossa trilha de habilidades AI Fundamentals.

Seedance 2.0: perguntas frequentes

O Seedance 2.0 é gratuito?

Não. Atualmente, o Seedance 2.0 está disponível via plataforma "Jimeng" da ByteDance na China, que exige assinatura paga (há relatos de planos a partir de ~69 RMB). Usuários internacionais costumam acessá-lo por agregadores de API ou wrappers de terceiros, com modelos de preço próprios.

Como acessar o Seedance 2.0 fora da China?

O acesso direto ao Jimeng geralmente exige número de celular e método de pagamento chineses. A maioria dos usuários fora da China hoje recorre a sites wrapper de IA ou serviços de API que integram o Seedance, embora sejam não oficiais e possam ter limites de uso ou custos diferentes. Espera-se acesso via plataforma Dreamina do CapCut (Dreamina) no fim de fevereiro de 2026.

Posso clonar uma pessoa ou estilo específico no Seedance 2.0?

Sim, mas com ressalvas. Você pode enviar imagens de referência para “clonar” a aparência de um personagem ou um vídeo para copiar um movimento de câmera. Porém, após a geração acidental de sósias de celebridades, a ByteDance teria endurecido as restrições ao uso de referências de pessoas reais para evitar deepfakes e infrações de direitos autorais.

O Seedance 2.0 gera som?

Sim. Diferente de muitos concorrentes que geram o vídeo primeiro e adicionam som depois, o Seedance 2.0 usa um Dual-Branch Diffusion Transformer para gerar quadros de vídeo e formas de onda de áudio simultaneamente. Isso resulta em sincronização mais justa, com efeitos sonoros (como passos ou vidro quebrando) precisos ao frame da ação visual.

O que diferencia o Seedance 2.0 do Sora 2 da OpenAI?

Enquanto o Sora 2 prioriza simular física do mundo real e vídeos longos, o Seedance 2.0 privilegia “velocidade comercial” e controle do diretor. Seu destaque é o sistema de referência quadri‑modal, que permite enviar até 12 arquivos de imagem, vídeo e áudio e atribuir papéis precisos (como referência de personagem ou movimento de câmera), oferecendo mais controle direto do que os prompts majoritariamente textuais do Sora.

Editor de Ciência de Dados @ DataCamp | Fazer previsões e construir com APIs é a minha paixão.