Lernpfad

Perplexity Computer ist ein Cloud-Agent, dem du eine Aufgabe zuweist und ihn dann arbeiten lässt. Seit dem Launch im Februar 2026 haben Updates geändert, wer Zugriff hat, wie Credits abgerechnet werden und wie viel Kontrolle du vor dem Start einer Ausführung bekommst. Viele frühe Reviews sind damit überholt.

Ich habe einen parallelen Research-Workflow über acht KI-Coding-Tools getestet – mit festem Prompt und sichtbarem Credit-Kontingent. Das Ergebnis reichte aus, um Preisgestaltung, Limits und die passende Tarifwahl im Zusammenhang zu bewerten.

Was ist Perplexity Computer und wie funktioniert es?

Computer ist Perplexitys Cloud-Agent-Produkt. Es ist kein Gerät und nicht dasselbe wie Perplexity Ask. Ask liefert Antworten. Computer führt Aktionen aus: Es durchsucht das Web, erstellt Dokumente und Folien, führt Code in einer Sandbox aus, nutzt Hunderte von Konnektoren und verknüpft diese Schritte zu einem fertigen Ergebnis.

Daneben gibt es ein separates Produkt namens Personal Computer, das lokal auf einem Mac läuft. Es wurde Mitte April 2026 eingeführt und wird von Max auf Pro ausgerollt. Diese Rezension bezieht sich auf den Cloud-Computer.

Task Composer von Computer im Perplexity-Web. Bild: Autor.

Die Architektur ist wichtig, weil sie die Kosten bestimmt. Computer entwirft einen Plan und leitet Schritte an spezialisierte Sub-Agenten in einer isolierten Cloud-Sandbox weiter. Seit dem Update vom 4. Mai 2026 ist GPT-5.5 der Standard-Orchestrator für Pro- und Max-Abos; Verweise aus der Launch-Phase auf Claude Opus 4.6 als Standard sind veraltet.

Bei Research-Aufgaben bezeichnet „parallele Ausführung“, wie Computer sucht und Arbeit aufteilt. Ein einzelner Research-Sub-Agent kann sieben Sucharten gleichzeitig ausführen: Web, wissenschaftlich, Personen, Bild, Video, Shopping und Social – und liest vollständige Quellseiten statt Snippets. Mehrere Sub-Agenten können zudem innerhalb einer Aufgabe laufen. Für Max-Nutzer ergänzt der Model Council eine separate Modell-Gegenprüfung für Fragen, bei denen Uneinigkeit zählt.

Zwei spätere Ergänzungen sind für diesen Test relevant: Planvorschau vor langen Tasks und Live-Kostentracking während der Ausführung. Diese Steuerungen erlauben es, den Lauf zu überwachen, statt die Kosten erst im Nachhinein zu bewerten.

Normale Perplexity-Ask-Suchen und Deep Research verbrauchen keine Credits. Computer-Tasks schon.

Perplexity-Computer-Preise: Pro, Max und wie Credits funktionieren

Die Abrechnung besteht aus zwei Teilen: einem festen Abo plus einem separaten Credit-Guthaben, das der Agent während des Laufs abbaut. Lies beides zusammen, sonst ist die tatsächliche Kostenlage schwer einzuschätzen.

Hier sind die aktuellen Preise für Privat- und Unternehmenskunden Anfang Mai 2026. Prüfe die Zahlen am Tag der Anmeldung, da Preise und Credit-Regeln je nach Region, Tarif oder Aktion variieren können.

|

Tarif |

Monatspreis |

Computer-Zugriff |

Inklusive Monats-Credits |

|

Free |

$0 |

Nein |

Keine |

|

Pro |

$20 im Monat oder $200 im Jahr |

Ja, seit 13. März 2026 |

Keine enthalten; Credits müssen gekauft werden |

|

Max |

$200 im Monat oder $2.000 im Jahr |

Ja |

10.000 |

|

Enterprise Pro |

$40 pro Platz und Monat |

Ja |

500 pro Platz |

|

Enterprise Max |

$325 pro Platz und Monat |

Ja |

15.000 pro Platz |

Zwei Punkte werden oft übersehen: Pro bietet zwar Zugriff, aber keine monatlichen Computer-Credits – Nutzer brauchen also gekaufte Credits oder Auto-Aufladung. Max enthält 10.000 Monats-Credits plus derzeit einmalige Bonus-Credits für zahlende Pro- und Max-Neuanmeldungen, siehe offizielle Hilfe-Seite zu Credits. Behandle Boni als temporär, da sie sich ändern und auslaufen können.

Die Credit-Kosten variieren je nach Aufgabe; Perplexity veröffentlicht keine Pro-Task-Tabelle. Einfache Jobs kosten Dutzende Credits; researchlastige Aufgaben gehen in die Hunderte oder Tausende; gescheiterte Coding-Schleifen überschritten bereits 10.000. Auto-Aufladung ist standardmäßig aus, Monats-Credits verfallen, und aktive Tasks pausieren, wenn dir die Credits ausgehen.

Parallele Ausführung testen: Ein echter Research-Workflow

Hier ist der echte Test: Ich bat Computer, acht KI-Coding-Tools zu recherchieren, für jedes dieselben Felder zu sammeln, Widersprüche zu markieren und die Ergebnisse in eine Vergleichstabelle plus ein kurzes Memo zu überführen. Der Fall testet parallelen Research, ohne in offene Coding-Arbeit abzugleiten, bei der sich Credits schwerer steuern lassen.

Vor dem Prompt müssen ein paar Voraussetzungen stimmen.

Voraussetzungen und Konto-Setup

Der Test lief auf Max wegen des Credit-Kontingents. Wie erwähnt können Pro-Nutzer denselben Workflow mit gekauften Credits fahren. Für reine Research-Aufgaben sind keine speziellen Konnektoren nötig. Du brauchst:

- Ein aktives Perplexity-Abo mit Computer-Zugriff, also Pro oder Max

- Ein Credit-Guthaben, das den Lauf abdeckt – idealerweise mindestens 1.500 Credits als Puffer für Iterationen

- Eine klare Zielliste, die vor dem Start feststeht, statt den Umfang von Computer interpretieren zu lassen

Das Computer-Panel öffnet sich auf dem Web-Home, im Computer-Tab auf iOS und in der Perplexity-Desktop-App auf dem Mac.

So schreibst du einen Prompt, der parallele Ausführung triggert

Prompt-Design ist entscheidend, weil Computer deine Anweisungen in Sub-Agentenarbeit übersetzt. Ein vager Prompt erzeugt einen vagen Lauf. Dieser hier fixiert Ziele, Felder, Zitierregel, Memo-Zielgruppe und Haltepunkt.

Research the following 8 AI coding tools in parallel: GitHub Copilot, Cursor,

Claude Code, Windsurf, Aider, Continue.dev, Tabnine, and Cody.

For each tool, collect the same fields:

Pricing for individual paid plansCore features, with a focus on agent behaviorMain use casesTwo main limitationsOne notable update from the past 90 daysA primary source link for every important claim

Then:

Build a single normalized comparison tableFlag any field where two of your sources contradict each otherWrite a 200-word recommendation memo for a senior backend engineer who already pays for one AI coding tool and is considering whether to switch

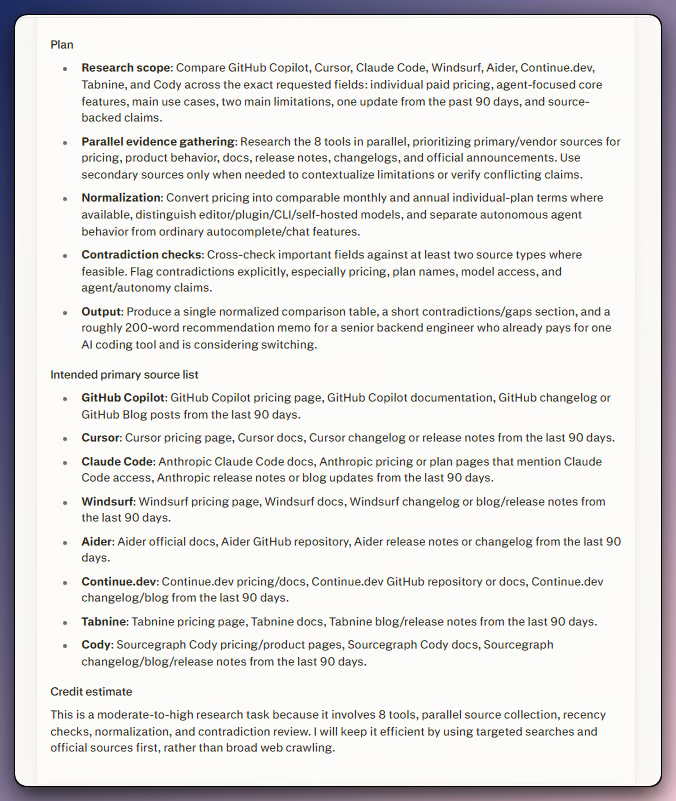

Before producing the final memo, show the plan, the list of sources you intend to cite, and your credit estimate, then wait for my approval.Zwei Designentscheidungen sind am wichtigsten: Die Planvorschau erlaubt es, den Umfang vor dem Credit-Verbrauch zu schärfen. Die Zeile „Widersprüche markieren“ zwingt Computer, Uneinigkeiten sichtbar zu machen statt sie in einer Antwort zu glätten.

Workflow mit Planvorschau und Live-Credits ausführen

Nach dem Absenden des Prompts stoppte Computer bei einem schriftlichen Plan mit den acht Ziel-Tools, den beabsichtigten Datenquellen, der Arbeitsreihenfolge und einer groben Credit-Schätzung. Mit der Freigabe startete die parallele Research-Phase, und der Live-Credit-Zähler im Thread begann zu steigen. Dieser Zähler, eingeführt im Update vom 27. März 2026, war die Zahl, die ich am genauesten beobachtete.

Planvorschau vor dem Start. Bild: Autor.

Sub-Agenten liefen über alle acht Tools parallel. Das Aktivitäts-Panel zeigte Fortschrittszeilen mit kurzen Hinweisen, welche Sites gelesen wurden. Ein Sub-Agent hielt an, um zu fragen, ob die Open-Source-CLI eines Anbieters als separates Produkt zählen soll. Solche Unterbrechungen sind wichtig, weil frühe Reviews Computer als Black Box beschrieben. Seit dem Update vom 17. April 2026 kannst du einzelne Sub-Agenten stoppen oder während des Tasks eine Folgeanweisung geben.

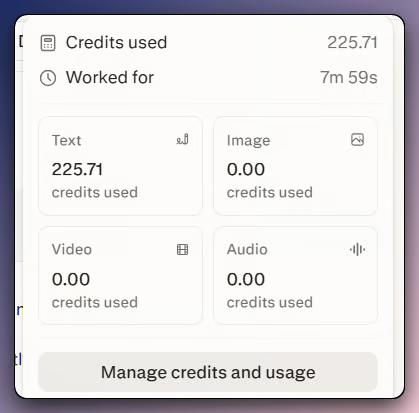

Der komplette Lauf dauerte 7 Minuten 59 Sekunden und verbrauchte 225,71 Credits. Diese Zahl wird bei dir abweichen. Agent-Läufe sind nicht deterministisch: Derselbe Prompt erzeugt eine andere Zerlegung, eine andere Modellzuweisung und ein leicht anderes Ergebnis. Wenn du für ein Video oder eine Demo aufzeichnest, mach vorab einen Probelauf.

Ausgabe prüfen: Genauigkeit und Nachbearbeitungszeit

Die Ausgabe war eine Markdown-Vergleichstabelle für alle acht Tools über die gewünschten Felder, mit Inline-Zitaten in den Zellen. Außerdem gab es eine Tabelle zu Widersprüchen und Lücken sowie ein kurzes Empfehlungsschreiben. Seit dem Update vom 27. März entwirft Computer standardmäßig in Markdown, mit PDF- und DOCX-Export auf Abruf.

Ich habe die Ausgabe gegen eine Checkliste bewertet, die ich vor dem Lauf erstellt hatte.

|

Kategorie |

Urteil |

Hinweise |

|

Genauigkeit bei harten Fakten |

Gemischt |

Einige Preis- und Feature-Aussagen brauchten Abgleich mit den zitierten Primärquellen |

|

Quellenqualität |

Bestanden |

Zitiert wurden Primärdokumente und Preisseiten, keine Aggregator-Blogposts |

|

Struktur |

Bestanden |

Normierte Tabelle musste nicht neu aufgebaut werden; Spaltenreihenfolge stimmte mit dem Prompt überein |

|

Umgang mit Konflikten |

Bestanden |

Markierte Felder mit Quellwidersprüchen, inklusive Beschreibung der Abweichung |

|

Nachbearbeitungszeit |

Gemischt |

Rund 30 Minuten Editing, fast alles am Empfehlungsschreiben |

|

Credit-Verbrauch |

Gemischt |

225,71 Credits für den Lauf, vorab aber weiterhin schwer zu schätzen |

Die Nachbearbeitung fiel klar aus: Die Tabelle war fast veröffentlichungsreif. Das Empfehlungsschreiben hingegen enthielt Absicherungsformulierungen und ein paar Sätze, die nicht zur Evidenz in der Tabelle passten. Dieses Memo – nicht die Daten – braucht den sorgfältigen menschlichen Feinschliff. Behandle die Ausgabe wie den ersten Entwurf eines Junior-Analysten: hilfreich, größtenteils richtig und einen gründlichen Durchgang wert, bevor sie rausgeht.

Wo Perplexity Computer punktet

Das Ergebnis deckt sich mit Berichten anderer Tester seit dem Launch. Der Use Case ist fokussiert.

- Paralleler Research mit normiertem Output. Sieben gleichzeitige Sucharten und das Lesen kompletter Seiten, verpackt als strukturierte Ausgabe – hier fiel im Test am wenigsten Nacharbeit an.

- Kostentransparenz und Kontrolle während des Laufs. Im Test reichte das, um den Lauf zu steuern, ohne den gesamten Prompt zu wiederholen.

- Kontextkompression und Modell-Routing. Der Agent hält einen konsistenten Thread-Zustand über lange Tasks, ohne dass du Routing-Logik schreibst oder eine Konnektor-Verdrahtung pflegen musst.

- Output-Portabilität. Computer entwirft in Markdown und exportiert bei Bedarf PDF oder DOCX.

Ich würde die Aussage nicht über Research und Synthese hinaus ausdehnen. Beim Coding wäre ich zurückhaltend.

Perplexity-Computer-Grenzen: Wo es hakt

Einige Einschränkungen sind real, und manche haben sich seit dem Launch verschoben. Diese waren im Test am relevantesten.

Die Zuverlässigkeit von Konnektoren ist uneinheitlich und ändert sich schnell. Frühe Tests 2026 fanden ablaufende Vercel-OAuths, flache Ahrefs-Daten und GitHub-Workarounds mit manuellem Personal Access Token. Das Update vom 27. März brachte einen Vercel-Konnektor, einen verbesserten Box-Konnektor und einen allgemeinen Hinweis zur Konnektor-Performance. Das beweist nicht, dass ältere Probleme behoben sind. Teste jeden kritischen Konnektor zuerst in einer risikoarmen Aufgabe.

Credit-Verbrauch nach dem Testlauf. Bild: Autor.

Coding-Workflows bergen das höchste Kostenrisiko. Cloud-Computer hat weiterhin keine Live-Vorschau, kein Hot Reload und nur begrenzte Einblicke während des Laufs. Das oben erwähnte Mac-Produkt bringt lokalen Zugriff, und *.pplx.app Publishing liefert etwas Prüfbares vor dem Go-live – aber beides macht aus dem Cloud-Computer noch keine enge Coding-Schleife.

Der Credit-Verbrauch bleibt vor Start schwer vorherzusagen. Die im Test genutzten Steuerungen reduzieren das Rätselraten während der Ausführung, aber breite Tasks mit vielen Sub-Agenten schwanken am stärksten.

Reproduzierbarkeit ist eingeschränkt. Zwei Läufe mit demselben Prompt erzeugen unterschiedliche Sub-Agenten-Pläne und leicht andere Ergebnisse. Auch die Credits variieren – mach vor jeder aufgezeichneten Demo einen Probelauf.

Datenschutzeinstellungen verdienen Beachtung für regulierte Teams oder sensible Workflows. Enterprise-Konten sind standardmäßig vom Training ausgeschlossen. Verbraucher mit Pro und Max müssen in den Kontoeinstellungen aktiv widersprechen.

Tarifempfehlung nach Nutzertyp

Die Antwort hängt davon ab, welche Arbeit du vergibst, wie oft du es nutzt, mit welchem Tarif du startest und wie diszipliniert du deine Credit-Limits setzt.

Hier die Aufschlüsselung nach Nutzertyp.

|

Nutzertyp |

Empfehlung |

Begründung |

|

Analysten und Researcher |

Max bei häufiger Nutzung |

Paralleler Research ist der Hauptfall; die enthaltenen Monats-Credits decken Regelbetrieb |

|

Technische Redakteure |

Pro testen, mit Vorsicht |

Begrenzte Research- und Synthese-Aufgaben passen besser als offene Arbeiten |

|

Developer mit Produktions-Apps |

Hohes Risiko in jedem Tarif |

Die Coding-Feedbackschleife ist noch indirekt |

|

Gelegenheitsnutzer |

Schwer zu rechtfertigen bei Max |

Die $200 monatlich rechnen sich nur mit echtem Workflow-Volumen |

|

Teams in regulierten Branchen |

Enterprise Pro oder Max prüfen |

Bringt Audit-Logs, Trainingsausschluss, Netzwerk-Firewall und Admin-Konnektorsteuerung |

|

Content-Creator und Strategen |

Zuerst Pro testen |

Wettbewerbsrecherchen und strukturierte Reports brauchen weniger Nacharbeit |

Wenn du nur einmal testen willst, ist Pro mit einem kleinen Credit-Kauf der risikoärmere Einstieg. Wenn du mehrmals pro Woche begrenzte Research-Aufgaben fährst, bietet Max einen festen monatlichen Credit-Pool.

Regeln für begrenzte Computer-Workflows

Diese Regeln ergeben sich aus den Testläufen.

Setze vor jeder Aufgabe ein monatliches Ausgabenlimit; das Standardlimit von $200 für frühe Läufe zu senken, begrenzt den Schaden, falls ein Task entgleist. Für alles, wofür du keinen Agenten brauchst, nutze Perplexity Ask. Verlange eine Planvorschau und gib sie vor dem Start frei oder korrigiere sie.

Halte Prompts eng, fixiere die Zielliste und fordere Zitate für jede wichtige Aussage. Beobachte bei langen Läufen denselben Kosten-Zähler wie im Test. Wenn er schneller steigt als geplant, stoppe den Lauf und frage Computer, wo die Arbeit hängt. In meinen Läufen brauchte das Empfehlungsschreiben mehr Prüfung als die Tabelle. Wenn du aufzeichnest, nutze ein abgeschottetes Konto mit bereinigten Konnektoren; echte Kontodaten landen sonst leicht in Screenshots.

Fazit

Computer funktioniert am besten, wenn die Aufgabe klar umrissen ist: feste Liste, Schema, Quellenregeln und ein Stoppunkt. Offen gelassen, fühlt es sich schnell teuer an.

In meinem Test brauchte die Tabelle weniger Editing als das Memo, und die laufenden Kosten waren wichtiger als erwartet. Für wiederkehrenden, begrenzten Research ist Max beim Credit-Setup einfacher. Fürs lockere Ausprobieren ist Pro plus kleiner Credit-Kauf der Weg mit weniger Bindung. Beim Coding wäre ich weiterhin vorsichtig.

Mehr Hintergrund zum Agenten-Muster findest du in unserem Kurs Developing LLM Applications with LangChain – dort geht es um Chains, Tools und Agents in Python.

Ich bin Dateningenieur und Community-Builder und arbeite mit Datenpipelines, Cloud- und KI-Tools. Außerdem schreibe ich praktische, super nützliche Tutorials für DataCamp und angehende Entwickler.

FAQs

Können Pro-Nutzer Perplexity Computer ohne zusätzliche Credits nutzen?

Nur, wenn noch Bonus-Credits vorhanden sind. Die sicherere Kontrolle ist nicht die Tarifseite, sondern die Credits-Seite in deinem Konto vor dem Start einer Aufgabe. Ist das Guthaben niedrig, halte den ersten Lauf eng und deaktiviere die Auto-Aufladung, bis du weißt, was eine typische Aufgabe in deinem Use Case kostet.

Wie viele Credits kostet eine typische Research-Aufgabe?

Eine Zahl, die ich als typisch angeben würde, gibt es nicht. Besser ist ein kleiner Probelauf: weniger Ziele, kein finales Memo und harter Stopp nach der Vergleichstabelle. So bekommst du eine Credit-Spanne, bevor du dich auf den kompletten Workflow festlegst.

Was ist der Unterschied zwischen Perplexity Computer und Personal Computer?

Computer nutzt du, wenn die Arbeit in der Cloud-Sandbox von Perplexity stattfinden kann. Personal Computer ist wichtig, wenn die Aufgabe auf Dateien, Apps oder Browsersessions auf deinem Mac angewiesen ist. Wenn du Windows oder Linux nutzt, betrachte Personal Computer vorerst als nicht verfügbar.

Was passiert, wenn Computer mitten in der Aufgabe keine Credits mehr hat?

Die Aufgabe pausiert – besser, als die Arbeit zu verlieren, aber es kann deinen Flow stören. Bevor du Credits nachlädst, lies die letzten Agent-Updates und entscheide, ob der Task noch auf Kurs ist. Wenn er in eine Schleife geraten ist, verlängern zusätzliche Credits nur die Schleife.

Kann ich Computer-Rechercheergebnisse ungeprüft übernehmen?

Nein. Beginne mit den Zellen, die am schnellsten veralten: Preise, Tariflimits, Launch-Daten und Angaben zu „kürzlichen Updates“. Diese würde ich prüfen, bevor ich am Stil feile – ein sauberes Memo mit einem veralteten Preis ist trotzdem falsch.