Cours

Chaque histoire a un point de départ, et pour l’analyste ou le data scientist, ce point de départ est souvent la régression linéaire simple. En effet, la régression linéaire simple est sans doute le modèle le plus fondamental. Si vous souhaitez sérieusement devenir analyste de données ou data scientist, la régression linéaire simple (et les régressions en général) est un incontournable.

Si la régression mérite d’être apprise, ce n’est pas seulement parce qu’elle est précieuse pour répondre à des questions essentielles dans pratiquement tous les domaines, mais aussi parce qu’elle ouvre la voie à une compréhension plus fine d’une multitude de sujets : tests d’hypothèses, inférence causale, prévision, etc. Suivez dès aujourd’hui notre cours Introduction to Regression in R et notre cours Introduction to Regression with statsmodels in Python.

Qu’est-ce que la régression linéaire simple ?

La régression linéaire simple est une régression linéaire avec une variable indépendante, aussi appelée variable explicative, et une variable dépendante, aussi appelée variable réponse. Dans la régression linéaire simple, la variable dépendante est continue.

Estimateur des moindres carrés ordinaires

La façon la plus courante de réaliser une régression linéaire simple est l’estimation par les moindres carrés ordinaires (MCO, OLS en anglais). Comme OLS est de loin la méthode la plus utilisée, la mention « moindres carrés ordinaires » est souvent implicite quand on parle de régression linéaire simple.

Les moindres carrés ordinaires consistent à minimiser la somme des carrés des écarts entre les valeurs observées (les points de données réels) et les valeurs prédites par la droite de régression. Ces écarts sont appelés résidus, et les mettre au carré garantit que les résidus positifs et négatifs sont traités de la même manière.

Comment la régression linéaire simple est utilisée

La régression linéaire simple aide à faire des prédictions et à comprendre les relations entre une variable indépendante et une variable dépendante. Par exemple, vous pourriez vouloir savoir comment la hauteur d’un arbre (variable indépendante) influe sur son nombre de feuilles (variable dépendante). En collectant des données et en ajustant un modèle de régression linéaire simple, vous pourriez prédire le nombre de feuilles en fonction de la hauteur de l’arbre. C’est la partie « prédiction ». Mais cette approche révèle aussi de combien le nombre de feuilles varie, en moyenne, lorsque l’arbre grandit, ce qui illustre l’usage de la régression linéaire simple pour comprendre les relations.

Équation de la régression linéaire simple

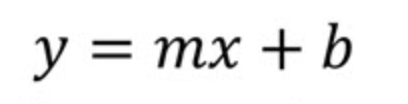

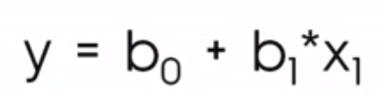

Regardons l’équation de la régression linéaire simple. Commençons par la forme pente–ordonnée à l’origine d’une droite, telle qu’on la voit en géométrie ou en algèbre. Autrement dit, revenons au point de départ.

Ici

- m est la pente de la droite

- b est l’ordonnée à l’origine

Dans le contexte de la data science, vous verrez plus souvent cette équation :

Où

- b0 est l’ordonnée à l’origine

- b1 est la pente

La notation avec b0 et b1 indique que nous sommes dans une situation de prédiction de y, d’où l’écriture ŷ, ou y-chapeau, puisque nous ne nous attendons pas à ce que la droite de régression passe par tous les points.

La visualisation suivante montre la différence conceptuelle entre la forme pente–ordonnée à l’origine à gauche et l’équation de régression à droite. En algèbre linéaire, on dirait que le système d’équations linéaires est surdéterminé : il y a plus d’équations (une trentaine) que d’inconnues (deux), on ne s’attend donc pas à trouver une solution exacte.

Forme pente–ordonnée à l’origine vs. équation de régression linéaire simple. Image de l’auteur

Forme pente–ordonnée à l’origine vs. équation de régression linéaire simple. Image de l’auteur

Coefficients du modèle de régression linéaire simple

Si nous utilisions uniquement l’équation pente–ordonnée à l’origine, nous trouverions les valeurs de m (pente) et b (ordonnée à l’origine) en calculant d’abord la pente comme « élévation sur course » (rise over run), c’est-à-dire la variation de y sur la variation de x entre deux points de la droite. Ensuite, une fois la pente trouvée, nous obtiendrions l’ordonnée à l’origine b en substituant les coordonnées d’un point de la droite dans l’équation et en résolvant en b. Cette dernière étape donne le point où la droite coupe l’axe des ordonnées.

Cela ne fonctionne pas en régression, car aucune droite ne passe par tous les points ; c’est pour cela que nous cherchons plutôt la meilleure droite d’ajustement. Heureusement, il existe des formules fermées élégantes pour trouver la pente et l’ordonnée à l’origine.

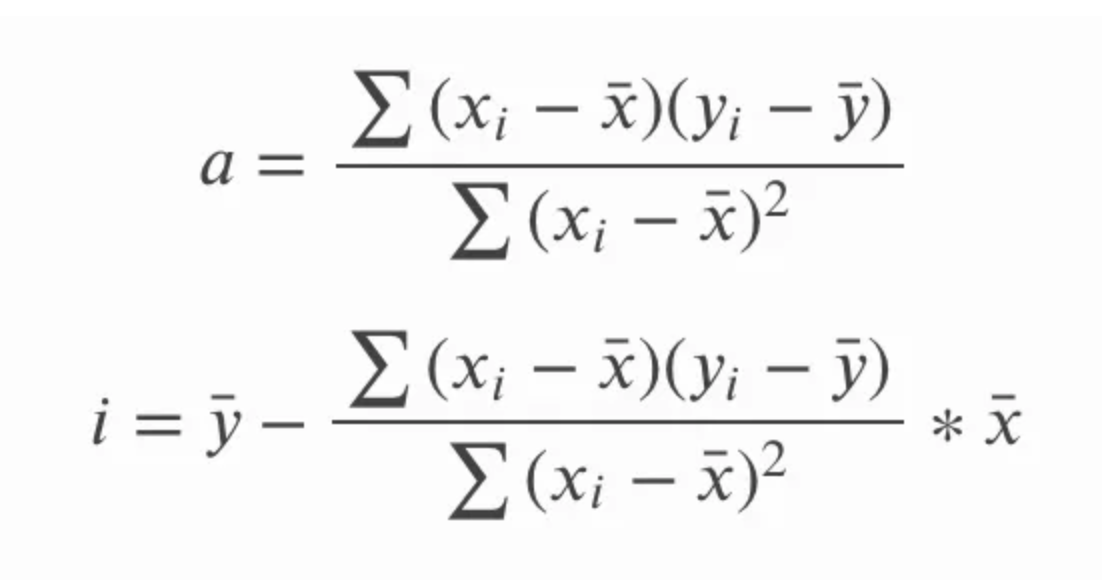

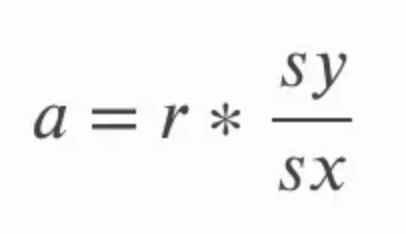

On peut calculer la pente en multipliant la corrélation r par le quotient de l’écart-type de y sur l’écart-type de x. Cela a du sens intuitivement, car on reconvertit en quelque sorte le coefficient de corrélation dans l’unité des variables d’origine. Dans l’équation ci-dessous, a désigne la pente, et sy et sx renvoient respectivement aux écarts-types de y et de x.

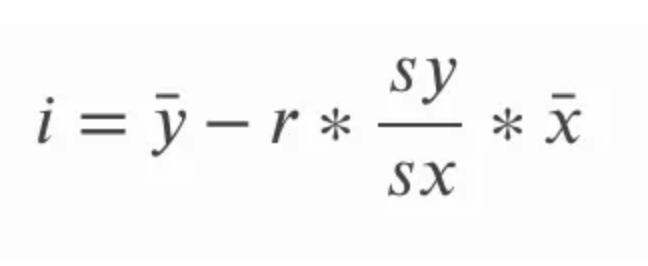

L’ordonnée à l’origine de la meilleure droite d’ajustement en régression linéaire simple se calcule une fois la pente connue. On soustrait le produit de la pente et de la moyenne de x à la moyenne de y. Dans l’équation ci-dessous, i désigne l’ordonnée à l’origine, et la barre au-dessus des valeurs x et y renvoie à leur moyenne ; on parle souvent de x-barre et y-barre.

Pour être complet, examinons des écritures alternatives de ces équations. Rappelez-vous que l’écart-type est la racine carrée de la variance ; au lieu de parler de l’écart-type de y et de x, on pourrait parler de la racine carrée de la variance de y et de x. La variance, rappelons-le, est la moyenne de la somme des carrés.

Dans l’équation de la pente ci-dessus, a, on pourrait aussi écrire sy et sx en termes d’écarts-types, et développer la formule longue de la corrélation r. On pourrait alors effectuer des multiplications en croix, simplifier en supprimant des termes communs, et aboutir à l’ensemble d’équations suivant pour la pente et l’ordonnée à l’origine. L’objectif n’est pas tant de montrer comment on passe de l’une à l’autre, mais de souligner qu’elles sont équivalentes, car vous pouvez rencontrer l’une ou l’autre.

Autre conséquence intéressante : la droite de régression linéaire simple passe par le point central, c’est-à-dire la moyenne de x et la moyenne de y. Autrement dit, la régression linéaire simple coupe au niveau des moyennes de la variable indépendante et de la variable dépendante, quelle que soit la distribution des points, ce qui lui confère une sorte de propriété d’« équilibre ».

Autres moyens de trouver les coefficients du modèle

Nous avons vu comment obtenir les coefficients de la régression linéaire simple via des équations élégantes. Examinons maintenant d’autres méthodes impliquant l’algèbre linéaire et le calcul différentiel. Les environnements de programmation privilégient ces techniques plus avancées car elles sont plus rapides et plus précises (le fait d’élever au carré pour calculer la variance peut réduire la précision).

- Algèbre linéaire : il existe des techniques d’algèbre linéaire pour trouver les coefficients d’une régression linéaire simple. On peut les obtenir en résolvant ce que l’on appelle l’équation normale. L’équation normale est intéressante, mais peu recommandée avec de grands jeux de données car elle implique une inversion de matrice coûteuse. Une autre technique est la décomposition QR, qui n’implique pas d’inversion de matrice et est réputée numériquement stable.

- Calcul différentiel : on peut trouver la pente et l’ordonnée à l’origine en prenant les dérivées partielles de la somme des carrés des erreurs (SSE) par rapport à la pente et à l’ordonnée, puis en les annulant pour résoudre les coefficients. Autre option liée au calcul : la descente de gradient, une technique d’optimisation itérative qui permet de minimiser la SSE pour retrouver la pente et l’ordonnée. La descente de gradient est étroitement liée au calcul car elle repose sur le gradient, vecteur de dérivées partielles.

Hypothèses du modèle de régression linéaire simple

Passons en revue les principales hypothèses du modèle de régression linéaire simple. Si elles sont violées, il peut être pertinent d’envisager une autre approche. Les trois premières, en particulier, sont fortes et ne doivent pas être ignorées.

- Linéarité : la relation entre la variable indépendante et la variable dépendante doit être linéaire. Si elle est non linéaire, le modèle ne la capturera pas correctement.

- Indépendance des erreurs : les résidus doivent être indépendants entre eux. Il ne doit donc pas y avoir de motifs ou de corrélations entre résidus. À surveiller de près pour des données ordonnées dans le temps.

- Homoscedasticité : les résidus doivent présenter une variance constante pour toutes les valeurs de la variable indépendante. Si la variance change (hétéroscédasticité), les prédictions dans certaines plages de x peuvent devenir moins fiables.

- Normalité des résidus : idéalement, les résidus doivent suivre une loi normale (gaussienne). C’est important pour les tests statistiques et l’estimation des niveaux de confiance. C’est moins critique pour la prédiction.

Évaluation d’un modèle de régression linéaire simple

Supposons que nous ayons créé un modèle de régression linéaire simple. Comment savoir s’il s’ajuste bien ? Pour répondre, examinons des graphiques de diagnostic et des statistiques du modèle.

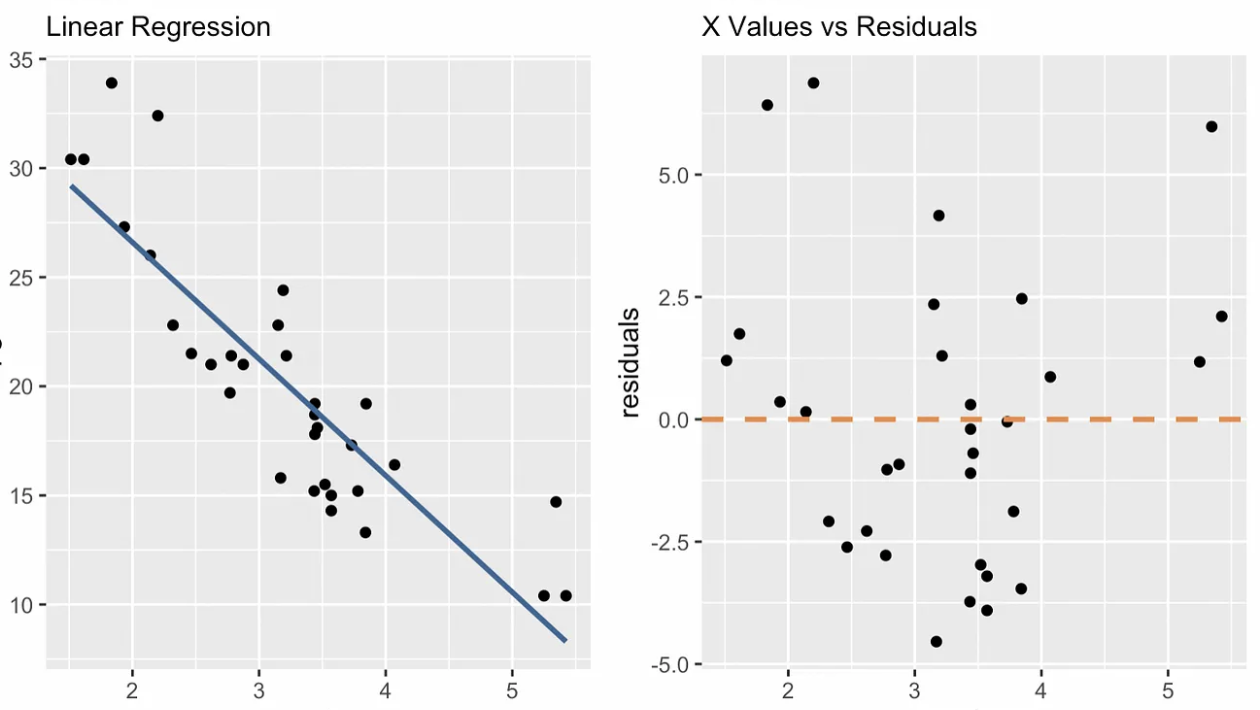

Graphiques de diagnostic

Les graphiques de diagnostic aident à vérifier l’adéquation du modèle et le respect des hypothèses. Tout motif ou écart suggère des problèmes d’ajustement ou une information non capturée. Un graphique de diagnostic propre à la régression linéaire simple est le nuage des valeurs de x contre les résidus, comme ci-dessous. D’autres graphiques utiles : Q-Q plot, échelle–localisation, numéro d’observation vs distance de Cook, etc.

Valeurs de x vs résidus. Image de l’auteur

Valeurs de x vs résidus. Image de l’auteur

Statistiques du modèle

Des statistiques comme R-carré et R-carré ajusté quantifient la part de variance de la variable dépendante expliquée par la variable indépendante. La statistique F teste la significativité globale du modèle, et les p-valeurs des coefficients renseignent sur l’impact des prédicteurs pris individuellement.

Comment interpréter une régression linéaire simple

Lors de l’interprétation des résultats d’une régression linéaire simple, il faut être précis dans la façon de décrire la relation entre la variable indépendante et la variable dépendante.

Comment interpréter la pente et l’ordonnée à l’origine

En particulier, soyez attentif à la formulation concernant les deux éléments clés : la pente et l’ordonnée à l’origine.

- L’ordonnée à l’origine indique où la droite de régression coupe l’axe des ordonnées. En pratique, elle représente la valeur de la variable dépendante quand la variable indépendante vaut zéro. Sachez que l’ordonnée à l’origine n’est pas toujours interprétable. Dans notre exemple des arbres, le modèle pourrait prédire un certain nombre de feuilles pour une hauteur nulle ; cela n’aurait pas de sens d’interpréter l’ordonnée à l’origine dans ce contexte.

- La pente indique de combien la variable dépendante est censée varier pour une augmentation d’une unité de la variable indépendante. Une pente positive suggère une relation positive : la variable dépendante augmente avec la variable indépendante. Une pente négative indique l’inverse.

Un point essentiel : corrélation n’est pas causalité. Même des analystes au fait de ce principe peuvent trébucher sur les mots en interprétant une régression linéaire simple. On ne dira pas que la hauteur d’un arbre cause un plus grand nombre de feuilles, mais plutôt qu’une augmentation d’une unité de la hauteur est associée à une augmentation d’un certain nombre de feuilles.

Autre point d’attention : extrapoler au-delà de l’intervalle des données peut donner des prédictions peu fiables. Un modèle qui prédit le nombre de feuilles selon la hauteur peut être peu précis pour des arbres très petits ou très grands, surtout si ces cas n’ont pas été pris en compte lors de la construction du modèle.

Comment penser les transformations

On parle de « modèles linéaires » car ils sont linéaires dans leur forme fonctionnelle. Plus précisément, en régression linéaire simple, la relation entre la variable réponse y et la variable prédictive x est modélisée comme une combinaison linéaire du prédicteur et d’une constante. Cela dit, vous seriez surpris de ce que l’on peut faire avec une simple régression linéaire. Bien que le modèle suppose une relation en ligne droite, on peut introduire des transformations pour capturer des relations non linéaires.

Par exemple, considérez la croissance du nombre d’ancêtres par génération, qui semble exponentielle : deux parents, quatre grands-parents, huit arrière-grands-parents, etc. On ne s’attend pas à ce qu’un modèle linéaire capture une croissance exponentielle, mais en prédisant log(y) plutôt que y, on linéarise la relation.

En y réfléchissant, il n’y a toutefois pas de croissance exponentielle illimitée à cause du « pedigree collapse » : le taux de croissance ralentit fortement car des ancêtres éloignés apparaissent à plusieurs endroits de l’arbre généalogique. Ainsi, prendre log(y) peut surestimer notre modèle. Pour atténuer cet effet, on peut créer une nouvelle variable via une transformation racine carrée de x et l’utiliser comme prédicteur. Je ne dis pas que ce modèle est correct ni ne cherche à l’interpréter complètement ; je veux montrer que log(y) et la racine carrée de x sont des transformations non linéaires qui entrent linéairement dans l’équation par rapport aux coefficients ; on reste donc dans une régression linéaire simple.

Régression linéaire simple en R et Python

Voyons la régression linéaire simple en R et en Python.

R

R est une excellente option pour la régression linéaire simple.

Calcul manuel de la pente et de l’ordonnée

Nous pouvons calculer nous-mêmes les coefficients en utilisant la moyenne et l’écart-type de nos variables.

# Manually calculate the slope and intercept in R

# Sample data

X <- c(1, 2, 3, 4, 5)

y <- c(2, 4, 5, 4, 5)

# Calculate means

mean_X <- mean(X)

mean_y <- mean(y)

# Calculate standard deviations

sd_X <- sd(X)

sd_y <- sd(y)

# Calculate correlation

correlation <- cor(X, y)

# Calculate slope (b1) using the formula: b1 = (correlation * sd_y) / sd_X

slope <- (correlation * sd_y) / sd_X

# Calculate intercept (b0) using the formula: b0 = mean_y - slope * mean_X

intercept <- mean_y - slope * mean_X

# Print the slope and intercept

cat("Slope (b1):", slope, "\n")

cat("Intercept (b0):", intercept, "\n")

# Use the manually calculated coefficients to predict y values

y_pred <- intercept + slope * X

cat("Predicted values:", y_pred, "\n")Utiliser la fonction lm()

En R, on peut créer une régression avec la fonction lm(), accessible sans bibliothèque additionnelle.

# Fit the model

model <- lm(y ~ X)

# Print the summary of the regression

summary(model)Python

Python est une autre excellente option pour la régression linéaire simple.

Calcul manuel de la pente et de l’ordonnée

Ici, nous calculons la moyenne et l’écart-type pour chaque variable.

import numpy as np

# Sample data

X = np.array([1, 2, 3, 4, 5])

y = np.array([2, 4, 5, 4, 5])

# Calculate means

mean_X = np.mean(X)

mean_y = np.mean(y)

# Calculate standard deviations

sd_X = np.std(X, ddof=1)

sd_y = np.std(y, ddof=1)

# Calculate correlation

correlation = np.corrcoef(X, y)[0, 1]

# Calculate slope (b1) using the formula: b1 = (correlation * sd_y) / sd_X

slope = (correlation * sd_y) / sd_X

# Calculate intercept (b0) using the formula: b0 = mean_y - slope * mean_X

intercept = mean_y - slope * mean_X

# Print the slope and intercept

print(f"Slope (b1): {slope}")

print(f"Intercept (b0): {intercept}")

# Use the manually calculated coefficients to predict y values

y_pred = intercept + slope * X

print(f"Predicted values: {y_pred}")Utiliser statsmodels

statsmodels est une option pour réaliser une régression linéaire simple.

import statsmodels.api as sm

# Adding a constant for the intercept

X = sm.add_constant(X)

# Fit the model

model = sm.OLS(y, X)

results = model.fit()

# Print the summary of the regression

print(results.summary())Régression linéaire simple, test t et ANOVA

La régression linéaire simple est utilisée dans les tests d’hypothèses et occupe une place centrale dans les tests t et l’analyse de la variance (ANOVA).

Régression linéaire simple et test t

Un test t sert souvent à déterminer si la pente de la droite de régression est significativement différente de zéro. Ce test permet de savoir si la variable indépendante a un effet statistiquement significatif. Concrètement, on formule une hypothèse nulle indiquant que la pente est égale à zéro (pas de relation linéaire), et le test t l’évalue. La régression linéaire simple intervient ici car une régression simple avec une variable indépendante binaire équivaut à une différence de moyennes, comme dans un test t.

Régression linéaire simple et ANOVA

L’analyse de la variance (ANOVA) est une méthode statistique utilisée pour évaluer l’adéquation globale du modèle et déterminer si la variable indépendante explique une part significative de la variance de la variable dépendante. On partitionne la variance totale de la variable dépendante en deux composantes : la variance expliquée par le modèle (entre groupes) et la variance due aux résidus/erreurs (intra-groupes). Le test F de l’ANOVA évalue si le modèle de régression, pris dans son ensemble, s’ajuste mieux aux données qu’un modèle sans prédicteurs. Dans notre exemple de hauteur d’arbre et de nombre de feuilles, l’ANOVA indiquerait si intégrer la hauteur améliore significativement notre capacité à prédire le nombre de feuilles.

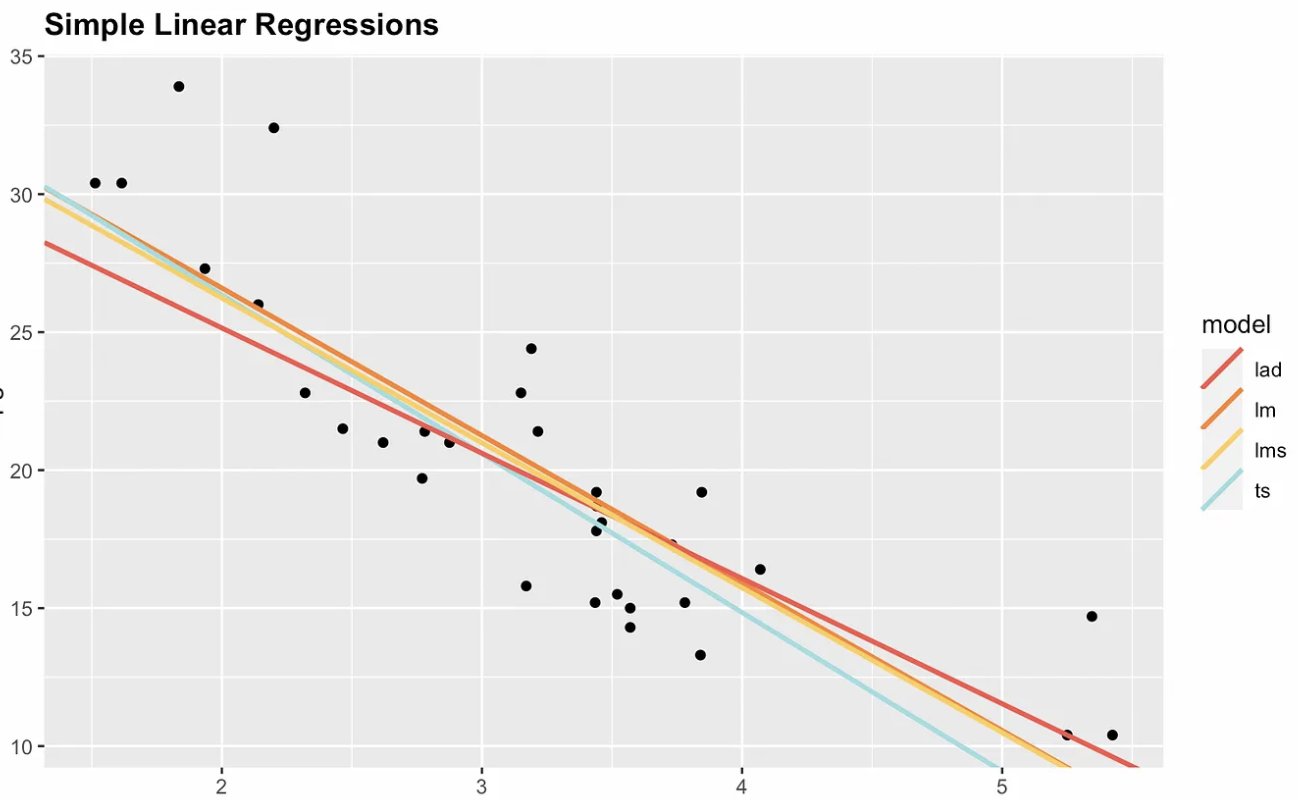

Alternatives aux MCO pour la régression linéaire simple

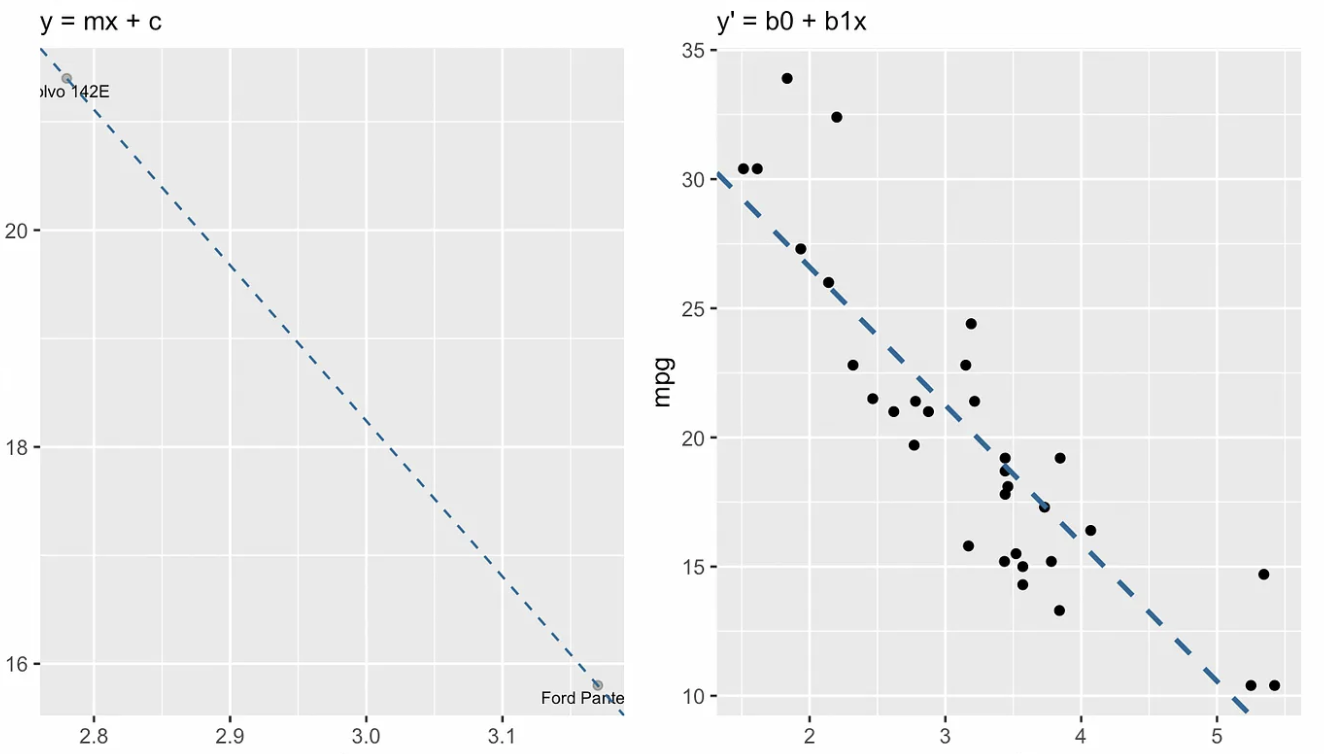

Nous avons indiqué que les moindres carrés ordinaires sont l’estimateur le plus courant en régression linéaire simple, et nous nous y sommes concentrés dans cet article. Toutefois, l’estimateur OLS est sensible aux valeurs aberrantes et manque de robustesse. Ajouter un point très influent ou à fort levier peut modifier fortement la pente et l’ordonnée de la droite.

Pour cette raison, il existe des options non paramétriques. La visualisation suivante montre OLS avec trois alternatives non paramétriques : l’écart absolu médian (MAD), les moindres carrés médians (LMS) et Theil–Sen. Observez que la pente et l’ordonnée diffèrent selon l’estimateur. Si l’on ajoutait un point très influent, par exemple x = 7 et y = 70, la droite de régression OLS changerait le plus.

Quatre options de régression linéaire simple. Image de l’auteur

Quatre options de régression linéaire simple. Image de l’auteur

Pour conclure

La régression linéaire simple est le point de départ pour comprendre des relations plus complexes dans les données. Pour vous accompagner, DataCamp propose des tutoriels pour continuer à pratiquer, notamment notre tutoriel Essentials of Linear Regression in Python, notre tutoriel How to Do Linear Regression in R, ainsi que Linear Regression in Excel: A Comprehensive Guide For Beginners.

Ces ressources vous guideront dans l’utilisation de différents outils pour réaliser une régression linéaire et en comprendre les applications. Enfin, si vous êtes prêt à développer vos compétences, consultez notre Multiple Linear Regression in R: Tutorial With Examples, qui couvre des modèles plus complexes avec plusieurs prédicteurs. Vous pouvez aussi regarder notre vidéo YouTube Regression in Excel Made Easy pour un parcours pas à pas, accessible aux débutants et dédié à Excel.

Devenez un scientifique ML

Je suis rédacteur et éditeur dans le domaine de la science des données. Je suis particulièrement intéressé par l'algèbre linéaire, les statistiques, R, etc. Je joue également beaucoup aux échecs !

FAQ sur la régression linéaire simple

Qu’est-ce que la régression linéaire simple ?

La régression linéaire simple est un type de régression impliquant une variable indépendante (explicative) et une variable dépendante (réponse). Elle sert à prédire une issue continue sur la base d’une relation linéaire entre ces deux variables.

Comment calcule-t-on la pente d’une régression linéaire simple ?

La pente se calcule en multipliant le coefficient de corrélation (r) par le quotient de l’écart-type de la variable dépendante (sy) sur l’écart-type de la variable indépendante (sx). Cela indique de combien la variable dépendante devrait varier pour une variation d’une unité de la variable indépendante.

Quelles méthodes permettent d’estimer les coefficients du modèle ?

On peut trouver les coefficients d’une régression linéaire simple via les moindres carrés ordinaires, en résolvant l’équation normale (algèbre linéaire), par décomposition QR, ou par descente de gradient (calcul différentiel).

Quelles hypothèses doivent être respectées en régression linéaire simple ?

La régression linéaire simple repose sur plusieurs hypothèses : 1) la relation entre variables doit être linéaire ; 2) les résidus doivent être indépendants ; 3) les résidus doivent avoir une variance constante (homoscedasticité) ; 4) idéalement, les résidus suivent une loi normale.

Comment évaluer un modèle de régression linéaire simple ?

On peut évaluer un modèle de régression linéaire simple à l’aide de graphiques de diagnostic (comme résidus vs valeurs de x et Q-Q plots) et de statistiques de modèle telles que R-carré, R-carré ajusté et la statistique F. Ces outils aident à juger de la qualité d’ajustement et de la fiabilité des prédictions.