Cours

Peu de notions sont aussi fondamentales et polyvalentes en statistique et en science des données que la loi gaussienne. Aussi appelée loi normale, ce modèle mathématique est le socle de nombreux méthodes statistiques et techniques d'analyse des données.

Ce guide complet clarifie le concept de loi gaussienne, en explorant ses propriétés, ses applications et son importance dans l'analyse de données moderne. Nous verrons pourquoi elle est si répandue dans les phénomènes naturels et comment elle est utilisée dans des domaines variés, de la finance à l'industrie.

Si vous débutez en statistique ou souhaitez réviser les bases, notre cours Introduction to Statistics constitue un excellent point de départ. Pour mettre ces concepts en pratique dans des langages de programmation spécifiques, nos cours Statistical Thinking in Python (Part 1) et Statistics Fundamentals with R vous aideront à apprécier les nombreuses façons dont la loi gaussienne intervient en statistique descriptive et inférentielle.

Qu'est-ce qu'une loi gaussienne ?

Une loi gaussienne, ou loi normale, est une loi de probabilité continue caractérisée par sa courbe en cloche. Elle est définie par deux paramètres :

- μ (mu) : la moyenne ou valeur attendue de la distribution

- σ (sigma) : l'écart type, qui mesure la dispersion de la distribution

La fonction de densité de probabilité (PDF) d'une loi gaussienne est donnée par :

Où :

- x est la variable

- e est le nombre d'Euler (environ 2,71828)

- π (pi) est la constante mathématique pi (environ 3,14159)

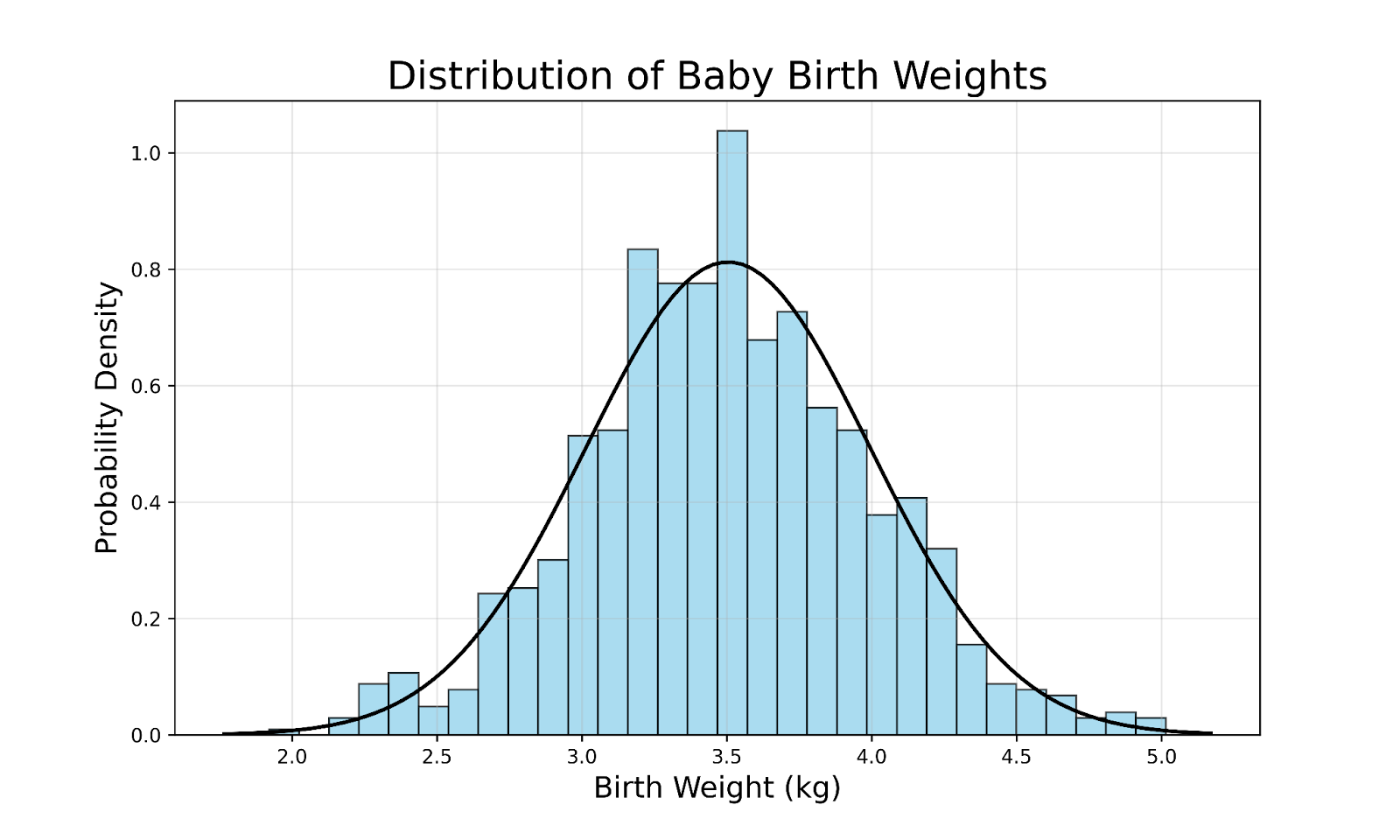

Visualiser la loi gaussienne

Pour illustrer le concept, prenons la distribution des poids de naissance des bébés à terme dans une grande population :

Quelques enseignements clés de ce graphique :

- La plupart des poids de naissance se concentrent autour d'une valeur moyenne (le sommet de la courbe).

- Moins de bébés présentent des poids s'écartant fortement de cette moyenne.

- Très peu de bébés ont des poids extrêmes (très élevés ou très faibles).

Le théorème central limite

La fréquence des lois gaussiennes dans la nature et en statistique s'explique par le théorème central limite (TCL). Le TCL énonce que la distribution des moyennes d'échantillons tend vers une loi normale à mesure que la taille de l'échantillon augmente (p. ex., n ≥ 30), quelle que soit la distribution de la population d'origine.

Un point clé du TCL est que cette convergence vers la normalité se produit relativement vite quand la taille d'échantillon augmente. Dans la plupart des cas pratiques, des échantillons de taille modérée (p. ex., n ≥ 30) suffisent pour que les moyennes d'échantillons approchent une loi normale, même si la population est asymétrique.

La loi normale centrée réduite

Au sein de la famille des lois gaussiennes, il existe un cas particulier, la loi normale centrée réduite (standard normal distribution). Il s'agit d'une loi gaussienne pour laquelle :

- La moyenne (μ) est exactement 0.

- L'écart type (σ) est exactement 1.

La fonction de densité de probabilité de la loi normale centrée réduite est donnée par la formule suivante.

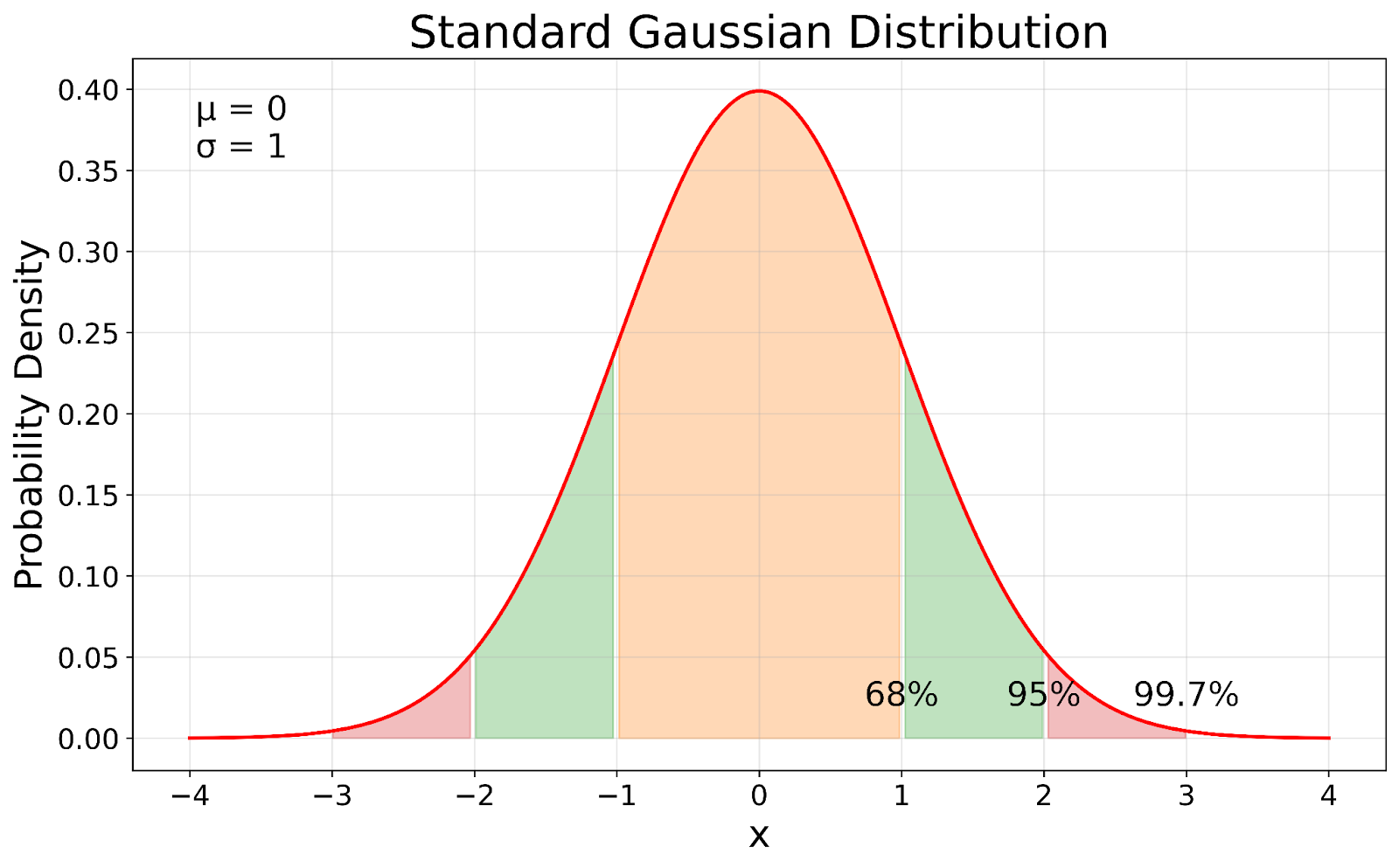

Remarquez que la formule de la densité de probabilité standard se simplifie par rapport à la forme générale grâce aux valeurs particulières de la moyenne et de l'écart type. Visualisons maintenant la loi normale centrée réduite.

Loi normale centrée réduite. Image de l'auteur

Loi normale centrée réduite. Image de l'auteur

La loi normale centrée réduite, illustrée ici, sert de référence en statistique. Vous pouvez voir comment il s'agit d'une version standardisée de toute loi gaussienne : la standardisation recentre la moyenne à 0 et ramène l'écart type à 1, tout en préservant les propriétés fondamentales de la distribution.

Propriétés des lois gaussiennes

Examinons à présent quelques propriétés des lois gaussiennes.

Symétrie et courbe en cloche

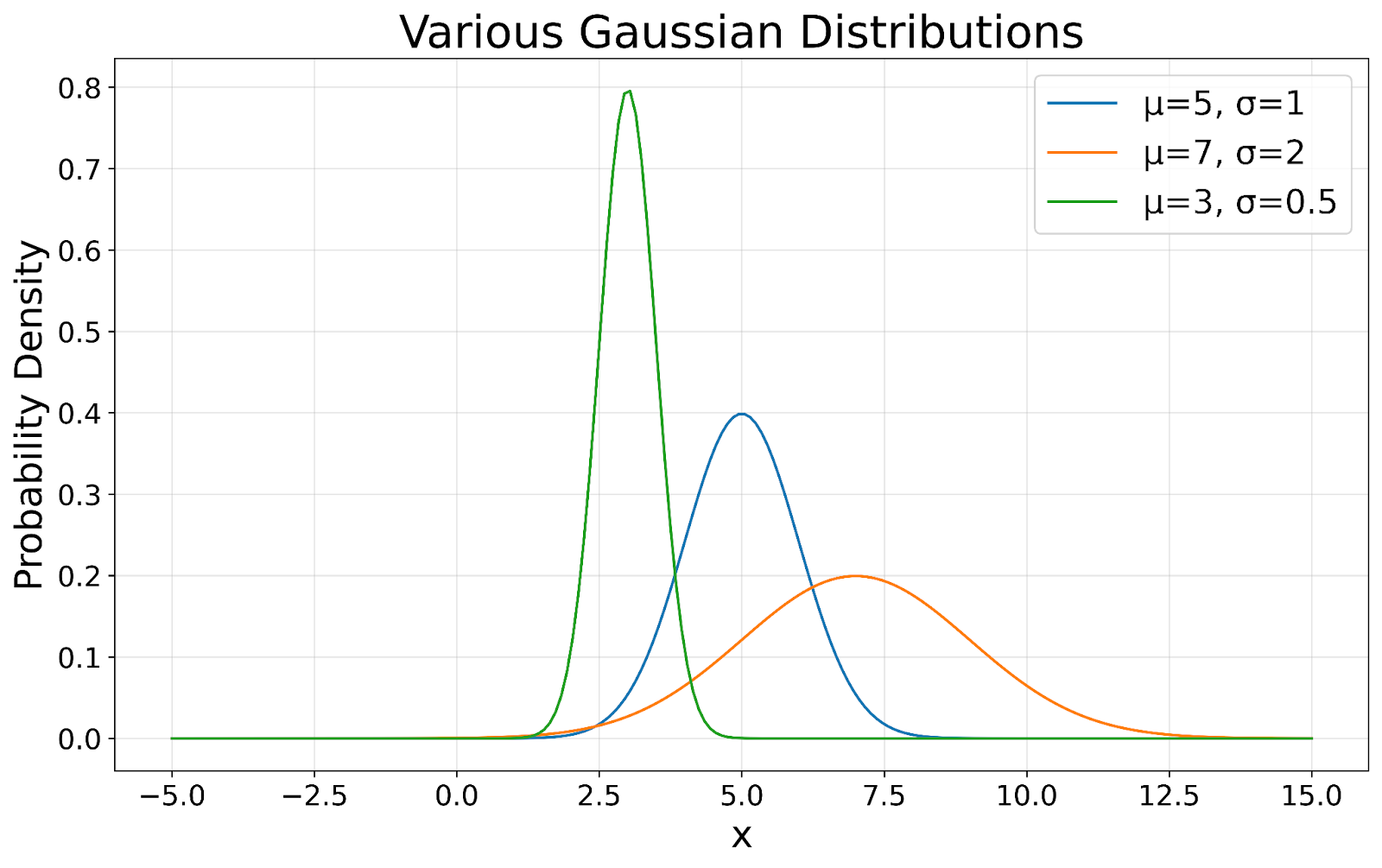

La signature d'une loi gaussienne est sa forme en cloche symétrique. Cette symétrie implique que les données ont autant de chances d'être au-dessus qu'au-dessous de la moyenne, ce qui est particulièrement utile pour estimer des probabilités et faire des inférences. Comme le montre la visualisation suivante, toutes les lois gaussiennes conservent cette forme en cloche, quelle que soit leur moyenne ou leur écart type.

Visualisation de lois gaussiennes. Image de l'auteur

Visualisation de lois gaussiennes. Image de l'auteur

Alignement moyenne, médiane et mode

Dans une loi gaussienne idéale, la moyenne (valeur moyenne), la médiane (valeur centrale) et le mode (valeur la plus fréquente) coïncident. Cet alignement renseigne clairement sur la tendance centrale des données, utile pour résumer des jeux de données. Dans notre visuel, le sommet de chaque courbe représente ce point central.

Écart type et dispersion des données

Dans une loi gaussienne, l'écart type indique à quel point les données s'éloignent de la moyenne. Il suit un schéma prévisible :

- Environ 68 % des données se situent à un écart type de la moyenne.

- Environ 95 % se situent à deux écarts types.

- Environ 99,7 % se situent à trois écarts types.

Cette règle, appelée règle 68-95-99,7, s'applique à toutes les lois gaussiennes, quelle que soit leur moyenne ou leur écart type.

Applications pratiques des lois gaussiennes

Les lois gaussiennes ne sont pas qu'un concept théorique : elles ont des applications étendues dans de nombreux domaines.

Inférence statistique et tests d'hypothèse

De nombreux tests statistiques, tels que les tests t et l'ANOVA, supposent une distribution normale des données. Ces tests aident à déterminer s'il existe des différences significatives entre des groupes ou si des effets observés sont probablement dus au hasard. L'hypothèse de normalité permet de calculer des p-values et des intervalles de confiance, offrant un cadre pour tirer des conclusions et prendre des décisions éclairées.

Cette hypothèse est si importante que des techniques de rééchantillonnage comme le bootstrap ont été développées pour générer des distributions de rééchantillonnage proches de la normalité à partir de données non normales, facilitant la construction d'intervalles de confiance et d'autres analyses. Notre tutoriel sur les tests d'hypothèse montre comment conduire ces tests dans divers scénarios, y compris lorsque les données sont normalement distribuées.

Algorithmes de machine learning

De nombreuses techniques de machine learning reposent sur des hypothèses de normalité, rendant les lois gaussiennes centrales pour leur fonctionnement et leur interprétation. En régression linéaire, par exemple, on souhaite généralement que les valeurs de y (variable dépendante) suivent une loi normale pour avoir confiance dans les estimations. On vise également des résidus (écarts entre valeurs observées et prédites) distribués normalement. Ces hypothèses soutiennent les tests utilisés pour évaluer la fiabilité du modèle et les intervalles de confiance de ses prédictions.

Par ailleurs, les spécialistes du machine learning préfèrent parfois travailler avec des données gaussiennes pour des raisons d'efficacité de calcul. Une distribution normale peut contribuer indirectement à l'efficience de certains algorithmes, notamment ceux qui supposent ou exploitent la normalité des données.

- Estimation des paramètres plus efficace : pour une loi gaussienne, la moyenne et la variance sont des statistiques suffisantes, ce qui évite de modéliser des moments d'ordre supérieur et accélère l'estimation.

- Convergence des algorithmes : des algorithmes comme la descente de gradient, utilisés pour l'optimisation en machine learning, convergent plus vite si les données sont normales.

- Complexité de calcul réduite pour certains algorithmes : des algorithmes comme Gaussian naive Bayes sont conçus pour des données normales et peuvent être très efficaces lorsque l'hypothèse tient.

Devenez un scientifique ML

Points d'attention avec les lois gaussiennes

Même si elles sont extrêmement utiles, il est important de garder à l'esprit quelques idées reçues fréquentes.

Toutes les données ne suivent pas une loi normale

De nombreux phénomènes naturels et sociaux suivent d'autres distributions. Vérifiez toujours vos données avant de supposer la normalité. Par exemple, les revenus sont souvent asymétriques à droite et suivent plutôt une loi log-normale. De même, les temps d'attente ou l'abondance des espèces en écologie suivent souvent des lois exponentielles ou en loi de puissance.

Même certaines distributions que l'on s'attend à voir normales ne le sont pas forcément. Par exemple, l'âge de toutes les personnes d'un quartier ne sera pas distribué normalement, notamment parce que certaines générations sont plus nombreuses. Enfin, certaines distributions semblent normales mais ne le sont pas : la loi de Pareto a une queue en loi de puissance, et la loi de Cauchy n'a ni moyenne ni variance définies.

Valeurs aberrantes et extrêmes

Dans une loi gaussienne, les valeurs extrêmes sont rares mais possibles. Ne rejetez pas automatiquement des points de données inhabituels : ils peuvent être informatifs. La règle 68-95-99,7 indique qu'environ 0,3 % des données se situeront au-delà de trois écarts types de la moyenne. Dans un jeu de 1 000 observations, cela représente environ 3 points très extrêmes sans remettre en cause l'hypothèse de normalité.

La taille d'échantillon compte

Le théorème central limite nécessite un échantillon suffisamment grand pour s'appliquer efficacement. Soyez prudent lorsque vous appliquez des hypothèses de normalité à de petits jeux de données. Sans seuil universel, beaucoup de statisticiens recommandent un minimum d'environ 30 observations pour que le TCL s'applique de manière raisonnable, avec des besoins plus élevés pour des distributions très asymétriques.

Autres distributions à considérer

Même si les lois gaussiennes sont très répandues, d'autres distributions peuvent être plus adaptées selon les cas.

Loi de Student

La loi de Student ressemble à la loi normale mais possède des queues plus épaisses, c'est-à-dire une probabilité plus élevée d'observer des valeurs éloignées de la moyenne. Elle est particulièrement utile dans les situations suivantes :

- Petites tailles d'échantillon : avec de petits échantillons (typiquement moins de 30), l'estimation de l'écart type populationnel est moins fiable. La loi de Student tient compte de cette incertitude accrue.

- Écart type populationnel inconnu : lorsque l'écart type de la population est inconnu — ce qui est fréquent — la loi de Student modélise plus fidèlement la distribution d'échantillonnage de la moyenne.

- Présence d'extrêmes et de queues épaisses : des données susceptibles de valeurs extrêmes ou d'outliers bénéficient des queues épaisses de la loi de Student, souvent plus adaptée que la normale.

À mesure que la taille d'échantillon augmente, la loi de Student converge vers la loi normale. Cela découle du théorème central limite, qui indique que la distribution d'échantillonnage de la moyenne tend vers la normalité avec l'augmentation de n, quelle que soit la distribution de la population.

Loi log-normale

La loi log-normale s'applique pour modéliser des données asymétriques à droite et ne pouvant pas prendre de valeurs négatives. Elle se caractérise par :

- Processus multiplicatifs : lorsque les données résultent de la multiplication de nombreux facteurs indépendants et positifs (p. ex., intérêts composés), la loi log-normale est souvent pertinente.

- Données asymétriques : des variables comme les revenus, les cours boursiers ou certaines mesures biologiques (longueurs d'organismes, temps de réaction) sont typiquement asymétriques à droite, ce qui rend la log-normale plus adaptée.

- Valeurs non négatives : la fonction exponentielle ne produisant pas de valeurs négatives, les variables log-normales sont strictement positives, ce qui convient aux cas réels où des valeurs négatives n'ont pas de sens.

Mathématiquement, une variable X est log-normale si ln(X) suit une loi normale. Cette propriété permet d'appliquer des techniques de la loi normale sur des données transformées par le logarithme, simplifiant l'analyse et l'interprétation.

Loi gaussienne multivariée

La loi gaussienne multivariée, ou loi normale multivariée, est l'extension en dimension supérieure de la loi normale univariée. Elle se caractérise par :

- Plusieurs variables corrélées : elle décrit la distribution jointe de deux variables aléatoires ou plus, normales et potentiellement corrélées.

- Courbes de niveau elliptiques : en deux dimensions, les lignes de densité forment des ellipses, et en dimension supérieure, des ellipsoïdes.

- Définie par un vecteur de moyennes et une matrice de covariance : au lieu d'une seule moyenne et variance, elle utilise un vecteur de moyennes et une matrice de covariance pour capturer les relations entre variables.

La loi gaussienne multivariée est largement utilisée dans des algorithmes de machine learning, comme les modèles de mélange gaussiens, pour le clustering et l'estimation de densité. Elle est aussi employée en finance pour comprendre et prévoir le comportement conjoint de plusieurs rendements d'actifs.

Conclusion

Les lois gaussiennes jouent un rôle central en analyse statistique et en science des données. Leur vaste applicabilité et leurs propriétés bien connues en font un outil incontournable, de l'assurance qualité en production à l'évaluation des risques en finance.

Cependant, il est essentiel de se rappeler que, même si la loi gaussienne est très utilisée, elle n'est pas une solution universelle. Savoir quand recourir à des distributions alternatives, comme la loi de Student ou la loi log-normale, est clé pour gagner en précision et en fiabilité. En alignant votre choix de distribution sur les caractéristiques intrinsèques de vos données, vous garantissez des inférences plus valides et de meilleures décisions.

Pour approfondir les probabilités et leurs applications en data science, notre cours Foundations of Probability in Python propose une exploration complète de ces notions. Si vous êtes plus à l'aise avec R, le cours Introduction to Statistics in R offre des bases solides en statistique avec R.

Questions sur la loi gaussienne

Qu'est-ce qu'une loi gaussienne (normale) ?

Une loi gaussienne, ou loi normale, est une loi de probabilité continue caractérisée par une courbe en cloche symétrique. Elle est définie par deux paramètres : la moyenne (centre) et l'écart type (dispersion/variabilité). La moyenne détermine le centre de la distribution et l'écart type en contrôle la largeur.

Qu'est-ce que la loi normale centrée réduite ?

La loi normale centrée réduite est un cas particulier de la loi gaussienne avec une moyenne de zéro et un écart type de un. Elle simplifie les calculs et permet d'utiliser des tables de z pour obtenir des probabilités et des valeurs critiques. Toute loi normale peut être transformée en loi centrée réduite via les z-scores.

Pourquoi l'appelle-t-on « courbe en cloche » ?

La loi gaussienne est souvent appelée « courbe en cloche » en raison de sa forme caractéristique. Lorsqu'on la trace, elle forme une courbe symétrique, en cloche, qui culmine à la moyenne. Les côtés s'affaissent à mesure qu'on s'éloigne de la moyenne dans un sens ou dans l'autre.

Quand ne faut-il pas utiliser la loi gaussienne ?

Elle ne doit pas être utilisée lorsque les données sont fortement asymétriques, présentent des queues épaisses (kurtosis) ou sont bornées (p. ex., impossibilité de valeurs négatives alors que la gaussienne en autorise). En présence de petits échantillons, d'outliers, ou si le processus générateur ne correspond pas aux hypothèses de normalité, d'autres distributions sont préférables. Évaluez toujours les caractéristiques des données avant de supposer la normalité.

Qu'est-ce que le théorème central limite et quel est son lien avec les lois gaussiennes ?

Le théorème central limite stipule que la distribution des moyennes d'échantillons tend vers une loi normale à mesure que la taille d'échantillon augmente, et ce, quelle que soit la distribution de la population. Il explique pourquoi de nombreux phénomènes naturels suivent une loi gaussienne et autorise l'usage étendu de techniques basées sur la normalité.

Qu'est-ce qu'une loi gaussienne multivariée ?

Une loi gaussienne multivariée est l'extension multidimensionnelle de la loi normale univariée, décrivant la distribution conjointe de deux variables ou plus, normales et corrélées. Elle est définie par un vecteur de moyennes et une matrice de covariance, plutôt que par une seule moyenne et variance.

Quelle est l'asymétrie et la kurtosis d'une loi gaussienne ?

Une loi parfaitement gaussienne a une asymétrie (skewness) nulle. Elle est donc parfaitement symétrique, ses deux côtés se reflétant autour de la moyenne. Sa kurtosis est de 3, valeur de référence. L'excès de kurtosis (kurtosis moins 3) est de 0 pour une loi gaussienne.