Kurs

Schauen wir uns ARIMA an – eine der beliebtesten, wenn nicht die beliebteste Technik für Zeitreihenprognosen. ARIMA ist so gefragt, weil es Zeitreihendaten effektiv modelliert: Es erfasst sowohl die autoregressiven (AR) als auch die gleitenden Durchschnittskomponenten (MA) und macht nicht-stationäre Reihen durch Differenzbildung (I) stationär. Diese Kombination macht ARIMA-Modelle besonders flexibel – deshalb kommen sie in sehr unterschiedlichen Bereichen zum Einsatz, von Finanzen bis Wettervorhersage.

ARIMA-Modelle sind technisch anspruchsvoll, aber ich zerlege die Teile so, dass du ein solides Verständnis aufbauen kannst. Vor dem Einstieg lohnt sich ein Blick auf einige Grundlagen. DataCamp bietet viele gute Ressourcen, zum Beispiel die Kurse ARIMA Models in Python oder ARIMA Models in R. Wähle einfach die Sprache, mit der du lieber arbeitest.

Warum ARIMA für Prognosen nutzen?

In Finanzen, Volkswirtschaft, Umweltwissenschaften u. a. weckt ARIMA großes Interesse, weil es komplexe Muster in vergangenen Beobachtungen identifiziert und für künftige Entwicklungen nutzbar macht – ein echter State-of-the-Art-Ansatz. Von der Vorhersage von Aktienkursen über Wetterprognosen bis zur Einschätzung von Konsumnachfrage: ARIMA ermöglicht treffsichere, umsetzbare Analysen.

Mit ARIMA analysieren und prognostizieren wir Zeitreihen auf einem Niveau, das Muster, Trends und Saisonalität berücksichtigt. Das liefert einen Rundumblick auf die zugrunde liegende Dynamik und unterstützt fundierte Entscheidungen.

Zentrale Komponenten von ARIMA-Modellen

Um ARIMA wirklich zu verstehen, zerlegen wir die Bausteine. Sind die Komponenten klar, wird auch das Gesamtprinzip der Methode deutlich. Hier erkläre ich jede Komponente im Detail.

Autoregressiver Teil (AR)

Die autoregressive Komponente (AR) bildet Trends aus vergangenen Werten und nutzt sie für Vorhersagen. Zur Einordnung: Im „autoregressiven Rahmen“ arbeitet man wie in einer Regression, nur dass man verzögerte Werte der Zeitreihe selbst als Regressoren verwendet.

Integrierter Teil (I)

Der integrierte Teil (I) bezieht sich auf die Differenzierung der Zeitreihe mit dem Ziel, Stationarität zu erreichen – also konstante Mittelwerte und Varianz über die Zeit. Vereinfacht gesagt subtrahieren wir eine Beobachtung von der vorherigen, um Trends und Saisonalität zu eliminieren. Durch Differenzieren stellen wir Stationarität her. Dieser Schritt ist nötig, damit das Modell die Struktur der Daten erfasst – und nicht das Rauschen.

Gleitender Durchschnitt (MA)

Die MA-Komponente betrachtet die Beziehung zwischen einer Beobachtung und einem Residualfehler. Indem wir analysieren, wie die aktuelle Beobachtung mit vergangenen Fehlern zusammenhängt, lassen sich Hinweise auf mögliche Muster im Datensatz ableiten.

Man kann die Residuen als eine Fehlerreihe betrachten; das MA-Modell schätzt deren Einfluss auf die aktuelle Beobachtung. Das ist besonders nützlich, um kurzfristige Schwankungen oder zufällige Schocks zu erkennen und zu modellieren. Über den MA-Teil gewinnen wir wertvolle Einblicke in das Verhalten der Zeitreihe und erhöhen die Prognosegenauigkeit.

So baust du ein ARIMA-Modell in Python

Für eine Prognose, etwa von Goldpreisen, kannst du folgende Schritte gehen. Zerlegen wir den Prozess gemeinsam.

Datenbeschaffung

Zuerst besorgen wir ein passendes Dataset und richten die Umgebung ein.

Datensatz finden

Sammle oder suche einen Datensatz auf Datenplattformen. Wichtig ist eine Historie über die Zeit. Hier ist ein Link zum Kaggle-Datensatz zu Gold-Futures-Preisen.

Pakete installieren

Wir installieren die benötigten Pakete, darunter statsmodels und sklearn.

import pandas as pdimport matplotlib.pyplot as pltfrom statsmodels.tsa.stattools import adfullerfrom statsmodels.graphics.tsaplots import plot_acf, plot_pacffrom statsmodels.tsa.arima.model import ARIMAfrom sklearn.metrics import mean_squared_errorDaten laden

Nun lesen wir die Daten in unsere Umgebung ein. Ich achte zusätzlich darauf, dass Datumsangaben korrekt erkannt und sortiert werden.

# Define the path to your CSV file# You may have to make this path more specific to the location of your file.csv_path = "future-gc00-daily-prices.csv"# Read the CSV, parse 'Date' column as datetime, and set it as the indexdata = pd.read_csv( csv_path, parse_dates=["Date"], dayfirst=False, index_col="Date")# Sort the DataFrame by the Date index in ascending orderdata.sort_index(inplace=True)Datenvorverarbeitung

Unser Datensatz ist recht sauber, aber in anderen Kontexten müssten wir Index-Themen beachten – zentral für Zeitreihenprognosen. Beispiel: Wenn wir Schlusskurse einer Börse prognostizieren, ist die Börse am Wochenende geschlossen.

Bevor es weitergeht, entferne ich noch schnell Kommas aus der Variable Close, die ich verwenden werde.

# Clean the "Close" columndata["Close"] = data["Close"].replace(',', '', regex=True)data["Close"] = pd.to_numeric(data["Close"], errors='coerce')data["Close"].replace([np.inf, -np.inf], np.nan, inplace=True)data.dropna(subset=["Close"], inplace=True)Fehlende Werte behandeln

Als Teil der Vorverarbeitung müssen wir oft auch Fehlwerte behandeln, z. B. per Vorwärtsauffüllen oder Mittelwertersatz. Beachte: Schon ein einziges NA kann je nach Sprache/Bibliothek verhindern, dass ARIMA läuft.

Ich hatte erwähnt, dass Wochenendtage als NA erscheinen könnten. Das kann vorkommen und erfordert ggf. einen Zusatzschritt. Glücklicherweise behandelt statsmodels die Daten als sequentiellen Index, ohne strikt regelmäßige Intervalle zu erzwingen – so kompiliert unser Modell auch mit Wochenendlücken.

Zeitdiagramm erstellen

Jetzt ist ein guter Zeitpunkt, die Reihe zu visualisieren:

# Plotting the original Close priceplt.figure(figsize=(14, 7))plt.plot(data.index, data["Close"], label='Close Price')plt.title('Close Price Over Time')plt.xlabel('Date')plt.ylabel('Close Price')plt.legend()plt.show()

Auf Stationarität prüfen und ggf. differenzieren

ARIMA-Modelle können bis zu einem gewissen Grad mit Nicht-Stationarität umgehen, aber nicht mit zeitvariierender Varianz. Für ein gut funktionierendes ARIMA braucht es daher stationäre Daten.

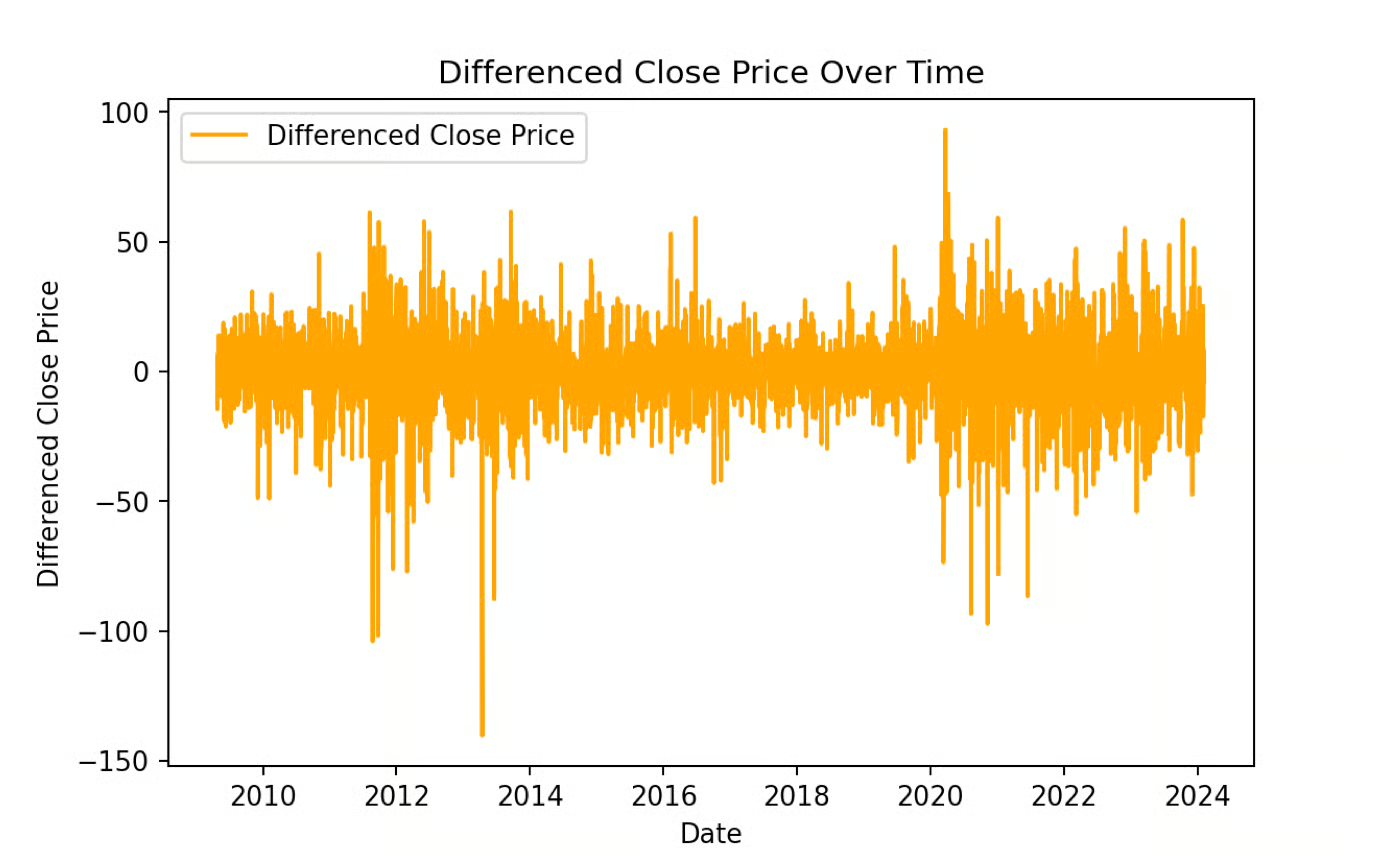

Der Plot oben zeigt klar einen Trend – die Reihe ist also nicht stationär; zudem scheint die Varianz über die Zeit zu schwanken. Mit dem erweiterten Dickey-Fuller-Test prüfen wir diese Intuition und erhalten Kennzahlen zu Mittelwert- und Varianzkonstanz.

# Perform the Augmented Dickey-Fuller test on the original seriesresult_original = adfuller(data["Close"])print(f"ADF Statistic (Original): {result_original[0]:.4f}")print(f"p-value (Original): {result_original[1]:.4f}")if result_original[1] < 0.05: print("Interpretation: The original series is Stationary.\n")else: print("Interpretation: The original series is Non-Stationary.\n")# Apply first-order differencingdata['Close_Diff'] = data['Close'].diff()# Perform the Augmented Dickey-Fuller test on the differenced seriesresult_diff = adfuller(data["Close_Diff"].dropna())print(f"ADF Statistic (Differenced): {result_diff[0]:.4f}")print(f"p-value (Differenced): {result_diff[1]:.4f}")if result_diff[1] < 0.05: print("Interpretation: The differenced series is Stationary.")else: print("Interpretation: The differenced series is Non-Stationary.")ADF Statistic (Original): -1.4367p-value (Original): 0.5646Interpretation: The original series is Non-Stationary.ADF Statistic (Differenced): -19.1308p-value (Differenced): 0.0000Interpretation: The differenced series is Stationary.Die Ergebnisse des ADF-Tests zeigen: Die Originalreihe ist nicht stationär – ein ARIMA „out of the box“ auf dieser Basis wäre ein Fehler.

Der ADF-Test auf der differenzierten Reihe weist hingegen Stationarität nach.

Ein kurzes Wort zur Differenzierung: Dabei subtrahieren wir jede Beobachtung von der vorherigen und erhalten so eine neue Zeitreihe erster Differenzen. (Diese ist um ein Element kürzer.) Falls die differenzierte Reihe noch nicht stationär ist, können wir ein zweites Mal differenzieren und so fort, bis Stationarität erreicht ist. Die benötigte Differenzierungsordnung ist die minimale Anzahl an Differenzen, die eine Reihe ohne Autokorrelation ergibt.

Wichtig: Differenziere nicht öfter als nötig – sonst erzeugst du künstliche Dynamiken. Und falls du ein saisonales ARIMA (SARIMA) aufbauen willst, würdest du eine saisonale Differenz in der Regel vor einer ersten (nicht-saisonalen) Differenz prüfen.

# Plotting the differenced Close priceplt.figure(figsize=(14, 7))plt.plot(data.index, data['Close_Diff'], label='Differenced Close Price', color='orange')plt.title('Differenced Close Price Over Time')plt.xlabel('Date')plt.ylabel('Differenced Close Price')plt.legend()plt.show()

Modellidentifikation

Beim Aufbau eines ARIMA-Modells wählen wir die Terme p, d und q.

- Der erste Parameter p ist die Anzahl der Verzögerungen. Er legt fest, wie weit wir für die Vorhersage in die Vergangenheit blicken. Grundlage ist die Autokorrelation der Reihe bei verschiedenen Lags.

- Der zweite Parameter d ist die Differenzierungsordnung. Differenzieren bedeutet, aufeinanderfolgende Zeitpunkte zu differenzieren, um Stationarität zu erreichen, also Trends und Varianzänderungen über die Zeit zu entfernen. d gibt an, bei welcher Ordnung die Reihe stationär wird.

- Der dritte Parameter q ist die Ordnung des MA-Teils. Er steht für die Anzahl der verzögerten Prognosefehler, die im Modell berücksichtigt werden. Anders als ein einfacher gleitender Durchschnitt, der Daten glättet, modelliert MA in ARIMA die Beziehung zwischen Beobachtung und Residuen eines auf verzögerte Werte angewandten MA-Modells.

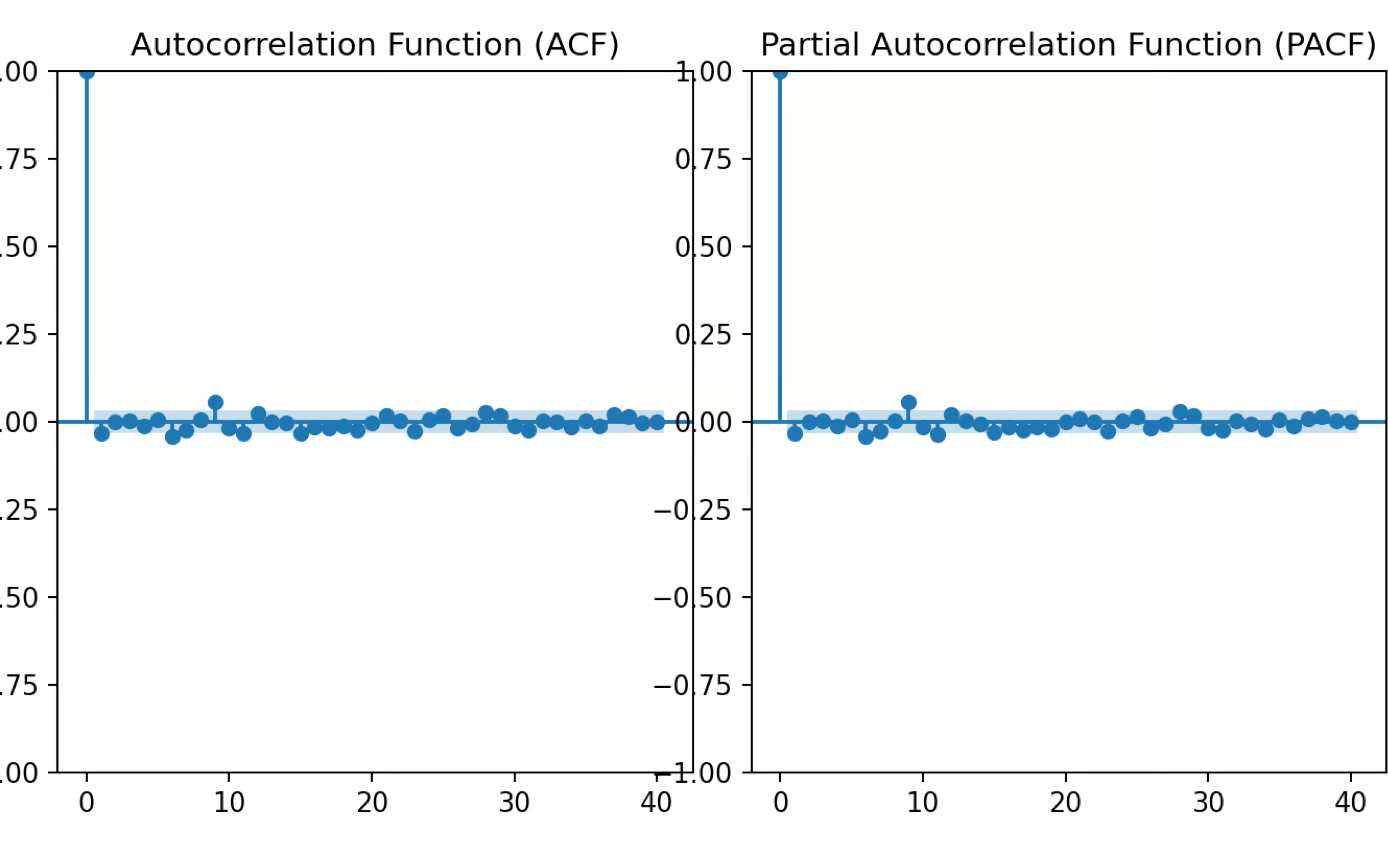

ARIMA-Terme bestimmen

Zur Bestimmung von p, d und q nutzen wir ACF (Autokorrelationsfunktion) und PACF (partielle Autokorrelationsfunktion). Wo ACF abrupt abfällt, liefert Hinweise auf q, und wo PACF abfällt, auf p. Den passenden Wert für d wählen wir so, dass die differenzierte Reihe näherungsweise wie weißes Rauschen wirkt. Für unsere Daten wählen wir jeweils 1 für p und q, da beim ersten Lag in beiden Fällen ein deutlicher Ausschlag zu sehen ist.

from statsmodels.graphics.tsaplots import plot_acf, plot_pacfimport matplotlib.pyplot as plt# Plot ACF and PACF for the differenced seriesfig, axes = plt.subplots(1, 2, figsize=(16, 4))# ACF plotplot_acf(data['Close_Diff'].dropna(), lags=40, ax=axes[0])axes[0].set_title('Autocorrelation Function (ACF)')# PACF plotplot_pacf(data['Close_Diff'].dropna(), lags=40, ax=axes[1])axes[1].set_title('Partial Autocorrelation Function (PACF)')plt.tight_layout()plt.show()

Parameterschätzung

Zur Klarstellung: Die Werte p, d und q beschreiben die Modellordnung (Lags für AR, Differenzierung und MA), sind aber nicht die zu schätzenden Parameter selbst. Nachdem p, d und q feststehen, schätzt das Modell weitere Parameter – etwa Koeffizienten der AR- und MA-Terme – per Maximum-Likelihood-Schätzung (MLE).

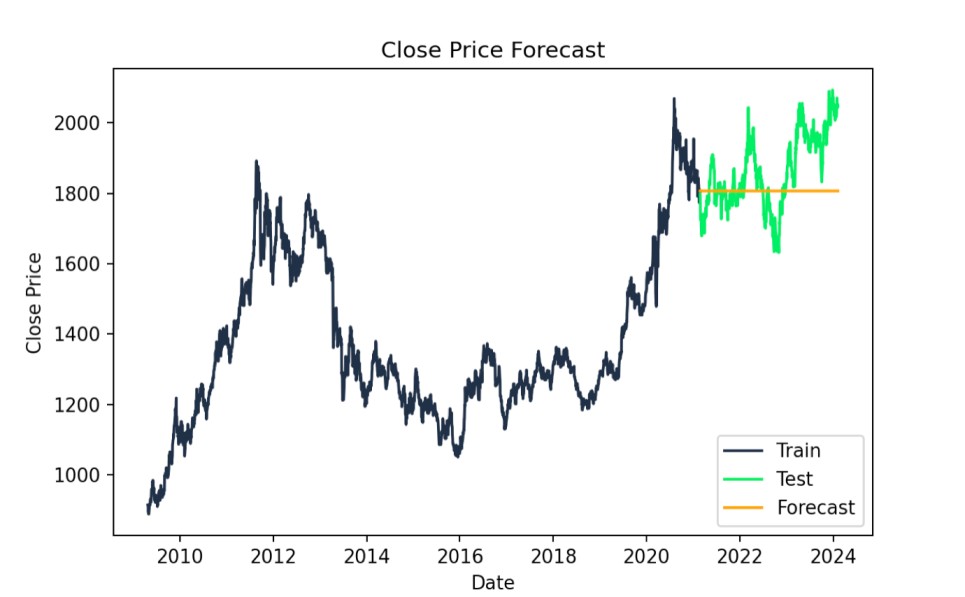

Prognose

Für Vorhersagen mit ARIMA nutzt du das angepasste Modell, um auf Basis der Daten zukünftige Werte zu schätzen. Anschließend visualisierst du die Prognosen sinnvollerweise gemeinsam mit den Ist-Werten. Das gelingt über einen Train/Test-Workflow, bei dem die Daten in Trainings- und Testmenge aufgeteilt werden. So siehst du, wie gut das Modell auf unbekannten Daten performt. Falls das neu für dich ist, schau dir unseren Kurs Model Validation in Python an.

1. Train/Test-Workflow nutzen

Zuerst teilen wir die Daten in Trainings- und Testdaten auf.

# Split data into train and testtrain_size = int(len(data) * 0.8)train, test = data.iloc[:train_size], data.iloc[train_size:]# Fit ARIMA modelmodel = ARIMA(train["Close"], order=(1,1,1))model_fit = model.fit()2. Zeitreihe visualisieren

Als Nächstes erzeugen wir die Prognose und prüfen sie visuell. So sehen wir, wie sich die Vorhersage gegenüber den Testdaten schlägt.

# Forecastforecast = model_fit.forecast(steps=len(test))# Plot the results with specified colorsplt.figure(figsize=(14,7))plt.plot(train.index, train["Close"], label='Train', color='#203147')plt.plot(test.index, test["Close"], label='Test', color='#01ef63')plt.plot(test.index, forecast, label='Forecast', color='orange')plt.title('Close Price Forecast')plt.xlabel('Date')plt.ylabel('Close Price')plt.legend()plt.show()

ARIMA-Prognose: Ist- vs. Vorhersagewerte. Bild: Autorin/Autor

3. Modellkennzahlen bewerten

Wir prüfen AIC- und BIC-Werte. Kleinere Werte deuten auf bessere Passung hin – allerdings vergleichen wir idealerweise mit einfacheren Modellen, um Overfitting zu vermeiden. Ich drucke die Werte hier aus; sinnvoll werden sie vor allem im Vergleich mehrerer ARIMA-Varianten auf denselben Daten, um das beste Modell zu finden.

print(f"AIC: {model_fit.aic}")print(f"BIC: {model_fit.bic}")AIC: 24602.97426066606BIC: 24620.97128230579Zusätzlich können wir den mittleren quadratischen Fehler auswerten, um die Passung praktisch zu beurteilen. Ein geringerer RMSE steht für ein besseres ARIMA-Modell und ist auf der Skala der Daten interpretierbar. Ein RMSE von 118,5339 bedeutet hier, dass die Vorhersagen im Mittel um etwa 118,53 $ vom tatsächlichen Close abweichen.

forecast = forecast[:len(test)]test_close = test["Close"][:len(forecast)]# Calculate RMSErmse = np.sqrt(mean_squared_error(test_close, forecast))print(f"RMSE: {rmse:.4f}")RMSE: 118.5339Werde ein ML-Wissenschaftler

Häufige Einsatzfelder von ARIMA-Prognosen

Schauen wir uns die Anwendungen von ARIMA in verschiedenen Branchen an. Von Volkswirtschaft und Finanzen über Wettervorhersage bis Gesundheit – viele Sektoren nutzen ARIMA-Modelle, um aus Daten Erkenntnisse zu gewinnen und die Prognosegüte zu erhöhen. Wichtige Beispiele:

Volkswirtschaft und Finanzen

ARIMAs Stärke liegt in der Fähigkeit, Finanzzeitreihen mit komplexen Autokorrelationen und Wechselwirkungen zwischen ökonomischen Indikatoren abzubilden. Dank Lag-Effekten und Differenzierung eignet es sich für volatile Kennzahlen wie Aktienkurse oder Wechselkurse.

- Finanzprognosen: Vorhersage von Aktienkursen, Wechselkursen und anderen Finanzinstrumenten zur Unterstützung von Anlagestrategien.

- Ökonomische Modellierung: Prognosen zur Entwicklung nationaler und globaler Wirtschaften zur Unterstützung wirtschaftspolitischer Entscheidungen.

- Bedarfsplanung: Prognose der Nachfrage nach Konsumgütern und Services zur Optimierung von Produktion und Beständen.

Wettervorhersage

ARIMA-Modelle nutzen historische Wettermuster für kurz- und langfristige Vorhersagen – flexibel genug für typische wie extreme Bedingungen.

- Temperatur- und Niederschlagsprognosen: Einsatz in Kurz- und Langfristprognosen unter Einbezug von Luft-Meer-Interaktionen und weiteren Faktoren.

- Klimamodellierung: Nutzung historischer Wetterdaten, um Klimatrends zu verstehen und künftige Klimaszenarien abzuschätzen.

Supply-Chain-Management

Dank der Modellierung von Lag-Effekten hilft ARIMA, Bestände zu steuern und potenzielle Störungen anhand historischer Muster und Lieferzeiten zu antizipieren.

- Nachfrageprognosen: Vorhersage der Produktnachfrage zur Planung von Produktion und Lagerbeständen.

- Bestandsmanagement: Sicherstellen passender Bestandsniveaus, um Kapitalbindung zu vermeiden und Kosten durch Über- oder Unterdeckung zu reduzieren.

- Supply-Chain-Optimierung: Prognose potenzieller Störungen durch Analyse mehrerer Variablen, etwa Transportverzögerungen oder Nachfrageschwankungen.

Gesundheitswesen

Im Gesundheitsbereich sind ARIMA-Modelle besonders wertvoll, etwa für die Prognose von Aufnahmen oder anderen Kennzahlen.

- Ausbruchsvorhersagen: Prognosen zur Ausbreitung infektiöser Krankheiten als Grundlage für proaktive Public-Health-Maßnahmen.

- Klinikaufnahmen: Prognose von Aufnahmeraten zur optimalen Ressourcen- und Personaleinsatzplanung.

- Patientenmonitoring: Analyse medizinischer Verlaufsdaten zur Früherkennung und für passgenaue Behandlungsstrategien.

Worauf du für bessere ARIMA-Prognosen achten solltest

Hier sind einige typische Fehler, die du beim Aufbau von ARIMA-Modellen vermeiden solltest:

Overfitting und Underfitting

Falsch gewählte p-, d- und q-Werte können zu Overfitting oder Underfitting führen. Overfitting entsteht, wenn das Modell zu komplex ist und Rauschen als Signal lernt – es generalisiert dann schlecht. Underfitting bedeutet umgekehrt, dass das Modell zu simpel ist und wichtige Muster nicht erfasst.

Gegen Overfitting helfen weniger Lag-Terme und ggf. eine geringere Differenzierungsordnung. Underfitting kann – wo sinnvoll – durch mehr autoregressive Terme adressiert werden. Entscheidend ist das richtige Maß. Validierung bzw. Cross-Validation unterstützt dich dabei.

Stationarität

Stationarität ist eine statistische Annahme zu zeitlichen Abhängigkeiten. Nicht-stationäre Daten führen leicht zu unzuverlässigen Prognosen und Scheinkorrelationen. Differenzierung oder Transformationen wie Log-Transformationen bzw. saisonale Anpassungen helfen, Stationarität herzustellen.

Saisonalität

Saisonalität ist ein weiterer zentraler Aspekt in der Zeitreihenanalyse. Viele reale Datensätze zeigen wiederkehrende Muster in festen Intervallen (täglich, wöchentlich, jährlich). Werden saisonale Muster ignoriert, leidet die Prognosequalität. Bei Saisonalität brauchen wir neben p und q saisonale Differenzen sowie saisonale AR- und MA-Terme. Eine Reihe kann mehr als eine Saisonalität besitzen.

Residualanalyse

Ein Kernschritt beim ARIMA ist die Prüfung, ob die Residuen stationär sind. Residuen sind die Differenz zwischen beobachteten Werten und Modellwerten. Über sie prüfen wir, ob das Modell die Dynamik der Daten adäquat abbildet. Residuen sollten zufällig streuen, ohne Trends oder Korrelationen.

Zeigen Residuen Muster oder Korrelationen, steckt noch ungenutzte Information im Signal. Statistische Tests und visuelle Diagnostik – z. B. Ljung-Box-Test, Histogramme und Diagnostikplots – helfen, die Modelltauglichkeit zu bewerten.

Nächste Schritte mit ARIMA und verwandten Modellen

Oft ist ARIMA nicht das Ende der Reise. Wie ARIMA auf AR- bzw. MA-Modellen aufbaut, gibt es auch neuere Ansätze. Zum einen können ARIMA-Modelle lineare und nichtlineare Muster in Zeitreihen abbilden. Für saisonale Prognosen lohnt sich ein Blick auf SARIMA, das periodische Muster modelliert – ideal etwa bei Absatzprognosen oder Wetter. Eine weitere Option sind ARIMAX-Modelle: ARIMA mit externen Einflussgrößen (exogenen Regressoren), die die Prognoseleistung deutlich steigern können.

Darüber hinaus kannst du im Machine-Learning-Bereich tiefer einsteigen – z. B. mit Recurrent Neural Networks (RNN) und LSTM für komplexe zeitliche Abhängigkeiten. Spannend ist auch die Bayes’sche Zeitreihenanalyse und wie sie Prognosen und Entscheidungsfindung bereichern kann.

Fazit

ARIMA ist ein etabliertes statistisches Modell für Zeitreihen: Es berücksichtigt autoregressive und gleitende Durchschnittskomponenten und sagt auf dieser Basis zukünftige Werte voraus. Es ermöglicht belastbare Prognosen aus historischen Daten – auch wenn sich Datensätze stark unterscheiden. Diese Anpassungsfähigkeit macht ARIMA zu einer weit verbreiteten Methode.

Praxis ist entscheidend, um die ARIMA-Grundlagen zu verankern. DataCamp bietet umfassende Kurse, die zu deinen Lernzielen passen. In diesen Top-Tutorials lernst du die Grundlagen des ARIMA-Modelings sowie die wichtigsten Tools und Techniken, um analytische Lösungen für reale Probleme schneller und mit weniger Aufwand umzusetzen. Am Ende solltest du ARIMA sicher in deiner künftigen Data-Science-Arbeit einsetzen können. Sieh dir die ARIMA-Kurse auf DataCamp an und bring deine Zeitreihenanalyse aufs nächste Level: Forecasting in R, Time Series with R, ARIMA Models in Python, ARIMA Models in R.

Werde ein ML-Wissenschaftler

Ich bin Teilzeit-Dozentin im Lehrprogramm des Fachbereichs Informatik an der An-Najah National University und habe 5 Jahre Erfahrung im Software-Engineering und 5+ Jahre im Bereich Data Science. Meine aktuellen Forschungsschwerpunkte sind Education EdTech und (FATE) in AI - Data science for Social Good/Impact. Zusätzlich zur Rolle des Dozenten. Ich bin ein außerschulischer Coding Educator, der Python-Programmierung unterrichtet, und ein technischer Mentor, der sein Wissen mit anderen teilt und Einblicke in die neuesten Trends und Techniken gibt. ein professioneller Trainer für Universitätsstudenten in Sachen Jobsuche (Vorstellungsgespräche, Lebenslauferstellung, Jobauswahl, Portfolio, Karrierecoaching) in der Tech-Welt.

Häufige Fragen zur Zeitreihenprognose

Was ist ein ARIMA-Modell?

Ein ARIMA-Modell (Autoregressive Integrated Moving Average) ist eine verbreitete statistische Methode für Zeitreihenprognosen. Es sagt zukünftige Werte voraus, indem es vergangene Beobachtungen (AR), Differenzierung zur Herstellung von Stationarität (I) und vergangene Fehler zur Verfeinerung der Vorhersagen (MA) kombiniert.

Worin liegt der Unterschied zwischen ARIMA und exponentieller Glättung?

Man kann sagen, ARIMA-Modelle beschreiben eine Reihe über ihre Autokorrelationen. Sie sind mächtiger und flexibler und werden häufig für stabile, längerfristige Prognosen eingesetzt. Exponentielle Glättung fokussiert stärker auf Trend und Saisonalität und gilt oft als überlegen bei kurzen, volatilen Reihen.

Wie hängt ARIMA mit Regressionsmodellierung zusammen?

ARIMA-Prognosen sind mit Regressionsmodellierung verwandt, da sie vergangene Werte und Fehler nutzen, um zukünftige Punkte vorherzusagen – ähnlich wie Regression abhängige Variablen über unabhängige erklärt. ARIMA macht nicht-stationäre Reihen durch Differenzierung stationär, was es mit Regression auf stationären Daten vergleichbar macht. Im Unterschied zur klassischen Regression berücksichtigt ARIMA jedoch explizit zeitabhängige Effekte und eignet sich daher besser für Zeitreihenprognosen.