Cursus

Depuis des semaines, on attendait l’arrivée de Claude Sonnet 5. Anthropic a finalement d’abord lancé Claude Opus 4.6, puis a enchaîné avec une mise à jour de sa famille de modèles Sonnet.

Claude Sonnet 4.6 apporte des connecteurs, des skills et la compaction de contexte à tous les utilisateurs, prend la tête du benchmark GDPval-AA et offre des performances de niveau flagship à un tarif accessible.

Si le développement s’est visiblement concentré sur les compétences agentiques, Anthropic promet « une mise à niveau générale des compétences du modèle » sur pratiquement tous les domaines pertinents.

Le modèle tient-il ses promesses ? Dans ce tutoriel, je vous présente les principales nouveautés du nouveau modèle d’Anthropic et je le mets à l’épreuve.

Consultez aussi nos guides sur Muse Spark et Qwen3.5, les nouveaux modèles phares de Meta et Alibaba, respectivement.

Présentation des modèles Claude

Qu’est-ce que Claude Sonnet 4.6 ?

Claude Sonnet 4.6 est le dernier grand modèle de langue (LLM) d’Anthropic. Il met l’accent sur le code agentique, l’utilisation de l’ordinateur et d’autres capacités agentiques, et constitue le modèle plus léger par rapport au tout récent modèle phare, Claude Opus 4.6.

Cette mise à jour à l’intitulé incrémental aurait pu surprendre il y a peu, mais elle s’inscrit dans la logique de la sortie récente. On peut interpréter ce versioning ainsi : Claude Sonnet 4.6 n’introduit peut-être pas beaucoup de nouvelles fonctionnalités isolées, mais intègre aux modèles Sonnet des fonctionnalités apparues tout récemment.

En plus de rendre accessibles à tous des fonctions auparavant réservées aux offres payantes, Claude Sonnet 4.6 affiche des performances nettement supérieures à son prédécesseur sur l’ensemble des tâches, tout en conservant la tarification API de Claude Sonnet 4.5 (3 $ / 15 $ par million de tokens en entrée/sortie). Il est disponible immédiatement via l’interface web de chat Claude et l’API.

Principales fonctionnalités de Claude Sonnet 4.6

L’approche d’Anthropic avec cette sortie vise à offrir des performances de niveau Opus au prix de Sonnet. Ambitieux sur le papier, cet objectif semble atteint au vu des benchmarks, que nous détaillerons plus loin.

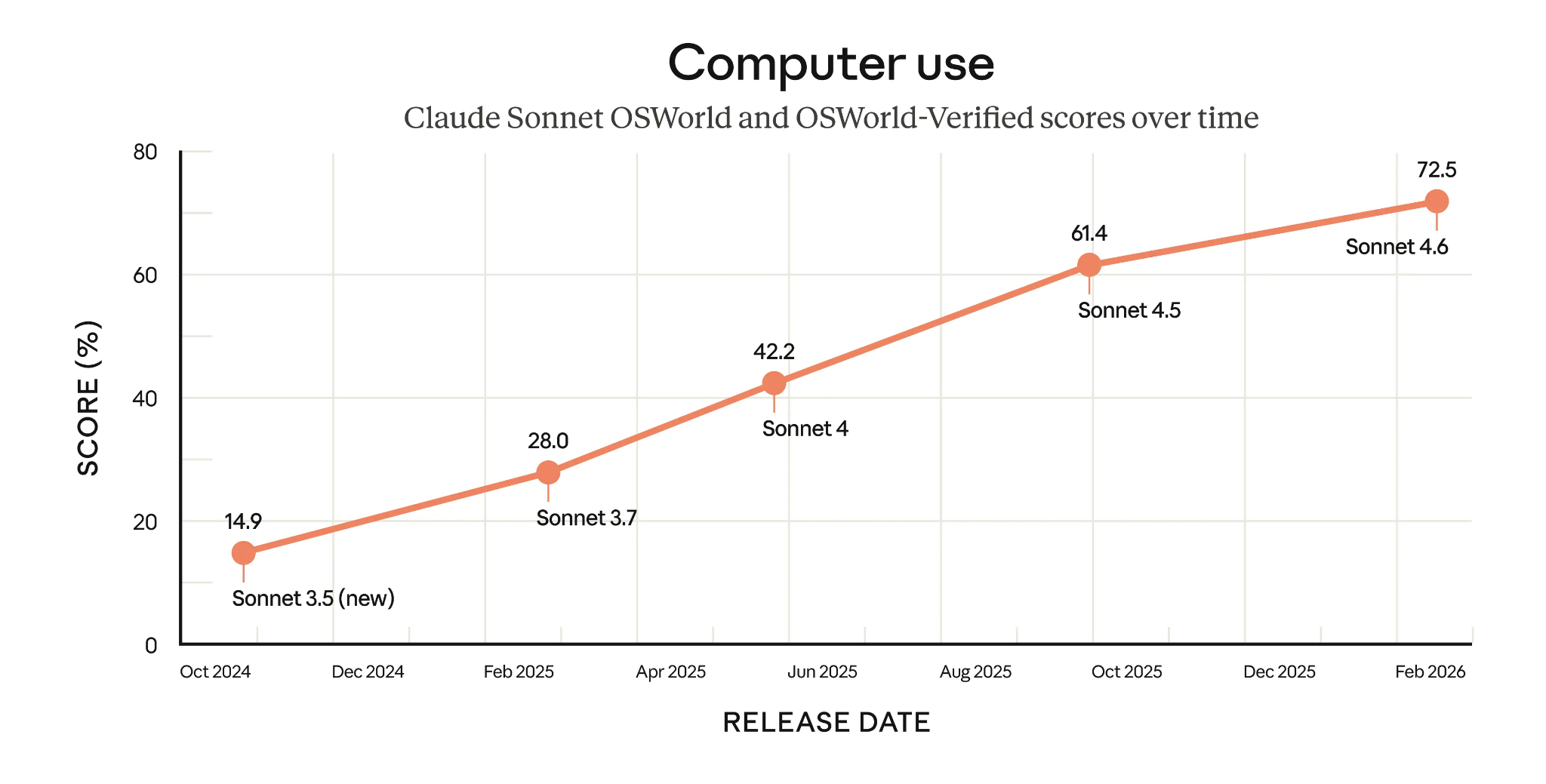

Un exemple marquant est l’utilisation agentique de l’ordinateur par Claude Sonnet 4.6, qui obtient un très impressionnant 72,5 % sur OSWorld-Verified. Comme on le voit sur le graphique ci-dessous, la progression des modèles Sonnet est spectaculaire : le score a plus que doublé en moins d’un an.

Scores OSWorld-Verified des modèles Claude Sonnet au fil du temps (Source : Anthropic)

Passons en revue quelques points saillants du nouveau modèle :

Intelligence quasi Opus pour le code et le raisonnement

Claude Sonnet 4.6 bénéficie d’une véritable montée en compétences sur un large éventail de tâches, notamment :

- Code

- Raisonnement à long horizon

- Planification agentique

- Travaux liés aux connaissances

- Design

D’après la note de version, Anthropic a constaté que les bêta-testeurs préféraient utiliser Sonnet 4.6 à Opus 4.5, ancien modèle phare d’Anthropic jusqu’il y a deux semaines à peine, environ 59 % du temps.

Ils ont cité une meilleure exécution des consignes, moins d’hallucinations et une résolution de problèmes en plusieurs étapes plus fiable pour expliquer cette préférence.

Compétences agentiques de pointe avec une sécurité renforcée

Le modèle présente des capacités proches du niveau humain sur de nombreuses tâches logicielles réelles, comme :

- Navigation dans des feuilles de calcul complexes

- Formulaires web multi-étapes

- Flux multi-onglets

Cela se reflète notamment dans l’excellent score OSWorld-Verified et dans certains benchmarks métier que nous aborderons plus loin.

La sécurité a également fait l’objet d’un fort investissement, point crucial avec la montée de l’IA agentique. Anthropic affirme que Claude Sonnet 4.6 résiste nettement mieux aux prompt injections que Sonnet 4.5 et se situe au niveau d’Opus 4.6 sur ce volet.

Planification à long horizon

La promesse la plus accrocheuse concerne sans doute la fenêtre de contexte étendue, qui atteint désormais 1 million de tokens. Sonnet 4.6 peut ainsi ingérer en une seule requête de très larges bases de code, des contrats volumineux ou d’importants corpus de recherche, puis raisonner efficacement à cette échelle. Cette fenêtre de contexte le place au niveau de Gemini 3 de Google.

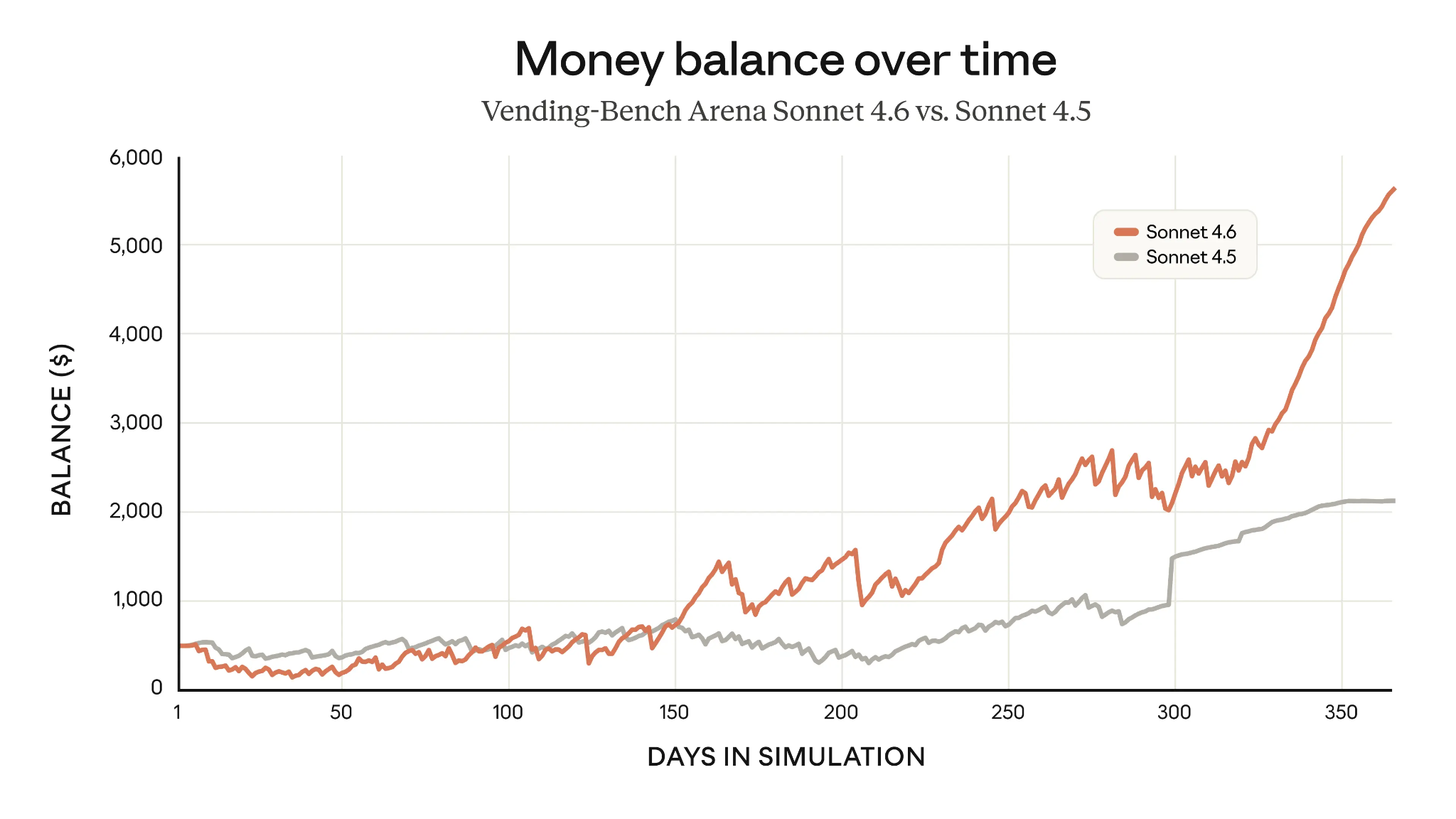

Un exemple d’amélioration de la planification à long terme est Vending-Bench Arena, qui évalue la capacité d’un modèle à faire tourner une entreprise simulée dans la durée, avec un volet compétitif entre modèles. En investissant lourdement dans l’infrastructure au démarrage, puis en capitalisant ensuite, Sonnet 4.6 a quasiment triplé les gains moyens de Sonnet 4.5 après un an.

Scores Vending-Bench de Claude Sonnet 4.6 vs Sonnet 4.5 (Source : Anthropic)

Améliorations avancées des workflows

Sur la plateforme Claude et via l’API, Sonnet 4.6 généralise des fonctions jusqu’ici réservées aux modèles Opus ou aux offres payantes.

Raisonnement adaptatif

Fonction introduite avec Claude Opus 4.6, le raisonnement adaptatif permet à Claude de décider automatiquement quand et combien raisonner avant de répondre. Dans l’API, on l’active via thinking: {type: “adaptive”}. Il est intégré par défaut pour Sonnet 4.6 et Opus 4.6 dans l’interface web.

Connecteurs

Les connecteurs proposent des intégrations basées sur le protocole MCP, donnant un accès direct à des applications externes comme Google Workspace et Slack. Ainsi, Sonnet 4.6 peut récupérer et exploiter des données en temps réel issues de ces outils au sein des conversations. Initialement réservés aux offres payantes, les connecteurs deviennent accessibles aux utilisateurs gratuits avec Sonnet 4.6 comme nouveau modèle par défaut.

Mettre Claude Sonnet 4.6 à l’épreuve

J’ai voulu évaluer Claude Sonnet 4.6 sur les mêmes tâches que dans notre guide sur Claude Opus 4.6 pour comparer directement les deux. Les tests visent des tâches en plusieurs étapes et sollicitent le raisonnement mathématique et lié au code.

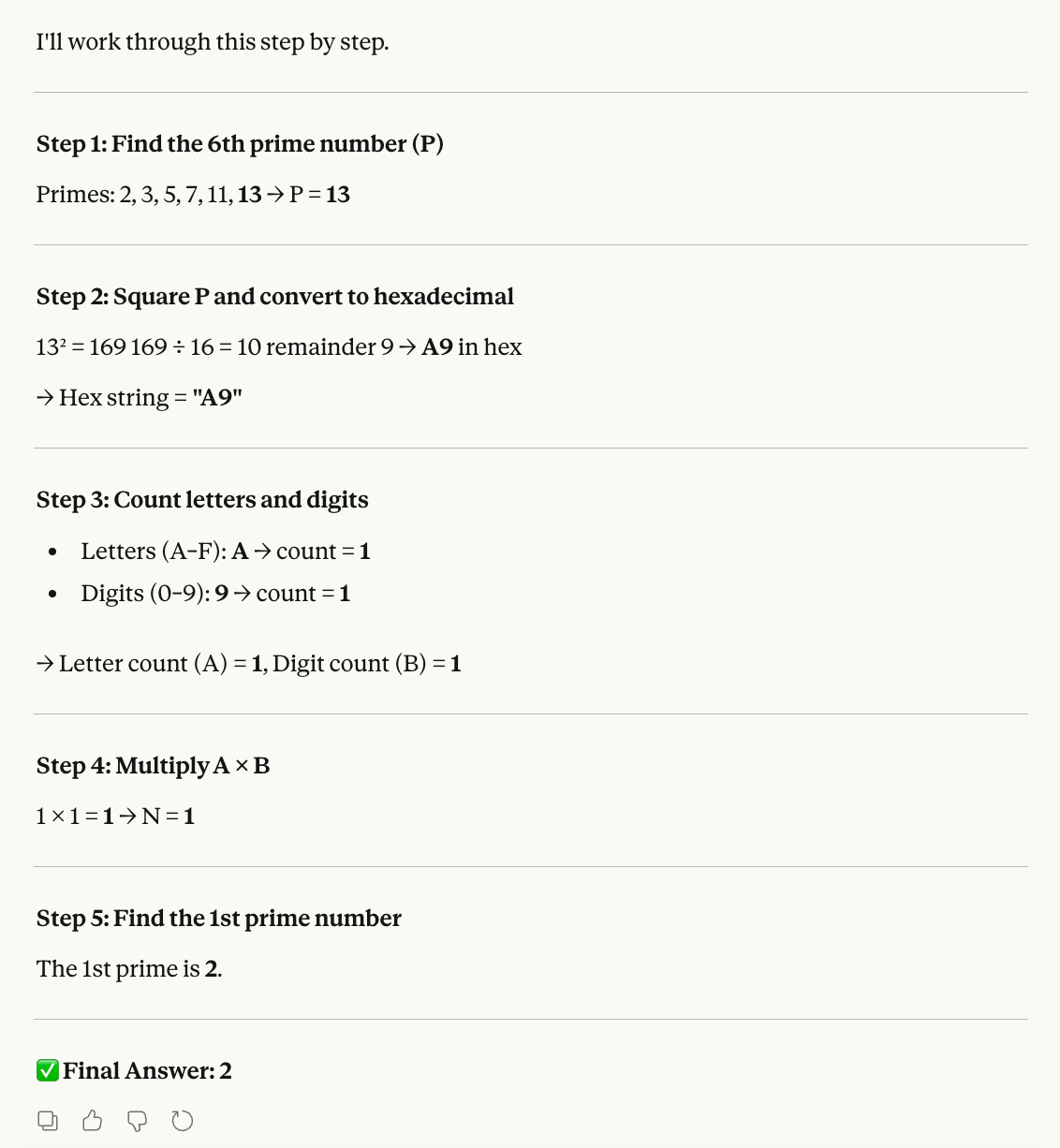

Test 1 : énigme logique hexadécimal-vers-décimal

Le premier test cible les compétences mathématiques :

Step 1: Find the 6th prime number. Let this be P.

Step 2: Convert the square of P into hexadecimal.

Step 3: Count the letters (A–F) and digits (0–9) in that hex string. Let these be A and B.

Step 4: Multiply A × B. Let this be N.

Step 5: Find the Nth prime number.Calculons nous-mêmes pour vérifier le résultat :

- Le 6e nombre premier est 13.

- 13 au carré fait 169.

- 169 vaut A9 en hexadécimal, avec 1 lettre et 1 chiffre.

- 1 × 1 = 1.

- Le premier nombre premier est 2.

L’idée de ce test est de piéger le modèle avec des consignes impliquant différentes logiques de comptage et de formats numériques. Comme Opus 4.6, Sonnet 4.6 réussit chaque étape et aboutit à la bonne conclusion :

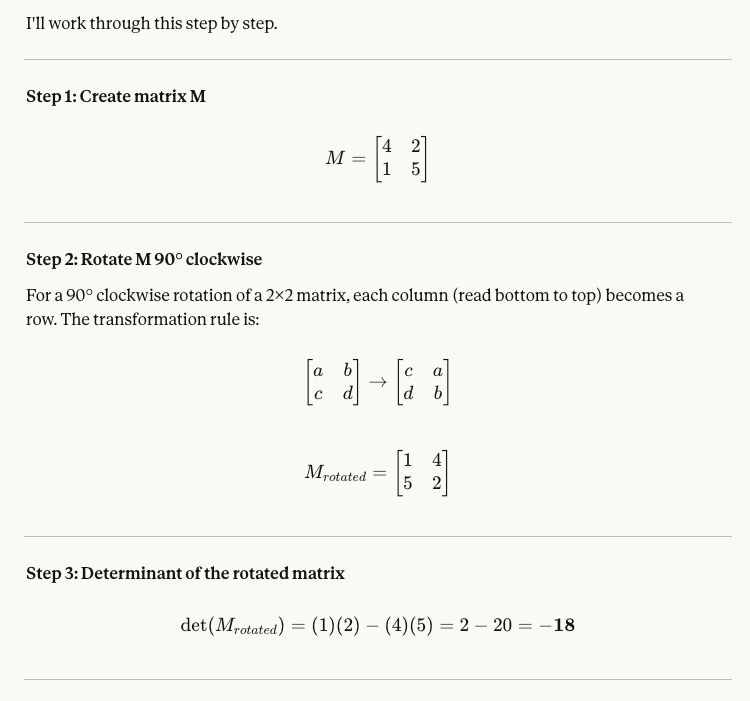

Test 2 : rotation d’une matrice

Le test suivant cible le raisonnement spatial, traditionnel point faible de nombreux LLM :

Step 1: Create a 2×2 matrix M with top row [4, 2] and bottom row [1, 5].

Step 2: Rotate M 90 degrees clockwise.

Step 3: Calculate the determinant of the rotated matrix.

Step 4: Cube that determinant.

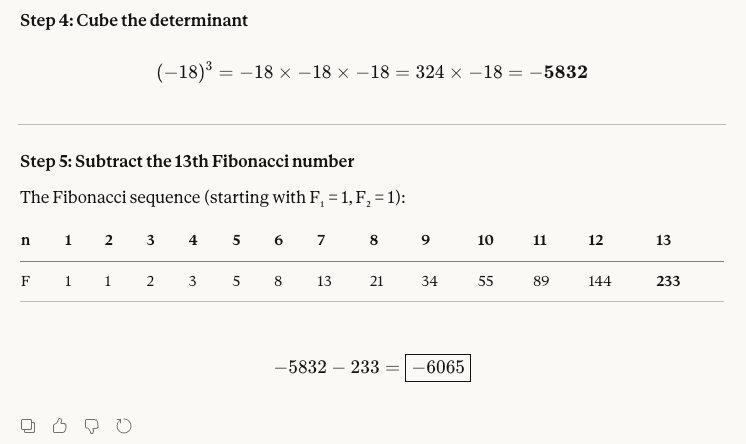

Step 5: Subtract the 13th Fibonacci number from the result.La réponse correcte est -6 065 :

- La matrice initiale est [[4, 2], [1, 5]].

- La matrice après rotation est [[1, 4], [5, 2]].

- Le déterminant est la différence des produits diagonaux, soit ici -18.

- Le cube de -18 vaut -5 832.

- -5 832 - 233 = -6 065.

Sonnet 4.6 ne rencontre aucune difficulté : il comprend le contexte spatial de la matrice et la fait pivoter correctement, et la gestion des nombres négatifs ne lui pose pas de problème non plus :

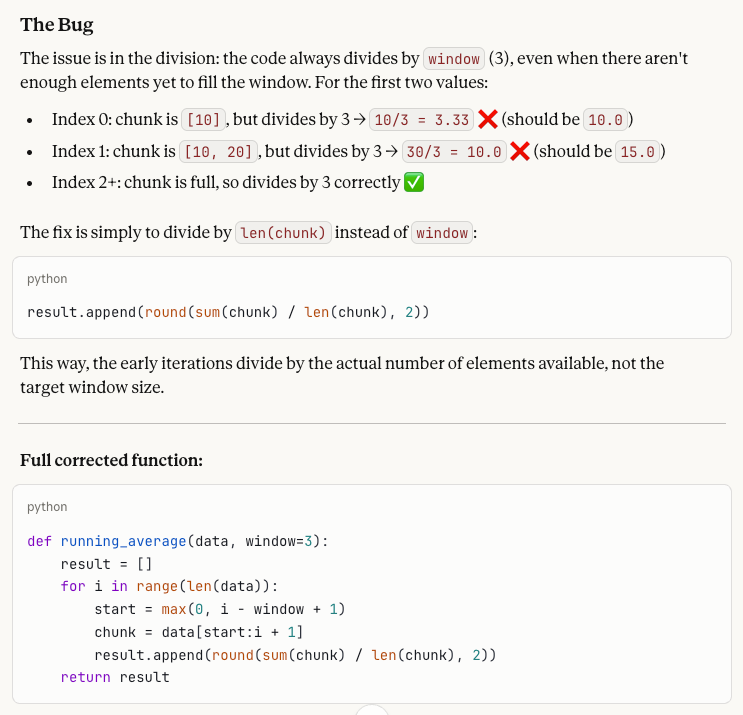

Test 3 : débogage de code

Terminons par le débogage, l’un des points forts annoncés de Sonnet 4.6. Le test vérifie jusqu’à quel point le modèle tient compte du contexte face à un bug précis.

A developer wrote this Python function to compute a running average:

def running_average(data, window=3):

result = []

for i in range(len(data)):

start = max(0, i - window + 1)

chunk = data[start:i + 1]

result.append(round(sum(chunk) / window, 2))

return result

When called with running_average([10, 20, 30, 40, 50]), the first two values in the output seem wrong. Why? Please help me fix what is wrong!Le problème, c’est que la fonction divise toujours par window (3), même lorsque le début de la liste ne contient pas encore 3 éléments. La sortie du code bogué est [3.33, 10.0, 20.0, 30.0, 40.0], mais les deux premières valeurs devraient être 10,0 et 15,0, car ces segments ne comptent respectivement que 1 et 2 éléments et doivent être divisés par ces nombres. La correction consiste donc à diviser par len(chunk) au lieu de window.

Ce test est intéressant car il vise un angle mort fréquent des LLM : ils exécutent souvent la boucle correctement mais jugent la sortie correcte. Ils voient les calculs s’enchaîner sans erreur, sans considérer ce que la fonction devrait faire. Seul un lien entre la finalité de la fonction et son exécution permet de repérer le bug.

Là encore, le modèle réussit le test. Bien sûr, il ne s’agit que d’un échantillon très limité de tests possibles, mais sur ces exemples, Sonnet 4.6 est au niveau d’Opus 4.6.

Benchmarks de Claude Sonnet 4.6

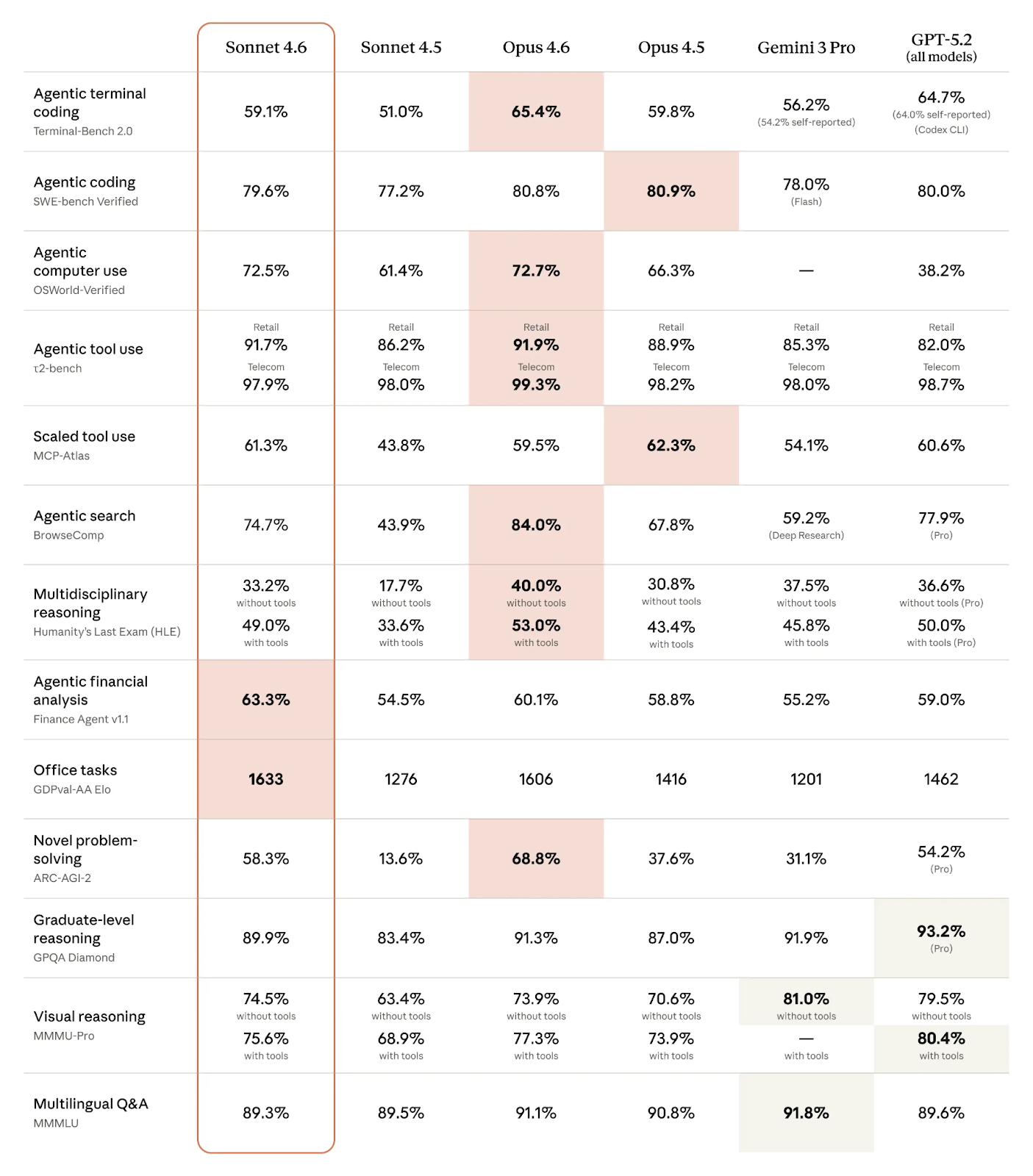

Avec la fréquence à laquelle de nouveaux modèles arrivent en ce moment, on est habitué à voir bouger les têtes de classement des benchmarks. Malgré tout, les premiers résultats de Claude Sonnet 4.6 sur plusieurs benchmarks LLM impressionnent, d’autant plus qu’il ne s’agit pas du modèle phare d’Anthropic.

Scores de benchmarks de Claude Sonnet 4.6 et de ses concurrents (Source : Anthropic)

Comme on le voit dans le tableau, Claude Sonnet 4.6 s’illustre sur les benchmarks agentiques :

- Utilisation agentique de l’ordinateur : Avec 72,5 % sur OSWorld-Verified, il prend la 2e place, de très peu derrière Claude Opus 4.6 (72,7 %), tout en devancçant nettement le nouveau modèle phare d’OpenAI GPT-5.3 Codex (64,7 %).

- Code agentique : Claude Sonnet 4.6 atteint 79,6 % sur SWE-bench verified. Les modèles Claude récents et la concurrence sont globalement au coude-à-coude autour de 80 %.

- Code agentique en terminal : Amélioration notable par rapport à Sonnet 4.5 (59,1 % contre 51 % sur Terminal-Bench 2.0), mais un peu derrière Opus 4.6 (65,4 %) et assez loin de GPT-5.3 Codex (75,1 %).

Point marquant : Anthropic semble prendre l’avantage sur des tâches agentiques spécifiques par domaine :

- Analyse financière agentique : Claude Sonnet 4.6 prend la tête avec 63,3 % sur Finance Agent v1.1, devant même Opus 4.6 (60,1 %).

- Tâches bureautiques : Autre benchmark où Sonnet 4.6 arrive premier, avec un Elo de 1633 sur GDPval-AA, là encore devant Opus 4.6 (1606).

Comment accéder à Claude Sonnet 4.6

Vous pouvez utiliser Claude Sonnet 4.6 dès maintenant via plusieurs canaux. Voici comment y accéder :

Accès via chat

Sonnet 4.6 est disponible via l’interface web Claude.ai, ses applications iOS et Android, ainsi que l’application de bureau macOS avec Claude Cowork.

Sur toutes ces plateformes, c’est le nouveau modèle par défaut, y compris pour l’offre gratuite. La création de fichiers, les connecteurs, les skills et la compaction de contexte sont donc accessibles à tous.

Accès API

Les développeurs peuvent utiliser Claude Sonnet 4.6 via l’API Anthropic avec l’ID de modèle claude-sonnet-4-6. La tarification reste identique à celle de son prédécesseur : 3 $ le million de tokens en entrée, 15 $ le million de tokens en sortie.

Pour des déploiements à l’échelle entreprise, Sonnet 4.6 est disponible sur de nombreuses plateformes cloud, comme AWS Bedrock ou Google Vertex AI, avec des tarifs spécifiques.

Outils de développement

Claude Sonnet 4.6 alimente désormais Claude Code et est le modèle par défaut pour les offres Pro et Team, tandis que les niveaux supérieurs utilisent par défaut Opus 4.6. Pour voir des exemples de projets à réaliser avec, consultez nos tutoriels sur les hooks Claude Code et la création de plugins pour Claude Code.

En outre, Sonnet 4.6 peut également s’utiliser avec des IDE et autres assistants de code, tels que Cursor ou Roo Code.

Claude Sonnet 4.6 vs Opus 4.6

Dans de nombreux domaines, l’écart entre Sonnet 4.6 et Opus 4.6 est si faible qu’on peut parler d’ex aequo. C’est particulièrement vrai pour les tâches agentiques comme le code agentique, l’utilisation de l’ordinateur et l’usage d’outils. Sonnet 4.6 surpasse même Opus 4.6 sur l’analyse financière agentique, les tâches bureautiques et l’usage d’outils à grande échelle.

Sans surprise, Opus 4.6 brille sur les tâches impliquant un raisonnement intensif ou de la créativité, comme la résolution de problèmes inédits et le raisonnement pluridisciplinaire. Côté agentique, Opus 4.6 est meilleur en code terminal agentique et en recherche agentique.

Choisir le bon modèle Claude

Pour la plupart des tâches de code et agentiques, et lorsque le suivi des consignes est clé, Claude Sonnet 4.6 est le meilleur choix : des performances pratiquement identiques pour un coût nettement inférieur. Il a en outre un avantage de vitesse.

Les équipes qui ont besoin d’un raisonnement expert ou de workflows multi-agents opteront plutôt pour Claude Opus 4.6. Pour la recherche, les migrations complexes ou les missions critiques, Opus 4.6 excelle.

Conclusion

Avec Claude Sonnet 4.5, Anthropic continue de mettre l’accent sur le code, les agents et l’utilisation de l’ordinateur. Au-delà d’un bond de performances par rapport à son prédécesseur, il généralise des fonctions comme les connecteurs et le raisonnement adaptatif, y compris dans l’offre gratuite.

Les premières impressions et les benchmarks sont très positifs, et cela ressemble à un changement de dimension : on obtient des performances proches d’Opus sans le prix fort. Pour beaucoup de workflows quotidiens, il est même difficile de justifier l’usage du modèle phare d’Anthropic. Cela dit, pour les tâches qui exigent un raisonnement poussé, Claude Opus 4.6 reste le meilleur choix.

Reste à voir combien de temps Claude Sonnet 4.6 pourra rester en tête des classements et comment les concurrents d’Anthropic répondront à cette sortie.

Nous avons évoqué les tâches agentiques tout au long de l’article. Si vous souhaitez en savoir plus sur l’usage de modèles comme Claude Sonnet 4.6 dans ce type de workflow, je vous recommande notre parcours de compétences AI Agent Fundamentals.

Claude Sonnet 4.6 : FAQ

Qu’est-ce que Claude Sonnet 4.6 ?

Claude Sonnet 4.6 est le dernier modèle d’IA de milieu de gamme d’Anthropic, lancé le 15 février 2026. Il apporte des améliorations en code, utilisation de l’ordinateur, raisonnement sur long contexte, planification agentique, travaux de connaissance et design. Son principal atout : des performances proches d’Opus 4.6 à moindre coût, idéal pour un usage quotidien, des workflows de production et des tâches complexes.

Quelles sont les principales nouveautés de Claude Sonnet 4.6 ?

Claude Sonnet 4.6 inclut une fenêtre de contexte d’1 million de tokens, un raisonnement adaptatif pour s’adapter dynamiquement et une compaction du contexte pour étendre la longueur de contexte effective. Il prend en charge une utilisation avancée de l’ordinateur pour des tâches comme la navigation dans des feuilles de calcul ou des formulaires web sans API, et une meilleure intégration d’outils comme la recherche web avec exécution de code.

Quelles performances pour le code et les benchmarks ?

Les utilisateurs préfèrent Sonnet 4.6 à Sonnet 4.5 dans 70 % des cas et à Opus 4.5 dans 59 % des cas dans Claude Code, grâce à une meilleure exécution des consignes, moins d’hallucinations et des performances stables sur des tâches multi-étapes. Il excelle sur de nombreux benchmarks liés aux agents, comme OSWorld (72,5 %) et SWE-bench Verified (79,6 %), et prend la première place sur les tâches bureautiques agentiques.

Comment accéder à Claude Sonnet 4.6 ?

Claude Sonnet 4.6 est désormais disponible sur tous les forfaits Claude (par défaut dans l’offre gratuite), sur Claude.ai, Claude Cowork, Claude Code, via l’API Anthropic (sous l’ID claude-sonnet-4-6), et sur des plateformes comme Amazon Bedrock et GitHub Copilot. La tarification est identique à Sonnet 4.5 : 3 $ en entrée / 15 $ en sortie par million de tokens.

Quand utiliser Claude Sonnet 4.6 plutôt qu’Opus 4.6 ?

Utilisez Claude Sonnet 4.6 pour la plupart des workflows quotidiens de code et d’automatisation : il est presque aussi capable que Claude Opus 4.6, mais plus rapide et bien moins cher. Privilégiez Opus 4.6 lorsque vous avez besoin d’un raisonnement expert critique (91,3 % sur GPQA), de recherche dans de longs contextes ou de workflows multi-agents complexes où la profondeur justifie le surcoût.

Rédacteur en chef Data Science chez DataCamp | Je suis passionné par la prévision et le développement à l'aide d'API.